物体判別方法

【課題】判別基準を判別対象ごとに個別に考える必要がなく、またカメラの設置位置や設置角度に対する自由度の大きい物体判別方法を提供する。

【解決手段】ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成し、判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、視差画像における面の折れ目の位置とその折れ目の方向をその判別対象物の特徴情報として抽出し、抽出した特徴情報に基づいて、判別対象物の種類を判別する。

【解決手段】ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成し、判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、視差画像における面の折れ目の位置とその折れ目の方向をその判別対象物の特徴情報として抽出し、抽出した特徴情報に基づいて、判別対象物の種類を判別する。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、ステレオカメラで撮影した画像内の物体の種類を判別する物体判別方法に関する。

【背景技術】

【0002】

ステレオカメラで撮影すると、撮影された物体までの距離を視差に基づいて認識することができる。この視差を利用した物体の判別方法には、たとえば、エレベータ乗り場の天井に、下方を撮影する2台のカメラを設置し、乗り場で待っている乗客の高さを検出し、該検出した乗客の高さと、2台のうちの1台が上から撮影した乗客の形状、大きさとから、乗客が車椅子に乗っているか、幼児であるか、通常の成人であるかなどを判別してエレベータの運転モードを切り替える技術がある(たとえば、特許文献1参照)。

【0003】

また、特許文献2に開示の技術では、エレベータ乗り場を複数のカメラで撮影し、主たるカメラの画像内の輝度勾配に基づいて物体のエッジを検出し、ステレオカメラから得られる視差が滑らかに繋がるようにエッジを連結させて物体の輪郭を定める。そして、輪郭の最高点の高さにより、その輪郭に対応する人物が、立っている人か否かを判定する。また、輪郭の最高点の高さが低い場合は、輪郭下部の形状の変化を時系列に追跡することで、歩行者の足の動きに相当する形状変化の有無を識別して、車椅子か歩行者かを判別するようになっている。

【0004】

特許文献3には、単眼カメラの画像に対して、画像内の各地点における輝度の勾配方向および勾配強度を算出し、これを小領域毎にヒストグラム(度数分布)化した勾配方向ヒストグラム(HOG:Histograms of Oriented Gradients)を生成し、これを既知の特定の物体に関する勾配方向ヒストグラムと比較する等により、未知の特定の物体を検出する技術が開示されている。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開平11−268879号公報

【特許文献2】特表2005−535016号公報

【特許文献3】特開2010−67102号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

従来の方法では、判別対象の物体毎に異なる判別基準を人が主観的に設定する必要があった。たとえば、車椅子を判別するには、人が主観的に捉えた車椅子の特徴(たとえば、高さが低い、下部に車輪があるなど)を判別基準に設定し、歩行者を判別するには、人が主観的に捉えた歩行者の特徴(たとえば、高さが一定以上ある、歩行時は足が動くなど)を判別基準に設定しなければならず、判別基準の設定に手間を要する。また、人が主観的に設定する判別基準の適/不適によって判別精度が影響を受ける。

【0007】

また、従来の判別方法は、カメラの撮影位置や撮影方向に関する制約が厳しく、この制約に従ってカメラを設置できない場合は、的確な判別は望めなかった。たとえば、特許文献2のように歩行者の足の動きを捉えて判別するには、判別対象物をある程度横から撮影するようにカメラを設置する必要があった。同様に、特許文献3のように勾配方向ヒストグラムを比較する方法においても、比較基準である既知の勾配方向ヒストグラムを取得した際のカメラの撮影位置・方向と、判別時のカメラの撮影位置・方向とが大きく相違すると、判別精度が大きく低下する、あるいは判別できなくなる、といった問題があった。

【0008】

また特許文献2、3のように、輝度勾配などから輪郭を検出して物体を判別する方法では、似通った輪郭を持つ物体(たとえば、正面側から見た起立者と着座者)の判別は難しい。

【0009】

本発明は、上記の問題を解決しようとするものであり、判別基準を判別対象ごとに個別に人が考える必要がなく、またカメラの設置位置や設置角度に対する自由度の大きい物体判別方法を提供することを目的としている。

【課題を解決するための手段】

【0010】

かかる目的を達成するための本発明の要旨とするところは、次の各項の発明に存する。

【0011】

[1]ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成するステップと、

前記判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、前記視差画像における面の折れ目の位置とその折れ目の方向を前記判別対象物の特徴情報として抽出するステップと、

前記抽出した特徴情報に基づいて、前記判別対象物の種類を判別するステップと、

を有する

ことを特徴とする物体判別方法。

【0012】

上記発明では、ステレオカメラで撮影した左右の画像から視差画像を作成する。この視差画像に基づき、カメラから画像上の各地点までの距離を認識できるので、各地点における面の勾配を、その周囲の地点の位置関係から求める。さらに、面の勾配の連なり状況から、面の折れ目の位置とその折れ目の方向をその判別対象物の特徴情報として抽出する。すなわち、周囲(前後、左右)で面の勾配が大きく変化する地点には面の折れ目が存在し、その折れ目の方向も周囲の面の勾配の状況(連なり状況)から認識することができる。そして、面の折れ目の方向や折れ目の存在する位置の傾向を表した特徴情報に基づいて、判別対象物の種類を判別する。判別対象物をステレオカメラで撮影する方向や距離がある程度変化しても、面の折れ目の方向や折れ目の位置の特徴量はあまり変化しない。これにより、たとえば、既知の物体の面の折れ目の方向や折れ目の位置をその物体の特徴量として学習し、この学習結果と比較して未知の物体の種類を判別する場合に、学習時点と判別時点とでカメラの設置場所を厳格に一致させる必要がなくなり、設置位置の自由度が確保される。

【0013】

[2]前記特徴情報として、さらに前記折れ目の強度を求める

ことを特徴とする[1]に記載の物体判別方法。

【0014】

上記発明では、物体の特徴量を、面の折れ目の方向とその折れ目の強度とによって表す。強度を加味することで、判別精度が高まる。

【0015】

[3]前記折れ目を尾根と谷に区別して前記特徴情報を抽出する

ことを特徴とする[1]または[2]に記載の物体判別方法。

【0016】

上記発明では、折れ目が尾根(凸)か谷(凹)かを区別することで、さらに判別精度を高めることができる。

【0017】

[4]前記視差画像内の注目画素を中心に対称な位置にある隣接画素間における画素値の逆数の差を、前記注目画素の地点における前記隣接画素間を結ぶ方向の勾配として求める

ことを特徴とする[1]乃至[3]のいずれか1項に記載の物体判別方法。

【0018】

上記発明では、画素値の逆数の差を勾配とする。実空間におけるカメラから対象物までの距離が大きくなるほどステレオカメラから得られる視差値の分解能は低下するので、これを補償し、同じ物体の面について求めた勾配がカメラからの距離によって変動することを防止する。

【0019】

[5]前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度で重み付けした折れ目の方向の度数分布を算出し、前記折れ目画像に属するすべての小領域の度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする[2]に記載の物体判別方法。

【0020】

[6]前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度と折れ目の方向をそれぞれ変量とする2次元の度数分布を算出し、前記折れ目画像に属するすべての小領域の前記度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする[2]または[3]に記載の物体判別方法。

【0021】

[7]前記抽出するステップが処理する前記判定対象物の視差画像は、前記判別対象物の部分を矩形に切り出した画像であって、その画像サイズが所定サイズになるように正規化されたものである

ことを特徴とする[1]乃至[6]のいずれか1項に記載の物体判別方法。

【0022】

上記発明では、同一の判定対象物であっても、ステレオカメラから判定対象物までの実空間での距離によって画像上のサイズが変動するので、これを解消するために、画像サイズを正規化する。

【0023】

[8]種類が既知の物体に関する前記特徴情報を学習し、前記学習した特徴情報に基づいて、未知の判別対象物の種類を判別する

ことを特徴とする[1]乃至[7]のいずれか1項に記載の物体判別方法。

【0024】

上記発明では、人が主観的に判別基準を設定する必要がなく、判別基準を設定する手間が軽減される。また、客観的な判別基準で判別することができる。

【発明の効果】

【0025】

本発明に係る物体判別方法によれば、判別基準を判別対象ごとに個別に考える必要がない。また、カメラの設置位置や設置角度に対する自由度が大きいので、各種の設置環境に対応することができる。

【図面の簡単な説明】

【0026】

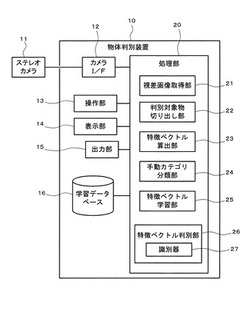

【図1】本発明の物体判別方法を適用した物体判別装置の概略構成を示すブロック図である。

【図2】物体判別装置の学習モードの処理を示す流れ図である。

【図3】物体判別装置の判別モードの処理を示す流れ図である。

【図4】ステレオカメラの設置例を示す図である。

【図5】判別対象物の部分を切り出した矩形領域の視差画像(同図(a))と、そのサイズを正規化した視差画像(同図(b))と、図5(a)の視差画像に対する領域のカラー画像を示す図である。

【図6】折れ目方向特徴抽出処理を示す流れ図である。

【図7】折れ目画像作成処理を示す流れ図である。

【図8】小領域(セル)と、ヒストグラムと、ヒストグラムの連結を示す図である。

【図9】二次元ヒストグラムの一例(尾根・谷区別なし)を示す図である。

【図10】二次元ヒストグラムの他の例(尾根・谷を区別)を示す図である。

【図11】二次元ヒストグラムを走査して1次元の特徴ベクトルに変換する際の走査順序の例を示す図である。

【図12】カメラの見下ろし角によって画像上の物体の面の勾配や形状が変動するのに対して、折れ目の方向の変化が少ないことを例示する図である。

【発明を実施するための形態】

【0027】

以下、図面に基づき本発明の各種実施の形態を説明する。

【0028】

図1は、本発明に係る物体判別方法を適用した物体判別装置10の概略構成図である。物体判別装置10には、ステレオカメラ11が接続される。ステレオカメラ11は、光軸を並行に揃えた左右2台のカメラで構成される。ステレオカメラ11で撮影して得られる左右2枚の画像内での各物体の位置の違い(視差)に基づいて、カメラからその物体までの距離を三角測量により導出することができる。

【0029】

物体判別装置10は、ステレオカメラ11が接続されるカメラI/F12と、処理部20と、設定操作などを受け付ける操作部13と、処理対象の画像や設定入力画面、判別結果などを表示する表示部14と、判別結果などを外部装置へ出力する出力部15と、学習したデータを記憶する学習データベース16などを備えて構成される。

【0030】

処理部20は、CPU(Central Processing Unit)、ROM(Read Only Memory)、RAM(Random Access Memory)などを主要部として構成される。表示部14は液晶ディスプレイなどで構成される。操作部13はスイッチ、キーボード、マウスなどのポインティングデバイス、表示部14の画面上に設けられたタッチパネルなどで構成される。

【0031】

処理部20は、カメラI/F12を通じてステレオカメラ11から入力される左右一対のカメラ画像から視差画像を生成する視差画像取得部21と、視差画像取得部21から出力された視差画像から判別対象物を検出し、対応する画像部分を矩形に切り出す判別対象物切り出し部22と、判別対象物切り出し部22から出力された視差画像(これを、切り出し視差画像とする)から、判別対象物の特徴を表した特徴ベクトルを算出する特徴ベクトル算出部23と、特徴ベクトル算出部23から出力された特徴ベクトルに対応する物体の種類の設定を操作部13等を通じてユーザから受け付け、特徴ベクトルを物体の種類(クラス)別に分類して学習データベース16に登録する手動カテゴリ分類部24と、学習データベース16に登録されている物体の種類別の多数の特徴ベクトルをパターン識別手法等により学習し、特徴空間上で物体の種類(クラス)を分別する識別器27の識別条件を算出する特徴ベクトル学習部25と、特徴ベクトル学習部25で算出した識別条件が設定された識別器27を用いて未知の特徴ベクトルがどのクラスに属するかを判別する特徴ベクトル判別部26としての機能を果たす。

【0032】

物体判別装置10は、動作モードとして学習モードと判別モードを備えている。図2は、学習モードで物体判別装置10が行う処理の流れを示している。図3は、判別モードで物体判別装置10が行う処理の流れを示している。

【0033】

学習モードでは、ステレオカメラ11から入力される左右一対の画像から視差画像を視差画像取得部21が生成する(ステップS101)。判別対象物切り出し部22はこの視差画像から判別対象物を検出し、その画像部分を切り出した、切り出し視差画像を出力する(ステップS102)。次に、切り出し視差画像内の判別対象物の特徴を表した特徴ベクトルを特徴ベクトル算出部23が導出する(ステップS103)。手動カテゴリ分類部24は、特徴ベクトル算出部23が出力した特徴ベクトルに対応する物体の種類の設定をユーザから受け付け、該特徴ベクトルを、設定された物体の種類と関連付けして学習データベース16に登録する(ステップS104)。

【0034】

このようにして多数の特徴ベクトルが学習データベース16に登録された状態でユーザから識別条件の設定指示を受けると、物体判別装置10の特徴ベクトル学習部25は、学習データベース16に記憶されている物体の種類別の特徴ベクトルをパターン識別手法により学習し、特徴空間上で物体の種類(クラス)を分割する識別器27に対して設定する識別条件を算出し、これを識別器27に設定する(ステップS105)。

【0035】

判別モードは、学習モードにて算出された識別条件が識別器27に設定された状態で実行される。図3に示す判別モードのステップS201からS203の動作は、学習モードのステップS101からS103と同一である。判別モードでは、ステップS203で特徴ベクトルを求めた後、その特徴ベクトルを識別器27に入力し、該特徴ベクトルがどのクラスに属するかを特徴ベクトル判別部26にて判別し、その判別結果を出力部15へ出力する(ステップS204)。

【0036】

次に、上記各ステップでの処理内容を詳細に説明する。

【0037】

ステレオカメラ11は、判別対象となる物体が現れることが予測される場所を撮像できる位置に設置される。たとえば、図4は、判別対象の物体を歩行者や車椅子とし、これらが通行する交差点の脇に立つ支柱の上にステレオカメラ11を取り付け、該交差点を斜め上から見下ろすようにステレオカメラ11で撮影する場合の設置例を示している。

【0038】

視差画像取得部21は、判別対象となる物体を撮影可能な位置に設置されたステレオカメラ11から取り込まれた左右一対の画像から視差画像を生成・取得する(ステップS101、S201)。

【0039】

視差画像中のある一画素には、対応する左画像(もしくは右画像)中のある地点を映す画素の横座標値と右画像(もしくは左画像)中の同一地点を映す画素の横座標値との差分値が格納される。

【0040】

判別対象物切り出し部22は、視差画像取得部21の出力する視差画像を取り込み、たとえば、背景差分手法を用いて、判別対象となる物体領域を包含する視差画像上の矩形領域を切り出す(ステップS102、S202)。

【0041】

このとき、矩形領域に含まれる、物体領域以外の画素には無効をあらわす固定のマスク画素値が入れられる。また、切り出した矩形領域の幅・高さは切り出し対象の実寸およびカメラからその対象までの実距離によって様々に変動するので、これを、予め設定した幅w、高さhになるよう正規化する。図5(a)は、切り出した矩形領域の視差画像を、図5(b)は、図5(a)の視差画像を、幅w、高さhに正規化した視差画像の一例である。なお、図5(c)には、ステレオカメラ11で撮影した左右の画像の一方の画像であって図5(a)の視差画像に対する領域の画像を参考に示した。

【0042】

次に、特徴ベクトル算出部23は、正規化された切り出し視差画像(入力視差画像とする)を判別対象物切り出し部22から入力し、この入力視差画像から折れ目方向の特徴ベクトルを抽出する折れ目方向特徴抽出処理を行う(ステップS103、S203)。

【0043】

図6は、折れ目方向特徴抽出処理の概要を示している。折れ目方向特徴抽出処理は、折れ目方向画像作成処理(ステップS301)と、分割エリアヒストグラム作成処理(ステップS302)と、分割エリアヒストグラム連結処理(ステップS303)とから構成される。

【0044】

折れ目方向画像作成処理(ステップS301)では、まず、入力視差画像Iの各画素の視差値I(u,v)から、画素値の逆数(およびステレオカメラのレンズ間距離Lとカメラのレンズ焦点距離c)を基に、u方向、v方向(図5(b)参照)の隣接画素間の視差の差分(=その地点の面の傾き)eu,evを下記の数1に示す式で入力視差画像Iの各画素について計算する。

【0045】

【数1】

【0046】

上記の演算は、ステレオカメラ11から得られる視差値が実空間における対象奥行き距離が大きくなるほど、実距離に対する視差値の分解能が低くなることを考慮した処理である。この処理を行わないと、同一物体であっても、カメラに対する位置(遠近)によって折れ目強度が変動してしまう。なお,実際の計算では特徴ベクトルを作成するときに定数が消去できるため、L,cは予め省略する。

【0047】

eu,evを基に、局所的なノイズを消去するため、半径dの周辺領域から平均をとったfu,fvを下記の数2に示す式で計算する。半径dは任意に設定すればよい。

【0048】

【数2】

【0049】

図7では、太線で囲む3画素×3画素の領域のeu,evの平均を該3画素×3画素の中心画素のfu,fvとする場合を例示している。このようにして入力視差画像Iの各画素についてfu,fvを求めることで、fu,fvを各画素の画素値とする勾配画像を生成する。

【0050】

次に、u方向、v方向の面の傾きを表すfu,fv値を基に、u方向、v方向の面の組み合わせを表すgu,gvを下記の数3に示す式で計算する。

【0051】

【数3】

【0052】

図7ではd=2として、注目画素K(u, v)におけるgu,gvを求める場合を例示している。

【0053】

gu,gvから折れ目方向θを下記の数4に示す式で計算し、また折れ目強度mを下記の数5に示す式で計算する。

【0054】

【数4】

【0055】

【数5】

【0056】

なお、各処理において、注目画素(u, v) を処理する際に、(u,

v),(u + 1, v),(u - 1, v),(u, v + 1),(u, v - 1)のいずれかがマスク画素の場合は処理を行わない。

【0057】

分割エリアヒストグラム作成処理(ステップS302)では、作成した折れ目方向画像を、幅s画素、高さt画素の小領域(セル)に分割する(図8参照)。そして、各小領域(セル)における折れ目方向θのヒストグラムを作成する。ここでは、正対する折れ目方向を無視するために、下記の数6に示す式を用いてθをθ´に修正する。

【0058】

【数6】

【0059】

このθ´を20°毎に量子化し、9個の階級(ビン)を持つヒストグラムとする。ここでは,i行j列の小領域のヒストグラム特徴をFij=[f1,f2,…,f9]と表す。

【0060】

また、算出されたm(折れ目の強度)を重みとしてヒストグラムを算出すると、より判別精度の高い特徴ベクトルが作成可能となる。

さらに、個々の画素における折れ目強度を保持する方法が考えられる。mをθとは別の次元として0から1に正規化した上でθと同数のビンに量子化した2次元ヒストグラムを算出すると、より判別精度の高い特徴ベクトルが作成可能となる(図9参照)。この場合、折れ目が谷(凹)か尾根(凸)かは区別されない。

【0061】

さらに、個々の画素における凹凸と折れ目強度を保持する方法が考えられる。fu(u-d,v),とfv(u+d,v) 、 fu(u,v-d) とfv(u,v+d)の大きさと正負符号の組み合わせにより、mに正負の符号を付けた上で2次元ヒストグラムを算出すると、最も判別精度の高い特徴ベクトルが作成可能となる(図10参照)。

【0062】

分割エリアヒストグラム連結処理(ステップS303)では、ステップS301で作成した小領域(セル)毎のヒストグラムを連結し、特徴ベクトルV=[F11,F12,…,F1q,F21,F22,…Fpq]を算出する(図6)。ここで、p= h/t, q= w/sとする。

【0063】

小領域において2次元ヒストグラムを使用している場合は、たとえば、図11に示すように、2次元ヒストグラム上の任意の一点を始点とし、任意の終点までを重複することなくすべての点を通るように走査して1次元の特徴ベクトルに変換する。分割エリアヒストグラム連結処理では、この1次元特徴ベクトルを連結する。

【0064】

図2に示す学習モードの処理のステップS104では、手動カテゴリ分類部24は、ステップS103で算出された特徴ベクトルに対応する物体の種類(カテゴリ)の手動入力を受け付ける。たとえば、ステップS103で算出された特徴ベクトルに対応する視差画像の元になったステレオカメラ11からの左右一対の画像のうちの一方のカラー画像等を表示部14に表示し、操作部13からその物体の種類の入力操作を受ける。そして、特徴ベクトルと、この特徴ベクトルに対して手動入力された物体の種類(カテゴリ)とを対応付けて学習データベース16に記憶する。すなわち、特徴ベクトルを物体の種類別に分離して学習データベース16に記憶する。

【0065】

図2に示す学習モードの処理のステップS105では、特徴ベクトル学習部25は、特徴ベクトル判別部26に記憶されているカテゴリ分類された多数の特徴ベクトルVを用いて、パターン識別手法による学習・識別器27の作成を行う。例えば、SVM(サポートベクタマシン)による2クラス判別のための学習・分離超平面の作成を行う。SVMとは、線形しきい素子を用いた教師付き学習によるパターン識別手法の一つである。ここでは、高次元の特徴を扱うために、カーネル関数を導入し、非線形判別を行っている。SVMについては、たとえば、下記文献に記載されている。

Nello Cristianini and John Shawe-Taylor, "An Introduction to

Support Vector Machines and other kernel-based learning methods,"

Cambridge University Press, 2000.

【0066】

たとえば、図4に示すようにステレオカメラ11を設置し、その撮影画像内から抽出された物体が歩行者であるか車椅子であるかを判別する場合には、実際に撮影された画像から取得して手動カテゴリ分類部24でその種類を付与した歩行者および車椅子に関する特徴ベクトルを多数収集して学習データベース16に記憶する。そして、学習データベース16に記憶されているこれら歩行者および車椅子に関する多数の特徴ベクトルから、歩行者、車椅子を判別する識別器27を作成する。

【0067】

このようにして判別用の識別器を作成するので、判別基準を人が主観的に設定する必要がなく、判別基準の設定の手間が軽減される。また、実際のカメラ画像から判別基準(識別器)を作成するので、人の主観が入らずに、客観的な判別基準を得ることができる。

【0068】

図3に示す判別モードの処理のステップS204では、特徴ベクトル判別部26は、学習モードのステップS105で作成された識別器を使用してパターン識別手法による対象カテゴリの判別を行う。例えば、SVMによって算出された分離超平面を用いて、未知の入力ベクトルVxが予め学習した2クラス(たとえば、歩行者、車椅子)のどちらに分類されるか判定する。

【0069】

特徴ベクトル判別部26による判別結果は、表示部14に表示される、あるいは出力部15から外部装置へ出力される。

【0070】

次に、折れ目の特徴ベクトルを用いて物体を判別する本発明の特有の効果について説明する。

【0071】

たとえば、図12(a)に示す直方体50を、真上に近い斜め上から見下ろす視点51からステレオカメラ11で撮影した場合、この直方体の手前の側面53は、同図(b)に示すように、斜め下方に大きく傾斜した面55として認識される。一方、水平に近い斜め上の視点52から僅かに見下ろすように撮影した場合、先ほどの側面53は、同図(c)に示すように、斜めに僅かに傾斜した面56として認識される。このように物体の面の勾配や形状を特徴量として物体を判別する場合には、同じ物体でも得られる特徴量(勾配や形状)が視点によって大きく相違するので、学習時のカメラの視点と判別時のカメラの視点との差の許容量は小さい。

【0072】

これに対し、本発明のように、面の折れ目を物体の特徴量とする場合、たとえば、直方体50の上面と手前の側面53との境界をなす折れ目の位置や向きは、視点51から撮影した場合(同図(b)の折れ目57)と視点52から撮影した場合(同図(c)の折れ目58)とで大差ない。このように面の折れ目を物体の特徴量として物体を判別すれば、視点の違いが特徴量の差に現われ難くいので、学習時と判別時とのカメラの視点の差の許容範囲が大きくなる。したがって、交差点など現場の制約からカメラの設置位置(視点)が学習時に対して大きく相違するような場合でも、判別精度を確保することができる。

【0073】

このように本発明の物体判別方法は、学習時と判別時との環境差異の影響を受け難い。この環境差異は、カメラの見下ろし角といった視点に限定されず、たとえば、カメラと判別物体までの距離、照明環境なども含まれる。

【0074】

以上、本発明の実施の形態を図面によって説明してきたが、具体的な構成は実施の形態に例示したものに限られるものではなく、本発明の要旨を逸脱しない範囲における変更や追加があっても本発明に含まれる。

【0075】

実施の形態では、歩行者と車椅子を判別する場合を例示したが、判別対象の物体はこれに限定されるものではない。本発明は、様々な三次元形状を持つ物体のクラス分けに適用することができる。

【0076】

また、識別器としてSVMを利用する例を示したが、面の折れ目の特徴情報に基づいて物体の種類を判別する手法は、任意の手法でよい。

【0077】

実施の形態では、学習機能と判別機能の双方を有する物体判別装置10を例示したが、学習機能を果たす学習装置と判別機能を果たす判別装置とを個別の装置として構成してもよい。この場合、学習装置で作成した識別器の設定内容を判別装置の識別器に設定すればよい。

【符号の説明】

【0078】

10…物体判別装置

11…ステレオカメラ

12…カメラI/F

13…操作部

14…表示部

15…出力部

16…学習データベース

20…処理部

21…視差画像取得部

22…判別対象物切り出し部

23…特徴ベクトル算出部

24…手動カテゴリ分類部

25…特徴ベクトル学習部

26…特徴ベクトル判別部

27…識別器

50…直方体

51、52…視点

53…側面

55…視点51から見た側面

56…視点52から見た側面

57、58…折れ目

K…注目画素

【技術分野】

【0001】

本発明は、ステレオカメラで撮影した画像内の物体の種類を判別する物体判別方法に関する。

【背景技術】

【0002】

ステレオカメラで撮影すると、撮影された物体までの距離を視差に基づいて認識することができる。この視差を利用した物体の判別方法には、たとえば、エレベータ乗り場の天井に、下方を撮影する2台のカメラを設置し、乗り場で待っている乗客の高さを検出し、該検出した乗客の高さと、2台のうちの1台が上から撮影した乗客の形状、大きさとから、乗客が車椅子に乗っているか、幼児であるか、通常の成人であるかなどを判別してエレベータの運転モードを切り替える技術がある(たとえば、特許文献1参照)。

【0003】

また、特許文献2に開示の技術では、エレベータ乗り場を複数のカメラで撮影し、主たるカメラの画像内の輝度勾配に基づいて物体のエッジを検出し、ステレオカメラから得られる視差が滑らかに繋がるようにエッジを連結させて物体の輪郭を定める。そして、輪郭の最高点の高さにより、その輪郭に対応する人物が、立っている人か否かを判定する。また、輪郭の最高点の高さが低い場合は、輪郭下部の形状の変化を時系列に追跡することで、歩行者の足の動きに相当する形状変化の有無を識別して、車椅子か歩行者かを判別するようになっている。

【0004】

特許文献3には、単眼カメラの画像に対して、画像内の各地点における輝度の勾配方向および勾配強度を算出し、これを小領域毎にヒストグラム(度数分布)化した勾配方向ヒストグラム(HOG:Histograms of Oriented Gradients)を生成し、これを既知の特定の物体に関する勾配方向ヒストグラムと比較する等により、未知の特定の物体を検出する技術が開示されている。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開平11−268879号公報

【特許文献2】特表2005−535016号公報

【特許文献3】特開2010−67102号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

従来の方法では、判別対象の物体毎に異なる判別基準を人が主観的に設定する必要があった。たとえば、車椅子を判別するには、人が主観的に捉えた車椅子の特徴(たとえば、高さが低い、下部に車輪があるなど)を判別基準に設定し、歩行者を判別するには、人が主観的に捉えた歩行者の特徴(たとえば、高さが一定以上ある、歩行時は足が動くなど)を判別基準に設定しなければならず、判別基準の設定に手間を要する。また、人が主観的に設定する判別基準の適/不適によって判別精度が影響を受ける。

【0007】

また、従来の判別方法は、カメラの撮影位置や撮影方向に関する制約が厳しく、この制約に従ってカメラを設置できない場合は、的確な判別は望めなかった。たとえば、特許文献2のように歩行者の足の動きを捉えて判別するには、判別対象物をある程度横から撮影するようにカメラを設置する必要があった。同様に、特許文献3のように勾配方向ヒストグラムを比較する方法においても、比較基準である既知の勾配方向ヒストグラムを取得した際のカメラの撮影位置・方向と、判別時のカメラの撮影位置・方向とが大きく相違すると、判別精度が大きく低下する、あるいは判別できなくなる、といった問題があった。

【0008】

また特許文献2、3のように、輝度勾配などから輪郭を検出して物体を判別する方法では、似通った輪郭を持つ物体(たとえば、正面側から見た起立者と着座者)の判別は難しい。

【0009】

本発明は、上記の問題を解決しようとするものであり、判別基準を判別対象ごとに個別に人が考える必要がなく、またカメラの設置位置や設置角度に対する自由度の大きい物体判別方法を提供することを目的としている。

【課題を解決するための手段】

【0010】

かかる目的を達成するための本発明の要旨とするところは、次の各項の発明に存する。

【0011】

[1]ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成するステップと、

前記判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、前記視差画像における面の折れ目の位置とその折れ目の方向を前記判別対象物の特徴情報として抽出するステップと、

前記抽出した特徴情報に基づいて、前記判別対象物の種類を判別するステップと、

を有する

ことを特徴とする物体判別方法。

【0012】

上記発明では、ステレオカメラで撮影した左右の画像から視差画像を作成する。この視差画像に基づき、カメラから画像上の各地点までの距離を認識できるので、各地点における面の勾配を、その周囲の地点の位置関係から求める。さらに、面の勾配の連なり状況から、面の折れ目の位置とその折れ目の方向をその判別対象物の特徴情報として抽出する。すなわち、周囲(前後、左右)で面の勾配が大きく変化する地点には面の折れ目が存在し、その折れ目の方向も周囲の面の勾配の状況(連なり状況)から認識することができる。そして、面の折れ目の方向や折れ目の存在する位置の傾向を表した特徴情報に基づいて、判別対象物の種類を判別する。判別対象物をステレオカメラで撮影する方向や距離がある程度変化しても、面の折れ目の方向や折れ目の位置の特徴量はあまり変化しない。これにより、たとえば、既知の物体の面の折れ目の方向や折れ目の位置をその物体の特徴量として学習し、この学習結果と比較して未知の物体の種類を判別する場合に、学習時点と判別時点とでカメラの設置場所を厳格に一致させる必要がなくなり、設置位置の自由度が確保される。

【0013】

[2]前記特徴情報として、さらに前記折れ目の強度を求める

ことを特徴とする[1]に記載の物体判別方法。

【0014】

上記発明では、物体の特徴量を、面の折れ目の方向とその折れ目の強度とによって表す。強度を加味することで、判別精度が高まる。

【0015】

[3]前記折れ目を尾根と谷に区別して前記特徴情報を抽出する

ことを特徴とする[1]または[2]に記載の物体判別方法。

【0016】

上記発明では、折れ目が尾根(凸)か谷(凹)かを区別することで、さらに判別精度を高めることができる。

【0017】

[4]前記視差画像内の注目画素を中心に対称な位置にある隣接画素間における画素値の逆数の差を、前記注目画素の地点における前記隣接画素間を結ぶ方向の勾配として求める

ことを特徴とする[1]乃至[3]のいずれか1項に記載の物体判別方法。

【0018】

上記発明では、画素値の逆数の差を勾配とする。実空間におけるカメラから対象物までの距離が大きくなるほどステレオカメラから得られる視差値の分解能は低下するので、これを補償し、同じ物体の面について求めた勾配がカメラからの距離によって変動することを防止する。

【0019】

[5]前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度で重み付けした折れ目の方向の度数分布を算出し、前記折れ目画像に属するすべての小領域の度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする[2]に記載の物体判別方法。

【0020】

[6]前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度と折れ目の方向をそれぞれ変量とする2次元の度数分布を算出し、前記折れ目画像に属するすべての小領域の前記度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする[2]または[3]に記載の物体判別方法。

【0021】

[7]前記抽出するステップが処理する前記判定対象物の視差画像は、前記判別対象物の部分を矩形に切り出した画像であって、その画像サイズが所定サイズになるように正規化されたものである

ことを特徴とする[1]乃至[6]のいずれか1項に記載の物体判別方法。

【0022】

上記発明では、同一の判定対象物であっても、ステレオカメラから判定対象物までの実空間での距離によって画像上のサイズが変動するので、これを解消するために、画像サイズを正規化する。

【0023】

[8]種類が既知の物体に関する前記特徴情報を学習し、前記学習した特徴情報に基づいて、未知の判別対象物の種類を判別する

ことを特徴とする[1]乃至[7]のいずれか1項に記載の物体判別方法。

【0024】

上記発明では、人が主観的に判別基準を設定する必要がなく、判別基準を設定する手間が軽減される。また、客観的な判別基準で判別することができる。

【発明の効果】

【0025】

本発明に係る物体判別方法によれば、判別基準を判別対象ごとに個別に考える必要がない。また、カメラの設置位置や設置角度に対する自由度が大きいので、各種の設置環境に対応することができる。

【図面の簡単な説明】

【0026】

【図1】本発明の物体判別方法を適用した物体判別装置の概略構成を示すブロック図である。

【図2】物体判別装置の学習モードの処理を示す流れ図である。

【図3】物体判別装置の判別モードの処理を示す流れ図である。

【図4】ステレオカメラの設置例を示す図である。

【図5】判別対象物の部分を切り出した矩形領域の視差画像(同図(a))と、そのサイズを正規化した視差画像(同図(b))と、図5(a)の視差画像に対する領域のカラー画像を示す図である。

【図6】折れ目方向特徴抽出処理を示す流れ図である。

【図7】折れ目画像作成処理を示す流れ図である。

【図8】小領域(セル)と、ヒストグラムと、ヒストグラムの連結を示す図である。

【図9】二次元ヒストグラムの一例(尾根・谷区別なし)を示す図である。

【図10】二次元ヒストグラムの他の例(尾根・谷を区別)を示す図である。

【図11】二次元ヒストグラムを走査して1次元の特徴ベクトルに変換する際の走査順序の例を示す図である。

【図12】カメラの見下ろし角によって画像上の物体の面の勾配や形状が変動するのに対して、折れ目の方向の変化が少ないことを例示する図である。

【発明を実施するための形態】

【0027】

以下、図面に基づき本発明の各種実施の形態を説明する。

【0028】

図1は、本発明に係る物体判別方法を適用した物体判別装置10の概略構成図である。物体判別装置10には、ステレオカメラ11が接続される。ステレオカメラ11は、光軸を並行に揃えた左右2台のカメラで構成される。ステレオカメラ11で撮影して得られる左右2枚の画像内での各物体の位置の違い(視差)に基づいて、カメラからその物体までの距離を三角測量により導出することができる。

【0029】

物体判別装置10は、ステレオカメラ11が接続されるカメラI/F12と、処理部20と、設定操作などを受け付ける操作部13と、処理対象の画像や設定入力画面、判別結果などを表示する表示部14と、判別結果などを外部装置へ出力する出力部15と、学習したデータを記憶する学習データベース16などを備えて構成される。

【0030】

処理部20は、CPU(Central Processing Unit)、ROM(Read Only Memory)、RAM(Random Access Memory)などを主要部として構成される。表示部14は液晶ディスプレイなどで構成される。操作部13はスイッチ、キーボード、マウスなどのポインティングデバイス、表示部14の画面上に設けられたタッチパネルなどで構成される。

【0031】

処理部20は、カメラI/F12を通じてステレオカメラ11から入力される左右一対のカメラ画像から視差画像を生成する視差画像取得部21と、視差画像取得部21から出力された視差画像から判別対象物を検出し、対応する画像部分を矩形に切り出す判別対象物切り出し部22と、判別対象物切り出し部22から出力された視差画像(これを、切り出し視差画像とする)から、判別対象物の特徴を表した特徴ベクトルを算出する特徴ベクトル算出部23と、特徴ベクトル算出部23から出力された特徴ベクトルに対応する物体の種類の設定を操作部13等を通じてユーザから受け付け、特徴ベクトルを物体の種類(クラス)別に分類して学習データベース16に登録する手動カテゴリ分類部24と、学習データベース16に登録されている物体の種類別の多数の特徴ベクトルをパターン識別手法等により学習し、特徴空間上で物体の種類(クラス)を分別する識別器27の識別条件を算出する特徴ベクトル学習部25と、特徴ベクトル学習部25で算出した識別条件が設定された識別器27を用いて未知の特徴ベクトルがどのクラスに属するかを判別する特徴ベクトル判別部26としての機能を果たす。

【0032】

物体判別装置10は、動作モードとして学習モードと判別モードを備えている。図2は、学習モードで物体判別装置10が行う処理の流れを示している。図3は、判別モードで物体判別装置10が行う処理の流れを示している。

【0033】

学習モードでは、ステレオカメラ11から入力される左右一対の画像から視差画像を視差画像取得部21が生成する(ステップS101)。判別対象物切り出し部22はこの視差画像から判別対象物を検出し、その画像部分を切り出した、切り出し視差画像を出力する(ステップS102)。次に、切り出し視差画像内の判別対象物の特徴を表した特徴ベクトルを特徴ベクトル算出部23が導出する(ステップS103)。手動カテゴリ分類部24は、特徴ベクトル算出部23が出力した特徴ベクトルに対応する物体の種類の設定をユーザから受け付け、該特徴ベクトルを、設定された物体の種類と関連付けして学習データベース16に登録する(ステップS104)。

【0034】

このようにして多数の特徴ベクトルが学習データベース16に登録された状態でユーザから識別条件の設定指示を受けると、物体判別装置10の特徴ベクトル学習部25は、学習データベース16に記憶されている物体の種類別の特徴ベクトルをパターン識別手法により学習し、特徴空間上で物体の種類(クラス)を分割する識別器27に対して設定する識別条件を算出し、これを識別器27に設定する(ステップS105)。

【0035】

判別モードは、学習モードにて算出された識別条件が識別器27に設定された状態で実行される。図3に示す判別モードのステップS201からS203の動作は、学習モードのステップS101からS103と同一である。判別モードでは、ステップS203で特徴ベクトルを求めた後、その特徴ベクトルを識別器27に入力し、該特徴ベクトルがどのクラスに属するかを特徴ベクトル判別部26にて判別し、その判別結果を出力部15へ出力する(ステップS204)。

【0036】

次に、上記各ステップでの処理内容を詳細に説明する。

【0037】

ステレオカメラ11は、判別対象となる物体が現れることが予測される場所を撮像できる位置に設置される。たとえば、図4は、判別対象の物体を歩行者や車椅子とし、これらが通行する交差点の脇に立つ支柱の上にステレオカメラ11を取り付け、該交差点を斜め上から見下ろすようにステレオカメラ11で撮影する場合の設置例を示している。

【0038】

視差画像取得部21は、判別対象となる物体を撮影可能な位置に設置されたステレオカメラ11から取り込まれた左右一対の画像から視差画像を生成・取得する(ステップS101、S201)。

【0039】

視差画像中のある一画素には、対応する左画像(もしくは右画像)中のある地点を映す画素の横座標値と右画像(もしくは左画像)中の同一地点を映す画素の横座標値との差分値が格納される。

【0040】

判別対象物切り出し部22は、視差画像取得部21の出力する視差画像を取り込み、たとえば、背景差分手法を用いて、判別対象となる物体領域を包含する視差画像上の矩形領域を切り出す(ステップS102、S202)。

【0041】

このとき、矩形領域に含まれる、物体領域以外の画素には無効をあらわす固定のマスク画素値が入れられる。また、切り出した矩形領域の幅・高さは切り出し対象の実寸およびカメラからその対象までの実距離によって様々に変動するので、これを、予め設定した幅w、高さhになるよう正規化する。図5(a)は、切り出した矩形領域の視差画像を、図5(b)は、図5(a)の視差画像を、幅w、高さhに正規化した視差画像の一例である。なお、図5(c)には、ステレオカメラ11で撮影した左右の画像の一方の画像であって図5(a)の視差画像に対する領域の画像を参考に示した。

【0042】

次に、特徴ベクトル算出部23は、正規化された切り出し視差画像(入力視差画像とする)を判別対象物切り出し部22から入力し、この入力視差画像から折れ目方向の特徴ベクトルを抽出する折れ目方向特徴抽出処理を行う(ステップS103、S203)。

【0043】

図6は、折れ目方向特徴抽出処理の概要を示している。折れ目方向特徴抽出処理は、折れ目方向画像作成処理(ステップS301)と、分割エリアヒストグラム作成処理(ステップS302)と、分割エリアヒストグラム連結処理(ステップS303)とから構成される。

【0044】

折れ目方向画像作成処理(ステップS301)では、まず、入力視差画像Iの各画素の視差値I(u,v)から、画素値の逆数(およびステレオカメラのレンズ間距離Lとカメラのレンズ焦点距離c)を基に、u方向、v方向(図5(b)参照)の隣接画素間の視差の差分(=その地点の面の傾き)eu,evを下記の数1に示す式で入力視差画像Iの各画素について計算する。

【0045】

【数1】

【0046】

上記の演算は、ステレオカメラ11から得られる視差値が実空間における対象奥行き距離が大きくなるほど、実距離に対する視差値の分解能が低くなることを考慮した処理である。この処理を行わないと、同一物体であっても、カメラに対する位置(遠近)によって折れ目強度が変動してしまう。なお,実際の計算では特徴ベクトルを作成するときに定数が消去できるため、L,cは予め省略する。

【0047】

eu,evを基に、局所的なノイズを消去するため、半径dの周辺領域から平均をとったfu,fvを下記の数2に示す式で計算する。半径dは任意に設定すればよい。

【0048】

【数2】

【0049】

図7では、太線で囲む3画素×3画素の領域のeu,evの平均を該3画素×3画素の中心画素のfu,fvとする場合を例示している。このようにして入力視差画像Iの各画素についてfu,fvを求めることで、fu,fvを各画素の画素値とする勾配画像を生成する。

【0050】

次に、u方向、v方向の面の傾きを表すfu,fv値を基に、u方向、v方向の面の組み合わせを表すgu,gvを下記の数3に示す式で計算する。

【0051】

【数3】

【0052】

図7ではd=2として、注目画素K(u, v)におけるgu,gvを求める場合を例示している。

【0053】

gu,gvから折れ目方向θを下記の数4に示す式で計算し、また折れ目強度mを下記の数5に示す式で計算する。

【0054】

【数4】

【0055】

【数5】

【0056】

なお、各処理において、注目画素(u, v) を処理する際に、(u,

v),(u + 1, v),(u - 1, v),(u, v + 1),(u, v - 1)のいずれかがマスク画素の場合は処理を行わない。

【0057】

分割エリアヒストグラム作成処理(ステップS302)では、作成した折れ目方向画像を、幅s画素、高さt画素の小領域(セル)に分割する(図8参照)。そして、各小領域(セル)における折れ目方向θのヒストグラムを作成する。ここでは、正対する折れ目方向を無視するために、下記の数6に示す式を用いてθをθ´に修正する。

【0058】

【数6】

【0059】

このθ´を20°毎に量子化し、9個の階級(ビン)を持つヒストグラムとする。ここでは,i行j列の小領域のヒストグラム特徴をFij=[f1,f2,…,f9]と表す。

【0060】

また、算出されたm(折れ目の強度)を重みとしてヒストグラムを算出すると、より判別精度の高い特徴ベクトルが作成可能となる。

さらに、個々の画素における折れ目強度を保持する方法が考えられる。mをθとは別の次元として0から1に正規化した上でθと同数のビンに量子化した2次元ヒストグラムを算出すると、より判別精度の高い特徴ベクトルが作成可能となる(図9参照)。この場合、折れ目が谷(凹)か尾根(凸)かは区別されない。

【0061】

さらに、個々の画素における凹凸と折れ目強度を保持する方法が考えられる。fu(u-d,v),とfv(u+d,v) 、 fu(u,v-d) とfv(u,v+d)の大きさと正負符号の組み合わせにより、mに正負の符号を付けた上で2次元ヒストグラムを算出すると、最も判別精度の高い特徴ベクトルが作成可能となる(図10参照)。

【0062】

分割エリアヒストグラム連結処理(ステップS303)では、ステップS301で作成した小領域(セル)毎のヒストグラムを連結し、特徴ベクトルV=[F11,F12,…,F1q,F21,F22,…Fpq]を算出する(図6)。ここで、p= h/t, q= w/sとする。

【0063】

小領域において2次元ヒストグラムを使用している場合は、たとえば、図11に示すように、2次元ヒストグラム上の任意の一点を始点とし、任意の終点までを重複することなくすべての点を通るように走査して1次元の特徴ベクトルに変換する。分割エリアヒストグラム連結処理では、この1次元特徴ベクトルを連結する。

【0064】

図2に示す学習モードの処理のステップS104では、手動カテゴリ分類部24は、ステップS103で算出された特徴ベクトルに対応する物体の種類(カテゴリ)の手動入力を受け付ける。たとえば、ステップS103で算出された特徴ベクトルに対応する視差画像の元になったステレオカメラ11からの左右一対の画像のうちの一方のカラー画像等を表示部14に表示し、操作部13からその物体の種類の入力操作を受ける。そして、特徴ベクトルと、この特徴ベクトルに対して手動入力された物体の種類(カテゴリ)とを対応付けて学習データベース16に記憶する。すなわち、特徴ベクトルを物体の種類別に分離して学習データベース16に記憶する。

【0065】

図2に示す学習モードの処理のステップS105では、特徴ベクトル学習部25は、特徴ベクトル判別部26に記憶されているカテゴリ分類された多数の特徴ベクトルVを用いて、パターン識別手法による学習・識別器27の作成を行う。例えば、SVM(サポートベクタマシン)による2クラス判別のための学習・分離超平面の作成を行う。SVMとは、線形しきい素子を用いた教師付き学習によるパターン識別手法の一つである。ここでは、高次元の特徴を扱うために、カーネル関数を導入し、非線形判別を行っている。SVMについては、たとえば、下記文献に記載されている。

Nello Cristianini and John Shawe-Taylor, "An Introduction to

Support Vector Machines and other kernel-based learning methods,"

Cambridge University Press, 2000.

【0066】

たとえば、図4に示すようにステレオカメラ11を設置し、その撮影画像内から抽出された物体が歩行者であるか車椅子であるかを判別する場合には、実際に撮影された画像から取得して手動カテゴリ分類部24でその種類を付与した歩行者および車椅子に関する特徴ベクトルを多数収集して学習データベース16に記憶する。そして、学習データベース16に記憶されているこれら歩行者および車椅子に関する多数の特徴ベクトルから、歩行者、車椅子を判別する識別器27を作成する。

【0067】

このようにして判別用の識別器を作成するので、判別基準を人が主観的に設定する必要がなく、判別基準の設定の手間が軽減される。また、実際のカメラ画像から判別基準(識別器)を作成するので、人の主観が入らずに、客観的な判別基準を得ることができる。

【0068】

図3に示す判別モードの処理のステップS204では、特徴ベクトル判別部26は、学習モードのステップS105で作成された識別器を使用してパターン識別手法による対象カテゴリの判別を行う。例えば、SVMによって算出された分離超平面を用いて、未知の入力ベクトルVxが予め学習した2クラス(たとえば、歩行者、車椅子)のどちらに分類されるか判定する。

【0069】

特徴ベクトル判別部26による判別結果は、表示部14に表示される、あるいは出力部15から外部装置へ出力される。

【0070】

次に、折れ目の特徴ベクトルを用いて物体を判別する本発明の特有の効果について説明する。

【0071】

たとえば、図12(a)に示す直方体50を、真上に近い斜め上から見下ろす視点51からステレオカメラ11で撮影した場合、この直方体の手前の側面53は、同図(b)に示すように、斜め下方に大きく傾斜した面55として認識される。一方、水平に近い斜め上の視点52から僅かに見下ろすように撮影した場合、先ほどの側面53は、同図(c)に示すように、斜めに僅かに傾斜した面56として認識される。このように物体の面の勾配や形状を特徴量として物体を判別する場合には、同じ物体でも得られる特徴量(勾配や形状)が視点によって大きく相違するので、学習時のカメラの視点と判別時のカメラの視点との差の許容量は小さい。

【0072】

これに対し、本発明のように、面の折れ目を物体の特徴量とする場合、たとえば、直方体50の上面と手前の側面53との境界をなす折れ目の位置や向きは、視点51から撮影した場合(同図(b)の折れ目57)と視点52から撮影した場合(同図(c)の折れ目58)とで大差ない。このように面の折れ目を物体の特徴量として物体を判別すれば、視点の違いが特徴量の差に現われ難くいので、学習時と判別時とのカメラの視点の差の許容範囲が大きくなる。したがって、交差点など現場の制約からカメラの設置位置(視点)が学習時に対して大きく相違するような場合でも、判別精度を確保することができる。

【0073】

このように本発明の物体判別方法は、学習時と判別時との環境差異の影響を受け難い。この環境差異は、カメラの見下ろし角といった視点に限定されず、たとえば、カメラと判別物体までの距離、照明環境なども含まれる。

【0074】

以上、本発明の実施の形態を図面によって説明してきたが、具体的な構成は実施の形態に例示したものに限られるものではなく、本発明の要旨を逸脱しない範囲における変更や追加があっても本発明に含まれる。

【0075】

実施の形態では、歩行者と車椅子を判別する場合を例示したが、判別対象の物体はこれに限定されるものではない。本発明は、様々な三次元形状を持つ物体のクラス分けに適用することができる。

【0076】

また、識別器としてSVMを利用する例を示したが、面の折れ目の特徴情報に基づいて物体の種類を判別する手法は、任意の手法でよい。

【0077】

実施の形態では、学習機能と判別機能の双方を有する物体判別装置10を例示したが、学習機能を果たす学習装置と判別機能を果たす判別装置とを個別の装置として構成してもよい。この場合、学習装置で作成した識別器の設定内容を判別装置の識別器に設定すればよい。

【符号の説明】

【0078】

10…物体判別装置

11…ステレオカメラ

12…カメラI/F

13…操作部

14…表示部

15…出力部

16…学習データベース

20…処理部

21…視差画像取得部

22…判別対象物切り出し部

23…特徴ベクトル算出部

24…手動カテゴリ分類部

25…特徴ベクトル学習部

26…特徴ベクトル判別部

27…識別器

50…直方体

51、52…視点

53…側面

55…視点51から見た側面

56…視点52から見た側面

57、58…折れ目

K…注目画素

【特許請求の範囲】

【請求項1】

ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成するステップと、

前記判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、前記視差画像における面の折れ目の位置とその折れ目の方向を前記判別対象物の特徴情報として抽出するステップと、

前記抽出した特徴情報に基づいて、前記判別対象物の種類を判別するステップと、

を有する

ことを特徴とする物体判別方法。

【請求項2】

前記特徴情報として、さらに前記折れ目の強度を求める

ことを特徴とする請求項1に記載の物体判別方法。

【請求項3】

前記折れ目を尾根と谷に区別して前記特徴情報を抽出する

ことを特徴とする請求項1または2に記載の物体判別方法。

【請求項4】

前記視差画像内の注目画素を中心に対称な位置にある隣接画素間における画素値の逆数の差を、前記注目画素の地点における前記隣接画素間を結ぶ方向の勾配として求める

ことを特徴とする請求項1乃至3のいずれか1項に記載の物体判別方法。

【請求項5】

前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度で重み付けした折れ目の方向の度数分布を算出し、前記折れ目画像に属するすべての小領域の度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする請求項2に記載の物体判別方法。

【請求項6】

前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度と折れ目の方向をそれぞれ変量とする2次元の度数分布を算出し、前記折れ目画像に属するすべての小領域の前記度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする請求項2または3に記載の物体判別方法。

【請求項7】

前記抽出するステップが処理する前記判定対象物の視差画像は、前記判別対象物の部分を矩形に切り出した画像であって、その画像サイズが所定サイズになるように正規化されたものである

ことを特徴とする請求項1乃至6のいずれか1項に記載の物体判別方法。

【請求項8】

種類が既知の物体に関する前記特徴情報を学習し、前記学習した特徴情報に基づいて、未知の判別対象物の種類を判別する

ことを特徴とする請求項1乃至7のいずれか1項に記載の物体判別方法。

【請求項1】

ステレオカメラで撮影して得た画像から判別対象物の視差画像を生成するステップと、

前記判別対象物の視差画像の各地点における面の勾配を求め、該面の勾配の連なり状況から、前記視差画像における面の折れ目の位置とその折れ目の方向を前記判別対象物の特徴情報として抽出するステップと、

前記抽出した特徴情報に基づいて、前記判別対象物の種類を判別するステップと、

を有する

ことを特徴とする物体判別方法。

【請求項2】

前記特徴情報として、さらに前記折れ目の強度を求める

ことを特徴とする請求項1に記載の物体判別方法。

【請求項3】

前記折れ目を尾根と谷に区別して前記特徴情報を抽出する

ことを特徴とする請求項1または2に記載の物体判別方法。

【請求項4】

前記視差画像内の注目画素を中心に対称な位置にある隣接画素間における画素値の逆数の差を、前記注目画素の地点における前記隣接画素間を結ぶ方向の勾配として求める

ことを特徴とする請求項1乃至3のいずれか1項に記載の物体判別方法。

【請求項5】

前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度で重み付けした折れ目の方向の度数分布を算出し、前記折れ目画像に属するすべての小領域の度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする請求項2に記載の物体判別方法。

【請求項6】

前記抽出するステップでは、

前記判別対象物の視差画像の各地点の勾配を画素値とする勾配画像を生成し、

前記判別対象物の前記勾配画像の各地点における面の折れ目の方向と折れ目の強度とを画素値とする折れ目画像を生成し、

前記判別対象物の前記折れ目画像を複数に分割した小領域毎に、折れ目の強度と折れ目の方向をそれぞれ変量とする2次元の度数分布を算出し、前記折れ目画像に属するすべての小領域の前記度数分布を連結したものを、前記判別対象物の特徴情報として生成する

ことを特徴とする請求項2または3に記載の物体判別方法。

【請求項7】

前記抽出するステップが処理する前記判定対象物の視差画像は、前記判別対象物の部分を矩形に切り出した画像であって、その画像サイズが所定サイズになるように正規化されたものである

ことを特徴とする請求項1乃至6のいずれか1項に記載の物体判別方法。

【請求項8】

種類が既知の物体に関する前記特徴情報を学習し、前記学習した特徴情報に基づいて、未知の判別対象物の種類を判別する

ことを特徴とする請求項1乃至7のいずれか1項に記載の物体判別方法。

【図1】

【図2】

【図3】

【図4】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図5】

【図2】

【図3】

【図4】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図5】

【公開番号】特開2013−114476(P2013−114476A)

【公開日】平成25年6月10日(2013.6.10)

【国際特許分類】

【出願番号】特願2011−260399(P2011−260399)

【出願日】平成23年11月29日(2011.11.29)

【出願人】(390010054)コイト電工株式会社 (136)

【出願人】(301021533)独立行政法人産業技術総合研究所 (6,529)

【Fターム(参考)】

【公開日】平成25年6月10日(2013.6.10)

【国際特許分類】

【出願日】平成23年11月29日(2011.11.29)

【出願人】(390010054)コイト電工株式会社 (136)

【出願人】(301021533)独立行政法人産業技術総合研究所 (6,529)

【Fターム(参考)】

[ Back to top ]