ロボット装置、ロボット制御方法、ロボット制御プログラム、およびロボットシステム

【課題】ユーザーへの情報の表現力を向上させるとともに、ユーザーの関与によって表現内容を変化させるロボットシステムを提供する。

【解決手段】ロボットと映像表示端末の組み合わせにより、現実のサービスを寸劇表現することで、ユーザーによる機能発見と感情移入を容易にしてユーザーへの情報の表現力を向上させるとともに、得られるユーザー属性と環境属性を反映し表現内容を変化させることでユーザーが飽きさせないようにする。

【解決手段】ロボットと映像表示端末の組み合わせにより、現実のサービスを寸劇表現することで、ユーザーによる機能発見と感情移入を容易にしてユーザーへの情報の表現力を向上させるとともに、得られるユーザー属性と環境属性を反映し表現内容を変化させることでユーザーが飽きさせないようにする。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、映像表示端末と連係動作するロボット装置、ロボット制御方法、ロボット制御プログラム、およびロボットシステムに関する。

【背景技術】

【0002】

近年、家庭用ロボットが国内外のメーカーから発売されており、一般の家庭内で見かける機会が多くなってきている。その中でも、人からの呼びかけに反応して、人とコミュニケーションをとりつつ、コンテンツなどの情報を提供するコミュニケーションロボットが現れてきている。たとえば、ロボットの感情に適合するコンテンツを選択し再生するものが提案されている(特許文献1参照)。

【0003】

前記特許文献1に記載のコンテンツ再生システムは、外部からの働きに応じてロボットが自分の感情を変更するとともにその感情情報をコンテンツ再生装置に送信することで、コンテンツ再生装置がロボットの感情に適合するコンテンツを選択して再生することで、ロボットの感情を表現するものである。

【0004】

また、ユーザーを飽きさせない方法として、本などの印刷媒体・記録媒体に印刷・記録されたストーリーを、ロボットが検出した時間の変化、季節の変化、感情の変化などに応じて、動的にストーリーを改変して毎回異なった内容を朗読するロボットが提案されている(特許文献2参照)。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2005−169567号公報

【特許文献2】特開2002−205291号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

しかしながら、前記特許文献1に開示の構成では、ユーザーがロボットを叩くとロボットが怒りだすといった、外部からの働きとロボットの感情変化の関係が固定的なものであったり、ユーザーの好みに合わせてコンテンツを変更することができないため、ユーザーは同じ出力しか繰り返さないロボットにいずれ飽きてしまう。

【0007】

特許文献2に開示の構成では、ロボット単体が動的に表現内容を改変した場合、ロボットは人間に比べて表情や仕草の表現力が劣るためロボットの動作意図がユーザーに伝わりにくく、さらに改変元となる媒体自体がユーザー属性や環境属性を反映せず固定なために、ロボットと媒体とそれぞれが提供する情報が不一致となることから、かえってユーザーにとってわかりにくくなるという課題があった。

【0008】

上記従来の技術の問題点に鑑み、本発明は、ユーザーへの情報の表現力を向上させるとともに、ユーザーの関与によって表現内容を変化させるロボットシステムを提供することを目的とする。

【課題を解決するための手段】

【0009】

本発明は、映像表示端末とロボットからなる映像表示端末連携型ロボットシステムであって、ロボットの傍らに舞台装置としての映像表示端末を置くことで、ロボットを演者とする舞台空間を構築するものである。

【0010】

映像表示端末はディスプレイなどの表示手段を備えているので、ロボットの演技に説得力を与えるための視覚的補助手段として機能し、場面、季節、時間、雰囲気などを表現するための大道具や小道具のオブジェクトを表示することで、ロボットが伝える内容に対してユーザーの感情移入を高めることができる。

【0011】

映像表示端末はタッチパネルなどの入力検知手段を備えているので、大道具や小道具のオブジェクトにユーザーが触れたときにオブジェクトの特徴に適った動作を実行する。例えば、「絵本読み聞かせ」のサービスにおける絵本の役割を意味する絵本のオブジェクトに触れると、絵本の表紙が開くアニメーションを実行したのち、ロボットが絵本のストーリーを身振りを加えつつ話すといった、人間が絵本の読み聞かせをするのと同じ行動をトレースするので、ユーザーにとってロボットの動作意図がより伝わりやすくなる。

【0012】

ロボットはカメラによる顔認識などのユーザー検知手段を備えているので、目の前にいる人物があらかじめ記憶手段に格納されたユーザー情報と一致するか否かを判定し、一致する場合はユーザー情報として格納されている絵本のタイトルと前回までの読了位置を参照して、前回の続きから読み聞かせを実行できる。また、目の前にいる人物のユーザー情報が記憶手段に格納されていない場合は、顔認識で人物の年齢を判定し、例えば人物を幼児と判定した場合、ロボットは幼児にとって聞き取りやすい声質・スピード・話し方を選択し、映像表示端末はディスプレイに表示する絵本の文字を幼児向けの平易な文章かつ漢字を廃した文字表現に変更した上で、絵本の最初の頁から読み聞かせを実行できる。

【0013】

映像表示端末はオブジェクト状態をロボットに伝えるときに、ロボットの行動分岐としての複数の行動パターンを付与して伝えて、ロボットは顔認識で目の前の人物の性別を判定し、その判定結果に応じた行動パターンを選択し実行できる。なお、前述の複数の発話の行動パターンは、映像表示端末からロボットに伝える以外に、前記オブジェクト状態に紐付けされたものとしてロボットが備える記憶手段に予め格納してもよい。

【0014】

映像表示端末は、例えば、「モーニングコール」のサービスにおける時計の役割を意味するオブジェクトをディスプレイ上に配置して、予め設定した時間からの経過とユーザーの覚醒具合に応じて、ロボットがユーザーにモーニングコールをする際の発話の音量・音程・抑揚・スピード・会話の間および身体動作の大きさ・スピード・力強さを変化させることができる。

【0015】

映像表示装置は、ディスプレイ上に表示されたオブジェクトを操作したことでロボットが発話および身体動作といった行動パターンを開始した直後に前述と異なるオブジェクトを操作したとき、ロボットに伝えるオブジェクト状態に付与された優先度の情報をもとに、実行中のロボットの行動パターンをキャンセルして、後のオブジェクトの操作に紐付けされた行動パターンを割込ませて実行できる。

【0016】

ロボットはマイクによる音声認識手段あるいは環境音認識手段を備えているので、例えば「動画コンテンツ再生」のサービスにおいて、ユーザーの歓声あるいは拍手音を検知することで、映像表示端末で再生する動画コンテンツをユーザーが楽しんでいると判定して、ユーザーの手拍子に同期してロボットが手拍子するとともに、映像表示端末は視覚的に派手な演出に変遷させる。

【発明の効果】

【0017】

以上のように本発明は、ユーザーへの情報の表現力を向上させるとともに、ユーザーの関与によって表現内容を変化させるロボットシステムを提供できる。

【図面の簡単な説明】

【0018】

【図1】実施の形態1におけるロボットを含むシステムの構成例を示す機能ブロック図

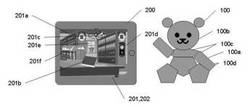

【図2】実施の形態1〜4におけるロボットが映像表示端末とともに使用される状態を示す図

【図3】実施の形態2〜4におけるロボットを含むシステムの構成例を示す機能ブロック図

【図4】実施の形態5におけるロボットを含むシステムの構成例を示す機能ブロック図

【図5】実施の形態5におけるロボットが映像表示端末とともに使用される状態を示す図

【発明を実施するための形態】

【0019】

以下本発明の実施の形態について図面を参照して説明する。

【0020】

(実施の形態1)

図1は、実施の形態1におけるロボットを含むシステムの構成を示す機能ブロック図である。図1に示すシステムは、映像表示端末200およびロボット100を含んでいる。

【0021】

図2は、ロボット100が映像表示端末200とともに使用される状態を示す図である。ロボット100の傍らに舞台装置としての映像表示端末200を置くことで、ロボットを演者とする舞台空間を構築する。ロボット100と映像表示端末200は横並びの左右の配置に限るものではなく、連動して表現する内容に応じて、縦並びの前後の配置や、段違いの上下の配置も含んでいる。

【0022】

映像表示端末200は、例えば、テレビジョン装置、タブレット、PC、PDA、ゲーム機、携帯電話またはインターホーンなどで構成することができる。

【0023】

映像表示端末200は、表示手段201、入力検知手段202、オブジェクト状態決定手段203、オブジェクト状態送信手段204を備えている。

【0024】

表示手段201は、ロボットの演技に説得力を与えるための視覚的補助手段として機能し、場面、季節、時間、雰囲気などを表現するための大道具や小道具のオブジェクトを表示する。例えば、図2で示すような「絵本の読み聞かせ」サービスを実現する場合、場面を現す大道具としての本棚を並べた図書館オブジェクト201aを背景に表示して、小道具として複数の絵本オブジェクト201bを「絵本が閉じた状態」で表示する。さらに、現在日時に応じた季節を示すため、夏であれば扇風機、冬であればストーブなどの季節オブジェクト201cを表示したり、時間を示すために時計オブジェクト201dの時刻表示にくわえて窓オブジェクト201eの外から指しこむ日光の波長の変化を模して表示するオブジェクト全体の色味を調整したり、場の雰囲気を示すために室内照明オブジェクト201fが発する光の明るさに応じて、表示する背景およびオブジェクト全体の色の濃淡を調整する。

【0025】

入力検知手段202は、ディスプレイとタッチパネルとを重ね合わせたタッチパネルディスプレイとして構成することで、ユーザーの指が触れた位置座標を検出できることから、ディスプレイに表示された複数の大道具や小道具のうち、ユーザーがどのオブジェクトに触れたといった操作入力を検知する。

【0026】

オブジェクト状態決定手段203は、入力検知手段202が検知した操作入力に対応して、現在のオブジェクト状態を別の状態に遷移させ、表示手段201に命令してオブジェクトの見かけ上の表示形態(形状、色、大きさ、位置姿勢)を変化できる。

【0027】

オブジェクト状態送信手段204は、オブジェクト状態決定手段203によってオブジェクト状態が遷移したことをロボット100に送信する。

【0028】

ロボット100と映像表示端末200とを有線または無線の通信モジュールで接続し、映像表示端末200のオブジェクト状態送信手段204から送信されたオブジェクト状態を含むデータを、ロボット100のオブジェクト状態受信手段105が受信する。このときの通信の形態は、例えば、Wi−Fi(登録商標)、Bluetooth(登録商標)などの技術を用いることができる。

【0029】

なお、上記の映像表示手段200を構成する各手段は、映像表示装置動作プログラムによって実現する。

【0030】

ロボット100は、記憶手段101、出力手段102、ユーザー検知手段103、ロボット状態決定手段104、オブジェクト状態受信手段105、ロボット状態送信手段106を備えている。

【0031】

ユーザー検知手段103は、ユーザーの顔や身体を含む映像を撮影するためのカメラと、ユーザーの発する音声を収集するためのマイクを備えており、人認識の技術を用いてロボット100の目の前にいるユーザーの顔や音声の特徴情報の抽出や年齢や性別の推定、または、ユーザーの視線を含む表情認識や音声の周波数成分や声のリズムを分析する技術を用いて、ユーザーの喜怒哀楽や集中度あるいは興奮度といった感情情報を推定できる。上記例に限らず、例えば、ロボット100には外界センサおよび内界センサを含む。例えば、外界センサとしては、ユーザーがロボット100の体表面に触れたことを検知するタッチセンサや圧力センサや脈拍センサあるいは熱センサ。内界センサとしては、ユーザーがロボット100を持った状態での移動および回転の操作を検知する加速度センサやジャイロセンサあるいは電子コンパスなどを含める。上記のユーザー検知手段103で得られた情報は「現在のユーザー情報」として扱う。

【0032】

【表1】

表1は、ユーザー検知手段103で得られる「現在のユーザー情報」の構成を示す。1つのIDに対して、年齢、性別、ロボットからユーザーに対する好感度といった基本情報、顔の特徴情報、音声の特徴情報、感情情報、外界センサ情報、内界センサ情報を含んでいる。

【0033】

出力手段102は、発話するためのスピーカや、複数の自由度をもつ機構で構成し、その可動部に駆動力を与えることにより、ロボットに身体動作を発生させる。このときの駆動力の発生源(アクチュエータ)には、サーボモータ、人工筋肉、磁力、静電気力などの技術を用いることができる。本実施形態のロボット100は、図2に示すように人の日常生活に溶け込みやすく親しまれているぬいぐるみの代表格であるクマの形状および構造を模してデザインされたクマ型ぬいぐるみロボットであり、外装もぬいぐるみと同様の柔軟素材を使用しているため、安心して直接触れて抱くことができる。なお、クマ型ぬいぐるみは、旧来から子供の遊び相手として存在しているように、人間らしい発話や身体動作を行う動物を擬人化したキャラクターとしても受け入れられやすい。もちろん、本実施の形態はクマ以外のキャラクターにも適用可能である。

【0034】

ロボット100は、動物を模して胴体部100a、頭部100b、腕部100c、脚部100dに分かれて構成されている。頭部100bは首位置にロール、ピッチおよびヨーの各軸方向の自由度をもって胴体部100aの上端位置に配置されている。腕部100cは肩位置にロールとピッチ、肘位置にロールとピッチの各軸方向の自由度をもって胴体部100aの上半分左右端位置に配置されている。脚部100dは股関節位置にピッチとヨーの各軸方向の自由度をもって胴体部100aの下半分左右端位置に配置されている。

【0035】

上記構成によって、人同士のコミュニケーションにおいて非言語情報がときに言語以上に情報を伝達すると言われるように、対話を促すためのいくつかの非言語情報としての身体動作(ジェスチャ)を表現できる。具体的には、同意を意味するうなづき、否定を意味する首振り、疑問を意味する首かしげ、話し相手と目をあわせるまたは逸らすアイコンタクト、自発的な発言を呈する挙手、相手からの発言を求める手招き、話題の対象を指差す、不快を伝える足のばたつかせなどのジェスチャを発話と同期させながら実行することが可能である。

【0036】

記憶手段101は、各種情報を格納するための記憶媒体を備えている。具体的には、予め格納されている「過去のユーザー情報」に加え、「オブジェクト状態と紐付けられた複数の行動パターン」も格納できる。

【0037】

【表2】

表2は、記憶手段101に格納する「過去のユーザー情報」の構成を示す。1つのIDに対して、名前や年齢、性別およびロボットからユーザーに対する好感度といった基本情報、顔の特徴情報、音声の特徴情報、複数のアプリケーション情報を含んでいる。アプリケーション情報には、過去に該ユーザーが行った行動のうち、例えば、「絵本読み聞かせ」サービスに関するアプリケーション情報としての、今までに読んだ絵本の名称と読了位置や読了回数を、基本情報に紐付けすることもできる。

【0038】

前記ユーザー検知手段103は、ロボット100の目の前にいるユーザーから得た「現在のユーザー情報」と、記憶手段101に格納された「過去のユーザー情報」とで、とくに顔の特徴情報を比較することでユーザーの個人識別を行うことができる。

【0039】

【表3】

表3は、記憶手段101に格納する「行動パターン」の構成を示す。1つのIDに対して、オブジェクト名およびオブジェクト状態に紐付けられた複数の行動パターン情報を含んでいる。行動パターンは、ロボットが出力するための発話および身体動作に関する情報を有する。

【0040】

例えば、「絵本の読み聞かせ」サービスに関して、「読み聞かせする」「本をすすめる」「待機する」などの行動パターンを用意する。さらに、各行動パターンに「行動確率」が設定されている場合は、ユーザーとロボットとのインタラクション回数によって上昇する「過去のユーザー情報」に含まれるユーザーへの好感度の値や、目の前のユーザーから得られる「現在のユーザー情報」に含まれる集中度の値が大きいほど行動確率の高い行動を優先して実行する。また、各行動パターンに「行動条件」が記述されている場合は、ロボットは該条件に従って行動パターンを選択する。

【0041】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態と紐付けされた複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0042】

ロボット状態送信手段106は、ロボット状態決定手段104によってロボット状態が遷移したことを映像表示端末200に送信する。

【0043】

なお、上記のロボット100を構成する各手段は、ロボット動作プログラムによって実現する。

【0044】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0045】

図2に示す映像表示端末200は、表示手段201と入力検知手段202は重なり合うタッチパネルディスプレイで構成され、「絵本の読み聞かせ」サービスを実現する場合、場面を現す大道具としての本棚を並べた図書館オブジェクト201aを背景に表示して、小道具として複数の絵本オブジェクト201bを「絵本が閉じた状態」で表示する。さらに、現在の季節を印象付ける(ここでは夏=扇風機)の季節オブジェクト201c、時間を示す時計オブジェクト201dの時刻表示と、ここでは昼なので窓の外の色を青とする窓オブジェクト201e、場の雰囲気を示すために室内照明オブジェクト201fを表示し照明がついていることを示すために周辺の色の濃淡を明るくなるように補正する。前記絵本のオブジェクト201bは「絵本が閉じた状態」と「絵本が開かれた状態」と「絵本を読んでいる状態」の3つの状態を持つ。

【0046】

タッチパネルディスプレイ上に表示された絵本のオブジェクト201aをユーザーが指で触れるとき、入力検知手段202の働きにより絵本のオブジェクトが操作されたと判断する。

【0047】

さらに、オブジェクト状態決定手段203は、絵本のオブジェクト状態を「絵本が閉じた状態」から「絵本が開かれている状態」に遷移すると同時に、表示手段201に命令して絵本の表紙が開くアニメーションを実行したのち絵本のストーリーのおける象徴的な場面を現す背景をディスプレイに表示し、オブジェクト状態送信手段204を介して、絵本のオブジェクト状態が「絵本が開かれている状態」に遷移したことをロボット100に送信する。

【0048】

ロボット100は、ユーザー検知手段103が目の前にいる人物から得た「現在のユーザー情報」の顔の特徴情報と、あらかじめ記憶手段102に格納された「過去のユーザー情報」の顔の特徴情報とが一致するか否かを判定する。

【0049】

オブジェクト状態受信手段105が「絵本が開かれている状態」を受信し、ロボット状態決定手段104は表3のIDc001を参照して行動条件90%の「絵本を読み聞かせる」の行動パターンを選択するとき、顔の特徴情報が一致する場合、表2のIDb000の「過去のユーザー情報」と紐付けられて格納されているアプリケーション情報の「絵本の名称」と「前回までの読了位置」と「読み聞かせ設定」を参照して、出力手段102に命令することで前回の続きから読み聞かせを実行できる。

【0050】

さらに、顔の特徴情報が一致しない場合は、ユーザー検知手段103の顔認識で人物の年齢を判定し、例えば人物を幼児と判定した場合、ロボット状態決定手段105が複数の行動パターンのうちから「絵本を読み聞かせる」を選択して、幼児にとって聞き取りやすい声質・スピード・話し方で絵本の最初の頁から読み聞かせることを出力手段102に命令する。

【0051】

以上のように、絵本オブジェクト201bの表紙を開こうとするユーザーのアクションで絵本が開き、つづいてロボット100が目の前の人物の特性に合わせて絵本のストーリーを身振りを加えつつ話すといった、人間がこどもなどに対して絵本の読み聞かせをするのと同じ一連の行動をトレースできるので、ロボットが絵本を読み聞かせようとするといった動作意図が、ユーザーにより伝わりやすくなる。

【0052】

ユーザーのタッチディスプレイの操作において、ディスプレイに表示するオブジェクトが複数ある状態で、ユーザーがオブジェクトAを操作した直後にオブジェクトBを操作するとき、ロボット100がオブジェクトAを操作した結果としての発話または身体動作の実行を継続し後のユーザーの操作がロボットに無視されたと感じさせないように、オブジェクト状態送信手段204は、オブジェクト状態に優先度を付与してロボット100に送信する仕組みを設ける。具体的には、先にオブジェクトAが操作されたときに優先度(通常)を付与してロボット100に送信し、予め想定するロボットの発話および身体動作の時間に達する前にオブジェクトBが操作されたときは優先度(高)を付与してロボット100に送信する。ロボット100は、より高い優先度をもつ情報を受け付けた場合は、実行中のロボットの行動パターンをキャンセルして、後のオブジェクトの操作に紐付けされた行動パターンを割込ませて実行できるようにする。

【0053】

以上の実施の形態は一例であり、ロボット100および映像表示端末200の構成例、動作例、使用例、外部形状例は、上記例に限定されない。

【0054】

(実施の形態2)

図3は、実施の形態2におけるロボットを含むシステムの構成例を示す機能ブロック図である。図3に示すシステムは、映像表示端末200に表示記憶手段205およびロボット状態受信手段206を含んでいる。

【0055】

ロボット100と映像表示端末200とを有線または無線の通信で接続しているので、ロボット状態送信手段106は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方を、ロボット状態に付与して送信できる。

【0056】

表示記憶手段205は、各種情報を格納するための記憶媒体を備えている。具体的には、1つのオブジェクト毎に「表示パターン」を格納できる。

【0057】

【表4】

表4は、表示記憶手段205に格納する「表示パターン」の構成を示す。1つのIDに対して、オブジェクト名、オブジェクト状態、ロボットの状態とユーザー情報に紐付けられた複数の表示パターン情報、およびオブジェクト属性を含んでいる。オブジェクト属性には、オブジェクトの役割グループを示す種別、オブジェクト利用の対象年齢、オブジェクト利用の有効期間をIDに紐付けすることもできる。

【0058】

オブジェクト状態決定手段203は、ロボット100から受信したロボット状態と紐付けされた表示パターンを選択し、さらにユーザー情報が付与されていた場合は、ユーザー情報に含まれる情報と該オブジェクト属性に対応して表示オブジェクトの表示状態を決定し、前記表示手段101の働きにより表示する。

【0059】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0060】

図2に示す映像表示端末200の表示手段201に、「読み聞かせ」サービスの場面を想起させる本棚を並べた図書館オブジェクト201aおよび「絵本が閉じた状態」の絵本オブジェクト201bが表示されている。

【0061】

ここで、「読み聞かせサービス」実行を期待するユーザー(幼児)がロボット100の正面に立ったとき、ロボット状態決定手段104は、ロボット状態を「待機状態」から「絵本を探す状態」に遷移すると同時に、出力手段101に命令して腕部100cを駆動させて本棚のある図書館オブジェクト201aを手で指し示す身体動作を実行する。次に、ロボット状態送信手段106を介してロボットが「絵本を探す状態」に遷移したことを意味するロボット状態と、前記ユーザー検知手段103がユーザーが幼児であるという情報を含む「現在のユーザー情報」を映像表示端末200に送信する。

【0062】

オブジェクト状態決定手段203は、表4のIDd050の表示パターンに従い、対象年齢を幼児とする絵本を本棚に並べるために、表4のオブジェクト属性の「本かつ対象年齢が幼児」という情報を参照する。さらに「絵本を読み聞かせる」のロボット状態を受信するときは、表4のIDd001の表示パターンに従い、ディスプレイに表示する絵本の文字を幼児向けの平易な文章かつ漢字を廃した文字表現に変更できる。

【0063】

以上のように、上記実施の形態1と本実施の形態2の組み合わせにより、ロボット100単体がユーザー情報に基づいて動的に発話および身体動作の表現内容を改変した場合に、改変元となる媒体としての映像表示端末200もユーザー属性を反映して表示内容も連動して改変されるので、ロボット100と映像表示端末200とが提供する情報が常に一致するので、ユーザーによる機能発見と感情移入を容易にしてユーザーへの情報の表現力を向上させるとともに、得られるユーザー属性と環境属性を反映し表現内容を変化させることでユーザーが飽きさせないようにする。

【0064】

以上の映像表示端末200が受信するユーザー情報は一例であり、他にも、ユーザーの名前、年齢、性別といった基本情報、顔の特徴情報、音声の特徴情報、喜怒哀楽、集中度および興奮度といった感情情報などがある。

【0065】

(実施の形態3)

ここでは、ロボット100が、前記映像表示装置200から受信した「ロボットに期待する複数の行動パターン」のうち一つの行動を決定し出力する形態を説明する。

【0066】

【表5】

表5は、映像表示端末200の表示記憶手段205に格納する「ロボットに期待する行動パターン」の構成を示す。本情報のフォーマットは、前述のロボット100の記憶手段101に格納する「行動パターン」と同一で、内容を変更している。

【0067】

例えば、「絵本の読み聞かせ」サービスに関する行動パターン情報として、「読み聞かせする」「本をすすめる」「絵本を読むか尋ねる」「待機する」などの複数の行動パターン情報を用意する。

【0068】

オブジェクト状態決定手段203は、入力検知手段202が検知した操作入力に対応して、現在のオブジェクト状態を別の状態に遷移させたことに加え、表5の該オブジェクトのオブジェクト状態に紐付けられたロボットに期待する複数の行動パターンをロボット100に送信する。

【0069】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態と紐付けされた複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0070】

ロボット状態送信手段106は、ロボット状態決定手段104によってロボット状態が遷移したことを映像表示端末200に送信する。

【0071】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態とロボットに期待する複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0072】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0073】

タッチパネルディスプレイ上に表示された絵本のオブジェクト201aをユーザーが指で触れるとき、入力検知手段202の働きにより絵本のオブジェクトが操作されたと判断する。

【0074】

さらに、オブジェクト状態決定手段203は、絵本のオブジェクト状態を「絵本が閉じた状態」から「絵本が開かれている状態」に遷移すると同時に、表示手段201に命令して絵本の表紙が開くアニメーションを実行したのち、絵本のストーリーの一場面を現す背景をディスプレイに表示する。続いて、オブジェクト状態送信手段204を介して、絵本のオブジェクト状態が「絵本が開かれている状態」に遷移したことと、表5のIDe001のオブジェクト状態に紐付けられたロボットに期待する複数の行動パターンである「絵本を読むか尋ねる」「絵本を閉じる」の2つを付与してロボット100に送信する。

【0075】

オブジェクト状態受信手段105が「絵本が開かれている状態」を受信するとき、ロボット状態決定手段104は、「行動条件」に従ってユーザー検知手段103を使って顔の特徴情報が「過去のユーザー情報」と一致するかどうかを判定する。

【0076】

顔の特徴情報が一致する場合「絵本を読むか尋ねる」の行動パターンを選択し、表3のIDc001の「過去のユーザー情報」と紐付けられて格納されているアプリケーション情報の「絵本の名称」と「読了回数」を参照する。該当する絵本の読了回数が5回以上であれば、ロボット100は絵本を読むかどうかを尋ねる発話と身体動作を出力したのち、ユーザー検知手段103の顔認識がユーザーの「はい」を意味するうなづき動作としての目や鼻の器官の上下動を認識した場合は「読み聞かせ設定」を参照して前回の続きから読み聞かせを実行する。また、ユーザー検知手段103の顔認識がユーザーの「いいえ」を意味する首振り動作としての目や鼻の器官の左右移動を認識するか、うなづき動作と首振り動作のいずれも認識することなく30秒以上経過した場合は、絵本を閉じる行動を実行する。読了回数が5未満であれば、「前回までの読了位置」と「読み聞かせ設定」を参照して読み聞かせを実行する。

【0077】

また、ロボット状態決定手段104は、顔の特徴情報が一致しない場合「絵本を閉じる」の行動パターンを選択し、絵本を閉じる行動を実行する。

【0078】

以上のように、映像表示端末200からロボット100に期待する複数の行動パターンを送信することで、ロボット側の記憶手段101に行動パターンを格納する容量の節約ができる。また、ロボット100が格納している古い行動パターンと異なって、例えば、場面、季節、時間、雰囲気などによって変化した新しい行動パターンを映像表示端末200から与えることで、ロボット100のインタラクションが多彩になり、ユーザはロボット100と飽きずに長時間付き合うことができる。

【0079】

(実施の形態4)

ロボット100が、前記映像表示装置200から受信した「アレンジ手段」に従って、行動を決定し出力する形態を説明する。

【0080】

例えば、「モーニングコール」サービスに関して、表4のIDd040およびd041に示すように時計と対応して「知らせる」「時計をとめる」「待機する」などの行動パターンを用意し、記憶手段101に格納する。また、行動パターンには、読み聞かせる絵本のストーリーに応じてロボットが出力するための発話と身体動作に関する情報を含んでいる。

【0081】

オブジェクト状態決定手段203は、時計オブジェクト201dの種別がタイマなので、予めセットしておいたアラーム時刻に達した場合、オブジェクト状態を「時刻表示状態」から「アラーム状態」に遷移させ、状態が遷移したこととアレンジ手段とを、ロボット100に送信する。

【0082】

具体的な動作例として、「モーニングコール」サービスの一例を以下に示す。

【0083】

オブジェクト状態決定手段203が、表4のIDd040を参照し、時計オブジェクト201dにセットした起床時間7時00分に達したと判断したとき、表4の時計のオブジェクト状態を「時刻表示状態」から「アラーム状態」に遷移すると同時に、表示手段201に命令して、時計が鳴動するアニメーションを実行したのち、オブジェクト状態送信手段204を介して、時計のオブジェクト状態が「アラーム状態」に遷移したことと、アレンジ手段としてのパラメータ「小さい声」を、ロボット100に送信する。

【0084】

ロボット100のオブジェクト状態受信手段105が、7時00分に「アラーム状態」を受信するとき、ロボット状態決定手段104は、表3のIDc041を参照し、ユーザー検知手段103によって目の前にいる人物の視線・表情の動きや発声から得た集中度が閾値未満の場合、意識が覚醒していない(眠そうにしている)と判断して、出力手段101に命令してモーニングコールを「お知らせする」ための発話を、アレンジ手段「小さい声」に応じた小さい音量で実行する。映像表示端末200のロボット状態手段206が、「お知らせする状態」を受信するとき、オブジェクト状態決定手段203は、表4のIDd041を参照し、1分後に再度アラームを鳴らす。

【0085】

上記のフローを、ユーザーの集中度が閾値以上になるまで1分経過するごとに繰り返す際に、アレンジ手段としてのパラメータを「大きな声」や「大きな動き」や「大きな音を立てる」のように変化するようにプログラムする。

【0086】

ロボットが受信したアレンジ手段に対応して、「大きな声」に対応して音量を大きくして発話し、「大きな動き」に対応して手足の末端の位置を胴体中心から離れるように身体動作を変化させ、「大きな音を立てる」に対応して破裂音や打撃音などの大きな効果音を伴って行動することで、ユーザーが覚醒する(起きる)のを促すことができる。最後に、ユーザー検知手段103によって目の前にいる人物から得た集中度が閾値以上の場合、意識が覚醒した(起きている)と判断して、出力手段101に命令してモーニングコールの「時計をとめる」身体動作を実行する。映像表示端末200のロボット状態手段206が、「時計を止める状態」を受信するとき、オブジェクト状態決定手段203は、表4のIDd041を参照し、時計を時刻表示状態に遷移させる。

【0087】

以上のように、映像表示端末200からアレンジ手段を与えることで、ロボット100の記憶手段101に格納された発話または身体動作を変化させることで、記憶手段101の容量を節約できる。また、ロボット100の感情表現が多彩になり、ユーザはロボット100と飽きずに長時間付き合うことができる。

【0088】

以上の発話および身体動作のアレンジ手段は一例であり、他にも、声の大小、声の抑揚、声のテンポ、声の性質(老若男女)、動きの大きさ、動きのスピード、動きの力強さなどがある。

【0089】

(実施の形態5)

図4は、実施の形態5におけるロボットを含むシステムの構成例を示す機能ブロック図である。図4に示すシステムは、ロボット100に音声認識手段107および環境音認識手段108を含んでいる。

【0090】

具体的な動作例として、コンサートの「動画コンテンツ再生」サービスの一例を以下に示す。

【0091】

図5は、ロボット100が映像表示端末200とともに使用される状態を示す図である。表示手段201は、動画再生する領域としての動画コンテンツオブジェクト201g、演出装置として観客の注目を集めるためのスポットライトオブジェクト201hと幻想的な雰囲気をつくるためのミスト発生器オブジェクト201iを配置する。なお、図5ではこれら演出装置を見えるようにディスプレイの表示領域内に配置しているが、実際の利用シーンにおいては、見えないようにディスプレイの表示領域外に配置してもよい。

【0092】

【表6】

表6は、表示記憶手段205に格納する「表示パターン」の構成を示す。本情報のフォーマットは、前述の表4と同一で、内容を変更している。

【0093】

オブジェクト状態決定手段203が、動画コンテンツオブジェクト201gを「停止状態」から「再生状態」に遷移させることで、ディスプレイ上でコンサートの音楽と映像を再生し、スポットライトオブジェクト201hを「消灯状態」から「点灯状態」に遷移させることでスポットライト光を意味する黄色かつ透過度50%でスポットライトを頂点とする三角形を動画コンテンツオブジェクト201gに重畳させて表示する。ミスト発生器オブジェクト201iは停止状態のままにする。傍らに置かれたロボット100は、映像表示端末200で再生されるコンサートの音楽と映像をユーザーが眺めている様子を、ユーザー検知手段103のカメラとマイクでモニタする。

【0094】

ユーザー検知手段103の顔認識によりユーザーの口の開閉状態の変化を検出するとき、マイクに入力された音情報を音声認識手段107に転送しユーザーの発話内容を解析して発話の有無を検出する。このように、口の開閉状態と音声認識をシンクロさせることで、周囲の雑音に起因する認識への悪影響を低減する。なお、発話内容の解析の一例として、テキスト化した言葉のもつイメージが「良い」のグループ(「いい」「すごい」「おもしろい」など)に含まれること、音声の周波数成分や声のリズムを分析して喜や楽の要素が含まれること、を元にして、「歓声」のレベルを判定できる。

【0095】

また、ユーザー検知手段103の画像認識によりユーザーの手の動きの変化を検出するとき、マイクに入力された音情報を環境音認識手段108に転送し環境音を解析して拍手音や打撃音の有無を検出する。このように、手の動きと環境音認識をシンクロさせることで、周囲の雑音に起因する認識への悪影響を低減する。なお、環境音の解析の一例として、音声の周波数成分などを分析して拍手に類似する音の特徴が多く含まれることで「拍手音」のレベルを判定できる。

【0096】

ここで、環境音認識手段108が、拍手音のレベルが予め設定された閾値よりも大きいと判断するとき、ロボット状態決定手段104は、ロボット状態を「待機状態」から「拍手する状態」に遷移すると同時に、出力手段101に命令して腕部100cを駆動させ、ユーザーの拍手音のタイミングに同期して拍手させてもよい。

【0097】

ロボット状態決定手段104は、ロボット状態を「待機状態」から「ユーザー検知状態」に遷移し、ロボット状態送信手段106を介してロボットが「ユーザー検知状態」に遷移したことを意味するロボット状態に、音声認識手段107が認識した音声認識結果または環境音認識手段108が認識した環境音認識結果を付与して送信する。

【0098】

オブジェクト状態決定手段203は、受信した「ユーザー検知状態」のロボット状態に付与された音声認識結果に「歓声」が含まれている場合、表6のIDe021の表示パターンに従い、歓声のレベルが閾値以上であれば、スポットライトオブジェクト201hの色を黄→赤→青→黄の順番で変更して点灯させたり、スポットライトの光を意味する三角形を、スポットライトを中心に振り子状にアニメーションさせる。また、歓声のレベルが閾値未満であれば、スポットライトオブジェクト201hは単色で点灯状態を維持する。

【0099】

オブジェクト状態決定手段203は、受信した「ユーザー検知状態」のロボット状態に付与された環境音認識結果に「拍手音」が含まれている場合、表6のIDe030の表示パターンに従い、拍手音のレベルが閾値以上であれば、ミスト発生器オブジェクト201iを「停止状態」から「実行状態」に遷移させ、ミスト効果を意味する白色かつ透明度50%の雲形状を動画コンテンツオブジェクト201gの下部に重畳させて左右移動するアニメーションを表示する。また、拍手音のレベルが閾値未満であれば、ミストオブジェクト201iは停止状態を維持する。

【0100】

以上のように、ロボットはマイクによる「音声認識手段」あるいは「環境音認識手段」を備えているので、ユーザーの歓声あるいは拍手音を検知することで、映像表示端末で再生する動画コンテンツをユーザーが楽しんでいると判定して、ユーザーの手拍子に同期してロボットが手拍子するとともに、映像表示端末は視覚的に派手な演出に変遷させることで、ユーザーの動画コンテンツへの感情移入を高めることができる。

【0101】

以上、本発明の実施形態の例を第1〜第5の実施形態として、とくに「絵本読み聞かせ」「モーニングコール」「動画コンテンツ再生」のサービスを例示して説明したが、本発明は上記実施形態に限られない。

【0102】

近年、IT技術によって多くの現実の情報サービスがインターネット上に構築されブラウザ上で情報を出力しマウスやキーボードによって情報を入力できるようになったが、人間と対話するような自然なやりとりが損なわれるため、子供や高齢者あるいは情報端末の扱いに不慣れな人にとって情報サービスを享受しにくい。本発明では、「ロボット=俳優」と「映像表示端末=舞台装置」とする組み合わせで、例えば「販売」というカテゴリにおいてロボットの配役を店員と置き換えて、映像表示端末に「薬局」「食料品売場」「衣料品売場」などを切り替えて表示させることで、現実のサービスを寸劇表現することで、ユーザーによりわかりやすく情報を出力し、ユーザーとの自然なやりとりで情報を入力する、情報サービスのシステムを提供することができる。

【産業上の利用可能性】

【0103】

本発明は、ロボットと映像表示端末の組み合わせにより、現実のサービスを寸劇表現することでユーザーによる機能発見と感情移入を容易にして、ユーザーによりわかりやすく情報を出力し、ユーザーとの自然なやりとりで情報を入力する、情報サービスのシステムとして有用である。

【符号の説明】

【0104】

100 ロボット

100a 胴体部

100b 頭部

100c 腕部

100d 脚部

101 記憶手段

102 出力手段

103 ユーザー検知手段

104 ロボット状態決定手段

105 オブジェクト状態受信手段

106 ロボット状態送信手段

107 音声認識手段

108 環境音認識手段

200 映像表示端末

201 表示手段

201a 図書館オブジェクト

201b 絵本オブジェクト

201c 季節オブジェクト

201d 時計オブジェクト

201e 窓オブジェクト

201f 室内照明オブジェクト

201g 動画コンテンツオブジェクト

201h スポットライトオブジェクト

201i ミスト発生器オブジェクト

202 入力検知手段

203 オブジェクト状態決定手段

204 オブジェクト状態送信手段

205 表示記憶手段

206 ロボット状態受信手段

【技術分野】

【0001】

本発明は、映像表示端末と連係動作するロボット装置、ロボット制御方法、ロボット制御プログラム、およびロボットシステムに関する。

【背景技術】

【0002】

近年、家庭用ロボットが国内外のメーカーから発売されており、一般の家庭内で見かける機会が多くなってきている。その中でも、人からの呼びかけに反応して、人とコミュニケーションをとりつつ、コンテンツなどの情報を提供するコミュニケーションロボットが現れてきている。たとえば、ロボットの感情に適合するコンテンツを選択し再生するものが提案されている(特許文献1参照)。

【0003】

前記特許文献1に記載のコンテンツ再生システムは、外部からの働きに応じてロボットが自分の感情を変更するとともにその感情情報をコンテンツ再生装置に送信することで、コンテンツ再生装置がロボットの感情に適合するコンテンツを選択して再生することで、ロボットの感情を表現するものである。

【0004】

また、ユーザーを飽きさせない方法として、本などの印刷媒体・記録媒体に印刷・記録されたストーリーを、ロボットが検出した時間の変化、季節の変化、感情の変化などに応じて、動的にストーリーを改変して毎回異なった内容を朗読するロボットが提案されている(特許文献2参照)。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2005−169567号公報

【特許文献2】特開2002−205291号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

しかしながら、前記特許文献1に開示の構成では、ユーザーがロボットを叩くとロボットが怒りだすといった、外部からの働きとロボットの感情変化の関係が固定的なものであったり、ユーザーの好みに合わせてコンテンツを変更することができないため、ユーザーは同じ出力しか繰り返さないロボットにいずれ飽きてしまう。

【0007】

特許文献2に開示の構成では、ロボット単体が動的に表現内容を改変した場合、ロボットは人間に比べて表情や仕草の表現力が劣るためロボットの動作意図がユーザーに伝わりにくく、さらに改変元となる媒体自体がユーザー属性や環境属性を反映せず固定なために、ロボットと媒体とそれぞれが提供する情報が不一致となることから、かえってユーザーにとってわかりにくくなるという課題があった。

【0008】

上記従来の技術の問題点に鑑み、本発明は、ユーザーへの情報の表現力を向上させるとともに、ユーザーの関与によって表現内容を変化させるロボットシステムを提供することを目的とする。

【課題を解決するための手段】

【0009】

本発明は、映像表示端末とロボットからなる映像表示端末連携型ロボットシステムであって、ロボットの傍らに舞台装置としての映像表示端末を置くことで、ロボットを演者とする舞台空間を構築するものである。

【0010】

映像表示端末はディスプレイなどの表示手段を備えているので、ロボットの演技に説得力を与えるための視覚的補助手段として機能し、場面、季節、時間、雰囲気などを表現するための大道具や小道具のオブジェクトを表示することで、ロボットが伝える内容に対してユーザーの感情移入を高めることができる。

【0011】

映像表示端末はタッチパネルなどの入力検知手段を備えているので、大道具や小道具のオブジェクトにユーザーが触れたときにオブジェクトの特徴に適った動作を実行する。例えば、「絵本読み聞かせ」のサービスにおける絵本の役割を意味する絵本のオブジェクトに触れると、絵本の表紙が開くアニメーションを実行したのち、ロボットが絵本のストーリーを身振りを加えつつ話すといった、人間が絵本の読み聞かせをするのと同じ行動をトレースするので、ユーザーにとってロボットの動作意図がより伝わりやすくなる。

【0012】

ロボットはカメラによる顔認識などのユーザー検知手段を備えているので、目の前にいる人物があらかじめ記憶手段に格納されたユーザー情報と一致するか否かを判定し、一致する場合はユーザー情報として格納されている絵本のタイトルと前回までの読了位置を参照して、前回の続きから読み聞かせを実行できる。また、目の前にいる人物のユーザー情報が記憶手段に格納されていない場合は、顔認識で人物の年齢を判定し、例えば人物を幼児と判定した場合、ロボットは幼児にとって聞き取りやすい声質・スピード・話し方を選択し、映像表示端末はディスプレイに表示する絵本の文字を幼児向けの平易な文章かつ漢字を廃した文字表現に変更した上で、絵本の最初の頁から読み聞かせを実行できる。

【0013】

映像表示端末はオブジェクト状態をロボットに伝えるときに、ロボットの行動分岐としての複数の行動パターンを付与して伝えて、ロボットは顔認識で目の前の人物の性別を判定し、その判定結果に応じた行動パターンを選択し実行できる。なお、前述の複数の発話の行動パターンは、映像表示端末からロボットに伝える以外に、前記オブジェクト状態に紐付けされたものとしてロボットが備える記憶手段に予め格納してもよい。

【0014】

映像表示端末は、例えば、「モーニングコール」のサービスにおける時計の役割を意味するオブジェクトをディスプレイ上に配置して、予め設定した時間からの経過とユーザーの覚醒具合に応じて、ロボットがユーザーにモーニングコールをする際の発話の音量・音程・抑揚・スピード・会話の間および身体動作の大きさ・スピード・力強さを変化させることができる。

【0015】

映像表示装置は、ディスプレイ上に表示されたオブジェクトを操作したことでロボットが発話および身体動作といった行動パターンを開始した直後に前述と異なるオブジェクトを操作したとき、ロボットに伝えるオブジェクト状態に付与された優先度の情報をもとに、実行中のロボットの行動パターンをキャンセルして、後のオブジェクトの操作に紐付けされた行動パターンを割込ませて実行できる。

【0016】

ロボットはマイクによる音声認識手段あるいは環境音認識手段を備えているので、例えば「動画コンテンツ再生」のサービスにおいて、ユーザーの歓声あるいは拍手音を検知することで、映像表示端末で再生する動画コンテンツをユーザーが楽しんでいると判定して、ユーザーの手拍子に同期してロボットが手拍子するとともに、映像表示端末は視覚的に派手な演出に変遷させる。

【発明の効果】

【0017】

以上のように本発明は、ユーザーへの情報の表現力を向上させるとともに、ユーザーの関与によって表現内容を変化させるロボットシステムを提供できる。

【図面の簡単な説明】

【0018】

【図1】実施の形態1におけるロボットを含むシステムの構成例を示す機能ブロック図

【図2】実施の形態1〜4におけるロボットが映像表示端末とともに使用される状態を示す図

【図3】実施の形態2〜4におけるロボットを含むシステムの構成例を示す機能ブロック図

【図4】実施の形態5におけるロボットを含むシステムの構成例を示す機能ブロック図

【図5】実施の形態5におけるロボットが映像表示端末とともに使用される状態を示す図

【発明を実施するための形態】

【0019】

以下本発明の実施の形態について図面を参照して説明する。

【0020】

(実施の形態1)

図1は、実施の形態1におけるロボットを含むシステムの構成を示す機能ブロック図である。図1に示すシステムは、映像表示端末200およびロボット100を含んでいる。

【0021】

図2は、ロボット100が映像表示端末200とともに使用される状態を示す図である。ロボット100の傍らに舞台装置としての映像表示端末200を置くことで、ロボットを演者とする舞台空間を構築する。ロボット100と映像表示端末200は横並びの左右の配置に限るものではなく、連動して表現する内容に応じて、縦並びの前後の配置や、段違いの上下の配置も含んでいる。

【0022】

映像表示端末200は、例えば、テレビジョン装置、タブレット、PC、PDA、ゲーム機、携帯電話またはインターホーンなどで構成することができる。

【0023】

映像表示端末200は、表示手段201、入力検知手段202、オブジェクト状態決定手段203、オブジェクト状態送信手段204を備えている。

【0024】

表示手段201は、ロボットの演技に説得力を与えるための視覚的補助手段として機能し、場面、季節、時間、雰囲気などを表現するための大道具や小道具のオブジェクトを表示する。例えば、図2で示すような「絵本の読み聞かせ」サービスを実現する場合、場面を現す大道具としての本棚を並べた図書館オブジェクト201aを背景に表示して、小道具として複数の絵本オブジェクト201bを「絵本が閉じた状態」で表示する。さらに、現在日時に応じた季節を示すため、夏であれば扇風機、冬であればストーブなどの季節オブジェクト201cを表示したり、時間を示すために時計オブジェクト201dの時刻表示にくわえて窓オブジェクト201eの外から指しこむ日光の波長の変化を模して表示するオブジェクト全体の色味を調整したり、場の雰囲気を示すために室内照明オブジェクト201fが発する光の明るさに応じて、表示する背景およびオブジェクト全体の色の濃淡を調整する。

【0025】

入力検知手段202は、ディスプレイとタッチパネルとを重ね合わせたタッチパネルディスプレイとして構成することで、ユーザーの指が触れた位置座標を検出できることから、ディスプレイに表示された複数の大道具や小道具のうち、ユーザーがどのオブジェクトに触れたといった操作入力を検知する。

【0026】

オブジェクト状態決定手段203は、入力検知手段202が検知した操作入力に対応して、現在のオブジェクト状態を別の状態に遷移させ、表示手段201に命令してオブジェクトの見かけ上の表示形態(形状、色、大きさ、位置姿勢)を変化できる。

【0027】

オブジェクト状態送信手段204は、オブジェクト状態決定手段203によってオブジェクト状態が遷移したことをロボット100に送信する。

【0028】

ロボット100と映像表示端末200とを有線または無線の通信モジュールで接続し、映像表示端末200のオブジェクト状態送信手段204から送信されたオブジェクト状態を含むデータを、ロボット100のオブジェクト状態受信手段105が受信する。このときの通信の形態は、例えば、Wi−Fi(登録商標)、Bluetooth(登録商標)などの技術を用いることができる。

【0029】

なお、上記の映像表示手段200を構成する各手段は、映像表示装置動作プログラムによって実現する。

【0030】

ロボット100は、記憶手段101、出力手段102、ユーザー検知手段103、ロボット状態決定手段104、オブジェクト状態受信手段105、ロボット状態送信手段106を備えている。

【0031】

ユーザー検知手段103は、ユーザーの顔や身体を含む映像を撮影するためのカメラと、ユーザーの発する音声を収集するためのマイクを備えており、人認識の技術を用いてロボット100の目の前にいるユーザーの顔や音声の特徴情報の抽出や年齢や性別の推定、または、ユーザーの視線を含む表情認識や音声の周波数成分や声のリズムを分析する技術を用いて、ユーザーの喜怒哀楽や集中度あるいは興奮度といった感情情報を推定できる。上記例に限らず、例えば、ロボット100には外界センサおよび内界センサを含む。例えば、外界センサとしては、ユーザーがロボット100の体表面に触れたことを検知するタッチセンサや圧力センサや脈拍センサあるいは熱センサ。内界センサとしては、ユーザーがロボット100を持った状態での移動および回転の操作を検知する加速度センサやジャイロセンサあるいは電子コンパスなどを含める。上記のユーザー検知手段103で得られた情報は「現在のユーザー情報」として扱う。

【0032】

【表1】

表1は、ユーザー検知手段103で得られる「現在のユーザー情報」の構成を示す。1つのIDに対して、年齢、性別、ロボットからユーザーに対する好感度といった基本情報、顔の特徴情報、音声の特徴情報、感情情報、外界センサ情報、内界センサ情報を含んでいる。

【0033】

出力手段102は、発話するためのスピーカや、複数の自由度をもつ機構で構成し、その可動部に駆動力を与えることにより、ロボットに身体動作を発生させる。このときの駆動力の発生源(アクチュエータ)には、サーボモータ、人工筋肉、磁力、静電気力などの技術を用いることができる。本実施形態のロボット100は、図2に示すように人の日常生活に溶け込みやすく親しまれているぬいぐるみの代表格であるクマの形状および構造を模してデザインされたクマ型ぬいぐるみロボットであり、外装もぬいぐるみと同様の柔軟素材を使用しているため、安心して直接触れて抱くことができる。なお、クマ型ぬいぐるみは、旧来から子供の遊び相手として存在しているように、人間らしい発話や身体動作を行う動物を擬人化したキャラクターとしても受け入れられやすい。もちろん、本実施の形態はクマ以外のキャラクターにも適用可能である。

【0034】

ロボット100は、動物を模して胴体部100a、頭部100b、腕部100c、脚部100dに分かれて構成されている。頭部100bは首位置にロール、ピッチおよびヨーの各軸方向の自由度をもって胴体部100aの上端位置に配置されている。腕部100cは肩位置にロールとピッチ、肘位置にロールとピッチの各軸方向の自由度をもって胴体部100aの上半分左右端位置に配置されている。脚部100dは股関節位置にピッチとヨーの各軸方向の自由度をもって胴体部100aの下半分左右端位置に配置されている。

【0035】

上記構成によって、人同士のコミュニケーションにおいて非言語情報がときに言語以上に情報を伝達すると言われるように、対話を促すためのいくつかの非言語情報としての身体動作(ジェスチャ)を表現できる。具体的には、同意を意味するうなづき、否定を意味する首振り、疑問を意味する首かしげ、話し相手と目をあわせるまたは逸らすアイコンタクト、自発的な発言を呈する挙手、相手からの発言を求める手招き、話題の対象を指差す、不快を伝える足のばたつかせなどのジェスチャを発話と同期させながら実行することが可能である。

【0036】

記憶手段101は、各種情報を格納するための記憶媒体を備えている。具体的には、予め格納されている「過去のユーザー情報」に加え、「オブジェクト状態と紐付けられた複数の行動パターン」も格納できる。

【0037】

【表2】

表2は、記憶手段101に格納する「過去のユーザー情報」の構成を示す。1つのIDに対して、名前や年齢、性別およびロボットからユーザーに対する好感度といった基本情報、顔の特徴情報、音声の特徴情報、複数のアプリケーション情報を含んでいる。アプリケーション情報には、過去に該ユーザーが行った行動のうち、例えば、「絵本読み聞かせ」サービスに関するアプリケーション情報としての、今までに読んだ絵本の名称と読了位置や読了回数を、基本情報に紐付けすることもできる。

【0038】

前記ユーザー検知手段103は、ロボット100の目の前にいるユーザーから得た「現在のユーザー情報」と、記憶手段101に格納された「過去のユーザー情報」とで、とくに顔の特徴情報を比較することでユーザーの個人識別を行うことができる。

【0039】

【表3】

表3は、記憶手段101に格納する「行動パターン」の構成を示す。1つのIDに対して、オブジェクト名およびオブジェクト状態に紐付けられた複数の行動パターン情報を含んでいる。行動パターンは、ロボットが出力するための発話および身体動作に関する情報を有する。

【0040】

例えば、「絵本の読み聞かせ」サービスに関して、「読み聞かせする」「本をすすめる」「待機する」などの行動パターンを用意する。さらに、各行動パターンに「行動確率」が設定されている場合は、ユーザーとロボットとのインタラクション回数によって上昇する「過去のユーザー情報」に含まれるユーザーへの好感度の値や、目の前のユーザーから得られる「現在のユーザー情報」に含まれる集中度の値が大きいほど行動確率の高い行動を優先して実行する。また、各行動パターンに「行動条件」が記述されている場合は、ロボットは該条件に従って行動パターンを選択する。

【0041】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態と紐付けされた複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0042】

ロボット状態送信手段106は、ロボット状態決定手段104によってロボット状態が遷移したことを映像表示端末200に送信する。

【0043】

なお、上記のロボット100を構成する各手段は、ロボット動作プログラムによって実現する。

【0044】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0045】

図2に示す映像表示端末200は、表示手段201と入力検知手段202は重なり合うタッチパネルディスプレイで構成され、「絵本の読み聞かせ」サービスを実現する場合、場面を現す大道具としての本棚を並べた図書館オブジェクト201aを背景に表示して、小道具として複数の絵本オブジェクト201bを「絵本が閉じた状態」で表示する。さらに、現在の季節を印象付ける(ここでは夏=扇風機)の季節オブジェクト201c、時間を示す時計オブジェクト201dの時刻表示と、ここでは昼なので窓の外の色を青とする窓オブジェクト201e、場の雰囲気を示すために室内照明オブジェクト201fを表示し照明がついていることを示すために周辺の色の濃淡を明るくなるように補正する。前記絵本のオブジェクト201bは「絵本が閉じた状態」と「絵本が開かれた状態」と「絵本を読んでいる状態」の3つの状態を持つ。

【0046】

タッチパネルディスプレイ上に表示された絵本のオブジェクト201aをユーザーが指で触れるとき、入力検知手段202の働きにより絵本のオブジェクトが操作されたと判断する。

【0047】

さらに、オブジェクト状態決定手段203は、絵本のオブジェクト状態を「絵本が閉じた状態」から「絵本が開かれている状態」に遷移すると同時に、表示手段201に命令して絵本の表紙が開くアニメーションを実行したのち絵本のストーリーのおける象徴的な場面を現す背景をディスプレイに表示し、オブジェクト状態送信手段204を介して、絵本のオブジェクト状態が「絵本が開かれている状態」に遷移したことをロボット100に送信する。

【0048】

ロボット100は、ユーザー検知手段103が目の前にいる人物から得た「現在のユーザー情報」の顔の特徴情報と、あらかじめ記憶手段102に格納された「過去のユーザー情報」の顔の特徴情報とが一致するか否かを判定する。

【0049】

オブジェクト状態受信手段105が「絵本が開かれている状態」を受信し、ロボット状態決定手段104は表3のIDc001を参照して行動条件90%の「絵本を読み聞かせる」の行動パターンを選択するとき、顔の特徴情報が一致する場合、表2のIDb000の「過去のユーザー情報」と紐付けられて格納されているアプリケーション情報の「絵本の名称」と「前回までの読了位置」と「読み聞かせ設定」を参照して、出力手段102に命令することで前回の続きから読み聞かせを実行できる。

【0050】

さらに、顔の特徴情報が一致しない場合は、ユーザー検知手段103の顔認識で人物の年齢を判定し、例えば人物を幼児と判定した場合、ロボット状態決定手段105が複数の行動パターンのうちから「絵本を読み聞かせる」を選択して、幼児にとって聞き取りやすい声質・スピード・話し方で絵本の最初の頁から読み聞かせることを出力手段102に命令する。

【0051】

以上のように、絵本オブジェクト201bの表紙を開こうとするユーザーのアクションで絵本が開き、つづいてロボット100が目の前の人物の特性に合わせて絵本のストーリーを身振りを加えつつ話すといった、人間がこどもなどに対して絵本の読み聞かせをするのと同じ一連の行動をトレースできるので、ロボットが絵本を読み聞かせようとするといった動作意図が、ユーザーにより伝わりやすくなる。

【0052】

ユーザーのタッチディスプレイの操作において、ディスプレイに表示するオブジェクトが複数ある状態で、ユーザーがオブジェクトAを操作した直後にオブジェクトBを操作するとき、ロボット100がオブジェクトAを操作した結果としての発話または身体動作の実行を継続し後のユーザーの操作がロボットに無視されたと感じさせないように、オブジェクト状態送信手段204は、オブジェクト状態に優先度を付与してロボット100に送信する仕組みを設ける。具体的には、先にオブジェクトAが操作されたときに優先度(通常)を付与してロボット100に送信し、予め想定するロボットの発話および身体動作の時間に達する前にオブジェクトBが操作されたときは優先度(高)を付与してロボット100に送信する。ロボット100は、より高い優先度をもつ情報を受け付けた場合は、実行中のロボットの行動パターンをキャンセルして、後のオブジェクトの操作に紐付けされた行動パターンを割込ませて実行できるようにする。

【0053】

以上の実施の形態は一例であり、ロボット100および映像表示端末200の構成例、動作例、使用例、外部形状例は、上記例に限定されない。

【0054】

(実施の形態2)

図3は、実施の形態2におけるロボットを含むシステムの構成例を示す機能ブロック図である。図3に示すシステムは、映像表示端末200に表示記憶手段205およびロボット状態受信手段206を含んでいる。

【0055】

ロボット100と映像表示端末200とを有線または無線の通信で接続しているので、ロボット状態送信手段106は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方を、ロボット状態に付与して送信できる。

【0056】

表示記憶手段205は、各種情報を格納するための記憶媒体を備えている。具体的には、1つのオブジェクト毎に「表示パターン」を格納できる。

【0057】

【表4】

表4は、表示記憶手段205に格納する「表示パターン」の構成を示す。1つのIDに対して、オブジェクト名、オブジェクト状態、ロボットの状態とユーザー情報に紐付けられた複数の表示パターン情報、およびオブジェクト属性を含んでいる。オブジェクト属性には、オブジェクトの役割グループを示す種別、オブジェクト利用の対象年齢、オブジェクト利用の有効期間をIDに紐付けすることもできる。

【0058】

オブジェクト状態決定手段203は、ロボット100から受信したロボット状態と紐付けされた表示パターンを選択し、さらにユーザー情報が付与されていた場合は、ユーザー情報に含まれる情報と該オブジェクト属性に対応して表示オブジェクトの表示状態を決定し、前記表示手段101の働きにより表示する。

【0059】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0060】

図2に示す映像表示端末200の表示手段201に、「読み聞かせ」サービスの場面を想起させる本棚を並べた図書館オブジェクト201aおよび「絵本が閉じた状態」の絵本オブジェクト201bが表示されている。

【0061】

ここで、「読み聞かせサービス」実行を期待するユーザー(幼児)がロボット100の正面に立ったとき、ロボット状態決定手段104は、ロボット状態を「待機状態」から「絵本を探す状態」に遷移すると同時に、出力手段101に命令して腕部100cを駆動させて本棚のある図書館オブジェクト201aを手で指し示す身体動作を実行する。次に、ロボット状態送信手段106を介してロボットが「絵本を探す状態」に遷移したことを意味するロボット状態と、前記ユーザー検知手段103がユーザーが幼児であるという情報を含む「現在のユーザー情報」を映像表示端末200に送信する。

【0062】

オブジェクト状態決定手段203は、表4のIDd050の表示パターンに従い、対象年齢を幼児とする絵本を本棚に並べるために、表4のオブジェクト属性の「本かつ対象年齢が幼児」という情報を参照する。さらに「絵本を読み聞かせる」のロボット状態を受信するときは、表4のIDd001の表示パターンに従い、ディスプレイに表示する絵本の文字を幼児向けの平易な文章かつ漢字を廃した文字表現に変更できる。

【0063】

以上のように、上記実施の形態1と本実施の形態2の組み合わせにより、ロボット100単体がユーザー情報に基づいて動的に発話および身体動作の表現内容を改変した場合に、改変元となる媒体としての映像表示端末200もユーザー属性を反映して表示内容も連動して改変されるので、ロボット100と映像表示端末200とが提供する情報が常に一致するので、ユーザーによる機能発見と感情移入を容易にしてユーザーへの情報の表現力を向上させるとともに、得られるユーザー属性と環境属性を反映し表現内容を変化させることでユーザーが飽きさせないようにする。

【0064】

以上の映像表示端末200が受信するユーザー情報は一例であり、他にも、ユーザーの名前、年齢、性別といった基本情報、顔の特徴情報、音声の特徴情報、喜怒哀楽、集中度および興奮度といった感情情報などがある。

【0065】

(実施の形態3)

ここでは、ロボット100が、前記映像表示装置200から受信した「ロボットに期待する複数の行動パターン」のうち一つの行動を決定し出力する形態を説明する。

【0066】

【表5】

表5は、映像表示端末200の表示記憶手段205に格納する「ロボットに期待する行動パターン」の構成を示す。本情報のフォーマットは、前述のロボット100の記憶手段101に格納する「行動パターン」と同一で、内容を変更している。

【0067】

例えば、「絵本の読み聞かせ」サービスに関する行動パターン情報として、「読み聞かせする」「本をすすめる」「絵本を読むか尋ねる」「待機する」などの複数の行動パターン情報を用意する。

【0068】

オブジェクト状態決定手段203は、入力検知手段202が検知した操作入力に対応して、現在のオブジェクト状態を別の状態に遷移させたことに加え、表5の該オブジェクトのオブジェクト状態に紐付けられたロボットに期待する複数の行動パターンをロボット100に送信する。

【0069】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態と紐付けされた複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0070】

ロボット状態送信手段106は、ロボット状態決定手段104によってロボット状態が遷移したことを映像表示端末200に送信する。

【0071】

ロボット状態決定手段104は、前記記憶手段101に格納した「過去のユーザー情報」と前記ユーザー検知手段103が取得した「現在のユーザー情報」の少なくとも一方に基づいて、映像表示端末200から受信したオブジェクト状態とロボットに期待する複数の行動パターンから一つを決定し、現在のロボット状態を別の状態に遷移させることで、前記出力手段102の働きによりロボットは発話または身体動作を出力する。

【0072】

具体的な動作例として、「絵本読み聞かせ」サービスの一例を以下に示す。

【0073】

タッチパネルディスプレイ上に表示された絵本のオブジェクト201aをユーザーが指で触れるとき、入力検知手段202の働きにより絵本のオブジェクトが操作されたと判断する。

【0074】

さらに、オブジェクト状態決定手段203は、絵本のオブジェクト状態を「絵本が閉じた状態」から「絵本が開かれている状態」に遷移すると同時に、表示手段201に命令して絵本の表紙が開くアニメーションを実行したのち、絵本のストーリーの一場面を現す背景をディスプレイに表示する。続いて、オブジェクト状態送信手段204を介して、絵本のオブジェクト状態が「絵本が開かれている状態」に遷移したことと、表5のIDe001のオブジェクト状態に紐付けられたロボットに期待する複数の行動パターンである「絵本を読むか尋ねる」「絵本を閉じる」の2つを付与してロボット100に送信する。

【0075】

オブジェクト状態受信手段105が「絵本が開かれている状態」を受信するとき、ロボット状態決定手段104は、「行動条件」に従ってユーザー検知手段103を使って顔の特徴情報が「過去のユーザー情報」と一致するかどうかを判定する。

【0076】

顔の特徴情報が一致する場合「絵本を読むか尋ねる」の行動パターンを選択し、表3のIDc001の「過去のユーザー情報」と紐付けられて格納されているアプリケーション情報の「絵本の名称」と「読了回数」を参照する。該当する絵本の読了回数が5回以上であれば、ロボット100は絵本を読むかどうかを尋ねる発話と身体動作を出力したのち、ユーザー検知手段103の顔認識がユーザーの「はい」を意味するうなづき動作としての目や鼻の器官の上下動を認識した場合は「読み聞かせ設定」を参照して前回の続きから読み聞かせを実行する。また、ユーザー検知手段103の顔認識がユーザーの「いいえ」を意味する首振り動作としての目や鼻の器官の左右移動を認識するか、うなづき動作と首振り動作のいずれも認識することなく30秒以上経過した場合は、絵本を閉じる行動を実行する。読了回数が5未満であれば、「前回までの読了位置」と「読み聞かせ設定」を参照して読み聞かせを実行する。

【0077】

また、ロボット状態決定手段104は、顔の特徴情報が一致しない場合「絵本を閉じる」の行動パターンを選択し、絵本を閉じる行動を実行する。

【0078】

以上のように、映像表示端末200からロボット100に期待する複数の行動パターンを送信することで、ロボット側の記憶手段101に行動パターンを格納する容量の節約ができる。また、ロボット100が格納している古い行動パターンと異なって、例えば、場面、季節、時間、雰囲気などによって変化した新しい行動パターンを映像表示端末200から与えることで、ロボット100のインタラクションが多彩になり、ユーザはロボット100と飽きずに長時間付き合うことができる。

【0079】

(実施の形態4)

ロボット100が、前記映像表示装置200から受信した「アレンジ手段」に従って、行動を決定し出力する形態を説明する。

【0080】

例えば、「モーニングコール」サービスに関して、表4のIDd040およびd041に示すように時計と対応して「知らせる」「時計をとめる」「待機する」などの行動パターンを用意し、記憶手段101に格納する。また、行動パターンには、読み聞かせる絵本のストーリーに応じてロボットが出力するための発話と身体動作に関する情報を含んでいる。

【0081】

オブジェクト状態決定手段203は、時計オブジェクト201dの種別がタイマなので、予めセットしておいたアラーム時刻に達した場合、オブジェクト状態を「時刻表示状態」から「アラーム状態」に遷移させ、状態が遷移したこととアレンジ手段とを、ロボット100に送信する。

【0082】

具体的な動作例として、「モーニングコール」サービスの一例を以下に示す。

【0083】

オブジェクト状態決定手段203が、表4のIDd040を参照し、時計オブジェクト201dにセットした起床時間7時00分に達したと判断したとき、表4の時計のオブジェクト状態を「時刻表示状態」から「アラーム状態」に遷移すると同時に、表示手段201に命令して、時計が鳴動するアニメーションを実行したのち、オブジェクト状態送信手段204を介して、時計のオブジェクト状態が「アラーム状態」に遷移したことと、アレンジ手段としてのパラメータ「小さい声」を、ロボット100に送信する。

【0084】

ロボット100のオブジェクト状態受信手段105が、7時00分に「アラーム状態」を受信するとき、ロボット状態決定手段104は、表3のIDc041を参照し、ユーザー検知手段103によって目の前にいる人物の視線・表情の動きや発声から得た集中度が閾値未満の場合、意識が覚醒していない(眠そうにしている)と判断して、出力手段101に命令してモーニングコールを「お知らせする」ための発話を、アレンジ手段「小さい声」に応じた小さい音量で実行する。映像表示端末200のロボット状態手段206が、「お知らせする状態」を受信するとき、オブジェクト状態決定手段203は、表4のIDd041を参照し、1分後に再度アラームを鳴らす。

【0085】

上記のフローを、ユーザーの集中度が閾値以上になるまで1分経過するごとに繰り返す際に、アレンジ手段としてのパラメータを「大きな声」や「大きな動き」や「大きな音を立てる」のように変化するようにプログラムする。

【0086】

ロボットが受信したアレンジ手段に対応して、「大きな声」に対応して音量を大きくして発話し、「大きな動き」に対応して手足の末端の位置を胴体中心から離れるように身体動作を変化させ、「大きな音を立てる」に対応して破裂音や打撃音などの大きな効果音を伴って行動することで、ユーザーが覚醒する(起きる)のを促すことができる。最後に、ユーザー検知手段103によって目の前にいる人物から得た集中度が閾値以上の場合、意識が覚醒した(起きている)と判断して、出力手段101に命令してモーニングコールの「時計をとめる」身体動作を実行する。映像表示端末200のロボット状態手段206が、「時計を止める状態」を受信するとき、オブジェクト状態決定手段203は、表4のIDd041を参照し、時計を時刻表示状態に遷移させる。

【0087】

以上のように、映像表示端末200からアレンジ手段を与えることで、ロボット100の記憶手段101に格納された発話または身体動作を変化させることで、記憶手段101の容量を節約できる。また、ロボット100の感情表現が多彩になり、ユーザはロボット100と飽きずに長時間付き合うことができる。

【0088】

以上の発話および身体動作のアレンジ手段は一例であり、他にも、声の大小、声の抑揚、声のテンポ、声の性質(老若男女)、動きの大きさ、動きのスピード、動きの力強さなどがある。

【0089】

(実施の形態5)

図4は、実施の形態5におけるロボットを含むシステムの構成例を示す機能ブロック図である。図4に示すシステムは、ロボット100に音声認識手段107および環境音認識手段108を含んでいる。

【0090】

具体的な動作例として、コンサートの「動画コンテンツ再生」サービスの一例を以下に示す。

【0091】

図5は、ロボット100が映像表示端末200とともに使用される状態を示す図である。表示手段201は、動画再生する領域としての動画コンテンツオブジェクト201g、演出装置として観客の注目を集めるためのスポットライトオブジェクト201hと幻想的な雰囲気をつくるためのミスト発生器オブジェクト201iを配置する。なお、図5ではこれら演出装置を見えるようにディスプレイの表示領域内に配置しているが、実際の利用シーンにおいては、見えないようにディスプレイの表示領域外に配置してもよい。

【0092】

【表6】

表6は、表示記憶手段205に格納する「表示パターン」の構成を示す。本情報のフォーマットは、前述の表4と同一で、内容を変更している。

【0093】

オブジェクト状態決定手段203が、動画コンテンツオブジェクト201gを「停止状態」から「再生状態」に遷移させることで、ディスプレイ上でコンサートの音楽と映像を再生し、スポットライトオブジェクト201hを「消灯状態」から「点灯状態」に遷移させることでスポットライト光を意味する黄色かつ透過度50%でスポットライトを頂点とする三角形を動画コンテンツオブジェクト201gに重畳させて表示する。ミスト発生器オブジェクト201iは停止状態のままにする。傍らに置かれたロボット100は、映像表示端末200で再生されるコンサートの音楽と映像をユーザーが眺めている様子を、ユーザー検知手段103のカメラとマイクでモニタする。

【0094】

ユーザー検知手段103の顔認識によりユーザーの口の開閉状態の変化を検出するとき、マイクに入力された音情報を音声認識手段107に転送しユーザーの発話内容を解析して発話の有無を検出する。このように、口の開閉状態と音声認識をシンクロさせることで、周囲の雑音に起因する認識への悪影響を低減する。なお、発話内容の解析の一例として、テキスト化した言葉のもつイメージが「良い」のグループ(「いい」「すごい」「おもしろい」など)に含まれること、音声の周波数成分や声のリズムを分析して喜や楽の要素が含まれること、を元にして、「歓声」のレベルを判定できる。

【0095】

また、ユーザー検知手段103の画像認識によりユーザーの手の動きの変化を検出するとき、マイクに入力された音情報を環境音認識手段108に転送し環境音を解析して拍手音や打撃音の有無を検出する。このように、手の動きと環境音認識をシンクロさせることで、周囲の雑音に起因する認識への悪影響を低減する。なお、環境音の解析の一例として、音声の周波数成分などを分析して拍手に類似する音の特徴が多く含まれることで「拍手音」のレベルを判定できる。

【0096】

ここで、環境音認識手段108が、拍手音のレベルが予め設定された閾値よりも大きいと判断するとき、ロボット状態決定手段104は、ロボット状態を「待機状態」から「拍手する状態」に遷移すると同時に、出力手段101に命令して腕部100cを駆動させ、ユーザーの拍手音のタイミングに同期して拍手させてもよい。

【0097】

ロボット状態決定手段104は、ロボット状態を「待機状態」から「ユーザー検知状態」に遷移し、ロボット状態送信手段106を介してロボットが「ユーザー検知状態」に遷移したことを意味するロボット状態に、音声認識手段107が認識した音声認識結果または環境音認識手段108が認識した環境音認識結果を付与して送信する。

【0098】

オブジェクト状態決定手段203は、受信した「ユーザー検知状態」のロボット状態に付与された音声認識結果に「歓声」が含まれている場合、表6のIDe021の表示パターンに従い、歓声のレベルが閾値以上であれば、スポットライトオブジェクト201hの色を黄→赤→青→黄の順番で変更して点灯させたり、スポットライトの光を意味する三角形を、スポットライトを中心に振り子状にアニメーションさせる。また、歓声のレベルが閾値未満であれば、スポットライトオブジェクト201hは単色で点灯状態を維持する。

【0099】

オブジェクト状態決定手段203は、受信した「ユーザー検知状態」のロボット状態に付与された環境音認識結果に「拍手音」が含まれている場合、表6のIDe030の表示パターンに従い、拍手音のレベルが閾値以上であれば、ミスト発生器オブジェクト201iを「停止状態」から「実行状態」に遷移させ、ミスト効果を意味する白色かつ透明度50%の雲形状を動画コンテンツオブジェクト201gの下部に重畳させて左右移動するアニメーションを表示する。また、拍手音のレベルが閾値未満であれば、ミストオブジェクト201iは停止状態を維持する。

【0100】

以上のように、ロボットはマイクによる「音声認識手段」あるいは「環境音認識手段」を備えているので、ユーザーの歓声あるいは拍手音を検知することで、映像表示端末で再生する動画コンテンツをユーザーが楽しんでいると判定して、ユーザーの手拍子に同期してロボットが手拍子するとともに、映像表示端末は視覚的に派手な演出に変遷させることで、ユーザーの動画コンテンツへの感情移入を高めることができる。

【0101】

以上、本発明の実施形態の例を第1〜第5の実施形態として、とくに「絵本読み聞かせ」「モーニングコール」「動画コンテンツ再生」のサービスを例示して説明したが、本発明は上記実施形態に限られない。

【0102】

近年、IT技術によって多くの現実の情報サービスがインターネット上に構築されブラウザ上で情報を出力しマウスやキーボードによって情報を入力できるようになったが、人間と対話するような自然なやりとりが損なわれるため、子供や高齢者あるいは情報端末の扱いに不慣れな人にとって情報サービスを享受しにくい。本発明では、「ロボット=俳優」と「映像表示端末=舞台装置」とする組み合わせで、例えば「販売」というカテゴリにおいてロボットの配役を店員と置き換えて、映像表示端末に「薬局」「食料品売場」「衣料品売場」などを切り替えて表示させることで、現実のサービスを寸劇表現することで、ユーザーによりわかりやすく情報を出力し、ユーザーとの自然なやりとりで情報を入力する、情報サービスのシステムを提供することができる。

【産業上の利用可能性】

【0103】

本発明は、ロボットと映像表示端末の組み合わせにより、現実のサービスを寸劇表現することでユーザーによる機能発見と感情移入を容易にして、ユーザーによりわかりやすく情報を出力し、ユーザーとの自然なやりとりで情報を入力する、情報サービスのシステムとして有用である。

【符号の説明】

【0104】

100 ロボット

100a 胴体部

100b 頭部

100c 腕部

100d 脚部

101 記憶手段

102 出力手段

103 ユーザー検知手段

104 ロボット状態決定手段

105 オブジェクト状態受信手段

106 ロボット状態送信手段

107 音声認識手段

108 環境音認識手段

200 映像表示端末

201 表示手段

201a 図書館オブジェクト

201b 絵本オブジェクト

201c 季節オブジェクト

201d 時計オブジェクト

201e 窓オブジェクト

201f 室内照明オブジェクト

201g 動画コンテンツオブジェクト

201h スポットライトオブジェクト

201i ミスト発生器オブジェクト

202 入力検知手段

203 オブジェクト状態決定手段

204 オブジェクト状態送信手段

205 表示記憶手段

206 ロボット状態受信手段

【特許請求の範囲】

【請求項1】

「映像表示端末」と「ロボット」からなる「映像表示端末連携型ロボットシステム」であって、前記映像表示端末は、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」と、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定し前記表示手段によって表示する「オブジェクト状態決定手段」と、前記オブジェクト状態決定手段の決定結果をロボットに送信する「オブジェクト状態送信手段」を備え、前記ロボットは、発話と身体動作の少なくとも一方が可能な「出力手段」と、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」と、前記映像表示端末から「オブジェクト状態」を受信する「オブジェクト状態受信手段」と、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定手段」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項2】

前記映像表示端末は、ロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、前記ロボットから前記「ロボット状態」を受信する「ロボット状態受信手段」と、同時に受信した現在のユーザー情報に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項3】

請求項1の前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、ロボットに期待する複数の行動パターンを付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、前記映像表示端末から受信したロボットに期待する複数の行動パターンのうち一つの行動を決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項4】

請求項1の前記ロボットは、オブジェクトの状態に紐付けられた複数の行動パターンを前記記憶手段に格納し、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、前記記憶手段に格納された複数の行動パターンのうち一つの行動を決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項5】

前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、アレンジ手段を付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、前記映像表示端末から受信したアレンジ手段に基づいて発話と身体動作の出力の少なくとも一方にアレンジを加える「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項6】

前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、優先度属性をもつ行動パターンを付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、現在実行中の行動の優先度属性を管理する「行動優先度管理手段」と、前記映像表示端末から受信した優先度属性と、現在実行中の行動の優先属性を比較して、高い優先度属性の行動パターンを決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項7】

前記ロボットは、ユーザーが発した音声を認識する「音声認識手段」と、前記ロボット状態決定手段の決定結果に前記音声認識手段が認識した音声認識結果を付与して映像表示端末に送信する「ロボット状態送信手段」を備え、前記映像表示端末は、音声認識結果と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、同時に受信した音声認識結果に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項8】

前記ロボットは、ユーザーの周辺環境の音声から発信源を認識する「環境音認識手段」と、前記ロボット状態決定手段の決定結果に前記環境認識手段が認識した環境音認識結果を付与して映像表示端末に送信する「ロボット状態送信手段」を備え、前記映像表示端末は、環境音認識結果と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、同時に受信した環境音認識結果に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項9】

ロボットと通信可能な映像表示端末であって、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」と、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定する「オブジェクト状態決定手段」と、前記オブジェクト状態決定手段の決定結果をロボットに送信する「オブジェクト状態送信手段」を備える、ことを特徴とする映像表示端末。

【請求項10】

請求項Xに記載の映像表示端末と通信可能なロボットであって、発話と身体動作の少なくとも一方が可能な「出力手段」と、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」と、前記映像表示端末から「オブジェクト状態」を受信する「オブジェクト状態受信手段」と、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定手段」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信手段」を備える、ことを特徴とするロボット。

【請求項11】

ユーザーの挙動を検知する「ユーザー検知手段」を有するロボットと通信可能な映像表示端末であって、オブジェクトを表示する「表示手段」とロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、前記ロボットからロボットの行動結果を含む「ロボット状態」を受信する「ロボット状態受信手段」と、同時に受信した現在のユーザー情報に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末。

【請求項12】

ロボットと通信可能で、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」を備える映像表示端末に、処理を実行させる映像表示端末動作プログラムであって、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定し前記表示手段によって表示する「オブジェクト状態決定処理」と、前記オブジェクト状態決定処理の決定結果をロボットに送信する「オブジェクト状態送信処理」を実行する、ことを特徴とする映像表示端末動作プログラム。

【請求項13】

請求項12に記載の映像表示端末と通信可能で、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」を備えるロボットに処理を実行させるロボット動作プログラムであって、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定処理」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信処理」を実行する、ことを特徴とするロボット動作プログラム。

【請求項14】

ユーザーの挙動を検知する「ユーザー検知手段」を有するロボットと通信可能で、オブジェクトを表示する「表示手段」とロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」を備える映像表示端末に処理を実行させるロボット動作プログラムであって、前記ロボットからロボットの行動結果を含む「ロボット状態」を受信する「ロボット状態受信処理」と、同時に受信した現在のユーザー情報に基づいて、前記ロボットの状態と紐付けされた複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定処理」を実行する、ことを特徴とする映像表示端末動作プログラム。

【請求項15】

映像表示端末とロボットからなる映像表示端末連携型ロボットシステムであって、

前記映像表示端末は、

オブジェクトを表示する表示手段と、

前記表示手段に対する入力を検知する入力検知手段と、

前記入力検知手段によって検知した前記オブジェクトに対する入力に基づいて、複数の行動情報を前記ロボットに送信する送信手段と、

を備え、

前記ロボットは、

ユーザーに関する情報を記憶する記憶手段と、

複数の行動が可能な可動部と、

前記送信手段から前記複数の行動情報を受信する受信手段と、

前記記憶手段に記憶された前記ユーザーに関する情報に基づいて、前記受信手段が受信した前記複数の行動情報のうち一の行動をするように前記可動部を制御する制御手段と、

を備える、

ことを特徴とする映像表示端末連携型ロボットシステム。

【請求項16】

前記ロボットは、

センシング手段と、

前記受信手段が受信した前記複数の行動情報のうち一の行動をするように前記可動部を制御した後に前記センシング手段が得たセンシング情報を前記映像表示端末に送信する送信手段と、

をさらに備える、

ことを特徴とする請求項15に記載の映像表示端末連携型ロボットシステム。

【請求項1】

「映像表示端末」と「ロボット」からなる「映像表示端末連携型ロボットシステム」であって、前記映像表示端末は、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」と、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定し前記表示手段によって表示する「オブジェクト状態決定手段」と、前記オブジェクト状態決定手段の決定結果をロボットに送信する「オブジェクト状態送信手段」を備え、前記ロボットは、発話と身体動作の少なくとも一方が可能な「出力手段」と、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」と、前記映像表示端末から「オブジェクト状態」を受信する「オブジェクト状態受信手段」と、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定手段」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項2】

前記映像表示端末は、ロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、前記ロボットから前記「ロボット状態」を受信する「ロボット状態受信手段」と、同時に受信した現在のユーザー情報に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項3】

請求項1の前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、ロボットに期待する複数の行動パターンを付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、前記映像表示端末から受信したロボットに期待する複数の行動パターンのうち一つの行動を決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項4】

請求項1の前記ロボットは、オブジェクトの状態に紐付けられた複数の行動パターンを前記記憶手段に格納し、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、前記記憶手段に格納された複数の行動パターンのうち一つの行動を決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項5】

前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、アレンジ手段を付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、前記映像表示端末から受信したアレンジ手段に基づいて発話と身体動作の出力の少なくとも一方にアレンジを加える「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項6】

前記映像表示端末は、前記オブジェクト状態決定手段の決定結果に、優先度属性をもつ行動パターンを付与して、ロボットに送信する「映像表示端末状態送信手段」を備え、前記ロボットは、現在実行中の行動の優先度属性を管理する「行動優先度管理手段」と、前記映像表示端末から受信した優先度属性と、現在実行中の行動の優先属性を比較して、高い優先度属性の行動パターンを決定し出力する「ロボット状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項7】

前記ロボットは、ユーザーが発した音声を認識する「音声認識手段」と、前記ロボット状態決定手段の決定結果に前記音声認識手段が認識した音声認識結果を付与して映像表示端末に送信する「ロボット状態送信手段」を備え、前記映像表示端末は、音声認識結果と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、同時に受信した音声認識結果に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項8】

前記ロボットは、ユーザーの周辺環境の音声から発信源を認識する「環境音認識手段」と、前記ロボット状態決定手段の決定結果に前記環境認識手段が認識した環境音認識結果を付与して映像表示端末に送信する「ロボット状態送信手段」を備え、前記映像表示端末は、環境音認識結果と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、同時に受信した環境音認識結果に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末連携ロボットシステム。

【請求項9】

ロボットと通信可能な映像表示端末であって、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」と、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定する「オブジェクト状態決定手段」と、前記オブジェクト状態決定手段の決定結果をロボットに送信する「オブジェクト状態送信手段」を備える、ことを特徴とする映像表示端末。

【請求項10】

請求項Xに記載の映像表示端末と通信可能なロボットであって、発話と身体動作の少なくとも一方が可能な「出力手段」と、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」と、前記映像表示端末から「オブジェクト状態」を受信する「オブジェクト状態受信手段」と、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定手段」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信手段」を備える、ことを特徴とするロボット。

【請求項11】

ユーザーの挙動を検知する「ユーザー検知手段」を有するロボットと通信可能な映像表示端末であって、オブジェクトを表示する「表示手段」とロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」と、前記ロボットからロボットの行動結果を含む「ロボット状態」を受信する「ロボット状態受信手段」と、同時に受信した現在のユーザー情報に基づいて、前記表示記憶手段に格納した複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定手段」を備える、ことを特徴とする映像表示端末。

【請求項12】

ロボットと通信可能で、オブジェクトを表示する「表示手段」と前記表示手段に対する操作入力を検知する「入力検知手段」を備える映像表示端末に、処理を実行させる映像表示端末動作プログラムであって、前記入力検知手段によって検知した前記オブジェクトへの入力に基づいて変化するオブジェクトの状態を決定し前記表示手段によって表示する「オブジェクト状態決定処理」と、前記オブジェクト状態決定処理の決定結果をロボットに送信する「オブジェクト状態送信処理」を実行する、ことを特徴とする映像表示端末動作プログラム。

【請求項13】

請求項12に記載の映像表示端末と通信可能で、ユーザーの挙動を検知する「ユーザー検知手段」と、ユーザー情報を格納する「記憶手段」を備えるロボットに処理を実行させるロボット動作プログラムであって、前記記憶手段に格納した過去のユーザー情報と前記ユーザー検知手段が取得した現在のユーザー情報の少なくとも一方に基づいて、オブジェクト状態と紐付けされた複数の行動パターンから一つを決定し出力する「ロボット状態決定処理」と、前記ロボット状態決定手段の決定結果を、映像表示端末に送信する「ロボット状態送信処理」を実行する、ことを特徴とするロボット動作プログラム。

【請求項14】

ユーザーの挙動を検知する「ユーザー検知手段」を有するロボットと通信可能で、オブジェクトを表示する「表示手段」とロボットの状態と紐付けされた複数の表示パターンを格納する「表示記憶手段」を備える映像表示端末に処理を実行させるロボット動作プログラムであって、前記ロボットからロボットの行動結果を含む「ロボット状態」を受信する「ロボット状態受信処理」と、同時に受信した現在のユーザー情報に基づいて、前記ロボットの状態と紐付けされた複数の表示パターンから一つを決定し前記表示手段によって表示する「オブジェクト状態決定処理」を実行する、ことを特徴とする映像表示端末動作プログラム。

【請求項15】

映像表示端末とロボットからなる映像表示端末連携型ロボットシステムであって、

前記映像表示端末は、

オブジェクトを表示する表示手段と、

前記表示手段に対する入力を検知する入力検知手段と、

前記入力検知手段によって検知した前記オブジェクトに対する入力に基づいて、複数の行動情報を前記ロボットに送信する送信手段と、

を備え、

前記ロボットは、

ユーザーに関する情報を記憶する記憶手段と、

複数の行動が可能な可動部と、

前記送信手段から前記複数の行動情報を受信する受信手段と、

前記記憶手段に記憶された前記ユーザーに関する情報に基づいて、前記受信手段が受信した前記複数の行動情報のうち一の行動をするように前記可動部を制御する制御手段と、

を備える、

ことを特徴とする映像表示端末連携型ロボットシステム。

【請求項16】

前記ロボットは、

センシング手段と、

前記受信手段が受信した前記複数の行動情報のうち一の行動をするように前記可動部を制御した後に前記センシング手段が得たセンシング情報を前記映像表示端末に送信する送信手段と、

をさらに備える、

ことを特徴とする請求項15に記載の映像表示端末連携型ロボットシステム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図2】

【図3】

【図4】

【図5】

【公開番号】特開2013−99823(P2013−99823A)

【公開日】平成25年5月23日(2013.5.23)

【国際特許分類】

【出願番号】特願2011−245141(P2011−245141)

【出願日】平成23年11月9日(2011.11.9)

【出願人】(000005821)パナソニック株式会社 (73,050)

【Fターム(参考)】

【公開日】平成25年5月23日(2013.5.23)

【国際特許分類】

【出願日】平成23年11月9日(2011.11.9)

【出願人】(000005821)パナソニック株式会社 (73,050)

【Fターム(参考)】

[ Back to top ]