予測装置

【課題】 予測対象区域における歩行者等の発生頻度を予測可能な予測装置を提供することを目的とする。

【解決手段】 過去の発生頻度データを検索し(S170)、FPFPを算出する(S180)。具体的には、予測器の出力である予測結果をベクトルとして表現する。つまり、予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考え、歩行者発生頻度の特徴ベクトル(予測の目的変数)を12次元とする。また、特徴ベクトルが発生する際に、その説明変数となる状況情報を{場所、日時、天候}とする。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とする。そして、この28次元の状況ベクトルに対する特徴ベクトルの回帰関係を線形最小2乗法で解く。

【解決手段】 過去の発生頻度データを検索し(S170)、FPFPを算出する(S180)。具体的には、予測器の出力である予測結果をベクトルとして表現する。つまり、予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考え、歩行者発生頻度の特徴ベクトル(予測の目的変数)を12次元とする。また、特徴ベクトルが発生する際に、その説明変数となる状況情報を{場所、日時、天候}とする。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とする。そして、この28次元の状況ベクトルに対する特徴ベクトルの回帰関係を線形最小2乗法で解く。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する技術に関する。

【背景技術】

【0002】

従来、プローブカーで集めた車両位置情報を基に、渋滞予測や旅行時間の推定を行う技術が開示されている(例えば、特許文献1参照)。ここでは単なる回帰分析ではなく、欠損値付き主成分分析(PCAMD )を用いることで、データの欠損を補っており、理論的には制約付き主成分分析がベースになっている。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特許第4329711号

【発明の概要】

【発明が解決しようとする課題】

【0004】

ところで、所定の区域における歩行者や自転車などの発生頻度を予測することが出来れば、歩行者や自転車などの安全が確保され、運転者の負担軽減にも寄与する。

しかしながら、上記特許文献1では、自車情報(特に位置)が基本になっており、車外環境の観測量(歩行者の数や自転車の数など)を用いたものではない。また、車両の移動特性と歩行者や自動車の移動形態、発生形態は異なると考えられ、車両の渋滞予測技術をそのまま歩行者に適用することはできない。

【0005】

本発明は、予測対象区域における歩行者等の発生頻度を予測可能な予測装置を提供することを目的とする。

【課題を解決するための手段】

【0006】

上記目的を達成するためになされた請求項1に記載の予測装置は、車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する。ここでオブジェクトとは、主として人間であるが、犬などの動物をも含む。また、予定走行経路は、例えばナビゲーション装置で探索された経路であることが考えられる。

【0007】

このとき、頻度データ取得手段は、過去の発生頻度に関する頻度データを取得する。この頻度データは、時空間を定義する「時空間情報」及び当該時空間情報に対応しオブジェクトの発生頻度を定義する「頻度情報」とからなる。このような頻度データは、予測装置の記憶手段に記憶されるものとしてもよいし、外部のセンタに記憶されているものとしてもよい。頻度データが外部のセンタに記憶されている場合、頻度データ取得手段は、センタとのデータ通信によって頻度データを取得することになる。そして、このような頻度データに基づき、予測器によって、予測対象区域におけるオブジェクトの発生頻度が予測される。

【0008】

このような過去の発生頻度に関する頻度データを自車両に又はセンタに集積しておけば、予測対象区域における歩行者等のオブジェクトの発生頻度を適切に予測することができる。

【0009】

なお、「時空間情報」は、例えば請求項2に示すように、状況情報を説明変数とする「状況ベクトル」として定義されるものとすることが考えられる。この状況情報には、請求項3に示すように、場所、日時、及び、天候の情報が含まれることとしてもよい。

【0010】

また、「頻度情報」は、例えば請求項4に示すように、特徴情報を目的変数とする「特徴ベクトル」として定義されるものとすることが考えられる。この特徴情報には、請求項5に示すように、オブジェクトの種類及び車両からの景観を複数に分割した部分領域の情報が含まれることとしてもよい。

【0011】

このような状況ベクトル及び特徴ベクトルを用いることで、比較的簡単に予測を行うことができる。例えば、請求項6に示すように、予測器は、状況ベクトルに対する特徴ベクトルの回帰関係を線形最小二乗法で解くことにより、予測対象区域におけるオブジェクトの発生頻度を予測することが考えられる。

【0012】

ところで、頻度データのセンタへの集積を考えた場合、請求項7に示すように、車両外部を撮像する撮像部と、撮像部にて撮像される画像に基づき、画像認識結果から頻度情報を生成する認識器とを備える構成とすることが考えられる。この場合、認識器が頻度情報を生成するため、頻度データを自車両に集積することが可能となる。

【0013】

ただし、認識器による画像認識結果は、種々の要因によって影響を受ける虞がある。そこで、請求項8に示すように、認識器による画像認識結果に対する信頼度を算出する演算部を備える構成としてもよい。例えば請求項9に示すように、演算部は、オブジェクトの種類、計測地点、画像認識のためのセンサ及び認識手法、並びに、車両の走行速度の少なくともいずれかに基づき、信頼度を算出することが例示される。これにより、集積される画像認識結果に対し信頼度という重み付けを行うことができる。その結果、認識器による画像認識結果を予測器の学習データとして用いることができる。

【0014】

認識器を備える構成を前提とすれば、請求項10に示すように、送信部が、車両走行地点の情報、及び、認識器による画像認識結果をアップロード情報としてセンタへアップロードする構成を採用することが考えられる。このようにすれば、予測装置を搭載する自車両がプローブカーとして機能する。

【0015】

このとき、請求項11に示すように、アップロード情報に、演算部にて算出された信頼度が含まれることとしてもよい。このようにすれば、信頼度付きの画像認識結果がセンタへアップロードされるため、センタに集積される画像認識結果に対し信頼度という重み付けを行うことができる。また、請求項12に示すように、アップロード情報に、予測器による予測結果が含まれることとしてもよい。このようにすれば、予測器を具備しない車両に対し、予測結果をセンタから配信することができる。もちろん、予測結果をセンタへ送信しない場合でも、センタ側で予測を行い、当該センタ側の予測結果を配信するようにしてもよい。

【0016】

ところで、学習データの質または量が十分でない場合、予測器による予測結果と認識器による画像認識結果とが大きくずれることになる。上述したように認識器による画像認識結果を予測器の学習データとすることができるため、予測器の改善の問題は、認識器の性能改善の問題に集約される。

【0017】

そこで、請求項13に示すように、予測器による予測結果と認識器による画像認識結果との差分が閾値以上の場合、センタに集積されたアップロード情報を取得することが考えられる。これによって、認識器の学習データの質と量とが改善される可能性が高くなる。その結果、予測器による予測結果と認識器による画像認識結果との差分を小さくすることに寄与する。

【0018】

なお、本発明は、認識器の学習データによる性能改善という特徴から、次のように構成してもよい。すなわち、「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、過去の発生頻度に関する頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、車両外部を撮像する撮像部と、前記撮像部にて撮像される画像に基づき、画像認識結果から前記頻度データを定義する頻度情報を生成する認識器と、を備え、車両外部のセンタに信頼度の付与された画像認識結果が集積されていることを前提として、前記予測器による予測結果と前記認識器による認識結果との差分が閾値以上の場合、前記センタに集積された前記画像認識結果を前記認識器の学習データとして取得することを特徴とする予測装置。」である。

【0019】

また、画像認識の性能を高めるために、認識パラメータを設定することが考えられる。すなわち、請求項14に示すように、画像認識のための認識パラメータを認識器に設定するパラメータ設定部を備えていることとしてもよい。

【0020】

具体的には、請求項15に示すように、パラメータ設定部は、過去の頻度データに基づき、認識パラメータを設定することが考えられる。例えば、通学団が多いところでは複数のオブジェクトを認識するための認識パラメータを設定するという具合である。また例えば、自転車が多いところでは自転車用の認識パラメータを設定するという具合である。

【0021】

また具体的には、請求項16に示すように、パラメータ設定部は、対象となるオブジェクトに応じて、認識パラメータを設定することが考えられる。オブジェクトの移動度及び移動範囲に基づく設定や、オブジェクトの画像特徴に基づく設定が例示される。

【0022】

このようにすれば、画像認識の性能の向上に寄与する。

このとき、請求項17に示すように、予測器による予測結果と認識器による画像認識結果との差分が閾値以上の場合、パラメータ設定部が、認識パラメータを修正するようにしてもよい。このようにすれば、認識器の性能改善が図られる。

【0023】

なお、本発明は、認識器の認識パラメータによる性能改善という特徴から、次のように構成してもよい。「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、過去の発生頻度に関する頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、車両外部を撮像する撮像部と、前記撮像部にて撮像される画像に基づき、画像認識結果から前記頻度データを定義する頻度情報を生成する認識器と、前記認識器に対し、画像認識のための認識パラメータを設定するパラメータ設定部と、を備え、前記予測器による予測結果と前記認識器による画像認識結果との差分が閾値以上の場合、前記パラメータ設定部は、前記認識パラメータを修正して設定することを特徴とする予測装置。」である。

【0024】

ところで、過去の頻度データがない場合でも、地理的な要因などからオブジェクトの発生頻度を予測できることが望ましい。

そこで、請求項18に示す構成を採用することが考えられる。すなわち、アトラクタの情報を取得するアトラクタ情報取得手段と、アトラクタ情報に基づき、当該アトラクタでのオブジェクトの存在確率をタイムゲートとして設定するタイムゲート設定手段と、を備える構成である。

【0025】

アトラクタは、例えば、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園として具現化される。タイムゲートは、時間的要因に影響されるアトラクタでのオブジェクトの存在確率を示す。例えば、アトラクタの営業時間などを基に、タイムゲートが設定されるという具合である。

【0026】

このとき、予測器は、アトラクタと予測対象区域との距離、及び、タイムゲートに基づき、予測対象区域におけるオブジェクトの発生頻度を予測する。

このようにすれば、過去の頻度データが少ない場合でも、地理的な要因などからオブジェクトの発生頻度を予測することができる。

【0027】

より具体的には、請求項19に示すように、タイムゲートを、オブジェクトの発生頻度を高さとする矩形波で定義することが例示される。この場合、予測器は、アトラクタから予測対象区域までの分岐路にて分割される矩形波の伝播を想定し、予測対象区域におけるオブジェクトの発生頻度を予測する。例えば、分岐路では矩形波の高さ(オブジェクト発生頻度)が小さくなるように伝播する。このようにすれば、アトラクタに起因するオブジェクトの発生頻度を比較的容易に予測することができる。

【0028】

なお、請求項20に示すように、タイムゲートを定義する矩形波は、アトラクタの平均収容人数を高さとするものとして初期化されることとしてもよい。このようにすれば、タイムゲートを比較的簡単な矩形波として定義することができる。

【0029】

また、例えば学校への登校時間が8:00〜8:30である場合、その登校時間以前のオブジェクト(例えば生徒)の発生頻度を予測する必要がある。そこで、請求項21に示すように、予測器は、時間的に遡る矩形波の伝播である逆伝播に基づき、予測対象区域におけるオブジェクトの発生頻度を予測することとしてもよい。このようにすれば、アトラクタに対してのオブジェクトの流入時間から、それ以前のオブジェクトの発生頻度を予測することができる。

【0030】

さらにまた、請求項22に示すように、予測器は、自車両の予測対象区域の通過時間を考慮して、予測対象区域におけるオブジェクトの発生頻度を予測することが例示される。つまり、自車両の速度が上がれば予測対象区域の通過時間が短くなるため、予測対象区域の通過時間を考慮すれば、より確実にオブジェクトの発生頻度を予測することができる。

【0031】

なお、本発明は、アトラクタに起因する予測という特徴から、次のように構成してもよい。すなわち、「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、集客力を有し、前記オブジェクトの流出入の駆動する要素であるアトラクタの情報を取得するアトラクタ情報取得手段と、前記アトラクタ情報に基づき、時間的要因に影響される前記アトラクタでの前記オブジェクトの存在確率をタイムゲートとして設定するタイムゲート設定手段と、を備え、前記予測器は、前記アトラクタと前記予測対象区域との距離、及び、前記タイムゲートに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測することを特徴とする予測装置。」である。

【図面の簡単な説明】

【0032】

【図1】タイプ1の車載装置の構成を示すブロック図である。

【図2】タイプ2の車載装置の構成を示すブロック図である。

【図3】タイプ3の車載装置の構成を示すブロック図である。

【図4】センタの構成を示すブロック図である。

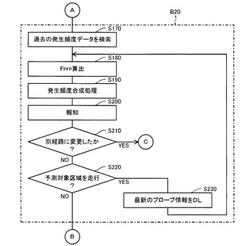

【図5】予報処理の一部を示すフローチャートである。

【図6】予報処理の一部を示すフローチャートである。

【図7】予報処理の一部を示すフローチャートである。

【図8】FATR算出処理を示すフローチャートである。

【図9】対象アトラクタの予測頻度算出を示すフローチャートである。

【図10】アトラクタのリストアップを示す説明図である。

【図11】複数のアトラクタに起因する発生頻度の合成を示す説明図である。

【図12】複数のアトラクタに起因する発生頻度の合成を示す説明図である。

【図13】発生頻度の算出の一例を示すタイミングチャートである。

【図14】発生頻度の算出の一例を示す説明図である。

【図15】過去の発生頻度データを予測に利用した一例を示す説明図である。

【図16】予測対象区域の一例を示す説明図である。

【図17】状況ベクトルと特徴ベクトルの一例を示す説明図である。

【図18】特徴情報に含まれる部分領域の一例を示す説明図である。

【図19】予測器による出力結果の一例を示す説明図である。

【図20】予測器による出力結果の一例を示す説明図である。

【図21】複数の車両での画像認識を示す説明図である。

【発明を実施するための形態】

【0033】

以下、本発明の実施形態を図面に基づいて説明する。

本実施形態では、想定する時間帯に所定の対象区域である「予測対象区域」(以下、ターゲットともいう)で発生する歩行者の頻度を予測する。

【0034】

[1.特徴]

(1)走行予定区域の近隣にある集客施設とその時間挙動を地理的要因および道路要因の観点から考慮し、走行予定時間における予測対象区域での歩行者発生頻度を予測する。

(2)過去の発生頻度に関する統計データから走行予定時間における歩行者発生頻度を予測する際に、プローブカーで集めた認識器の結果を用い、人手による正解データの入力を最小にとどめる。

(3)上記の認識器の結果を用いる際に認識の信頼度に関する情報を考慮する。

(4)走行予定区域を走行した際に得た最新の認識結果と、あらかじめ上記の枠組みで得た歩行者発生頻度との間の差分情報を評価することにより、認識器と予測器の性能を改善する。

【0035】

[2.具体的用途]

主として車載カメラの視野内にあるオブジェクト(自転車、歩行者、動物)を検出し、特にカメラに接近するオブジェクトについてドライバーに警報を発するような運転支援装置に応用する。アプリケーションプログラムとして、大きく分けると、次の3つが考えられる。

【0036】

[2−1.人予報]

複数のセンサが得た情報を共有することにより、人や自転車の発生を予測する。これによって指定場所での人の発生頻度を天気予報のように前もって予測し、都市情報として活用する。

【0037】

[2−2.運転支援]

人予報の結果、対象地域を通過する前に注意、危険回避、装置設定、旅行計画変更、運転者変更(運転計画)を行うことが可能になり、予防安全を促進することができる。すなわち、最終的に事故を低減させるという観点から言えば、単に認識結果を赤枠で表示したり、警告を発したりするだけではなく、運転支援という立場であらかじめ危険を回避するように情報を提供する。

【0038】

例えば、まったく見知らぬ土地をレンタカーで運転する場合、歩行者や自転車と出くわす確率が高い場所や時間帯を事前に知ることができれば、ドライバーの精神的負荷は軽減される。

【0039】

[2−3.認識支援]

上記の予測結果とプローブカーによる認識結果を通信手段で連携させることにより、認識性能を改善させる。

【0040】

(1)通信で得られる外部データ(特に、天候や環境に関するデータ)により認識性能を改善させる。

(2)通信で外部の処理装置とつながることで演算量や処理内容を向上させ、認識機能を改善させる。

【0041】

(3)複数のセンサが連携することにより、多数の時空間点で観測したデータを相互利用し、個々の車の認識性能を改善する。

(4)その地域や時間、天候にあった認識パラメータを通信で獲得し、認識性能を適応化させる。

【0042】

[3.予測式]

最初に、考えられる予測式について説明しておく。

センシング装置(ソース)、時間帯、地点に対応して認識結果の信頼度を決め、信頼度と認識結果を地図データ上に記憶し、その時空間分布から走行予定区域における歩行者発生頻度を予測する。

【0043】

その予測値のM個の集まりについてN個のカテゴリのオブジェクトに関する予測発生頻度の値をM×N行列Fで表現する。時間情報を含む状況sと想定する場所xについて、発生頻度の予測値で構成される行列F(x,s)を次式でモデル化する。

【0044】

【数1】

【0045】

なお、ここで、

FRWPは、自車または現在地から予測対象位置xまでの走行経路周辺で得られる画像認識結果から算出したx上の予測発生頻度である。

【0046】

また、FRXTは、xにおいて現在または最近観測された画像を認識した結果である。

さらにまた、FPFPは、過去の統計データに基づいて場所x状況sにおける発生頻度を予測した結果である。

【0047】

また、FATRは、x周辺にあるアトラクタの影響に基く予測発生量。これはタイムゲートによりさらに精度の高い情報に修正される。

なお、Λは上記の4つの発生頻度行列からひとつの発生頻度行列を作成する関数であり、もっとも簡単なものは次式で表現される。

【0048】

【数2】

【0049】

[3−1.予測方式1]

もっとも容易に実現できる予測方式は、次のようなものである。

【0050】

【数3】

【0051】

これは、「飛び出し注意」とか「通学路につき子供に注意」、あるいは「動物注意」といった道路標識がこの予測に近い意味合いを持つ。ただし、本実施形態ではターゲット周辺の任意の区域における頻度予測を想定し、複数のアトラクタの影響を合成して定量的に表現することを考える。

【0052】

[3−2.予測方式2]

過去の統計データがすでにある場合は、FPFP用いることで、次のように表現することができる。

【0053】

【数4】

【0054】

FPFPは基本的には過去のデータの学習に基づく回帰予測であるが、データに欠損がある場合もFATRによって補えるという特長を本方式は有する。

[3−3.予測方式3]

ターゲットまでの距離が近く、しかも発生頻度がターゲットまでの移動時間内にあまり変動しないような場合はターゲット周辺に存在する認識器の結果に重点をおき、次のような式で表現可能である。

【0055】

【数5】

【0056】

この場合は、準リアルタイムかつ正確な認識系と通信系がそろっていないと実現できない。過去からの予測が困難な群集の発生などはこの方式が都合がよい。認識系が十分でないならば、画像そのものを自車まで配信してもらうということも考えられ、この場合はプローブカーによる無線通信システムの問題に帰着される。

【0057】

[3−4.実施形態における予測方式]

FRWPに関しては、ターゲットとは異なる地点の時空間点で観測された発生頻度とターゲットでの発生頻度との間の相関を計算することとなり、問題はFPFPと同様になる。そこで、本実施形態では主として式4を用いて説明を行う。

【0058】

[4.予測器への情報提供]

また、本システムの予測器に用いる情報は次のソースから提供されることを想定する。

(1)車両(予測装置)

予測装置は、3つのタイプで構成することができる。

【0059】

(1−1)タイプ1:認識器と予測器との両方を具備し、センタと通信を行うもの。

(1−2)タイプ2:予測器のみを具備し、センタと通信を行うもの。

(1−3)タイプ3:センタから配信される情報を受信して報知を行うもの。

【0060】

(2)携帯電話機やPCなどの無線通信端末

センシングした位置情報と記憶した個人プロファイル情報とを周囲の車両又はセンタに送信する。これによって、画像処理などのセンシングによっては困難な歩行者情報(性別、年齢、目的地など)を高い信頼度で地図上にマッピングすることができる。この端末によって他の歩行者をセンシングすることも不可能ではない。ただし、端末の持ち主の歩行状態を発信する手段として用いることが一般的である。

【0061】

(3)定点観測インフラ

車両などの移動体から歩行者をセンシングする場合に比べて、位置が固定されており、背景の動きも少ないので歩行者の認識率は一般に車両の場合よりも高い。したがって、予測の信頼度も高くなる。一方で、コスト面から設置件数や設置場所が限られるため、予測できる対象区域も限定される。

【0062】

[5.予測装置の構成]

図1に、タイプ1の予測装置10のブロック図を示す。

予測装置10は、主として、送受信部20と、ナビゲーション装置30と、認識器40と、予測器50と、記憶部60とを備えている。

【0063】

送受信部20は、センタ70との間でデータ通信を行うための構成である。

ナビゲーション装置30は、報知部31、アトラクタ情報32を有しており、予測器50と接続されている。報知部31は、運転者への報知を行うためのディスプレイやスピーカなどで構成される。アトラクタ情報32については、後述する。

【0064】

認識器40は、撮像部41、パラメータ設定部42、評価部43、及び、変換部44に接続されている。また、変換部44には演算部45が接続されており、演算部45には情報生成部46が接続されている。

【0065】

予測部50は、パラメータ設定部42、及び、評価部43に接続されている。

記憶部60は、変換部44からの情報を記憶するための記憶媒体である。

撮像部41は、車載カメラとして具現化され、認識器40に対し、画像データを送出する。パラメータ設定部42は、認識器40に対し、画像認識のための認識パラメータを設定する。パラメータについては後述する。評価部43は、予測器50からの出力と認識器40からの出力とを比較して評価するための構成である。評価部43では、具体的には、予測器50からの出力と認識器40からの出力との差分情報を算出する。この差分情報は、変換部44で変換された後、記憶部60及び演算部45へ送出される。

【0066】

認識器40からの出力である画像認識結果は、変換部44で変換された後、記憶部60に記憶される。また、変換部44で変換された後、演算部45へ送出される。演算部45では、画像認識結果に対する信頼度を算出する。

【0067】

情報生成部46は、画像認識結果に、演算部45によって算出された信頼度などを付加して、センタ70へのアップロード情報を生成する。

予測器50は、歩行者発生頻度を予測するための構成である。予測器50は、センタ70から送信されてくる情報を、ナビゲーション装置30を介して取得し、当該情報に基づく予測を行う。また、予測器50は、記憶部60に記憶される画像認識結果に基づく予測を行う。

【0068】

この予測装置10は、現在位置、走行予定経路、差分情報、及び、認識結果などをセンタ70へアップロードし、センタ70から、予測対象区域の情報(アトラクタ情報、タイムゲート情報、Web情報など)を受信する。

【0069】

図2に、タイプ2の予測装置11のブロック図を示す。なお、予測装置10と同様の構成部位には、同一の符号を付した。

予測装置11は、主として、送受信部20と、ナビゲーション装置30と、予測器50と、記憶部60とを備えている。予測装置10と異なるのは、認識器40及びこれに付随する構成を有していないことである。なお、それ以外の構成については予測装置10と同様となっているため、説明を割愛する。

【0070】

この予測装置11は、現在位置、走行予定経路などをセンタ70へアップロードし、センタ70から、予測対象区域の情報(アトラクタ情報、タイムゲート情報、Web情報など)を受信する。

【0071】

図3に、タイプ3の予測装置12のブロック図を示す。など、予測装置10,11と同様の構成部位には、同一の符号を付した。

予測装置12は、受信部21と、ナビゲーション装置30と、報知部31とを備えている。この場合、予測器50さえ有していないため、センタ70からの受信動作のみを行う。具体的には、センタ70から、場所や歩行者の発生頻度を示す予測頻度などの予測情報を受信する。

【0072】

[6.センタの構成]

図4に、センタ70のブロック図を示す。

センタ70は、受信部71、要求処理部72、検索部73、結果処理部74、記憶部75、大規模予測部76、及び、配信部77を備えている。

【0073】

受信部71は、予測装置10,11から送信される情報を受信するための構成である。

要求処理部72は、予測装置10,11から所定情報の送信要求などがあると、検索部73へ当該情報の検索を指示する。

【0074】

検索部73は、記憶部75に記憶されたデータの検索を行うための構成である。検索部73による検索結果データは、記憶部75に記憶される。また、検索結果データは、配信部77へ送出される。

【0075】

結果処理部74は、例えば予測装置10から画像認識結果などのアップロード情報が送信されてきた場合、当該データを所定形式で記憶部75へ記憶する。具体的には、予測装置10,11から、歩行者発生頻度に関する信頼度付きの情報を受信し、それらを地理情報に関連付けて、時空間データベースを構築する。

【0076】

記憶部75は、ハードディスク装置などの記憶媒体として具現化される。

大規模予測部76は、記憶部75に構築される時空間データベースを利用し、歩行者の発生頻度にかかる大規模な予測演算を行う。予測演算の結果は「予報」として、記憶部75に記憶されると共に、配信部77へ送出される。

【0077】

配信部77は、予測装置10,11,12へ情報を配信するための構成である。

なお、ここでは、予測装置10,11からセンタ70への情報送信について説明したが、携帯電話機やPCなどの無線通信端末、及び、定点観測インフラ(交差点カメラなど)からもセンタ70へ情報送信されることとしてもよい。

【0078】

また、本実施形態では、認識器40及び予測器50の両方を備えるタイプ1の予測装置10を例に挙げて、以下説明を続ける。

[7.予報処理]

図5、図6、図7は、予測装置10にて実行される予報処理を示すフローチャートである。なお、この予報処理は、図5中にB10で示す「FATRの算出に関する処理」、図6中にB20で示す「FPFPの算出に関する処理」、及び図7中にB30で示す「認識器40の性能向上に関する処理」に大別される。そこで、以下では、全体の流れを一通り説明した後、これらのB10〜B30のブロックごとに詳細な説明を加える。

【0079】

[7−1.予報処理全体の流れ]

最初のS100では、ナビ走行予定経路を取得する。この処理は、ナビゲーション装置30にて実行されるものであり、ユーザによって設定された走行予定経路が取得される。

【0080】

次のS110では、予測対象区域を設定する。この処理は、例えばナビゲーション装置30により、予測対象区域の情報をユーザに入力させるように促すものとすることが考えられる。

【0081】

次のB10では、FATRを算出する。FATRは、上述したように、アトラクタの影響に基づく予測発生頻度である。

続く図6中のB20では、FPFPを算出し(S180)、B10にて算出されたFATRと合成して(S190)、予測対象区域での歩行者発生頻度を予測して報知する(S200)。

【0082】

次の図7中のB30では、認識器40の性能向上のための演算処理を行う。

そして、S310では、画像認識結果からアップロード情報を生成する。この処理は、図1中の情報生成部46の機能として実現される。次のS320では、アップロード情報をセンタ70へ送信する。

【0083】

[7−2.FATRの算出に関する処理]

図5中のB10に示すように、S120では、センタ70を利用するか否かを判断する。ここでセンタ70を利用しない場合(S120:NO)、S130へ移行する。一方、センタ70を利用する場合(S120:YES)、S140へ移行する。

【0084】

センタ70を利用しない場合に移行するS130では、ナビゲーション装置30が有するアトラクタ情報32を取得する。その後、S160へ移行する。

センタ70を利用する場合に移行するS140では、現在地及び走行予定経路をセンタ70へ送信し、アトラクタ情報を要求する。これにより、センタ70は、アトラクタ情報を送信してくる。そこで、S150では、センタ70からのアトラクタ情報を受信する。その後、S160へ移行する。

【0085】

S160では、FATR算出処理を実行する。

[7−2−1.FATR算出処理]

続けて、図8のフローチャートに基づき、FATR算出処理を説明する。

【0086】

最初のS400では、予測対象リンクを設定する。この処理は、予定経路上の位置xkを含むリンク$L(xk)を予測対象リンクとするものである。

次のS410では、アトラクタを探索してリスト化する。この処理は、予測対象区域$L(xk)周辺のアトラクタを探索し、i=1,・・・,Ikの番号を割り当てて、リスト化するものである。例えば、図10に示すように、病院A1、銀行A2、地下鉄駅A3、ショッピングセンタA4としてリストアップされる。

【0087】

続くS420では、アトラクタの番号iを初期化して「0」とする。

次のS430では、アトラクタの番号iをインクリメントする。これにより、アトラクタA1から処理が開始されることになる。

【0088】

続くS440では、タイムゲートを設定する。この処理は、アトラクタAiの情報(平均収容人数、営業時間など)を基に、タイムゲートTG(Ai)を設定するものである。

次のS450では、処理対象のアトラクタに起因する予測頻度を算出する。この処理は、Aiに起因する$L(xk)上の予測頻度FATR(xk,sl|Ai)を算出するものである。

【0089】

続くS460では、S450にて算出された予測頻度を足し合わせる。具体的には、FATR(xk,sl)=FATR(xk,sl)+FATR(xk,sl|Ai)を計算する。

次のS470では、全てのアトラクタを処理したか否かを判断する。ここで全てのアトラクタについて処理したと判断された場合(S470:YES)、FATR算出処理を終了する。一方、処理していないアトラクタがあるうちは(S470:NO)、S430からの処理を繰り返す。

【0090】

次に、図9に基づいて、上述したS450の処理の詳細について説明する。

最初のS451では、矩形波を設定する。この処理は、平均収容人数N0(i)を高さとする矩形波ΓTGiを設定するものである。

【0091】

次のS452では、経路を確定する。この処理は、アトラクタAiから予測対象区域までの経路$LNを確定するものである。

続くS453では、リンクをリストアップする。この処理は、n番目の分岐$Bnと(n+1)番目の分岐$Bn+1の間のリンク$Lnをリストアップするものである。なお、ここでn=1,・・・,N−1である。

【0092】

次のS454では、リンク番号nを初期化して「0」にする。

続くS455では、リンク番号nをインクリメントする。これにより、リンク$L1から処理が開始されることになる。

【0093】

次のS456では、発生頻度を分岐に応じて分割する。この処理は、リンク$Ln-1での発生頻度Nn-1を分岐$Bnに関してJn個に分割するものである。ここでは、特に情報がなければ、Jn等分する。

【0094】

続くS457では、全てのリンクを処理したか否かを判断する。ここで全てのリンクについて処理したと判断された場合(S457:YES)、S458へ移行する。一方、処理していないリンクがあるうちは(S457:NO)、S455からの処理を繰り返す。

【0095】

S458では、予測頻度を算出する。この処理は、リンク$LNのオブジェクトの存在時間、予測対象の時間範囲、及び、自車の通過時間に基づき、オブジェクトの発生頻度を予測頻度として算出するものである。

【0096】

以上が、図5中のB10で示した「FATRの算出に関する処理」である。ここで、この処理に対する理解を容易にするため、具体例を挙げて説明をする。ここでは、最初にアトラクタ情報について詳述し、その後、タイムゲートによる考え方を説明する。

【0097】

[7−2−2.アトラクタ情報]

アトラクタは、例えば、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園など、集客力があり、人の流出入を駆動する要素である。このアトラクタについて十分な地理情報(地図情報やWeb情報など)があれば、歩行者の発生頻度に関して一次予測が行える。

【0098】

そこで、本実施形態では、具体的に下記の情報を用いた予測手法を提案する。

(1)アトラクタのサービス時間帯(学校ならば登下校時間)。

(2)アトラクタの周辺の地図情報(特に位置とアクセス情報)、道路情報。

【0099】

(3)アトラクタ及びそのアトラクタへのアクセス情報が天候(雨、風、雪)の影響を受けやすいかどうか。

(4)アトラクタに出入りする人の移動度(歩行者、自転車)。

【0100】

[7−2−3.アトラクタのクラス分類]

アトラクタは、次の2種類のカテゴリによってクラス分類することができる。

(1)平均利用時間

A1クラス:4時間以上(例えば、学校、オフィスビル、駅など)

A2クラス:2時間〜4時間(例えば、病院、ショッピングセンタ、映画館、スポーツ施設など)

A3クラス:1時間〜2時間(例えば、銀行、店、レストランなど)

A4クラス:1時間未満(例えば、コンビニ、郵便局など)

(2)手段(経由地)であるか目的地であるか。

【0101】

B1クラス:利用時間帯がほぼさだまっている目的地(例えば、学校、オフィスビルなど)

B2クラス:利用時間がさだまっていない目的地(例えば、病院、ショッピングセンタ、映画館、スポーツ施設、コンビニ、郵便局、レストラン、店、銀行など)

B3クラス:利用時間がさだまっていない経由地(例えば、駅、バス停など)

アトラクタの機能する時間のうち、人の出入りの激しい時間帯を活性化時間と呼ぶことにする。特にそれがアトラクタ側で定めた時間帯である場合、それをタイムゲートと呼ぶことにする。

【0102】

[7−2−4.タイムゲート]

上記のアトラクタに付随するタイムゲート(以下、適宜「TG」と記載する)を高さ「1」の矩形波と考える。これを基本波形としてアトラクタ中に存在する歩行者頻度を高さとする波(歩行者発生頻度の確率波)を定義する。

【0103】

本実施形態では、簡単化のため平均収容人数N0(i)を高さとする矩形波Γπiを考える。そして、アトラクタから半径1km以内の予測対象区域(ターゲット)xkでは、矩形波Γπiを区間内の移動時間と観測時間範囲に応じて変形させる。

【0104】

移動時間は、移動度とターゲット区間の長さで決まる。移動度が時速4kmで200mの区間である場合、移動時間は3分となる。また、観測時間範囲は、予測対象となる時間範囲であり、予測の時間分解能に相当する。例えば、30分単位で設定し、朝8時から8時半までを観測時間範囲として設定することが考えられる。具体的には、時速40kmの自動車で200mの区間を通過する場合、観測時間範囲は、18秒間となる。

【0105】

アトラクタにおける矩形波Γπiは、予測対象区域xkとアトラクタAi(i番目のアトラクタを示す)の間の経路を通じて伝播(時間的には過去にさかのぼる)する。これを「逆伝播」と呼ぶことにする。矩形波Γπiは、経路途中の分岐の数に応じてその高さが低くなる。これは分岐によって歩行者数が少なくなっていくからである。ここで、分岐前の歩行者発生頻度と分岐後の複数経路の歩行者発生頻度の総和は等しいと仮定する。また、ここでは簡単化のため、この分岐は木構造であると仮定する。

【0106】

すると、距離L(xk/Ai)と途中の分岐数及び分岐の比率は、予報の性質に影響を与える。「分岐の比率」が関係するのは、各分岐に等分された数の歩行者が存在するとはかぎらないためである。また、予報の性質は、予測対象区域に逆伝播させた矩形波Γπiの高さ、すなわち確率的歩行者発生頻度である。

【0107】

なお、地図上でどのような分岐が経路上で生じ、各ルートで経路長がどういう値になるかに関しては、すでにその類のグラフアルゴリズムがカーナビゲーションシステムなどで使われているので、ここではその詳細は省略する。

【0108】

例えば、ある学校の登校時間帯を7時から8時までとすると、それをTGとして8:00前の30分程度で移動できる範囲にわたってTGが過去の方向に伝播し、その範囲内で人発生のピークが出現しやすくなる。すなわち、時間的に平均化された発生頻度とは異なる発生頻度になる場合が出てくる。計測データが著しく少ない場合には、このようなピークが発生する性質までもモデル化すれば予報の確信度をさらにあげることができる。

【0109】

TGの伝播を駆動する要素を列挙すると、次のようになる。

(1)TGが定義される場所(アトラクタ)

(2)TGを通過しようとするオブジェクトのカテゴリ(子供、自転車など)

(3)オブジェクトOj存在する(通過する)と想定される場所x(Oj)とアトラクタAiが存在する場所x(Ai)との間の経路

(4)オブジェクトの種類(歩行者、自転車、他)に応じた移動度

例えば、自転車は歩行者の3倍の移動度と仮定すると、想定区域(ターゲット)内における所定時間内の発生頻度は自転車のほうが1/3となる。

【0110】

[7−2−5.複数のアトラクタの影響]

次に複数のアトラクタの影響を考察する。複数のアトラクタ{A1,・・・,Ai,・・・AIk}が走行予定位置xkの近隣に存在する場合、Aiで駆動される矩形波ΓTGiがアトラクタAiにいたるルートに逆伝播し、予測対象区域上では複数のアトラクタから逆伝播したΓTGiの合成波形として人発生頻度が予測される。

【0111】

例えば、図11のように2つのアトラクタA1,A2が存在する場合、それぞれから想定する走行区域ターゲットにTGが逆伝播することによって、Aiが駆動する発生頻度F1とA2が駆動する発生頻度F2の和として発生する歩行者がターゲット区域における予測発生頻度となる。矩形波ΓTG1とΓTG2との合成を、図12に模式的に示した。

【0112】

これを一般化すると次式で表現される。

【0113】

【数6】

【0114】

[7−2−5.人の移動度]

本実施形態でいう人の移動度は、大きく分けて次の2種類である。

(1)歩行者の移動度:μP

(2)自転車の移動度:μB

歩行者は車両に比べて移動度の値および移動範囲は小さいが、移動に際しての自由度が高い。すなわち、追い越しも自由であるし、経路変更も任意である。さらに、車のように車両間の依存関係がない。

【0115】

このような移動度は、アトラクタAiに関連する情報(先見情報)がない場合には、純粋に統計計算で求める。一方、アトラクタAiに関連する情報(先見情報)がある場合、少ない計測結果に対してオフセットを与えることができる。

【0116】

[7−2−6.遭遇時間の予測]

TG(Ai)から予測対象区間ターゲットまでの距離とルートとは、ナビゲーション装置30による地図情報やWeb情報に基づき、取得することが可能である。

【0117】

したがって、TG(Ai)をルートに沿って逆伝播させれば、ターゲット内の人の存在時間(道路沿いの移動時間)を推定することができる。走行経路上で遭遇する歩行者発生頻度を予測する際の手助けとなる。

【0118】

このとき、以下のような制約を用いてもよい。

(R1)歩行者がアトラクタまで歩行によって移動する距離は1km程度とする。

(R2)自転車の場合は移動する距離は最大3km程度とする。

【0119】

(R3)歩行者、自転車ともに屋外の道路では天候の影響を受けやすい。

(R4)歩行者の移動度は自転車の移動度の1/3程度となる。

[7−2−7.TGの逆伝播の一例]

図13及び図14に学校をアトラクタとした場合のTGの逆伝播の例を示す。ここでは上記(R4)の制約を用いて30人中15人の生徒(うち12人が徒歩、3人が自転車)が同時に校門をスタートして帰宅する場合を想定し、交差点ごとの分岐で等分されていく仮定の下で、矩形波ΓTGiの伝播の様子をタイムチャートで示す。

【0120】

図14中のFBは自転車の発生頻度、FPは歩行者の発生頻度である。また、$L4={1/2,3/3,1/3,1/2}という表現はアトラクタから予測対象区域までの経路の分岐の様子を記述している。具体的には、図14に示すように、校門から出て右矢印方向を1/2、その反対方向を2/2と表現し、次の交差点では3分岐あるので同様に記述している。一般に、次に示すように、アトラクタから見た予測対象区域のリンクを表現することができる。

【0121】

【数7】

【0122】

ただし、Jnはn番目の分岐点における分岐数、jnはそのJn個の分岐のうちの(例えば分岐路に向かって最左から右回りで)jn番目の分岐を経路として選択することを意味する。この表記に基づき、F$obj($Ln)はn番目の分岐から(n+1)番目の分岐までのリンクにおけるオブジェクト$objに関する発生頻度を表す。

【0123】

図14の例では、$obj=Bが自転車の発生頻度を示し、$obj=Pが歩行者の発生頻度を示す。同様にD($Ln)はリンクの距離を表す。このような表記の下で、図14の地図上に各リンクにおける発生頻度の予想値を示す。

【0124】

ここでは15人の生徒が同時に下校を開始した場合を想定したが、実際は校門を出る時刻は、ばらつくと考えられる。このことを考慮して問題を簡単化すると、予測対象区域における平均予測発生頻度は予測発生頻度(矩形波ΓTGiの高さ)に黄色の区間で示した予測対象時間Tpredictと各オブジェクトの予測対象区域(リンク)における存在時間Texistの比をかけた値として算出される。すなわち、次の式で示される。

【0125】

【数8】

【0126】

さらに、自車の予測対象区域内の通過時間Texist#Cを考慮すれば、通過時の観測率λCが乗じられた発生頻度は次式で算出できる。

【0127】

【数9】

【0128】

なお、上記の各オブジェクト(歩行者、自転車、自車両)の存在時間はリンク長と移動度から次式で算出される。ただし、$obj=P,B,Cである。

【0129】

【数10】

【0130】

次に通学時の発生頻度をこの帰宅時の発生頻度と同じ理屈で予想できると仮定する。これは近似的に、上述の帰宅時のプロセスの時間軸を逆転させたメカニズムで算出できる。すなわち、上記で考慮した下校開始時刻のばらつきは登校時にもあると考えれば、概算としてほぼ同じ発生密度がアトラクタに対する時間差で(時間の向きは逆なので逆伝播と呼ぶ)観測されると予想される。したがって上記の平均予想発生頻度は登校時にも一次近似値として採用できる。

【0131】

[7−2−8.Web情報の利用]

アトラクタの位置や機能時間、活性化時間およびTGはWeb情報から得られる場合がある。また、天候、渋滞情報に関する情報も取得できる。

【0132】

[7−2−9.ナビ情報の利用]

ナビからは{現在位置、進行方向、周辺施設(アトラクタ)の有無、渋滞情報}に関する情報を得ることができる。

【0133】

[7−3.FPFPの算出に関する処理]

次に、図6中のB20で示した「FPFPの算出に関する処理」について説明する。

最初のS170では、過去の発生頻度データを検索する。この処理は、記憶部60に記憶された走行経路上の過去の発生頻度データを検索するものである。

【0134】

続くS180では、FPFPを算出する。この処理は、過去の発生頻度データに基づき、場所x状況sにおける発生頻度を予測した結果としてのFPFPを算出するものである。なお、詳しい算出方法については後述する。

【0135】

次のS190では、予測頻度FATRとFPFPとを合成する。この処理は、上述した式4によって2つの発生頻度FATRとFPFPとを合成するものである。

続くS200では、予測頻度を運転者へ報知する。この処理は、ナビゲーション装置30によって、報知部31を介して行われる。

【0136】

次のS210では、別経路に変更したか否かを判断する。この処理は、予測対象区域を回避して別経路への変更を行ったか否かを判断するものである。ここで別経路への変更を行ったと判断された場合(S210:YES)、図5中のS100からの処理を繰り返す。一方、別経路への変更を行っていないと判断された場合(S210:NO)、S220へ移行する。

【0137】

S220では、予測対象区域を走行しているか否かを判断する。ここで予測対象区域を走行している場合(S220:YES)、センタ70から最新のプローブ情報を受信し、S180からの処理を繰り返す。一方、予測対象区域を走行していない場合(S220:NO)、図7中のS240へ移行する。

【0138】

[7−3−1.過去の統計に基づく歩行者発生頻度の予測]

図15に、ユーザの車両Aにおいて、予測対象区域における歩行者発生頻度を提示する際の概略プロセスを示す。ここでは、予測対象区域に向かう車両Aがセンタ70に対して予測に必要な情報を送信し、一方で予測対象区域近辺をAが通過する以前(Aがリクエストを出す以前の過去も含む)に通過して撮像した車両(プローブカー)が画像認識結果に関する情報をセンタ70にアップロードしている様子を示している。このような状況設定のもとで複数のアトラクタとの関係やターゲットに向かう時間経過に応じて歩行者発生頻度が提示される。

【0139】

[7−3−2.予測対象区域の例示]

図16に実際の実験において設定した予測対象区域の例を示す。図16では、刈谷駅方面から知立駅方面へ走行し、店が立っている交差点を左折したことを示している。このとき、予測対象区域は、高架までの区間1、店までの区間2、店を過ぎた後の区間3として設定した。

【0140】

[7−3−3.特徴ベクトルの定義]

ここでは予測器50の出力である予測対象をベクトルとして表現する。図17に予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考えた場合の例を示す。これによって、ある車載カメラで観測される歩行者発生頻度の特徴ベクトル(予測の目的変数)は12次元となる。この特徴ベクトルの定義は、そのまま予測器50の学習においても用いられる。

【0141】

ただし、現状の画像認識技術では上記のような複雑な分類について高い認識率を達成することは困難である。高い精度の学習データを得るにはオフラインの高度な認識処理かあるいは複数のセンサの複合処理、または人手による正解付与に頼ることになる。図17では、人手による正解付与(GT:Ground Truth)を採用した。

【0142】

なお、ここでは、予測対象区域の部分領域として、自車から見て{右、左}という領域を設定しているが、さらに細かく部分領域を設定してもよい。例えば、図18は、実際に車両から撮影した画像を示し、画像認識における部分領域の設定例(ここでは{左側歩道、走行車線、対向車線、右側歩道})を示している。

【0143】

[7−3−4.状況ベクトルの定義]

特徴ベクトルが発生する際に、その説明変数となる状況情報は図17における{場所、日時、天候}である。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とした。

【0144】

したがって、状況ベクトルは合計28次元となり、これに対する特徴ベクトルの回帰関係を線形最小2乗法(後述の式17参照)で解いた結果が図19の右側のグラフである。これらが予測結果となる。すなわち、左側は目視による計測結果をグラフ化したものであり、右側は自己交差の回帰予測結果をグラフ化したものである。ここで、オブジェクトは、「1」が左女性、「2」が左子供、「3」が左男性、「4」が左不明、「5」が左自転車、「6」が左犬、「7」が右女性、「8」が右子供、「9」が右男性、「10」が右不明、「11」が右自転車、「12」が右犬となっている。また、同様に、想定される種々の状況の下での予測例を図20(a)〜(f)に示した。

【0145】

なお、状況ベクトルはさらに拡張することができ、時間情報に関しては、日種効果、季節効果、時間帯効果、年中行事の影響などを考慮してもよい。渋滞予測に応用することも考えられる。また、道路環境や地理要因についても拡張可能であり、それらは各要因を表現する語彙に対して数量化(例えば0と1の間の値)を施すことで行う。

【0146】

[7−3−5.信頼度を用いた予測]

本実施形態における予測性能は認識器40の性能に大きく影響される。認識器40の性能は、一般に停車時と走行時では異なる。歩行者を含む移動体に関しては停車時のほうが認識率は高いため、停車時の認識結果の信頼度は走行時よりも高い。たとえば「定点(停車時)においては認識率Ri>80、走行時ではRi=60程度」といった例が考えられる。さらには、一般的に走行速度が速いほど、歩行者や自転車に対する相対速度が大きくなり、それらの認識率は低下する。

【0147】

「停車時」をさらに状況分類すると、{交差点の一時停止、道路わきの停車、駐車場の停車}といった場所のタイプが関与する。また、「走行時」においても画像認識のしやすさは周囲背景の影響を大きく受ける。特に、対向車両や先行車両、ビルや街路樹、ガードレール、道路標識の白線、障害物などは歩行者の認識率を左右する。

【0148】

そこで、認識器40の出力(確信度)に対して認識器40の信頼度riを付与することとし、自車速度と場所のタイプに応じた平均認識率をもってその値とする。このように環境条件に応じた認識器40の性能変動を認識器40の信頼度で表現し、信頼度つきの認識結果をナビ上に記憶する、あるいはセンタに送信することで地図上に認識結果の時空間情報を作成することが可能になる。

【0149】

自転車と人では発生の分布が異なると考えられる。これは主として移動度と移動範囲に起因する。この性質を利用して、認識器40と予測器50の設定を行う。

[7−3−6.信頼度の設定]

認識器40の信頼度については下記のような設定が考えられる。

【0150】

(1)オブジェクトごとに認識率の信頼度を変える。{歩行者、自転車}

(2)計測地点ごとに認識率の信頼度を変える。下記の要素が計測地点の環境特徴として認識器40の性能に影響を与えるため、信頼度に変化をもたらす。

【0151】

・{道幅、歩道幅、ガードレールの有無、白線、電線の有無、街路樹}

・{交差点、単路}

・{商店街、住宅街、オフィス街}

(3)センサ(認識手法を含む)ごとに認識率の信頼度を変える。

【0152】

(4)車両の走行速度に応じて信頼度を設定する。

例えば、次のカテゴリで走行速度を分類する。[停車、発進、徐行、低速、中速、高速]

[7−3−7.センタへのアップロード]

いま、iをセンシングが行われた地点名の番号とするとき、(xi,si,ri,fi)を予測装置10からセンタ70へのアップロード情報とする。ただし、

xi:地点iの座標

si:地点iの状況

ri:認識器40の信頼度(条件ごとの平均認識率)

fi:予測器50の結果

である。また、siは以下の情報を含む。

【0153】

(1)場所のタイプ:{駅前, 住宅街, ビル街, 公園, 海岸, 他}

(2)道路環境:{交差点, 単路, 駐車場}

(3)走行状態:({停車,発進,徐行,走行中}, 走行速度)

(4)歩行者の存在方向:{右, 正面, 左}

(5)認識結果:{歩行者,自転車,それ以外}

[7−3−8.異なる車両間での認識結果の対応づけ]

図21に示すように異なる車両A,Bが同時に同じ地点の歩行者を観測した場合、歩行者発生の統計量という観点でいえば、Aの画像とBの画像の間で対応付けを行い、重複してカウントすることを防ぐ。ただし、この対応付けを行うには、三次元的な歩行者位置を高精度で獲得する必要がある。一方で、事故発生にいたる危険度という観点では、同じ歩行者に対して観測する車両台数分だけ危険度は増大すると考えることもできる。

【0154】

そこで、本実施形態では、

(規範1)純粋に歩行者の発生数の統計データの獲得を志向する。

(規範2)上記を危険度に換算して延べ歩行者人数を統計データとする。

【0155】

の2つの規範を考える。

一般に、A,Bで同一場所の歩行者群を観測した場合、対応をとることの技術的難易度は高い。そこで、

(1)和をとる方法(延べ人数の算出を行う)

(2)複数の観測値から代表的な値を算出する方法

(2−1)平均値をとる方法

(2−2)最大値を選ぶ方法

(3)高度なバッチ処理を行う方法

が考えられる。

【0156】

ここで方法(1)は(規範2)に該当する。すなわち、複数台の車両で同一の歩行者を撮影したときも延べ数としてカウントする。もし、センタ70に撮像位置を付した映像データが集積されるならば(3)により上記の対応付けも可能となる。

【0157】

[7−3−9.予測の時間範囲]

プローブカーに代表される車両(予測装置10)からセンタ70に撮像画像をアップロードし相互利用するという考えに基づくと、センタ70でそのアップロードされた画像群に大規模かつ高度な演算を施し、歩行者その他の認識を行うことは可能である。

【0158】

この場合、サービスをうける車両は、少なくとも自車位置からセンタ70との交信およびセンタ70での計算を考慮した遅延時間に相当する距離だけ離れた位置について予測された情報を受け取ることができる。予測の信頼度が多少低くても即座に予報を得たいという場合は自車位置に関する過去の統計情報から予想された歩行者発生頻度を即座にセンタ70から得ることができる。

【0159】

[7−4.認識器40の性能向上に関する処理]

次に、図7中のB30で示した認識器40の性能向上に関する処理について説明する。

S240では、認識パラメータを設定する。この認識パラメータは、画像認識のためのパラメータである。

【0160】

S250では、画像から歩行者を認識する。この処理は、撮像部41からのデータに基づき、認識器40が行うものである。

次のS260では、部分領域ごとの発生頻度に変換する。

【0161】

続くS270では、差分を評価する。

次のS280では、差分が閾値以下か否かを判断する。ここで差分が閾値以下であると判断された場合(S280:YES)、S290にて信頼度を算出し、S320へ移行する。一方、差分が閾値を上回ると判断された場合(S280:NO)、認識パラメータを修正して、S240からの処理を繰り返す。

【0162】

[7−4−1.認識器40の性能向上]

予測を目的とする場合は、画像の認識演算は必ずしも車載でリアルタイムに行う必要はない。画像データと位置情報をセンタ70に伝送し、センタ70側で大量に一括処理することも考えられる。また、このような画像伝送に適した認識方式も提案されている。以下では、予測器50と認識器40とのインタラクションを想定した認識器40の性能向上について説明する。

【0163】

[7−4−2.認識パラメータの設定]

(1)過去のデータに基づく設定

過去のデータから予測した歩行者発生頻度の時空間分布を初期値として、これから行う画像認識のパラメータを設定する。例えば、以下のようにすることが考えられる。

【0164】

・通学団が多いところでは複数の集団認識にあった認識パラメータを設定する。

・自転車が多いところでは自転車用の認識パラメータを設定する。

・過去のデータから地図上の位置および撮像画面上の部分領域(図18参照)の位置について重み付けを施す。

【0165】

(2)対象オブジェクトに応じた設定

(2―1)移動度および移動範囲に基づく設定

自転車と人では移動度と移動範囲が異なるため、発生頻度の分布も異なってくる。この性質を利用して、認識器40及び予測器50を設定する。

【0166】

例えば、自転車など移動度の高い対象物の場合は過去に通り過ぎた場合でも、交差点停車時に追いつかれて再度目前に出現するケースがある。このような場合、隣接する複数の空間範囲(1つの空間範囲は本実施形態で予測頻度の算出対象となる走行系路上の1区域とする)にまたがった時間範囲での出現予測が必要となる。例えば、走行予定経路に沿ってxa,xb,xcの3つの領域がその順番に隣接している際に、xa区間内で走行する方向と同じ方向に進路をとる自転車B1を検出した際には、xbまたはxcに存在する交差点において再度B1と遭遇する可能性があるため、自転車の予測頻度を高めておくという具合である。

【0167】

(2−2)オブジェクトの画像特徴に基づく設定

オブジェクトの形状、空間スペクトル(DCT係数など)、動き、色などを含む画像特徴およびその時系列変化を特徴ベクトルとする認識特性(多変量回帰分析では回帰係数行列、主成分分析では固有行列がそれに相当する)を利用して、認識器40及び予測機を設定する。

【0168】

(2−3)認識対象領域の限定

歩行者存在領域(歩道、車道、駐車場、階段など)は一般に統計的に限定することができる。しかし、それらを撮影する車載カメラの位置姿勢は車載カメラの取り付け位置や車の走行状態に応じて変化するために、シーン中での見え方が変化する。ただし、その変化は車載カメラであるがゆえにある程度パターン化できるため、ケースバイケースで画像面上の二次元領域として歩行者存在領域を限定することは、なおも可能である。

【0169】

(2−4)予想される歩行者のタイプに応じた設定

特開2009−271758号公報に開示したように、歩行者のタイプに応じた認識特性を選択し、それにあったパラメータを設定することができる。ここでは過去の統計や周囲環境をもとに、たとえば通学児童が多いならばその身長や動きにあった認識パラメータ(DCT係数のAC電力に関する判定閾値や主成分電力の判定閾値、動きの発生状況など)、老人の一人歩きが多いようであればそれにあったパラメータを優先的に設定するなどが考えられる。

【0170】

[7−4−3.認識器40の原理]

いま、ある車両のカメラで撮影した画像において、特開2007−060273号公報及び、特開2007−072987号公報に開示したように、画像中に存在しうるオブジェクトの確信度を画像データ特徴量に対する多変量線形回帰モデルで表現すれば、次式で歩行者認識の結果を算出することができる。

【0171】

【数11】

【0172】

ただし、CBは(K×N)の行列であり、k行n列の成分[CB]knは画像中のk番目の部分領域がカテゴリnのオブジェクトである場合の確信度を表す。

いま、歩行者であるかどうかだけであるならばN=1としてCBは列ベクトルとなり、k行目の成分はk番目の部分領域(たとえば画像中のブロック画素)に映るオブジェクトが歩行者である確信度を表す。もし、N>1の歩行者分類があれば[CB]knは部分領域kにおけるカテゴリnの歩行者(たとえば男性、女性、子供、など)を表す。あるいはN=2として歩行者確信度と非歩行者確信度をn=1,2に割り当てることもできるし、歩行者のカテゴリに方向因子{右、正面、左など}を含めることもできる。ただし、一般に分類のカテゴリが増えるほど認識器40は高い性能が求められるため、現状の画像認識技術では歩行者の有無程度にとどめておくほうが現実的である。

【0173】

SBは(K×L)の行列であり、状況ベクトルssと画像特徴ベクトルspで構成される特徴ベクトルsB(L次元列ベクトル)を転置した行ベクトルsBT(k)をk行目に含む。Bはこれらの特徴量に対する回帰係数行列(L×N)である。このBは最小二乗法により求めることができ、次式のようになる。

【0174】

【数12】

【0175】

ここで、初期のBを算出するためにはYB(K×N)にサンプル映像から人間が作成した正解値(GT)を、SBにはその各々に対応する画像などの特徴量を入れてやる必要がある。このBを用いて新たなシーンで歩行者を認識させる。そのときの認識の信頼度はその平均認識率として算出することができる。ただし、走行開始後にGTをリアルタイムで獲得することはほぼ不可能であるため、その後の認識履歴はリアルタイムでは推定した確信度ベースとなる。一方で、センタへのアップロードを行うかあるいは走行終了後にオフライン処理を行えば走行映像にGTを付与していくことはできる。

【0176】

なお、歩行者の認識に関しては特開2009−271758号公報のように、差分画像のDCT係数をベースにして時系列特徴量を構成し、主成分分析で判定する方法も適用できる。この場合、上記式11のSBを主成分分析によって次元圧縮された特徴量で構成することで、それ以後の回帰係数を用いた認識の枠組みがそのまま適用できる(主成分回帰分析)。それ以外にも非線形手法を含む多くの方法(SVMや動的テンプレート、動きベクトルを用いる方法など)が存在し、学習型の認識手法の場合は学習データと認識特性の関係において上記と類似した様相(学習量の増大に伴う認識率向上、過学習(overfitting)、学習不適合、異常値、データ欠損の問題など)を呈する。本実施形態ではそれらの詳細は省略する。

【0177】

[7−4−4.予測器50]

過去の統計に基づく予測頻度の行列FP(KP×M)は多変量回帰予測によれば、次式で表される。

【0178】

【数13】

【0179】

ただし、

P:回帰係数行列(LP×M)

sP:特徴ベクトル(LP×1)

SP:特徴行列(KP×LP)

である。Pは認識器40の場合と同様に最小二乗法を用いて次式で算出できる。

【0180】

【数14】

【0181】

予測頻度のデータ行列YP(KP×M)は上述の車載の認識器40が算出した確信度行列CB(画像内の部分領域ごとの認識結果)を用いて作成することができる。これはCBで歩行者と判定された部分領域から歩行者数を計数し、予測対象区域内の部分領域(M個)における発生頻度値に変換することで可能になる。いま、この変換操作を次式で表現する。

【0182】

【数15】

【0183】

ここでCBの信頼度がRB(≒70)であれば、CBから生成したYPを学習データとする回帰係数行列Pの信頼度もたかだかRB程度になる。いま、この機械認識によって推定した真理値をET(Estimated Truth)と呼ぶことにする。

【0184】

もし、オフライン処理などにより人間あるいは完全な認識器40が与えた正解値(GT)を用いることができるならば、上記のRBはほぼ100%とすることができる。このETとGTを用いて予測の条件を論理的に分類すると以下のようになる。

【0185】

(1)過去の統計データなし(GT、ETともになし)

(2)GTなし、ETあり

(3)GTあり、ETなし

(4)GTとETが混在

これらの場合を統一的に表現するためには、RBの値を認識データに付与すればよい。いま、CBにGTとETが混在している場合、上記式4を想定すると、CBは、次式で表される。

【0186】

【数16】

【0187】

つまり、各学習イベントの実効確信度が認識器40の信頼度と認識器40が出力した確信度の積で表現された値となる。ただし、

M:地点kにおける部分領域(歩行者が存在しうる領域。図18参照)の最大個数。車道内/車道外、進行方向の右側/左側、などを分類のカテゴリとして部分領域を定義することができる。

【0188】

rk:地点kの画像に用いた認識器40の信頼度。人間によるGTの場合はほぼ値1をとる。厳密にはスキルによって左右されるため、1未満になる場合もある。

fkm:地点kで撮影した画像中のm番目の部分領域で認識された歩行者の数(認識器40が出力した歩行者発生頻度)

である。このYP^を過去の統計データとして予測頻度の行列FPの近似値FP^を算出すると、次式のようになる。

【0189】

【数17】

【0190】

となる。この確信度FP^の信頼度R(FP^)が、たとえば

【0191】

【数18】

【0192】

ならば予測器50と認識器40のトータルの性能はサービス要件を満たすと判断できる。

[7−4−5.同一場所のセンシング]

同じ場所と時間における複数の観測値については、各々の観測値に基く確信度をスコアとみなして合計し、平均値あるいは総合点の閾値判定をする。そこで、同じ時空間XTθで撮像される複数の画像(所定区域内Xで同じ時間帯Tに同じ進行方向θで撮影した複数の画像)に対して、複数の認識器40が認識結果(確信度ベクトル)を集積させる。すなわち、次式で示される。

【0193】

【数19】

【0194】

ここで、rnは次のようになる。

【0195】

【数20】

【0196】

また、

n:認識器の識別番号であり、n=1,・・・,N

f0:初期の歩行者頻度ベクトル

fn:認識器nが出力する歩行者頻度ベクトル

f:N個の認識器の出力の平均値

sl:時刻を含む状況ベクトル(lは離散時刻のインデックスを示す整数)

上の式19により、対象地点kごとに算出する。この場合、認識器40の信頼度が低い値であってもその集積効果により、全体として十分な信頼度の確信度を出力することができると期待される。

【0197】

[7−4−6.1台の車両による観測]

車載カメラ画像の認識結果、撮影時刻、撮影場所はカーナビの地図上で対応付けて記憶装置に格納することができる。このようにして1台の車が観測したデータを車載のハードディスクなどに蓄積しておけば、ナビゲーション装置を介して位置xkを指定することで、それまでの通過時刻の履歴{sl}を検索することができる。また、時間情報を状況ベクトルsで指定すれば他の周囲状況や通過地点xが検索できる。1台の車が何度も同じルートを通る場合、車に蓄積される観測データでルート上の通過地点に関する予測(蓄積データにはない未来時刻に関する人発生頻度を推定する)を行うことが可能になる。これは、日種、曜日、時間帯に依存した時空間分布を仮定することで可能になる。

【0198】

1台の車に記憶された過去の統計データから、これから走行する予定位置における歩行者発生頻度を予測するには、上記式17により次式を計算すればよい。

【0199】

【数21】

【0200】

ただし、

xk:各成分は番号kを割り振られた地点を地理的に特定する語彙(座標、地名に関する言語表現)、すなわち非数値情報に対応し、これらを数量化理論により数値化した値をとる。具体的には、各語彙を予測対象として指定するときに1、そうでなければ0を入れる。

【0201】

sl:各成分は番号lを割り振られた離散時刻を特定する語彙(季節、月、曜日、時間帯)と対応しており、予測条件として指定するときに1、そうでなければ0を入れる。さらには離散時刻lにおけるxkの付帯状況(天候や周囲環境など)もこのベクトル内で記述できる。

【0202】

また、予測対象となった地点で車両が実際に観測した値F1と予測値F0との間の誤差ΔFは次式で表される。

【0203】

【数22】

【0204】

[7−4−7.統計データの分類]

予測器50の入力となる統計データは以下のソースから得られる。

(1)車載の認識器40の出力(ET)または人手によるGT

(2)センタ上の認識器の出力または人手によるGT

(3)携帯機器やPCによる認識結果(ET)または人手によるGT

(4)定点観測インフラによる認識結果(ET)または人手によるGT

危険度という観点では、上記の統計データは次のカテゴリで事前に分類されていることが望ましい。

【0205】

(a)歩行者の車道内歩行者と車道外歩行者

(b)走路進行方向の右か左

などを分類して予測できれば実効性が向上する。これは観測区域をドライバーの視野から見てM個の部分領域に分割し、それらを特徴ベクトルに組み込むことで容易に実現される。

【0206】

[7−4−8.認識器40の性能改善]

予測器50で算出した予測発生頻度と認識器40が走行時に撮像した画像から算出した発生頻度の間の差分が大きければ、予測器50と認識器40の少なくともどちらか一方について修正を施す必要がある。いま、その差分の大きさを次式のスカラー値で表現する。

【0207】

【数23】

【0208】

これは絶対値規範による予測誤差電力と解釈できる。このEPがある閾値EPTHを超えるとき、予測器50と認識器40とに関わる修正を行う。

しかるに、上記式4の予測器50に関して大幅な修正が必要となるのは以下のケースに限られる。

【0209】

(1)FATRにおいて、アトラクタとタイムゲートに関する設定が大きく間違っている場合

(2)FRFPにおいて、学習データの質または量が十分でない場合

ここで(1)は画像認識が関与しないためここでは考えないこととし、特に(2)に注目する。FRFPにおいてどのような予測方式を用いるかによって性能は変わりうるが、ここではあるひとつの予測方式に限定した場合(本実施例では多変量線形回帰予測:式13、式14)の修正について考える。

【0210】

予測器50の学習データをすべて人手で作成するのは一般に困難であるので、認識器40の出力を信頼度つきで予測器50の学習データとすることはすでに述べた。したがって、予測器50の改善の問題は、認識器40の性能改善の問題に集約される。

【0211】

認識器40の性能改善に際しては次の2つの手法がある。

(IP1)画像認識の学習データの質と量を改善する。

(IP2)画像認識の設定パラメータを改善する。

【0212】

まず、(IP1)に関しては、次の制約式を満たすまで、学習データを増やすことを行う。

【0213】

【数24】

【0214】

ただし、rnは、上記式20で示すごとくである。

すなわち、{認識器40の平均値が閾値1(fth)以上}かつ{プローブによる確信度の合計値が閾値2(Φth)}となるまで学習データを増大させる。これはプローブシステムによってセンタが集めた信頼度つきの画像認識結果を学習データとしてダウンロードすることによって行われる。あるいは事前にセンタ上で計算した認識特性(回帰係数行列)をダウンロードしてもよい。この(IP1)が完了した段階で再度、上述の予測と認識のプロセスを繰り返し、上記式22で差分を再評価する。ここで、式23のEPを再度計算し、EPがEPTH以下になるならば修正はここで終了する。もし、EP>EPTHであれば、(IP2)を開始する。

【0215】

(IP2)の処理、予測、認識、EP評価を繰り返し、EPがEPTH以下になれば終了する。所定のパラメータ範囲内でEPTH以下にならなければ、修正を終了してEPが最小値をとった場合のパラメータを暫定的に採用し、センタに他の車両の認識器40の設定例を問い合わせる。

【0216】

[8.効果]

本実施形態では、過去の発生頻度データを検索し(図6中のS170)、FPFPを算出する(S180)。具体的には、予測器50の出力である予測結果をベクトルとして表現する。つまり、予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考え、ある車載カメラで観測される歩行者発生頻度の特徴ベクトル(予測の目的変数)を12次元とした。また、特徴ベクトルが発生する際に、その説明変数となる状況情報を{場所、日時、天候}とした。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とする。そして、この28次元の状況ベクトルに対する特徴ベクトルの回帰関係を線形最小2乗法で解くようにした。

【0217】

このように、過去の発生頻度データを時空間情報(状況ベクトル)及び頻度情報(特徴ベクトル)からなる頻度データとし、このような頻度データに基づき、予測器50によって、予測対象区域におけるオブジェクトの発生頻度を予測する。

【0218】

これにより、予測対象区域における歩行者等のオブジェクトの発生頻度を適切に予測することができる。

また、本実施形態では、車両外部を撮像する撮像部41と、撮像部41にて撮像される画像に基づき、画像認識結果から頻度情報を生成する認識器40とを備える構成とした(図1参照)。これにより、頻度データを自車両に集積することが可能となる。

【0219】

さらにまた、本実施形態では、認識器40による画像認識結果に対する信頼度を算出する演算部45を備える構成とした(図1参照)。演算部45は、オブジェクトの種類、計測地点、画像認識のためのセンサ及び認識手法、並びに、車両の走行速度の少なくともいずれかに基づき、信頼度を算出する(図7中のS290)。これにより、集積される画像認識結果に対し信頼度という重み付けを行うことができる。その結果、認識器40による画像認識結果を予測器50の学習データとして用いることができる。

【0220】

また、本実施形態では、送受信部20が、車両走行地点の情報、認識器40による画像認識結果、演算部45にて算出された信頼度、及び、予測器50の予測結果をセンタ70へアップロードする(図7中のS310,S320)。これにより、予測装置10を搭載する自車両がプローブカーとして機能する。また、信頼度をアップロードするため、センタ70に集積される画像認識結果に対し信頼度という重み付けを行うことができる。さらにまた、予測器50による予測結果をアップロードするため、予測器50を具備しない車両(図3参照)に対し、予測結果をセンタから配信することができる。もちろん、予測結果をセンタ70へ送信しない場合でも、センタ70側で予測を行い、当該センタ70側の予測結果を配信するようにしてもよい(図4中の大規模予測部76及び配信部77)。

【0221】

さらにまた、本実施形態では、画像認識のための認識パラメータを認識器40に設定するパラメータ設定部42を備えている(図1参照)。パラメータ設定部42は、過去の頻度データに基づき、又は、対象となるオブジェクトに応じて、認識パラメータを設定する。これにより、画像認識性能の向上に寄与する。

【0222】

しかも、予測器50による予測結果と認識器40による画像認識結果との差分が閾値以上の場合(図7中のS270,S280)、認識パラメータを修正する(S300)。これにより、認識器40の性能改善が図られる。

【0223】

なお、予測器50による予測結果と認識器40による画像認識結果との差分が閾値以上の場合(図7中のS270,S280)、センタ70に集積されたアップロード情報を取得するようにしてもよい。このようにすれば、認識器40の学習データの質と量とが改善される可能性が高くなる。その結果、予測器50による予測結果と認識器40による画像認識結果との差分を小さくすることに寄与する。

【0224】

また、本実施形態では、過去の頻度データがない場合でも、地理的な要因などからオブジェクトの発生頻度を予測する。

具体的には、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園などのアトラクタの情報を取得し(図5中のS130,S150)、FATRを算出する(S160)。詳細には、アトラクタ情報からタイムゲート(TG)を設定し(図8中のS440)、タイムゲートを矩形波として当該矩形波の伝播を想定し、分岐路で発生頻度の分割処理を行う(図9中のS451〜S453,S456)。これにより、過去の頻度データが少ない場合でも、地理的な要因などからオブジェクトの発生頻度を予測することができる。また、タイムゲートを矩形波で定義するため、アトラクタに起因するオブジェクトの発生頻度を比較的容易に予測することができる。さらにまた、タイムゲートを定義する矩形波は、アトラクタの平均収容人数を高さとするものとして初期化される。これにより、タイムゲートを比較的簡単な矩形波として定義することができる。また、予測器50は、時間的に遡る矩形波の伝播である逆伝播に基づき、予測対象区域におけるオブジェクトの発生頻度を予測する。これにより、アトラクタに対してのオブジェクトの流入時間から、それ以前のオブジェクトの発生頻度を予測することができる。さらにまた、予測器50は、自車両の予測対象区域の通過時間を考慮して、予測対象区域におけるオブジェクトの発生頻度を予測する。これにより、確実にオブジェクトの発生頻度を予測することができる。

【0225】

なお、本実施形態における送受信部20が「頻度データ取得手段」及び「送信部」に相当し、予測器50が「予測器」に相当し、撮像部41が「撮像部」に相当し、認識器40が「認識器」に相当し、演算部45が「演算部」に相当し、パラメータ設定部42が「パラメータ設定部」に相当する。

【0226】

また、図5中のS130及びS150が「アトラクタ情報取得手段」の機能としての処理に相当し、図8中のS440が「タイムゲート設定手段」の機能としての処理に相当する。

【0227】

以上、本発明は、上述した実施形態に何ら限定されるものではなく、その要旨を逸脱しない範囲において種々なる形態で実施可能である。

【符号の説明】

【0228】

10,11,12…予測装置

20…送受信部

21…受信部

30…ナビゲーション装置

31…報知部

32…アトラクタ情報

40…認識器

41…撮像部

42…パラメータ設定部

43…評価部

44…変換部

45…演算部

46…情報生成部

50…予測器

60…記憶部

70…センタ

【技術分野】

【0001】

本発明は、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する技術に関する。

【背景技術】

【0002】

従来、プローブカーで集めた車両位置情報を基に、渋滞予測や旅行時間の推定を行う技術が開示されている(例えば、特許文献1参照)。ここでは単なる回帰分析ではなく、欠損値付き主成分分析(PCAMD )を用いることで、データの欠損を補っており、理論的には制約付き主成分分析がベースになっている。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特許第4329711号

【発明の概要】

【発明が解決しようとする課題】

【0004】

ところで、所定の区域における歩行者や自転車などの発生頻度を予測することが出来れば、歩行者や自転車などの安全が確保され、運転者の負担軽減にも寄与する。

しかしながら、上記特許文献1では、自車情報(特に位置)が基本になっており、車外環境の観測量(歩行者の数や自転車の数など)を用いたものではない。また、車両の移動特性と歩行者や自動車の移動形態、発生形態は異なると考えられ、車両の渋滞予測技術をそのまま歩行者に適用することはできない。

【0005】

本発明は、予測対象区域における歩行者等の発生頻度を予測可能な予測装置を提供することを目的とする。

【課題を解決するための手段】

【0006】

上記目的を達成するためになされた請求項1に記載の予測装置は、車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する。ここでオブジェクトとは、主として人間であるが、犬などの動物をも含む。また、予定走行経路は、例えばナビゲーション装置で探索された経路であることが考えられる。

【0007】

このとき、頻度データ取得手段は、過去の発生頻度に関する頻度データを取得する。この頻度データは、時空間を定義する「時空間情報」及び当該時空間情報に対応しオブジェクトの発生頻度を定義する「頻度情報」とからなる。このような頻度データは、予測装置の記憶手段に記憶されるものとしてもよいし、外部のセンタに記憶されているものとしてもよい。頻度データが外部のセンタに記憶されている場合、頻度データ取得手段は、センタとのデータ通信によって頻度データを取得することになる。そして、このような頻度データに基づき、予測器によって、予測対象区域におけるオブジェクトの発生頻度が予測される。

【0008】

このような過去の発生頻度に関する頻度データを自車両に又はセンタに集積しておけば、予測対象区域における歩行者等のオブジェクトの発生頻度を適切に予測することができる。

【0009】

なお、「時空間情報」は、例えば請求項2に示すように、状況情報を説明変数とする「状況ベクトル」として定義されるものとすることが考えられる。この状況情報には、請求項3に示すように、場所、日時、及び、天候の情報が含まれることとしてもよい。

【0010】

また、「頻度情報」は、例えば請求項4に示すように、特徴情報を目的変数とする「特徴ベクトル」として定義されるものとすることが考えられる。この特徴情報には、請求項5に示すように、オブジェクトの種類及び車両からの景観を複数に分割した部分領域の情報が含まれることとしてもよい。

【0011】

このような状況ベクトル及び特徴ベクトルを用いることで、比較的簡単に予測を行うことができる。例えば、請求項6に示すように、予測器は、状況ベクトルに対する特徴ベクトルの回帰関係を線形最小二乗法で解くことにより、予測対象区域におけるオブジェクトの発生頻度を予測することが考えられる。

【0012】

ところで、頻度データのセンタへの集積を考えた場合、請求項7に示すように、車両外部を撮像する撮像部と、撮像部にて撮像される画像に基づき、画像認識結果から頻度情報を生成する認識器とを備える構成とすることが考えられる。この場合、認識器が頻度情報を生成するため、頻度データを自車両に集積することが可能となる。

【0013】

ただし、認識器による画像認識結果は、種々の要因によって影響を受ける虞がある。そこで、請求項8に示すように、認識器による画像認識結果に対する信頼度を算出する演算部を備える構成としてもよい。例えば請求項9に示すように、演算部は、オブジェクトの種類、計測地点、画像認識のためのセンサ及び認識手法、並びに、車両の走行速度の少なくともいずれかに基づき、信頼度を算出することが例示される。これにより、集積される画像認識結果に対し信頼度という重み付けを行うことができる。その結果、認識器による画像認識結果を予測器の学習データとして用いることができる。

【0014】

認識器を備える構成を前提とすれば、請求項10に示すように、送信部が、車両走行地点の情報、及び、認識器による画像認識結果をアップロード情報としてセンタへアップロードする構成を採用することが考えられる。このようにすれば、予測装置を搭載する自車両がプローブカーとして機能する。

【0015】

このとき、請求項11に示すように、アップロード情報に、演算部にて算出された信頼度が含まれることとしてもよい。このようにすれば、信頼度付きの画像認識結果がセンタへアップロードされるため、センタに集積される画像認識結果に対し信頼度という重み付けを行うことができる。また、請求項12に示すように、アップロード情報に、予測器による予測結果が含まれることとしてもよい。このようにすれば、予測器を具備しない車両に対し、予測結果をセンタから配信することができる。もちろん、予測結果をセンタへ送信しない場合でも、センタ側で予測を行い、当該センタ側の予測結果を配信するようにしてもよい。

【0016】

ところで、学習データの質または量が十分でない場合、予測器による予測結果と認識器による画像認識結果とが大きくずれることになる。上述したように認識器による画像認識結果を予測器の学習データとすることができるため、予測器の改善の問題は、認識器の性能改善の問題に集約される。

【0017】

そこで、請求項13に示すように、予測器による予測結果と認識器による画像認識結果との差分が閾値以上の場合、センタに集積されたアップロード情報を取得することが考えられる。これによって、認識器の学習データの質と量とが改善される可能性が高くなる。その結果、予測器による予測結果と認識器による画像認識結果との差分を小さくすることに寄与する。

【0018】

なお、本発明は、認識器の学習データによる性能改善という特徴から、次のように構成してもよい。すなわち、「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、過去の発生頻度に関する頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、車両外部を撮像する撮像部と、前記撮像部にて撮像される画像に基づき、画像認識結果から前記頻度データを定義する頻度情報を生成する認識器と、を備え、車両外部のセンタに信頼度の付与された画像認識結果が集積されていることを前提として、前記予測器による予測結果と前記認識器による認識結果との差分が閾値以上の場合、前記センタに集積された前記画像認識結果を前記認識器の学習データとして取得することを特徴とする予測装置。」である。

【0019】

また、画像認識の性能を高めるために、認識パラメータを設定することが考えられる。すなわち、請求項14に示すように、画像認識のための認識パラメータを認識器に設定するパラメータ設定部を備えていることとしてもよい。

【0020】

具体的には、請求項15に示すように、パラメータ設定部は、過去の頻度データに基づき、認識パラメータを設定することが考えられる。例えば、通学団が多いところでは複数のオブジェクトを認識するための認識パラメータを設定するという具合である。また例えば、自転車が多いところでは自転車用の認識パラメータを設定するという具合である。

【0021】

また具体的には、請求項16に示すように、パラメータ設定部は、対象となるオブジェクトに応じて、認識パラメータを設定することが考えられる。オブジェクトの移動度及び移動範囲に基づく設定や、オブジェクトの画像特徴に基づく設定が例示される。

【0022】

このようにすれば、画像認識の性能の向上に寄与する。

このとき、請求項17に示すように、予測器による予測結果と認識器による画像認識結果との差分が閾値以上の場合、パラメータ設定部が、認識パラメータを修正するようにしてもよい。このようにすれば、認識器の性能改善が図られる。

【0023】

なお、本発明は、認識器の認識パラメータによる性能改善という特徴から、次のように構成してもよい。「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、過去の発生頻度に関する頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、車両外部を撮像する撮像部と、前記撮像部にて撮像される画像に基づき、画像認識結果から前記頻度データを定義する頻度情報を生成する認識器と、前記認識器に対し、画像認識のための認識パラメータを設定するパラメータ設定部と、を備え、前記予測器による予測結果と前記認識器による画像認識結果との差分が閾値以上の場合、前記パラメータ設定部は、前記認識パラメータを修正して設定することを特徴とする予測装置。」である。

【0024】

ところで、過去の頻度データがない場合でも、地理的な要因などからオブジェクトの発生頻度を予測できることが望ましい。

そこで、請求項18に示す構成を採用することが考えられる。すなわち、アトラクタの情報を取得するアトラクタ情報取得手段と、アトラクタ情報に基づき、当該アトラクタでのオブジェクトの存在確率をタイムゲートとして設定するタイムゲート設定手段と、を備える構成である。

【0025】

アトラクタは、例えば、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園として具現化される。タイムゲートは、時間的要因に影響されるアトラクタでのオブジェクトの存在確率を示す。例えば、アトラクタの営業時間などを基に、タイムゲートが設定されるという具合である。

【0026】

このとき、予測器は、アトラクタと予測対象区域との距離、及び、タイムゲートに基づき、予測対象区域におけるオブジェクトの発生頻度を予測する。

このようにすれば、過去の頻度データが少ない場合でも、地理的な要因などからオブジェクトの発生頻度を予測することができる。

【0027】

より具体的には、請求項19に示すように、タイムゲートを、オブジェクトの発生頻度を高さとする矩形波で定義することが例示される。この場合、予測器は、アトラクタから予測対象区域までの分岐路にて分割される矩形波の伝播を想定し、予測対象区域におけるオブジェクトの発生頻度を予測する。例えば、分岐路では矩形波の高さ(オブジェクト発生頻度)が小さくなるように伝播する。このようにすれば、アトラクタに起因するオブジェクトの発生頻度を比較的容易に予測することができる。

【0028】

なお、請求項20に示すように、タイムゲートを定義する矩形波は、アトラクタの平均収容人数を高さとするものとして初期化されることとしてもよい。このようにすれば、タイムゲートを比較的簡単な矩形波として定義することができる。

【0029】

また、例えば学校への登校時間が8:00〜8:30である場合、その登校時間以前のオブジェクト(例えば生徒)の発生頻度を予測する必要がある。そこで、請求項21に示すように、予測器は、時間的に遡る矩形波の伝播である逆伝播に基づき、予測対象区域におけるオブジェクトの発生頻度を予測することとしてもよい。このようにすれば、アトラクタに対してのオブジェクトの流入時間から、それ以前のオブジェクトの発生頻度を予測することができる。

【0030】

さらにまた、請求項22に示すように、予測器は、自車両の予測対象区域の通過時間を考慮して、予測対象区域におけるオブジェクトの発生頻度を予測することが例示される。つまり、自車両の速度が上がれば予測対象区域の通過時間が短くなるため、予測対象区域の通過時間を考慮すれば、より確実にオブジェクトの発生頻度を予測することができる。

【0031】

なお、本発明は、アトラクタに起因する予測という特徴から、次のように構成してもよい。すなわち、「車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、集客力を有し、前記オブジェクトの流出入の駆動する要素であるアトラクタの情報を取得するアトラクタ情報取得手段と、前記アトラクタ情報に基づき、時間的要因に影響される前記アトラクタでの前記オブジェクトの存在確率をタイムゲートとして設定するタイムゲート設定手段と、を備え、前記予測器は、前記アトラクタと前記予測対象区域との距離、及び、前記タイムゲートに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測することを特徴とする予測装置。」である。

【図面の簡単な説明】

【0032】

【図1】タイプ1の車載装置の構成を示すブロック図である。

【図2】タイプ2の車載装置の構成を示すブロック図である。

【図3】タイプ3の車載装置の構成を示すブロック図である。

【図4】センタの構成を示すブロック図である。

【図5】予報処理の一部を示すフローチャートである。

【図6】予報処理の一部を示すフローチャートである。

【図7】予報処理の一部を示すフローチャートである。

【図8】FATR算出処理を示すフローチャートである。

【図9】対象アトラクタの予測頻度算出を示すフローチャートである。

【図10】アトラクタのリストアップを示す説明図である。

【図11】複数のアトラクタに起因する発生頻度の合成を示す説明図である。

【図12】複数のアトラクタに起因する発生頻度の合成を示す説明図である。

【図13】発生頻度の算出の一例を示すタイミングチャートである。

【図14】発生頻度の算出の一例を示す説明図である。

【図15】過去の発生頻度データを予測に利用した一例を示す説明図である。

【図16】予測対象区域の一例を示す説明図である。

【図17】状況ベクトルと特徴ベクトルの一例を示す説明図である。

【図18】特徴情報に含まれる部分領域の一例を示す説明図である。

【図19】予測器による出力結果の一例を示す説明図である。

【図20】予測器による出力結果の一例を示す説明図である。

【図21】複数の車両での画像認識を示す説明図である。

【発明を実施するための形態】

【0033】

以下、本発明の実施形態を図面に基づいて説明する。

本実施形態では、想定する時間帯に所定の対象区域である「予測対象区域」(以下、ターゲットともいう)で発生する歩行者の頻度を予測する。

【0034】

[1.特徴]

(1)走行予定区域の近隣にある集客施設とその時間挙動を地理的要因および道路要因の観点から考慮し、走行予定時間における予測対象区域での歩行者発生頻度を予測する。

(2)過去の発生頻度に関する統計データから走行予定時間における歩行者発生頻度を予測する際に、プローブカーで集めた認識器の結果を用い、人手による正解データの入力を最小にとどめる。

(3)上記の認識器の結果を用いる際に認識の信頼度に関する情報を考慮する。

(4)走行予定区域を走行した際に得た最新の認識結果と、あらかじめ上記の枠組みで得た歩行者発生頻度との間の差分情報を評価することにより、認識器と予測器の性能を改善する。

【0035】

[2.具体的用途]

主として車載カメラの視野内にあるオブジェクト(自転車、歩行者、動物)を検出し、特にカメラに接近するオブジェクトについてドライバーに警報を発するような運転支援装置に応用する。アプリケーションプログラムとして、大きく分けると、次の3つが考えられる。

【0036】

[2−1.人予報]

複数のセンサが得た情報を共有することにより、人や自転車の発生を予測する。これによって指定場所での人の発生頻度を天気予報のように前もって予測し、都市情報として活用する。

【0037】

[2−2.運転支援]

人予報の結果、対象地域を通過する前に注意、危険回避、装置設定、旅行計画変更、運転者変更(運転計画)を行うことが可能になり、予防安全を促進することができる。すなわち、最終的に事故を低減させるという観点から言えば、単に認識結果を赤枠で表示したり、警告を発したりするだけではなく、運転支援という立場であらかじめ危険を回避するように情報を提供する。

【0038】

例えば、まったく見知らぬ土地をレンタカーで運転する場合、歩行者や自転車と出くわす確率が高い場所や時間帯を事前に知ることができれば、ドライバーの精神的負荷は軽減される。

【0039】

[2−3.認識支援]

上記の予測結果とプローブカーによる認識結果を通信手段で連携させることにより、認識性能を改善させる。

【0040】

(1)通信で得られる外部データ(特に、天候や環境に関するデータ)により認識性能を改善させる。

(2)通信で外部の処理装置とつながることで演算量や処理内容を向上させ、認識機能を改善させる。

【0041】

(3)複数のセンサが連携することにより、多数の時空間点で観測したデータを相互利用し、個々の車の認識性能を改善する。

(4)その地域や時間、天候にあった認識パラメータを通信で獲得し、認識性能を適応化させる。

【0042】

[3.予測式]

最初に、考えられる予測式について説明しておく。

センシング装置(ソース)、時間帯、地点に対応して認識結果の信頼度を決め、信頼度と認識結果を地図データ上に記憶し、その時空間分布から走行予定区域における歩行者発生頻度を予測する。

【0043】

その予測値のM個の集まりについてN個のカテゴリのオブジェクトに関する予測発生頻度の値をM×N行列Fで表現する。時間情報を含む状況sと想定する場所xについて、発生頻度の予測値で構成される行列F(x,s)を次式でモデル化する。

【0044】

【数1】

【0045】

なお、ここで、

FRWPは、自車または現在地から予測対象位置xまでの走行経路周辺で得られる画像認識結果から算出したx上の予測発生頻度である。

【0046】

また、FRXTは、xにおいて現在または最近観測された画像を認識した結果である。

さらにまた、FPFPは、過去の統計データに基づいて場所x状況sにおける発生頻度を予測した結果である。

【0047】

また、FATRは、x周辺にあるアトラクタの影響に基く予測発生量。これはタイムゲートによりさらに精度の高い情報に修正される。

なお、Λは上記の4つの発生頻度行列からひとつの発生頻度行列を作成する関数であり、もっとも簡単なものは次式で表現される。

【0048】

【数2】

【0049】

[3−1.予測方式1]

もっとも容易に実現できる予測方式は、次のようなものである。

【0050】

【数3】

【0051】

これは、「飛び出し注意」とか「通学路につき子供に注意」、あるいは「動物注意」といった道路標識がこの予測に近い意味合いを持つ。ただし、本実施形態ではターゲット周辺の任意の区域における頻度予測を想定し、複数のアトラクタの影響を合成して定量的に表現することを考える。

【0052】

[3−2.予測方式2]

過去の統計データがすでにある場合は、FPFP用いることで、次のように表現することができる。

【0053】

【数4】

【0054】

FPFPは基本的には過去のデータの学習に基づく回帰予測であるが、データに欠損がある場合もFATRによって補えるという特長を本方式は有する。

[3−3.予測方式3]

ターゲットまでの距離が近く、しかも発生頻度がターゲットまでの移動時間内にあまり変動しないような場合はターゲット周辺に存在する認識器の結果に重点をおき、次のような式で表現可能である。

【0055】

【数5】

【0056】

この場合は、準リアルタイムかつ正確な認識系と通信系がそろっていないと実現できない。過去からの予測が困難な群集の発生などはこの方式が都合がよい。認識系が十分でないならば、画像そのものを自車まで配信してもらうということも考えられ、この場合はプローブカーによる無線通信システムの問題に帰着される。

【0057】

[3−4.実施形態における予測方式]

FRWPに関しては、ターゲットとは異なる地点の時空間点で観測された発生頻度とターゲットでの発生頻度との間の相関を計算することとなり、問題はFPFPと同様になる。そこで、本実施形態では主として式4を用いて説明を行う。

【0058】

[4.予測器への情報提供]

また、本システムの予測器に用いる情報は次のソースから提供されることを想定する。

(1)車両(予測装置)

予測装置は、3つのタイプで構成することができる。

【0059】

(1−1)タイプ1:認識器と予測器との両方を具備し、センタと通信を行うもの。

(1−2)タイプ2:予測器のみを具備し、センタと通信を行うもの。

(1−3)タイプ3:センタから配信される情報を受信して報知を行うもの。

【0060】

(2)携帯電話機やPCなどの無線通信端末

センシングした位置情報と記憶した個人プロファイル情報とを周囲の車両又はセンタに送信する。これによって、画像処理などのセンシングによっては困難な歩行者情報(性別、年齢、目的地など)を高い信頼度で地図上にマッピングすることができる。この端末によって他の歩行者をセンシングすることも不可能ではない。ただし、端末の持ち主の歩行状態を発信する手段として用いることが一般的である。

【0061】

(3)定点観測インフラ

車両などの移動体から歩行者をセンシングする場合に比べて、位置が固定されており、背景の動きも少ないので歩行者の認識率は一般に車両の場合よりも高い。したがって、予測の信頼度も高くなる。一方で、コスト面から設置件数や設置場所が限られるため、予測できる対象区域も限定される。

【0062】

[5.予測装置の構成]

図1に、タイプ1の予測装置10のブロック図を示す。

予測装置10は、主として、送受信部20と、ナビゲーション装置30と、認識器40と、予測器50と、記憶部60とを備えている。

【0063】

送受信部20は、センタ70との間でデータ通信を行うための構成である。

ナビゲーション装置30は、報知部31、アトラクタ情報32を有しており、予測器50と接続されている。報知部31は、運転者への報知を行うためのディスプレイやスピーカなどで構成される。アトラクタ情報32については、後述する。

【0064】

認識器40は、撮像部41、パラメータ設定部42、評価部43、及び、変換部44に接続されている。また、変換部44には演算部45が接続されており、演算部45には情報生成部46が接続されている。

【0065】

予測部50は、パラメータ設定部42、及び、評価部43に接続されている。

記憶部60は、変換部44からの情報を記憶するための記憶媒体である。

撮像部41は、車載カメラとして具現化され、認識器40に対し、画像データを送出する。パラメータ設定部42は、認識器40に対し、画像認識のための認識パラメータを設定する。パラメータについては後述する。評価部43は、予測器50からの出力と認識器40からの出力とを比較して評価するための構成である。評価部43では、具体的には、予測器50からの出力と認識器40からの出力との差分情報を算出する。この差分情報は、変換部44で変換された後、記憶部60及び演算部45へ送出される。

【0066】

認識器40からの出力である画像認識結果は、変換部44で変換された後、記憶部60に記憶される。また、変換部44で変換された後、演算部45へ送出される。演算部45では、画像認識結果に対する信頼度を算出する。

【0067】

情報生成部46は、画像認識結果に、演算部45によって算出された信頼度などを付加して、センタ70へのアップロード情報を生成する。

予測器50は、歩行者発生頻度を予測するための構成である。予測器50は、センタ70から送信されてくる情報を、ナビゲーション装置30を介して取得し、当該情報に基づく予測を行う。また、予測器50は、記憶部60に記憶される画像認識結果に基づく予測を行う。

【0068】

この予測装置10は、現在位置、走行予定経路、差分情報、及び、認識結果などをセンタ70へアップロードし、センタ70から、予測対象区域の情報(アトラクタ情報、タイムゲート情報、Web情報など)を受信する。

【0069】

図2に、タイプ2の予測装置11のブロック図を示す。なお、予測装置10と同様の構成部位には、同一の符号を付した。

予測装置11は、主として、送受信部20と、ナビゲーション装置30と、予測器50と、記憶部60とを備えている。予測装置10と異なるのは、認識器40及びこれに付随する構成を有していないことである。なお、それ以外の構成については予測装置10と同様となっているため、説明を割愛する。

【0070】

この予測装置11は、現在位置、走行予定経路などをセンタ70へアップロードし、センタ70から、予測対象区域の情報(アトラクタ情報、タイムゲート情報、Web情報など)を受信する。

【0071】

図3に、タイプ3の予測装置12のブロック図を示す。など、予測装置10,11と同様の構成部位には、同一の符号を付した。

予測装置12は、受信部21と、ナビゲーション装置30と、報知部31とを備えている。この場合、予測器50さえ有していないため、センタ70からの受信動作のみを行う。具体的には、センタ70から、場所や歩行者の発生頻度を示す予測頻度などの予測情報を受信する。

【0072】

[6.センタの構成]

図4に、センタ70のブロック図を示す。

センタ70は、受信部71、要求処理部72、検索部73、結果処理部74、記憶部75、大規模予測部76、及び、配信部77を備えている。

【0073】

受信部71は、予測装置10,11から送信される情報を受信するための構成である。

要求処理部72は、予測装置10,11から所定情報の送信要求などがあると、検索部73へ当該情報の検索を指示する。

【0074】

検索部73は、記憶部75に記憶されたデータの検索を行うための構成である。検索部73による検索結果データは、記憶部75に記憶される。また、検索結果データは、配信部77へ送出される。

【0075】

結果処理部74は、例えば予測装置10から画像認識結果などのアップロード情報が送信されてきた場合、当該データを所定形式で記憶部75へ記憶する。具体的には、予測装置10,11から、歩行者発生頻度に関する信頼度付きの情報を受信し、それらを地理情報に関連付けて、時空間データベースを構築する。

【0076】

記憶部75は、ハードディスク装置などの記憶媒体として具現化される。

大規模予測部76は、記憶部75に構築される時空間データベースを利用し、歩行者の発生頻度にかかる大規模な予測演算を行う。予測演算の結果は「予報」として、記憶部75に記憶されると共に、配信部77へ送出される。

【0077】

配信部77は、予測装置10,11,12へ情報を配信するための構成である。

なお、ここでは、予測装置10,11からセンタ70への情報送信について説明したが、携帯電話機やPCなどの無線通信端末、及び、定点観測インフラ(交差点カメラなど)からもセンタ70へ情報送信されることとしてもよい。

【0078】

また、本実施形態では、認識器40及び予測器50の両方を備えるタイプ1の予測装置10を例に挙げて、以下説明を続ける。

[7.予報処理]

図5、図6、図7は、予測装置10にて実行される予報処理を示すフローチャートである。なお、この予報処理は、図5中にB10で示す「FATRの算出に関する処理」、図6中にB20で示す「FPFPの算出に関する処理」、及び図7中にB30で示す「認識器40の性能向上に関する処理」に大別される。そこで、以下では、全体の流れを一通り説明した後、これらのB10〜B30のブロックごとに詳細な説明を加える。

【0079】

[7−1.予報処理全体の流れ]

最初のS100では、ナビ走行予定経路を取得する。この処理は、ナビゲーション装置30にて実行されるものであり、ユーザによって設定された走行予定経路が取得される。

【0080】

次のS110では、予測対象区域を設定する。この処理は、例えばナビゲーション装置30により、予測対象区域の情報をユーザに入力させるように促すものとすることが考えられる。

【0081】

次のB10では、FATRを算出する。FATRは、上述したように、アトラクタの影響に基づく予測発生頻度である。

続く図6中のB20では、FPFPを算出し(S180)、B10にて算出されたFATRと合成して(S190)、予測対象区域での歩行者発生頻度を予測して報知する(S200)。

【0082】

次の図7中のB30では、認識器40の性能向上のための演算処理を行う。

そして、S310では、画像認識結果からアップロード情報を生成する。この処理は、図1中の情報生成部46の機能として実現される。次のS320では、アップロード情報をセンタ70へ送信する。

【0083】

[7−2.FATRの算出に関する処理]

図5中のB10に示すように、S120では、センタ70を利用するか否かを判断する。ここでセンタ70を利用しない場合(S120:NO)、S130へ移行する。一方、センタ70を利用する場合(S120:YES)、S140へ移行する。

【0084】

センタ70を利用しない場合に移行するS130では、ナビゲーション装置30が有するアトラクタ情報32を取得する。その後、S160へ移行する。

センタ70を利用する場合に移行するS140では、現在地及び走行予定経路をセンタ70へ送信し、アトラクタ情報を要求する。これにより、センタ70は、アトラクタ情報を送信してくる。そこで、S150では、センタ70からのアトラクタ情報を受信する。その後、S160へ移行する。

【0085】

S160では、FATR算出処理を実行する。

[7−2−1.FATR算出処理]

続けて、図8のフローチャートに基づき、FATR算出処理を説明する。

【0086】

最初のS400では、予測対象リンクを設定する。この処理は、予定経路上の位置xkを含むリンク$L(xk)を予測対象リンクとするものである。

次のS410では、アトラクタを探索してリスト化する。この処理は、予測対象区域$L(xk)周辺のアトラクタを探索し、i=1,・・・,Ikの番号を割り当てて、リスト化するものである。例えば、図10に示すように、病院A1、銀行A2、地下鉄駅A3、ショッピングセンタA4としてリストアップされる。

【0087】

続くS420では、アトラクタの番号iを初期化して「0」とする。

次のS430では、アトラクタの番号iをインクリメントする。これにより、アトラクタA1から処理が開始されることになる。

【0088】

続くS440では、タイムゲートを設定する。この処理は、アトラクタAiの情報(平均収容人数、営業時間など)を基に、タイムゲートTG(Ai)を設定するものである。

次のS450では、処理対象のアトラクタに起因する予測頻度を算出する。この処理は、Aiに起因する$L(xk)上の予測頻度FATR(xk,sl|Ai)を算出するものである。

【0089】

続くS460では、S450にて算出された予測頻度を足し合わせる。具体的には、FATR(xk,sl)=FATR(xk,sl)+FATR(xk,sl|Ai)を計算する。

次のS470では、全てのアトラクタを処理したか否かを判断する。ここで全てのアトラクタについて処理したと判断された場合(S470:YES)、FATR算出処理を終了する。一方、処理していないアトラクタがあるうちは(S470:NO)、S430からの処理を繰り返す。

【0090】

次に、図9に基づいて、上述したS450の処理の詳細について説明する。

最初のS451では、矩形波を設定する。この処理は、平均収容人数N0(i)を高さとする矩形波ΓTGiを設定するものである。

【0091】

次のS452では、経路を確定する。この処理は、アトラクタAiから予測対象区域までの経路$LNを確定するものである。

続くS453では、リンクをリストアップする。この処理は、n番目の分岐$Bnと(n+1)番目の分岐$Bn+1の間のリンク$Lnをリストアップするものである。なお、ここでn=1,・・・,N−1である。

【0092】

次のS454では、リンク番号nを初期化して「0」にする。

続くS455では、リンク番号nをインクリメントする。これにより、リンク$L1から処理が開始されることになる。

【0093】

次のS456では、発生頻度を分岐に応じて分割する。この処理は、リンク$Ln-1での発生頻度Nn-1を分岐$Bnに関してJn個に分割するものである。ここでは、特に情報がなければ、Jn等分する。

【0094】

続くS457では、全てのリンクを処理したか否かを判断する。ここで全てのリンクについて処理したと判断された場合(S457:YES)、S458へ移行する。一方、処理していないリンクがあるうちは(S457:NO)、S455からの処理を繰り返す。

【0095】

S458では、予測頻度を算出する。この処理は、リンク$LNのオブジェクトの存在時間、予測対象の時間範囲、及び、自車の通過時間に基づき、オブジェクトの発生頻度を予測頻度として算出するものである。

【0096】

以上が、図5中のB10で示した「FATRの算出に関する処理」である。ここで、この処理に対する理解を容易にするため、具体例を挙げて説明をする。ここでは、最初にアトラクタ情報について詳述し、その後、タイムゲートによる考え方を説明する。

【0097】

[7−2−2.アトラクタ情報]

アトラクタは、例えば、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園など、集客力があり、人の流出入を駆動する要素である。このアトラクタについて十分な地理情報(地図情報やWeb情報など)があれば、歩行者の発生頻度に関して一次予測が行える。

【0098】

そこで、本実施形態では、具体的に下記の情報を用いた予測手法を提案する。

(1)アトラクタのサービス時間帯(学校ならば登下校時間)。

(2)アトラクタの周辺の地図情報(特に位置とアクセス情報)、道路情報。

【0099】

(3)アトラクタ及びそのアトラクタへのアクセス情報が天候(雨、風、雪)の影響を受けやすいかどうか。

(4)アトラクタに出入りする人の移動度(歩行者、自転車)。

【0100】

[7−2−3.アトラクタのクラス分類]

アトラクタは、次の2種類のカテゴリによってクラス分類することができる。

(1)平均利用時間

A1クラス:4時間以上(例えば、学校、オフィスビル、駅など)

A2クラス:2時間〜4時間(例えば、病院、ショッピングセンタ、映画館、スポーツ施設など)

A3クラス:1時間〜2時間(例えば、銀行、店、レストランなど)

A4クラス:1時間未満(例えば、コンビニ、郵便局など)

(2)手段(経由地)であるか目的地であるか。

【0101】

B1クラス:利用時間帯がほぼさだまっている目的地(例えば、学校、オフィスビルなど)

B2クラス:利用時間がさだまっていない目的地(例えば、病院、ショッピングセンタ、映画館、スポーツ施設、コンビニ、郵便局、レストラン、店、銀行など)

B3クラス:利用時間がさだまっていない経由地(例えば、駅、バス停など)

アトラクタの機能する時間のうち、人の出入りの激しい時間帯を活性化時間と呼ぶことにする。特にそれがアトラクタ側で定めた時間帯である場合、それをタイムゲートと呼ぶことにする。

【0102】

[7−2−4.タイムゲート]

上記のアトラクタに付随するタイムゲート(以下、適宜「TG」と記載する)を高さ「1」の矩形波と考える。これを基本波形としてアトラクタ中に存在する歩行者頻度を高さとする波(歩行者発生頻度の確率波)を定義する。

【0103】

本実施形態では、簡単化のため平均収容人数N0(i)を高さとする矩形波Γπiを考える。そして、アトラクタから半径1km以内の予測対象区域(ターゲット)xkでは、矩形波Γπiを区間内の移動時間と観測時間範囲に応じて変形させる。

【0104】

移動時間は、移動度とターゲット区間の長さで決まる。移動度が時速4kmで200mの区間である場合、移動時間は3分となる。また、観測時間範囲は、予測対象となる時間範囲であり、予測の時間分解能に相当する。例えば、30分単位で設定し、朝8時から8時半までを観測時間範囲として設定することが考えられる。具体的には、時速40kmの自動車で200mの区間を通過する場合、観測時間範囲は、18秒間となる。

【0105】

アトラクタにおける矩形波Γπiは、予測対象区域xkとアトラクタAi(i番目のアトラクタを示す)の間の経路を通じて伝播(時間的には過去にさかのぼる)する。これを「逆伝播」と呼ぶことにする。矩形波Γπiは、経路途中の分岐の数に応じてその高さが低くなる。これは分岐によって歩行者数が少なくなっていくからである。ここで、分岐前の歩行者発生頻度と分岐後の複数経路の歩行者発生頻度の総和は等しいと仮定する。また、ここでは簡単化のため、この分岐は木構造であると仮定する。

【0106】

すると、距離L(xk/Ai)と途中の分岐数及び分岐の比率は、予報の性質に影響を与える。「分岐の比率」が関係するのは、各分岐に等分された数の歩行者が存在するとはかぎらないためである。また、予報の性質は、予測対象区域に逆伝播させた矩形波Γπiの高さ、すなわち確率的歩行者発生頻度である。

【0107】

なお、地図上でどのような分岐が経路上で生じ、各ルートで経路長がどういう値になるかに関しては、すでにその類のグラフアルゴリズムがカーナビゲーションシステムなどで使われているので、ここではその詳細は省略する。

【0108】

例えば、ある学校の登校時間帯を7時から8時までとすると、それをTGとして8:00前の30分程度で移動できる範囲にわたってTGが過去の方向に伝播し、その範囲内で人発生のピークが出現しやすくなる。すなわち、時間的に平均化された発生頻度とは異なる発生頻度になる場合が出てくる。計測データが著しく少ない場合には、このようなピークが発生する性質までもモデル化すれば予報の確信度をさらにあげることができる。

【0109】

TGの伝播を駆動する要素を列挙すると、次のようになる。

(1)TGが定義される場所(アトラクタ)

(2)TGを通過しようとするオブジェクトのカテゴリ(子供、自転車など)

(3)オブジェクトOj存在する(通過する)と想定される場所x(Oj)とアトラクタAiが存在する場所x(Ai)との間の経路

(4)オブジェクトの種類(歩行者、自転車、他)に応じた移動度

例えば、自転車は歩行者の3倍の移動度と仮定すると、想定区域(ターゲット)内における所定時間内の発生頻度は自転車のほうが1/3となる。

【0110】

[7−2−5.複数のアトラクタの影響]

次に複数のアトラクタの影響を考察する。複数のアトラクタ{A1,・・・,Ai,・・・AIk}が走行予定位置xkの近隣に存在する場合、Aiで駆動される矩形波ΓTGiがアトラクタAiにいたるルートに逆伝播し、予測対象区域上では複数のアトラクタから逆伝播したΓTGiの合成波形として人発生頻度が予測される。

【0111】

例えば、図11のように2つのアトラクタA1,A2が存在する場合、それぞれから想定する走行区域ターゲットにTGが逆伝播することによって、Aiが駆動する発生頻度F1とA2が駆動する発生頻度F2の和として発生する歩行者がターゲット区域における予測発生頻度となる。矩形波ΓTG1とΓTG2との合成を、図12に模式的に示した。

【0112】

これを一般化すると次式で表現される。

【0113】

【数6】

【0114】

[7−2−5.人の移動度]

本実施形態でいう人の移動度は、大きく分けて次の2種類である。

(1)歩行者の移動度:μP

(2)自転車の移動度:μB

歩行者は車両に比べて移動度の値および移動範囲は小さいが、移動に際しての自由度が高い。すなわち、追い越しも自由であるし、経路変更も任意である。さらに、車のように車両間の依存関係がない。

【0115】

このような移動度は、アトラクタAiに関連する情報(先見情報)がない場合には、純粋に統計計算で求める。一方、アトラクタAiに関連する情報(先見情報)がある場合、少ない計測結果に対してオフセットを与えることができる。

【0116】

[7−2−6.遭遇時間の予測]

TG(Ai)から予測対象区間ターゲットまでの距離とルートとは、ナビゲーション装置30による地図情報やWeb情報に基づき、取得することが可能である。

【0117】

したがって、TG(Ai)をルートに沿って逆伝播させれば、ターゲット内の人の存在時間(道路沿いの移動時間)を推定することができる。走行経路上で遭遇する歩行者発生頻度を予測する際の手助けとなる。

【0118】

このとき、以下のような制約を用いてもよい。

(R1)歩行者がアトラクタまで歩行によって移動する距離は1km程度とする。

(R2)自転車の場合は移動する距離は最大3km程度とする。

【0119】

(R3)歩行者、自転車ともに屋外の道路では天候の影響を受けやすい。

(R4)歩行者の移動度は自転車の移動度の1/3程度となる。

[7−2−7.TGの逆伝播の一例]

図13及び図14に学校をアトラクタとした場合のTGの逆伝播の例を示す。ここでは上記(R4)の制約を用いて30人中15人の生徒(うち12人が徒歩、3人が自転車)が同時に校門をスタートして帰宅する場合を想定し、交差点ごとの分岐で等分されていく仮定の下で、矩形波ΓTGiの伝播の様子をタイムチャートで示す。

【0120】

図14中のFBは自転車の発生頻度、FPは歩行者の発生頻度である。また、$L4={1/2,3/3,1/3,1/2}という表現はアトラクタから予測対象区域までの経路の分岐の様子を記述している。具体的には、図14に示すように、校門から出て右矢印方向を1/2、その反対方向を2/2と表現し、次の交差点では3分岐あるので同様に記述している。一般に、次に示すように、アトラクタから見た予測対象区域のリンクを表現することができる。

【0121】

【数7】

【0122】

ただし、Jnはn番目の分岐点における分岐数、jnはそのJn個の分岐のうちの(例えば分岐路に向かって最左から右回りで)jn番目の分岐を経路として選択することを意味する。この表記に基づき、F$obj($Ln)はn番目の分岐から(n+1)番目の分岐までのリンクにおけるオブジェクト$objに関する発生頻度を表す。

【0123】

図14の例では、$obj=Bが自転車の発生頻度を示し、$obj=Pが歩行者の発生頻度を示す。同様にD($Ln)はリンクの距離を表す。このような表記の下で、図14の地図上に各リンクにおける発生頻度の予想値を示す。

【0124】

ここでは15人の生徒が同時に下校を開始した場合を想定したが、実際は校門を出る時刻は、ばらつくと考えられる。このことを考慮して問題を簡単化すると、予測対象区域における平均予測発生頻度は予測発生頻度(矩形波ΓTGiの高さ)に黄色の区間で示した予測対象時間Tpredictと各オブジェクトの予測対象区域(リンク)における存在時間Texistの比をかけた値として算出される。すなわち、次の式で示される。

【0125】

【数8】

【0126】

さらに、自車の予測対象区域内の通過時間Texist#Cを考慮すれば、通過時の観測率λCが乗じられた発生頻度は次式で算出できる。

【0127】

【数9】

【0128】

なお、上記の各オブジェクト(歩行者、自転車、自車両)の存在時間はリンク長と移動度から次式で算出される。ただし、$obj=P,B,Cである。

【0129】

【数10】

【0130】

次に通学時の発生頻度をこの帰宅時の発生頻度と同じ理屈で予想できると仮定する。これは近似的に、上述の帰宅時のプロセスの時間軸を逆転させたメカニズムで算出できる。すなわち、上記で考慮した下校開始時刻のばらつきは登校時にもあると考えれば、概算としてほぼ同じ発生密度がアトラクタに対する時間差で(時間の向きは逆なので逆伝播と呼ぶ)観測されると予想される。したがって上記の平均予想発生頻度は登校時にも一次近似値として採用できる。

【0131】

[7−2−8.Web情報の利用]

アトラクタの位置や機能時間、活性化時間およびTGはWeb情報から得られる場合がある。また、天候、渋滞情報に関する情報も取得できる。

【0132】

[7−2−9.ナビ情報の利用]

ナビからは{現在位置、進行方向、周辺施設(アトラクタ)の有無、渋滞情報}に関する情報を得ることができる。

【0133】

[7−3.FPFPの算出に関する処理]

次に、図6中のB20で示した「FPFPの算出に関する処理」について説明する。

最初のS170では、過去の発生頻度データを検索する。この処理は、記憶部60に記憶された走行経路上の過去の発生頻度データを検索するものである。

【0134】

続くS180では、FPFPを算出する。この処理は、過去の発生頻度データに基づき、場所x状況sにおける発生頻度を予測した結果としてのFPFPを算出するものである。なお、詳しい算出方法については後述する。

【0135】

次のS190では、予測頻度FATRとFPFPとを合成する。この処理は、上述した式4によって2つの発生頻度FATRとFPFPとを合成するものである。

続くS200では、予測頻度を運転者へ報知する。この処理は、ナビゲーション装置30によって、報知部31を介して行われる。

【0136】

次のS210では、別経路に変更したか否かを判断する。この処理は、予測対象区域を回避して別経路への変更を行ったか否かを判断するものである。ここで別経路への変更を行ったと判断された場合(S210:YES)、図5中のS100からの処理を繰り返す。一方、別経路への変更を行っていないと判断された場合(S210:NO)、S220へ移行する。

【0137】

S220では、予測対象区域を走行しているか否かを判断する。ここで予測対象区域を走行している場合(S220:YES)、センタ70から最新のプローブ情報を受信し、S180からの処理を繰り返す。一方、予測対象区域を走行していない場合(S220:NO)、図7中のS240へ移行する。

【0138】

[7−3−1.過去の統計に基づく歩行者発生頻度の予測]

図15に、ユーザの車両Aにおいて、予測対象区域における歩行者発生頻度を提示する際の概略プロセスを示す。ここでは、予測対象区域に向かう車両Aがセンタ70に対して予測に必要な情報を送信し、一方で予測対象区域近辺をAが通過する以前(Aがリクエストを出す以前の過去も含む)に通過して撮像した車両(プローブカー)が画像認識結果に関する情報をセンタ70にアップロードしている様子を示している。このような状況設定のもとで複数のアトラクタとの関係やターゲットに向かう時間経過に応じて歩行者発生頻度が提示される。

【0139】

[7−3−2.予測対象区域の例示]

図16に実際の実験において設定した予測対象区域の例を示す。図16では、刈谷駅方面から知立駅方面へ走行し、店が立っている交差点を左折したことを示している。このとき、予測対象区域は、高架までの区間1、店までの区間2、店を過ぎた後の区間3として設定した。

【0140】

[7−3−3.特徴ベクトルの定義]

ここでは予測器50の出力である予測対象をベクトルとして表現する。図17に予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考えた場合の例を示す。これによって、ある車載カメラで観測される歩行者発生頻度の特徴ベクトル(予測の目的変数)は12次元となる。この特徴ベクトルの定義は、そのまま予測器50の学習においても用いられる。

【0141】

ただし、現状の画像認識技術では上記のような複雑な分類について高い認識率を達成することは困難である。高い精度の学習データを得るにはオフラインの高度な認識処理かあるいは複数のセンサの複合処理、または人手による正解付与に頼ることになる。図17では、人手による正解付与(GT:Ground Truth)を採用した。

【0142】

なお、ここでは、予測対象区域の部分領域として、自車から見て{右、左}という領域を設定しているが、さらに細かく部分領域を設定してもよい。例えば、図18は、実際に車両から撮影した画像を示し、画像認識における部分領域の設定例(ここでは{左側歩道、走行車線、対向車線、右側歩道})を示している。

【0143】

[7−3−4.状況ベクトルの定義]

特徴ベクトルが発生する際に、その説明変数となる状況情報は図17における{場所、日時、天候}である。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とした。

【0144】

したがって、状況ベクトルは合計28次元となり、これに対する特徴ベクトルの回帰関係を線形最小2乗法(後述の式17参照)で解いた結果が図19の右側のグラフである。これらが予測結果となる。すなわち、左側は目視による計測結果をグラフ化したものであり、右側は自己交差の回帰予測結果をグラフ化したものである。ここで、オブジェクトは、「1」が左女性、「2」が左子供、「3」が左男性、「4」が左不明、「5」が左自転車、「6」が左犬、「7」が右女性、「8」が右子供、「9」が右男性、「10」が右不明、「11」が右自転車、「12」が右犬となっている。また、同様に、想定される種々の状況の下での予測例を図20(a)〜(f)に示した。

【0145】

なお、状況ベクトルはさらに拡張することができ、時間情報に関しては、日種効果、季節効果、時間帯効果、年中行事の影響などを考慮してもよい。渋滞予測に応用することも考えられる。また、道路環境や地理要因についても拡張可能であり、それらは各要因を表現する語彙に対して数量化(例えば0と1の間の値)を施すことで行う。

【0146】

[7−3−5.信頼度を用いた予測]

本実施形態における予測性能は認識器40の性能に大きく影響される。認識器40の性能は、一般に停車時と走行時では異なる。歩行者を含む移動体に関しては停車時のほうが認識率は高いため、停車時の認識結果の信頼度は走行時よりも高い。たとえば「定点(停車時)においては認識率Ri>80、走行時ではRi=60程度」といった例が考えられる。さらには、一般的に走行速度が速いほど、歩行者や自転車に対する相対速度が大きくなり、それらの認識率は低下する。

【0147】

「停車時」をさらに状況分類すると、{交差点の一時停止、道路わきの停車、駐車場の停車}といった場所のタイプが関与する。また、「走行時」においても画像認識のしやすさは周囲背景の影響を大きく受ける。特に、対向車両や先行車両、ビルや街路樹、ガードレール、道路標識の白線、障害物などは歩行者の認識率を左右する。

【0148】

そこで、認識器40の出力(確信度)に対して認識器40の信頼度riを付与することとし、自車速度と場所のタイプに応じた平均認識率をもってその値とする。このように環境条件に応じた認識器40の性能変動を認識器40の信頼度で表現し、信頼度つきの認識結果をナビ上に記憶する、あるいはセンタに送信することで地図上に認識結果の時空間情報を作成することが可能になる。

【0149】

自転車と人では発生の分布が異なると考えられる。これは主として移動度と移動範囲に起因する。この性質を利用して、認識器40と予測器50の設定を行う。

[7−3−6.信頼度の設定]

認識器40の信頼度については下記のような設定が考えられる。

【0150】

(1)オブジェクトごとに認識率の信頼度を変える。{歩行者、自転車}

(2)計測地点ごとに認識率の信頼度を変える。下記の要素が計測地点の環境特徴として認識器40の性能に影響を与えるため、信頼度に変化をもたらす。

【0151】

・{道幅、歩道幅、ガードレールの有無、白線、電線の有無、街路樹}

・{交差点、単路}

・{商店街、住宅街、オフィス街}

(3)センサ(認識手法を含む)ごとに認識率の信頼度を変える。

【0152】

(4)車両の走行速度に応じて信頼度を設定する。

例えば、次のカテゴリで走行速度を分類する。[停車、発進、徐行、低速、中速、高速]

[7−3−7.センタへのアップロード]

いま、iをセンシングが行われた地点名の番号とするとき、(xi,si,ri,fi)を予測装置10からセンタ70へのアップロード情報とする。ただし、

xi:地点iの座標

si:地点iの状況

ri:認識器40の信頼度(条件ごとの平均認識率)

fi:予測器50の結果

である。また、siは以下の情報を含む。

【0153】

(1)場所のタイプ:{駅前, 住宅街, ビル街, 公園, 海岸, 他}

(2)道路環境:{交差点, 単路, 駐車場}

(3)走行状態:({停車,発進,徐行,走行中}, 走行速度)

(4)歩行者の存在方向:{右, 正面, 左}

(5)認識結果:{歩行者,自転車,それ以外}

[7−3−8.異なる車両間での認識結果の対応づけ]

図21に示すように異なる車両A,Bが同時に同じ地点の歩行者を観測した場合、歩行者発生の統計量という観点でいえば、Aの画像とBの画像の間で対応付けを行い、重複してカウントすることを防ぐ。ただし、この対応付けを行うには、三次元的な歩行者位置を高精度で獲得する必要がある。一方で、事故発生にいたる危険度という観点では、同じ歩行者に対して観測する車両台数分だけ危険度は増大すると考えることもできる。

【0154】

そこで、本実施形態では、

(規範1)純粋に歩行者の発生数の統計データの獲得を志向する。

(規範2)上記を危険度に換算して延べ歩行者人数を統計データとする。

【0155】

の2つの規範を考える。

一般に、A,Bで同一場所の歩行者群を観測した場合、対応をとることの技術的難易度は高い。そこで、

(1)和をとる方法(延べ人数の算出を行う)

(2)複数の観測値から代表的な値を算出する方法

(2−1)平均値をとる方法

(2−2)最大値を選ぶ方法

(3)高度なバッチ処理を行う方法

が考えられる。

【0156】

ここで方法(1)は(規範2)に該当する。すなわち、複数台の車両で同一の歩行者を撮影したときも延べ数としてカウントする。もし、センタ70に撮像位置を付した映像データが集積されるならば(3)により上記の対応付けも可能となる。

【0157】

[7−3−9.予測の時間範囲]

プローブカーに代表される車両(予測装置10)からセンタ70に撮像画像をアップロードし相互利用するという考えに基づくと、センタ70でそのアップロードされた画像群に大規模かつ高度な演算を施し、歩行者その他の認識を行うことは可能である。

【0158】

この場合、サービスをうける車両は、少なくとも自車位置からセンタ70との交信およびセンタ70での計算を考慮した遅延時間に相当する距離だけ離れた位置について予測された情報を受け取ることができる。予測の信頼度が多少低くても即座に予報を得たいという場合は自車位置に関する過去の統計情報から予想された歩行者発生頻度を即座にセンタ70から得ることができる。

【0159】

[7−4.認識器40の性能向上に関する処理]

次に、図7中のB30で示した認識器40の性能向上に関する処理について説明する。

S240では、認識パラメータを設定する。この認識パラメータは、画像認識のためのパラメータである。

【0160】

S250では、画像から歩行者を認識する。この処理は、撮像部41からのデータに基づき、認識器40が行うものである。

次のS260では、部分領域ごとの発生頻度に変換する。

【0161】

続くS270では、差分を評価する。

次のS280では、差分が閾値以下か否かを判断する。ここで差分が閾値以下であると判断された場合(S280:YES)、S290にて信頼度を算出し、S320へ移行する。一方、差分が閾値を上回ると判断された場合(S280:NO)、認識パラメータを修正して、S240からの処理を繰り返す。

【0162】

[7−4−1.認識器40の性能向上]

予測を目的とする場合は、画像の認識演算は必ずしも車載でリアルタイムに行う必要はない。画像データと位置情報をセンタ70に伝送し、センタ70側で大量に一括処理することも考えられる。また、このような画像伝送に適した認識方式も提案されている。以下では、予測器50と認識器40とのインタラクションを想定した認識器40の性能向上について説明する。

【0163】

[7−4−2.認識パラメータの設定]

(1)過去のデータに基づく設定

過去のデータから予測した歩行者発生頻度の時空間分布を初期値として、これから行う画像認識のパラメータを設定する。例えば、以下のようにすることが考えられる。

【0164】

・通学団が多いところでは複数の集団認識にあった認識パラメータを設定する。

・自転車が多いところでは自転車用の認識パラメータを設定する。

・過去のデータから地図上の位置および撮像画面上の部分領域(図18参照)の位置について重み付けを施す。

【0165】

(2)対象オブジェクトに応じた設定

(2―1)移動度および移動範囲に基づく設定

自転車と人では移動度と移動範囲が異なるため、発生頻度の分布も異なってくる。この性質を利用して、認識器40及び予測器50を設定する。

【0166】

例えば、自転車など移動度の高い対象物の場合は過去に通り過ぎた場合でも、交差点停車時に追いつかれて再度目前に出現するケースがある。このような場合、隣接する複数の空間範囲(1つの空間範囲は本実施形態で予測頻度の算出対象となる走行系路上の1区域とする)にまたがった時間範囲での出現予測が必要となる。例えば、走行予定経路に沿ってxa,xb,xcの3つの領域がその順番に隣接している際に、xa区間内で走行する方向と同じ方向に進路をとる自転車B1を検出した際には、xbまたはxcに存在する交差点において再度B1と遭遇する可能性があるため、自転車の予測頻度を高めておくという具合である。

【0167】

(2−2)オブジェクトの画像特徴に基づく設定

オブジェクトの形状、空間スペクトル(DCT係数など)、動き、色などを含む画像特徴およびその時系列変化を特徴ベクトルとする認識特性(多変量回帰分析では回帰係数行列、主成分分析では固有行列がそれに相当する)を利用して、認識器40及び予測機を設定する。

【0168】

(2−3)認識対象領域の限定

歩行者存在領域(歩道、車道、駐車場、階段など)は一般に統計的に限定することができる。しかし、それらを撮影する車載カメラの位置姿勢は車載カメラの取り付け位置や車の走行状態に応じて変化するために、シーン中での見え方が変化する。ただし、その変化は車載カメラであるがゆえにある程度パターン化できるため、ケースバイケースで画像面上の二次元領域として歩行者存在領域を限定することは、なおも可能である。

【0169】

(2−4)予想される歩行者のタイプに応じた設定

特開2009−271758号公報に開示したように、歩行者のタイプに応じた認識特性を選択し、それにあったパラメータを設定することができる。ここでは過去の統計や周囲環境をもとに、たとえば通学児童が多いならばその身長や動きにあった認識パラメータ(DCT係数のAC電力に関する判定閾値や主成分電力の判定閾値、動きの発生状況など)、老人の一人歩きが多いようであればそれにあったパラメータを優先的に設定するなどが考えられる。

【0170】

[7−4−3.認識器40の原理]

いま、ある車両のカメラで撮影した画像において、特開2007−060273号公報及び、特開2007−072987号公報に開示したように、画像中に存在しうるオブジェクトの確信度を画像データ特徴量に対する多変量線形回帰モデルで表現すれば、次式で歩行者認識の結果を算出することができる。

【0171】

【数11】

【0172】

ただし、CBは(K×N)の行列であり、k行n列の成分[CB]knは画像中のk番目の部分領域がカテゴリnのオブジェクトである場合の確信度を表す。

いま、歩行者であるかどうかだけであるならばN=1としてCBは列ベクトルとなり、k行目の成分はk番目の部分領域(たとえば画像中のブロック画素)に映るオブジェクトが歩行者である確信度を表す。もし、N>1の歩行者分類があれば[CB]knは部分領域kにおけるカテゴリnの歩行者(たとえば男性、女性、子供、など)を表す。あるいはN=2として歩行者確信度と非歩行者確信度をn=1,2に割り当てることもできるし、歩行者のカテゴリに方向因子{右、正面、左など}を含めることもできる。ただし、一般に分類のカテゴリが増えるほど認識器40は高い性能が求められるため、現状の画像認識技術では歩行者の有無程度にとどめておくほうが現実的である。

【0173】

SBは(K×L)の行列であり、状況ベクトルssと画像特徴ベクトルspで構成される特徴ベクトルsB(L次元列ベクトル)を転置した行ベクトルsBT(k)をk行目に含む。Bはこれらの特徴量に対する回帰係数行列(L×N)である。このBは最小二乗法により求めることができ、次式のようになる。

【0174】

【数12】

【0175】

ここで、初期のBを算出するためにはYB(K×N)にサンプル映像から人間が作成した正解値(GT)を、SBにはその各々に対応する画像などの特徴量を入れてやる必要がある。このBを用いて新たなシーンで歩行者を認識させる。そのときの認識の信頼度はその平均認識率として算出することができる。ただし、走行開始後にGTをリアルタイムで獲得することはほぼ不可能であるため、その後の認識履歴はリアルタイムでは推定した確信度ベースとなる。一方で、センタへのアップロードを行うかあるいは走行終了後にオフライン処理を行えば走行映像にGTを付与していくことはできる。

【0176】

なお、歩行者の認識に関しては特開2009−271758号公報のように、差分画像のDCT係数をベースにして時系列特徴量を構成し、主成分分析で判定する方法も適用できる。この場合、上記式11のSBを主成分分析によって次元圧縮された特徴量で構成することで、それ以後の回帰係数を用いた認識の枠組みがそのまま適用できる(主成分回帰分析)。それ以外にも非線形手法を含む多くの方法(SVMや動的テンプレート、動きベクトルを用いる方法など)が存在し、学習型の認識手法の場合は学習データと認識特性の関係において上記と類似した様相(学習量の増大に伴う認識率向上、過学習(overfitting)、学習不適合、異常値、データ欠損の問題など)を呈する。本実施形態ではそれらの詳細は省略する。

【0177】

[7−4−4.予測器50]

過去の統計に基づく予測頻度の行列FP(KP×M)は多変量回帰予測によれば、次式で表される。

【0178】

【数13】

【0179】

ただし、

P:回帰係数行列(LP×M)

sP:特徴ベクトル(LP×1)

SP:特徴行列(KP×LP)

である。Pは認識器40の場合と同様に最小二乗法を用いて次式で算出できる。

【0180】

【数14】

【0181】

予測頻度のデータ行列YP(KP×M)は上述の車載の認識器40が算出した確信度行列CB(画像内の部分領域ごとの認識結果)を用いて作成することができる。これはCBで歩行者と判定された部分領域から歩行者数を計数し、予測対象区域内の部分領域(M個)における発生頻度値に変換することで可能になる。いま、この変換操作を次式で表現する。

【0182】

【数15】

【0183】

ここでCBの信頼度がRB(≒70)であれば、CBから生成したYPを学習データとする回帰係数行列Pの信頼度もたかだかRB程度になる。いま、この機械認識によって推定した真理値をET(Estimated Truth)と呼ぶことにする。

【0184】

もし、オフライン処理などにより人間あるいは完全な認識器40が与えた正解値(GT)を用いることができるならば、上記のRBはほぼ100%とすることができる。このETとGTを用いて予測の条件を論理的に分類すると以下のようになる。

【0185】

(1)過去の統計データなし(GT、ETともになし)

(2)GTなし、ETあり

(3)GTあり、ETなし

(4)GTとETが混在

これらの場合を統一的に表現するためには、RBの値を認識データに付与すればよい。いま、CBにGTとETが混在している場合、上記式4を想定すると、CBは、次式で表される。

【0186】

【数16】

【0187】

つまり、各学習イベントの実効確信度が認識器40の信頼度と認識器40が出力した確信度の積で表現された値となる。ただし、

M:地点kにおける部分領域(歩行者が存在しうる領域。図18参照)の最大個数。車道内/車道外、進行方向の右側/左側、などを分類のカテゴリとして部分領域を定義することができる。

【0188】

rk:地点kの画像に用いた認識器40の信頼度。人間によるGTの場合はほぼ値1をとる。厳密にはスキルによって左右されるため、1未満になる場合もある。

fkm:地点kで撮影した画像中のm番目の部分領域で認識された歩行者の数(認識器40が出力した歩行者発生頻度)

である。このYP^を過去の統計データとして予測頻度の行列FPの近似値FP^を算出すると、次式のようになる。

【0189】

【数17】

【0190】

となる。この確信度FP^の信頼度R(FP^)が、たとえば

【0191】

【数18】

【0192】

ならば予測器50と認識器40のトータルの性能はサービス要件を満たすと判断できる。

[7−4−5.同一場所のセンシング]

同じ場所と時間における複数の観測値については、各々の観測値に基く確信度をスコアとみなして合計し、平均値あるいは総合点の閾値判定をする。そこで、同じ時空間XTθで撮像される複数の画像(所定区域内Xで同じ時間帯Tに同じ進行方向θで撮影した複数の画像)に対して、複数の認識器40が認識結果(確信度ベクトル)を集積させる。すなわち、次式で示される。

【0193】

【数19】

【0194】

ここで、rnは次のようになる。

【0195】

【数20】

【0196】

また、

n:認識器の識別番号であり、n=1,・・・,N

f0:初期の歩行者頻度ベクトル

fn:認識器nが出力する歩行者頻度ベクトル

f:N個の認識器の出力の平均値

sl:時刻を含む状況ベクトル(lは離散時刻のインデックスを示す整数)

上の式19により、対象地点kごとに算出する。この場合、認識器40の信頼度が低い値であってもその集積効果により、全体として十分な信頼度の確信度を出力することができると期待される。

【0197】

[7−4−6.1台の車両による観測]

車載カメラ画像の認識結果、撮影時刻、撮影場所はカーナビの地図上で対応付けて記憶装置に格納することができる。このようにして1台の車が観測したデータを車載のハードディスクなどに蓄積しておけば、ナビゲーション装置を介して位置xkを指定することで、それまでの通過時刻の履歴{sl}を検索することができる。また、時間情報を状況ベクトルsで指定すれば他の周囲状況や通過地点xが検索できる。1台の車が何度も同じルートを通る場合、車に蓄積される観測データでルート上の通過地点に関する予測(蓄積データにはない未来時刻に関する人発生頻度を推定する)を行うことが可能になる。これは、日種、曜日、時間帯に依存した時空間分布を仮定することで可能になる。

【0198】

1台の車に記憶された過去の統計データから、これから走行する予定位置における歩行者発生頻度を予測するには、上記式17により次式を計算すればよい。

【0199】

【数21】

【0200】

ただし、

xk:各成分は番号kを割り振られた地点を地理的に特定する語彙(座標、地名に関する言語表現)、すなわち非数値情報に対応し、これらを数量化理論により数値化した値をとる。具体的には、各語彙を予測対象として指定するときに1、そうでなければ0を入れる。

【0201】

sl:各成分は番号lを割り振られた離散時刻を特定する語彙(季節、月、曜日、時間帯)と対応しており、予測条件として指定するときに1、そうでなければ0を入れる。さらには離散時刻lにおけるxkの付帯状況(天候や周囲環境など)もこのベクトル内で記述できる。

【0202】

また、予測対象となった地点で車両が実際に観測した値F1と予測値F0との間の誤差ΔFは次式で表される。

【0203】

【数22】

【0204】

[7−4−7.統計データの分類]

予測器50の入力となる統計データは以下のソースから得られる。

(1)車載の認識器40の出力(ET)または人手によるGT

(2)センタ上の認識器の出力または人手によるGT

(3)携帯機器やPCによる認識結果(ET)または人手によるGT

(4)定点観測インフラによる認識結果(ET)または人手によるGT

危険度という観点では、上記の統計データは次のカテゴリで事前に分類されていることが望ましい。

【0205】

(a)歩行者の車道内歩行者と車道外歩行者

(b)走路進行方向の右か左

などを分類して予測できれば実効性が向上する。これは観測区域をドライバーの視野から見てM個の部分領域に分割し、それらを特徴ベクトルに組み込むことで容易に実現される。

【0206】

[7−4−8.認識器40の性能改善]

予測器50で算出した予測発生頻度と認識器40が走行時に撮像した画像から算出した発生頻度の間の差分が大きければ、予測器50と認識器40の少なくともどちらか一方について修正を施す必要がある。いま、その差分の大きさを次式のスカラー値で表現する。

【0207】

【数23】

【0208】

これは絶対値規範による予測誤差電力と解釈できる。このEPがある閾値EPTHを超えるとき、予測器50と認識器40とに関わる修正を行う。

しかるに、上記式4の予測器50に関して大幅な修正が必要となるのは以下のケースに限られる。

【0209】

(1)FATRにおいて、アトラクタとタイムゲートに関する設定が大きく間違っている場合

(2)FRFPにおいて、学習データの質または量が十分でない場合

ここで(1)は画像認識が関与しないためここでは考えないこととし、特に(2)に注目する。FRFPにおいてどのような予測方式を用いるかによって性能は変わりうるが、ここではあるひとつの予測方式に限定した場合(本実施例では多変量線形回帰予測:式13、式14)の修正について考える。

【0210】

予測器50の学習データをすべて人手で作成するのは一般に困難であるので、認識器40の出力を信頼度つきで予測器50の学習データとすることはすでに述べた。したがって、予測器50の改善の問題は、認識器40の性能改善の問題に集約される。

【0211】

認識器40の性能改善に際しては次の2つの手法がある。

(IP1)画像認識の学習データの質と量を改善する。

(IP2)画像認識の設定パラメータを改善する。

【0212】

まず、(IP1)に関しては、次の制約式を満たすまで、学習データを増やすことを行う。

【0213】

【数24】

【0214】

ただし、rnは、上記式20で示すごとくである。

すなわち、{認識器40の平均値が閾値1(fth)以上}かつ{プローブによる確信度の合計値が閾値2(Φth)}となるまで学習データを増大させる。これはプローブシステムによってセンタが集めた信頼度つきの画像認識結果を学習データとしてダウンロードすることによって行われる。あるいは事前にセンタ上で計算した認識特性(回帰係数行列)をダウンロードしてもよい。この(IP1)が完了した段階で再度、上述の予測と認識のプロセスを繰り返し、上記式22で差分を再評価する。ここで、式23のEPを再度計算し、EPがEPTH以下になるならば修正はここで終了する。もし、EP>EPTHであれば、(IP2)を開始する。

【0215】

(IP2)の処理、予測、認識、EP評価を繰り返し、EPがEPTH以下になれば終了する。所定のパラメータ範囲内でEPTH以下にならなければ、修正を終了してEPが最小値をとった場合のパラメータを暫定的に採用し、センタに他の車両の認識器40の設定例を問い合わせる。

【0216】

[8.効果]

本実施形態では、過去の発生頻度データを検索し(図6中のS170)、FPFPを算出する(S180)。具体的には、予測器50の出力である予測結果をベクトルとして表現する。つまり、予測対象の分類を{男性、女性、子供、自転車、不明、犬}×{右、左}の合計12種類で考え、ある車載カメラで観測される歩行者発生頻度の特徴ベクトル(予測の目的変数)を12次元とした。また、特徴ベクトルが発生する際に、その説明変数となる状況情報を{場所、日時、天候}とした。ここで、場所は3次元(それぞれの次元が区間に相当)、日時は{年、月、曜日}の合計22次元、天候は{晴、曇、雨}の3次元とする。そして、この28次元の状況ベクトルに対する特徴ベクトルの回帰関係を線形最小2乗法で解くようにした。

【0217】

このように、過去の発生頻度データを時空間情報(状況ベクトル)及び頻度情報(特徴ベクトル)からなる頻度データとし、このような頻度データに基づき、予測器50によって、予測対象区域におけるオブジェクトの発生頻度を予測する。

【0218】

これにより、予測対象区域における歩行者等のオブジェクトの発生頻度を適切に予測することができる。

また、本実施形態では、車両外部を撮像する撮像部41と、撮像部41にて撮像される画像に基づき、画像認識結果から頻度情報を生成する認識器40とを備える構成とした(図1参照)。これにより、頻度データを自車両に集積することが可能となる。

【0219】

さらにまた、本実施形態では、認識器40による画像認識結果に対する信頼度を算出する演算部45を備える構成とした(図1参照)。演算部45は、オブジェクトの種類、計測地点、画像認識のためのセンサ及び認識手法、並びに、車両の走行速度の少なくともいずれかに基づき、信頼度を算出する(図7中のS290)。これにより、集積される画像認識結果に対し信頼度という重み付けを行うことができる。その結果、認識器40による画像認識結果を予測器50の学習データとして用いることができる。

【0220】

また、本実施形態では、送受信部20が、車両走行地点の情報、認識器40による画像認識結果、演算部45にて算出された信頼度、及び、予測器50の予測結果をセンタ70へアップロードする(図7中のS310,S320)。これにより、予測装置10を搭載する自車両がプローブカーとして機能する。また、信頼度をアップロードするため、センタ70に集積される画像認識結果に対し信頼度という重み付けを行うことができる。さらにまた、予測器50による予測結果をアップロードするため、予測器50を具備しない車両(図3参照)に対し、予測結果をセンタから配信することができる。もちろん、予測結果をセンタ70へ送信しない場合でも、センタ70側で予測を行い、当該センタ70側の予測結果を配信するようにしてもよい(図4中の大規模予測部76及び配信部77)。

【0221】

さらにまた、本実施形態では、画像認識のための認識パラメータを認識器40に設定するパラメータ設定部42を備えている(図1参照)。パラメータ設定部42は、過去の頻度データに基づき、又は、対象となるオブジェクトに応じて、認識パラメータを設定する。これにより、画像認識性能の向上に寄与する。

【0222】

しかも、予測器50による予測結果と認識器40による画像認識結果との差分が閾値以上の場合(図7中のS270,S280)、認識パラメータを修正する(S300)。これにより、認識器40の性能改善が図られる。

【0223】

なお、予測器50による予測結果と認識器40による画像認識結果との差分が閾値以上の場合(図7中のS270,S280)、センタ70に集積されたアップロード情報を取得するようにしてもよい。このようにすれば、認識器40の学習データの質と量とが改善される可能性が高くなる。その結果、予測器50による予測結果と認識器40による画像認識結果との差分を小さくすることに寄与する。

【0224】

また、本実施形態では、過去の頻度データがない場合でも、地理的な要因などからオブジェクトの発生頻度を予測する。

具体的には、学校、店、ショッピングセンタ、病院、駅、テーマパーク、ホール、野球場、バス停、駅、公園などのアトラクタの情報を取得し(図5中のS130,S150)、FATRを算出する(S160)。詳細には、アトラクタ情報からタイムゲート(TG)を設定し(図8中のS440)、タイムゲートを矩形波として当該矩形波の伝播を想定し、分岐路で発生頻度の分割処理を行う(図9中のS451〜S453,S456)。これにより、過去の頻度データが少ない場合でも、地理的な要因などからオブジェクトの発生頻度を予測することができる。また、タイムゲートを矩形波で定義するため、アトラクタに起因するオブジェクトの発生頻度を比較的容易に予測することができる。さらにまた、タイムゲートを定義する矩形波は、アトラクタの平均収容人数を高さとするものとして初期化される。これにより、タイムゲートを比較的簡単な矩形波として定義することができる。また、予測器50は、時間的に遡る矩形波の伝播である逆伝播に基づき、予測対象区域におけるオブジェクトの発生頻度を予測する。これにより、アトラクタに対してのオブジェクトの流入時間から、それ以前のオブジェクトの発生頻度を予測することができる。さらにまた、予測器50は、自車両の予測対象区域の通過時間を考慮して、予測対象区域におけるオブジェクトの発生頻度を予測する。これにより、確実にオブジェクトの発生頻度を予測することができる。

【0225】

なお、本実施形態における送受信部20が「頻度データ取得手段」及び「送信部」に相当し、予測器50が「予測器」に相当し、撮像部41が「撮像部」に相当し、認識器40が「認識器」に相当し、演算部45が「演算部」に相当し、パラメータ設定部42が「パラメータ設定部」に相当する。

【0226】

また、図5中のS130及びS150が「アトラクタ情報取得手段」の機能としての処理に相当し、図8中のS440が「タイムゲート設定手段」の機能としての処理に相当する。

【0227】

以上、本発明は、上述した実施形態に何ら限定されるものではなく、その要旨を逸脱しない範囲において種々なる形態で実施可能である。

【符号の説明】

【0228】

10,11,12…予測装置

20…送受信部

21…受信部

30…ナビゲーション装置

31…報知部

32…アトラクタ情報

40…認識器

41…撮像部

42…パラメータ設定部

43…評価部

44…変換部

45…演算部

46…情報生成部

50…予測器

60…記憶部

70…センタ

【特許請求の範囲】

【請求項1】

車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、

過去の発生頻度に関する頻度データであって、時空間を定義する時空間情報及び当該時空間情報に対応し前記発生頻度を定義する頻度情報とからなる頻度データを取得する頻度データ取得手段と、

前記頻度データ取得手段にて取得される前記頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、

を備えていることを特徴とする予測装置。

【請求項2】

請求項1に記載の予測装置において、

前記時空間情報は、状況情報を説明変数とする状況ベクトルとして定義されること

を特徴とする予測装置。

【請求項3】

請求項2に記載の予測装置において、

前記状況情報には、場所、日時、及び、天候の情報が含まれること

を特徴とする予測装置。

【請求項4】

請求項3に記載の予測装置において、

前記頻度情報は、特徴情報を目的変数とする特徴ベクトルとして定義されること

を特徴とする予測装置。

【請求項5】

請求項4に記載の予測装置において、

前記特徴情報には、オブジェクトの種類及び車両からの景観を複数に分割した部分領域の情報が含まれること

を特徴とする予測装置。

【請求項6】

請求項4又は5に記載の予測装置において、

前記予測器は、前記状況ベクトルに対する前記特徴ベクトルの回帰関係を線形最小二乗法で解くことにより、前記予測対象区域における前記オブジェクトの発生頻度を予測すること

を特徴とする予測装置。

【請求項7】

請求項1〜6のいずれか一項に記載の予測装置において、

車両外部を撮像する撮像部と、

前記撮像部にて撮像される画像に基づき、画像認識結果から前記頻度情報を生成する認識器と、

を備えていることを特徴とする予測装置。

【請求項8】

請求項7に記載の予測装置において、

前記認識器による前記画像認識結果に対する信頼度を算出する演算部を備えていること

を特徴とする予測装置。

【請求項9】

請求項8に記載の予測装置において、

前記演算部は、前記オブジェクトの種類、計測地点、画像認識のためのセンサ及び認識手法、並びに、車両の走行速度の少なくともいずれかに基づき、信頼度を算出すること

を特徴とする予測装置。

【請求項10】

請求項7〜9のいずれか一項に記載の予測装置において、

車両走行地点の情報、及び、前記認識器による前記画像認識結果をアップロード情報としてセンタへアップロードする送信部を備えていること

を特徴とする予測装置。

【請求項11】

請求項10に記載の予測装置において、

前記アップロード情報には、前記演算部にて算出された前記信頼度が含まれること

を特徴とする予測装置。

【請求項12】

請求項10又は11に記載の予測装置において、

前記アップロード情報には、前記予測器による予測結果が含まれること

を特徴とする予測装置。

【請求項13】

請求項7〜12のいずれか一項に記載の予測装置において、

前記予測器による予測結果と前記認識器による認識結果との差分が閾値以上の場合、センタに集積された前記アップロード情報を取得すること

を特徴とする予測装置。

【請求項14】

請求項7〜13のいずれか一項に記載の予測装置において、

画像認識のための認識パラメータを認識器に設定するパラメータ設定部を備えていること

を特徴とする予測装置。

【請求項15】

請求項14に記載の予測装置において、

前記パラメータ設定部は、過去の頻度データに基づき、前記認識パラメータを設定すること

を特徴とする予測装置。

【請求項16】

請求項14又は15に記載の予測装置において、

前記パラメータ設定部は、対象となるオブジェクトに応じて、前記認識パラメータを設定すること

を特徴とする予測装置。

【請求項17】

請求項14〜16のいずれか一項に記載の予測装置において、

前記予測器による予測結果と前記認識器による画像認識結果との差分が閾値以上の場合、前記パラメータ設定部は、前記認識パラメータを修正して設定すること

を特徴とする予測装置。

【請求項18】

請求項1〜17のいずれか一項に記載の予測装置において、

集客力を有し、前記オブジェクトの流出入の駆動する要素であるアトラクタの情報を取得するアトラクタ情報取得手段と、

前記アトラクタ情報に基づき、時間的要因に影響される前記アトラクタでの前記オブジェクトの存在確率をタイムゲートとして設定するタイムゲート設定手段と、を備え、

前記予測器は、前記アトラクタと前記予測対象区域との距離、及び、前記タイムゲートに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測すること

を特徴とする予測装置。

【請求項19】

請求項18に記載の予測装置において、

前記タイムゲートは、前記オブジェクトの発生頻度を高さとする矩形波で定義され、

前記予測器は、前記アトラクタから前記予測対象区域までの分岐路にて分割される前記矩形波の伝播を想定し、前記予測対象区域における前記オブジェクトの発生頻度を予測すること

を特徴とする予測装置。

【請求項20】

請求項19に記載の予測装置において、

前記タイムゲートを定義する矩形波は、前記アトラクタの平均収容人数を高さとするものとして初期化されること

を特徴とする予測装置。

【請求項21】

請求項19又は20に記載の予測装置において、

前記予測器は、時間的に遡る前記矩形波の伝播である逆伝播に基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測すること

を特徴とする予測装置。

【請求項22】

請求項18〜21のいずれか一項に記載の予測装置において、

前記予測器は、自車両の前記予測対象区域の通過時間を考慮して、前記予測対象区域における前記オブジェクトの発生頻度を予測すること

を特徴とする予測装置。

【請求項1】

車両に搭載されて用いられ、予定走行経路上の所定区域である予測対象区域における車両外部のオブジェクトの発生頻度を予測する予測装置であって、

過去の発生頻度に関する頻度データであって、時空間を定義する時空間情報及び当該時空間情報に対応し前記発生頻度を定義する頻度情報とからなる頻度データを取得する頻度データ取得手段と、

前記頻度データ取得手段にて取得される前記頻度データに基づき、前記予測対象区域における前記オブジェクトの発生頻度を予測する予測器と、

を備えていることを特徴とする予測装置。

【請求項2】

請求項1に記載の予測装置において、

前記時空間情報は、状況情報を説明変数とする状況ベクトルとして定義されること