制御処理プログラム、画像表示装置、および画像表示方法

【課題】操作者の指の位置に応じて拡張現実オブジェクトの動作を開始することができる制御処理プログラム、画像表示装置、および画像表示方法を提供する。

【解決手段】本発明の制御処理プログラムは、背景映像を取得する手順と、設置する画像形成装置の表示位置情報を取得する手順と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順と、手または指の位置情報を取得する手順と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順と、前記出力映像を表示する手順と、を有する。

【解決手段】本発明の制御処理プログラムは、背景映像を取得する手順と、設置する画像形成装置の表示位置情報を取得する手順と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順と、手または指の位置情報を取得する手順と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順と、前記出力映像を表示する手順と、を有する。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、制御処理プログラム、画像表示装置、および画像表示方法に関する。

【背景技術】

【0002】

近年、現実の世界の映像に仮想的な物体の画像(以下、拡張現実オブジェクトと称する)を合成してディスプレイで表示することにより、その拡張現実オブジェクトがあたかも現実の世界に存在するかのように視聴者に見せる拡張現実感を使用した技術が注目されている。

【0003】

たとえば下記の特許文献1には、現実の部屋の映像に仮想的な家具の画像を合成して、家具があたかも現実の部屋に存在するかのように見せる技術が開示されている。

【0004】

また、単に現実の世界の映像に拡張現実オブジェクト合成して表示させるだけではなく、拡張現実オブジェクトに対して操作者が働きかけることにより、拡張現実オブジェクトが何らかの動作を開始する技術も開発されている。たとえば、下記の特許文献2には、現実の世界の映像に合成して表示された仮想的なキャラクタを操作者が発する音声に応じて動かす技術が開示されている。

【0005】

しかしながら、特許文献2の画像表示システムでは、操作者が発する音声に応じて拡張現実オブジェクトの動作を開始することはできるものの、操作者の動作、たとえば操作者の指の位置に応じて拡張現実オブジェクトの動作を開始することはできない。

【先行技術文献】

【特許文献】

【0006】

【特許文献1】特表2010−541054号公報

【特許文献2】特許第4696184号公報

【発明の概要】

【発明が解決しようとする課題】

【0007】

本発明は、上述した問題を解決するためになされたものである。したがって、本発明の目的は、操作者の指の位置に応じて拡張現実オブジェクトの動作を開始することができる制御処理プログラム、画像表示装置、および画像表示方法を提供することである。

【課題を解決するための手段】

【0008】

本発明の上記目的は、下記によって達成される。

【0009】

(1)背景映像を取得する手順(a)と、設置する画像形成装置の表示位置情報を取得する手順(b)と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順(c)と、手または指の位置情報を取得する手順(d)と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順(e)と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順(f)と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順(g)と、前記出力映像を表示する手順(h)と、を有する、コンピューターに実行させるための制御処理プログラム。

【0010】

(2)前記背景映像は、前記画像形成装置を設置する場所を撮像手段が撮像して取得されることを特徴とする上記(1)に記載の制御処理プログラム。

【0011】

(3)前記手順(b)において、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする上記(2)に記載の制御処理プログラム。

【0012】

(4)上記(1)〜(3)のいずれか1つに記載の画像処理プログラムを記録したコンピューター読み取り可能な記録媒体。

【0013】

(5)背景映像を取得する背景映像取得手段と、設置する画像形成装置の表示位置情報を取得する表示位置情報取得手段と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する装置画像生成手段と、手または指の位置情報を取得する手指位置情報取得手段と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成するポインタ画像生成手段と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する画像合成手段と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行するモデル実行手段と、前記出力映像を表示する表示手段と、を有することを特徴とする画像表示装置。

【0014】

(6)前記背景映像取得手段は、撮像手段を有し、前記背景映像は、前記画像形成装置を設置する場所を前記撮像手段が撮像して取得されることを特徴とする上記(5)に記載の画像表示装置。

【0015】

(7)前記表示位置情報取得手段は、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする上記(6)に記載の画像表示装置。

【0016】

(8)背景映像を取得する段階と、設置する画像形成装置の表示位置情報を取得する段階と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する段階と、手または指の位置情報を取得する段階と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する段階と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する段階と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する段階と、前記出力映像を表示する段階と、を有する、画像表示方法。

【発明の効果】

【0017】

本発明によれば、操作者の手または指の位置に基づいて、ディスプレイに表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行し、拡張現実オブジェクトの動作を開始する。したがって、操作者は、画像形成装置を実際に操作しているような体験をすることができるので、画像形成装置を実際に設置した場合に近い状態で事前検討することができる。

【図面の簡単な説明】

【0018】

【図1】本発明の第1の実施形態の画像表示装置の概観を示す概略斜視図である。

【図2】本発明の第1の実施形態の画像表示装置の概略ブロック構成図である。

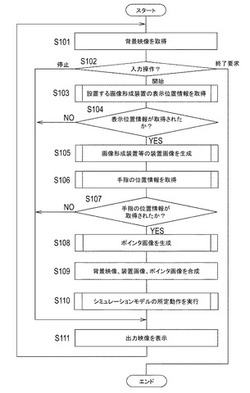

【図3】本発明の第1の実施形態における制御処理プログラムの処理手順を概略的に説明するためのフローチャートである。

【図4】本発明の第1の実施形態において、入力操作として「終了要求」が選択された場合にディスプレイに表示される背景映像を例示する図である。

【図5】本発明の第1の実施形態において、マーカーが配置されていない場合にディスプレイに表示される背景映像を例示する図である。

【図6】本発明の第1の実施形態において、操作者の手指がカメラの視野に入っていない場合にディスプレイに表示される映像を例示する図である。

【図7】本発明の第1の実施形態において、背景映像、装置画像、およびポインタ画像を合成した場合にディスプレイに表示される映像を例示する図である。

【図8】図3に示すステップS103を説明するフローチャートである。

【図9】図3に示すステップS105を説明するフローチャートである。

【図10】図3に示すステップS106を説明するフローチャートである。

【図11】操作ポイントを算出する方法を説明するための模式図である。

【図12】図3に示すステップS108を説明するフローチャートである。

【図13】図12に示すステップS503を説明するフローチャートである。

【図14A】ポインタ画像を例示するための図である。

【図14B】ポインタ画像を例示するための図である。

【図14C】ポインタ画像を例示するための図である。

【図14D】ポインタ画像を例示するための図である。

【図14E】ポインタ画像を例示するための図である。

【図15】図3に示すステップS110を説明するフローチャートである。

【図16】図15に示すステップS702を説明するフローチャートである。

【図17】「印刷動作」のシミュレーションを実行した場合にディスプレイに表示される映像を例示する図である。

【図18】本発明の第2の実施形態の画像表示装置の概略ブロック構成図である。

【発明を実施するための形態】

【0019】

(第1の実施形態)

以下、図1を参照して、本発明の第1の実施形態を説明する。図1は本発明の第1の実施形態の画像表示装置の概観を示す概略斜視図であり、図2は本発明の第1の実施形態の画像表示装置の概略ブロック構成図である。本実施形態の画像表示装置は、操作者の手または指の位置に基づいて、ディスプレイに表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行し、拡張現実オブジェクトの動作を開始させることを特徴とする。なお、本実施形態の画像表示装置は、複写機、プリンター、ファクシミリ、複合機などの画像形成装置の設置を検討する場合に好適に使用することができる。

【0020】

図1に示すとおり、本実施形態の画像表示装置100は、携帯可能なタブレット型の端末であり、画像表示装置100の操作者(以下、単に操作者と称する)が室内を自由に持ち歩くことができるように構成されている。本実施形態では、操作者が画像表示装置100を使用して、画像形成装置および画像形成装置のオプション装置(以下、画像形成装置等と称する)を窓Wがある室内に設置することを検討する場合を想定して説明する。

【0021】

なお、本実施形態の画像表示装置は、上述のようなタブレット型ではなく、背景に拡張現実オブジェクトを重ね合せて表示するゴーグル型(メガネ型)であってもよい。この場合、画像表示装置は操作者の顔部に装着されるので持ち運ぶ必要がなくなる。

【0022】

画像表示装置100は、カメラ110、センサー120、ディスプレイ130、タッチパネル140、スピーカー150、制御部160(図2を参照)、および筐体170を有する。

【0023】

カメラ110は、背景映像取得手段および表示位置情報取得手段として、画像形成装置等を設置する場所を撮像し、背景映像を取得する。操作者は、画像形成装置等を設置する場所がカメラ110の視野に入るように筐体170の向きを調整する。

【0024】

カメラ110は、筐体170の一面に取り付けられており、画像形成装置等を設置する場所の映像を所定の周期で取り込み、制御部160に伝達する。この際、マーカー200の画像も画像形成装置等を設置する場所の映像の一部として取り込まれ、制御部160に伝達される。マーカー200は、表面に文字、記号、図形などが記されたシート状の媒体であり、設置する画像形成装置の機種を識別する情報を含む。操作者は、画像形成装置を設置する場所にマーカー200を予め配置しておく。なお、カメラ110は、筐体170に内蔵することもできる。

【0025】

センサー120は、手指位置情報取得手段として、操作者の手または指(以下、手指と称する)を検出する。センサー120は、たとえば赤外線センサーを有し、筐体170の一面にカメラ110と並んで取り付けられる。センサー120は、センサー120の近距離にある物体からの赤外線放射を赤外線センサーで検出する。センサー120は、操作者の手指が赤外線センサーの検出範囲に入ると、操作者の手指の赤外線放射を検出して、画像データとして制御部160に伝達する。センサー120は、筐体170に内蔵することもできる。

【0026】

なお、後述するとおり、本実施形態の画像表示装置100では、操作者の手指の位置に基づいて、ディスプレイ130に表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行する。操作者の手指の位置は、センサー120が操作者の手指を検出し、制御部160で検出結果を処理することによって取得される。

【0027】

一方、センサー120は赤外線センサーで物体を検出するので、特別に判別処理を施さない限り、制御部160は手指が操作者のものであるのか他の人間のものであるのかを判別することはできない。以下では、説明の便宜上、操作者の手指を用いる場合を例示して説明する。しかしながら、手指には操作者以外の人間の手指も含むことができる。また、人間の手指の代わりに指示棒などを用いることもできる。

【0028】

ディスプレイ130は、表示手段として、出力映像、各種設定項目、メッセージなどを表示する。具体的には、ディスプレイ130は、制御部160が生成する拡張現実オブジェクトと背景映像とが合成された出力映像を表示する。また、ディスプレイ130は、画像表示装置100の各種のモード、機能、オプション装置の機種、表示方法などの設定項目を設定する際の設定画面を表示する。さらに、ディスプレイ130は、各種の設定項目を設定する際に制御部160から出力されたメッセージ、警告メッセージなどを表示する。

【0029】

なお、画像表示装置100は、制御部160からの出力映像を画像表示装置100の外部に出力する出力端子(不図示)をさらに備えることもできる。表画像示装置100が当該出力端子を通じて大画面のディスプレイ、プロジェクタなどに出力映像を送信することにより、ディスプレイ130に表示される映像と同じ映像を大画面のディスプレイ、プロジェクタなどで同時に観ることができる。

【0030】

タッチパネル140は、操作者からの入力操作を受付ける。本実施形態では、操作者は、タッチパネル140を介して各種のモード、機能、オプション装置の機種、表示方法などの設定項目の設定をすることができる。タッチパネル140は、ディスプレイ130上に配置されており、ディスプレイ130の表示に対応する位置に操作者の手指が接触することにより、上記設定項目が選択され、選択された設定項目の情報が制御部160に伝達される。なお、ゴーグル型の画像表示装置の場合は、押ボタンスイッチなどを介して各種のモード、機能、オプション装置の機種、表示方法などを設定することができる。

【0031】

スピーカー150は、印刷音、効果音、警告音、音声案内などを出力する。スピーカー150は、たとえば実際の画像形成装置等が発する音を収録した音または模した音を印刷音として画像形成装置等の動作シミュレーションをする際に発生させる。また、スピーカー150は、たとえば画像表示装置100の設定画面の設定項目を選択するときなどに効果音を出力する。また、動作上のトラブルが生じたときなどには警告音や音声案内を出力する。

【0032】

制御部160は、カメラ110、センサー120、ディスプレイ130、タッチパネル140、およびスピーカー150を制御する。図2に示すとおり、制御部160は、CPU(Central Processing Unit)部161、ROM(Read Only Memory)部162、RAM(Random Access Memory)部163、および大容量記憶部164を有する。制御部160は、表示位置情報取得手段、装置画像生成手段、手指位置情報取得手段、ポインタ画像生成手段、画像合成手段、モデル実行手段として機能する。

【0033】

CPU部161は、バスを通じてROM部162、RAM部163、および大容量記憶部164に接続されている。また、CPU部161は、各種専用インターフェース(不図示)を通じてそれぞれカメラ110、センサー120、ディスプレイ130、タッチパネル140、およびスピーカー150に接続されている。

【0034】

ROM部162は、制御処理プログラム、3Dデータ、およびコンテンツデータを格納する。制御処理プログラムは、画像表示装置100の動作を制御し、各種の演算処理を実行するためのソフトウェア・プログラムであり、CPU部161によって逐次的に実行される。

【0035】

3Dデータは、設置する画像形成装置およびオプション装置の外形を表す3次元画像データを含む。オプション装置としては、たとえば中綴じステープル装置、ステープル製本装置などがある。本実施形態では、3Dデータとして画像形成装置等の機種に応じた3次元画像データが用意されている。なお、3Dデータは、コンピューター・グラフィックスなどで使用される一般的なデータ形式でROM部162に記憶されており、データ形式はとくに限定されない。

【0036】

コンテンツデータは、画像形成装置等に関する実体的なデータなどを含む。具体的には、コンテンツデータは、画像形成装置等の構成に関する情報、画像形成装置等の各部のサイズおよび位置に関する情報、マーカー画像情報、シミュレーションモデルなどを含む。

【0037】

画像形成装置等は、機種によって構成が異なる。コンテンツデータは、それぞれの機種が有する構成要素、構成要素同士の関係などの情報を含む。また、コンテンツデータは、画像形成装置等の各々の筐体サイズに加えて、各々の構成要素、たとえば画像形成装置の操作パネル(オペレーション・パネル)、背面ドア、排紙トレイなどの構成要素のサイズおよび位置も含む。

【0038】

マーカー画像情報は、マーカーの画像に含まれる情報である。マーカー画像情報は、画像形成装置の機種と一義的に対応付けられている。したがって、背景映像からマーカー200の画像を抽出し、マーカー画像情報を取得することにより、設置する画像形成装置の機種を特定することができる。

【0039】

シミュレーションモデルは、画像形成装置等の動作を模擬するための動作シミュレーションモデルである。CPU部161は、設置する画像形成装置等の機種を特定したのち、シミュレーションモデルを走行させて、画像形成装置等の動作シミュレーションを開始する。

【0040】

RAM部163は、背景映像、AR(Augmented Reality)オブジェクト画像、表示状態情報、内部状態情報などを格納する。背景映像は、カメラ110が撮像した背景映像であり、所定の周期で取得されてRAM部163に格納される。本実施形態では、CPU部161は、背景映像に含まれるマーカー200の画像を抽出して画像形成装置を設置する表示位置情報を取得し、RAM部163に格納する。

【0041】

ARオブジェクト画像は、拡張現実オブジェクトとしての画像形成装置等の画像(以下、装置画像と称する)と拡張現実オブジェクトとしての手指のポインタ画像を含む。

【0042】

装置画像は、3Dデータを、設置する画像形成装置等の大きさおよび向きに合わせて、ディスプレイ130に表示する2次元画像に変換したものである。本実施形態では、CPU部161は、画像形成装置の表示位置情報と、ROM部162に格納されている画像形成装置等のサイズに関する情報と、表示状態情報とに基づいて、3Dデータから画像形成装置等の装置画像を生成し、RAM部163に格納する。

【0043】

また、ポインタ画像は、ディスプレイ130上で操作者の手指の位置を示す。ポインタ画像は、たとえば「矢印」、「指」などの所定の画像から選択され、背景映像の操作者の手指の画像10の位置に重ね合せるように生成される。また、ポインタ画像を表示しないように設定することもできる。CPU部161は、手指の位置情報に基づいて、ポインタ画像を生成し、RAM部163に格納する。手指の位置情報は、センサー120からの画像データに基づいてCPU部161が算出する。手指の位置情報の具体的な取得方法およびポインタ画像の具体的な生成方法については後述する。

【0044】

表示状態情報は、装置画像がディスプレイ130にどのような状態で表示されるかについての情報である。表示状態情報は、現在表示対象となっているオプション構成に関する情報、表示方法に関する情報などを含む。表示方法としては、たとえば装置画像の重ね合せ、透過などがある。表示状態情報は、現在表示対象となっているオプション構成や表示方法が変更されると更新される。オプション構成に関する情報、表示方法に関する情報はタッチパネル140を介して操作者が適宜設定することができる。

【0045】

内部状態情報は、シミュレーションモデルの内部状態に関する情報である。本実施形態では、内部状態には、大きく分けて「正常状態」および「故障状態」がある。動作シミュレーションが開始されると、シミュレーションモデルは、「正常状態」となる。

【0046】

内部状態が「正常状態」のとき、シミュレーションモデルは、「印刷動作」などの動作を実行することができる。一方、「故障状態」のとき、シミュレーションモデルは、「印刷動作」などの動作を実行することができない。一方、内部状態が「故障状態」のときしか実行できない動作もある。内部状態が「故障状態」のときは、たとえば背面ドアが開いているときなどである。

【0047】

動作シミュレーションの開始時における内部状態情報の初期値は、ROM部162のコンテンツデータに格納されている。動作シミュレーションが進行し、内部状態が変化すると、内部状態情報は更新される。内部状態が「正常状態」で、シミュレーションモデルが印刷中である場合、内部状態情報は、「正常状態」でかつ「印刷中」である旨を示す情報を含む。

【0048】

CPU161は、シミュレーションモデルの内部状態情報を参照し、画像形成装置を設置する位置と手指の位置情報とに基づいて、画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する。シミュレーションモデルの具体的な動作については後述する。

【0049】

大容量記憶部164は、たとえばハードディスクドライブ、フラッシュメモリなどを備える。大容量記憶部164には、動作シミュレーションを実行する際に表示する動画、設定項目を設定する際に表示するメッセージ動画などの動画データまたは画像データ、印刷音、効果音、警告音、音声案内などの音声データが格納されている。

【0050】

以下、図3〜図7を参照して、本実施形態における制御処理プログラムの処理手順を概略的に説明する。図3は本発明の第1の実施形態における制御処理プログラムの処理手順を概略的に説明するためのフローチャートである。また、図4は、本発明の第1の実施形態において、入力操作として「終了要求」が選択された場合にディスプレイに表示される背景映像を例示する図である。また、図5は本発明の第1の実施形態において、マーカーが配置されていない場合にディスプレイに表示される背景映像を例示する図であり、図6は本発明の第1の実施形態において、操作者の手指がカメラの視野に入っていない場合にディスプレイに表示される映像を例示する図である。また、図7は、本発明の第1の実施形態において、背景映像、装置画像、およびポインタ画像を合成した場合にディスプレイに表示される映像を例示する図である。

【0051】

まず、背景映像を取得する(ステップS101)。カメラ110は、室内において画像形成装置を設置する場所を撮像し、撮像した背景映像をRAM部163に格納する。画像形成装置を設置する場所にマーカー200が事前に配置されている場合、マーカー200を含んだ背景映像がRAM部163に格納される。また、操作者がカメラ110の視野に手指を挿し入れると、背景映像には操作者の手指の画像10も含まれる。

【0052】

次に、入力操作を受け付ける(ステップS102)。制御部160は、タッチパネル140を介して操作者の入力操作を受け付ける。ディスプレイ130は、「終了要求」、「停止」、および「開始」の選択画面を表示する。入力操作として「終了要求」が選択された場合(ステップS102:終了要求)、処理を終了する。入力操作として「停止」が選択された場合(ステップS102:停止)、ステップS111に移行する。図4に示すとおり、制御部160は出力映像として背景映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0053】

一方、入力操作として「開始」が選択された場合(ステップS102:開始)、設置する画像形成装置の表示位置情報を取得する(ステップS103)。制御部160は、背景映像からマーカー200の画像を抽出し、設置する画像形成装置の表示位置情報を取得する。

【0054】

次に、表示位置情報が取得されたか否かを判定する(ステップS104)。表示位置情報が取得されていない場合(ステップS104:NO)、ステップS111に移行する。図5に示すとおり、制御部160は出力映像として背景映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0055】

一方、表示位置情報が取得された場合(ステップS104:YES)、画像形成装置等の装置画像を生成する(ステップS105)。制御部160は、表示位置情報と、ROM部162に格納されている画像形成装置等のサイズに関する情報と、表示状態情報とに基づいて、3Dデータから画像形成装置等の装置画像を生成する。生成された画像形成装置等の装置画像はRAM部163に格納される。

【0056】

次に、手指の位置情報を取得する(ステップS106)。センサー120は、手指からの赤外線放射を検出して、検出結果を画像データとして制御部160に伝達する。制御部160は、上記画像データに基づいて手指の位置情報を算出する。

【0057】

次に、手指の位置情報が取得されたか否かを判定する(ステップS107)。手指の位置情報が取得されていない場合(ステップS107:NO)、ステップS111に移行する。図6に示すとおり、制御部160は出力映像として背景映像に装置画像20を合成した出力映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0058】

一方、手指の位置情報が取得されている場合(ステップS107:YES)、ポインタ画像を生成する(ステップS108)。制御部160は、内部状態情報、手指の位置情報などに基づいて、所定の形状のポインタ画像を生成する。ポインタ画像は、手指の位置情報に基づいて、背景映像の操作者の手指の画像10の位置に重ね合せるように生成される。生成されたポインタ画像はRAM部163に格納される。

【0059】

次に、背景映像、装置画像20、およびポインタ画像を合成する(ステップS109)。制御部160は、RAM部163に格納された背景映像、装置画像、およびポインタ画像を合成する。

【0060】

次に、シミュレーションモデルの所定動作を実行する(ステップS110)。制御部160は、画像形成装置を設置する位置と手指の位置情報とに基づいて、画像形成装置を設置する位置と操作者の手指の位置との間の離間距離を算出し、シミュレーションモデルの所定の動作を当該離間距離の大きさに応じて実行する。

【0061】

次に、出力映像を表示する(ステップS111)。図7に示すとおり、制御部160は背景映像、装置画像20、およびポインタ画像30を合成した出力映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0062】

以上、本実施形態における制御処理プログラムの処理手順を概略的に説明した。以下では、図8〜図17を参照して、図3に示す本実施形態の制御処理プログラムの処理手順についてより詳しく説明する。

【0063】

<設置する画像形成装置の表示位置情報の取得(ステップS103)>

図8は、図3に示すステップS103を説明するフローチャートである。図8に示すとおり、まず、背景映像からマーカー200の画像を抽出する(ステップS201)。CPU部161は、RAM部163に格納されている背景映像からマーカー200の画像を抽出する。

【0064】

次に、マーカー200の画像が抽出されたか否かを判定する(ステップS202)。マーカー200の画像が抽出された場合(ステップS202:YES)、設置する画像形成装置の表示位置情報を取得する(ステップS203)。具体的には、CPU部161は、背景映像から抽出されたマーカー200の画像の大きさおよび向きから、表示位置情報として、設置する画像形成装置の表示位置座標および向きを算出する。ここで、画像形成装置の向きは、画像表示装置100とマーカー200とを結ぶ直線の方向に対する画像形成装置の角度で表される。

【0065】

なお、背景映像から抽出されたマーカーの画像の大きさおよび向きから、拡張現実オブジェクトの表示位置座標および向きを算出する技術は公知技術であるので、ここでは説明を省略する。

【0066】

また、本実施形態では、マーカー200の位置は、設置する画像形成装置の底面の中央部の位置に対応している。しかしながら、マーカー200の位置は、設置する画像形成装置の底面の端部の位置に対応するようにしてもよい。

【0067】

さらに、CPU部161は、抽出されたマーカー200の画像からマーカー画像情報と、カメラ110とマーカー200との離間距離とを取得する。

【0068】

一方、マーカー200の画像が検出されなかった場合(ステップS202:NO)、ステップS104に移行する。

【0069】

<画像形成装置等の装置画像の生成(ステップS105)>

図9は、図3に示すステップS105を説明するフローチャートである。図9に示すとおり、まず、表示状態情報を取得する(ステップS301)。上述したとおり、表示状態情報は、装置画像20がディスプレイ130にどのような状態で表示されるかについての情報である。

【0070】

次に、画像形成装置等の3Dデータを取得する(ステップS302)。具体的には、画像形成装置等の機種と表示状態情報とに基づいてROM部162の3Dデータを取得する。

【0071】

次に、画像形成装置等の装置画像を生成する(ステップS303)。具体的には、ステップS302で取得された3Dデータと、表示位置情報と、画像形成装置等のサイズに関する情報とに基づいて、画像形成装置等の装置画像20を生成する。たとえば、画像形成装置として複写機の機種Xを生成し、オプション装置として中綴じステープル装置の機種Yを透過表示で生成する。

【0072】

<手指の位置情報の取得(ステップS106)>

図10は図3に示すステップS106を説明するフローチャートであり、図11は操作ポイントを算出する方法を説明するための模式図である。

【0073】

まず、図10に示すとおり、センサーから近距離にある物体を検出する(ステップS401)。操作者が手指などをセンサー120の検出範囲に挿し入れると、センサー120はセンサー120から近距離にある物体を検出して、画像データとして制御部160に伝達する。

【0074】

次に、手指の位置情報を取得する(ステップS402)。センサー120からの画像データから操作者の手指の位置情報を取得する。

【0075】

具体的には、制御部160は、カメラ110と操作者の手指との間の離間距離を計測し、当該離間距離に基づいて上記画像データから手指の領域を抽出する。なお、センサー120からの離間距離が一定の範囲内である画像領域を他の領域と区別して抽出する技術は公知であるので、ここでは説明を省略する。

【0076】

図11に示すとおり、本実施形態では、抽出された手指の領域40から操作ポイントを算出し、手指の位置情報とする。手指の領域40は、カメラ110で撮像される背景映像の領域(以下、視認領域50と称する)の上下左右のいずれかの辺から伸びる形で抽出される。手指の領域40と視認領域50の辺とが交わる位置(A点)が図11に示す区画P1〜P4のうちのどの区画に存在するかに応じて、操作ポイント(B点)を決定する。具体的には、以下のとおりである。

・A点が区画P1の辺に存在するとき、B点は手指の領域の最も下でかつ最も右にとる。

・A点が区画P2の辺に存在するとき、B点は手指の領域の最も下でかつ最も左にとる。

・A点が区画P3の辺に存在するとき、B点は手指の領域の最も上でかつ最も右にとる。

・A点が区画P4の辺に存在するとき、B点は手指の領域の最も上でかつ最も左にとる。

【0077】

<ポインタ画像の生成(ステップS108)>

図12は図3に示すステップS108を説明するフローチャートであり、図13は図12に示すステップS503を説明するフローチャートである。また、図14A〜図14Eは、ポインタ画像を例示するための図である。

【0078】

以下では、設置位置に設置された画像形成装置を実空間上に想定し、当該画像形成装置を仮想的な画像形成装置と称する。仮想的な画像形成装置をディスプレイ130上に可視化したものが上述した画像形成装置の装置画像20である。本実施形態では、仮想的な画像形成装置と操作ポイントとの離間距離に応じてポインタ画像の形状を選択する。

【0079】

仮想的な画像形成装置と操作ポイントとの離間距離は、画像形成装置を設置する位置と操作ポイントとの位置に基づいて算出することができる。また、仮想的な画像形成装置の各構成要素の位置、たとえば操作パネルの位置は、画像形成装置を設置する位置と、画像形成装置等の各部のサイズおよび位置に関する情報とに基づいて算出することができる。

【0080】

一方、上述のとおり、操作ポイントの位置は、カメラ110と操作者の手指との間の相対的な位置関係に基づくものであるので、マーカー200を基準とした位置に変換する必要がある。カメラ110とマーカー200との離間距離は、背景映像から抽出したマーカー200の画像から算出することができる。したがって、マーカー200を基準とした実空間の操作ポイントの位置を算出することができる。以下、マーカー200を基準とした操作ポイントの位置を単に操作ポイントと称する。

【0081】

本実施形態では、ポインタ画像の形状、色、透過率は、シミュレーションモデルの内部状態と、仮想的な画像形成装置と操作ポイントとの離間距離とに応じて変化させることができる。以下、ポインタ画像を生成する手順を説明する。

【0082】

まず、図12に示すとおり、シミュレーションモデルの内部状態情報を取得する(ステップS501)。上述のとおり、内部状態情報は、シミュレーションモデルの内部状態に関する情報である。

【0083】

次に、仮想的な画像形成装置と操作ポイントとの離間距離を算出する(ステップS502)。具体的には、制御部160は、仮想的な画像形成装置の位置と手指の位置情報とに基づいて、仮想的な画像形成装置と操作ポイントとの離間距離を算出する。

【0084】

次に、ポインタ画像を選択する(ステップS503)。制御部160は、シミュレーションモデルの内部状態と、仮想的な画像形成装置と操作ポイントとの離間距離と、に応じて、ポインタ画像を選択する。具体的には、図13に示すとおりである。なお、以下ではポインタ画像として「矢印(Obj1)」、「指(Obj2)」、「半透明の矢印(Obj3)」、「工具(Obj4)」を例示して説明するが、ポインタ画像はこれらに限定されない。また、上記離間距離および内部状態とポインタ画像の形状、色、透過率との対応関係も以下で説明するものに限定されない。

【0085】

まず、仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離以上か否かを判定する(ステップS601)。仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離以上の場合(ステップS601:第1の所定距離以上)、図14Aに示すとおり、ポインタ画像31として「半透明の矢印(Obj3)」を選択する(ステップS602)。

【0086】

一方、仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離未満の場合(ステップS601:第1の所定距離未満)、シミュレーションモデルの内部状態を判定する(ステップS603)。内部状態が「故障状態」である場合(ステップS603:故障状態)、図14Bに示すとおり、ポインタ画像32として「工具(Obj4)」を選択する(ステップS604)。なお、上記第1の所定距離は、たとえば50cm〜2mであり、好適には1mである。

【0087】

一方、内部状態が「正常状態」である場合(ステップS603:正常状態)、仮想的な画像形成装置の表面のうち操作ポイントから最も近い面は背面であるか否かを判定する(ステップS605)。仮想的な画像形成装置の表面のうち操作ポイントから最も近い面が背面である場合(ステップS605:YES)、図14Cに示すとおり、ポインタ画像32として「工具(Obj4)」を選択する(ステップS606)。

【0088】

一方、仮想的な画像形成装置の表面のうち操作ポイントから最も近い面が背面ではない場合(ステップS605:NO)、操作ポイントは仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在するか否かを判定する(ステップS607)。操作ポイントが仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在する場合(ステップS607:YES)、図14Dに示すとおり、ポインタ画像33として「指(Obj2)」を選択する(ステップS608)。なお、上記第2の所定距離は、たとえば10〜30cmであり、好適には20cmである。

【0089】

一方、操作ポイントが仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在しない場合(ステップS607:NO)、図14Eに示すとおり、ポインタ画像30として「矢印(Obj1)」を選択する(ステップS609)。

【0090】

次に、再び図12に戻って、ポインタ画像を生成する(ステップS504)。ポインタ画像30〜33は、図4A〜図4Eに示すとおり、その先端が操作ポイントに一致し、背景映像の操作者の手指の画像10に重ね合されるように生成される。生成されたポインタ画像30〜33はRAM部163に格納される。

【0091】

<シミュレーションモデルの所定動作の実行(ステップS110)>

図15は図3に示すステップS110を説明するフローチャートであり、図16は図15に示すステップS702を説明するフローチャートである。また、図17は、「印刷動作」のシミュレーションを実行した場合にディスプレイに表示される映像を例示する図である。

【0092】

まず、シミュレーションモデルの内部状態情報を取得する(ステップS701)。制御部160は、シミュレーションモデルの内部状態情報を取得して、シミュレーションモデルが現在どのような状態であるのかを参照する。

【0093】

次に、シミュレーションモデルの動作を選択する(ステップS702)。制御部160は、仮想的な画像形成装置と操作者の手指との位置関係およびシミュレーションモデルの内部状態に応じて、シミュレーションモデルの動作を選択する。具体的には、図16に示すとおりである。なお、以下では、シミュレーションモデルの動作として「印刷動作」および「背面ドアオープン動作」を選択する場合について例示して説明するが、シミュレーションモデルの動作は「印刷動作」および「背面ドアオープン動作」に限定されない。

【0094】

まず、シミュレーションモデルの内部状態を判定する(ステップS801)。内部状態が「正常状態」である場合(ステップS801:正常状態)、ステップS802に移行する。一方、内部状態が「故障状態」である場合(ステップS801:故障状態)、ステップS805に移行する。

【0095】

ステップS802に移行した場合、操作ポイントが仮想的な画像形成装置の操作パネルから第3の所定距離以内に存在するか否かを判定する(ステップS802)。操作ポイントが画像形成装置の操作パネルから第3の所定距離以内に存在しない場合(ステップS802:NO)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。なお、上記第3の所定距離は、たとえば1〜10cmであり、好適には5cmである。

【0096】

一方、操作ポイントが仮想的な画像形成装置の操作パネルから第3の所定距離以内に存在する場合(ステップS802:YES)、シミュレーションモデルが動作中か否かを判定する(ステップS803)。シミュレーションモデルが動作中である場合(ステップS803:YES)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。

【0097】

一方、シミュレーションモデルが動作中ではない場合(ステップS803:NO)、シミュレーションモデルの動作として「印刷動作」を選択し、図15のステップS703に移行する。

【0098】

次に、ステップS805に移行した場合、操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在するか否かを判定する(ステップS805)。操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在しない場合(ステップS805:NO)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。なお、上記第4の所定距離は、たとえば1〜10cmであり、好適には5cmである。

【0099】

一方、操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在する場合(ステップS805:YES)、シミュレーションモデルが背面ドアオープン中か否かを判定する(ステップS806)。シミュレーションモデルが背面ドアオープン中である場合(ステップS806:YES)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。

【0100】

一方、シミュレーションモデルが背面ドアオープン中ではない場合(ステップS806:NO)、シミュレーションモデルの動作として「背面ドアオープン動作」を選択し、図15のステップS703に移行する。

【0101】

次に、再び図15に戻って、シミュレーションモデルの内部状態を更新する(ステップS703)。ステップS702で選択したシミュレーションモデルの動作に基づいて、シミュレーションモデルの内部状態を更新する。

【0102】

次に、操作ポイントが規定の領域に存在するか否かを判定する(ステップS704)。操作者の手指の移動に伴いポインタ画像の表示位置も移動する。制御部160は、操作ポイントが、仮想的な画像形成装置の予め規定された領域(たとえば、操作パネル上のスタートボタン)に存在するか否かを判定する。操作ポイントが規定の領域に存在しない場合(ステップS704:NO)、シミュレーションモデルの所定動作を実行せずに図3のステップS111に移行する。

【0103】

なお、上記規定の領域は、必ずしも操作ポイントと接触する範囲の領域である必要はない。たとえば、操作パネル上のスタートボタン上方の所定の範囲を含むように設定することもできる。

【0104】

また、操作ポイントが所定の領域に存在するか否かを判定するのではなく、たとえば操作ポイントの位置が単位時間あたりに動く距離、すなわち操作ポイントの移動速度に応じて、シミュレーションモデルの所定動作を実行するように構成してもよい。

【0105】

一方、操作ポイントが規定の領域に存在する場合(ステップS704:YES)、シミュレーションモデルの所定動作を実行する(ステップS705)。ステップS702で選択されたシミュレーションモデルの動作に基づいて、シミュレーションモデルの所定動作を実行する。

【0106】

たとえば、選択されたシミュレーションモデルの動作が「印刷動作」である場合、制御部160は、シミュレーションモデルで「印刷動作」を実行する。図17に示すとおり、「印刷動作」が実行されると、ディスプレイ130には装置画像20が印刷した用紙Sを排紙する様子が動画で表示される。また、スピーカー150は、装置画像20の印刷動作に合わせて印刷音を発生する。なお、装置画像20が印刷する様子を動画で表示する代わりに、実際の画像形成装置が印刷する様子を収録した動画をディスプレイ130に表示してもよい。

【0107】

以上のとおり、本実施形態の画像表示装置100は、画像形成装置を設置する場所の背景映像からマーカー200の画像を抽出して表示位置情報を取得し、装置画像20を生成する。また、画像表示装置100は、手指の位置情報を取得し、ポインタ画像30〜33を生成する。そして、画像形成装置を設置する位置および手指の位置情報に基づいて、シミュレーションモデルの所定の動作を実行し、装置画像20およびポインタ画像30〜33を背景映像と合成して表示する。

【0108】

以上のとおり、説明した本実施形態は、以下の効果を奏する。

【0109】

(a)画像形成装置を設置する場所の背景映像に装置画像20を合成して表示し、操作者の手指の位置に基づいて、ディスプレイ130に表示された装置画像20のシミュレーションモデルの所定動作を実行し、装置画像20の動作を開始する。したがって、操作者は、設置する場所で画像形成装置等を実際に操作しているような体験をすることができるので、画像形成装置等を実際に設置した場合に近い状態で事前検討することができる。

【0110】

(b)画像形成装置を設置する位置に配置されたマーカー200の画像を抽出して、画像形成装置の表示位置情報を取得するので、画像表示装置100を保持する操作者の位置が変化しても背景映像に装置画像20を正確な位置および向きで表示することができる。その結果、操作者は、設置する画像形成装置と室内の他の物体、たとえば窓Wとの位置関係などを確実に把握することができる。

【0111】

(c)現物の画像形成装置を使用することなく、画像形成装置の動作を確認することができる確認用現物の確保・設置、トナー、用紙などの費用を削減することができる。

【0112】

(第2の実施形態)

第1の実施形態では、画像形成装置を設置する場所の背景映像からマーカーの画像を抽出して表示位置情報を取得し、背景映像、装置画像、およびポインタ画像を合成して表示することを説明した。第2の実施形態では、背景映像からマーカーの画像を抽出して表示位置情報を取得せずに他の方法を用いて表示位置情報を取得し、規定の背景映像、装置画像、およびポインタ画像を合成して表示することを説明する。なお、以下の説明では説明の重複を避けるため、第1の実施形態と同様の構成については説明を省略する。

【0113】

図18は、本発明の第2の実施形態の画像表示装置の概略ブロック構成図である。図18に示すとおり、本実施形態の画像表示装置100は、第1の実施形態のカメラ110の代わりに背景映像生成部180を有する。

【0114】

背景映像生成部180は、画像表示装置100の筐体170に内蔵されていてもよいし、筐体170の外部に配置されていてもよい。背景映像生成部180が筐体170の外部に配置されている場合は、有線通信または無線通信で映像データを制御部160に送信する。以下では、背景映像生成部180が筐体170に内蔵されている場合について説明する。

【0115】

<背景映像の取得>

背景映像生成部180は、背景映像取得手段として、大容量記憶部164に規定の背景映像を複数格納している。背景映像は、たとえば画像形成装置等が設置されるオフィスの映像、画像形成装置等を紹介する展示場の映像、コンピューター・グラフィックスの映像などを含む。制御部160は、背景映像生成部180で生成された規定の背景映像に装置画像20およびポインタ画像を合成して出力映像を生成し、ディスプレイ130は合成された出力映像を表示する。したがって、操作者は、画像形成装置等が設置されると想定される場所や状況に応じて背景映像を適宜切り替えることができる。

【0116】

<設置する画像形成装置の表示位置情報の取得>

本実施形態では、たとえば画像表示装置100の位置が予め定められており、設置する画像形成装置の位置と画像表示装置100との相対的な位置が既知である場合を想定する。あるいは、画像表示装置100の位置を正確に取得することができる公知の技術を使用してもよい。制御部160は、設置する画像形成装置の位置と画像表示装置100との相対的な位置関係に基づいて、画像形成装置の表示位置情報を取得することができる。

【0117】

以上のとおり、本実施形態の画像表示装置100は、設置する画像形成装置の位置と操作者との相対的な位置関係に基づいて表示位置情報を取得し、背景映像生成部180で生成された規定の背景映像に装置画像およびポインタ画像を合成して表示する。

【0118】

以上のとおり、説明した本実施形態は、第1の実施形態の効果に加えて以下の効果を奏する。

【0119】

(d)背景映像生成部180は、大容量記憶部164に規定の背景映像を複数保持している。したがって、操作者は、画像形成装置等が設置されると想定される場所に応じて背景映像を適宜切り替えることができる。

【0120】

以上のとおり、実施形態において、本発明の画像表示装置を説明した。しかしながら、本発明は、その技術思想の範囲内において当業者が適宜に追加、変形、および省略することができることはいうまでもない。

【0121】

たとえば、第1の実施形態では、1つのマーカーを配置して1台の画像形成装置を設置する場合について説明した。しかしながら、マーカーの数は1つに限定されず、複数のマーカーを配置してもよい。たとえば、2つのマーカーを配置する場合、2台の画像形成装置の装置画像を表示することができる。

【0122】

また、第1の実施形態では、画像形成装置を設置する場所に配置されたマーカーを用いて表示位置情報を取得することを説明した。しかしながら、表示位置情報を取得する方法はマーカーを使用する方法に限定されない。

【0123】

また、第1の実施形態では、センサーによって検出された物体の画像データから手指の領域を抽出し、当該手指の領域とカメラの視認領域の辺とが交わる位置が所定のうちのどの区画に存在するかに応じて、操作ポイントを決定することを説明した。しかしながら、操作ポイントの決定方法は、このような方法に限定されず他の方法を使用してもよい。

【符号の説明】

【0124】

10 操作者の手指の画像、

20 装置画像、

30〜33 ポインタ画像、

40 手指の領域、

100 画像表示装置、

110 カメラ、

120 センサー

130 ディスプレイ、

140 タッチパネル、

150 スピーカー、

160 制御部、

161 CPU部、

162 RAM部、

163 ROM部、

164 大容量記憶部、

170 筐体、

180 背景映像生成部、

200 マーカー。

【技術分野】

【0001】

本発明は、制御処理プログラム、画像表示装置、および画像表示方法に関する。

【背景技術】

【0002】

近年、現実の世界の映像に仮想的な物体の画像(以下、拡張現実オブジェクトと称する)を合成してディスプレイで表示することにより、その拡張現実オブジェクトがあたかも現実の世界に存在するかのように視聴者に見せる拡張現実感を使用した技術が注目されている。

【0003】

たとえば下記の特許文献1には、現実の部屋の映像に仮想的な家具の画像を合成して、家具があたかも現実の部屋に存在するかのように見せる技術が開示されている。

【0004】

また、単に現実の世界の映像に拡張現実オブジェクト合成して表示させるだけではなく、拡張現実オブジェクトに対して操作者が働きかけることにより、拡張現実オブジェクトが何らかの動作を開始する技術も開発されている。たとえば、下記の特許文献2には、現実の世界の映像に合成して表示された仮想的なキャラクタを操作者が発する音声に応じて動かす技術が開示されている。

【0005】

しかしながら、特許文献2の画像表示システムでは、操作者が発する音声に応じて拡張現実オブジェクトの動作を開始することはできるものの、操作者の動作、たとえば操作者の指の位置に応じて拡張現実オブジェクトの動作を開始することはできない。

【先行技術文献】

【特許文献】

【0006】

【特許文献1】特表2010−541054号公報

【特許文献2】特許第4696184号公報

【発明の概要】

【発明が解決しようとする課題】

【0007】

本発明は、上述した問題を解決するためになされたものである。したがって、本発明の目的は、操作者の指の位置に応じて拡張現実オブジェクトの動作を開始することができる制御処理プログラム、画像表示装置、および画像表示方法を提供することである。

【課題を解決するための手段】

【0008】

本発明の上記目的は、下記によって達成される。

【0009】

(1)背景映像を取得する手順(a)と、設置する画像形成装置の表示位置情報を取得する手順(b)と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順(c)と、手または指の位置情報を取得する手順(d)と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順(e)と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順(f)と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順(g)と、前記出力映像を表示する手順(h)と、を有する、コンピューターに実行させるための制御処理プログラム。

【0010】

(2)前記背景映像は、前記画像形成装置を設置する場所を撮像手段が撮像して取得されることを特徴とする上記(1)に記載の制御処理プログラム。

【0011】

(3)前記手順(b)において、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする上記(2)に記載の制御処理プログラム。

【0012】

(4)上記(1)〜(3)のいずれか1つに記載の画像処理プログラムを記録したコンピューター読み取り可能な記録媒体。

【0013】

(5)背景映像を取得する背景映像取得手段と、設置する画像形成装置の表示位置情報を取得する表示位置情報取得手段と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する装置画像生成手段と、手または指の位置情報を取得する手指位置情報取得手段と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成するポインタ画像生成手段と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する画像合成手段と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行するモデル実行手段と、前記出力映像を表示する表示手段と、を有することを特徴とする画像表示装置。

【0014】

(6)前記背景映像取得手段は、撮像手段を有し、前記背景映像は、前記画像形成装置を設置する場所を前記撮像手段が撮像して取得されることを特徴とする上記(5)に記載の画像表示装置。

【0015】

(7)前記表示位置情報取得手段は、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする上記(6)に記載の画像表示装置。

【0016】

(8)背景映像を取得する段階と、設置する画像形成装置の表示位置情報を取得する段階と、前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する段階と、手または指の位置情報を取得する段階と、前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する段階と、前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する段階と、前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する段階と、前記出力映像を表示する段階と、を有する、画像表示方法。

【発明の効果】

【0017】

本発明によれば、操作者の手または指の位置に基づいて、ディスプレイに表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行し、拡張現実オブジェクトの動作を開始する。したがって、操作者は、画像形成装置を実際に操作しているような体験をすることができるので、画像形成装置を実際に設置した場合に近い状態で事前検討することができる。

【図面の簡単な説明】

【0018】

【図1】本発明の第1の実施形態の画像表示装置の概観を示す概略斜視図である。

【図2】本発明の第1の実施形態の画像表示装置の概略ブロック構成図である。

【図3】本発明の第1の実施形態における制御処理プログラムの処理手順を概略的に説明するためのフローチャートである。

【図4】本発明の第1の実施形態において、入力操作として「終了要求」が選択された場合にディスプレイに表示される背景映像を例示する図である。

【図5】本発明の第1の実施形態において、マーカーが配置されていない場合にディスプレイに表示される背景映像を例示する図である。

【図6】本発明の第1の実施形態において、操作者の手指がカメラの視野に入っていない場合にディスプレイに表示される映像を例示する図である。

【図7】本発明の第1の実施形態において、背景映像、装置画像、およびポインタ画像を合成した場合にディスプレイに表示される映像を例示する図である。

【図8】図3に示すステップS103を説明するフローチャートである。

【図9】図3に示すステップS105を説明するフローチャートである。

【図10】図3に示すステップS106を説明するフローチャートである。

【図11】操作ポイントを算出する方法を説明するための模式図である。

【図12】図3に示すステップS108を説明するフローチャートである。

【図13】図12に示すステップS503を説明するフローチャートである。

【図14A】ポインタ画像を例示するための図である。

【図14B】ポインタ画像を例示するための図である。

【図14C】ポインタ画像を例示するための図である。

【図14D】ポインタ画像を例示するための図である。

【図14E】ポインタ画像を例示するための図である。

【図15】図3に示すステップS110を説明するフローチャートである。

【図16】図15に示すステップS702を説明するフローチャートである。

【図17】「印刷動作」のシミュレーションを実行した場合にディスプレイに表示される映像を例示する図である。

【図18】本発明の第2の実施形態の画像表示装置の概略ブロック構成図である。

【発明を実施するための形態】

【0019】

(第1の実施形態)

以下、図1を参照して、本発明の第1の実施形態を説明する。図1は本発明の第1の実施形態の画像表示装置の概観を示す概略斜視図であり、図2は本発明の第1の実施形態の画像表示装置の概略ブロック構成図である。本実施形態の画像表示装置は、操作者の手または指の位置に基づいて、ディスプレイに表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行し、拡張現実オブジェクトの動作を開始させることを特徴とする。なお、本実施形態の画像表示装置は、複写機、プリンター、ファクシミリ、複合機などの画像形成装置の設置を検討する場合に好適に使用することができる。

【0020】

図1に示すとおり、本実施形態の画像表示装置100は、携帯可能なタブレット型の端末であり、画像表示装置100の操作者(以下、単に操作者と称する)が室内を自由に持ち歩くことができるように構成されている。本実施形態では、操作者が画像表示装置100を使用して、画像形成装置および画像形成装置のオプション装置(以下、画像形成装置等と称する)を窓Wがある室内に設置することを検討する場合を想定して説明する。

【0021】

なお、本実施形態の画像表示装置は、上述のようなタブレット型ではなく、背景に拡張現実オブジェクトを重ね合せて表示するゴーグル型(メガネ型)であってもよい。この場合、画像表示装置は操作者の顔部に装着されるので持ち運ぶ必要がなくなる。

【0022】

画像表示装置100は、カメラ110、センサー120、ディスプレイ130、タッチパネル140、スピーカー150、制御部160(図2を参照)、および筐体170を有する。

【0023】

カメラ110は、背景映像取得手段および表示位置情報取得手段として、画像形成装置等を設置する場所を撮像し、背景映像を取得する。操作者は、画像形成装置等を設置する場所がカメラ110の視野に入るように筐体170の向きを調整する。

【0024】

カメラ110は、筐体170の一面に取り付けられており、画像形成装置等を設置する場所の映像を所定の周期で取り込み、制御部160に伝達する。この際、マーカー200の画像も画像形成装置等を設置する場所の映像の一部として取り込まれ、制御部160に伝達される。マーカー200は、表面に文字、記号、図形などが記されたシート状の媒体であり、設置する画像形成装置の機種を識別する情報を含む。操作者は、画像形成装置を設置する場所にマーカー200を予め配置しておく。なお、カメラ110は、筐体170に内蔵することもできる。

【0025】

センサー120は、手指位置情報取得手段として、操作者の手または指(以下、手指と称する)を検出する。センサー120は、たとえば赤外線センサーを有し、筐体170の一面にカメラ110と並んで取り付けられる。センサー120は、センサー120の近距離にある物体からの赤外線放射を赤外線センサーで検出する。センサー120は、操作者の手指が赤外線センサーの検出範囲に入ると、操作者の手指の赤外線放射を検出して、画像データとして制御部160に伝達する。センサー120は、筐体170に内蔵することもできる。

【0026】

なお、後述するとおり、本実施形態の画像表示装置100では、操作者の手指の位置に基づいて、ディスプレイ130に表示された拡張現実オブジェクトのシミュレーションモデルの所定動作を実行する。操作者の手指の位置は、センサー120が操作者の手指を検出し、制御部160で検出結果を処理することによって取得される。

【0027】

一方、センサー120は赤外線センサーで物体を検出するので、特別に判別処理を施さない限り、制御部160は手指が操作者のものであるのか他の人間のものであるのかを判別することはできない。以下では、説明の便宜上、操作者の手指を用いる場合を例示して説明する。しかしながら、手指には操作者以外の人間の手指も含むことができる。また、人間の手指の代わりに指示棒などを用いることもできる。

【0028】

ディスプレイ130は、表示手段として、出力映像、各種設定項目、メッセージなどを表示する。具体的には、ディスプレイ130は、制御部160が生成する拡張現実オブジェクトと背景映像とが合成された出力映像を表示する。また、ディスプレイ130は、画像表示装置100の各種のモード、機能、オプション装置の機種、表示方法などの設定項目を設定する際の設定画面を表示する。さらに、ディスプレイ130は、各種の設定項目を設定する際に制御部160から出力されたメッセージ、警告メッセージなどを表示する。

【0029】

なお、画像表示装置100は、制御部160からの出力映像を画像表示装置100の外部に出力する出力端子(不図示)をさらに備えることもできる。表画像示装置100が当該出力端子を通じて大画面のディスプレイ、プロジェクタなどに出力映像を送信することにより、ディスプレイ130に表示される映像と同じ映像を大画面のディスプレイ、プロジェクタなどで同時に観ることができる。

【0030】

タッチパネル140は、操作者からの入力操作を受付ける。本実施形態では、操作者は、タッチパネル140を介して各種のモード、機能、オプション装置の機種、表示方法などの設定項目の設定をすることができる。タッチパネル140は、ディスプレイ130上に配置されており、ディスプレイ130の表示に対応する位置に操作者の手指が接触することにより、上記設定項目が選択され、選択された設定項目の情報が制御部160に伝達される。なお、ゴーグル型の画像表示装置の場合は、押ボタンスイッチなどを介して各種のモード、機能、オプション装置の機種、表示方法などを設定することができる。

【0031】

スピーカー150は、印刷音、効果音、警告音、音声案内などを出力する。スピーカー150は、たとえば実際の画像形成装置等が発する音を収録した音または模した音を印刷音として画像形成装置等の動作シミュレーションをする際に発生させる。また、スピーカー150は、たとえば画像表示装置100の設定画面の設定項目を選択するときなどに効果音を出力する。また、動作上のトラブルが生じたときなどには警告音や音声案内を出力する。

【0032】

制御部160は、カメラ110、センサー120、ディスプレイ130、タッチパネル140、およびスピーカー150を制御する。図2に示すとおり、制御部160は、CPU(Central Processing Unit)部161、ROM(Read Only Memory)部162、RAM(Random Access Memory)部163、および大容量記憶部164を有する。制御部160は、表示位置情報取得手段、装置画像生成手段、手指位置情報取得手段、ポインタ画像生成手段、画像合成手段、モデル実行手段として機能する。

【0033】

CPU部161は、バスを通じてROM部162、RAM部163、および大容量記憶部164に接続されている。また、CPU部161は、各種専用インターフェース(不図示)を通じてそれぞれカメラ110、センサー120、ディスプレイ130、タッチパネル140、およびスピーカー150に接続されている。

【0034】

ROM部162は、制御処理プログラム、3Dデータ、およびコンテンツデータを格納する。制御処理プログラムは、画像表示装置100の動作を制御し、各種の演算処理を実行するためのソフトウェア・プログラムであり、CPU部161によって逐次的に実行される。

【0035】

3Dデータは、設置する画像形成装置およびオプション装置の外形を表す3次元画像データを含む。オプション装置としては、たとえば中綴じステープル装置、ステープル製本装置などがある。本実施形態では、3Dデータとして画像形成装置等の機種に応じた3次元画像データが用意されている。なお、3Dデータは、コンピューター・グラフィックスなどで使用される一般的なデータ形式でROM部162に記憶されており、データ形式はとくに限定されない。

【0036】

コンテンツデータは、画像形成装置等に関する実体的なデータなどを含む。具体的には、コンテンツデータは、画像形成装置等の構成に関する情報、画像形成装置等の各部のサイズおよび位置に関する情報、マーカー画像情報、シミュレーションモデルなどを含む。

【0037】

画像形成装置等は、機種によって構成が異なる。コンテンツデータは、それぞれの機種が有する構成要素、構成要素同士の関係などの情報を含む。また、コンテンツデータは、画像形成装置等の各々の筐体サイズに加えて、各々の構成要素、たとえば画像形成装置の操作パネル(オペレーション・パネル)、背面ドア、排紙トレイなどの構成要素のサイズおよび位置も含む。

【0038】

マーカー画像情報は、マーカーの画像に含まれる情報である。マーカー画像情報は、画像形成装置の機種と一義的に対応付けられている。したがって、背景映像からマーカー200の画像を抽出し、マーカー画像情報を取得することにより、設置する画像形成装置の機種を特定することができる。

【0039】

シミュレーションモデルは、画像形成装置等の動作を模擬するための動作シミュレーションモデルである。CPU部161は、設置する画像形成装置等の機種を特定したのち、シミュレーションモデルを走行させて、画像形成装置等の動作シミュレーションを開始する。

【0040】

RAM部163は、背景映像、AR(Augmented Reality)オブジェクト画像、表示状態情報、内部状態情報などを格納する。背景映像は、カメラ110が撮像した背景映像であり、所定の周期で取得されてRAM部163に格納される。本実施形態では、CPU部161は、背景映像に含まれるマーカー200の画像を抽出して画像形成装置を設置する表示位置情報を取得し、RAM部163に格納する。

【0041】

ARオブジェクト画像は、拡張現実オブジェクトとしての画像形成装置等の画像(以下、装置画像と称する)と拡張現実オブジェクトとしての手指のポインタ画像を含む。

【0042】

装置画像は、3Dデータを、設置する画像形成装置等の大きさおよび向きに合わせて、ディスプレイ130に表示する2次元画像に変換したものである。本実施形態では、CPU部161は、画像形成装置の表示位置情報と、ROM部162に格納されている画像形成装置等のサイズに関する情報と、表示状態情報とに基づいて、3Dデータから画像形成装置等の装置画像を生成し、RAM部163に格納する。

【0043】

また、ポインタ画像は、ディスプレイ130上で操作者の手指の位置を示す。ポインタ画像は、たとえば「矢印」、「指」などの所定の画像から選択され、背景映像の操作者の手指の画像10の位置に重ね合せるように生成される。また、ポインタ画像を表示しないように設定することもできる。CPU部161は、手指の位置情報に基づいて、ポインタ画像を生成し、RAM部163に格納する。手指の位置情報は、センサー120からの画像データに基づいてCPU部161が算出する。手指の位置情報の具体的な取得方法およびポインタ画像の具体的な生成方法については後述する。

【0044】

表示状態情報は、装置画像がディスプレイ130にどのような状態で表示されるかについての情報である。表示状態情報は、現在表示対象となっているオプション構成に関する情報、表示方法に関する情報などを含む。表示方法としては、たとえば装置画像の重ね合せ、透過などがある。表示状態情報は、現在表示対象となっているオプション構成や表示方法が変更されると更新される。オプション構成に関する情報、表示方法に関する情報はタッチパネル140を介して操作者が適宜設定することができる。

【0045】

内部状態情報は、シミュレーションモデルの内部状態に関する情報である。本実施形態では、内部状態には、大きく分けて「正常状態」および「故障状態」がある。動作シミュレーションが開始されると、シミュレーションモデルは、「正常状態」となる。

【0046】

内部状態が「正常状態」のとき、シミュレーションモデルは、「印刷動作」などの動作を実行することができる。一方、「故障状態」のとき、シミュレーションモデルは、「印刷動作」などの動作を実行することができない。一方、内部状態が「故障状態」のときしか実行できない動作もある。内部状態が「故障状態」のときは、たとえば背面ドアが開いているときなどである。

【0047】

動作シミュレーションの開始時における内部状態情報の初期値は、ROM部162のコンテンツデータに格納されている。動作シミュレーションが進行し、内部状態が変化すると、内部状態情報は更新される。内部状態が「正常状態」で、シミュレーションモデルが印刷中である場合、内部状態情報は、「正常状態」でかつ「印刷中」である旨を示す情報を含む。

【0048】

CPU161は、シミュレーションモデルの内部状態情報を参照し、画像形成装置を設置する位置と手指の位置情報とに基づいて、画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する。シミュレーションモデルの具体的な動作については後述する。

【0049】

大容量記憶部164は、たとえばハードディスクドライブ、フラッシュメモリなどを備える。大容量記憶部164には、動作シミュレーションを実行する際に表示する動画、設定項目を設定する際に表示するメッセージ動画などの動画データまたは画像データ、印刷音、効果音、警告音、音声案内などの音声データが格納されている。

【0050】

以下、図3〜図7を参照して、本実施形態における制御処理プログラムの処理手順を概略的に説明する。図3は本発明の第1の実施形態における制御処理プログラムの処理手順を概略的に説明するためのフローチャートである。また、図4は、本発明の第1の実施形態において、入力操作として「終了要求」が選択された場合にディスプレイに表示される背景映像を例示する図である。また、図5は本発明の第1の実施形態において、マーカーが配置されていない場合にディスプレイに表示される背景映像を例示する図であり、図6は本発明の第1の実施形態において、操作者の手指がカメラの視野に入っていない場合にディスプレイに表示される映像を例示する図である。また、図7は、本発明の第1の実施形態において、背景映像、装置画像、およびポインタ画像を合成した場合にディスプレイに表示される映像を例示する図である。

【0051】

まず、背景映像を取得する(ステップS101)。カメラ110は、室内において画像形成装置を設置する場所を撮像し、撮像した背景映像をRAM部163に格納する。画像形成装置を設置する場所にマーカー200が事前に配置されている場合、マーカー200を含んだ背景映像がRAM部163に格納される。また、操作者がカメラ110の視野に手指を挿し入れると、背景映像には操作者の手指の画像10も含まれる。

【0052】

次に、入力操作を受け付ける(ステップS102)。制御部160は、タッチパネル140を介して操作者の入力操作を受け付ける。ディスプレイ130は、「終了要求」、「停止」、および「開始」の選択画面を表示する。入力操作として「終了要求」が選択された場合(ステップS102:終了要求)、処理を終了する。入力操作として「停止」が選択された場合(ステップS102:停止)、ステップS111に移行する。図4に示すとおり、制御部160は出力映像として背景映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0053】

一方、入力操作として「開始」が選択された場合(ステップS102:開始)、設置する画像形成装置の表示位置情報を取得する(ステップS103)。制御部160は、背景映像からマーカー200の画像を抽出し、設置する画像形成装置の表示位置情報を取得する。

【0054】

次に、表示位置情報が取得されたか否かを判定する(ステップS104)。表示位置情報が取得されていない場合(ステップS104:NO)、ステップS111に移行する。図5に示すとおり、制御部160は出力映像として背景映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0055】

一方、表示位置情報が取得された場合(ステップS104:YES)、画像形成装置等の装置画像を生成する(ステップS105)。制御部160は、表示位置情報と、ROM部162に格納されている画像形成装置等のサイズに関する情報と、表示状態情報とに基づいて、3Dデータから画像形成装置等の装置画像を生成する。生成された画像形成装置等の装置画像はRAM部163に格納される。

【0056】

次に、手指の位置情報を取得する(ステップS106)。センサー120は、手指からの赤外線放射を検出して、検出結果を画像データとして制御部160に伝達する。制御部160は、上記画像データに基づいて手指の位置情報を算出する。

【0057】

次に、手指の位置情報が取得されたか否かを判定する(ステップS107)。手指の位置情報が取得されていない場合(ステップS107:NO)、ステップS111に移行する。図6に示すとおり、制御部160は出力映像として背景映像に装置画像20を合成した出力映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0058】

一方、手指の位置情報が取得されている場合(ステップS107:YES)、ポインタ画像を生成する(ステップS108)。制御部160は、内部状態情報、手指の位置情報などに基づいて、所定の形状のポインタ画像を生成する。ポインタ画像は、手指の位置情報に基づいて、背景映像の操作者の手指の画像10の位置に重ね合せるように生成される。生成されたポインタ画像はRAM部163に格納される。

【0059】

次に、背景映像、装置画像20、およびポインタ画像を合成する(ステップS109)。制御部160は、RAM部163に格納された背景映像、装置画像、およびポインタ画像を合成する。

【0060】

次に、シミュレーションモデルの所定動作を実行する(ステップS110)。制御部160は、画像形成装置を設置する位置と手指の位置情報とに基づいて、画像形成装置を設置する位置と操作者の手指の位置との間の離間距離を算出し、シミュレーションモデルの所定の動作を当該離間距離の大きさに応じて実行する。

【0061】

次に、出力映像を表示する(ステップS111)。図7に示すとおり、制御部160は背景映像、装置画像20、およびポインタ画像30を合成した出力映像を出力し、ディスプレイ130は出力映像を表示する。そして、再びステップS101に戻って処理を継続する。

【0062】

以上、本実施形態における制御処理プログラムの処理手順を概略的に説明した。以下では、図8〜図17を参照して、図3に示す本実施形態の制御処理プログラムの処理手順についてより詳しく説明する。

【0063】

<設置する画像形成装置の表示位置情報の取得(ステップS103)>

図8は、図3に示すステップS103を説明するフローチャートである。図8に示すとおり、まず、背景映像からマーカー200の画像を抽出する(ステップS201)。CPU部161は、RAM部163に格納されている背景映像からマーカー200の画像を抽出する。

【0064】

次に、マーカー200の画像が抽出されたか否かを判定する(ステップS202)。マーカー200の画像が抽出された場合(ステップS202:YES)、設置する画像形成装置の表示位置情報を取得する(ステップS203)。具体的には、CPU部161は、背景映像から抽出されたマーカー200の画像の大きさおよび向きから、表示位置情報として、設置する画像形成装置の表示位置座標および向きを算出する。ここで、画像形成装置の向きは、画像表示装置100とマーカー200とを結ぶ直線の方向に対する画像形成装置の角度で表される。

【0065】

なお、背景映像から抽出されたマーカーの画像の大きさおよび向きから、拡張現実オブジェクトの表示位置座標および向きを算出する技術は公知技術であるので、ここでは説明を省略する。

【0066】

また、本実施形態では、マーカー200の位置は、設置する画像形成装置の底面の中央部の位置に対応している。しかしながら、マーカー200の位置は、設置する画像形成装置の底面の端部の位置に対応するようにしてもよい。

【0067】

さらに、CPU部161は、抽出されたマーカー200の画像からマーカー画像情報と、カメラ110とマーカー200との離間距離とを取得する。

【0068】

一方、マーカー200の画像が検出されなかった場合(ステップS202:NO)、ステップS104に移行する。

【0069】

<画像形成装置等の装置画像の生成(ステップS105)>

図9は、図3に示すステップS105を説明するフローチャートである。図9に示すとおり、まず、表示状態情報を取得する(ステップS301)。上述したとおり、表示状態情報は、装置画像20がディスプレイ130にどのような状態で表示されるかについての情報である。

【0070】

次に、画像形成装置等の3Dデータを取得する(ステップS302)。具体的には、画像形成装置等の機種と表示状態情報とに基づいてROM部162の3Dデータを取得する。

【0071】

次に、画像形成装置等の装置画像を生成する(ステップS303)。具体的には、ステップS302で取得された3Dデータと、表示位置情報と、画像形成装置等のサイズに関する情報とに基づいて、画像形成装置等の装置画像20を生成する。たとえば、画像形成装置として複写機の機種Xを生成し、オプション装置として中綴じステープル装置の機種Yを透過表示で生成する。

【0072】

<手指の位置情報の取得(ステップS106)>

図10は図3に示すステップS106を説明するフローチャートであり、図11は操作ポイントを算出する方法を説明するための模式図である。

【0073】

まず、図10に示すとおり、センサーから近距離にある物体を検出する(ステップS401)。操作者が手指などをセンサー120の検出範囲に挿し入れると、センサー120はセンサー120から近距離にある物体を検出して、画像データとして制御部160に伝達する。

【0074】

次に、手指の位置情報を取得する(ステップS402)。センサー120からの画像データから操作者の手指の位置情報を取得する。

【0075】

具体的には、制御部160は、カメラ110と操作者の手指との間の離間距離を計測し、当該離間距離に基づいて上記画像データから手指の領域を抽出する。なお、センサー120からの離間距離が一定の範囲内である画像領域を他の領域と区別して抽出する技術は公知であるので、ここでは説明を省略する。

【0076】

図11に示すとおり、本実施形態では、抽出された手指の領域40から操作ポイントを算出し、手指の位置情報とする。手指の領域40は、カメラ110で撮像される背景映像の領域(以下、視認領域50と称する)の上下左右のいずれかの辺から伸びる形で抽出される。手指の領域40と視認領域50の辺とが交わる位置(A点)が図11に示す区画P1〜P4のうちのどの区画に存在するかに応じて、操作ポイント(B点)を決定する。具体的には、以下のとおりである。

・A点が区画P1の辺に存在するとき、B点は手指の領域の最も下でかつ最も右にとる。

・A点が区画P2の辺に存在するとき、B点は手指の領域の最も下でかつ最も左にとる。

・A点が区画P3の辺に存在するとき、B点は手指の領域の最も上でかつ最も右にとる。

・A点が区画P4の辺に存在するとき、B点は手指の領域の最も上でかつ最も左にとる。

【0077】

<ポインタ画像の生成(ステップS108)>

図12は図3に示すステップS108を説明するフローチャートであり、図13は図12に示すステップS503を説明するフローチャートである。また、図14A〜図14Eは、ポインタ画像を例示するための図である。

【0078】

以下では、設置位置に設置された画像形成装置を実空間上に想定し、当該画像形成装置を仮想的な画像形成装置と称する。仮想的な画像形成装置をディスプレイ130上に可視化したものが上述した画像形成装置の装置画像20である。本実施形態では、仮想的な画像形成装置と操作ポイントとの離間距離に応じてポインタ画像の形状を選択する。

【0079】

仮想的な画像形成装置と操作ポイントとの離間距離は、画像形成装置を設置する位置と操作ポイントとの位置に基づいて算出することができる。また、仮想的な画像形成装置の各構成要素の位置、たとえば操作パネルの位置は、画像形成装置を設置する位置と、画像形成装置等の各部のサイズおよび位置に関する情報とに基づいて算出することができる。

【0080】

一方、上述のとおり、操作ポイントの位置は、カメラ110と操作者の手指との間の相対的な位置関係に基づくものであるので、マーカー200を基準とした位置に変換する必要がある。カメラ110とマーカー200との離間距離は、背景映像から抽出したマーカー200の画像から算出することができる。したがって、マーカー200を基準とした実空間の操作ポイントの位置を算出することができる。以下、マーカー200を基準とした操作ポイントの位置を単に操作ポイントと称する。

【0081】

本実施形態では、ポインタ画像の形状、色、透過率は、シミュレーションモデルの内部状態と、仮想的な画像形成装置と操作ポイントとの離間距離とに応じて変化させることができる。以下、ポインタ画像を生成する手順を説明する。

【0082】

まず、図12に示すとおり、シミュレーションモデルの内部状態情報を取得する(ステップS501)。上述のとおり、内部状態情報は、シミュレーションモデルの内部状態に関する情報である。

【0083】

次に、仮想的な画像形成装置と操作ポイントとの離間距離を算出する(ステップS502)。具体的には、制御部160は、仮想的な画像形成装置の位置と手指の位置情報とに基づいて、仮想的な画像形成装置と操作ポイントとの離間距離を算出する。

【0084】

次に、ポインタ画像を選択する(ステップS503)。制御部160は、シミュレーションモデルの内部状態と、仮想的な画像形成装置と操作ポイントとの離間距離と、に応じて、ポインタ画像を選択する。具体的には、図13に示すとおりである。なお、以下ではポインタ画像として「矢印(Obj1)」、「指(Obj2)」、「半透明の矢印(Obj3)」、「工具(Obj4)」を例示して説明するが、ポインタ画像はこれらに限定されない。また、上記離間距離および内部状態とポインタ画像の形状、色、透過率との対応関係も以下で説明するものに限定されない。

【0085】

まず、仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離以上か否かを判定する(ステップS601)。仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離以上の場合(ステップS601:第1の所定距離以上)、図14Aに示すとおり、ポインタ画像31として「半透明の矢印(Obj3)」を選択する(ステップS602)。

【0086】

一方、仮想的な画像形成装置と操作ポイントとの距離が第1の所定距離未満の場合(ステップS601:第1の所定距離未満)、シミュレーションモデルの内部状態を判定する(ステップS603)。内部状態が「故障状態」である場合(ステップS603:故障状態)、図14Bに示すとおり、ポインタ画像32として「工具(Obj4)」を選択する(ステップS604)。なお、上記第1の所定距離は、たとえば50cm〜2mであり、好適には1mである。

【0087】

一方、内部状態が「正常状態」である場合(ステップS603:正常状態)、仮想的な画像形成装置の表面のうち操作ポイントから最も近い面は背面であるか否かを判定する(ステップS605)。仮想的な画像形成装置の表面のうち操作ポイントから最も近い面が背面である場合(ステップS605:YES)、図14Cに示すとおり、ポインタ画像32として「工具(Obj4)」を選択する(ステップS606)。

【0088】

一方、仮想的な画像形成装置の表面のうち操作ポイントから最も近い面が背面ではない場合(ステップS605:NO)、操作ポイントは仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在するか否かを判定する(ステップS607)。操作ポイントが仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在する場合(ステップS607:YES)、図14Dに示すとおり、ポインタ画像33として「指(Obj2)」を選択する(ステップS608)。なお、上記第2の所定距離は、たとえば10〜30cmであり、好適には20cmである。

【0089】

一方、操作ポイントが仮想的な画像形成装置の操作パネルから第2の所定距離以内に存在しない場合(ステップS607:NO)、図14Eに示すとおり、ポインタ画像30として「矢印(Obj1)」を選択する(ステップS609)。

【0090】

次に、再び図12に戻って、ポインタ画像を生成する(ステップS504)。ポインタ画像30〜33は、図4A〜図4Eに示すとおり、その先端が操作ポイントに一致し、背景映像の操作者の手指の画像10に重ね合されるように生成される。生成されたポインタ画像30〜33はRAM部163に格納される。

【0091】

<シミュレーションモデルの所定動作の実行(ステップS110)>

図15は図3に示すステップS110を説明するフローチャートであり、図16は図15に示すステップS702を説明するフローチャートである。また、図17は、「印刷動作」のシミュレーションを実行した場合にディスプレイに表示される映像を例示する図である。

【0092】

まず、シミュレーションモデルの内部状態情報を取得する(ステップS701)。制御部160は、シミュレーションモデルの内部状態情報を取得して、シミュレーションモデルが現在どのような状態であるのかを参照する。

【0093】

次に、シミュレーションモデルの動作を選択する(ステップS702)。制御部160は、仮想的な画像形成装置と操作者の手指との位置関係およびシミュレーションモデルの内部状態に応じて、シミュレーションモデルの動作を選択する。具体的には、図16に示すとおりである。なお、以下では、シミュレーションモデルの動作として「印刷動作」および「背面ドアオープン動作」を選択する場合について例示して説明するが、シミュレーションモデルの動作は「印刷動作」および「背面ドアオープン動作」に限定されない。

【0094】

まず、シミュレーションモデルの内部状態を判定する(ステップS801)。内部状態が「正常状態」である場合(ステップS801:正常状態)、ステップS802に移行する。一方、内部状態が「故障状態」である場合(ステップS801:故障状態)、ステップS805に移行する。

【0095】

ステップS802に移行した場合、操作ポイントが仮想的な画像形成装置の操作パネルから第3の所定距離以内に存在するか否かを判定する(ステップS802)。操作ポイントが画像形成装置の操作パネルから第3の所定距離以内に存在しない場合(ステップS802:NO)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。なお、上記第3の所定距離は、たとえば1〜10cmであり、好適には5cmである。

【0096】

一方、操作ポイントが仮想的な画像形成装置の操作パネルから第3の所定距離以内に存在する場合(ステップS802:YES)、シミュレーションモデルが動作中か否かを判定する(ステップS803)。シミュレーションモデルが動作中である場合(ステップS803:YES)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。

【0097】

一方、シミュレーションモデルが動作中ではない場合(ステップS803:NO)、シミュレーションモデルの動作として「印刷動作」を選択し、図15のステップS703に移行する。

【0098】

次に、ステップS805に移行した場合、操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在するか否かを判定する(ステップS805)。操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在しない場合(ステップS805:NO)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。なお、上記第4の所定距離は、たとえば1〜10cmであり、好適には5cmである。

【0099】

一方、操作ポイントが仮想的な画像形成装置の背面ドアの開閉部から第4の所定距離以内に存在する場合(ステップS805:YES)、シミュレーションモデルが背面ドアオープン中か否かを判定する(ステップS806)。シミュレーションモデルが背面ドアオープン中である場合(ステップS806:YES)、シミュレーションモデルの動作を選択せずに図15のステップS703に移行する。

【0100】

一方、シミュレーションモデルが背面ドアオープン中ではない場合(ステップS806:NO)、シミュレーションモデルの動作として「背面ドアオープン動作」を選択し、図15のステップS703に移行する。

【0101】

次に、再び図15に戻って、シミュレーションモデルの内部状態を更新する(ステップS703)。ステップS702で選択したシミュレーションモデルの動作に基づいて、シミュレーションモデルの内部状態を更新する。

【0102】

次に、操作ポイントが規定の領域に存在するか否かを判定する(ステップS704)。操作者の手指の移動に伴いポインタ画像の表示位置も移動する。制御部160は、操作ポイントが、仮想的な画像形成装置の予め規定された領域(たとえば、操作パネル上のスタートボタン)に存在するか否かを判定する。操作ポイントが規定の領域に存在しない場合(ステップS704:NO)、シミュレーションモデルの所定動作を実行せずに図3のステップS111に移行する。

【0103】

なお、上記規定の領域は、必ずしも操作ポイントと接触する範囲の領域である必要はない。たとえば、操作パネル上のスタートボタン上方の所定の範囲を含むように設定することもできる。

【0104】

また、操作ポイントが所定の領域に存在するか否かを判定するのではなく、たとえば操作ポイントの位置が単位時間あたりに動く距離、すなわち操作ポイントの移動速度に応じて、シミュレーションモデルの所定動作を実行するように構成してもよい。

【0105】

一方、操作ポイントが規定の領域に存在する場合(ステップS704:YES)、シミュレーションモデルの所定動作を実行する(ステップS705)。ステップS702で選択されたシミュレーションモデルの動作に基づいて、シミュレーションモデルの所定動作を実行する。

【0106】

たとえば、選択されたシミュレーションモデルの動作が「印刷動作」である場合、制御部160は、シミュレーションモデルで「印刷動作」を実行する。図17に示すとおり、「印刷動作」が実行されると、ディスプレイ130には装置画像20が印刷した用紙Sを排紙する様子が動画で表示される。また、スピーカー150は、装置画像20の印刷動作に合わせて印刷音を発生する。なお、装置画像20が印刷する様子を動画で表示する代わりに、実際の画像形成装置が印刷する様子を収録した動画をディスプレイ130に表示してもよい。

【0107】

以上のとおり、本実施形態の画像表示装置100は、画像形成装置を設置する場所の背景映像からマーカー200の画像を抽出して表示位置情報を取得し、装置画像20を生成する。また、画像表示装置100は、手指の位置情報を取得し、ポインタ画像30〜33を生成する。そして、画像形成装置を設置する位置および手指の位置情報に基づいて、シミュレーションモデルの所定の動作を実行し、装置画像20およびポインタ画像30〜33を背景映像と合成して表示する。

【0108】

以上のとおり、説明した本実施形態は、以下の効果を奏する。

【0109】

(a)画像形成装置を設置する場所の背景映像に装置画像20を合成して表示し、操作者の手指の位置に基づいて、ディスプレイ130に表示された装置画像20のシミュレーションモデルの所定動作を実行し、装置画像20の動作を開始する。したがって、操作者は、設置する場所で画像形成装置等を実際に操作しているような体験をすることができるので、画像形成装置等を実際に設置した場合に近い状態で事前検討することができる。

【0110】

(b)画像形成装置を設置する位置に配置されたマーカー200の画像を抽出して、画像形成装置の表示位置情報を取得するので、画像表示装置100を保持する操作者の位置が変化しても背景映像に装置画像20を正確な位置および向きで表示することができる。その結果、操作者は、設置する画像形成装置と室内の他の物体、たとえば窓Wとの位置関係などを確実に把握することができる。

【0111】

(c)現物の画像形成装置を使用することなく、画像形成装置の動作を確認することができる確認用現物の確保・設置、トナー、用紙などの費用を削減することができる。

【0112】

(第2の実施形態)

第1の実施形態では、画像形成装置を設置する場所の背景映像からマーカーの画像を抽出して表示位置情報を取得し、背景映像、装置画像、およびポインタ画像を合成して表示することを説明した。第2の実施形態では、背景映像からマーカーの画像を抽出して表示位置情報を取得せずに他の方法を用いて表示位置情報を取得し、規定の背景映像、装置画像、およびポインタ画像を合成して表示することを説明する。なお、以下の説明では説明の重複を避けるため、第1の実施形態と同様の構成については説明を省略する。

【0113】

図18は、本発明の第2の実施形態の画像表示装置の概略ブロック構成図である。図18に示すとおり、本実施形態の画像表示装置100は、第1の実施形態のカメラ110の代わりに背景映像生成部180を有する。

【0114】

背景映像生成部180は、画像表示装置100の筐体170に内蔵されていてもよいし、筐体170の外部に配置されていてもよい。背景映像生成部180が筐体170の外部に配置されている場合は、有線通信または無線通信で映像データを制御部160に送信する。以下では、背景映像生成部180が筐体170に内蔵されている場合について説明する。

【0115】

<背景映像の取得>

背景映像生成部180は、背景映像取得手段として、大容量記憶部164に規定の背景映像を複数格納している。背景映像は、たとえば画像形成装置等が設置されるオフィスの映像、画像形成装置等を紹介する展示場の映像、コンピューター・グラフィックスの映像などを含む。制御部160は、背景映像生成部180で生成された規定の背景映像に装置画像20およびポインタ画像を合成して出力映像を生成し、ディスプレイ130は合成された出力映像を表示する。したがって、操作者は、画像形成装置等が設置されると想定される場所や状況に応じて背景映像を適宜切り替えることができる。

【0116】

<設置する画像形成装置の表示位置情報の取得>

本実施形態では、たとえば画像表示装置100の位置が予め定められており、設置する画像形成装置の位置と画像表示装置100との相対的な位置が既知である場合を想定する。あるいは、画像表示装置100の位置を正確に取得することができる公知の技術を使用してもよい。制御部160は、設置する画像形成装置の位置と画像表示装置100との相対的な位置関係に基づいて、画像形成装置の表示位置情報を取得することができる。

【0117】

以上のとおり、本実施形態の画像表示装置100は、設置する画像形成装置の位置と操作者との相対的な位置関係に基づいて表示位置情報を取得し、背景映像生成部180で生成された規定の背景映像に装置画像およびポインタ画像を合成して表示する。

【0118】

以上のとおり、説明した本実施形態は、第1の実施形態の効果に加えて以下の効果を奏する。

【0119】

(d)背景映像生成部180は、大容量記憶部164に規定の背景映像を複数保持している。したがって、操作者は、画像形成装置等が設置されると想定される場所に応じて背景映像を適宜切り替えることができる。

【0120】

以上のとおり、実施形態において、本発明の画像表示装置を説明した。しかしながら、本発明は、その技術思想の範囲内において当業者が適宜に追加、変形、および省略することができることはいうまでもない。

【0121】

たとえば、第1の実施形態では、1つのマーカーを配置して1台の画像形成装置を設置する場合について説明した。しかしながら、マーカーの数は1つに限定されず、複数のマーカーを配置してもよい。たとえば、2つのマーカーを配置する場合、2台の画像形成装置の装置画像を表示することができる。

【0122】

また、第1の実施形態では、画像形成装置を設置する場所に配置されたマーカーを用いて表示位置情報を取得することを説明した。しかしながら、表示位置情報を取得する方法はマーカーを使用する方法に限定されない。

【0123】

また、第1の実施形態では、センサーによって検出された物体の画像データから手指の領域を抽出し、当該手指の領域とカメラの視認領域の辺とが交わる位置が所定のうちのどの区画に存在するかに応じて、操作ポイントを決定することを説明した。しかしながら、操作ポイントの決定方法は、このような方法に限定されず他の方法を使用してもよい。

【符号の説明】

【0124】

10 操作者の手指の画像、

20 装置画像、

30〜33 ポインタ画像、

40 手指の領域、

100 画像表示装置、

110 カメラ、

120 センサー

130 ディスプレイ、

140 タッチパネル、

150 スピーカー、

160 制御部、

161 CPU部、

162 RAM部、

163 ROM部、

164 大容量記憶部、

170 筐体、

180 背景映像生成部、

200 マーカー。

【特許請求の範囲】

【請求項1】

背景映像を取得する手順(a)と、

設置する画像形成装置の表示位置情報を取得する手順(b)と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順(c)と、

手または指の位置情報を取得する手順(d)と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順(e)と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順(f)と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順(g)と、

前記出力映像を表示する手順(h)と、

を有する、コンピューターに実行させるための制御処理プログラム。

【請求項2】

前記背景映像は、前記画像形成装置を設置する場所を撮像手段が撮像して取得されることを特徴とする請求項1に記載の制御処理プログラム。

【請求項3】

前記手順(b)において、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする請求項2に記載の制御処理プログラム。

【請求項4】

請求項1〜3のいずれか1項に記載の画像処理プログラムを記録したコンピューター読み取り可能な記録媒体。

【請求項5】

背景映像を取得する背景映像取得手段と、

設置する画像形成装置の表示位置情報を取得する表示位置情報取得手段と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する装置画像生成手段と、

手または指の位置情報を取得する手指位置情報取得手段と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成するポインタ画像生成手段と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する画像合成手段と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行するモデル実行手段と、

前記出力映像を表示する表示手段と、

を有することを特徴とする画像表示装置。

【請求項6】

前記背景映像取得手段は、撮像手段を有し、

前記背景映像は、前記画像形成装置を設置する場所を前記撮像手段が撮像して取得されることを特徴とする請求項5に記載の画像表示装置。

【請求項7】

前記表示位置情報取得手段は、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする請求項6に記載の画像表示装置。

【請求項8】

背景映像を取得する段階と、

設置する画像形成装置の表示位置情報を取得する段階と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する段階と、

手または指の位置情報を取得する段階と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する段階と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する段階と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する段階と、

前記出力映像を表示する段階と、

を有する、画像表示方法。

【請求項1】

背景映像を取得する手順(a)と、

設置する画像形成装置の表示位置情報を取得する手順(b)と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する手順(c)と、

手または指の位置情報を取得する手順(d)と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する手順(e)と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する手順(f)と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する手順(g)と、

前記出力映像を表示する手順(h)と、

を有する、コンピューターに実行させるための制御処理プログラム。

【請求項2】

前記背景映像は、前記画像形成装置を設置する場所を撮像手段が撮像して取得されることを特徴とする請求項1に記載の制御処理プログラム。

【請求項3】

前記手順(b)において、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする請求項2に記載の制御処理プログラム。

【請求項4】

請求項1〜3のいずれか1項に記載の画像処理プログラムを記録したコンピューター読み取り可能な記録媒体。

【請求項5】

背景映像を取得する背景映像取得手段と、

設置する画像形成装置の表示位置情報を取得する表示位置情報取得手段と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する装置画像生成手段と、

手または指の位置情報を取得する手指位置情報取得手段と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成するポインタ画像生成手段と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する画像合成手段と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行するモデル実行手段と、

前記出力映像を表示する表示手段と、

を有することを特徴とする画像表示装置。

【請求項6】

前記背景映像取得手段は、撮像手段を有し、

前記背景映像は、前記画像形成装置を設置する場所を前記撮像手段が撮像して取得されることを特徴とする請求項5に記載の画像表示装置。

【請求項7】

前記表示位置情報取得手段は、前記背景映像からマーカーの画像を抽出して前記表示位置情報を取得することを特徴とする請求項6に記載の画像表示装置。

【請求項8】

背景映像を取得する段階と、

設置する画像形成装置の表示位置情報を取得する段階と、

前記表示位置情報と前記画像形成装置のサイズに関する情報とに基づいて、前記画像形成装置の装置画像を生成する段階と、

手または指の位置情報を取得する段階と、

前記手または指の位置情報に基づいて、前記手または指の位置を示すポインタ画像を生成する段階と、

前記背景映像、前記装置画像、および前記ポインタ画像を合成して出力映像を生成する段階と、

前記画像形成装置を設置する位置と前記手または指の位置情報とに基づいて、前記画像形成装置の動作を模擬するシミュレーションモデルの所定の動作を実行する段階と、

前記出力映像を表示する段階と、

を有する、画像表示方法。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図15】

【図16】

【図17】

【図18】

【図7】

【図14A】

【図14B】

【図14C】

【図14D】

【図14E】

【図2】

【図3】

【図4】

【図5】

【図6】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図15】

【図16】

【図17】

【図18】

【図7】

【図14A】

【図14B】

【図14C】

【図14D】

【図14E】

【公開番号】特開2013−105330(P2013−105330A)

【公開日】平成25年5月30日(2013.5.30)

【国際特許分類】

【出願番号】特願2011−248898(P2011−248898)

【出願日】平成23年11月14日(2011.11.14)

【出願人】(303000372)コニカミノルタビジネステクノロジーズ株式会社 (12,802)

【Fターム(参考)】

【公開日】平成25年5月30日(2013.5.30)

【国際特許分類】

【出願日】平成23年11月14日(2011.11.14)

【出願人】(303000372)コニカミノルタビジネステクノロジーズ株式会社 (12,802)

【Fターム(参考)】

[ Back to top ]