情報取得装置、情報取得方法、およびプログラム

【課題】画像データから同一対象者の顔の変化を検出し、変化の内容を示す情報を取得すること。

【解決手段】対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報を取得する変化内容情報取得部と、を備える。

【解決手段】対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報を取得する変化内容情報取得部と、を備える。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、情報取得装置、情報取得方法、およびプログラムに関する。

【背景技術】

【0002】

対象者の顔を撮像し、撮像により得られた画像データを利用して、化粧のアドバイスを行うシステムがある。

例えば、対象者の顔を撮像した画像データに基づき、対象者の顔に仮想的に化粧を施した顔の画像を表示する表示装置がある。これにより、対象者は、実際に化粧をしなくても、化粧を施した場合の自分の顔をイメージすることができる(例えば、特許文献1参照)。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特開2001−238727号公報

【発明の概要】

【発明が解決しようとする課題】

【0004】

しかしながら、全ての対象者の顔の凹凸形状や素肌の色等が一致しているわけではないため、仮想的に化粧を施した場合と、実際に化粧を施した場合とでは、化粧後の顔のイメージが異なるという問題がある。そのため、実際に化粧品の購入を検討している場合、対象者は、売場等で化粧部員に化粧を施してもらい、自分の顔にあっているかどうかを確認してから、化粧品を購入するという場合が多い。

また、同じ化粧品であっても、付ける位置や色の濃さによって、顔のイメージが異なる場合がある。そのため、化粧品を購入しても、売場の化粧部員が化粧したように対象者自身が再現できないという問題がある。

【0005】

本発明は、上記の事情を考慮してなされたものであり、画像データから同一対象者の顔の変化を検出し、変化の内容を示す情報を取得することができる情報取得装置、情報取得方法、およびプログラムを提供することを目的とする。

【課題を解決するための手段】

【0006】

この発明は上述した課題を解決するためになされたもので、本発明の一態様による情報取得装置は、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、前記検出部によって検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得部と、を備える。

【0007】

この発明は上述した課題を解決するためになされたもので、本発明の一態様による情報取得方法は、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出するステップと、検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得するステップと、検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得するステップと、を備える。

【0008】

この発明は上述した課題を解決するためになされたもので、本発明の一態様によるプログラムは、コンピュータに、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出手順、検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得手順、検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得手順、を実行させるためのプログラムである。

【発明の効果】

【0009】

本発明によれば、画像データから同一対象者の顔の変化を検出し、変化の内容を示す情報を取得することができる。

【図面の簡単な説明】

【0010】

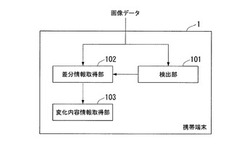

【図1】本発明の一実施形態に係る情報取得装置(携帯端末)の概略構成の一例を示す図である。

【図2】本発明の一実施形態に係る情報取得装置(携帯端末)の構成の一例を示すブロック図である。

【図3】本発明の一実施形態に係る情報取得装置(携帯端末)の動作フローの一例について説明するための図である。

【図4】本発明の一実施形態に係る情報取得装置(携帯端末)に表示される顔マーカーの一例を示す図である。

【図5】本発明の一実施形態に係る第1画像データD1の画像の一例を示す図である。

【図6】本発明の一実施形態に係る第2画像データD2の画像の一例を示す図である。

【図7】本発明の一実施形態に係る第1画像データD1から検出した顔A1の輪郭を示す輪郭線202を示す。

【図8】本発明の一実施形態に係る第2画像データD2から検出した顔A2の輪郭を示す輪郭線203を示す。

【図9】本発明の一実施形態に係る第1画像データD1の画像から検出されるパーツの基準点を示す図である。

【図10】本発明の一実施形態に係る第2画像データD2の画像から検出されるパーツの基準点を示す図である。

【図11】本発明の一実施形態に係る通知情報Kを表示する画像の一例を示す図である。

【発明を実施するための形態】

【0011】

[第1実施形態]

以下、図面を参照して本発明の一実施形態について説明する。図1は、本発明の一実施形態に係る情報取得装置の概要について説明するための図である。なお、本実施形態では、情報取得装置がカメラ付き携帯端末である例について、以下説明する。しかし、本発明はこれに限られず、情報取得装置は、スマートフォン、携帯ゲーム機、タブレット型PC(Personal Computer)、あるいは、ノート型PC等であってもよい。

本実施形態に係る携帯端末1は、対象者の変化前後の顔を撮像することにより、顔の変化の内容を示す情報を対象者に提供するものである。

【0012】

図1に示す通り、本実施形態に係る携帯端末1は、検出部101と、差分情報取得部102と、変化内容情報取得部103とを備える。この検出部101と差分情報取得部102とには、対象者の顔を撮像することにより取得した画像データが入力する。本実施形態において、検出部101と差分情報取得部102とには、対象者Aの顔A1を撮像することにより取得した第1画像データD1と、対象者Aの顔A1に化粧を施した後の対象者Aの顔A2を撮像することにより取得した第2画像データD2とが入力する。

なお、本実施形態においては、化粧前後の顔を撮像した画像データに基づき変化を検出する例について説明するが、本発明はこれに限られない。第1画像データD1と第2画像データD2とは、少なくとも第2画像データD2の方が、第1画像データD1よりも後に撮像された画像データであればよい。また、第1画像データD1が撮像された時と、第2画像データD2が撮像された時との間に、化粧が施されてなくてもよく、また、化粧以外のヘアメイク等の装飾が施されてもよい。

【0013】

検出部101は、入力する変化前の画像データと変化後の画像データから、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する。なお、この予め決められたパーツとは、顔内の位置を検出するために基準となるパーツであって、例えば、眉毛、両目、鼻、口等である。この検出部101は、例えば、第1画像データD1と第2画像データD2から各パーツに対応する画像領域を検出し、各パーツの画像領域の位置を示す情報(以下、パーツ位置情報Fという)を取得する。なお、パーツ位置情報Fは、例えば、画像データに含まれる複数の画素の画素座標値で示される。また、第1画像データD1から検出された各パーツの位置を示す情報をパーツ位置情報F1と、第2画像データD2から検出された各パーツの位置を示す情報をパーツ位置情報F2と、それぞれ示す。

【0014】

差分情報取得部102は、検出部101によって検出されたパーツ位置情報Fに基づき、入力する変化前の画像データと変化後の画像データに含まれる同じパーツ同士の位置を合わせることで、変化の前後の顔の位置合わせを実行する。この差分情報取得部102は、変化前後の顔の位置を合わせた状態において、入力する変化前の画像データと変化後の画像データに基づき、各画像データについての色成分の差分を示す情報(以下、差分情報Gという)を取得する。例えば、差分情報取得部102は、検出部101によって取得されたパーツ位置情報F1、F2に基づき、第1画像データD1と第2画像データD2について顔A1と顔A2との位置を合わせる。この差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1の色成分C1´と、第2画像データD2に示される顔A2の色成分C2´とを比較して、顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。なお、色成分とは、各画素に含まれるR(赤)、G(緑)、B(青)の色の強さを示す情報である。

【0015】

例えば、顔A2は、顔A1に対して両頬にピンク色のチーク(頬紅)を施した顔である場合について説明する。この場合、顔A2の両頬に相当する画素の色成分が顔A1の両頬に相当する画素の色成分と異なる。よって、差分情報取得部102は、顔A1と顔A2の両頬に相当する画素の色成分の差分を示す情報を、差分情報G12として取得する。また、差分情報取得部102は、検出部101によって検出されたパーツ位置情報F1、F2に基づき、顔と各パーツの位置関係に応じて、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す情報(以下、変化位置情報Hという)を取得する。上述した顔A1の両頬にピンク色のチークを施した顔が顔A2である例において、差分情報取得部102は、差分情報G12が検出された画素が、顔内の両頬に対応することを示す変化位置情報H12を取得する。なお、顔内のどの位置に対応するかを示す情報は、顔の輪郭と各パーツとの位置関係に基づき、携帯端末1内のメモリに予め登録されている。

【0016】

変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報(以下、変化内容情報Jという)のうち、差分情報Gが示す色が変化している部分に対応する変化内容情報Jを取得する。言い換えると、変化内容情報取得部103は、検出部101によって検出された各パーツと、差分情報取得部102が算出した差分情報Gが示す色が変化している部分との位置関係に基づき、差分情報Gが示す色が変化している部分に対応する変化内容情報Jを取得する。

また、変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、差分情報Gが示す色に応じて予め決められている顔内の変化の内容を示す変化内容情報Jのうち、差分情報Gが示す色に対応する変化内容情報Jを取得する。

【0017】

例えば、この変化内容情報取得部103は、差分情報取得部102から差分情報G12と変化位置情報H12とを入力する。変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12とに基づき、顔A2には顔A1と比べて“両頬がピンク色に変化している”ということを判定する。つまり、変化内容情報取得部103は、“両頬がピンク色に変化している”という変化を検出する。変化内容情報取得部103は、この検出した変化を示す判定結果(つまり検出した変化)に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示すデータを参照して、この変化の内容を示す変化内容情報Jを取得する。ここで、変化の内容とは、検出された変化の要因に基づき、色成分の変化が示す変化の内容である。つまり、変化内容情報取得部103は、“両頬がピンク色に変化している”という判定結果が、“両頬にピンク色のチークを施した”という変化の内容を示していると判定する。変化内容情報取得部103は、この“両頬にピンク色のチークを施した”という変化内容を示す変化内容情報J12を取得する。なお、この例において、変化内容情報取得部103は、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報である“両頬にチークを施した”という変化内容情報J12−1と、差分情報Gが示す色に応じて予め決められている顔内の変化の内容を示す情報である“ピンク色のチークを施した”という変化内容情報J12−2と、取得する。変化内容情報J12は、この変化内容情報J12−1と変化内容情報J12−2とをあわせた情報である。

なお、本発明はこれに限られず、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報だけを示す変化内容情報を取得するものであってもよい。

【0018】

次に、図2を参照して、携帯端末1の構成の一例について説明する。図2は、携帯端末1の構成の一例を示すブロック図である。

図2に示す通り、携帯端末1は、上述の検出部101と、差分情報取得部102と、変化内容情報取得部103とを備える制御部100を備える。また、携帯端末1は、撮像部104と、操作部105と、画像処理部106と、ワークメモリ107と、記録用メモリ108と、表示部109と、圧縮処理部110と、伸長処理部111と、リサイズ処理部112と、電源部113と、計時部114と、制御用メモリ115とを備える。

【0019】

制御部100は、上述の検出部101と、差分情報取得部102と、変化内容情報取得部103に加え、通知情報生成部116と、表示制御部117と、画像管理部118とを備える。なお、上述した検出部101と、差分情報取得部102と、変化内容情報取得部103とについても、ここでより詳細に説明する。

【0020】

検出部101は、顔検出部1101と、顔パーツ検出部1102とを含む。

顔検出部1101は、記録用メモリ108から画像データを読み出して、画像に含まれる顔の輪郭を検出する。この顔検出部1101は、例えば、画像データに対してエッジ検出等を行い、画素値の変化の大きさに基づき、顔の輪郭を検出する。この顔検出部1101は、顔の輪郭を検出した場合、検出した顔の輪郭の位置を示す情報を取得する。この顔検出部1101は、例えば、画像データを構成する複数の画素の座標値で顔の輪郭の位置を示す情報を取得する。

【0021】

顔パーツ検出部1102は、顔検出部1101から入力する情報に基づき、人物の顔に含まれる予め決められたパーツを検出する。例えば、顔パーツ検出部1102は、顔内における各パーツの概ねの位置と画像特徴量とが対応づけられているパーツ位置対応データR1を参照して、顔検出部1101によって検出された顔の画像特徴量に基づき、各パーツの画像領域の位置を検出する。このパーツ位置対応データR1において、例えば、1つのパーツである右目の項目としては、輪郭線でその範囲が規定される顔内の右目の概ねの位置を示す情報と、目の画像であると判定するための画像特徴量を示す情報とが対応付けられている。このパーツ位置対応データR1には、その他にも、左目、右眉、左眉・・・等、複数の項目ごとに情報が対応付けられている。顔パーツ検出部1102は、このパーツ位置対応データR1を参照することで、顔検出部1101によって検出された顔の輪郭に対応する各パーツの画像領域を検出することができる。そして、顔パーツ検出部1102は、各パーツを検出した場合、検出した各パーツの位置を示すパーツ位置情報Fを取得する。この顔パーツ検出部1102は、例えば、画像データを構成する複数の画素の座標値で各パーツの位置を示すパーツ位置情報Fを取得する。顔パーツ検出部1102は、第1画像データD1からパーツ位置情報F1を取得し、第2画像データD2からパーツ位置情報F2を取得する。なお、パーツ位置情報F1、F2のそれぞれには、検出された複数のパーツのそれぞれの位置を示す情報が含まれている。なお、パーツ位置対応データR1は、制御用メモリ115に保存されている。

【0022】

差分情報取得部102は、記録用メモリ108から変化前の画像データと変化後の画像データとを読み出して、各画像に含まれる顔の色成分を比較して、両者の差分を示す差分情報Gを取得する。例えば、差分情報取得部102は、記録用メモリ108から第1画像データD1および第2画像データD2を読み出す。この差分情報取得部102は、検出部101によって検出された第1画像データD1に含まれる各パーツの位置を示すパーツ位置情報F1と、第2画像データD2に含まれる各パーツの位置を示すパーツ位置情報F2に基づき、顔A1と顔A2との位置を合わせた状態で、顔A1を構成する各画素の色成分C1と、顔A2を構成する各画素の色成分C2との差分を計算して、差分情報G12を算出する。

具体的に説明すると、差分情報取得部102は、例えば、第1画像データD1および第2画像データD2に基づき、それぞれの画像データの各画素の色成分C1、C2を算出する。この差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1に対応する画素の色成分C1´と、第2画像データD2に示される顔A2に対応する画素の色成分C2´との差分を計算し、顔A1と顔A2との色成分C1´、C2´の差分を示す差分情報G12を取得する。

また、差分情報取得部102は、検出部101によって検出された各パーツの位置関係に基づき、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す変化位置情報H12を取得する。具体的に説明すると、差分情報取得部102は、例えば、制御用メモリ115に登録されている位置関係データR2を参照して、差分情報G12に基づき、顔A1と顔A2との色が異なる部分を人物の顔の位置で示す変化位置情報H12を取得する。この位置関係データR2は、例えば、人物の顔内における各パーツの位置を示す基準点に対する相対的な位置関係を距離や方向により示す情報と、人物の顔内の位置を示す情報とを対応付ける情報である。例えば、この位置関係データR2において、人物の顔内の“頬”であることを示す情報は、目や鼻を示す基準点に対する相対的な位置関係において目の下であってかつ鼻の横の領域であることを示す情報と、対応付けられている。

【0023】

変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報Jを取得する。

例えば、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12とに基づき、顔A2において、顔A1から変化した部分の位置を示す情報と、変化した色を示す情報とを取得する。この変化内容情報取得部103は、顔A1と顔A2とを比較した場合に変化した部分の位置を示す情報として、“両頬の頬骨付近”を示す情報を取得する。また、変化内容情報取得部103は、変化した色を示す情報として、“ピンク色”を示す情報を取得する。つまり、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12に基づき、顔A2は顔A1と比べて“両頬がピンク色に変化している”と判定する。そして、変化内容情報取得部103は、判定結果が示す変化の要因に基づき、変化の内容を示す変化内容情報Jを取得する。ここでは、変化内容情報取得部103は、この検出した変化を示す判定結果(つまり検出した変化)に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示す変化内容データR3を参照して、この変化の内容を示す変化内容情報Jを取得する。よって、変化内容情報取得部103は、“両頬がピンク色に変化している”ということを示す変化内容情報J12を取得する。なお、変化内容データR3は、制御用メモリ115に保存されている。

【0024】

通知情報生成部116は、変化内容情報取得部103によって取得された変化内容情報Jに基づき、変化の内容をユーザに通知する通知情報Kを生成する。例えば、通知情報生成部116は、制御用メモリ115に登録されている通知情報生成データR4を参照して、顔A1に施された変化の手順を示す通知情報Kを生成する。この通知情報生成データR4には、「変化した部分の位置を示す情報」と、「変化した色を示す情報」と、この変化の部分や色に応じた通知情報Kとがそれぞれ対応付けられているデータである。通知情報生成部116は、通知情報生成データR4を参照して、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」のうち少なくともいずれか一方と一致する通知情報Kを検索する。一致する通知情報Kが検索により得られた場合、通知情報生成部116は、検索により得た通知情報Kを表示制御部117に出力する。

【0025】

表示制御部117は、表示部109に表示させる画像を作成し、表示部109に対して作成した画像を表示するよう制御する。この表示制御部117は、通知情報生成部116から入力する通知情報Kと、記録用メモリから読み出した画像データとに基づき、予め決められたレイアウトで、通知情報Kと画像データとを同時に表示部109に表示させる。なお、表示制御部117は、変化後の画像データと通知情報Kとを表示部109に表示させることが好ましい。しかし、本発明はこれに限られず、表示制御部117は、変化前後の両方の画像データの画像と通知情報Kとを同時に表示部109に表示させるようにしてもよい。また、表示制御部117は、変化前後の画像を表示している状態において通知情報Kを表示する操作指示が操作部105から入力された場合に、通知情報Kを表示部109に表示させるようにしてもよい。

【0026】

画像管理部118は、撮像部104によって生成された画像データを記録用メモリ108に保管する。この画像管理部118は、例えば、操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と撮像部104によって生成された画像データとを対応付けて、記録用メモリ108に格納する。

【0027】

撮像部104は、光学系104aと、光学系104aを介して入射する光学像から画像データを生成する撮像素子104bと、撮像素子104bから出力される画像データのアナログ信号をデジタル信号に変換し、画像データのデジタル信号を出力するA/D変換部104cとを備える。撮像部104は、操作部105を介して電源が起動されると、入射する光学像から画像データに生成して、連続的に画像処理部106に出力する。このように、撮像部104が撮像可能な状態において生成した画像データを連続して表示部109に表示する画像を、ライブビュー画像という。ユーザは、このライブビュー画像を見ながら、撮像する画像を決定することができる。

【0028】

操作部105は、例えば、電源スイッチボタン151、シャッターボタン152、および再生ボタン153を備える。なお、操作部105は、これ以外にも、操作ボタン、十字キー、あるいはタッチパネルの操作入力手段を含む。この操作部105は、ユーザからの操作を受け付け、受け付けた操作を示す操作情報を出力する。なお、電源スイッチボタン151は、電源がオンされていない状態において押下されることにより、電源をオンする操作指示を受け付ける。また、電源スイッチボタン151は、電源がオンされている状態において押下されることにより、電源をオフする操作指示を受け付ける。シャッターボタン152は、電源がオンされている状態において押下されることで、撮像の操作指示を受け付ける。再生ボタン153は、押下されることで、携帯端末1の記録用メモリ108に保存されている画像データを再生する操作指示を受け付ける。

【0029】

画像処理部106は、撮像部104から出力される画像データに対して画像処理をし、ワークメモリ107に格納する。

ワークメモリ107は、携帯端末1の各種処理において一時的に情報を格納する記憶領域である。

記録用メモリ108は、ユーザがシャッターボタン152を押下したことにより撮像部104が撮像した画像データを保存する記憶領域である。

表示部109は、例えば、液晶ディスプレイであって、制御部100の表示制御部117によって表示が制御される。

圧縮処理部110は、撮像部104によって生成された画像データを、例えば、JPEGファイルに圧縮する処理を実行する。

伸長処理部111は、記録用メモリ108にJPEGファイルで圧縮して格納されている画像データを、例えばJPEG画像に伸長する処理を実行する。この伸長処理部111は、JPEG画像に伸長した画像を、ワークメモリ107に展開する。

リサイズ処理部112は、撮像部104によって生成された画像データのサイズを、表示部109において表示可能なサイズにリサイズする処理を実行する。

電源部113は、電池を備え、電池の電力を携帯端末1の全体に供給する。

計時部114は、時刻を計時し、計時した時刻を示す時刻情報を出力する。

制御用メモリ115は、制御部100が各種の制御処理を実行する際に利用する情報を格納する記憶領域である。

【0030】

次に、図3〜11を参照して、本実施形態に係る携帯端末1の動作フローの一例について説明する。図3は、携帯端末1の動作フローの一例を示すフローチャートである。なお、ここで説明する携帯端末1の動作フローは、対象者Aが美容部員によって化粧を施してもらっているというシーンにおいて、対象者Aが化粧の手順ごとに自分の顔を撮像した場合の携帯端末1の動作フローである。図3では、説明省略のために、化粧をしていない状態の顔A1から、両頬にチークを入れた状態の顔A2の変化の内容を示す変化内容情報を取得する例について説明する。しかし、本発明に係る携帯端末1はこれに限られず、チークの後に、アイシャドー、アイブロー、アイライナー、マスカラ等で化粧をする度ごと、化粧の前後の顔を撮影して、以下に説明するような処理を実行してもよい。

【0031】

まず、携帯端末1は、操作部105の電源スイッチ151が押下され、電源がオンされると、撮像部104によって撮像されている画像をライブビュー画像として表示部109に表示する。ここで、表示部109は、例えば、表示部109が表示する画面内に顔の基準位置を示す顔マーカー201を表示する。この顔マーカー201の表示例を、図4に示す。図4に示すように、顔マーカー201は、人物の顔の輪郭の概ねの形状を示す線である。なお、図4に示すように、顔マーカー201の付近には、対象者Aにその使用方法を示す情報(例えば、“ここに顔をあわせて下さい”)を表示してもよい。

【0032】

(ステップST1)

そして、対象者Aは、ライブビュー画像を見ながら、自分の顔の輪郭と顔マーカー201とを合わせて、シャッターボタン152を押下する。これにより、撮像部104は、第1画像データD1を生成し、画像処理部106に出力する。この第1画像データD1の画像の一例を図5に示す。図5に示す通り、第1画像データD1の画像には、化粧をしていない状態の対象者Aの顔A1が含まれている。そして、画像処理部106は、第1画像データD1に対して画像処理をし、ワークメモリ107に格納する。次いで、圧縮処理部110は、ワークメモリ107内の第1画像データD1を、例えば、JPEGファイルに圧縮する処理を実行する。そして、制御部100の画像管理部118は、例えば、顔A1を撮像するため操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と第1画像データD1とを対応付けて、記録用メモリ108に格納する。

【0033】

ここで、対象者Aは、美容部員によって、両頬にピンク色のチークをのせてもらう。より具体的に説明すると、美容部員は、対象者Aの頬骨の一番高いところを中心に楕円状にチークをのせる。このとき、美容部員は、中心から外側に向かって徐々に色が薄くなるように、ぼかしてチークをのせる。

【0034】

(ステップST2)

そして、対象者Aは、ライブビュー画像を見ながら、再度、自分の顔の輪郭と顔マーカー201とを合わせ、シャッターボタン152を押下する。これにより、撮像部104は、第2画像データD2を生成し、画像処理部106に出力する。この第2画像データD2の画像の一例を図6に示す。図6に示す通り、第2画像データD2の画像には、化粧をしていない状態の対象者Aの顔A1に対して、両頬にチークがのせられた対象者Aの顔A2が含まれている。そして、画像処理部106は、第2画像データD2に対して画像処理をし、ワークメモリ107に格納する。次いで、圧縮処理部110は、ワークメモリ107内の第2画像データD2を、例えば、JPEGファイルに圧縮する処理を実行する。そして、制御部100の画像管理部118は、例えば、顔A2を撮像するため操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と第2画像データD2とを対応付けて、記録用メモリ108に格納する。

【0035】

(ステップST3)

そして、検出部101の顔検出部1101は、記録用メモリ108から第1画像データD1と第2画像データD2とを読み出して、各画像に含まれる顔A1と顔A2の輪郭を検出する。顔検出部1101が検出した顔の輪郭の一例を図7、8に示す。図7は、第1画像データD1から検出した顔A1の輪郭を示す輪郭線202を示す。また、図8は、第2画像データD2から検出した顔A2の輪郭を示す輪郭線203を示す。この顔検出部1101は、第1画像データD1において輪郭線202の位置を示す情報を取得する。また、顔検出部1101は、第2画像データD2において輪郭線203の位置を示す情報を取得する。この輪郭線202、203の位置を示す情報とは、例えば、各画像データに含まれる画素の座標値である。顔検出部1101は、検出した輪郭線202の位置を示す情報と、輪郭線203の位置を示す情報とを顔パーツ検出部1102に出力する。

【0036】

(ステップST4)

次いで、顔パーツ検出部1102は、顔検出部1101から入力する情報に基づき、人物の顔に含まれる予め決められたパーツを検出する。ここで、図9、10を参照して、画像データから各パーツを検出する一例について説明する。図9は、第1画像データD1の画像から検出されるパーツの基準点を示す図である。図10は、第2画像データD2の画像から検出されるパーツの基準点を示す図である。

顔パーツ検出部1102は、例えば、顔検出部1101によって検出された顔の輪郭線202、203のそれぞれと接する矩形状の顔枠204、205において、予め位置が決められている各パーツを検出する。顔パーツ検出部1102は、例えば、顔枠204、205内における各パーツの概ねの位置と各パーツの画像特徴量とが対応づけられているパーツ位置対応データR1を用いて、顔枠204、205内の画像特徴量に基づき、各パーツの画像領域を検出する。

【0037】

(ステップST5)

そして、顔パーツ検出部1102は、検出した各パーツの画像領域に基づき、各パーツの位置を示す基準点を検出し、パーツ位置情報Fを取得する。具体的に説明すると、顔パーツ検出部1102は、図9、10に示すように、右の眉毛の左右の2点a、bと、左の眉毛の左右の2点c、dと、右目の左右の2点e、fと、左目の左右の2点g、hと、右の小鼻の付け根iと、左の小鼻の付け根jと、口の左右の2点k、lとのそれぞれの位置を、各パーツの基準点として検出する。

顔パーツ検出部1102は、第1画像データD1から検出した各パーツの基準点a〜lを検出し、基準点a〜lに対応する画素の座標値を示す情報を、パーツ位置情報F1として取得する。また、顔パーツ検出部1102は、第2画像データD2から検出した各パーツの基準点a〜lを検出し、基準点a〜lに対応する画素の座標値を示す情報を、パーツ位置情報F2として取得する。

そして、顔パーツ検出部1102は、取得したパーツ位置情報F1、F2を差分情報取得部102に出力する。

【0038】

(ステップST6)

次いで、差分情報取得部102は、記録用メモリ108から第1画像データD1と第2画像データD2とを読み出して、各画像に含まれる顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。具体的に説明すると、差分情報取得部102は、顔パーツ検出部1102から入力するパーツ位置情報F1、F2に基づき、第1画像データD1と第2画像データD2について同じパーツ同士の位置を合わせて、顔A1と顔A2との位置を合わせる。また、差分情報取得部102は、例えば、第1画像データD1および第2画像データD2に基づき、それぞれの画像データの各画素の色成分C1、C2を算出する。

そして、差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1に対応する色成分C1´と、第2画像データD2に示される顔A2に対応する色成分C2´とを比較して、顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。

【0039】

(ステップST7)

本実施形態では、顔A1に対して両頬にピンク色のチークを施した顔が顔A2である。よって、顔A2の両頬に相当する画素の色成分が顔A1の両頬に相当する画素の色成分と異なる。従って、差分情報取得部102は、顔A1と顔A2の両頬に相当する画素の色成分の差分を、差分情報G12として取得する。

また、差分情報取得部102は、パーツ位置情報F1、F2に基づき、検出部101によって検出された各パーツの位置関係に応じて、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す変化位置情報H12を取得する。従って、差分情報取得部102は、各パーツの基準点a〜lの位置情報に基づき、各パーツの位置関係を示す位置関係データR2を参照して、差分情報G12が示す顔A1と顔A2とを比較して色が異なる部分が、顔内のどの位置に対応する領域であるかを判定する。この差分情報取得部102は、位置関係データR2を参照して、例えば、顔内の各パーツとの相対的な距離に応じて、顔内のどの位置(例えば、頬、頬骨のトップ、下頬、口の横、目じり、Tゾーン等)に対応する領域であるかを判定する。そして、差分情報取得部102は、判定した顔内の領域を示す変化位置情報H12を取得する。そして、差分情報取得部102は、取得した差分情報G12と変化位置情報H12とを変化内容情報取得部103に出力する。

【0040】

そして、変化内容情報取得部103は、検出部101によって検出された各パーツと、差分情報取得部102が算出した差分情報G12が示す「色が変化している部分」との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報J12を取得する。

【0041】

(ステップST8)

具体的に説明すると、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12に基づき、顔A2において、顔A1から「変化した部分の位置を示す情報」と、「変化した色を示す情報」を取得する。従って、変化内容情報取得部103は、顔A1と顔A2とを比較した場合に「変化した部分の位置を示す情報」として、両頬の頬骨を中心にした楕円形の領域を示す情報を取得する。また、変化内容情報取得部103は、「変化した色を示す情報」として、頬骨を中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化する色彩を示す情報を取得する。つまり、変化内容情報取得部103は、顔A2は顔A1と比べて“両頬の楕円形の領域がピンク色に変化しており、具体的には、頬骨の中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化している”ということを判定する。言い換えると、変化内容情報取得部103は、このような変化を検出している。

【0042】

(ステップST9)

そして、変化内容情報取得部103は、ステップST8の判定結果が示す変化に基づき、変化の内容を示す変化内容情報J12を取得する。ここでは、変化内容情報取得部103は、判定結果が示す変化に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示す変化内容データR3を参照して、この変化の内容を示す変化内容情報J12を取得する。従って、差分情報取得部102は、“両頬の楕円形の領域がピンク色に変化している”という判定結果から、その変化の内容は、“両頬にピンク色のチークを施した”という変化内容を示していると判定する。よって、変化内容情報取得部103は、変化内容情報J12−1として、“両頬にピンク色のチークを施した”ことを示す情報を取得する。

また、差分情報取得部102は、“頬骨の中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化している”という判定結果から、その変化の内容が“頬骨のトップを中心にグラデーションをつけた色彩を施した”という変化内容を示していると判定する。よって、変化内容情報取得部103は、変化内容情報J12−2として、“頬骨のトップを中心にグラデーションをつけた色彩を施した”ことを示す情報を取得する。

よって、差分情報取得部102は、この変化内容情報J12−1と変化内容情報J12−2とに基づき、変化の内容が“両頬にピンク色のチークを施した”ことと“頬骨のトップを中心にグラデーションをつけた色彩を施した”ことであることを示す変化内容情報J12を取得する。

【0043】

(ステップST10)

次いで、通知情報生成部116は、変化内容情報J12に基づき、変化の内容を対象者Aに通知する通知情報K12を生成する。例えば、通知情報生成部116は、制御用メモリ115に登録されている通知情報生成データR4を参照して、変化の内容に対応する通知情報K12を生成する。具体的に説明すると、通知情報生成部116は、通知情報生成データR4に登録されている「変化した部分の位置を示す情報」や「変化した色を示す情報」と、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」とを比較して一致するものを検索する。一致する情報が検索して得られた場合、変化内容情報取得部103は、通知情報生成データR4において、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」と一致する情報と対応付けられている通知情報Kを、通知情報K12として取得する。

例えば、通知情報生成データR4において、変化した部分を示す情報として「頬、頬骨」が、変化した色を示す情報として「ピンク色、グラデーション」が、登録されている。また、これらの情報に対応する通知情報Kとして「頬骨のトップを中心に、ピンク色のチークを入れてください。ここでポイントは、トップを中心に色を濃く入れて、周りの色をぼかしてください」が登録されている。

一方、通知情報生成部116は、変化内容情報J12が示す「変化した部分の位置を示す情報」として、頬および頬骨を、「変化した色を示す情報」として、ピンク色、グラデーションを取得している。よって、通知情報生成部116は、通知情報K12として、通知情報生成データR4に登録されている通知情報K「頬骨のトップを中心に、ピンク色のチークを入れてください。ここでポイントは、トップを中心に色を濃く入れて、周りの色をぼかしてください」を、通知情報K12として取得する。

そして、通知情報生成部116は、取得した通知情報K12を表示制御部117に出力する。

【0044】

(ステップST11)

次いで、表示制御部117は、通知情報生成部116から入力する通知情報K12と、記録用メモリ108から読み出した第2画像データD2とに基づき、予め決められたレイアウトで、通知情報Kと第2画像データD2とを表示部109に表示させる。このとき、表示部109に表示される画像の一例を、図11に示す。図11に示す通り、表示部109には、第2画像データD2が表示され、この第2画像データD2の画像の下に、通知情報が表示される。

【0045】

上述の通り、本実施形態に係る携帯端末1は、対象者の顔を撮影した画像データに基づき、変化前の画像データと変化後の画像データの色成分の変化に基づき、変化した内容を判定することができる。よって、変化後の画像データにおいて、変化前の対象者に対してどのような変化要因が与えられたかを判定することができる。従って、対象者は、変化前の顔と、変化後の顔を撮像するだけで、変化の内容を示す情報を取得することができる。つまり、対象者は、変化の内容を示す情報を自ら作成する手間が省け、さらに、変化後の画像データと変化の内容を示す情報とを対応付けて管理する手間が省ける。

【0046】

例えば、対象者Aが美容部員に、チーク、アイシャドー、アイブロー、アイライナー、マスカラ、の順番で化粧を施してもらう場合、対象者Aは、チークをつける前の顔A1を撮像し、チークをつけた後の顔A2を撮像する。その後、アイシャドーをつけた後の顔A3を撮像し、アイブローをつけた後の顔A4を撮像し、アイライナーをつけた後の顔A5を撮像し、マスカラをつけた後の顔A6を撮像する。

この場合、携帯端末1は、顔A2と顔A3を比較することで、アイシャドーの入れ方を示す情報を取得することができる。例えば、アイホール全体にホワイト系のラメパウダーをのせた後、目じりにピンク系のパウダーをのせて、目の際に茶系のアイライナーをぼかしていれたとする。この場合、携帯端末1は、顔A2と顔A3の色成分を比較して、上述のような処理を実行することにより、変化の内容を示す変化内容情報Jとして、上述のようなアイシャドーの状態(アイホール全体にホワイト系のラメパウダーが全体的についていること、目じりにピンク系のパウダーが付いていること、目の際に茶系のアイライナーが外側がグラデーション状態で付いていること)を示す情報を取得することができる。なお、このようなアイメイクをする場合、最初にアイホール全体に薄い色を入れて、暖色系のパウダーは濃い暗い色よりも先につける場合が多い。このように、パウダーの色や付けられている場所によって、アイライナーの入れ方を推測することができる。よって、アイメイクの色を示す情報と、アイメイクの位置を示す情報と、これらアイメイクの色と位置に応じて予め決められる通知情報Kとを、それぞれ対応付けた通知情報生成データR4を用いることにより、携帯端末1は、アイシャドーの入れ方を示す通知情報Kを取得することができる。

【0047】

このように、美容部員やメイクアップアーティスト等のプロに化粧をしてもらった場合であっても、対象者Aは、変化前の顔と変化後の顔を撮像することにより、化粧の手順や化粧のポイント等を示した文字情報を取得することができる。これにより、対象者Aは、化粧を受けている最中に化粧の手順をメモしたりする手間が省ける。また、取得した文字情報を利用して、美容部員やメイクアップアーティスト等によるプロの技を再現することが可能となる。

【0048】

また、本実施形態に係る携帯端末1は、化粧を施す前後の顔ではなく、例えば、数ヶ月前の顔と現在の顔とを比較して、その変化を示す変化内容情報Jや通知情報Kを取得するものであってもよい。例えば、携帯端末1は、しみ、皺、日焼けなどの変化を検出し、変化内容情報Jや通知情報Kを取得するもであってもよい。

【0049】

さらに、本実施形態に係る情報読取装置は、携帯端末1に搭載されている構成に限られず、例えば、サーバに搭載されているものであってもよい。この場合、サーバは、通信可能に接続される携帯端末から受信した画像データに基づき、変化内容情報Jや通知情報Kを作成し、作成した変化内容情報Jや通知情報Kを携帯端末に返信するものであってもよい。これにより、携帯端末側では、情報読取装置の構成を有していない場合であっても、画像データをサーバに送信することで、変化内容情報Jや通知情報Kを取得することができる。

【0050】

また、本実施の形態に係る情報取得装置は、内部にコンピュータシステムを有している。そして、動作の過程は、プログラムの形式でコンピュータ読み取り可能な記録媒体に記憶されており、このプログラムをコンピュータシステムが読み出して実行することによって、上記処理が行われる。ここでいう「コンピュータシステム」とは、CPU及び各種メモリやOS、周辺機器等のハードウェアを含むものである。

また、「コンピュータシステム」は、WWWシステムを利用している場合であれば、ホームページ提供環境(あるいは表示環境)も含むものとする。

【0051】

また、各ステップを実現するためのプログラムをコンピュータ読み取り可能な記録媒体に記録して、また、この機能を実現するためのプログラムをコンピュータ読み取り可能な記録媒体に記録して、この記録媒体に記録されたプログラムをコンピュータシステムに読み込ませ、実行することにより、検出対象物の形状情報の推定値を算出する処理を行ってもよい。

また、「コンピュータ読み取り可能な記録媒体」とは、フレキシブルディスク、光磁気ディスク、ROM、フラッシュメモリ等の書き込み可能な不揮発性メモリ、CD−ROM等の可搬媒体、コンピュータシステムに内蔵されるハードディスク等の記憶装置のことをいう。

【0052】

さらに「コンピュータ読み取り可能な記録媒体」とは、インターネット等のネットワークや電話回線等の通信回線を介してプログラムが送信された場合のサーバやクライアントとなるコンピュータシステム内部の揮発性メモリ(例えばDRAM(Dynamic Random Access Memory))のように、一定時間プログラムを保持しているものも含むものとする。

また、上記プログラムは、このプログラムを記憶装置等に格納したコンピュータシステムから、伝送媒体を介して、あるいは、伝送媒体中の伝送波により他のコンピュータシステムに伝送されてもよい。ここで、プログラムを伝送する「伝送媒体」は、インターネット等のネットワーク(通信網)や電話回線等の通信回線(通信線)のように情報を伝送する機能を有する媒体のことをいう。

また、上記プログラムは、前述した機能の一部を実現するためのものであっても良い。さらに、前述した機能をコンピュータシステムに既に記録されているプログラムとの組合せで実現できるもの、いわゆる差分ファイル(差分プログラム)であっても良い。

【符号の説明】

【0053】

1…携帯端末

100…制御部、

101…検出部、

102…差分情報取得部、

103…変化内容情報取得部、

104…撮像部、

105…操作部、

106…画像処理部、

107…ワークメモリ、

108…記録用メモリ、

109…表示部、

110…圧縮処理部、

111…伸長処理部、

112…リサイズ処理部、

113…電源部、

114…計時部、

115…制御用メモリ、

116…通知情報生成部、

117…表示制御部、

118…画像管理部、

1101…顔検出部、

1102…顔パーツ検出部、

R1…パーツ位置対応データ

R2…位置関係データ

R3…変化内容データ

R4…通知情報生成データ

201…顔マーカー

202…輪郭線

203…輪郭線

204…顔枠

205…顔枠

【技術分野】

【0001】

本発明は、情報取得装置、情報取得方法、およびプログラムに関する。

【背景技術】

【0002】

対象者の顔を撮像し、撮像により得られた画像データを利用して、化粧のアドバイスを行うシステムがある。

例えば、対象者の顔を撮像した画像データに基づき、対象者の顔に仮想的に化粧を施した顔の画像を表示する表示装置がある。これにより、対象者は、実際に化粧をしなくても、化粧を施した場合の自分の顔をイメージすることができる(例えば、特許文献1参照)。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特開2001−238727号公報

【発明の概要】

【発明が解決しようとする課題】

【0004】

しかしながら、全ての対象者の顔の凹凸形状や素肌の色等が一致しているわけではないため、仮想的に化粧を施した場合と、実際に化粧を施した場合とでは、化粧後の顔のイメージが異なるという問題がある。そのため、実際に化粧品の購入を検討している場合、対象者は、売場等で化粧部員に化粧を施してもらい、自分の顔にあっているかどうかを確認してから、化粧品を購入するという場合が多い。

また、同じ化粧品であっても、付ける位置や色の濃さによって、顔のイメージが異なる場合がある。そのため、化粧品を購入しても、売場の化粧部員が化粧したように対象者自身が再現できないという問題がある。

【0005】

本発明は、上記の事情を考慮してなされたものであり、画像データから同一対象者の顔の変化を検出し、変化の内容を示す情報を取得することができる情報取得装置、情報取得方法、およびプログラムを提供することを目的とする。

【課題を解決するための手段】

【0006】

この発明は上述した課題を解決するためになされたもので、本発明の一態様による情報取得装置は、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、前記検出部によって検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得部と、を備える。

【0007】

この発明は上述した課題を解決するためになされたもので、本発明の一態様による情報取得方法は、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出するステップと、検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得するステップと、検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得するステップと、を備える。

【0008】

この発明は上述した課題を解決するためになされたもので、本発明の一態様によるプログラムは、コンピュータに、対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出手順、検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得手順、検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得手順、を実行させるためのプログラムである。

【発明の効果】

【0009】

本発明によれば、画像データから同一対象者の顔の変化を検出し、変化の内容を示す情報を取得することができる。

【図面の簡単な説明】

【0010】

【図1】本発明の一実施形態に係る情報取得装置(携帯端末)の概略構成の一例を示す図である。

【図2】本発明の一実施形態に係る情報取得装置(携帯端末)の構成の一例を示すブロック図である。

【図3】本発明の一実施形態に係る情報取得装置(携帯端末)の動作フローの一例について説明するための図である。

【図4】本発明の一実施形態に係る情報取得装置(携帯端末)に表示される顔マーカーの一例を示す図である。

【図5】本発明の一実施形態に係る第1画像データD1の画像の一例を示す図である。

【図6】本発明の一実施形態に係る第2画像データD2の画像の一例を示す図である。

【図7】本発明の一実施形態に係る第1画像データD1から検出した顔A1の輪郭を示す輪郭線202を示す。

【図8】本発明の一実施形態に係る第2画像データD2から検出した顔A2の輪郭を示す輪郭線203を示す。

【図9】本発明の一実施形態に係る第1画像データD1の画像から検出されるパーツの基準点を示す図である。

【図10】本発明の一実施形態に係る第2画像データD2の画像から検出されるパーツの基準点を示す図である。

【図11】本発明の一実施形態に係る通知情報Kを表示する画像の一例を示す図である。

【発明を実施するための形態】

【0011】

[第1実施形態]

以下、図面を参照して本発明の一実施形態について説明する。図1は、本発明の一実施形態に係る情報取得装置の概要について説明するための図である。なお、本実施形態では、情報取得装置がカメラ付き携帯端末である例について、以下説明する。しかし、本発明はこれに限られず、情報取得装置は、スマートフォン、携帯ゲーム機、タブレット型PC(Personal Computer)、あるいは、ノート型PC等であってもよい。

本実施形態に係る携帯端末1は、対象者の変化前後の顔を撮像することにより、顔の変化の内容を示す情報を対象者に提供するものである。

【0012】

図1に示す通り、本実施形態に係る携帯端末1は、検出部101と、差分情報取得部102と、変化内容情報取得部103とを備える。この検出部101と差分情報取得部102とには、対象者の顔を撮像することにより取得した画像データが入力する。本実施形態において、検出部101と差分情報取得部102とには、対象者Aの顔A1を撮像することにより取得した第1画像データD1と、対象者Aの顔A1に化粧を施した後の対象者Aの顔A2を撮像することにより取得した第2画像データD2とが入力する。

なお、本実施形態においては、化粧前後の顔を撮像した画像データに基づき変化を検出する例について説明するが、本発明はこれに限られない。第1画像データD1と第2画像データD2とは、少なくとも第2画像データD2の方が、第1画像データD1よりも後に撮像された画像データであればよい。また、第1画像データD1が撮像された時と、第2画像データD2が撮像された時との間に、化粧が施されてなくてもよく、また、化粧以外のヘアメイク等の装飾が施されてもよい。

【0013】

検出部101は、入力する変化前の画像データと変化後の画像データから、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する。なお、この予め決められたパーツとは、顔内の位置を検出するために基準となるパーツであって、例えば、眉毛、両目、鼻、口等である。この検出部101は、例えば、第1画像データD1と第2画像データD2から各パーツに対応する画像領域を検出し、各パーツの画像領域の位置を示す情報(以下、パーツ位置情報Fという)を取得する。なお、パーツ位置情報Fは、例えば、画像データに含まれる複数の画素の画素座標値で示される。また、第1画像データD1から検出された各パーツの位置を示す情報をパーツ位置情報F1と、第2画像データD2から検出された各パーツの位置を示す情報をパーツ位置情報F2と、それぞれ示す。

【0014】

差分情報取得部102は、検出部101によって検出されたパーツ位置情報Fに基づき、入力する変化前の画像データと変化後の画像データに含まれる同じパーツ同士の位置を合わせることで、変化の前後の顔の位置合わせを実行する。この差分情報取得部102は、変化前後の顔の位置を合わせた状態において、入力する変化前の画像データと変化後の画像データに基づき、各画像データについての色成分の差分を示す情報(以下、差分情報Gという)を取得する。例えば、差分情報取得部102は、検出部101によって取得されたパーツ位置情報F1、F2に基づき、第1画像データD1と第2画像データD2について顔A1と顔A2との位置を合わせる。この差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1の色成分C1´と、第2画像データD2に示される顔A2の色成分C2´とを比較して、顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。なお、色成分とは、各画素に含まれるR(赤)、G(緑)、B(青)の色の強さを示す情報である。

【0015】

例えば、顔A2は、顔A1に対して両頬にピンク色のチーク(頬紅)を施した顔である場合について説明する。この場合、顔A2の両頬に相当する画素の色成分が顔A1の両頬に相当する画素の色成分と異なる。よって、差分情報取得部102は、顔A1と顔A2の両頬に相当する画素の色成分の差分を示す情報を、差分情報G12として取得する。また、差分情報取得部102は、検出部101によって検出されたパーツ位置情報F1、F2に基づき、顔と各パーツの位置関係に応じて、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す情報(以下、変化位置情報Hという)を取得する。上述した顔A1の両頬にピンク色のチークを施した顔が顔A2である例において、差分情報取得部102は、差分情報G12が検出された画素が、顔内の両頬に対応することを示す変化位置情報H12を取得する。なお、顔内のどの位置に対応するかを示す情報は、顔の輪郭と各パーツとの位置関係に基づき、携帯端末1内のメモリに予め登録されている。

【0016】

変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報(以下、変化内容情報Jという)のうち、差分情報Gが示す色が変化している部分に対応する変化内容情報Jを取得する。言い換えると、変化内容情報取得部103は、検出部101によって検出された各パーツと、差分情報取得部102が算出した差分情報Gが示す色が変化している部分との位置関係に基づき、差分情報Gが示す色が変化している部分に対応する変化内容情報Jを取得する。

また、変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、差分情報Gが示す色に応じて予め決められている顔内の変化の内容を示す変化内容情報Jのうち、差分情報Gが示す色に対応する変化内容情報Jを取得する。

【0017】

例えば、この変化内容情報取得部103は、差分情報取得部102から差分情報G12と変化位置情報H12とを入力する。変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12とに基づき、顔A2には顔A1と比べて“両頬がピンク色に変化している”ということを判定する。つまり、変化内容情報取得部103は、“両頬がピンク色に変化している”という変化を検出する。変化内容情報取得部103は、この検出した変化を示す判定結果(つまり検出した変化)に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示すデータを参照して、この変化の内容を示す変化内容情報Jを取得する。ここで、変化の内容とは、検出された変化の要因に基づき、色成分の変化が示す変化の内容である。つまり、変化内容情報取得部103は、“両頬がピンク色に変化している”という判定結果が、“両頬にピンク色のチークを施した”という変化の内容を示していると判定する。変化内容情報取得部103は、この“両頬にピンク色のチークを施した”という変化内容を示す変化内容情報J12を取得する。なお、この例において、変化内容情報取得部103は、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報である“両頬にチークを施した”という変化内容情報J12−1と、差分情報Gが示す色に応じて予め決められている顔内の変化の内容を示す情報である“ピンク色のチークを施した”という変化内容情報J12−2と、取得する。変化内容情報J12は、この変化内容情報J12−1と変化内容情報J12−2とをあわせた情報である。

なお、本発明はこれに限られず、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す情報だけを示す変化内容情報を取得するものであってもよい。

【0018】

次に、図2を参照して、携帯端末1の構成の一例について説明する。図2は、携帯端末1の構成の一例を示すブロック図である。

図2に示す通り、携帯端末1は、上述の検出部101と、差分情報取得部102と、変化内容情報取得部103とを備える制御部100を備える。また、携帯端末1は、撮像部104と、操作部105と、画像処理部106と、ワークメモリ107と、記録用メモリ108と、表示部109と、圧縮処理部110と、伸長処理部111と、リサイズ処理部112と、電源部113と、計時部114と、制御用メモリ115とを備える。

【0019】

制御部100は、上述の検出部101と、差分情報取得部102と、変化内容情報取得部103に加え、通知情報生成部116と、表示制御部117と、画像管理部118とを備える。なお、上述した検出部101と、差分情報取得部102と、変化内容情報取得部103とについても、ここでより詳細に説明する。

【0020】

検出部101は、顔検出部1101と、顔パーツ検出部1102とを含む。

顔検出部1101は、記録用メモリ108から画像データを読み出して、画像に含まれる顔の輪郭を検出する。この顔検出部1101は、例えば、画像データに対してエッジ検出等を行い、画素値の変化の大きさに基づき、顔の輪郭を検出する。この顔検出部1101は、顔の輪郭を検出した場合、検出した顔の輪郭の位置を示す情報を取得する。この顔検出部1101は、例えば、画像データを構成する複数の画素の座標値で顔の輪郭の位置を示す情報を取得する。

【0021】

顔パーツ検出部1102は、顔検出部1101から入力する情報に基づき、人物の顔に含まれる予め決められたパーツを検出する。例えば、顔パーツ検出部1102は、顔内における各パーツの概ねの位置と画像特徴量とが対応づけられているパーツ位置対応データR1を参照して、顔検出部1101によって検出された顔の画像特徴量に基づき、各パーツの画像領域の位置を検出する。このパーツ位置対応データR1において、例えば、1つのパーツである右目の項目としては、輪郭線でその範囲が規定される顔内の右目の概ねの位置を示す情報と、目の画像であると判定するための画像特徴量を示す情報とが対応付けられている。このパーツ位置対応データR1には、その他にも、左目、右眉、左眉・・・等、複数の項目ごとに情報が対応付けられている。顔パーツ検出部1102は、このパーツ位置対応データR1を参照することで、顔検出部1101によって検出された顔の輪郭に対応する各パーツの画像領域を検出することができる。そして、顔パーツ検出部1102は、各パーツを検出した場合、検出した各パーツの位置を示すパーツ位置情報Fを取得する。この顔パーツ検出部1102は、例えば、画像データを構成する複数の画素の座標値で各パーツの位置を示すパーツ位置情報Fを取得する。顔パーツ検出部1102は、第1画像データD1からパーツ位置情報F1を取得し、第2画像データD2からパーツ位置情報F2を取得する。なお、パーツ位置情報F1、F2のそれぞれには、検出された複数のパーツのそれぞれの位置を示す情報が含まれている。なお、パーツ位置対応データR1は、制御用メモリ115に保存されている。

【0022】

差分情報取得部102は、記録用メモリ108から変化前の画像データと変化後の画像データとを読み出して、各画像に含まれる顔の色成分を比較して、両者の差分を示す差分情報Gを取得する。例えば、差分情報取得部102は、記録用メモリ108から第1画像データD1および第2画像データD2を読み出す。この差分情報取得部102は、検出部101によって検出された第1画像データD1に含まれる各パーツの位置を示すパーツ位置情報F1と、第2画像データD2に含まれる各パーツの位置を示すパーツ位置情報F2に基づき、顔A1と顔A2との位置を合わせた状態で、顔A1を構成する各画素の色成分C1と、顔A2を構成する各画素の色成分C2との差分を計算して、差分情報G12を算出する。

具体的に説明すると、差分情報取得部102は、例えば、第1画像データD1および第2画像データD2に基づき、それぞれの画像データの各画素の色成分C1、C2を算出する。この差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1に対応する画素の色成分C1´と、第2画像データD2に示される顔A2に対応する画素の色成分C2´との差分を計算し、顔A1と顔A2との色成分C1´、C2´の差分を示す差分情報G12を取得する。

また、差分情報取得部102は、検出部101によって検出された各パーツの位置関係に基づき、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す変化位置情報H12を取得する。具体的に説明すると、差分情報取得部102は、例えば、制御用メモリ115に登録されている位置関係データR2を参照して、差分情報G12に基づき、顔A1と顔A2との色が異なる部分を人物の顔の位置で示す変化位置情報H12を取得する。この位置関係データR2は、例えば、人物の顔内における各パーツの位置を示す基準点に対する相対的な位置関係を距離や方向により示す情報と、人物の顔内の位置を示す情報とを対応付ける情報である。例えば、この位置関係データR2において、人物の顔内の“頬”であることを示す情報は、目や鼻を示す基準点に対する相対的な位置関係において目の下であってかつ鼻の横の領域であることを示す情報と、対応付けられている。

【0023】

変化内容情報取得部103は、差分情報取得部102から入力する差分情報Gと変化位置情報Hとに基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報Jを取得する。

例えば、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12とに基づき、顔A2において、顔A1から変化した部分の位置を示す情報と、変化した色を示す情報とを取得する。この変化内容情報取得部103は、顔A1と顔A2とを比較した場合に変化した部分の位置を示す情報として、“両頬の頬骨付近”を示す情報を取得する。また、変化内容情報取得部103は、変化した色を示す情報として、“ピンク色”を示す情報を取得する。つまり、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12に基づき、顔A2は顔A1と比べて“両頬がピンク色に変化している”と判定する。そして、変化内容情報取得部103は、判定結果が示す変化の要因に基づき、変化の内容を示す変化内容情報Jを取得する。ここでは、変化内容情報取得部103は、この検出した変化を示す判定結果(つまり検出した変化)に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示す変化内容データR3を参照して、この変化の内容を示す変化内容情報Jを取得する。よって、変化内容情報取得部103は、“両頬がピンク色に変化している”ということを示す変化内容情報J12を取得する。なお、変化内容データR3は、制御用メモリ115に保存されている。

【0024】

通知情報生成部116は、変化内容情報取得部103によって取得された変化内容情報Jに基づき、変化の内容をユーザに通知する通知情報Kを生成する。例えば、通知情報生成部116は、制御用メモリ115に登録されている通知情報生成データR4を参照して、顔A1に施された変化の手順を示す通知情報Kを生成する。この通知情報生成データR4には、「変化した部分の位置を示す情報」と、「変化した色を示す情報」と、この変化の部分や色に応じた通知情報Kとがそれぞれ対応付けられているデータである。通知情報生成部116は、通知情報生成データR4を参照して、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」のうち少なくともいずれか一方と一致する通知情報Kを検索する。一致する通知情報Kが検索により得られた場合、通知情報生成部116は、検索により得た通知情報Kを表示制御部117に出力する。

【0025】

表示制御部117は、表示部109に表示させる画像を作成し、表示部109に対して作成した画像を表示するよう制御する。この表示制御部117は、通知情報生成部116から入力する通知情報Kと、記録用メモリから読み出した画像データとに基づき、予め決められたレイアウトで、通知情報Kと画像データとを同時に表示部109に表示させる。なお、表示制御部117は、変化後の画像データと通知情報Kとを表示部109に表示させることが好ましい。しかし、本発明はこれに限られず、表示制御部117は、変化前後の両方の画像データの画像と通知情報Kとを同時に表示部109に表示させるようにしてもよい。また、表示制御部117は、変化前後の画像を表示している状態において通知情報Kを表示する操作指示が操作部105から入力された場合に、通知情報Kを表示部109に表示させるようにしてもよい。

【0026】

画像管理部118は、撮像部104によって生成された画像データを記録用メモリ108に保管する。この画像管理部118は、例えば、操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と撮像部104によって生成された画像データとを対応付けて、記録用メモリ108に格納する。

【0027】

撮像部104は、光学系104aと、光学系104aを介して入射する光学像から画像データを生成する撮像素子104bと、撮像素子104bから出力される画像データのアナログ信号をデジタル信号に変換し、画像データのデジタル信号を出力するA/D変換部104cとを備える。撮像部104は、操作部105を介して電源が起動されると、入射する光学像から画像データに生成して、連続的に画像処理部106に出力する。このように、撮像部104が撮像可能な状態において生成した画像データを連続して表示部109に表示する画像を、ライブビュー画像という。ユーザは、このライブビュー画像を見ながら、撮像する画像を決定することができる。

【0028】

操作部105は、例えば、電源スイッチボタン151、シャッターボタン152、および再生ボタン153を備える。なお、操作部105は、これ以外にも、操作ボタン、十字キー、あるいはタッチパネルの操作入力手段を含む。この操作部105は、ユーザからの操作を受け付け、受け付けた操作を示す操作情報を出力する。なお、電源スイッチボタン151は、電源がオンされていない状態において押下されることにより、電源をオンする操作指示を受け付ける。また、電源スイッチボタン151は、電源がオンされている状態において押下されることにより、電源をオフする操作指示を受け付ける。シャッターボタン152は、電源がオンされている状態において押下されることで、撮像の操作指示を受け付ける。再生ボタン153は、押下されることで、携帯端末1の記録用メモリ108に保存されている画像データを再生する操作指示を受け付ける。

【0029】

画像処理部106は、撮像部104から出力される画像データに対して画像処理をし、ワークメモリ107に格納する。

ワークメモリ107は、携帯端末1の各種処理において一時的に情報を格納する記憶領域である。

記録用メモリ108は、ユーザがシャッターボタン152を押下したことにより撮像部104が撮像した画像データを保存する記憶領域である。

表示部109は、例えば、液晶ディスプレイであって、制御部100の表示制御部117によって表示が制御される。

圧縮処理部110は、撮像部104によって生成された画像データを、例えば、JPEGファイルに圧縮する処理を実行する。

伸長処理部111は、記録用メモリ108にJPEGファイルで圧縮して格納されている画像データを、例えばJPEG画像に伸長する処理を実行する。この伸長処理部111は、JPEG画像に伸長した画像を、ワークメモリ107に展開する。

リサイズ処理部112は、撮像部104によって生成された画像データのサイズを、表示部109において表示可能なサイズにリサイズする処理を実行する。

電源部113は、電池を備え、電池の電力を携帯端末1の全体に供給する。

計時部114は、時刻を計時し、計時した時刻を示す時刻情報を出力する。

制御用メモリ115は、制御部100が各種の制御処理を実行する際に利用する情報を格納する記憶領域である。

【0030】

次に、図3〜11を参照して、本実施形態に係る携帯端末1の動作フローの一例について説明する。図3は、携帯端末1の動作フローの一例を示すフローチャートである。なお、ここで説明する携帯端末1の動作フローは、対象者Aが美容部員によって化粧を施してもらっているというシーンにおいて、対象者Aが化粧の手順ごとに自分の顔を撮像した場合の携帯端末1の動作フローである。図3では、説明省略のために、化粧をしていない状態の顔A1から、両頬にチークを入れた状態の顔A2の変化の内容を示す変化内容情報を取得する例について説明する。しかし、本発明に係る携帯端末1はこれに限られず、チークの後に、アイシャドー、アイブロー、アイライナー、マスカラ等で化粧をする度ごと、化粧の前後の顔を撮影して、以下に説明するような処理を実行してもよい。

【0031】

まず、携帯端末1は、操作部105の電源スイッチ151が押下され、電源がオンされると、撮像部104によって撮像されている画像をライブビュー画像として表示部109に表示する。ここで、表示部109は、例えば、表示部109が表示する画面内に顔の基準位置を示す顔マーカー201を表示する。この顔マーカー201の表示例を、図4に示す。図4に示すように、顔マーカー201は、人物の顔の輪郭の概ねの形状を示す線である。なお、図4に示すように、顔マーカー201の付近には、対象者Aにその使用方法を示す情報(例えば、“ここに顔をあわせて下さい”)を表示してもよい。

【0032】

(ステップST1)

そして、対象者Aは、ライブビュー画像を見ながら、自分の顔の輪郭と顔マーカー201とを合わせて、シャッターボタン152を押下する。これにより、撮像部104は、第1画像データD1を生成し、画像処理部106に出力する。この第1画像データD1の画像の一例を図5に示す。図5に示す通り、第1画像データD1の画像には、化粧をしていない状態の対象者Aの顔A1が含まれている。そして、画像処理部106は、第1画像データD1に対して画像処理をし、ワークメモリ107に格納する。次いで、圧縮処理部110は、ワークメモリ107内の第1画像データD1を、例えば、JPEGファイルに圧縮する処理を実行する。そして、制御部100の画像管理部118は、例えば、顔A1を撮像するため操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と第1画像データD1とを対応付けて、記録用メモリ108に格納する。

【0033】

ここで、対象者Aは、美容部員によって、両頬にピンク色のチークをのせてもらう。より具体的に説明すると、美容部員は、対象者Aの頬骨の一番高いところを中心に楕円状にチークをのせる。このとき、美容部員は、中心から外側に向かって徐々に色が薄くなるように、ぼかしてチークをのせる。

【0034】

(ステップST2)

そして、対象者Aは、ライブビュー画像を見ながら、再度、自分の顔の輪郭と顔マーカー201とを合わせ、シャッターボタン152を押下する。これにより、撮像部104は、第2画像データD2を生成し、画像処理部106に出力する。この第2画像データD2の画像の一例を図6に示す。図6に示す通り、第2画像データD2の画像には、化粧をしていない状態の対象者Aの顔A1に対して、両頬にチークがのせられた対象者Aの顔A2が含まれている。そして、画像処理部106は、第2画像データD2に対して画像処理をし、ワークメモリ107に格納する。次いで、圧縮処理部110は、ワークメモリ107内の第2画像データD2を、例えば、JPEGファイルに圧縮する処理を実行する。そして、制御部100の画像管理部118は、例えば、顔A2を撮像するため操作部105のシャッターボタン152が押下された時刻を示す時刻情報を計時部114から取得し、この時刻情報と第2画像データD2とを対応付けて、記録用メモリ108に格納する。

【0035】

(ステップST3)

そして、検出部101の顔検出部1101は、記録用メモリ108から第1画像データD1と第2画像データD2とを読み出して、各画像に含まれる顔A1と顔A2の輪郭を検出する。顔検出部1101が検出した顔の輪郭の一例を図7、8に示す。図7は、第1画像データD1から検出した顔A1の輪郭を示す輪郭線202を示す。また、図8は、第2画像データD2から検出した顔A2の輪郭を示す輪郭線203を示す。この顔検出部1101は、第1画像データD1において輪郭線202の位置を示す情報を取得する。また、顔検出部1101は、第2画像データD2において輪郭線203の位置を示す情報を取得する。この輪郭線202、203の位置を示す情報とは、例えば、各画像データに含まれる画素の座標値である。顔検出部1101は、検出した輪郭線202の位置を示す情報と、輪郭線203の位置を示す情報とを顔パーツ検出部1102に出力する。

【0036】

(ステップST4)

次いで、顔パーツ検出部1102は、顔検出部1101から入力する情報に基づき、人物の顔に含まれる予め決められたパーツを検出する。ここで、図9、10を参照して、画像データから各パーツを検出する一例について説明する。図9は、第1画像データD1の画像から検出されるパーツの基準点を示す図である。図10は、第2画像データD2の画像から検出されるパーツの基準点を示す図である。

顔パーツ検出部1102は、例えば、顔検出部1101によって検出された顔の輪郭線202、203のそれぞれと接する矩形状の顔枠204、205において、予め位置が決められている各パーツを検出する。顔パーツ検出部1102は、例えば、顔枠204、205内における各パーツの概ねの位置と各パーツの画像特徴量とが対応づけられているパーツ位置対応データR1を用いて、顔枠204、205内の画像特徴量に基づき、各パーツの画像領域を検出する。

【0037】

(ステップST5)

そして、顔パーツ検出部1102は、検出した各パーツの画像領域に基づき、各パーツの位置を示す基準点を検出し、パーツ位置情報Fを取得する。具体的に説明すると、顔パーツ検出部1102は、図9、10に示すように、右の眉毛の左右の2点a、bと、左の眉毛の左右の2点c、dと、右目の左右の2点e、fと、左目の左右の2点g、hと、右の小鼻の付け根iと、左の小鼻の付け根jと、口の左右の2点k、lとのそれぞれの位置を、各パーツの基準点として検出する。

顔パーツ検出部1102は、第1画像データD1から検出した各パーツの基準点a〜lを検出し、基準点a〜lに対応する画素の座標値を示す情報を、パーツ位置情報F1として取得する。また、顔パーツ検出部1102は、第2画像データD2から検出した各パーツの基準点a〜lを検出し、基準点a〜lに対応する画素の座標値を示す情報を、パーツ位置情報F2として取得する。

そして、顔パーツ検出部1102は、取得したパーツ位置情報F1、F2を差分情報取得部102に出力する。

【0038】

(ステップST6)

次いで、差分情報取得部102は、記録用メモリ108から第1画像データD1と第2画像データD2とを読み出して、各画像に含まれる顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。具体的に説明すると、差分情報取得部102は、顔パーツ検出部1102から入力するパーツ位置情報F1、F2に基づき、第1画像データD1と第2画像データD2について同じパーツ同士の位置を合わせて、顔A1と顔A2との位置を合わせる。また、差分情報取得部102は、例えば、第1画像データD1および第2画像データD2に基づき、それぞれの画像データの各画素の色成分C1、C2を算出する。

そして、差分情報取得部102は、顔A1と顔A2との位置を合わせた状態で、第1画像データD1に示される顔A1に対応する色成分C1´と、第2画像データD2に示される顔A2に対応する色成分C2´とを比較して、顔A1と顔A2との色成分の差分を示す差分情報G12を取得する。

【0039】

(ステップST7)

本実施形態では、顔A1に対して両頬にピンク色のチークを施した顔が顔A2である。よって、顔A2の両頬に相当する画素の色成分が顔A1の両頬に相当する画素の色成分と異なる。従って、差分情報取得部102は、顔A1と顔A2の両頬に相当する画素の色成分の差分を、差分情報G12として取得する。

また、差分情報取得部102は、パーツ位置情報F1、F2に基づき、検出部101によって検出された各パーツの位置関係に応じて、差分情報G12が検出された画素が、顔内のどの位置に対応するかを示す変化位置情報H12を取得する。従って、差分情報取得部102は、各パーツの基準点a〜lの位置情報に基づき、各パーツの位置関係を示す位置関係データR2を参照して、差分情報G12が示す顔A1と顔A2とを比較して色が異なる部分が、顔内のどの位置に対応する領域であるかを判定する。この差分情報取得部102は、位置関係データR2を参照して、例えば、顔内の各パーツとの相対的な距離に応じて、顔内のどの位置(例えば、頬、頬骨のトップ、下頬、口の横、目じり、Tゾーン等)に対応する領域であるかを判定する。そして、差分情報取得部102は、判定した顔内の領域を示す変化位置情報H12を取得する。そして、差分情報取得部102は、取得した差分情報G12と変化位置情報H12とを変化内容情報取得部103に出力する。

【0040】

そして、変化内容情報取得部103は、検出部101によって検出された各パーツと、差分情報取得部102が算出した差分情報G12が示す「色が変化している部分」との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報J12を取得する。

【0041】

(ステップST8)

具体的に説明すると、変化内容情報取得部103は、入力する差分情報G12と変化位置情報H12に基づき、顔A2において、顔A1から「変化した部分の位置を示す情報」と、「変化した色を示す情報」を取得する。従って、変化内容情報取得部103は、顔A1と顔A2とを比較した場合に「変化した部分の位置を示す情報」として、両頬の頬骨を中心にした楕円形の領域を示す情報を取得する。また、変化内容情報取得部103は、「変化した色を示す情報」として、頬骨を中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化する色彩を示す情報を取得する。つまり、変化内容情報取得部103は、顔A2は顔A1と比べて“両頬の楕円形の領域がピンク色に変化しており、具体的には、頬骨の中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化している”ということを判定する。言い換えると、変化内容情報取得部103は、このような変化を検出している。

【0042】

(ステップST9)

そして、変化内容情報取得部103は、ステップST8の判定結果が示す変化に基づき、変化の内容を示す変化内容情報J12を取得する。ここでは、変化内容情報取得部103は、判定結果が示す変化に基づき、携帯端末1内のメモリに予め登録されている差分情報Gに応じた変化の内容を示す変化内容データR3を参照して、この変化の内容を示す変化内容情報J12を取得する。従って、差分情報取得部102は、“両頬の楕円形の領域がピンク色に変化している”という判定結果から、その変化の内容は、“両頬にピンク色のチークを施した”という変化内容を示していると判定する。よって、変化内容情報取得部103は、変化内容情報J12−1として、“両頬にピンク色のチークを施した”ことを示す情報を取得する。

また、差分情報取得部102は、“頬骨の中心が最も濃いピンク色で、外側に向かって徐々に薄いピンク色に変化している”という判定結果から、その変化の内容が“頬骨のトップを中心にグラデーションをつけた色彩を施した”という変化内容を示していると判定する。よって、変化内容情報取得部103は、変化内容情報J12−2として、“頬骨のトップを中心にグラデーションをつけた色彩を施した”ことを示す情報を取得する。

よって、差分情報取得部102は、この変化内容情報J12−1と変化内容情報J12−2とに基づき、変化の内容が“両頬にピンク色のチークを施した”ことと“頬骨のトップを中心にグラデーションをつけた色彩を施した”ことであることを示す変化内容情報J12を取得する。

【0043】

(ステップST10)

次いで、通知情報生成部116は、変化内容情報J12に基づき、変化の内容を対象者Aに通知する通知情報K12を生成する。例えば、通知情報生成部116は、制御用メモリ115に登録されている通知情報生成データR4を参照して、変化の内容に対応する通知情報K12を生成する。具体的に説明すると、通知情報生成部116は、通知情報生成データR4に登録されている「変化した部分の位置を示す情報」や「変化した色を示す情報」と、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」とを比較して一致するものを検索する。一致する情報が検索して得られた場合、変化内容情報取得部103は、通知情報生成データR4において、変化内容情報J12が示す「変化した部分の位置を示す情報」と「変化した色を示す情報」と一致する情報と対応付けられている通知情報Kを、通知情報K12として取得する。

例えば、通知情報生成データR4において、変化した部分を示す情報として「頬、頬骨」が、変化した色を示す情報として「ピンク色、グラデーション」が、登録されている。また、これらの情報に対応する通知情報Kとして「頬骨のトップを中心に、ピンク色のチークを入れてください。ここでポイントは、トップを中心に色を濃く入れて、周りの色をぼかしてください」が登録されている。

一方、通知情報生成部116は、変化内容情報J12が示す「変化した部分の位置を示す情報」として、頬および頬骨を、「変化した色を示す情報」として、ピンク色、グラデーションを取得している。よって、通知情報生成部116は、通知情報K12として、通知情報生成データR4に登録されている通知情報K「頬骨のトップを中心に、ピンク色のチークを入れてください。ここでポイントは、トップを中心に色を濃く入れて、周りの色をぼかしてください」を、通知情報K12として取得する。

そして、通知情報生成部116は、取得した通知情報K12を表示制御部117に出力する。

【0044】

(ステップST11)

次いで、表示制御部117は、通知情報生成部116から入力する通知情報K12と、記録用メモリ108から読み出した第2画像データD2とに基づき、予め決められたレイアウトで、通知情報Kと第2画像データD2とを表示部109に表示させる。このとき、表示部109に表示される画像の一例を、図11に示す。図11に示す通り、表示部109には、第2画像データD2が表示され、この第2画像データD2の画像の下に、通知情報が表示される。

【0045】

上述の通り、本実施形態に係る携帯端末1は、対象者の顔を撮影した画像データに基づき、変化前の画像データと変化後の画像データの色成分の変化に基づき、変化した内容を判定することができる。よって、変化後の画像データにおいて、変化前の対象者に対してどのような変化要因が与えられたかを判定することができる。従って、対象者は、変化前の顔と、変化後の顔を撮像するだけで、変化の内容を示す情報を取得することができる。つまり、対象者は、変化の内容を示す情報を自ら作成する手間が省け、さらに、変化後の画像データと変化の内容を示す情報とを対応付けて管理する手間が省ける。

【0046】

例えば、対象者Aが美容部員に、チーク、アイシャドー、アイブロー、アイライナー、マスカラ、の順番で化粧を施してもらう場合、対象者Aは、チークをつける前の顔A1を撮像し、チークをつけた後の顔A2を撮像する。その後、アイシャドーをつけた後の顔A3を撮像し、アイブローをつけた後の顔A4を撮像し、アイライナーをつけた後の顔A5を撮像し、マスカラをつけた後の顔A6を撮像する。

この場合、携帯端末1は、顔A2と顔A3を比較することで、アイシャドーの入れ方を示す情報を取得することができる。例えば、アイホール全体にホワイト系のラメパウダーをのせた後、目じりにピンク系のパウダーをのせて、目の際に茶系のアイライナーをぼかしていれたとする。この場合、携帯端末1は、顔A2と顔A3の色成分を比較して、上述のような処理を実行することにより、変化の内容を示す変化内容情報Jとして、上述のようなアイシャドーの状態(アイホール全体にホワイト系のラメパウダーが全体的についていること、目じりにピンク系のパウダーが付いていること、目の際に茶系のアイライナーが外側がグラデーション状態で付いていること)を示す情報を取得することができる。なお、このようなアイメイクをする場合、最初にアイホール全体に薄い色を入れて、暖色系のパウダーは濃い暗い色よりも先につける場合が多い。このように、パウダーの色や付けられている場所によって、アイライナーの入れ方を推測することができる。よって、アイメイクの色を示す情報と、アイメイクの位置を示す情報と、これらアイメイクの色と位置に応じて予め決められる通知情報Kとを、それぞれ対応付けた通知情報生成データR4を用いることにより、携帯端末1は、アイシャドーの入れ方を示す通知情報Kを取得することができる。

【0047】

このように、美容部員やメイクアップアーティスト等のプロに化粧をしてもらった場合であっても、対象者Aは、変化前の顔と変化後の顔を撮像することにより、化粧の手順や化粧のポイント等を示した文字情報を取得することができる。これにより、対象者Aは、化粧を受けている最中に化粧の手順をメモしたりする手間が省ける。また、取得した文字情報を利用して、美容部員やメイクアップアーティスト等によるプロの技を再現することが可能となる。

【0048】

また、本実施形態に係る携帯端末1は、化粧を施す前後の顔ではなく、例えば、数ヶ月前の顔と現在の顔とを比較して、その変化を示す変化内容情報Jや通知情報Kを取得するものであってもよい。例えば、携帯端末1は、しみ、皺、日焼けなどの変化を検出し、変化内容情報Jや通知情報Kを取得するもであってもよい。

【0049】

さらに、本実施形態に係る情報読取装置は、携帯端末1に搭載されている構成に限られず、例えば、サーバに搭載されているものであってもよい。この場合、サーバは、通信可能に接続される携帯端末から受信した画像データに基づき、変化内容情報Jや通知情報Kを作成し、作成した変化内容情報Jや通知情報Kを携帯端末に返信するものであってもよい。これにより、携帯端末側では、情報読取装置の構成を有していない場合であっても、画像データをサーバに送信することで、変化内容情報Jや通知情報Kを取得することができる。

【0050】

また、本実施の形態に係る情報取得装置は、内部にコンピュータシステムを有している。そして、動作の過程は、プログラムの形式でコンピュータ読み取り可能な記録媒体に記憶されており、このプログラムをコンピュータシステムが読み出して実行することによって、上記処理が行われる。ここでいう「コンピュータシステム」とは、CPU及び各種メモリやOS、周辺機器等のハードウェアを含むものである。

また、「コンピュータシステム」は、WWWシステムを利用している場合であれば、ホームページ提供環境(あるいは表示環境)も含むものとする。

【0051】

また、各ステップを実現するためのプログラムをコンピュータ読み取り可能な記録媒体に記録して、また、この機能を実現するためのプログラムをコンピュータ読み取り可能な記録媒体に記録して、この記録媒体に記録されたプログラムをコンピュータシステムに読み込ませ、実行することにより、検出対象物の形状情報の推定値を算出する処理を行ってもよい。

また、「コンピュータ読み取り可能な記録媒体」とは、フレキシブルディスク、光磁気ディスク、ROM、フラッシュメモリ等の書き込み可能な不揮発性メモリ、CD−ROM等の可搬媒体、コンピュータシステムに内蔵されるハードディスク等の記憶装置のことをいう。

【0052】

さらに「コンピュータ読み取り可能な記録媒体」とは、インターネット等のネットワークや電話回線等の通信回線を介してプログラムが送信された場合のサーバやクライアントとなるコンピュータシステム内部の揮発性メモリ(例えばDRAM(Dynamic Random Access Memory))のように、一定時間プログラムを保持しているものも含むものとする。

また、上記プログラムは、このプログラムを記憶装置等に格納したコンピュータシステムから、伝送媒体を介して、あるいは、伝送媒体中の伝送波により他のコンピュータシステムに伝送されてもよい。ここで、プログラムを伝送する「伝送媒体」は、インターネット等のネットワーク(通信網)や電話回線等の通信回線(通信線)のように情報を伝送する機能を有する媒体のことをいう。

また、上記プログラムは、前述した機能の一部を実現するためのものであっても良い。さらに、前述した機能をコンピュータシステムに既に記録されているプログラムとの組合せで実現できるもの、いわゆる差分ファイル(差分プログラム)であっても良い。

【符号の説明】

【0053】

1…携帯端末

100…制御部、

101…検出部、

102…差分情報取得部、

103…変化内容情報取得部、

104…撮像部、

105…操作部、

106…画像処理部、

107…ワークメモリ、

108…記録用メモリ、

109…表示部、

110…圧縮処理部、

111…伸長処理部、

112…リサイズ処理部、

113…電源部、

114…計時部、

115…制御用メモリ、

116…通知情報生成部、

117…表示制御部、

118…画像管理部、

1101…顔検出部、

1102…顔パーツ検出部、

R1…パーツ位置対応データ

R2…位置関係データ

R3…変化内容データ

R4…通知情報生成データ

201…顔マーカー

202…輪郭線

203…輪郭線

204…顔枠

205…顔枠

【特許請求の範囲】

【請求項1】

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、

前記検出部によって検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、

前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得部と、

を備えることを特徴とする情報取得装置。

【請求項2】

前記変化内容情報取得部は、

前記差分情報に基づき、前記差分情報が示す色に応じて予め決められている顔内の変化の内容を示す前記変化内容情報のうち、前記差分情報が示す色に対応する前記変化内容情報を取得することを特徴とする請求項1に記載の情報取得装置。

【請求項3】

前記変化内容情報取得部は、

前記人物の顔における位置に応じて予め決められている顔内の化粧の状態を示す前記変化内容情報を取得することを特徴とする請求項1または2に記載の情報取得装置。

【請求項4】

前記変化内容情報に基づき、前記第1画像データに施された変化の手順を示す通知情報を取得する通知情報取得部をさらに備えることを特徴とする請求項1から3のうちいずれか一項に記載の情報取得装置。

【請求項5】

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出するステップと、

検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得するステップと、

検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得するステップと、

を備えることを特徴とする情報取得方法。

【請求項6】

コンピュータに、

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出手順、

検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得手順、

検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得手順、

を実行させるためのプログラム。

【請求項1】

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出部と、

前記検出部によって検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得部と、

前記検出部によって検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得部と、

を備えることを特徴とする情報取得装置。

【請求項2】

前記変化内容情報取得部は、

前記差分情報に基づき、前記差分情報が示す色に応じて予め決められている顔内の変化の内容を示す前記変化内容情報のうち、前記差分情報が示す色に対応する前記変化内容情報を取得することを特徴とする請求項1に記載の情報取得装置。

【請求項3】

前記変化内容情報取得部は、

前記人物の顔における位置に応じて予め決められている顔内の化粧の状態を示す前記変化内容情報を取得することを特徴とする請求項1または2に記載の情報取得装置。

【請求項4】

前記変化内容情報に基づき、前記第1画像データに施された変化の手順を示す通知情報を取得する通知情報取得部をさらに備えることを特徴とする請求項1から3のうちいずれか一項に記載の情報取得装置。

【請求項5】

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出するステップと、

検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得するステップと、

検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得するステップと、

を備えることを特徴とする情報取得方法。

【請求項6】

コンピュータに、

対象者の顔を撮影することにより取得した第1画像データと、前記第1画像データを撮像した後に前記被写体の顔を撮像することにより取得した第2画像データとから、それぞれ、人物の顔に含まれる一部であって検出対象として予め決められたパーツを検出する検出手順、

検出された同じパーツ同士を対応付けて前記第1画像データ内の顔と前記第2画像データ内の顔との位置を合わせて、前記第1画像データに示される顔の色成分と、前記第2画像データに示される顔の色成分とを比較して、前記第1画像データと前記第2画像データとの色成分の差分を示す差分情報を取得する差分情報取得手順、

検出された各パーツと、前記差分情報が示す色が変化している部分との位置関係に基づき、人物の顔における位置に応じて予め決められている顔内の変化の内容を示す変化内容情報うち、前記差分情報が示す色が変化している部分に対応する前記変化内容情報を取得する変化内容情報取得手順、

を実行させるためのプログラム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【公開番号】特開2013−25516(P2013−25516A)

【公開日】平成25年2月4日(2013.2.4)

【国際特許分類】

【出願番号】特願2011−158781(P2011−158781)

【出願日】平成23年7月20日(2011.7.20)

【出願人】(310006855)NECカシオモバイルコミュニケーションズ株式会社 (1,081)

【Fターム(参考)】

【公開日】平成25年2月4日(2013.2.4)

【国際特許分類】

【出願日】平成23年7月20日(2011.7.20)

【出願人】(310006855)NECカシオモバイルコミュニケーションズ株式会社 (1,081)

【Fターム(参考)】

[ Back to top ]