感情推定システム及びそれを利用した学習システム

【課題】学習者等の感情を高精度かつ高信頼に推定することが可能な感情推定システム及び学習システムを提供する。

【解決手段】顔画像データを取得可能なカメラ5と、カメラ5で撮影した被験者の顔画像データから平均変化率を算出する平均変化率算出手段21と、複数の被験者の顔特徴点の平均変化率と感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を抽出して絞り込みを行うと共に、他方、平均変化率の大小により2つに分けた各グループ内の平均値及び分散共分散行列を算出して構成した推定基準量データベース31と、カメラ5によって得られた顔画像データに基づいて被感情推定者がいずれのグループに属するかを判定する判定手段23と、判定手段23の判定結果に基づいて推定基準量データベース31のうち被感情推定者が属するグループのデータを用いて感情を推定する感情推定手段25とを備えてなる。

【解決手段】顔画像データを取得可能なカメラ5と、カメラ5で撮影した被験者の顔画像データから平均変化率を算出する平均変化率算出手段21と、複数の被験者の顔特徴点の平均変化率と感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を抽出して絞り込みを行うと共に、他方、平均変化率の大小により2つに分けた各グループ内の平均値及び分散共分散行列を算出して構成した推定基準量データベース31と、カメラ5によって得られた顔画像データに基づいて被感情推定者がいずれのグループに属するかを判定する判定手段23と、判定手段23の判定結果に基づいて推定基準量データベース31のうち被感情推定者が属するグループのデータを用いて感情を推定する感情推定手段25とを備えてなる。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、感情推定システム及びそれを利用した学習システムに関し、さらに詳しくは、コンピュータによって人の動的な顔画像データから感情の変化を高い精度で推定することを可能とすると共に、e−ラーニングに代表される学習支援システムを利用する学習者の感情をそれによって把握することでその感情に即した学習教材をより高い精度で提供することを可能とする感情推定システム及びそれを利用した学習システムに関する。

【背景技術】

【0002】

従来のヒューマンインタフェースは、操作性や安全性、疲れにくいといった人間とコンピュータとの適合を目的として研究が行われてきたが、一方で、人の感情や状況を予測し、その感情に最適な対応が可能な人に、より親和性のあるヒューマンインタフェースが求められている。人は、相手の表情を動的に読み取り、その微妙な変化から相手の感情などの内面的な状態を推定することで、円滑なコミュニケーションを図っている。したがって、人とコンピュータとの間のコミュニケーション手段として表情を利用するためには、コンピュータが人の動的な顔画像から感情の変化を理解することが必要である。そのためには、以下に挙げるいくつかの課題の解決が必要とされている。

(1) 人が表出する表情について、より多くの事例を対象にする。

(2) 誇張された表情ではなく、自然な表情から感情を推定する。

(3) 人による表情の認識過程や判断に近いアルゴリズムの開発。

(4) 感情の変化に応じた最適な対応や、情報提供を行うためのリアルタイム性。

【0003】

一方、近年の教育分野へのIT(情報技術)の導入に伴い、企業や大学等においてe−ラーニング等のコンピュータを利用した学習支援システムが広く利用されている。e−ラーニングの学習形態にもいくつかの種類があり、目的によって使い分けられているが、代表的な例としては、サーバから教材をダウンロードして自習形式で学習を行うWBT(Web Based Training)がある。WBTをベースにしたe−ラーニングの最大の特徴は、時間と場所の制約が無いことであるが、反面、教師が学習者の学習中の様子を把握して指導することができないという問題がある。このようなe−ラーニング学習環境の改善のため、学習者の行き詰まりをリアルタイムで検知する方法や、誤答に対して教師のリアルタイムでのアドバイスを学習者に送信するシステム等の事例が報告されている。

【0004】

一般的に対面式の講義では、教師は学習者の表情やしぐさなどから理解度や集中度、興味の有無などを確認しながら状況に応じて講義を進めている。本発明者らも、より人に親和性のある新しいヒューマンインタフェースであるe−ラーニング支援システムの開発を進めてきた。例えば、学習者の音声、表情・動作、生態情報等に基づいた心理状態推定情報を遠隔地の教師に表示する遠隔会議・教育システム(例えば、特許文献1参照)や、学習者の心理・精神状態をモニタして心理状態の推定を行い、これを基に現在の心理状態に対応した電子教材を提供することにより学習を支援する電子教材学習支援装置、電子教材学習支援システム及び電子教材学習支援プログラム(例えば、特許文献2参照)等をこれまでに開発した。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2006−262010号公報

【特許文献2】特開2006−23506号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

e−ラーニング等においては、学習者が意欲を持って学習しているか否かを、教師が把握することが学習成果を上げるために重要であるが、上述の特許文献1及び2では、少人数の被験者(学習者)の顔画像から感情推定に用いる特徴量を抽出していたため、被験者数や、顔特徴点の特定等の妥当性についての検証が十分とはいえなかったことから、感情推定の精度は必ずしも高いものではなかった。

【0007】

従って、本発明の目的は、コンピュータによってe−ラーニングの学習者の顔画像からリアルタイムで感情の変化を高精度かつ高信頼に推定することが可能な感情推定システム及びそれを利用した学習システムを提供することにある。

また、本発明は、利用者への負担や実用性を考慮し、顔画像と生体情報の併用ではなく、顔画像のみをリアルタイム処理することで、より信頼度の高い感情推定システム及びそれを利用した学習システムを提供することを目的とする。

【課題を解決するための手段】

【0008】

上記目的を達成するため、請求項1に記載の本発明は、人の感情をその表情の変化に基づいて推定する感情推定システムにおいて、被験者の表情の変化を撮影し、その表情の変化を顔画像データとして取得可能なカメラと、カメラで撮影した被験者の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴ってそれぞれ移動した各変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段と、複数の被験者における平均変化率算出手段によって算出した顔特徴点の平均変化率と、そのときの感情であってSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を相関の強弱に基づいて抽出し、抽出した顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行い、他方、各顔特徴点の平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に2つのグループ内のそれぞれの平均変化率の平均値及び分散共分散行列を算出して構成した推定基準量データベースと、感情推定を行うための被感情推定者の表情をカメラで撮影して得られた顔画像データに基づいて平均変化率算出手段によって算出された被感情推定者の各顔特徴点の平均変化率から被感情推定者が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを所定の基準に基づいて判定する判定手段と、判定手段によって判定された結果に基づいて推定基準量データベースのうち被感情推定者が属するとされたグループのデータを用いて被感情推定者の感情を推定する感情推定手段とを備えてなることを特徴とする。

【0009】

上記目的を達成するため、請求項2に記載の本発明は、請求項1に記載の感情推定システムにおいて、複数の異なる感情対は、「理解できた」及び「理解できない」からなる第1感情対と、「面白い」及び「つまらない」からなる第2感情対と、「集中している」及び「飽きている」からなる第3感情対と、「簡単」及び「難しいからなる」第4感情対の4つであることを特徴とする。

【0010】

上記目的を達成するため、請求項3に記載の本発明は、請求項1又は2に記載の感情推定システムにおいて、顔特徴点は、左右の眉の内と外及び左右の口端であり、これらの顔特徴点について、頭頂と部顎を結んだ線分を基準線分とし、頭頂部中心に半径が基準線分長の1/2の円と、顎を中心に半径が基準線分長の√5/2の2つの円との交点のうち向かって左側の交点を原点とし、2つの交点を結ぶ直線をx軸とし、頭頂部から顎を結ぶ直線と平行且つ原点との交点を始点とする直線をy軸とした相対座標におけるx方向及びy方向のそれぞれ12点の平均変化率を算出することを特徴とする。

【0011】

上記目的を達成するため、請求項4に記載の本発明は、請求項3に記載の感情推定システムにおいて、相関行列は、12点のうちの顔特徴点の1つとその他の顔特徴点との相関から求めることを特徴とする。

【0012】

上記目的を達成するため、請求項5に記載の本発明は、請求項1から4のいずれか1項に記載の感情推定システムにおいて、感情推定手段は、被感情推定者の学習前の平静状態における顔特徴点の位置から学習中における顔特徴点の移動距離に基づいて顔特徴点の平均変化率を求めることを特徴とする。

【0013】

上記目的を達成するため、請求項6に記載の本発明は、請求項1から5のいずれか1項に記載の感情推定システムにおいて、平均変化率算出手段は、IQR(interquartile range)×3倍を超える値を除外する前処理を行い、さらに再度IQR×1.5倍以上3倍以下にある値を除く処理を行う外れ値除去手段を含んでなることを特徴とする。

【0014】

上記目的を達成するため、請求項7に記載の本発明は、請求項1から6のいずれか1項に記載の感情推定システムにおいて、感情推定手段は、感情対のそれぞれについてマハラノビス距離を算出した後、距離に過大な影響を与える固有値を除き、一致率の高い固有値に基づいて再度マハラノビス距離を比較し、距離の短い方のグループの感情に属すると判断することを特徴とする。

【0015】

上記目的を達成するため、請求項8に記載の本発明は、請求項1から7のいずれか1項に記載の感情推定システムにおいて、平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを判定するための所定の基準は、所定時間における顔特徴点の各平均変化率の95%が0.02を越えたか否かによることを特徴とする。

【0016】

上記目的を達成するため、請求項9に記載の本発明は、請求項1から8のいずれか1項に記載の感情推定システムを備え、予め各感情に合わせて作成した教材データを格納した教材データベースと、感情推定システムによって推定された感情に合った教材データをデータベースから検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段とを備え、学習者の感情に即した教材を提供することを特徴とする学習システムを提供する。

【発明の効果】

【0017】

本発明に係る感情推定システム及びそれを利用した学習システムによれば、各顔特徴点の平均変化率を所定の基準に基づいて大小2つのグループに分けて感情推定を行うと共に、感情推定を行う各顔特徴点を絞り込むこととしたので、従来よりも被感情推定者(学習者)の感情を高精度かつ高信頼に推定することができるという効果がある。

【0018】

また、本発明に係る感情推定システム及びそれを利用した学習システムは被感情推定者の表情をカメラで捉え、その表情の変化のみを利用するものであることから、従来のように体温などの生体情報を取得するためのセンサ等を利用者の身体に直接に取り付ける必要がないので利用者への負担が少なく実用性が高いと共に、顔画像のみでより信頼度の高い感情推定を行うことができるという効果がある。

【図面の簡単な説明】

【0019】

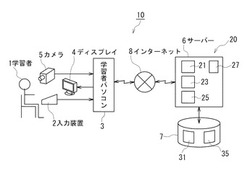

【図1】本発明の実施の形態に係る学習システムを示すブロック図である。

【図2】感情推定を行うための処理を示すフローチャートである。

【図3】図2に示した処理の詳細を示すフローチャートである。

【図4】顔特徴点を示す説明図である。

【図5】顔画像解析用の相対座標系を示す図である。

【図6】顔画像の解析手順を示すフローチャートである。

【図7】図3に示すステップS122の処理の詳細を示すフローチャートである。

【図8】顔特徴点の変化を示す分布特性を示す図である。

【図9】顔特徴点平均変化率のx座標、y座標の25%タイル点、75%タイル点を2次元平面上にプロットした図であり、(a)は「理解できた」の感情の場合であり、(b)「理解できない」の感情の場合である。

【図10】「理解できた」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図である。

【図11】「理解できない」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図である。

【図12】マハラノビス距離による感情推定処理を示すフローチャートである。

【図13】図12のステップS134の処理の詳細を示すフローチャートである。

【図14】Sグループにおける抽出した感情の特徴量の共分散行列の固有値のスクリープロットを示す図である。

【図15】学習ナビゲーション手段のブロック図である。

【図16】本発明の実施例及び比較例を示す図である。

【発明を実施するための形態】

【0020】

本発明に係る感情推定システム及びそれを利用した学習システムについて図面を参照しつつ以下詳細に説明する。図1は本発明に係る感情推定システムを備えた学習システムの概要を示すブロック図である。

【0021】

[学習システムの構成]

図示された学習システム10は、学習者の感情の推定に関する情報の収集及びこれに基づく感情推定等を行う本発明に係る感情推定システム20を備えて構成されており、学習システム10はこの感情推定システム20によって学習者1の学習中における感情の変化を捉え、そのときの感情に即した教材を学習者1に提供するようになっている。

【0022】

すなわち、感情推定システム20を備えた学習システム10は、学習者1の自宅や学校など学習を行う場所に設置されて学習者1によって操作される入力装置2と、入力装置2に接続された学習者用パーソナルコンピュータ本体3(以下、「学習者用パソコン3」という)と、学習者用パソコン3に接続されたディスプレイ4と、学習者用パソコン3に接続されて学習者1の顔を撮影して画像データを取得するためのカメラ5(ビデオカメラ)と、カメラ5で撮影した画像データを学習者用パソコン3から入手すると共に学習者1の感情の推定を行って学習支援をする教師となるべきサーバ6と、各種の電子データを格納するためにサーバ6に接続された記憶装置7とを備えて構成されており、サーバ6と学習者用パソコン3とはインターネット8を介して接続可能とされている。なお、必要に応じて、サーバ6側にも図示しないディスプレイ及びマウスやキーボードなどの入力装置が設置される。

【0023】

サーバ6は、いわゆる汎用のコンピュータによって構成されており、図示しない中央処理装置、入力装置、通信装置、メモリなどの記憶装置を備えて構成されている。ハード構成自体は一般的なものであるためその詳しい説明は省略する。サーバ6は、公知のハード構成を利用して、カメラ5で撮影した学習者1の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴って移動したそれぞれの変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段21と、平均変化率算出手段21によって算出された学習者1の顔特徴点の平均変化率から学習者1の感情を推定する感情推定手段25を備えており、また、サーバ6と接続された記憶装置7には感情推定を行う基準となる推定基準量データベース31が格納されている。これにより感情推定システム20及びこの感情推定システム20を備えた学習システム10を備えた学習システム10が構築されている。以下、感情推定システム20について説明する。

【0024】

感情推定システム20は推定基準量データベース31を備えており、推定基準量データベース31は、後述するように顔特徴点の平均変化率の小さなグループと顔特徴点の平均変化率の大きなグループの2つに分けられて構成されていると共に、感情推定システム20を形成するサーバ6には、感情の推定を行う対象である被感情推定者としての学習者1の表情をカメラ5で撮影することによって得られた顔画像データに基づいて平均変化率算出手段21が算出した学習者1の各顔特徴点の平均変化率から学習者1が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを所定の基準に基づいて判定する判定手段23を備えている。また、記憶装置7には、学習システム10が利用するための教材データベース35であって、学習者1が学習を進めていく上で現れるであろう種々の感情に合わせて予め作成した教材データからなる教材データベース35が格納されていると共に、サーバ6には感情推定システム20によって推定された学習者1の感情に合った教材データを教材データベース35から検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段27を備えている。尚、出力デバイスとしては、例えば、映像や画像を映すディスプレイや、音声を出すスーピーカ若しくはイヤホンなどがある。

【0025】

感情推定を行う基準となる推定基準量データベース31についてさらに説明する。ここで、被験者とは、推定基準量データベース31を構築するために感情推定を行う基準となるデータを収集するための対象者をいう。推定基準量データベース31は感情推定を行うための基準となるデータを備えて構成されるデータベースであり、予め複数の被験者から必要なデータを取得することによって構築されている。すなわち、平均変化率算出手段21は、被験者の表情の変化をカメラ5で撮影することによって取得した顔画像データに基づいて予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴って移動したそれぞれの変化量について所定時間当たりの平均値を平均変化率として算出する。次に、平均変化率算出手段21によって算出された複数の被験者の顔特徴点の平均変化率とそのときの感情についてSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対、例えば、「理解できた−理解できない」、「面白い−つまらない」等、に対応する顔特徴点を相関の強弱に基づいて抽出する。そして、抽出した顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行う。他方、各顔特徴点の平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に2つのグループ内のそれぞれの平均値及び分散共分散行列を算出することによって形成されている。以下、感情推定システム20の処理のフローについてさらに詳細に説明する。

【0026】

[平均変化率の算出]

初めに、カメラ5で撮影した学習者1の顔画像データを用いて学習者1の顔特徴点が移動した変化量から平均変化率を算出するために平均変化率算出手段21が行う処理について説明する。図2は感情推定を行うための処理を示すフローチャート、図3は図2に示した処理の詳細を示すフローチャート、図4は顔特徴点を示す説明図である。尚、平均変化率算出手段21は推定基準量データベース31に格納する感情推定を行うためのデータを取得する際にも利用されるものである。

【0027】

人の表情の変化は、表情筋(更には咀嚼筋)の収縮・弛緩により引き起こされる形状の変化であり、表情の変化と感情とは関連があるとされている(例えば、「表情分析入門」P.Ekman and W.V.Friesen(工藤力訳)誠信書房、1987年)。そこで、発明者らは、これらの知見に基づき、表情の変化に伴って生じる表情筋の変化量と感情との対応付けを行った。具体的には、表情筋の動きを検出するために表情の変化に伴って移動し、且つ、画像から抽出しやすい顔の部位として右眉外、右眉内、左眉外、左眉内、右口端、左口端の6点を顔特徴点として定義した。また、顔画像の正規化を行うために頭頂部及び顎の2点を基準点として使用する。なお、学習者1の眉が髪で隠れてしまうと十分な精度で顔特徴点の追跡が行えない可能性が考えられるので顔特徴点の追跡に影響を与えない程度の髪型および髪の長さとするか、髪を結ぶことによって眉全体が確認できるようにしておくことが好ましい。

【0028】

次に、カメラ5によって撮影した被験者の顔画像データに対し、図5に示すような顔画像解析用の相対座標系を用意した。すなち、撮影した顔画像は、顔の大きさや傾きを考慮し頭頂部から顎までの距離を基準線分長として座標の正規化を行い、各顔特徴点の相対座標値を算出する。図6は顔画像の解析手順を示すフローチャートであり、図6を用いて座標の正規化処理について説明する。

【0029】

(1)被験者の顔画像データは、学習前の1分間及び学習中の5分間においてカメラ5で連続的に撮影することによって取得される(図6のS1211、S1212)。カメラ5で撮影した被験者の映像を2次元画像追跡ソフト(例えば、デジモ社製「2D−PTV」)を用いて上記した顔特徴点(右眉外、右眉内、左眉外、左眉内、右口端、左口端の6点)と基準点(頭頂部と顎の2点)の合計8点について15フレーム/Sに設定した軌跡追跡を行うことにより(S1213、S1216)2次元座標値座標に変換(640×480の画素数)する(S1214、S1217)。なお、図5の画面の向かって左上を原点とし、右向きにx軸正、下向きにy軸正とした座標系を用い、初期フレームのみ顔特徴点の位置情報を手動で設定する。

【0030】

(2)次に、数式1により「頭頂部H(xh,yh)−顎C(xc,yc)の長さを求める。

【0031】

【数1】

【0032】

頭頂部−顎の長さを基準線分長(BL=Base Line 長さL)とし、頭頂部H(xh,yh)を中心に半径が基準線分BLの長さの1/2の円と、顎C(xc,yc)を中心に同じく半径が基準線分BLの長さの√5/2の2つの円との交点のうち、向かって画像左側の交点を新たに原点O(0,0)とする。

【0033】

(3)2つの円との交点を結ぶ直線をx軸とし、頭頂部から顎へ向かう直線BLと平行かつ原点との交点を始点とする直線をy軸とした顔領域を内包する正方形を作成し、各顔特徴点座標の相対座標化を全てのフレームについて実施する(図5参照)。

【0034】

(4)各顔特徴点の相対座標値から学習前の平静時における1分間の顔特徴点座標値の平均値を算出し(S1215)、被験者の基準値(平静状態)とする。学習中の画像に対してフレーム毎に基準値との移動距離が算出され、所定時間(例えば、30秒)間隔で平均値が算出され(S1218)、上記平静時からの移動距離に基づいて顔特徴点の平均変化率が算出される。例えば、基準となる平静状態の顔特徴点の座標位置x座標の位置をx0、x軸方向の移動距離がδxiのときのx方向の変化量Δxi=δxi/x0で求められる。なお、数値は無次元である。

【0035】

[推定感情の定義]

従来、表情や感情に関する研究の多くは、上記Ekmanが提唱した基本6感情を推定の対象としている。しかし、e−ラーニング学習の場面においては、このような基本6感情よりも、学習内容が「理解できた」又は「理解できない」、「面白い」又は「つまらない」、更に学習に「集中している」又は「飽きている」、「難しい」又は「簡単」等の学習中に起こる感情を推定することが重要であると考えられる。そこで、表1に示すe−ラーニングの学習環境に対応した第1感情対から第4感情対の4感情対8感情を定義した。

【0036】

【表1】

【0037】

表1に示す各感情対について、上記学習を終了後、直ちに被験者に撮影した学習端末の教材画面映像を提示し、30秒間隔で5分間、計10回のSD法(Semantic Differential Method)による「1」〜「5」段階の主観評価を実施する(S121)。評価「1」,「2」を表1の左側の感情、「4」,「5」を右側の感情と定義し、更に「3」は中立状態として評価感情からは除く。以上のようにして得られたデータは、記憶装置7に格納(蓄積)される(S121)。なお、4つの感情対は、それぞれ独立しているものと仮定し、同時に2つ以上の感情を所有することがある。

【0038】

次に、平均変化率の分析について説明する。上述のようにして求められた顔特徴点の平均変化率(感情推定に用いる特徴量)について、分布、相関及び被験者数との関連を説明する。まず、前処理(S122)として、不要なデータの除去を行う(図7参照)。図8は顔特徴点の変化を示す分布特性を示す図であり、図8に示すような箱ひげ図によりデータの分布の確認を行ったところ(S1221)、IQR(interquartile range)×3倍を超える値(図8の枠で囲った2つのデータD1,D2)が見られた。

【0039】

一般に、IQR×3倍を超える値(極値)は、異常値であることを疑う必要がある。そこで、発明者らは学習中の表情を撮影した映像を確認したところ、例えば、追跡できないほどの急激な傾きや、髪を気にするしぐさ等が見られた。これらは顔特徴点の変化とは直接関係の無い動きであると考えられるため、IQRが3倍を超える値は特徴量の対象データから除外し、それ以外のデータを有効値として採用する(S1222)。以降、この有効値を顔特徴点平均変化率とし、感情推定のための特徴量の抽出に用いる。なお、相関は少しの外れ値でも影響を受け易いことから、上記前処理を行った後、再度、IQRが1.5倍以上3倍以下にある値を除いたデータを用いて分析を行うものとする(S1223)。

【0040】

[分布に関する分析]

図9は顔特徴点平均変化率のx座標、y座標の25%タイル点、75%タイル点(IQR)を2次元平面上にプロットした図であり、(a)は「理解できた」の場合であり、(b)は「理解できない」の場合である。図中、特性R1は右眉外、特性R2は右眉内、特性R3は右口端、特性L1は左眉外、特性L2は左眉内、特性L3は左口端の特性である。図9(a)の「理解できた」は、図9図(b)の「理解できない」に比べ、変化率の分布範囲が広くなっていることが分かる。

【0041】

また、図9より、(a)「理解できない」は、平均変化率が−0.006≦x≦+0.01、−0.003≦y≦+0.01の範囲で分布しているが、(b)「理解できた」は−0.014≦x≦+0.013、−0.009≦y≦+0.02の範囲で分布している。左右眉のy軸の四分位偏差の平均値は、(a)理解できない0.004、(b)理解できた0.011となり、(a)「理解できない」では上方向(y軸マイナス方向)への変化が小さい傾向が認められた。この傾向は、第2感情対から第4感情対まで同様に見られ、「理解できない」、「つまらない」、「飽きている」、「難しい」の否定的な感情を伴う表情の変化は、「理解できた」、「面白い」、「集中している」、「簡単」の肯定的な感情を伴う表情の変化と比較し表情の変化が小さく、平静状態よりも特に上方向への変化が小さい傾向が確認された。なお、「理解できない」の各顔特徴点は、y軸プラス側に変化していることから、顔特徴点が平静状態よりも下方向へ動くことが予測される。

【0042】

[相関に関する分析]

図10は、「理解できた」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図、図11は、「理解できない」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図であり、詳しくは被験者23名の第1感情対(「理解できない」−「理解できた」)の顔特徴点平均変化率の2変数を全ての組み合わせのマトリックスプロット(相関行列)を示している。

【0043】

図10及び図11から以下のような傾向が確認された。

(1)「理解できた」では、右眉内yと左眉内yの相関係数r=0.95と強く(図10中のE)、「理解できない」ではr=0.33と相関がみられない(図11中のE)傾向が確認された。

(2)「理解できた」では、左右の眉の内側、外側のy軸方向(図10中のA〜F)への相関係数の平均はravg=0.76であり、「理解できない」の相関係数の平均ravg=0.49と比較し眉同士のy軸方向への相関が強い傾向が確認された。

(3)「理解できた」では、右口端yと左口端yの相関がr=0.81と強いが(図10中のG)、「理解できない」では、r=0.32と相関がみられなかった(図11中のG)。なお、この傾向は、第2感情対から第4感情対においても同様に見られた。

【0044】

この結果について、顔特徴点の動きを表情筋と関連付けて考察すると、眉は、額にある前頭筋と眉間にある雛眉筋、および眼輪筋により移動・変形するが、これらの筋肉は連動して、眉に対し 軸方向に一様な収縮をさせる。図10及び図11より「理解できた」では、「理解できない」と比較し一様に移動・変形する傾向が強い傾向が確認された。

【0045】

一般的に、顔の形状や大きさ表情の変化などには個人差が見られるが、抽出した特徴量の標準偏差・平均値が何名の被験者のデータの蓄積によって収束が見られるかという被験者数の妥当性を検討することは実用上重要である。

【0046】

そこで、被験者数と顔特徴点平均変化率の標準偏差及び平均値を算出し、被験者数に対する収束度合いを検討したところ、4つの感情対は、被験者が7名程度までは変化率の標準偏差の値が大きく変動したが、10名を超えると標準偏差の値の変動が小さくなり、更に、15名程度でほぼ一定値に収束する傾向が見られた。このことは、相関とも関連するが、人間の表情筋は任意の方向に自由に動くのではなく、各筋肉の方向に沿って変形及び移動するため、可動範囲及び方向が或る程度限定されており、その動きには規則性がある為と考えられる。本発明では、この特徴量を用いており、被験者数の数を15名程度とすれば妥当な推定結果を得ることができると考えられる。

【0047】

[感情の推定]

次に、感情推定手段25について学習者1の感情を推定する処理(図2のステップS13)に基づいて説明する。上述したように、ステップS11,12において主観評価を行い、e−ラーニング学習者の表情と感情の時系列変化を測定して特徴量の抽出を行った。その結果、顔特徴点平均変化率と感情との間には、変化率及び相関に関して関連のあることが実証された。感情推定手段25は、以上の結果を基に、距離尺度の1つであるマハラノビス距離(Mahalanobis distance)を評価関数に用いて感情推定を行う。この点、顔特徴点の変化量には個人差が確認あり、またマハラノビス距離には、これまでに次元数に対するサンプル数の数、および固有値の影響に関する問題が報告されていることから、本発明では、あらかじめ被験者を顔特徴点平均変化率の大小により2つのグループに分けることとした。次に、次元数に対するサンプル数を相対的に増やすため、感情対ごとに推定に用いる顔特徴点を選択する。さらに、マハラノビス距離を用いた演算では、感情対どちらかの特徴量の共分散行列の累積寄与率が95%以上となる次元までの固有値を用いる。図12はマハラノビス距離による感情推定処理を示すフローチャートである。

【0048】

まず、上記ステップS11,12により抽出した特徴量を学習サンプルとして用いる。事前に、顔特徴点平均変化率が小さな人(被験者又は学習者1)を「Sグループ(ポーカーフェイス)」とし、顔特徴点平均変化率が大きな人(被験者又は学習者1)を「Lグループ(表情豊かな顔)」とする(S131)。次に、各グループごとに平均値及び共分散行列を算出する(S132、S133)。次に、各感情の学習サンプルの相関係数行列から相関の強い顔特徴点を抽出し感情の推定に用いる。そして、評価データについて各感情対でマハラノビス距離を計算(S134)した後、一致率と固有値について検討し、マハラノビス距離に過大な影響を与えると考えられる固有値を打ち切り、一致率の高い固有の数を選択する(S135)。選択した固有値で、再度、マハラノビス距離を比較し、距離の小さい方のグループの感情に属するものと判断する。

【0049】

マハラノビス距離の計算においては、パターンの次元数に対して十分な数の学習サンプルを用意する必要があるが、利用分野によっては容易には得られない場合がある。そこで、平均変化率算出手段21によって算出した平均変化率、すなわち、抽出した特徴量から有効な特徴量に絞り込みを行う。上記したように、顔特徴点の相関は感情により特徴が見られるものと、相関が見られないものとが存在する。そこで、各感情で相関係数行列を求め、感情対で相関に差異が見られ且つ相関が強い顔特徴点を推定に用いる。各感情の相関係数行列から、相関係数≧0.7を基準に各感情対で感情推定に用いる顔特徴点を決定した。表2は、感情推定に用いる顔特徴点の一覧を示している。

【0050】

【表2】

【0051】

[被験者のグループ分け]

特徴量の分析より被験者には、顔特徴点平均変化率の大きな者と、顔特徴点平均変化率の小さな者が存在し、肯定的な感情は、否定的な感情と比較し変化率の分布が広いことが確認された。そこで、本発明では、変化率の小さな者を「Sグループ」に、変化率の大きな者を「Lグループ」の2つのグループに分け、それぞれのグループ毎に感情推定を行うこととした。グループ分けの基準は、相対的な基準によって2つに分ければよいが、例えば、「学習中の5分間の顔特徴点平均変化率の95%が、変化率0.02以下」である者を「Sグループ」とし、そうでない者を「Lグループ」とするとよい。換言すれば、「Sグループ」は顔特徴点平均変化率の小さい者が属するグループ、「Lグループ」は顔特徴点平均変化率の大きい者が属するグループとなる。そこで、感情推定システム20に学習中の5分間の顔特徴点平均変化率の95%が、変化率0.02以下を基準にして被験者又は学習者1をいずれかのグループに属するかの判定を行う判定手段23を設け、グループ分けが行われるようにした。すなわち、時間tからt+30(sec)の顔特徴点平均変化率をFvalue、5分間の顔特徴点平均変化率のサンプル数×0.95をFsamples、Fvalueを満たすサンプル数をCount(Fvalue)とするとき、グループ分けの基準は以下の数式で表されるPを満たす被験者を「Sグループ」、そうでない被者を「Lグループ」として分類する。

P=((−0.02≦Fvalue≦+.002 AND Count(Fvalue)≦Fsamples))

すなわち、「Sグループ」は、顔特徴点平均変化率の小さい被験者が属するグループ、「Lグループ」は、顔特徴点平均変化率の大きい被験者の属するグループである。なお、実際のシステムでは、サンプルコンテンツでグループ分けを行うことになる。

【0052】

[マハラノビス距離と固有値展開]

ここで、xを未知入力ベクトル(推定データ)、μを母集団の平均値ベクトル(サンプル平均)、母集団の共分散行列をΣとすると、xとμの間のマハラノビス距離は、数式2により与えられる。

【0053】

【数2】

【0054】

ここで、共分散行列は、Σ対称行列であるため、正規直行行列Pは、数式3により対角化させることができる。

【0055】

【数3】

【0056】

Σの第Σ固有値をλk、λkに対応する固有ベクトルをφkとすれば、数式2は、数式4のように書き直すことができる。

【0057】

【数4】

【0058】

したがって、グループAとグループBの2つの場合、dA2<dB2であればグループAに属し、dA2>dB2であればグループBに属することになる。

【0059】

次に、図12のステップS134の処理について、図13のフローチャートを用いて説明する。まず、推定対象感情ナンバー(N)をN=0に設定し(S1341)、更に、N=N+1、つまり「感情対1」を設定する(S1342)。次に、N=NMAXか否か、つまり「感情対4」か否かを判定する(S1343)。N=NMAXが判定された場合(S1343:Yes)、感情推定の演算を終了し(S1344)、NMAXの感情中、最少マハラノビス距離の感情を推定感情として終了する(S1345)。

【0060】

ステップS1343でN=NMAXではないことが判定された場合(S1343:No)、感情No.Nの推定に使用する顔特徴点を指定する(S1346)。更に、記憶装置7から感情推定データを読み出し(S1347)、このデータを基に感情推定演算(マハラノビス距離計算を実施する(S1348)。その後、処理は、ステップS135にリターンする。

【0061】

マハラノビス距離には、分散(固有値)がゼロに近い軸が多く存在し、これらの軸は、

・冗長である、

・分散(固有値)の小さい軸が距離に過大な影響を与えるために認識率の低下をもたらす、

という問題が指摘されている。

【0062】

この2つの問題について図14を例に説明する。図14は、Sグループにおける抽出した感情の特徴量の共分散行列の固有値のスクリープロットを示す図である。Sグループの「理解できた」の固有値の変化は、λ1=3.06、λ2=1.53、λ3=0.63、λ4=0.33と、λ3からは1以下となり、λ12では0.002と極めて0に近い。上記数式4に示すように、固有値λkが分母になっているため、値の小さな固有値の方がより距離に大きな影響を及ぼすことになる。

【0063】

特に、固有値の値が0に近い場合、その影響がより大きいと考えられる。この場合の累積寄与率(Ck)は、C3=85.30%、C4=90.70%となり、「理解できた」の固有値のうち、値の大きな4つで全体の90%以上を説明することができる。したがって、特徴量は、第3次元から固有値の値が急激に減少して1以下となり、分散行列の固有値の問題が顕著に現れ、計算する際に考慮が必要であることが分かる。そこで、推定演算時に、あらかじめ感情対どちらかの特徴量の共分散行列の累積寄与率(Ck)がCm≧95%となる第m次元までの固有値λm、およびλmに対応する固有ベクトルφmまでを用い、数式4よりk=1,2・・・mとしてマハラノビス距離を計算した後、一致率と固有値について検討し、マハラノビス距離に過大な影響を与えると考えられる固有値は打ち切り、一致率の高い固有値を選択する(S135)。選択した固有値で再度マハラノビス距離を比較し、マハラノビス距離の小さい方のグループの感情に属すると判断する。

【0064】

一方、本発明に係る学習システム10は、平均変化率算出手段21、判定手段23、感情推定手段25を備えた上述の感情推定システム20のほか、学習ナビゲーション手段27を備えている。学習ナビゲーション手段27は、感情推定システム20によって推定された学習者1の感情に基づき、記憶装置7に格納された教材データベース35から予め感情ごとに対応させて作成した複数の教材データの中からそのときの学習者1の感情に即した教材データを選択し、学習者用パソコン3のディスプレイ4や、図示しないスーピーカ若しくはイヤホンなどを用いて教材データを再生するものである。

【0065】

記憶装置7には教材データベース35が設けられており、教材データベースには各種の学習テーマに即した教材データが格納されている。1つの学習テーマは、学習の進捗に合わせて難易度が高い教材データ、難易度が普通の教材データ、難易度の低い教材データが用意されている。例えば、図15に示すように、ある学習テーマの第1章から第n章までの各章にはそれぞれ難易度の高い「難」、難易度が普通の「中」、難易度の低い「易」の3種類の教材データが用意されている。そして、感情推定システム20が第1章の学習をしている際の学習者1の感情を「理解できた」であると特定した場合にはその情報に基づいて学習ナビゲーション手段27は教材データベース35から第2章の学習データの中から「難」レベルの教材データを選択し、当該学習データを学習者1の学習者用パソコン3に送出する。そして、順次これを繰り返すことにより、学習者1に対してそのときの感情及びレベルに合わせた教材が提供されることになる。

【0066】

[実施の形態の効果]

本実施の形態によれば、人の表情変化の大小から感情推定の対象者を2つのグループに分け、更に推定に用いる顔特徴点を感情対で選択して推定を行うことにより、学習者の感情変化を従来よりも高い確率推定することができるという効果がある。また、体温などの生体情報を取得するためのセンサ等を利用者の身体に直接に取り付ける必要がないので利用者への負担が少なく実用性が高いと共に、顔画像のみでより信頼度の高い感情推定を行うことができるという効果がある。

【実施例】

【0067】

次に、本発明に係る感情推定システム及びそれを利用した学習システムの具体的な実施例について説明する。図16は実施例と従来手法(感情及び生体情報)による比較例の感情推定の結果を示す図である。尚、SとLのグループ分けは以下の通りである。

【0068】

初めに、推定基準量データベース31を構成するデータを取得するための被験者を23名(男性18名、女性5名)とし、その中でグループSは被験者10名(男性10名、女性0名)、グループLは被験者13名(男性8名、女性5名)である。一方、感情評価の対象となる学習者は、推定基準量データベース31を構成するデータを取得するための上記被験者を23名の対象者とは異なる学習者A、B、Cの3名(男性2、女性1名)である。

【0069】

(1)学習者A、B、C3名についてe−ラーニングを行った後、学習中の感情についてSD法による主観評価を実施し30秒間隔の主観感情を特定した。

(2)平均変化率算出手段21によって学習中の3名の学習者A、B、Cの画像解析をそれぞれ行い、顔特徴点平均変化率を算出した。得られた学習者A、B、C3名の評価データ数を表3に示す。

【0070】

【表3】

【0071】

(3)そして、判定手段23によって学習者A、B、Cのグループ分けを行った。その結果は以下のとおりである。

学習者A:女性(Sグループ)

学習者B:男性(Sグループ)

学習者C:男性(Lグループ)

【0072】

[結果]

本実施例における感情の推定結果と実際の学習者A、B、Cの感情との一致率の結果は、図16に示すように、「理解できた」が81.3%、「理解できない」が33.3%、「面白い」が100.0%、「つまらない」が100.0%、「集中している」が55.6%、「飽きている」が100.0%、「簡単」が80.0%、「難しい」が83.3%で、8感情の一致率の平均は77.1%であった。一致率の高い感情対は「面白い−つまらない」であり、一方、推定率の低い感情対は「理解できた−理解できない」であった。従来法の8感情の一致率は47.3%であり、本発明に係る感情推定システムによれば、従来手法による感情推定と比較して29.8%の一致率の向上が見られた。これは、被験者を顔特徴点の平均変化率の大小によってグループ分けしたこと、および、感情推定に用いる顔特徴点を感情対で選択することが一致率の向上の要因であると考えられる。

【0073】

以上の結果から以下の結論が得られた。

(1)推定感情と被験者の評価感情の比である全感情の一致率は、比較例が47.3%であるのに対し、実施例は77.1%であり、その有効性が確認された。

(2)e−ラーニング学習中の表情の変化率は、平均変化率の大きな被験者と小さな被験者が存在するが、顔の長さに対して平均1〜4%ほどの微小な変化である。

(3)肯定的な感情に伴う顔特徴点変化率は、否定的な感情を伴う変化よりも大きく、特に眉に対してy軸方向に一様な変化をする傾向が強い。

(4)顔特徴点平均変化率の分散及び平均値は、4つの感情対において約15名という少数の被験者で収束する傾向が確認された。

【0074】

このように、本発明に係る感情推定システム20によって特定した学習者1の感情は高い確率で正しく判断することが可能であり、また。感情推定システム20によって特定された感情に基づいて教材を提供する本発明に係る学習システム1は学習者1に対して適切な教材データを提供することが可能となる。

【0075】

なお、上記実施の形態においては、図2〜図12に示す処理は、サーバ6によって行うものとしたが、学習者用パソコン3によって処理する構成であってもよい。或いは、学習者パソコン3やサーバ6に接続された専用の感情推定システムを設ける構成であってもよい。

【0076】

また、インターネット8は会社等に設けられたLAN等の通信回線であってもよい。また、インターネット8やLAN等の通信回線を介することなく、サーバ6の機能を学習者用パソコン3において機能させるように構成することも可能である。

【産業上の利用可能性】

【0077】

感情推定の対象を公共サービスの利用者、相談者等にすることで、感情推定システムを学習システム以外の用途にも適用可能である。

【符号の説明】

【0078】

1 学習者

2 入力装置

3 学習者用パソコン

4 ディスプレイ

5 カメラ

6 サーバ

7 記憶装置

8 インターネット

10 学習システム

20 感情推定システム

21 平均変化率算出手段

23 判定手段

25 感情推定手段

31 推定基準量データベース

35 教材データベース

【技術分野】

【0001】

本発明は、感情推定システム及びそれを利用した学習システムに関し、さらに詳しくは、コンピュータによって人の動的な顔画像データから感情の変化を高い精度で推定することを可能とすると共に、e−ラーニングに代表される学習支援システムを利用する学習者の感情をそれによって把握することでその感情に即した学習教材をより高い精度で提供することを可能とする感情推定システム及びそれを利用した学習システムに関する。

【背景技術】

【0002】

従来のヒューマンインタフェースは、操作性や安全性、疲れにくいといった人間とコンピュータとの適合を目的として研究が行われてきたが、一方で、人の感情や状況を予測し、その感情に最適な対応が可能な人に、より親和性のあるヒューマンインタフェースが求められている。人は、相手の表情を動的に読み取り、その微妙な変化から相手の感情などの内面的な状態を推定することで、円滑なコミュニケーションを図っている。したがって、人とコンピュータとの間のコミュニケーション手段として表情を利用するためには、コンピュータが人の動的な顔画像から感情の変化を理解することが必要である。そのためには、以下に挙げるいくつかの課題の解決が必要とされている。

(1) 人が表出する表情について、より多くの事例を対象にする。

(2) 誇張された表情ではなく、自然な表情から感情を推定する。

(3) 人による表情の認識過程や判断に近いアルゴリズムの開発。

(4) 感情の変化に応じた最適な対応や、情報提供を行うためのリアルタイム性。

【0003】

一方、近年の教育分野へのIT(情報技術)の導入に伴い、企業や大学等においてe−ラーニング等のコンピュータを利用した学習支援システムが広く利用されている。e−ラーニングの学習形態にもいくつかの種類があり、目的によって使い分けられているが、代表的な例としては、サーバから教材をダウンロードして自習形式で学習を行うWBT(Web Based Training)がある。WBTをベースにしたe−ラーニングの最大の特徴は、時間と場所の制約が無いことであるが、反面、教師が学習者の学習中の様子を把握して指導することができないという問題がある。このようなe−ラーニング学習環境の改善のため、学習者の行き詰まりをリアルタイムで検知する方法や、誤答に対して教師のリアルタイムでのアドバイスを学習者に送信するシステム等の事例が報告されている。

【0004】

一般的に対面式の講義では、教師は学習者の表情やしぐさなどから理解度や集中度、興味の有無などを確認しながら状況に応じて講義を進めている。本発明者らも、より人に親和性のある新しいヒューマンインタフェースであるe−ラーニング支援システムの開発を進めてきた。例えば、学習者の音声、表情・動作、生態情報等に基づいた心理状態推定情報を遠隔地の教師に表示する遠隔会議・教育システム(例えば、特許文献1参照)や、学習者の心理・精神状態をモニタして心理状態の推定を行い、これを基に現在の心理状態に対応した電子教材を提供することにより学習を支援する電子教材学習支援装置、電子教材学習支援システム及び電子教材学習支援プログラム(例えば、特許文献2参照)等をこれまでに開発した。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2006−262010号公報

【特許文献2】特開2006−23506号公報

【発明の概要】

【発明が解決しようとする課題】

【0006】

e−ラーニング等においては、学習者が意欲を持って学習しているか否かを、教師が把握することが学習成果を上げるために重要であるが、上述の特許文献1及び2では、少人数の被験者(学習者)の顔画像から感情推定に用いる特徴量を抽出していたため、被験者数や、顔特徴点の特定等の妥当性についての検証が十分とはいえなかったことから、感情推定の精度は必ずしも高いものではなかった。

【0007】

従って、本発明の目的は、コンピュータによってe−ラーニングの学習者の顔画像からリアルタイムで感情の変化を高精度かつ高信頼に推定することが可能な感情推定システム及びそれを利用した学習システムを提供することにある。

また、本発明は、利用者への負担や実用性を考慮し、顔画像と生体情報の併用ではなく、顔画像のみをリアルタイム処理することで、より信頼度の高い感情推定システム及びそれを利用した学習システムを提供することを目的とする。

【課題を解決するための手段】

【0008】

上記目的を達成するため、請求項1に記載の本発明は、人の感情をその表情の変化に基づいて推定する感情推定システムにおいて、被験者の表情の変化を撮影し、その表情の変化を顔画像データとして取得可能なカメラと、カメラで撮影した被験者の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴ってそれぞれ移動した各変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段と、複数の被験者における平均変化率算出手段によって算出した顔特徴点の平均変化率と、そのときの感情であってSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を相関の強弱に基づいて抽出し、抽出した顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行い、他方、各顔特徴点の平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に2つのグループ内のそれぞれの平均変化率の平均値及び分散共分散行列を算出して構成した推定基準量データベースと、感情推定を行うための被感情推定者の表情をカメラで撮影して得られた顔画像データに基づいて平均変化率算出手段によって算出された被感情推定者の各顔特徴点の平均変化率から被感情推定者が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを所定の基準に基づいて判定する判定手段と、判定手段によって判定された結果に基づいて推定基準量データベースのうち被感情推定者が属するとされたグループのデータを用いて被感情推定者の感情を推定する感情推定手段とを備えてなることを特徴とする。

【0009】

上記目的を達成するため、請求項2に記載の本発明は、請求項1に記載の感情推定システムにおいて、複数の異なる感情対は、「理解できた」及び「理解できない」からなる第1感情対と、「面白い」及び「つまらない」からなる第2感情対と、「集中している」及び「飽きている」からなる第3感情対と、「簡単」及び「難しいからなる」第4感情対の4つであることを特徴とする。

【0010】

上記目的を達成するため、請求項3に記載の本発明は、請求項1又は2に記載の感情推定システムにおいて、顔特徴点は、左右の眉の内と外及び左右の口端であり、これらの顔特徴点について、頭頂と部顎を結んだ線分を基準線分とし、頭頂部中心に半径が基準線分長の1/2の円と、顎を中心に半径が基準線分長の√5/2の2つの円との交点のうち向かって左側の交点を原点とし、2つの交点を結ぶ直線をx軸とし、頭頂部から顎を結ぶ直線と平行且つ原点との交点を始点とする直線をy軸とした相対座標におけるx方向及びy方向のそれぞれ12点の平均変化率を算出することを特徴とする。

【0011】

上記目的を達成するため、請求項4に記載の本発明は、請求項3に記載の感情推定システムにおいて、相関行列は、12点のうちの顔特徴点の1つとその他の顔特徴点との相関から求めることを特徴とする。

【0012】

上記目的を達成するため、請求項5に記載の本発明は、請求項1から4のいずれか1項に記載の感情推定システムにおいて、感情推定手段は、被感情推定者の学習前の平静状態における顔特徴点の位置から学習中における顔特徴点の移動距離に基づいて顔特徴点の平均変化率を求めることを特徴とする。

【0013】

上記目的を達成するため、請求項6に記載の本発明は、請求項1から5のいずれか1項に記載の感情推定システムにおいて、平均変化率算出手段は、IQR(interquartile range)×3倍を超える値を除外する前処理を行い、さらに再度IQR×1.5倍以上3倍以下にある値を除く処理を行う外れ値除去手段を含んでなることを特徴とする。

【0014】

上記目的を達成するため、請求項7に記載の本発明は、請求項1から6のいずれか1項に記載の感情推定システムにおいて、感情推定手段は、感情対のそれぞれについてマハラノビス距離を算出した後、距離に過大な影響を与える固有値を除き、一致率の高い固有値に基づいて再度マハラノビス距離を比較し、距離の短い方のグループの感情に属すると判断することを特徴とする。

【0015】

上記目的を達成するため、請求項8に記載の本発明は、請求項1から7のいずれか1項に記載の感情推定システムにおいて、平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを判定するための所定の基準は、所定時間における顔特徴点の各平均変化率の95%が0.02を越えたか否かによることを特徴とする。

【0016】

上記目的を達成するため、請求項9に記載の本発明は、請求項1から8のいずれか1項に記載の感情推定システムを備え、予め各感情に合わせて作成した教材データを格納した教材データベースと、感情推定システムによって推定された感情に合った教材データをデータベースから検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段とを備え、学習者の感情に即した教材を提供することを特徴とする学習システムを提供する。

【発明の効果】

【0017】

本発明に係る感情推定システム及びそれを利用した学習システムによれば、各顔特徴点の平均変化率を所定の基準に基づいて大小2つのグループに分けて感情推定を行うと共に、感情推定を行う各顔特徴点を絞り込むこととしたので、従来よりも被感情推定者(学習者)の感情を高精度かつ高信頼に推定することができるという効果がある。

【0018】

また、本発明に係る感情推定システム及びそれを利用した学習システムは被感情推定者の表情をカメラで捉え、その表情の変化のみを利用するものであることから、従来のように体温などの生体情報を取得するためのセンサ等を利用者の身体に直接に取り付ける必要がないので利用者への負担が少なく実用性が高いと共に、顔画像のみでより信頼度の高い感情推定を行うことができるという効果がある。

【図面の簡単な説明】

【0019】

【図1】本発明の実施の形態に係る学習システムを示すブロック図である。

【図2】感情推定を行うための処理を示すフローチャートである。

【図3】図2に示した処理の詳細を示すフローチャートである。

【図4】顔特徴点を示す説明図である。

【図5】顔画像解析用の相対座標系を示す図である。

【図6】顔画像の解析手順を示すフローチャートである。

【図7】図3に示すステップS122の処理の詳細を示すフローチャートである。

【図8】顔特徴点の変化を示す分布特性を示す図である。

【図9】顔特徴点平均変化率のx座標、y座標の25%タイル点、75%タイル点を2次元平面上にプロットした図であり、(a)は「理解できた」の感情の場合であり、(b)「理解できない」の感情の場合である。

【図10】「理解できた」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図である。

【図11】「理解できない」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図である。

【図12】マハラノビス距離による感情推定処理を示すフローチャートである。

【図13】図12のステップS134の処理の詳細を示すフローチャートである。

【図14】Sグループにおける抽出した感情の特徴量の共分散行列の固有値のスクリープロットを示す図である。

【図15】学習ナビゲーション手段のブロック図である。

【図16】本発明の実施例及び比較例を示す図である。

【発明を実施するための形態】

【0020】

本発明に係る感情推定システム及びそれを利用した学習システムについて図面を参照しつつ以下詳細に説明する。図1は本発明に係る感情推定システムを備えた学習システムの概要を示すブロック図である。

【0021】

[学習システムの構成]

図示された学習システム10は、学習者の感情の推定に関する情報の収集及びこれに基づく感情推定等を行う本発明に係る感情推定システム20を備えて構成されており、学習システム10はこの感情推定システム20によって学習者1の学習中における感情の変化を捉え、そのときの感情に即した教材を学習者1に提供するようになっている。

【0022】

すなわち、感情推定システム20を備えた学習システム10は、学習者1の自宅や学校など学習を行う場所に設置されて学習者1によって操作される入力装置2と、入力装置2に接続された学習者用パーソナルコンピュータ本体3(以下、「学習者用パソコン3」という)と、学習者用パソコン3に接続されたディスプレイ4と、学習者用パソコン3に接続されて学習者1の顔を撮影して画像データを取得するためのカメラ5(ビデオカメラ)と、カメラ5で撮影した画像データを学習者用パソコン3から入手すると共に学習者1の感情の推定を行って学習支援をする教師となるべきサーバ6と、各種の電子データを格納するためにサーバ6に接続された記憶装置7とを備えて構成されており、サーバ6と学習者用パソコン3とはインターネット8を介して接続可能とされている。なお、必要に応じて、サーバ6側にも図示しないディスプレイ及びマウスやキーボードなどの入力装置が設置される。

【0023】

サーバ6は、いわゆる汎用のコンピュータによって構成されており、図示しない中央処理装置、入力装置、通信装置、メモリなどの記憶装置を備えて構成されている。ハード構成自体は一般的なものであるためその詳しい説明は省略する。サーバ6は、公知のハード構成を利用して、カメラ5で撮影した学習者1の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴って移動したそれぞれの変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段21と、平均変化率算出手段21によって算出された学習者1の顔特徴点の平均変化率から学習者1の感情を推定する感情推定手段25を備えており、また、サーバ6と接続された記憶装置7には感情推定を行う基準となる推定基準量データベース31が格納されている。これにより感情推定システム20及びこの感情推定システム20を備えた学習システム10を備えた学習システム10が構築されている。以下、感情推定システム20について説明する。

【0024】

感情推定システム20は推定基準量データベース31を備えており、推定基準量データベース31は、後述するように顔特徴点の平均変化率の小さなグループと顔特徴点の平均変化率の大きなグループの2つに分けられて構成されていると共に、感情推定システム20を形成するサーバ6には、感情の推定を行う対象である被感情推定者としての学習者1の表情をカメラ5で撮影することによって得られた顔画像データに基づいて平均変化率算出手段21が算出した学習者1の各顔特徴点の平均変化率から学習者1が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを所定の基準に基づいて判定する判定手段23を備えている。また、記憶装置7には、学習システム10が利用するための教材データベース35であって、学習者1が学習を進めていく上で現れるであろう種々の感情に合わせて予め作成した教材データからなる教材データベース35が格納されていると共に、サーバ6には感情推定システム20によって推定された学習者1の感情に合った教材データを教材データベース35から検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段27を備えている。尚、出力デバイスとしては、例えば、映像や画像を映すディスプレイや、音声を出すスーピーカ若しくはイヤホンなどがある。

【0025】

感情推定を行う基準となる推定基準量データベース31についてさらに説明する。ここで、被験者とは、推定基準量データベース31を構築するために感情推定を行う基準となるデータを収集するための対象者をいう。推定基準量データベース31は感情推定を行うための基準となるデータを備えて構成されるデータベースであり、予め複数の被験者から必要なデータを取得することによって構築されている。すなわち、平均変化率算出手段21は、被験者の表情の変化をカメラ5で撮影することによって取得した顔画像データに基づいて予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴って移動したそれぞれの変化量について所定時間当たりの平均値を平均変化率として算出する。次に、平均変化率算出手段21によって算出された複数の被験者の顔特徴点の平均変化率とそのときの感情についてSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対、例えば、「理解できた−理解できない」、「面白い−つまらない」等、に対応する顔特徴点を相関の強弱に基づいて抽出する。そして、抽出した顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行う。他方、各顔特徴点の平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に2つのグループ内のそれぞれの平均値及び分散共分散行列を算出することによって形成されている。以下、感情推定システム20の処理のフローについてさらに詳細に説明する。

【0026】

[平均変化率の算出]

初めに、カメラ5で撮影した学習者1の顔画像データを用いて学習者1の顔特徴点が移動した変化量から平均変化率を算出するために平均変化率算出手段21が行う処理について説明する。図2は感情推定を行うための処理を示すフローチャート、図3は図2に示した処理の詳細を示すフローチャート、図4は顔特徴点を示す説明図である。尚、平均変化率算出手段21は推定基準量データベース31に格納する感情推定を行うためのデータを取得する際にも利用されるものである。

【0027】

人の表情の変化は、表情筋(更には咀嚼筋)の収縮・弛緩により引き起こされる形状の変化であり、表情の変化と感情とは関連があるとされている(例えば、「表情分析入門」P.Ekman and W.V.Friesen(工藤力訳)誠信書房、1987年)。そこで、発明者らは、これらの知見に基づき、表情の変化に伴って生じる表情筋の変化量と感情との対応付けを行った。具体的には、表情筋の動きを検出するために表情の変化に伴って移動し、且つ、画像から抽出しやすい顔の部位として右眉外、右眉内、左眉外、左眉内、右口端、左口端の6点を顔特徴点として定義した。また、顔画像の正規化を行うために頭頂部及び顎の2点を基準点として使用する。なお、学習者1の眉が髪で隠れてしまうと十分な精度で顔特徴点の追跡が行えない可能性が考えられるので顔特徴点の追跡に影響を与えない程度の髪型および髪の長さとするか、髪を結ぶことによって眉全体が確認できるようにしておくことが好ましい。

【0028】

次に、カメラ5によって撮影した被験者の顔画像データに対し、図5に示すような顔画像解析用の相対座標系を用意した。すなち、撮影した顔画像は、顔の大きさや傾きを考慮し頭頂部から顎までの距離を基準線分長として座標の正規化を行い、各顔特徴点の相対座標値を算出する。図6は顔画像の解析手順を示すフローチャートであり、図6を用いて座標の正規化処理について説明する。

【0029】

(1)被験者の顔画像データは、学習前の1分間及び学習中の5分間においてカメラ5で連続的に撮影することによって取得される(図6のS1211、S1212)。カメラ5で撮影した被験者の映像を2次元画像追跡ソフト(例えば、デジモ社製「2D−PTV」)を用いて上記した顔特徴点(右眉外、右眉内、左眉外、左眉内、右口端、左口端の6点)と基準点(頭頂部と顎の2点)の合計8点について15フレーム/Sに設定した軌跡追跡を行うことにより(S1213、S1216)2次元座標値座標に変換(640×480の画素数)する(S1214、S1217)。なお、図5の画面の向かって左上を原点とし、右向きにx軸正、下向きにy軸正とした座標系を用い、初期フレームのみ顔特徴点の位置情報を手動で設定する。

【0030】

(2)次に、数式1により「頭頂部H(xh,yh)−顎C(xc,yc)の長さを求める。

【0031】

【数1】

【0032】

頭頂部−顎の長さを基準線分長(BL=Base Line 長さL)とし、頭頂部H(xh,yh)を中心に半径が基準線分BLの長さの1/2の円と、顎C(xc,yc)を中心に同じく半径が基準線分BLの長さの√5/2の2つの円との交点のうち、向かって画像左側の交点を新たに原点O(0,0)とする。

【0033】

(3)2つの円との交点を結ぶ直線をx軸とし、頭頂部から顎へ向かう直線BLと平行かつ原点との交点を始点とする直線をy軸とした顔領域を内包する正方形を作成し、各顔特徴点座標の相対座標化を全てのフレームについて実施する(図5参照)。

【0034】

(4)各顔特徴点の相対座標値から学習前の平静時における1分間の顔特徴点座標値の平均値を算出し(S1215)、被験者の基準値(平静状態)とする。学習中の画像に対してフレーム毎に基準値との移動距離が算出され、所定時間(例えば、30秒)間隔で平均値が算出され(S1218)、上記平静時からの移動距離に基づいて顔特徴点の平均変化率が算出される。例えば、基準となる平静状態の顔特徴点の座標位置x座標の位置をx0、x軸方向の移動距離がδxiのときのx方向の変化量Δxi=δxi/x0で求められる。なお、数値は無次元である。

【0035】

[推定感情の定義]

従来、表情や感情に関する研究の多くは、上記Ekmanが提唱した基本6感情を推定の対象としている。しかし、e−ラーニング学習の場面においては、このような基本6感情よりも、学習内容が「理解できた」又は「理解できない」、「面白い」又は「つまらない」、更に学習に「集中している」又は「飽きている」、「難しい」又は「簡単」等の学習中に起こる感情を推定することが重要であると考えられる。そこで、表1に示すe−ラーニングの学習環境に対応した第1感情対から第4感情対の4感情対8感情を定義した。

【0036】

【表1】

【0037】

表1に示す各感情対について、上記学習を終了後、直ちに被験者に撮影した学習端末の教材画面映像を提示し、30秒間隔で5分間、計10回のSD法(Semantic Differential Method)による「1」〜「5」段階の主観評価を実施する(S121)。評価「1」,「2」を表1の左側の感情、「4」,「5」を右側の感情と定義し、更に「3」は中立状態として評価感情からは除く。以上のようにして得られたデータは、記憶装置7に格納(蓄積)される(S121)。なお、4つの感情対は、それぞれ独立しているものと仮定し、同時に2つ以上の感情を所有することがある。

【0038】

次に、平均変化率の分析について説明する。上述のようにして求められた顔特徴点の平均変化率(感情推定に用いる特徴量)について、分布、相関及び被験者数との関連を説明する。まず、前処理(S122)として、不要なデータの除去を行う(図7参照)。図8は顔特徴点の変化を示す分布特性を示す図であり、図8に示すような箱ひげ図によりデータの分布の確認を行ったところ(S1221)、IQR(interquartile range)×3倍を超える値(図8の枠で囲った2つのデータD1,D2)が見られた。

【0039】

一般に、IQR×3倍を超える値(極値)は、異常値であることを疑う必要がある。そこで、発明者らは学習中の表情を撮影した映像を確認したところ、例えば、追跡できないほどの急激な傾きや、髪を気にするしぐさ等が見られた。これらは顔特徴点の変化とは直接関係の無い動きであると考えられるため、IQRが3倍を超える値は特徴量の対象データから除外し、それ以外のデータを有効値として採用する(S1222)。以降、この有効値を顔特徴点平均変化率とし、感情推定のための特徴量の抽出に用いる。なお、相関は少しの外れ値でも影響を受け易いことから、上記前処理を行った後、再度、IQRが1.5倍以上3倍以下にある値を除いたデータを用いて分析を行うものとする(S1223)。

【0040】

[分布に関する分析]

図9は顔特徴点平均変化率のx座標、y座標の25%タイル点、75%タイル点(IQR)を2次元平面上にプロットした図であり、(a)は「理解できた」の場合であり、(b)は「理解できない」の場合である。図中、特性R1は右眉外、特性R2は右眉内、特性R3は右口端、特性L1は左眉外、特性L2は左眉内、特性L3は左口端の特性である。図9(a)の「理解できた」は、図9図(b)の「理解できない」に比べ、変化率の分布範囲が広くなっていることが分かる。

【0041】

また、図9より、(a)「理解できない」は、平均変化率が−0.006≦x≦+0.01、−0.003≦y≦+0.01の範囲で分布しているが、(b)「理解できた」は−0.014≦x≦+0.013、−0.009≦y≦+0.02の範囲で分布している。左右眉のy軸の四分位偏差の平均値は、(a)理解できない0.004、(b)理解できた0.011となり、(a)「理解できない」では上方向(y軸マイナス方向)への変化が小さい傾向が認められた。この傾向は、第2感情対から第4感情対まで同様に見られ、「理解できない」、「つまらない」、「飽きている」、「難しい」の否定的な感情を伴う表情の変化は、「理解できた」、「面白い」、「集中している」、「簡単」の肯定的な感情を伴う表情の変化と比較し表情の変化が小さく、平静状態よりも特に上方向への変化が小さい傾向が確認された。なお、「理解できない」の各顔特徴点は、y軸プラス側に変化していることから、顔特徴点が平静状態よりも下方向へ動くことが予測される。

【0042】

[相関に関する分析]

図10は、「理解できた」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図、図11は、「理解できない」の顔特徴点平均変化率のデータの分布状態をマトリックスで表示した図であり、詳しくは被験者23名の第1感情対(「理解できない」−「理解できた」)の顔特徴点平均変化率の2変数を全ての組み合わせのマトリックスプロット(相関行列)を示している。

【0043】

図10及び図11から以下のような傾向が確認された。

(1)「理解できた」では、右眉内yと左眉内yの相関係数r=0.95と強く(図10中のE)、「理解できない」ではr=0.33と相関がみられない(図11中のE)傾向が確認された。

(2)「理解できた」では、左右の眉の内側、外側のy軸方向(図10中のA〜F)への相関係数の平均はravg=0.76であり、「理解できない」の相関係数の平均ravg=0.49と比較し眉同士のy軸方向への相関が強い傾向が確認された。

(3)「理解できた」では、右口端yと左口端yの相関がr=0.81と強いが(図10中のG)、「理解できない」では、r=0.32と相関がみられなかった(図11中のG)。なお、この傾向は、第2感情対から第4感情対においても同様に見られた。

【0044】

この結果について、顔特徴点の動きを表情筋と関連付けて考察すると、眉は、額にある前頭筋と眉間にある雛眉筋、および眼輪筋により移動・変形するが、これらの筋肉は連動して、眉に対し 軸方向に一様な収縮をさせる。図10及び図11より「理解できた」では、「理解できない」と比較し一様に移動・変形する傾向が強い傾向が確認された。

【0045】

一般的に、顔の形状や大きさ表情の変化などには個人差が見られるが、抽出した特徴量の標準偏差・平均値が何名の被験者のデータの蓄積によって収束が見られるかという被験者数の妥当性を検討することは実用上重要である。

【0046】

そこで、被験者数と顔特徴点平均変化率の標準偏差及び平均値を算出し、被験者数に対する収束度合いを検討したところ、4つの感情対は、被験者が7名程度までは変化率の標準偏差の値が大きく変動したが、10名を超えると標準偏差の値の変動が小さくなり、更に、15名程度でほぼ一定値に収束する傾向が見られた。このことは、相関とも関連するが、人間の表情筋は任意の方向に自由に動くのではなく、各筋肉の方向に沿って変形及び移動するため、可動範囲及び方向が或る程度限定されており、その動きには規則性がある為と考えられる。本発明では、この特徴量を用いており、被験者数の数を15名程度とすれば妥当な推定結果を得ることができると考えられる。

【0047】

[感情の推定]

次に、感情推定手段25について学習者1の感情を推定する処理(図2のステップS13)に基づいて説明する。上述したように、ステップS11,12において主観評価を行い、e−ラーニング学習者の表情と感情の時系列変化を測定して特徴量の抽出を行った。その結果、顔特徴点平均変化率と感情との間には、変化率及び相関に関して関連のあることが実証された。感情推定手段25は、以上の結果を基に、距離尺度の1つであるマハラノビス距離(Mahalanobis distance)を評価関数に用いて感情推定を行う。この点、顔特徴点の変化量には個人差が確認あり、またマハラノビス距離には、これまでに次元数に対するサンプル数の数、および固有値の影響に関する問題が報告されていることから、本発明では、あらかじめ被験者を顔特徴点平均変化率の大小により2つのグループに分けることとした。次に、次元数に対するサンプル数を相対的に増やすため、感情対ごとに推定に用いる顔特徴点を選択する。さらに、マハラノビス距離を用いた演算では、感情対どちらかの特徴量の共分散行列の累積寄与率が95%以上となる次元までの固有値を用いる。図12はマハラノビス距離による感情推定処理を示すフローチャートである。

【0048】

まず、上記ステップS11,12により抽出した特徴量を学習サンプルとして用いる。事前に、顔特徴点平均変化率が小さな人(被験者又は学習者1)を「Sグループ(ポーカーフェイス)」とし、顔特徴点平均変化率が大きな人(被験者又は学習者1)を「Lグループ(表情豊かな顔)」とする(S131)。次に、各グループごとに平均値及び共分散行列を算出する(S132、S133)。次に、各感情の学習サンプルの相関係数行列から相関の強い顔特徴点を抽出し感情の推定に用いる。そして、評価データについて各感情対でマハラノビス距離を計算(S134)した後、一致率と固有値について検討し、マハラノビス距離に過大な影響を与えると考えられる固有値を打ち切り、一致率の高い固有の数を選択する(S135)。選択した固有値で、再度、マハラノビス距離を比較し、距離の小さい方のグループの感情に属するものと判断する。

【0049】

マハラノビス距離の計算においては、パターンの次元数に対して十分な数の学習サンプルを用意する必要があるが、利用分野によっては容易には得られない場合がある。そこで、平均変化率算出手段21によって算出した平均変化率、すなわち、抽出した特徴量から有効な特徴量に絞り込みを行う。上記したように、顔特徴点の相関は感情により特徴が見られるものと、相関が見られないものとが存在する。そこで、各感情で相関係数行列を求め、感情対で相関に差異が見られ且つ相関が強い顔特徴点を推定に用いる。各感情の相関係数行列から、相関係数≧0.7を基準に各感情対で感情推定に用いる顔特徴点を決定した。表2は、感情推定に用いる顔特徴点の一覧を示している。

【0050】

【表2】

【0051】

[被験者のグループ分け]

特徴量の分析より被験者には、顔特徴点平均変化率の大きな者と、顔特徴点平均変化率の小さな者が存在し、肯定的な感情は、否定的な感情と比較し変化率の分布が広いことが確認された。そこで、本発明では、変化率の小さな者を「Sグループ」に、変化率の大きな者を「Lグループ」の2つのグループに分け、それぞれのグループ毎に感情推定を行うこととした。グループ分けの基準は、相対的な基準によって2つに分ければよいが、例えば、「学習中の5分間の顔特徴点平均変化率の95%が、変化率0.02以下」である者を「Sグループ」とし、そうでない者を「Lグループ」とするとよい。換言すれば、「Sグループ」は顔特徴点平均変化率の小さい者が属するグループ、「Lグループ」は顔特徴点平均変化率の大きい者が属するグループとなる。そこで、感情推定システム20に学習中の5分間の顔特徴点平均変化率の95%が、変化率0.02以下を基準にして被験者又は学習者1をいずれかのグループに属するかの判定を行う判定手段23を設け、グループ分けが行われるようにした。すなわち、時間tからt+30(sec)の顔特徴点平均変化率をFvalue、5分間の顔特徴点平均変化率のサンプル数×0.95をFsamples、Fvalueを満たすサンプル数をCount(Fvalue)とするとき、グループ分けの基準は以下の数式で表されるPを満たす被験者を「Sグループ」、そうでない被者を「Lグループ」として分類する。

P=((−0.02≦Fvalue≦+.002 AND Count(Fvalue)≦Fsamples))

すなわち、「Sグループ」は、顔特徴点平均変化率の小さい被験者が属するグループ、「Lグループ」は、顔特徴点平均変化率の大きい被験者の属するグループである。なお、実際のシステムでは、サンプルコンテンツでグループ分けを行うことになる。

【0052】

[マハラノビス距離と固有値展開]

ここで、xを未知入力ベクトル(推定データ)、μを母集団の平均値ベクトル(サンプル平均)、母集団の共分散行列をΣとすると、xとμの間のマハラノビス距離は、数式2により与えられる。

【0053】

【数2】

【0054】

ここで、共分散行列は、Σ対称行列であるため、正規直行行列Pは、数式3により対角化させることができる。

【0055】

【数3】

【0056】

Σの第Σ固有値をλk、λkに対応する固有ベクトルをφkとすれば、数式2は、数式4のように書き直すことができる。

【0057】

【数4】

【0058】

したがって、グループAとグループBの2つの場合、dA2<dB2であればグループAに属し、dA2>dB2であればグループBに属することになる。

【0059】

次に、図12のステップS134の処理について、図13のフローチャートを用いて説明する。まず、推定対象感情ナンバー(N)をN=0に設定し(S1341)、更に、N=N+1、つまり「感情対1」を設定する(S1342)。次に、N=NMAXか否か、つまり「感情対4」か否かを判定する(S1343)。N=NMAXが判定された場合(S1343:Yes)、感情推定の演算を終了し(S1344)、NMAXの感情中、最少マハラノビス距離の感情を推定感情として終了する(S1345)。

【0060】

ステップS1343でN=NMAXではないことが判定された場合(S1343:No)、感情No.Nの推定に使用する顔特徴点を指定する(S1346)。更に、記憶装置7から感情推定データを読み出し(S1347)、このデータを基に感情推定演算(マハラノビス距離計算を実施する(S1348)。その後、処理は、ステップS135にリターンする。

【0061】

マハラノビス距離には、分散(固有値)がゼロに近い軸が多く存在し、これらの軸は、

・冗長である、

・分散(固有値)の小さい軸が距離に過大な影響を与えるために認識率の低下をもたらす、

という問題が指摘されている。

【0062】

この2つの問題について図14を例に説明する。図14は、Sグループにおける抽出した感情の特徴量の共分散行列の固有値のスクリープロットを示す図である。Sグループの「理解できた」の固有値の変化は、λ1=3.06、λ2=1.53、λ3=0.63、λ4=0.33と、λ3からは1以下となり、λ12では0.002と極めて0に近い。上記数式4に示すように、固有値λkが分母になっているため、値の小さな固有値の方がより距離に大きな影響を及ぼすことになる。

【0063】

特に、固有値の値が0に近い場合、その影響がより大きいと考えられる。この場合の累積寄与率(Ck)は、C3=85.30%、C4=90.70%となり、「理解できた」の固有値のうち、値の大きな4つで全体の90%以上を説明することができる。したがって、特徴量は、第3次元から固有値の値が急激に減少して1以下となり、分散行列の固有値の問題が顕著に現れ、計算する際に考慮が必要であることが分かる。そこで、推定演算時に、あらかじめ感情対どちらかの特徴量の共分散行列の累積寄与率(Ck)がCm≧95%となる第m次元までの固有値λm、およびλmに対応する固有ベクトルφmまでを用い、数式4よりk=1,2・・・mとしてマハラノビス距離を計算した後、一致率と固有値について検討し、マハラノビス距離に過大な影響を与えると考えられる固有値は打ち切り、一致率の高い固有値を選択する(S135)。選択した固有値で再度マハラノビス距離を比較し、マハラノビス距離の小さい方のグループの感情に属すると判断する。

【0064】

一方、本発明に係る学習システム10は、平均変化率算出手段21、判定手段23、感情推定手段25を備えた上述の感情推定システム20のほか、学習ナビゲーション手段27を備えている。学習ナビゲーション手段27は、感情推定システム20によって推定された学習者1の感情に基づき、記憶装置7に格納された教材データベース35から予め感情ごとに対応させて作成した複数の教材データの中からそのときの学習者1の感情に即した教材データを選択し、学習者用パソコン3のディスプレイ4や、図示しないスーピーカ若しくはイヤホンなどを用いて教材データを再生するものである。

【0065】

記憶装置7には教材データベース35が設けられており、教材データベースには各種の学習テーマに即した教材データが格納されている。1つの学習テーマは、学習の進捗に合わせて難易度が高い教材データ、難易度が普通の教材データ、難易度の低い教材データが用意されている。例えば、図15に示すように、ある学習テーマの第1章から第n章までの各章にはそれぞれ難易度の高い「難」、難易度が普通の「中」、難易度の低い「易」の3種類の教材データが用意されている。そして、感情推定システム20が第1章の学習をしている際の学習者1の感情を「理解できた」であると特定した場合にはその情報に基づいて学習ナビゲーション手段27は教材データベース35から第2章の学習データの中から「難」レベルの教材データを選択し、当該学習データを学習者1の学習者用パソコン3に送出する。そして、順次これを繰り返すことにより、学習者1に対してそのときの感情及びレベルに合わせた教材が提供されることになる。

【0066】

[実施の形態の効果]

本実施の形態によれば、人の表情変化の大小から感情推定の対象者を2つのグループに分け、更に推定に用いる顔特徴点を感情対で選択して推定を行うことにより、学習者の感情変化を従来よりも高い確率推定することができるという効果がある。また、体温などの生体情報を取得するためのセンサ等を利用者の身体に直接に取り付ける必要がないので利用者への負担が少なく実用性が高いと共に、顔画像のみでより信頼度の高い感情推定を行うことができるという効果がある。

【実施例】

【0067】

次に、本発明に係る感情推定システム及びそれを利用した学習システムの具体的な実施例について説明する。図16は実施例と従来手法(感情及び生体情報)による比較例の感情推定の結果を示す図である。尚、SとLのグループ分けは以下の通りである。

【0068】

初めに、推定基準量データベース31を構成するデータを取得するための被験者を23名(男性18名、女性5名)とし、その中でグループSは被験者10名(男性10名、女性0名)、グループLは被験者13名(男性8名、女性5名)である。一方、感情評価の対象となる学習者は、推定基準量データベース31を構成するデータを取得するための上記被験者を23名の対象者とは異なる学習者A、B、Cの3名(男性2、女性1名)である。

【0069】

(1)学習者A、B、C3名についてe−ラーニングを行った後、学習中の感情についてSD法による主観評価を実施し30秒間隔の主観感情を特定した。

(2)平均変化率算出手段21によって学習中の3名の学習者A、B、Cの画像解析をそれぞれ行い、顔特徴点平均変化率を算出した。得られた学習者A、B、C3名の評価データ数を表3に示す。

【0070】

【表3】

【0071】

(3)そして、判定手段23によって学習者A、B、Cのグループ分けを行った。その結果は以下のとおりである。

学習者A:女性(Sグループ)

学習者B:男性(Sグループ)

学習者C:男性(Lグループ)

【0072】

[結果]

本実施例における感情の推定結果と実際の学習者A、B、Cの感情との一致率の結果は、図16に示すように、「理解できた」が81.3%、「理解できない」が33.3%、「面白い」が100.0%、「つまらない」が100.0%、「集中している」が55.6%、「飽きている」が100.0%、「簡単」が80.0%、「難しい」が83.3%で、8感情の一致率の平均は77.1%であった。一致率の高い感情対は「面白い−つまらない」であり、一方、推定率の低い感情対は「理解できた−理解できない」であった。従来法の8感情の一致率は47.3%であり、本発明に係る感情推定システムによれば、従来手法による感情推定と比較して29.8%の一致率の向上が見られた。これは、被験者を顔特徴点の平均変化率の大小によってグループ分けしたこと、および、感情推定に用いる顔特徴点を感情対で選択することが一致率の向上の要因であると考えられる。

【0073】

以上の結果から以下の結論が得られた。

(1)推定感情と被験者の評価感情の比である全感情の一致率は、比較例が47.3%であるのに対し、実施例は77.1%であり、その有効性が確認された。

(2)e−ラーニング学習中の表情の変化率は、平均変化率の大きな被験者と小さな被験者が存在するが、顔の長さに対して平均1〜4%ほどの微小な変化である。

(3)肯定的な感情に伴う顔特徴点変化率は、否定的な感情を伴う変化よりも大きく、特に眉に対してy軸方向に一様な変化をする傾向が強い。

(4)顔特徴点平均変化率の分散及び平均値は、4つの感情対において約15名という少数の被験者で収束する傾向が確認された。

【0074】

このように、本発明に係る感情推定システム20によって特定した学習者1の感情は高い確率で正しく判断することが可能であり、また。感情推定システム20によって特定された感情に基づいて教材を提供する本発明に係る学習システム1は学習者1に対して適切な教材データを提供することが可能となる。

【0075】

なお、上記実施の形態においては、図2〜図12に示す処理は、サーバ6によって行うものとしたが、学習者用パソコン3によって処理する構成であってもよい。或いは、学習者パソコン3やサーバ6に接続された専用の感情推定システムを設ける構成であってもよい。

【0076】

また、インターネット8は会社等に設けられたLAN等の通信回線であってもよい。また、インターネット8やLAN等の通信回線を介することなく、サーバ6の機能を学習者用パソコン3において機能させるように構成することも可能である。

【産業上の利用可能性】

【0077】

感情推定の対象を公共サービスの利用者、相談者等にすることで、感情推定システムを学習システム以外の用途にも適用可能である。

【符号の説明】

【0078】

1 学習者

2 入力装置

3 学習者用パソコン

4 ディスプレイ

5 カメラ

6 サーバ

7 記憶装置

8 インターネット

10 学習システム

20 感情推定システム

21 平均変化率算出手段

23 判定手段

25 感情推定手段

31 推定基準量データベース

35 教材データベース

【特許請求の範囲】

【請求項1】

人の感情をその表情の変化に基づいて推定する感情推定システムにおいて、

被験者の表情の変化を撮影し、その表情の変化を顔画像データとして取得可能なカメラと、

前記カメラで撮影した前記被験者の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴ってそれぞれ移動した各変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段と、

複数の被験者における前記平均変化率算出手段によって算出した前記顔特徴点の平均変化率と、そのときの感情であってSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を相関の強弱に基づいて抽出し、抽出した前記顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行い、他方、各顔特徴点の前記平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に前記2つのグループ内のそれぞれの平均変化率の平均値及び分散共分散行列を算出して構成した推定基準量データベースと、

感情推定を行うための被感情推定者の表情を前記カメラで撮影して得られた顔画像データに基づいて前記平均変化率算出手段によって算出された当該被感情推定者の各顔特徴点の平均変化率から当該被感情推定者が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを前記所定の基準に基づいて判定する判定手段と、

前記判定手段によって判定された結果に基づいて前記推定基準量データベースのうち当該被感情推定者が属するとされたグループのデータを用いて当該被感情推定者の感情を推定する感情推定手段と、

を備えてなることを特徴とする感情推定システム。

【請求項2】

請求項1に記載の感情推定システムにおいて、

前記複数の異なる感情対は、「理解できた」及び「理解できない」からなる第1感情対と、「面白い」及び「つまらない」からなる第2感情対と、「集中している」及び「飽きている」からなる第3感情対と、「簡単」及び「難しいからなる」第4感情対の4つであることを特徴とする感情推定システム。

【請求項3】

請求項1又は2に記載の感情推定システムにおいて、

前記顔特徴点は、左右の眉の内と外及び左右の口端であり、

これらの顔特徴点について、頭頂と部顎を結んだ線分を基準線分とし、頭頂部中心に半径が基準線分長の1/2の円と、顎を中心に半径が基準線分長の√5/2の2つの円との交点のうち向かって左側の交点を原点とし、2つの交点を結ぶ直線をx軸とし、頭頂部から顎を結ぶ直線と平行且つ原点との交点を始点とする直線をy軸とした相対座標におけるx方向及びy方向のそれぞれ12点の平均変化率を算出することを特徴とする感情推定システム。

【請求項4】

請求項3に記載の感情推定システムにおいて、

前記相関行列は、前記12点のうちの顔特徴点の1つとその他の顔特徴点との相関から求めることを特徴とする感情推定システム。

【請求項5】

請求項1から4のいずれか1項に記載の感情推定システムにおいて、

前記感情推定手段は、前記被感情推定者の学習前の平静状態における顔特徴点の位置から学習中における前記顔特徴点の移動距離に基づいて当該顔特徴点の平均変化率を求めることを特徴とする感情推定システム。

【請求項6】

請求項1から5のいずれか1項に記載の感情推定システムにおいて、

前記平均変化率算出手段は、IQR(interquartile range)×3倍を超える値を除外する前処理を行い、さらに再度IQR×1.5倍以上3倍以下にある値を除く処理を行う外れ値除去手段を含んでなることを特徴とする感情推定システム。

【請求項7】

請求項1から6のいずれか1項に記載の感情推定システムにおいて、

前記感情推定手段は、前記感情対のそれぞれについてマハラノビス距離を算出した後、距離に過大な影響を与える固有値を除き、一致率の高い固有値に基づいて再度マハラノビス距離を比較し、距離の短い方のグループの感情に属すると判断することを特徴とする感情推定システム。

【請求項8】

請求項1から7のいずれか1項に記載の感情推定システムにおいて、

平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを判定するための所定の基準は、所定時間における前記顔特徴点の各平均変化率の95%が0.02を越えたか否かによることを特徴とする感情推定システム。

【請求項9】

請求項1から8のいずれか1項に記載の感情推定システムを備え、

予め各感情に合わせて作成した教材データを格納した教材データベースと、

前記感情推定システムによって推定された感情に合った教材データを前記データベースから検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段と、

を備え、学習者の感情に即した教材を提供することを特徴とする学習システム。

【請求項1】

人の感情をその表情の変化に基づいて推定する感情推定システムにおいて、

被験者の表情の変化を撮影し、その表情の変化を顔画像データとして取得可能なカメラと、

前記カメラで撮影した前記被験者の顔画像データから、予め複数選定した顔の所定部位である顔特徴点が表情の変化に伴ってそれぞれ移動した各変化量について所定時間当たりの平均値を平均変化率として算出する平均変化率算出手段と、

複数の被験者における前記平均変化率算出手段によって算出した前記顔特徴点の平均変化率と、そのときの感情であってSD法に基づく主観評価によって特定した感情との相関行列から感情推定に用いる複数の異なる感情対に対応する顔特徴点を相関の強弱に基づいて抽出し、抽出した前記顔特徴点の中からさらに各感情対で相関に差違が見られ且つ相関が強い顔特徴点を感情推定に用いるための顔特徴点として絞り込みを行い、他方、各顔特徴点の前記平均変化率の小さな被験者と大きな被験者とを所定の基準に基づいて相対的に2つのグループに分けると共に前記2つのグループ内のそれぞれの平均変化率の平均値及び分散共分散行列を算出して構成した推定基準量データベースと、

感情推定を行うための被感情推定者の表情を前記カメラで撮影して得られた顔画像データに基づいて前記平均変化率算出手段によって算出された当該被感情推定者の各顔特徴点の平均変化率から当該被感情推定者が平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを前記所定の基準に基づいて判定する判定手段と、

前記判定手段によって判定された結果に基づいて前記推定基準量データベースのうち当該被感情推定者が属するとされたグループのデータを用いて当該被感情推定者の感情を推定する感情推定手段と、

を備えてなることを特徴とする感情推定システム。

【請求項2】

請求項1に記載の感情推定システムにおいて、

前記複数の異なる感情対は、「理解できた」及び「理解できない」からなる第1感情対と、「面白い」及び「つまらない」からなる第2感情対と、「集中している」及び「飽きている」からなる第3感情対と、「簡単」及び「難しいからなる」第4感情対の4つであることを特徴とする感情推定システム。

【請求項3】

請求項1又は2に記載の感情推定システムにおいて、

前記顔特徴点は、左右の眉の内と外及び左右の口端であり、

これらの顔特徴点について、頭頂と部顎を結んだ線分を基準線分とし、頭頂部中心に半径が基準線分長の1/2の円と、顎を中心に半径が基準線分長の√5/2の2つの円との交点のうち向かって左側の交点を原点とし、2つの交点を結ぶ直線をx軸とし、頭頂部から顎を結ぶ直線と平行且つ原点との交点を始点とする直線をy軸とした相対座標におけるx方向及びy方向のそれぞれ12点の平均変化率を算出することを特徴とする感情推定システム。

【請求項4】

請求項3に記載の感情推定システムにおいて、

前記相関行列は、前記12点のうちの顔特徴点の1つとその他の顔特徴点との相関から求めることを特徴とする感情推定システム。

【請求項5】

請求項1から4のいずれか1項に記載の感情推定システムにおいて、

前記感情推定手段は、前記被感情推定者の学習前の平静状態における顔特徴点の位置から学習中における前記顔特徴点の移動距離に基づいて当該顔特徴点の平均変化率を求めることを特徴とする感情推定システム。

【請求項6】

請求項1から5のいずれか1項に記載の感情推定システムにおいて、

前記平均変化率算出手段は、IQR(interquartile range)×3倍を超える値を除外する前処理を行い、さらに再度IQR×1.5倍以上3倍以下にある値を除く処理を行う外れ値除去手段を含んでなることを特徴とする感情推定システム。

【請求項7】

請求項1から6のいずれか1項に記載の感情推定システムにおいて、

前記感情推定手段は、前記感情対のそれぞれについてマハラノビス距離を算出した後、距離に過大な影響を与える固有値を除き、一致率の高い固有値に基づいて再度マハラノビス距離を比較し、距離の短い方のグループの感情に属すると判断することを特徴とする感情推定システム。

【請求項8】

請求項1から7のいずれか1項に記載の感情推定システムにおいて、

平均変化率の小さなグループに属するか平均変化率の大きなグループに属するかを判定するための所定の基準は、所定時間における前記顔特徴点の各平均変化率の95%が0.02を越えたか否かによることを特徴とする感情推定システム。

【請求項9】

請求項1から8のいずれか1項に記載の感情推定システムを備え、

予め各感情に合わせて作成した教材データを格納した教材データベースと、

前記感情推定システムによって推定された感情に合った教材データを前記データベースから検索抽出し、画像や音声として出力デバイスを介して出力する学習ナビゲーション手段と、

を備え、学習者の感情に即した教材を提供することを特徴とする学習システム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【公開番号】特開2011−39934(P2011−39934A)

【公開日】平成23年2月24日(2011.2.24)

【国際特許分類】

【出願番号】特願2009−188598(P2009−188598)

【出願日】平成21年8月17日(2009.8.17)

【出願人】(000125369)学校法人東海大学 (352)

【Fターム(参考)】

【公開日】平成23年2月24日(2011.2.24)

【国際特許分類】

【出願日】平成21年8月17日(2009.8.17)

【出願人】(000125369)学校法人東海大学 (352)

【Fターム(参考)】

[ Back to top ]