映像フレーム内におけるスプリアス領域の識別

【課題】映像フレーム内におけるスプリアス領域の識別

【解決手段】

デジタル映像監視システムにおいて、映像シーケンスにおいて動いているオブジェクトを表す前景領域を識別するために幾つかの処理段階が採用される。現在のフレーム内の候補オブジェクトと1つ以上の以前のフレームにおいて既に識別されているオブジェクトとの間の対応性を識別するためにオブジェクト追跡段階5も提供される。この方法により、前記前景オブジェクト又は各前景オブジェクトによってとられる経路を計算すること及びこの経路情報を軌跡データベースに格納することが可能である。追跡性能を向上させるために、オブジェクト追跡段階5は、特定のオブジェクトを追跡すべきかどうかを決定する状態遷移オブジェクト管理方式を採用する。前記オブジェクト管理方式の一部として、動き上の特徴に基づいて識別されるスプリアスオブジェクトが前記システムから削除される。この削除は、例えばノイズ又はランダムな動きを表している可能性がある不要なアーティファクトの追跡に貴重な処理資源が浪費されないようにする。

【解決手段】

デジタル映像監視システムにおいて、映像シーケンスにおいて動いているオブジェクトを表す前景領域を識別するために幾つかの処理段階が採用される。現在のフレーム内の候補オブジェクトと1つ以上の以前のフレームにおいて既に識別されているオブジェクトとの間の対応性を識別するためにオブジェクト追跡段階5も提供される。この方法により、前記前景オブジェクト又は各前景オブジェクトによってとられる経路を計算すること及びこの経路情報を軌跡データベースに格納することが可能である。追跡性能を向上させるために、オブジェクト追跡段階5は、特定のオブジェクトを追跡すべきかどうかを決定する状態遷移オブジェクト管理方式を採用する。前記オブジェクト管理方式の一部として、動き上の特徴に基づいて識別されるスプリアスオブジェクトが前記システムから削除される。この削除は、例えばノイズ又はランダムな動きを表している可能性がある不要なアーティファクトの追跡に貴重な処理資源が浪費されないようにする。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、映像フレーム、特に映像シーケンスの一部を具備する映像フレーム内におけるスプリアス領域を識別するための方法及びシステムに関するものである。

【背景技術】

【0002】

デジタル映像処理は、広範な用途において用いられる。例えば、現代の映像監視システムは、映像内において動いているオブジェクトに関する情報を提供するためのデジタル処理技術を採用する。前記システムは、典型的には、直接リンク又はネットワークリンクを介してコンピュータシステムに接続されるビデオカメラを具備する。前記コンピュータシステムは、前記カメラから供給された映像データを処理及び解析するように構成されたソフトウェアを実行する。

【0003】

図1は、前記監視システムのソフトウェアレベルの段階を示すブロック図である。第1の段階1においては、最初のセグメントの映像データから背景モデルが学習される。前記背景モデルは、典型的には、相対的に静的な背景コンテンツを表す統計情報を具備する。この点に関して、背景シーンは、前景内のオブジェクトと比較して相対的に静止した状態になることが理解されるであろう。第2の段階3においては、前景抽出及び背景適合化が各着信映像フレームにおいて行われる。現在のフレームが背景モデルと比較され、現在のフレームのいずれの画素が前景領域を表し、いずれの画素が背景を表すかを推定する。背景モデルの小さい変化も更新される。第3の段階5においては、前景領域がフレーム間で追跡され、現在のフレーム内の前景領域と以前のフレーム内において追跡された前景領域との間において対応性が確立される。他方、例えば追跡されたオブジェクトのうちの1つ以上に関する挙動解析を行うことができるより高位のアプリケーション7が各前景領域の追跡歴を利用できるように軌跡データベースが更新される。

【0004】

各映像フレームを処理後は、背景モデルに関する有効性検査9が行われて依然として有効であるかどうかが決定される。取得されたシーンの有意な変化又は突然の変化は、第1の段階1に戻ることによる新たな背景モデルの初期設定を要求する場合がある。

【0005】

既知のインテリジェント映像システムが米国特許出願公開公報番号2003/0053659 A1において開示されている。既知の前景抽出・追跡方法が、"Learning Patterns of Activity using Real-Time Tracking", IEEE Transactions on Pattern Analysis and Machine Intelligence, Volume 22, No.8, August 2000(「リアルタイム追跡を用いた活動パターンの学習」、パターン解析及び機械知能に関するIEEE交渉 第22巻、No.8、2000年8月)においてスタウファー及びグリムソンによって開示されている。

【0006】

前景抽出段階3においては、いくつかの画素領域が実際には前景オブジェクトでないときに前景オブジェクトとして分類されるのが一般的である。例えば、映像シーンが、樹木上において前後に揺れ動く葉のような繰り返しの動きを含む場合は、前景抽出段階3は、これらの葉が実際には背景シーンの一部を形成するときに前記動いている領域を前景として分類することがある。さらに、映像データを取得、符号化及び復号するプロセスは、不可避的にノイズをシステムに導入することになる。このノイズは、前景抽出段階3の固有の動作によって前景として検出される可能性がある。本明細書においては、前記のような不正確に分類された画像領域が検討され、これらの画像領域はスプリアス領域と呼ばれる。

【発明の開示】

【発明が解決しようとする課題】

【0007】

映像フレーム内の前記スプリアス領域を識別することが望ましい。この方法により、真の対象領域に関して実行することが意図されている後続の処理ステップのためにこれらのスプリアス領域を無視することが可能である。例えば、オブジェクト追跡段階5は真の前景領域のみに関して動作することが望ましい。映像処理システムは、反復性の動き又はノイズを表す領域の追跡を試みることによって、ユーザーにとって重要でないデータに関して貴重な処理及びメモリ資源を浪費する。

【課題を解決するための手段】

【0008】

本発明の第1の側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法が提供され、前記方法は、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、(ii)前記領域が予め決められた数の後続フレームにおいて現れるかどうかを決定し、前記現れる場合は、前記予め決められた数のフレームにおける前記領域の位置の変化を示す動きパラメータを前記領域に割り当てることと、(iii)前記動きパラメータをしきい値と比較して前記領域を追跡すべきかどうかを決定することと、(iv)前記領域を追跡すべきである場合は、前記領域が識別される後続フレームに関する前記領域のフレーム位置を記録すること、とを具備する。

【0009】

本発明の好ましい特長が、本明細書に添付される従属請求項において定義されている。

【0010】

本発明のさらなる側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法が提供され、前記方法は、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、(ii)前記複数の映像フレームにおける動き上の特徴に基づいて動きパラメータζmを前記領域に割り当てることと、(iii)前記領域が識別される前記映像シーケンスの後続フレームに関して、前記動きパラメータが予め決められたしきい値Tζを下回る場合のみに前記領域のフレーム位置を記録すること、とを具備する。

【0011】

本発明のさらなる側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを選択的に追跡するための映像処理システムが提供され、前記システムは、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別し、(ii)前記領域が予め決められた数の後続フレーム内において現れるかどうかを決定し、前記現れる場合は、前記予め決められた数のフレームにおける前記領域の位置の変化を表す動きパラメータを前記領域に割り当て、(iii)前記動きパラメータをしきい値と比較して前記領域を追跡すべきかどうかを決定し、(iv)前記領域を追跡すべきである場合は、前記領域が識別される後続フレームに関して前記領域のフレーム位置を記録するように構成される。

【0012】

本発明のさらなる側面により、映像シーケンスの一部を具備する映像フレーム内のオブジェクトを分類する方法が提供され、前記方法は、(a)第1のフレーム内の第1のオブジェクトを識別して複数の予め決められた状態のうちの1つを有する状態パラメータと関連づけることであって、各状態は関連づけられた異なる遷移規則を有することと、(b)後続フレーム内の少なくとも1つの候補オブジェクトを識別することと、(c)前記候補オブジェクト又は各候補オブジェクトを前記第1のオブジェクトと比較して両オブジェクト間に対応性が存在するかどうかを決定することと、(d)前記関連づけられた遷移規則に従って前記第1のオブジェクトの前記状態パラメータを更新することであって、前記遷移規則は、ステップ(c)において対応性が識別されたかどうかに依存して前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移すべきであるかを示すこと、とを具備する。

【0013】

オブジェクトが特定の状態にあると分類することによって、前記オブジェクトを追跡すべきであるかどうかを決定することが可能である。後続フレーム内の候補オブジェクトと比較後に、前記オブジェクトと関連づけられた予め定義された規則が適用されて前記オブジェクトの更新された状態が決定される。前記更新された状態は、例えば、前記オブジェクトが新しいこと、真のオブジェクトであること、隠されていること又は前記後続フレームから消えていることを反映させることができ、このため、次のフレームを受信時に適切な規則を適用することができる。

【0014】

前記方法は、前記映像シーケンスの複数の後続フレームに関する繰り返しステップ(b)乃至(d)をさらに具備することが可能である。

【0015】

状態と関連づけられた遷移規則は、ステップ(c)において対応性が識別されない場合に状態パラメータに現在の状態を維持させることができる。状態パラメータは、新しい状態又は真の状態を有することができ、新しい状態と関連づけられた遷移規則は、ステップ(c)において対応性が識別された場合に状態パラメータが真の状態に変更されるようにすることができる。前記方法は、状態パラメータが真の状態にあるときのみに第1のオブジェクトと対応する候補オブジェクトとの間における位置変化を記録することをさらに具備することができる。

【0016】

前記状態パラメータは、ステップ(c)において複数の順次フレームにおける対応性が識別された場合のみに真の状態に変更することができる。

【0017】

前記状態パラメータは、(i)ステップ(c)において対応性が識別され、(ii)前記オブジェクトの抽出された位置上の特徴が予め決められた判定基準を満たしている場合のみに前記真の状態に変更することができる。ステップ(ii)は、複数の映像フレームにおける位置上の特徴に基づいて動き率ζmを第1の領域に割り当てることと、前記動き率が予め決められたしきい値Tζを下回る場合に前記予め定義された判定基準を満たしているとして前記第1のオブジェクトを分類すること、とを具備することができる。

【数2】

【0018】

ここで、σcx2及びσcy2は、x方向及びy方向のそれぞれにおける第1のオブジェクトの位置分散である。σvx2及びσvy2は、x方向及びy方向のそれぞれにおける速度分散であり、τは、予め決められた定数である。

【0019】

前記方法は、前記後続フレーム内の対応する候補オブジェクトを、前記第1のオブジェクトと前記対応する候補オブジェクトとの間における記録された位置変化を示すオーバーレイされた経路ラインとともに表示することをさらに具備することができる。

【0020】

前記状態パラメータは、隠された状態を有することも可能であり、真の状態と関連づけられた前記遷移規則は、ステップ(c)において対応性が特定されずさらに前記第1のオブジェクトが同じフレーム内に現れる異なる対象領域とオーバーラップする場合に前記状態パラメータを前記隠された状態に変化させる。

【0021】

前記方法は、第1のオブジェクトの外観特徴fioを表す第1の組のデータを提供することと、後続フレーム内の前記候補領域又は各候補領域に関して、前記各々のオブジェクトの外観特徴fibを表す第2の組のデータを抽出することと、前記第1の組の外観データをコスト関数Cob内の前記第2の組の又は各々の第2の組の外観データと結合させそれによって前記第1のオブジェクトと前記新しい候補領域又は各々の新しい候補領域との間対応戸を示す数値パラメータを生成することを具備するステップ(c)と、をさらに具備することができる。

【0022】

コスト関数は、次式によって与えることができる。

【数3】

【0023】

ここで、fioは、第1のオブジェクトの外観特徴を表し、fioは、候補領域の外観特徴を表し、σi2は、予め決められた数のフレームにおけるfioの分散であり、nは、第1及び第2のデータセット内の外観特徴数である。

【0024】

前記第1のオブジェクト及び候補オブジェクトの外観特徴は、前記オブジェクト及び候補オブジェクトのフレーム位置に関連する特徴と、前記オブジェクト及び候補オブジェクトの形状に関連する特徴と、を含む。ステップ(c)において対応性が識別された場合は、前記第1のオブジェクトの外観特徴fioは、前記第1のオブジェクトが対応する前記候補オブジェクトの外観特徴fibを用いて更新することができる。

【0025】

本発明のさらなる側面により、コンピュータによって読み取り可能な媒体に格納され、(a)第1のフレーム内において第1のオブジェクトを識別し、各々の状態が関連づけられた異なる遷移規則を有する複数の予め決められた状態のうちの1つを有する状態パラメータと関連づけるステップ、(b)後続フレームにおいて少なくとも1つの候補オブジェクトを識別するステップ、(c)前記候補オブジェクト又は各候補オブジェクトを前記第1のオブジェクトと比較して両オブジェクト間に対応性が存在するかどうかを決定するステップ、及び(d)前記関連づけられた遷移規則に従って前記第1のオブジェクトの状態パラメータを更新するステップであって、前記遷移規則は、ステップ(c)において対応性が識別されたかどうかに依存して前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移させるべきであるかを示すステップ、をコンピュータに実行させるための一組の命令を具備するコンピュータプログラムが提供される。

【0026】

本発明のさらなる側面により、映像シーケンスのフレームを受信するための入力部と、1つ以上のフレームにおいて識別されたオブジェクトを表すデータ、及び各オブジェクトと関連づけられ、複数の予め決められた状態のうちの1つを表す状態パラメータを格納するように構成されたオブジェクト待ち行列と、複数の予め決められた状態のうちの1つを表す状態パラメータと、1つ以上の候補オブジェクトを有するフレームを受信しさらに前記候補オブジェクト又は各候補オブジェクトが前記オブジェクト待ち行列内の各オブジェクトとマッチするかどうかを決定するように構成された映像解析手段と、前記オブジェクトの状態パラメータの状態に対応する遷移規則に従って前記オブジェクト待ち行列内の各オブジェクトの状態パラメータを更新するように構成された状態遷移コントローラであって、前記遷移規則は、前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移させるベきかを示す状態遷移コントローラと、を具備する映像処理装置が提供される。

【0027】

本発明のさらなる側面により、映像フレームにおいて識別された1つ以上のオブジェクトを表す情報を格納する映像処理システムとともに用いるための状態遷移データベースが提供され、各オブジェクトは、複数の予め定義されたオブジェクト状態のうちの1つに分類され、前記データベースは、各々のオブジェクト状態に関する複数の異なる遷移規則を定義し、前記遷移規則は、前記オブジェクトが後続フレーム内において現れるオブジェクトとマッチされているかどうかに依存して前記オブジェクトが遷移される2つ以上の更新状態を定義する。

【0028】

次に、本発明は、例を用いて添付図を参照しつつ説明される。

【発明を実施するための最良の形態】

【0029】

図2に関して、インテリジェント映像監視システム10は、カメラ11と、パーソナルコンピュータ(PC)13と、映像モニター15と、を具備する。カメラ11は、ウェブカメラ、例えばLogitec(登録商標)Pro4000カラーウェブカムである。デジタル画像データを出力する能力を備えたあらゆる型のカメラ、例えば、デジタルカムコーダー又はアナログーデジタル変換手段を有するアナログカメラ、を用いることが可能である。ウェブカメラ11は、ネットワーク14を通じてPC13と通信し、ネットワーク14は、ローカルエリアネットワーク(LAN)又はインターネット等のあらゆるネットワークであることができる。実際には、ウェブカメラ11及びPC13は、デジタル加入者ライン(DSL)モデム等の各々のネットワーク接続(図示されていない)を介してネットワーク14に接続される。代替として、ウェブカメラ11は、PC13のユニバーサルシリアルバス(USB)ポート12によって直接PC13に接続することができる。PC13は、あらゆる標準的なコンピュータを具備することができる。この場合は、PC13は、1GHzのプロセッサ、512メガバイトのランダムアクセスメモリ(RAM)、及び40ギガバイトのハードディスクドライブを有するデスクトップコンピュータである。映像モニター15は、標準の映像コネクタによってPC13に接続される17”薄膜トランジスタ(TFT)モニターである。

【0030】

PC13のハードディスクドライブにおいて映像処理ソフトウェアが提供される。前記ソフトウェアは、ウェブカメラ11から受け取られた映像データに関する幾つかの処理作業を行うように構成される。前記映像データは、取得された映像の個々のフレームを表し、各フレームは、複数の画像要素、すなわち画素から成る。この実施形態においては、各フレームは、320画素(幅)×240画素(高さ)の表示フォーマットを有する。用途に依存して代替表示フォーマットを用いることができる。ウェブカメラ11は、カラーのカメラであるため、各画素は、フレーム内における前記画素の位置を示すデータ、及び表示される色を決定する3つの色成分、すなわち、赤、緑及び青の各成分、の各々の重み付けによって表される。当業において理解されるように、所定の画素の輝度Yは、次式によって概算することができる。

【0031】

Y = α.R + β.G + γ.B (1)

ここで、α = 0.114、β = 0.587、及びγ = 0.299である。

【0032】

R、G及びBは、赤、緑及び青の色成分をそれぞれ表す。Yに関する代替方程式が知られているが、本発明の出願者は、上式が好ましいことを発見している。

【0033】

前記映像処理ソフトウェアは、図3に示されるように、幾つかの段階を具備する。図3は、図1に類似し、影除去段階17及びオブジェクト特徴付け段階18が追加され、両段階は、前景抽出段階3とオブジェクト追跡段階5との間に組み込まれている。

【0034】

影除去段階17の目的は、各映像フレームから影を除去して領域を強調することである。この方法で、前景領域の形状を識別する後続処理段階は、向上された信頼性を持って動作することができる。影除去段階17を含めることは、本発明にとって不可欠でないが、向上された動作を提供するのに役立つ。

【0035】

オブジェクト特徴付け段階18の目的は、映像フレーム内において識別された各前景領域に関するいわゆる特徴セットを抽出することである。前記特徴セットは、現在の映像フレーム内のオブジェクトを以前の映像フレームにおいて識別されたオブジェクトとマッチングさせるために後続ステップにおいて用いられる複数の予め決められた特徴を具備する。

【0036】

背景学習

前記映像処理ソフトウェアは、最初に、背景学習段階1を実行する。この段階の目的は、最初のセグメントの映像データから背景モデルを構築することである。この映像セグメントは、典型的には100のフレームを具備する。画像の背景シーンは、(前景オブジェクトと比較して)相対的に静止した状態になる可能性が高いため、この段階は、前景オブジェクトが見えるべきでない背景モデルを構築する。

【0037】

図4は、背景モデル19を示す。この場合は、ウェブカメラ11は、駐車場の方に向けられていた。PC13のメモリ内において、背景モデル19は、画素の位置を表す一組の格納データ、及び各画素の赤、緑及び青の色成分の各々の重み付けによって表される。

【0038】

背景モデル19を構築した後は、着信映像フレームがPC13によって受け取られ、前記映像処理ソフトウェアによって処理される。後続する前景抽出段階3、影除去段階17、オブジェクト特徴付け段階18、オブジェクト追跡段階5、及び高位アプリケーション7は、映像フレームをリアルタイムで処理する。

【0039】

前景抽出及び背景適合化

前景抽出及び背景適合化段階3(以下「前景抽出段階」と呼ばれる)は、現在のフレームの各画素を解析する。各画素は、背景モデル19内の対応する位置を占る画素と比較され、現在のフレームの画素が前景オブジェクト又は背景の一部を表すかどうかを推定する。背景モデル19の小さい変化は、動的に更新される。背景モデル19のより激しい変化又は突然の変化は、参照数字9によって示される試験を用いて実行される再学習動作を要求する。

【0040】

前景抽出段階3の詳細な説明は、本発明について理解する上で不可欠ではないが、当業者は、前景抽出3を実行するための既知の方法が存在することを理解するであろう。おそらく最も単純な方法は、各画素の輝度を背景モデル19内の対応位置を占める画素の輝度と比較することである。前記2つの画素間の差が予め決められたしきい値を超える場合は、現在の画素は、前景画素として分類される。

【0041】

特に有効な方法は、'Learning Patterns of Activity Using Real-Time Tracking', IEEE Transactions on Pattern Analysis and Machine Intelligence, Volume 22, No.8, August 2000, pp. 747-757(「リアルタイム追跡を用いた活動パターンの学習」、パターン解析及び機械知能に関するIEEE交渉、第22巻、No.8、2000年8月、747乃至757頁)においてスタウファー及びグリムソンによって説明されるいわゆるガウス混合(MoG)方法である。前記MoG方法の実装は、米国特許出願開示公報番号2003/0053658においても説明されている。背景モデルを構築するため及び前景抽出を行うためのさらなるMoG方法が、出願者の同時係属英国特許出願番号0425937.0において開示されている。この英国特許出願、又は外国の同等物の完全な内容は、本明細書によって参照されることによって本明細書に組み入れられる。すべての参照は、上記背景モデル19を構築するために適した背景学習方法を説明する。

【0042】

要約すると、前記MoG方法は、着信映像フレームの各画素を異なるガウス(又は正規)統計分布の組合せとしてモデル作成することを含む。このことは、同じシーンポイントのサンプルはガウス雑音分布を示す可能性が高いという仮定を反映させたものである。正規分布の組合せは、2つ以上のプロセスを経時で観測できるという予想を反映させたものである。前記組合せの各々の分布の永続性及び分散に基づき、いずれの分布が現在の背景に対応するかが決定される。背景分布に適合しない画素は、確実に対応しさらに幾つかのフレームにわたって築き上げられた一貫した証拠によって裏付けられた分布が存在するまでは前景画素として分類される。

【0043】

本明細書において説明される実施形態の場合は、前景抽出段階3は、好ましいことに、前記MoG方法を用いて動作する。しかしながら、この動作は、絶対に不可欠であるわけではなく、代替方法を用いることが可能である。

【0044】

前景抽出段階3の動作は、ウェブカメラ11からの着信映像フレーム21を示す図5を参照することによってより良く理解される。映像フレーム21は、(a)駐車場を横切って歩いている人23、及び(b)駐車場の下方部分を横切っている車両を描写する。映像フレーム21の各画素が背景モデル19内の対応する画素と比較され、前記各画素を前景画素又は背景画素のいずれとして分類すべきかが決定される。その結果、前景抽出段階3は、前景マスクを生成する。マスクは、各画素の分類、すなわち前景又は背景のいずれを表すかに関する情報を含む一組の画像データである。図6に関して、前景マスク27のビジュアル表示が示されており、前景画素が白で示され、背景画素が黒で示される。

【0045】

前景マスク27は、第1及び第2の前景領域29、31を含む。しかしながら、いずれの前景領域29、31も、その形状に関して特に適切には定義されておらず、実際にはいずれの前景オブジェクトが表されているかを前景マスク27のみを用いて決定するのは困難である。この原因は、図5に示されるように、人23及び車両25が背景上に落としている影である。前記影を表す画素は、背景モデル19内の対応する位置を占めている画素よりも暗い強度を有している。従って、これらの画素は、誤って前景画素として分類されている。強調の存在も同様の問題を引き起こす可能性がある。

【0046】

影及び強調の結果、後続する処理段階において問題が発生する可能性がある。例えば、オブジェクト特徴付け段階18が前景抽出段階3から直接前景マスク27を受け取る場合は、前景オブジェクトの一定の特徴を識別することが難しい場合がある。オブジェクト追跡段階5は、現在のフレーム内の前景オブジェクトと以前のフレームにおいて追跡された前景オブジェクトとの間で対応させるのが難しい場合がある。各々のマスクプロフィールがいずれの「実世界」のオブジェクトに類似するかに従ってオブジェクトが分類されるオブジェクト分類段階を映像監視システム10が含む場合も同様の問題が発生する可能性がある。

【0047】

上記の問題を軽減するため、前記映像処理ソフトウェアは、影除去段階17を含む。

【0048】

影除去

図7は、影除去段階17の主な機能上の要素を示す。弱影除去32と強影除去33を具備する2つの分枝を有するプロセスが採用される。両方とも前景マスク27に関して並行して動作し、更新マスク及び部分的領域マスクをそれぞれ生成する。

【0049】

並行動作は本発明にとって不可欠でないことを理解すべきである。しかしながら、このリアルタイム映像監視システム10の目的上は並行動作が好ましい。

【0050】

弱影除去32の目的は、現在のフレーム内に存在する最も重大な影のみを除去することである。実際には、幾つかの非常に区別しやすい影のみが存在すると仮定される。しかしながら、フレームは、現実的には強度が異なる幾つかの影を有する可能性があるため、弱影除去32だけでは不十分になる。その結果、幾つかの画素は依然として誤って前景画素として分類される可能性がある。

【0051】

逆に、強影除去33の目的は、現在のフレーム内に存在する実質的にすべての影を除去することである。その結果、一部の真の前景エリアが誤って影領域として検出される可能性がある。自己の上に影、いわゆる自己影、を作っているオブジェクトは特に脆弱である。例えば、人間の顔を示しているフレームは、鼻によって頬の上に作られた自己影領域を含む場合がある。強影除去33は、この領域の画素が実際には前景オブジェクト、すなわち顔の一部を形成しているにもかかわらずこの自己影領域を除去させてしまう。その結果は、通常は、同じオブジェクトの各部分が互いに切り離されているように見える断片化された画像になる。後続する処理ステップは、各断片を別個のオブジェクトとして解釈してしまう可能性がある。

【0052】

影除去段階17は、弱影除去29及び強影除去30の両方からの出力を用いていわゆるオブジェクト分類マスクを生成する。前記オブジェクト分類マスクは、部分的領域マスクを具備し、前記部分的領域マスクは、前景オブジェクト形状の改良された表現を、断片化されたオブジェクト部分が共通のオブジェクトに属するものとして適宜分類されるようにするための追加の分類情報とともに提供する。前記を達成させるために、弱影除去32に続く更新マスクにおいて、コネクテッドコンポーネントアナリシス(CCA)動作34が採用される。前記CCA動作は、前景オブジェクト形成段階35に送られるオブジェクトマスクを生成する。CCA段階34及び前景オブジェクト形成段階35の動作が以下において説明される。

【0053】

CCA動作34の目的は、更新された前景マスク内の1つ以上のクラスタの画像画素を識別することである。1つのクラスタは、1つ以上の隣接する画素、又は連結された画素を具備することができる。各クラスタを囲んでいる最小の長方形のエリアの輪郭を定める境界が、ソフトウェアによって自動的に確定される。フレーム上における各長方形エリアの位置が第1の更新マスクに加えられてオブジェクトマスクが形成される。

【0054】

上記のプロセスについて説明するために、図6に示される前景マスク27が影除去段階17に現在入力されると仮定する。図8aは、弱影除去32の結果から得られた更新された前景マスク36を示す。予想されるように、幾つかの影が除去されているが、各オブジェクト29’、31’の形状は引き続き輪郭が不明確な状態である。図8bは、CCA段階34によって生成され、各クラスタ29’及び31’を囲む長方形の境界が加えられているオブジェクトマスク37を示す。

【0055】

図8cは、強影除去33が行われた後の部分的領域マスク38を示す。各オブジェクト29’’、31’’の形状がより明確になっていることがわかるであろう。しかしながら、強影除去33は、不可避的に、一部の前景画素が背景画素として不正確に分類されており、さらに各オブジェクトが幾つかの別個の部分に断片化されている。

【0056】

前景オブジェクト形成段階35において、オブジェクトマスク37及び部分的領域マスク38が比較され、部分的領域マスク38においてオブジェクトマスク37の共通する長方形エリア内に位置する前景画素が識別される。共通の長方形エリア内にあるすべての前景画素は、同じ前景オブジェクトに属するとして分類される。これらの2つの長方形エリアの各々は、ブロブマスクと呼ばれる。

【0057】

上述されるように、前景オブジェクト形成段階35によって生成された出力は、オブジェクト分類マスク39と呼ばれる。オブジェクト分類マスク39は、強影除去33を用いて前景オブジェクトの改良された形状の表示を提供する。前景領域の断片化に起因する潜在的問題は、所定の境界領域内に入る各部分に共通のアイデンティティを割り当てることによって回避され、前記境界領域の大きさは、弱影除去32によって決定される。図8dは、オブジェクト分類マスク39をビジュアル的に表した図であり、前景オブジェクト形成段階35の結果得られた2つのブロック部マスクを含む。

【0058】

CCA段階34及びオブジェクト形成段階35の動作原理は、図8e乃至8hを参照することによってより良く理解される。図8eは、弱影除去32後における前景マスクの大写し部分を示す。単一の前景画素クラスタが存在する。図8fは、CCA段階34によって生成されたオブジェクトマスクの大写し部分を示す。CCA段階34は、各前景画素を囲む上で十分な大きさの長方形の境界の輪郭を定めている。図8gは、強影除去33後における部分的領域マスクの大写し部分を示す。単一の前景画素クラスタではなく、2つの別個のクラスタが存在する。図8hは、前景オブジェクト形成段階35後におけるオブジェクト分類マスクの大写し部分を示す。部分的領域マスク内においてCCA段階34によって定められた長方形の境界内にあるすべての前景画素は、共通する前景領域を表すとして分類されている。

【0059】

ソフトウェアレベルの動作を含む影除去段階のさらなる詳細が、出願者の同時係属英国特許出願番号0424030.5において開示されている。この英国特許出願、又は外国の同等物の完全な内容は、本明細書によって参照されることによって本明細書に組み入れられる。

【0060】

オブジェクト追跡

映像処理ソフトウェアに関するこれまでの説明は、着信映像フレーム内において存在する可能性がある前景領域を識別するように及び影及び強調の影響を影除去段階17によって軽減するように構成された段階に集中している。本節は、後続する段階、すなわちオブジェクト追跡段階5の動作について説明する。

【0061】

影除去段階17からの出力は、オブジェクト分類マスクを表す映像データであり、前記オブジェクト分類マスク自体は、可能性のある(又は「候補」の)前景オブジェクトの形状を各々が表す1つ以上のブロブマスクを具備することができる。図8dに示されるオブジェクト分類マスク39においては、人及び車両の形状をそれぞれ表す2つのブロブマスク29A、29Bが存在する。オブジェクト追跡段階5は、現在のフレーム内のブロブマスクと1つ以上の以前のフレームにおいて既に識別されているブロブマスクとの間における対応性を識別するように構成される。このような方法で、前記前景オブジェクト又は各前景オブジェクトによってとられる経路を計算すること及びこの経路情報を軌跡データベースに記録することが可能である。前記経路情報は、映像モニター15において表示すること及び/又は例えばオブジェクトによってとられる経路に基づく挙動解析を行うように構成される高位アプリケーション7が利用できるようにすることが可能である。

【0062】

オブジェクト追跡原理が図9に示される。図9のaに関して、第1及び第2のオブジェクト130,132が第1のフレーム内に示され、各々のオブジェクトのフレーム位置がデカルト座標によって示されている。図9のb及び図9のcは、映像シーケンスの第2及び第3の連続フレーム内の第1及び第2のオブジェクト130、132を示す。両オブジェクト130、132は、各フレーム内での位置を変えており、オブジェクトの動きを示していることがわかるであろう。後述されるオブジェクト追跡段階5においては、各オブジェクト130、132によってとられる軌跡ベクトルが計算され、表示された軌跡ベクトルによって経路が表される。図9のd及び図9のeは、第2及び第3のフレームをそれぞれ受け取り後における各オブジェクト130、132と関連する経路を示す。図9のeは、これらの3つのフレームに関する累積経路を示す。計算された軌跡ベクトルを表すデカルト座標も示される。

【0063】

各ブロブマスクを追跡するためには、最初に、現在のフレーム内のブロブマスクと以前のフレーム内において識別されたブロブマスクとの間において対応性、すなわちマッチ性を確立させる必要がある。説明を明確化するため、以前のフレームにおいて識別されているブロブマスクは、以下では「オブジェクト」と呼ばれる。以下において詳細に説明されるように、ブロブマスクとオブジェクトの各組合せにマッチングコストCobが割り当てられ、前記コストは、各対間におけるマッチ度を示す。マッチングコストCobは、特徴に基づく対応性測定基準を用いて計算される。当業者によって理解されるように、特徴に基づく対応性測定基準は、複数の特徴を各オブジェクトから抽出することと、コスト関数においてこれらの特徴を用いて着信ブロブマスクとのマッチを識別すること、とを含む。代替として、テンプレートに基づく対応性測定基準を用いることが可能であり、この方法は、例えばヒストグラム又はカラーブロックの形の外観テンプレートを採用し、さらに、着信ブロブマスクが各テンプレートと比較されてマッチが見つけ出される。ブロブマスク及びオブジェクトの数が増加するのに従って、テンプレートに基づく方法は時間がかかる傾向があり、この理由のため、特徴に基づく方法が好ましい。

【0064】

特徴に基づく対応性方法における第1の段階は、着信フレームの各ブロブマスクから予め決められた特徴を抽出することである。この抽出は、図3に示されるように、オブジェクト特徴付け段階18によって行われる。複数の特徴は、各ブロブマスクと関連づけられた「特徴セット」を具備する。表1は、前記特徴セットの特徴を示し、これらの特徴は、比較動作において適切な結果を提供する特徴を識別するための広範な実験後に選択されたものである。これらの特徴は、4つの主な組、すなわち、位置、形状、色及びベクトルの各特徴に分類される。以下において説明されるように、右側の列は、位置特徴更新プロセスにおいて採用されるカルマンフィルタアルゴリズムに関連する。

【0065】

表1.オブジェクト特徴付け段階18によって抽出された特徴セット

【表1】

【0066】

図10に関して、ブロブマスク41の位置特徴が示されている。中心位置特徴43は、ブロブマスク41の質量/重力の中心である。バウンディングボックス45及びオブジェクトバウンディング楕円47も示されており、後者は、円周内の全画素を囲む上で十分な大きさである。バウンディングボックス45は、ブロブマスク41のすべての前景画素を囲む最小の長方形である。残りの特徴については自明である。

【0067】

各ブロブマスクに関する特徴セットを生成後は、各特徴セットがオブジェクト追跡段階5によって受信される。次に、図11を参照してオブジェクト追跡段階5の動作が説明される。

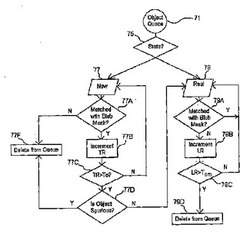

【0068】

図11に示されるように、オブジェクト追跡段階5は、幾つかの副段階55、57、59、63、65を具備する。第1の副段階55においては、上記のマッチングコストCobが、オブジェクト待ち行列に格納された(a)着信ブロブマスクと(b)オブジェクトの各組合せに関して計算される。オブジェクト待ち行列は、以前のフレーム、より正確には予め決められた数の以前のフレー、において識別されているオブジェクトに関連するデータを保持する。図12に関して、オブジェクト待ち行列71が表されている。各オブジェクトと関連づけられた特徴セットを格納することに加えて、状態パラメータ、追跡レコードパラメータ(TR)及び失われたレコードパラメータ(LR)を含むその他の幾つかのパラメータも存在することが注記される。

【0069】

第2の副段階57においては、ブロブマスクとオブジェクトとの間のマッチが識別される。第3の副段階59においては、オブジェクト待ち行列71が、前段階の結果に基づいて更新される。この更新は、マッチされたオブジェクトの位置以外の特徴の代わりに、マッチしたブロブマスクの対応する特徴を用いることが含まれる。位置特徴は、第3の副段階59においては更新されない。第4の副段階63においては、オブジェクト待ち行列71内の各オブジェクトと関連づけられた状態パラメータを、状態遷移オブジェクト管理方式を用いて更新することができる。前記状態遷移オブジェクト管理方式は、幾つかの特徴に基づいてオブジェクトの状態を決定する一組の規則を具備する。オブジェクトの状態は、前記オブジェクトを追跡又は削除するか、又はその状態パラメータを変更すべきかを決定する。前記状態遷移管理方式の一部として、ユーザーにとって重要である可能性がある真の前景オブジェクトではなくスプリアスオブジェクトを表しているかどうかを決定するためにオブジェクトを検査することも可能である。第5の副段階65においては、オブジェクト特徴予測は、マッチされたオブジェクトの位置特徴をカルマンフィルタアルゴリズム(後述される)を用いて更新する。オブジェクト待ち行列71が第1の副段階55に戻され、次のブロブマスクの組に関するマッチングコスト計算が、オブジェクト待ち行列内の各オブジェクトに関する前記更新された特徴セットを用いて行われる。

【0070】

上述されるように、第5の副段階65において、カルマンフィルタアルゴリズムは、オブジェクト待ち行列71内のマッチされたオブジェクトの位置特徴を更新する。より具体的には、前記アルゴリズムは、次のフレームの3つの位置特徴の各々の値を予測する。この予測は、オブジェクト待ち行列71内のオブジェクトを(動きに起因して)前記フレーム内の異なる位置を占める可能性がある着信ブロブマスクと成功裡に一致させるためには、第1の副段階55においてマッチングコスト計算を行う前に位置特徴を予測及び更新するのが有利であるという事実を反映したものである。カルマンフィルタアルゴリズムは、仮想処理システムにおいて共通して用いられる反復性アルゴリズムであり、その概念は、当業者によって良く理解されるはずである。カルマンフィルタに関するさらなる情報が、グレッグ・ウェルチ及びゲーリー・ビショップによる"An Introduction to the Kalman Filter", SIGGRAPH 2001 Course 8, Computer Graphics, Annual Conference on Computer Graphics & Interactive Techniques, ACM Press, Addison-Wesley, Los Angeles, California, USA, August 2001 Course Pack(「カルマンフィルタ入門」、SIGGRAPH 2001 課程8、コンピュータグラフィックス、コンピュータグラフィックス及び対話技術に関する年次会議、ACMプレス、アディソン−ウェズレイ、ロサンゼルス、カリフォルニア、米国、2001年8月コースパック)において開示されている。この文書は、現在は、http://www.cs.unc.edu/−tracker/media/pdf/SIGGRAPGH2001 CoursePack 08.pdfにおいて入手可能である。

【0071】

表1の右側の列に関して、中心位置特徴(xco, yco)は、2次カルマンフィルタを用いて予測されることが注記される。このことは、各ブロブに関する速度特徴(vx0, vy0)を予測するのを可能にする。速度特徴(vxo, vyo)は、中心位置特徴の第1の導出関数であり、第4の副段階63において採用される状態遷移オブジェクト管理方式において用いられる。

【0072】

特徴セットの残りの位置以外の特徴は、第3の副段階59において、現在の値を、これらの特徴がマッチするブロブマスクの対応する特徴値に代えることによって更新される。カルマンフィルタリングプロセスは、計算集中型であるため、メモリ及び処理電力を節約するのに役立つ。

【0073】

次に、上述される副段階の各々がさらに詳細に説明される。

【0074】

第1の副段階55においては、以下の測定基準を用いてマッチングコスト関数Cobが各ブロブマスクに割り当てられる。

【数4】

【0075】

この測定基準は、一般的にはマハラノビスの距離測定基準と呼ばれ、オブジェクト待ち行列71内に格納されたブロブマスク特徴セットfib及びオブジェクト特徴セットfioからのすべての特徴を結合させて1つの好都合なコスト関数Cobにする(ここで、共分散行列は単位行列であると仮定されている)。パラメータσは、以前の観測に関して計算されたfioの標準偏差である。以前の観測数は50のフレームであるのが好ましいが、初期状態においては、前記標準偏差は、明らかに、50のフレームが受信されるまでより少ない観測を用いる。コスト関数Cobの値が低いほど、ブロブマスクとオブジェクトとの間のマッチがより優れている。

【0076】

コスト関数Cobは、(a)現在のフレーム内のブロブマスク及び(b)オブジェクト待ち行列71内に格納されたオブジェクトの各組合せに関して計算される。この動作は、図13において例示されており、前記図は、オブジェクト待ち行列71及び3つのブロブマスクと関連する特徴セットリスト72の両方を示す。これらのブロブマスクは、A、B及びCのラベルが貼付され、オブジェクトは、D、E及びFのラベルが貼付される。図12に示されるように、第1の副段階55からの出力は、各対の結果を示す格子として表すことができる「対応リスト」である。表2(下表)は、3つのブロブマスクA、B及びC、及び3つのオブジェクトD、E及びFを格納するオブジェクト待ち行列を有する着信フレームが関わるマッチングコスト計算に関する典型的対応リストである。格子内の数字は、各々の対に関するコスト関数Cobである。

【表2】

【0077】

コスト関数Cobの値に関してしきい値Tcが設定される。具体的には、CobがTcよりも上、例えば12である場合は、前記値は、対応リストには入れられない。Cobの値が大きい場合は、特徴セット間の対応度が低いことを示しており、このため、相対的に大きいCob値を生み出す対は直ちに捨てることができる。このことは、要求される処理量を低減させる。上例からわかるように、ブロブマスクBとオブジェクトDの対に関するコスト関数Cobは、12よりも上であり、このため、この値は対応リストには入れられない。

【0078】

要求される処理量をさらに低減させるために、コスト関数Cobが漸進的に計算されるように早期ジャンプ戦略が採用される。各々の新たな特徴との比較に応じてCob値が増加するのに従い、CobがTcと比較される。Cob > Tcである場合は、計算が直ちに停止し、現在の対は対応リストには入れられない。

【0079】

第2の副段階57において、対応リストを用いて最良のマッチを見つけ出す作業が行われる。最低のコスト関数Cobを有する対を識別するためにグローバルな探索が行われる。上例においては、ブロブマスクAとオブジェクトEを対にすることは、最低のコストが得られる。この対にすることは、「マッチされた」とみなされ、ブロブマスクA又はオブジェクトEが関係するその他のあらゆる対、すなわち、A&D、A&F、B&E及びC&Eは、対応リストから取り除かれる。最終結果は、オブジェクトが各ブロブマスクと対応することを示す「マッチリスト」である。表3は、上例の結果得られたマッチリストを示す。

【表3】

【0080】

上例において、各ブロブマスクは、待ち行列内のオブジェクトとマッチされている。しかしながら、最良のマッチを見つけ出す段階57の結果得ることが可能な2つのその他のシナリオが存在する。ブロブマスクがオブジェクト待ち行列内のいずれのオブジェクトともマッチしない場合は、コスト関数Cobは、すべてのオブジェクト比較に関してTcを上回ることになり、前記ブロブマスクは映像シーケンス内の「新しい」オブジェクトを表すと想定することができる。いずれのブロブマスクともマッチしないオブジェクトがオブジェクト待ち行列内に存在する場合は、前記オブジェクトは映像シーケンスから「消えている」と想定することができる。「新しい」及び「消えている」という表現は、状態の見出しの下で待ち行列内に格納することができる2つの型のオブジェクト状態を表す。以下において明確になるように、追跡をより効果的に及び効率的に行うために異なる状態を有するオブジェクトに関して異なる追跡戦略を採用することができる。特に、本発明では、オブジェクトの追跡歴を記録するかどうを決定するために前記オブジェクトの状態を用いる。

【0081】

第3の副段階59において、オブジェクト待ち行列が更新される。上述されるように、この更新は、待ち行列内においてマッチされた着信ブロブマスクを有するオブジェクトに関する位置以外の特徴を更新することを含む。

【0082】

第4の副段階63においては、各オブジェクトの状態が必要に応じてモニタリング及び更新される。より具体的には、各オブジェクトは、その値に依存して前記オブジェクトを追跡すべきかどうか及び/又はオブジェクト待ち行列から削除すべきかどうかを決定する状態が割り当てられる。オブジェクトに割り当てられる状態は、映像シーケンス内において発生する可能性がある様々なシナリオを考慮する状態遷移管理方式によって決定される。次に、2つの異なる状態遷移オブジェクト管理方式が説明される。

【0083】

単純追跡方式

映像シーケンスが互いを隠さない幾つかのオブジェクトを具備すると仮定した場合は(隠すとは、オブジェクトの一部又は全部が他のオブジェクトによって隠されて見えないことを意味する)、相対的に単純な追跡方式を採用することができる。この追跡方式は、図14に示される状態遷移オブジェクト管理方式によって代表され、第4の副段階63において待ち行列71に格納された各オブジェクトに対して適用される。

【0084】

図14に関して、オブジェクト待ち行列71内の各オブジェクトは、2つの主な状態のうちの1つ、すなわち「新しい状態」又は「真の状態」を占めることになる。「新しい」オブジェクトは、予め決められた数のフレームToに関して着信ブロブとマッチしていないオブジェクトであると定義される。前記「新しい」オブジェクトがToのフレームに関して着信ブロブといったんマッチした時点で、前記オブジェクトは「真」とみなされ、追跡目的のためにその位置が記録される。他方、オブジェクトが異なる予め決められた数のフレームTOMに関して着信フレームとマッチしていない場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。この実施形態においては、Toは、10のフレームに設定され、TOMは5つのフレームに設定される。

【0085】

オブジェクトの現在の状態は、オブジェクト待ち行列71内の状態パラメータによって定義される。次に、流れ図の各ステップに関して、第1のステップ75においては、前記オブジェクトの状態は、このフレーム期間においていずれの追加ステップが前記オブジェクトに対して適用されるかを決定する。前記オブジェクトが現在「新しい」として分類されており、ステップ77Aにおける決定により着信ブロブマスクとマッチする場合は、ステップ77BにおいてTRパラメータが増やされる。後続ステップ77Cにおいて、TRがToよりも大きいかどうかの試験が行われる。TRがToよりも大きい場合は、ステップ77Dにおいて、前記オブジェクトがスプリアスであるかどうかを決定するためのさらなる試験が行われる(この試験は、以下において詳細に説明される)。前記オブジェクトがスプリアスであるとみなされた場合は、ステップ77Eにおいてオブジェクト待ち行列から削除される。前記オブジェクトがスプリアスであるとみなされない場合は、オブジェクト待ち行列内の状態パラメータが「真」に変更される。ステップ84の結果が否定である場合は、オブジェクト待ち行列71内の状態パラメータは「新しい」として維持される。

【0086】

前記オブジェクトが現在「真」として分類されており、着信ブロブマスクとマッチしている場合は、その状態パラメータは「真」として維持される。ステップ79Aにおいてマッチしていない場合は、ステップ79BにおいてLRパラメータが増やされる。次のステップ79Cにおいて、前記オブジェクトが今回の場合は5つのフレームに関して着信ブロブマスクとマッチしていないことを示すTOMよりもLRが大きいかどうかが決定される。LRがTOMよりも大きい場合は、ステップ79Dにおいて前記オブジェクトがオブジェクト待ち行列から削除される。

【0087】

オブジェクト待ち行列71内において「真」と分類されるオブジェクトが追跡される。この追跡は、フレーム内の各「真の」オブジェクトの座標を記録し、さらにより多くのフレームが受信されるのに従って前記オブジェクトによってとられる軌跡を計算することによって行われる。この軌跡情報は、表示のために又はより高位のアプリケーション7による処理のために前記追跡情報を利用可能にする軌跡データベース内に格納される。好ましいことに、「真の」状態を有するオブジェクトは、バウンディングボックスによって囲まれた形で映像モニター15に表示される。前記軌跡情報は、前記オブジェクトによってとられた累積経路を示すトレールラインを作図するために用いられる。複数のオブジェクトを追跡中である場合は、前記トレールラインは、異なる各々の色で作図することができる。

【0088】

スプリアスオブジェクトの識別

第4の副段階63の一部として、図14のステップ77Dによって示されるように、オブジェクト待ち行列内の各「新しい」オブジェクトに関してスプリアスオブジェクト識別が行われる。具体的には、第4の副段階63は、各オブジェクトの動きに関する特徴を解析し、前記オブジェクトがスプリアスな前景領域を表しているかどうかを決定する。この点に関して、前景抽出段階3の動作は、一定の画像領域がユーザーにとって重要である前景オブジェクトを表していないにもかかわらず前景として分類される可能性がある。従って、後続の処理動作がこれらのオブジェクトに関して行われないようにこれらのオブジェクトを識別する価値がある。

【0089】

前景抽出段階3においてスプリアス領域が生成される可能性がある理由は幾つかある。樹木の葉又は枝の動き等の反復する動きの存在が共通する原因である。これらの葉は、背景モデルに関して動いているため、これらの葉を表す画素は、前景画素として分類することができる。しかしながら、この領域の画素は真の前景を表しておらず、このためこのような領域は、一般的にはスプリアスとみなされる。映像処理ソフトウェアも全体的なシステム内にノイズを導入する可能性がある。ノイズのある画素は、前景抽出段階3によって前景画素として解釈される可能性がある。いずれの場合も、スプリアス領域の軌跡を記録することによって処理資源とメモリ資源を浪費するのは望ましくない。この理由により、スプリアスであるとみなされるオブジェクトを識別してその後に除去するためのスプリアスオブジェクト識別が採用される。

【0090】

シーン内のノイズ及び/又はランダムな動きの影響を例示するため、図15a乃至15cが参照される。図15aは、背景学習段階1において生成された背景モデルを示す。前記背景モデルは、動いているオブジェクトが存在しない駐車場を示す。図15bは、3つの前景オブジェクト、すなわち、駐車場内を歩いている人、駐車場から出る車両及びフレームの左側において車両の近くを歩いている人が存在する着信映像フレームを示す。図15cは、前景抽出後の前景マスクを示す。上記の3つのオブジェクトを表している画素は、前景領域として正確に分類されている。これらの領域は、監視目的に関するものであり、これらの領域の軌跡は、オブジェクト追跡段階5によって追跡すべきである。しかしながら、特にフレームの右上の樹木領域において、幾つかのその他の白いエリアが存在している。これらの白いエリアは、可視の前景オブジェクトを表していないにもかかわらず前景として分類されている画素を表す。これらはスプリアス領域の例であり、その存在は、樹木のノイズ及びランダムな動きに起因する。明らかなことに、これらのオブジェクトの追跡は望ましくない。

【0091】

スプリアス領域を識別するために、オブジェクト待ち行列80内の各「新しい」オブジェクトによって示される動きがモニタリングされる。動きに関する一定の特徴は、複数のフレームにわたって測定時には、スプリアス効果を一般的に発生させるランダムな動き及び/又はノイズの影響を示す可能性があることが注記される。従って、図14のオブジェクト管理方式のステップ85において、映像処理ソフトウェアは、例えばこれらのブロブマスクをオブジェクト待ち行列80から削除することによって適切な措置を講じることができるようにするために、これらの動き上の特徴を有するオブジェクトを削除するように動作可能である。

【0092】

第1の例として、ほとんどの監視用途においては、ほとんど又はまったく動きを示さない真の前景オブジェクトが突然フレーム内に現れる可能性はない。このことは、映像コーデック内の量子化誤差によって引き起こされるスプリアス領域を示す可能性がある。従って、オブジェクト待ち行列内において動きがほぼゼロであって「新しい」と分類されるあらゆるオブジェクトがスプリアスとみなされる。前記オブジェクトは、好ましいことに、オブジェクト待ち行列71から除去されるか又は十分な時間にわたって追跡されている場合においても「真の」オブジェクトに変更されるのが少なくとも防止される。

【0093】

オブジェクトによって示される動き量を測定するために、前記ソフトウェアは、前記オブジェクトの中心点(xcb, ycb)の位置を複数のフレームにわたってモニタリングする。この情報は、オブジェクト待ち行列80内の特徴セット情報から入手可能である。中心点(xcb, ycb)の動きは、前記中心点位置の分散(σcx2, σcy2)によって定義することも可能であり、前記分散は、以前のフレームにわたって取得された値から導き出される。この場合は、中心点位置の分散がほぼゼロである「新しい」オブジェクトは、スプリアスとみなされる。

【0094】

第2の例として、ノイズ又はその他の現象(例えば波のような動きをしている葉)等のランダムな影響によって生成されるオブジェクトは、通常はランダムな動きを示す。この型の動きは、中心点位置の大きな分散(σcx2, σcy2)を呈し、中心位置の速度のさらに大きな分散(σvx2, σvy2)を呈する。この場合は、ステップ85は、複数のフレームにおける中心点位置の変化(又は分散)及び速度の変化(又は分散)の両方の計算を要求する。両値が各々のしきい値を上回る場合は、前記オブジェクトはスプリアスとみなされてオブジェクト待ち行列71から取り除かれる。

【0095】

好都合なことに、上記状況のいずれか/両方は、位置分散と速度分散の比に基づいていわゆる動き率ζmを用いて検出することができる。x座標及びy座標の両方を考慮に入れるため、前記動き率は、好ましいことに次式によって与えられる。

【数5】

【0096】

ここで、σcx2及びσcy2は、x方向とy方向におけるそれぞれの位置変化であり、σvx2及びσvy2は、x方向及びy方向におけるそれぞれの速度分散であり、τは、前記オブジェクトが完全に静止した状態であり(それによって分母をゼロにする)場合に動き率が急増するのを防止する予め決められた定数である。本実施形態においては、0.1の値がτに関して用いられる。

【0097】

オブジェクトに関する位置分散値及び速度分散値は、好ましいことに、予め決められた数の以前に取得されたフレームにわたる前記オブジェクトの位置及び速度に関してフレームごとに計算される。前記フレーム数は、フレーム取得速度に依存して変化可能である。1秒当たり25フレームの取得速度に関しては、5乃至10のフレームのウィンドーが適切である。例えば5つのフレームのウィンドーを用いる場合は、現在のフレームt内のオブジェクトの中心点位置の分散は、以前の5つのフレーム(t−1、t−2、t−3、t−4、t−5)にわたる平均位置を現在位置から減じることによって計算する。同様に、速度分散は、以前の5つのフレームにわたる平均速度を最後に記録された速度から減じることによって計算する。この点に関しては、速度は、個々のフレーム間における位置の変化を表すことが理解されるであろう。次のフレームt+1が受信されたときは、前記オブジェクトに関する位置分散及び速度分散は、フレームt、t−1、t−2、t−3及びt−4を具備する更新されたウィンドーに関して計算される。

【0098】

動き率が予め決められたしきい値Tζと比較されて前記オブジェクトの動きが規則的であるかどうかが決定され、このため以下のようになる。

【0099】

ζm > Tζである場合は、動きが規則的である−スプリアスでない

ζm > Tζでない場合は、動きが不規則である−スプリアスである

この実施形態においては、Tζの値は、2.5に設定される。この値は、人及び車両の通常の動きのモニタリングを含む毎秒25フレームの映像取得速度に関して当てはまることがわかっている。相対的に一定の動きを含む低速の動きのシナリオに関しては、Tζの値は、より多くのノイズを除去するためにより高い値に設定することができる。動きが突然変化する高速の動きのシナリオに関しては、Tζの値は、大きな速度変化に耐えるために2.5よりもわずかに小さい値に設定すべきである。実際には、2つの値範囲が提供され、第1の下方の範囲は、不規則なオブジェクトの動きを示し、上方の範囲は、真の前景オブジェクトと関連する規則的な動きを示す。

【0100】

要約すると、この副段階は、現在のフレームと前フレームとの間における動きがノイズ又はランダムな動き等のスプリアス効果を示す前景オブジェクトを識別するように構成される。この動きが、予め決められた数の以前のフレームにわたって記録された位置特徴のスライディングウィンドーと比較され、x方向とy方向における現在の位置分散と速度分散が決定され、前記分散は、予め決められた限度外にある場合は、後続する追跡段階から無視することができる不要なオブジェクトが存在することを示す。要求される場合は、システムは、前記検出されたスプリアスオブジェクトを表している画素の代わりに背景モデルからの画素を表示することによって、前記スプリアスオブジェクトの表示を抑止することができる。

【0101】

高度追跡方式

単純追跡方式においては、フレームシーケンス内において現れるオブジェクトは、その他のオブジェクトによって隠されない、又は一時的に視界から消えないと想定される。この理由により、図14の状態遷移管理方式は、オブジェクトを追跡すべきか又はオブジェクト待ち行列から削除すべきかを決定するために、2つの主な状態、すなわち「新しい」状態及び「真の」状態のみを要求する。しかしながら、ほとんどの実際の監視状況においては、オブジェクトは、あらゆる時点にシーン内のあらゆる場所に現れるか又はシーン内のあらゆる場所から消える可能性がある。オブジェクトは、数フレームだけ消えてその他の場所に再び現れることがある。複数のオブジェクトがシーンを横切り、互いを隠し、その後に分離することが可能である。この理由により、第4の副段階63において複雑な状態遷移管理方式を利用する高度追跡方式が提供される。この状態遷移管理方式が図16に示される。

【0102】

図16に関して、オブジェクト待ち行列内の各オブジェクトは6つの主な状態、すなわち「新しい」100、「成熟」101、「一時的に入手不能」102、「隠されている」103、「消えている」104及び「再び現れている」105のうちの1つを占めることがわかるであろう。各着信フレームに関して、オブジェクト待ち行列内のオブジェクトは、それぞれの状態を維持すること、それぞれの状態を変えること、又はオブジェクト待ち行列から削除されることができる。図14の管理方式における場合のように、各状態は、前記各状態を占めるオブジェクトを追跡(すなわち、その動き軌跡を記録及び表示)すべきか、削除すべきか、及び/又は新たなフレームが受信されたときに前記オブジェクトがどのように挙動しているかを反映させるようにその状態を変化させるべきか、を決定するための異なる追跡戦略を採用する。

【0103】

次に、前記管理方式の各状態が説明される。

【0104】

新しい100 該オブジェクトは、たった今、又はつい最近にシーン内に現れている。前記オブジェクトは、例えばランダムノイズに起因するスプリアスである可能性があり、このため、真の前景オブジェクトとして受け入れることができる前に前記オブジェクトの信頼度を累積する必要がある。この累積は、図13において描かれる単純管理方式と同様の方法で、すなわち、ステップ100aにおいてマッチング動作を行い、着信ブロブマスクとマッチする場合は追跡記録(TR)を増やすことによって行われる。ステップ100cにおいて、前記オブジェクトが予め決められた数の連続フレームTo、例えば10フレーム、に関してマッチしている場合は、ステップ100dに入り、上記のスプリアス試験が行われる。ステップ100aにおいてマッチされないか又はステップ100dにおいて前記オブジェクトがスプリアスであるとみなされた場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。ステップ100dにおいて前記オブジェクトがスプリアスであるとみなされない場合は、前記オブジェクトに関する特徴セットが更新され、その状態が「成熟」になる。

【0105】

成熟 該オブジェクトは、真の前景オブジェクトとして受け入れられている。こ101 の場合は、映像処理ソフトウェアは、前記オブジェクトを囲んだバウンデ

ィングボックスを映像モニター15に表示する。さらに、追加のフレームが受信されたときに前記オブジェクトの動きが追跡され、軌跡情報が格 納及び映像モニター15に表示される。前記オブジェクトがステップ101aにおいて着信ブロブマスクとマッチし続ける場合は、前記オブジェクトの状態は引き続き「成熟」状態になる。しかしながら、マッチしない場合は、前記オブジェクトがオブジェクト待ち行列80内の他のオブジェクトとオーバーラップするかどうかを決定するための試験がステップ101bにおいて行われる。このオーバーラップは、これらの2つのオブジェクトのバウンディングボックスがオーバーラップしている場合に発生する。オーバーラップしている場合は、前記オブジェクトが更新され、このためその状態は「隠されている」である。オーバーラップが存在しない場合は、失われたレコード(LR)パラメータがステップ101cにおいて‘1’に設定され、前記オブジェクトの状態が「一時的に入手不能」に更新される。

【0106】

一時的に オブジェクトは、幾つかの理由で一時的に入手不能になることがある。前入手不能 記オブジェクトは、ノイズによって壊されていること、他のオブジェクト 102 の背後に消えていること、又は単にシーンから出ている場合がある。前記

オブジェクトがステップ102aにおいて着信ブロブマスクと再度マッチする場合は、前記オブジェクトは、再度シーン内に入っており、このためその状態は「成熟」に戻る。マッチがない場合は、ステップ101bのオーバーラップ試験がステップ102bにおいて繰り返され、隠されているかどうかが試験される。隠されていない場合は、ステップ102cにおいてLRが増やされ、ステップ102dにおいてしきい値Toiと比較される。Toiは、成熟オブジェクトが失われたとみなされる前に前記成熟オブジェクトが紛失している可能性があるフレーム数である。従って、LRがToiよりも大きい場合は、前記オブジェクトの状態が「消えている」に変更される。LRがToiよりも小さい場合は、「一時的に入手不能」として状態が維持される。この状態においては、前記オブジェクトは、その軌跡情報が格納及び表示されるようにするために依然として追跡される。

【0107】

隠されている この場合は、該オブジェクトがオブジェクト待ち行列内のその他のオ 103 ジェクトとオーバーラップしている。この状態は、例えば、オブジェクト

がディスカッションに関わっている2人以上の人を表している場合又はこれらの人のうちの1人が他の1人の後ろに立っている場合に生じる可能性がある。この場合は、個々の特徴の描写を抽出及び更新することができない場合がある。しかしながら、対象となるオブジェクトを隠しているオブジェクトのバウンディングボックス特徴がその位置に関して幾つかの制約を提供する。ステップ103aにおいて、前記オブジェクトが着信ブロブマスクとマッチされている場合は、前記オブジェクトの状態は再度「成熟」であり、前記オブジェクトが隠しているオブジェクトから分離されていることを示す。マッチしてない場合は、ステップ103bは、オーバーラップが依然として存在するかどうかを決定し、オーバーラップしている場合は、前記オブジェクトの「隠されている」状態が維持される。オーバーラップがない場合は、ステップ103cにおいてLRが1に設定され、状態が「消えている」に変更される。「成熟」及び「一時的に入手不能」と同様に、前記オブジェクトは依然として追跡され、その軌跡情報が格納及び表示される。

【0108】

消えている オブジェクトの状態が「消えている」に達した場合は、前記オブジェクト104 がシーンから完全に出ているか、又は例えば樹木の後ろを歩くか又は建物

のドアを通ることによって背景オブジェクトの後ろに隠された状態になったことを反映させることになる。ステップ104aにおいて、前記オブジェクトが着信ブロブマスクと再度マッチされた場合は、ステップ104eにおいてTRが1に設定され、状態が「再度現れている」に更新される。しかしながら、このことは、しきい値TOMによって設定された一定数の フレーム内において起きなければならない。ステップ104aにおいてマッチが行われない場合は、ステップ104bにおいてLRが増やされ、ステップ104cにおいてTOMと比較される。LRがTOMよりも大きい場合は、前記オブジェクトは、ステップ104dにおいてオブジェクト待ち行列から削除される。その他の場合は、前記オブジェクトの状態は、「消えている」に維持される。この状態においては、前記オブジェクトに関する追跡は行われない。

【0109】

再び現れて この状態においては、以前に「消えている」として分類されているオブジェいる クトが、相対的に短時間のうちに、再びシーン内に現れている。この再出現、

105 は、前記オブジェクトが、例えば建物のドアから中に入った後に短時間で前記ドアから再び現れた場合に生じることが可能である。このオブジェクトの状態を「成熟」に戻す前に前記オブジェクトに関する信頼度を累積させることが望ましい。従って、前記再び現れたオブジェクトがステップ105aにおいて着信ブロブマスクとマッチしないかぎり、前記オブジェクトは、ステップ105aにおいてオブジェクト待ち行列から削除される。マッチングが行われた場合は、ステップ105bにおいてTRが増やされてステップ105cにおいてさらなるパラメータTorと比較される。TRがTorを超える上での十分な信頼度を前記オブジェクトが構築しないかぎり、その状態は「再び現れている」にとどまる。TRがTorを超えている場合は、ステップ105dに入り、ステップ105dにおいて上記のスプリアス識別試験が行われる。前記オブジェクトがスプリアスであるとみなされた場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。前記オブジェクトがスプリアスであるとみなされない場合は、前記オブジェクトの状態が「成熟」に更新される。「消えている」状態においては、前記オブジェクトに関する追跡は行われない。

【0110】

高度追跡方式に関する追加のマッチングコスト

これまでは、オブジェクト追跡段階5の第1の副段階55は、方程式(2)によって定義され、最良のマッチ発見副段階57における解析用の単一の対応リストを生成する単一のマッチングコストCobを採用している。このマッチングコストCobは、単純追跡方式及び高度追跡方式の両方に関して適切に機能する。しかしながら、高度追跡方式において提供される追加の状態を考慮した場合は、オブジェクトが特定の状態を有するときにこれらのオブジェクトの特徴を考慮する幾つかのマッチングコストを提供するのが有利である。従って、代替実施形態においては、3つのマッチングコストが提供される。すなわち、(i)方程式(2)とまったく同じであるCob、(ii)方程式(2)とまったく同じであるが、特徴セットのnp0を考慮しないCno−numpels、及び(iii)方程式(2)とまったく同じであるが特徴セットの速度特徴(vxo, vyo)を考慮しないCno−velである。

【0111】

第1の副段階55によって1つの対応リストが生成される代わりに、以下の規則に基づいて4つの対応リストが生成される。

【0112】

Lold−すべてのブロブマスクとオブジェクトの対を含む対応リスト。ここで、Con<Tc及び状態 ≠「新しい」

Lnew−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Con<Tc及び状態 =「新しい」

Lno−numpels−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Cno−numpels<Tc及び状態 は、「成熟」、「一時的に入手不能」又は「隠されている」

Lno−vel−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Cno−vel<Tc及び状態は、「成熟」、「一時的に入手不能」又は「隠されている」

ここで、Tcは、好ましいことに依然と同じ値、すなわち12を有する。

【0113】

第1の副段階57において、Lold、Lnew、Lno−numpels及びLno−velの順序に従い、各対応リストに関するグローバル探索が順次で行われる。この順序は、より高い信頼度を有する「成熟」オブジェクトが「新しい」オブジェクトよりも前に処理されることを保証する。

【0114】

Lno−numpelsリストは、npo特徴に関する情報を含まないCno−numpelsの効力によって、ブロブマスク画素数の突然の変化による有意な影響を受けないコスト関数値を具備する。この点に関して、背景減算誤差、又は部分的覆い隠し状況がnpo値の突然の変化を引き起こす可能性があり、さらにそのことが有効なマッチが行われるのを妨げる可能性がある。前記のような状況は、車両が部分的にシーンから抜け出て短時間後に戻る場合に発生する可能性がある。

【0115】

Lno−velリストは、「隠された」状態においてはオブジェクトの特徴はカルマンフィルタリングプロセスによって更新されるために用いられる。速度特徴(vxo, vyo)を無視しない場合は、オブジェクトが隠しているオブジェクトから分離した場合に前記オブジェクトが追跡されない可能性がある。この理由は、カルマンフィルタは、隠しているオブジェクトの特徴に基づいて隠されているオブジェクトの速度を予測するためである。

【0116】

Lno−numpels及びLno−velの対応リストがスプリアスオブジェクト及びノイズによる影響を受けないようにするため、本発明では、コスト関数Cno−numpels及びCno−velの計算を、状態「成熟」、「一時的に入手不能」又は「隠されている」を有するオブジェクトに制限する。

【0117】

追加のマッチングコストを高度追跡方式とともに用いることは、効率的でかつ強固な動作を提供する。隠されている又は一時的に消えているオブジェクトを、向上された信頼度を持って追跡することができる。

【0118】

Lold、Lnew、Lno−numpels及びLno−velに関して実行されるステップの順序が図17の流れ図に示されている。グローバル探索は、Loldを取得すること(ステップ109)と、対応リスト内の最低コスト関数を識別してマッチされているブロブマスクとオブジェクトの対をマッチリストに転送すること(ステップ111)と、前記マッチされたブロブマスク又はオブジェクトの結果得られた残りのコスト関数を取り除くこと(ステップ113)と、対応リストが空であるかどうかを決定すること(ステップ115)、とを具備する。対応リストが空である場合は、ステップ117において次の対応リストが取得され、プロセスがステップ109から繰り返す。対応リストが空でない場合は、現在の対応リストを用いて空になるまでステップ111が繰り返される。4つ対応リストの各々が空であるときに、第3の副段階59においてオブジェクト待ち行列が更新される。

【0119】

初期条件

オブジェクト追跡段階5に関する上記の説明は、オブジェクト待ち行列71には少なくとも1つのオブジェクトが存在すると仮定している。しかしながら、映像処理ソフトウェアが最初に動作されるとき、又は映像シーンにおいて活動がないときには、オブジェクト待ち行列71は空になる。このことは、ブロブマスクの組がオブジェクト追跡段階5によって受け取られたときに前記オブジェクトと比較すべきオブジェクトが存在しないことを意味する。この場合は、これらのブロブマスクは「新しい」オブジェクトとしてオブジェクト待ち行列71内に入れられるが、第4の副段階63において状態遷移管理方式によって処理されない。第5の副段階65においては、カルマンフィルタアルゴリズムは、各オブジェクトに関する位置特徴を予測及び更新する。次のフレームが受信されたときに、オブジェクト追跡段階5は、前述されるように動作し、現時点におけるオブジェクト待ち行列71は、着信ブロブマスクを比較するための1つ以上のオブジェクトを含んでいる。

【0120】

軌跡情報

「真」(単純追跡方式の場合)又は「成熟」、「一時的に入手不能」又は「隠されている」(高度追跡方式の場合)として分類されているブロブマスクに関して、軌跡情報がオブジェクト状態更新副段階63によって生成される。この軌跡情報は、各追跡されたオブジェクトに関して、中心位置のデカルト座標、及び前記中心位置が関連するオブジェクトのアイデンティティを具備することができる。代替形態の軌跡情報、例えば、変位情報又はベクトル情報も生成可能である。図18に関して、軌跡情報は、軌跡データベースである第1の高位アプリケーション121によって受け取られる。軌跡データベース121は、前記軌跡情報を格納し、シーン上において各オブジェクトによってとられた経路を前記軌跡情報からリアルタイムで計算する。軌跡データベース121は、表示制御アプリケーションである第2の高位アプリケーション123によって受け取られる経路データを出力する。

【0121】

表示制御アプリケーション123は、PC13のハードドライブに格納された映像データを映像モニター1に表示することを制御する。表示制御アプリケーション70は、図3に示されるすべての処理段階から映像データを受け取ることができ、前記映像データによって表されている映像シーケンスをリアルタイムで又はその他の形で表示するように構成される。オペレータは、複数の画像を単一の画面上で見ることができる。例えば、オペレータは、背景モデル19及びオブジェクト分類マスク39の両方を同時に見るのを希望することができる。オペレータにとって特に関心があるのは、軌跡データベース21からの経路データである。表示制御アプリケーション123からの処理後フレーム125が図19に示されている。前景オブジェクト23、25に対応するブロブマスクは、「真」として識別され、その軌跡が軌跡データベース121に記録されている。結果的に得られた経路データは、現在のフレームにまで至る映像セグメントのコースにわたってオブジェクトによってとられた累積経路をそれぞれ表すトレールライン129、127を生成する。図19には示されていないが、前記軌跡データベースは、異なるオブジェクトとの関連性を示すための異なる色を各トレールライン129、127に割り当てる。

【0122】

さらに高位のアプリケーション7を提供することができる。例えば、オブジェクト分類アプリケーションは、影除去段階17からのブロブマスクを「現実の」オブジェクトのテンプレートと比較することができる。マッチが存在する場合は、前記オブジェクト分類アプリケーションは、図19に示されるように、バウンディングボックスの隣のオブジェクトを識別するラベルを表示することができる。

【0123】

要約すると、上述されるオブジェクト追跡段階5は、各オブジェクトが特定の状態を有するとして分類する状態遷移オブジェクト管理方式を提供することによって改良されたオブジェクト追跡を提供する。オブジェクトが分類される状態は、前記オブジェクトが追跡されるかどうか、すなわちその動き軌跡が記録されるかどうか、及び現在の状態を特に現在の状態に関する予め定められた規則に基づいて維持又変更すべきかを決定する。

【0124】

インテリジェント監視システム19の性能は、幾つかの実際上の状況からの結果を示した図20乃至22を参照することによってより良く理解されるであろう。各々の場合において、上述される高度追跡方式が採用された。

【0125】

図20のa乃至図20のbにおいて、映像シーケンスの4つのフレームが示されている。図20のaにおいては、単一のオブジェクト、すなわち車、がフレームの左端において識別されている。この時点においては、前記オブジェクトの状態パラメータは「成熟」である。識別は、前記車を囲んでいるバウンディングボックスによって確認される。図20のb及び図20のcにおいては、前記オブジェクトは、フレームの縁から消え始める。しかしながら、Cno−numplesコスト関数を用いたマッチングが行われ、このため、画素数の突然の減少は結果に対して重大な影響を及ぼさない。状態は「成熟」に維持され、前記オブジェクトは引き続き追跡される。図20のdにおいては、前記オブジェクトは、再び視界内に現れ、依然として追跡されている。

【0126】

図21のa乃至21のdにおいて、さらなる映像シーケンスの4つのフレームが示されている。図21のaにおいては、第1及び第2のオブジェクトがフレームの左下の方向において識別されている。この時点においては、各オブジェクトの状態パラメータは、「成熟」である。図21のb及び21のcにおいては、前記2つのオブジェクトは、互いに接近して各々のバウンディングボックスをオーバーラップさせる。この場合は、大きい方のオブジェクトの状態パラメータは、「成熟」として維持され、小さい方のオブジェクトの状態パラメータは、「隠されている」に変更される。この理由は、結合されたブロブマスクは大きい方のオブジェクトのバウンディングボックスにより似ているためである。しかしながら、カルマンフィルタは、現在の特徴セットに基づいて小さい方のオブジェクトの位置の予測を続ける。さらに、小さい方のオブジェクトの速度特徴を無視するCno−velコスト関数を用いたマッチングが行われ、このため、後続フレームとのマッチが行われて状態パラメータが再度「成熟」状態になる。図21のdに示されるように、いずれの時点においても、追跡は停止しておらず、両オブジェクトは、それぞれのバウンディングボックスが分離するまで正確に追跡される。

【0127】

最後に、図22のa乃至22のdにおいて、さらなる映像シーケンスの4つのフレームが示されている。この場合は、前記映像シーケンスは、魚眼レンズを有するカメラを用いて取得され、前記カメラの使用は、現代の映像監視システムにおいては一般的である。図21のaにおいては、第1のオブジェクト、すなわち移動中の車両、がフレームの左側方向において識別される。フレームの右側方向に位置する第2のオブジェクト、すなわち車両、が動き出している。しかしながら、このオブジェクトは、10の連続するフレームにおいてまだマッチされていないため「新しい」として分類される。画像21bにおいては、前記第1のオブジェクトは、魚眼レンズの歪みに起因してその大きさが劇的に変化しているにもかかわらず引き続きマッチングされており、従って追跡されている。この段階においては、前記第2のオブジェクトは、10の連続するフレームにわたってマッチングされており、このため「成熟」オブジェクトとして分類される。従って、前記第2のオブジェクトのバウンディングボックスは可視である。図21のcにおいては、前記第1のオブジェクトは、もはやフレーム内には見えず、このためその状態は「消えている」に変更される。前記第2のオブジェクトは、移動し続け、このためその状態は「成熟」として維持されて引き続き追跡される。このことは、前記第2のオブジェクトの動きが魚眼レンズの歪みに起因して放物線状にみえるにもかかわらず行われる。図11のdにおいても前記第2のオブジェクトの追跡が以前と同じように継続し、前記オブジェクトの変化する形状によって影響されない。

【図面の簡単な説明】

【0128】

【図1】従来のインテリジェント映像システムの処理段階を示したブロック図である。

【図2】本発明の実施形態によるインテリジェント映像監視システムの構成要素を示したブロック図である。

【図3】図2に示される監視システムの処理段階を示したブロック図である。

【図4】監視システムの前景抽出段階において用いられる背景モデルを表した図である。

【図5】前景抽出段階への着信映像フレームを表した図である。

【図6】前景抽出段階によって生成される前景マスクを表した図である。

【図7】監視システムの影除去段階の機能上の要素を表したブロック図である。

【図8a】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8b】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8c】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8d】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8e】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8f】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8g】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8h】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図9】a〜eは複数の映像フレーム内において現れる2つの異なるオブジェクトを追跡するプロセスを示した概略図である。

【図10】幾つかの抽出された位置特徴が示されるブロブマスクを表した図である。

【図11】監視システムのオブジェクト追跡段階の処理副段階を示したブロック図である。

【図12】オブジェクト追跡段階において用いられるオブジェクト待ち行列を表すテーブルである。

【図13】オブジェクト追跡段階においてマッチングコスト処理副段階を表した概略図である。

【図14】複数のオブジェクト状態及び各々の状態と関連づけられた遷移規則を示す流れ図である。

【図15a】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図15b】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図15c】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図16】高度追跡方式に関連する流れ図である。

【図17】マッチングコスト処理副段階において実行することができる幾つかの追加ステップを示す流れ図である。

【図18】軌跡データベース及び表示制御アプリケーションのブロック図である。

【図19】追跡及び前記追跡に関するオブジェクト分類情報を示す処理後映像フレームを表した図である。

【図20】a〜dは本発明について理解するのに役立つ、第1の映像シーケンスの順次フレームを示した図である。

【図21】a〜dは本発明について理解するのに役立つ、第2の映像シーケンスの順次フレームを示した図である。

【図22】a〜dは本発明について理解するのに役立つ、第1の映像シーケンスの順次フレームを示した図である。

【技術分野】

【0001】

本発明は、映像フレーム、特に映像シーケンスの一部を具備する映像フレーム内におけるスプリアス領域を識別するための方法及びシステムに関するものである。

【背景技術】

【0002】

デジタル映像処理は、広範な用途において用いられる。例えば、現代の映像監視システムは、映像内において動いているオブジェクトに関する情報を提供するためのデジタル処理技術を採用する。前記システムは、典型的には、直接リンク又はネットワークリンクを介してコンピュータシステムに接続されるビデオカメラを具備する。前記コンピュータシステムは、前記カメラから供給された映像データを処理及び解析するように構成されたソフトウェアを実行する。

【0003】

図1は、前記監視システムのソフトウェアレベルの段階を示すブロック図である。第1の段階1においては、最初のセグメントの映像データから背景モデルが学習される。前記背景モデルは、典型的には、相対的に静的な背景コンテンツを表す統計情報を具備する。この点に関して、背景シーンは、前景内のオブジェクトと比較して相対的に静止した状態になることが理解されるであろう。第2の段階3においては、前景抽出及び背景適合化が各着信映像フレームにおいて行われる。現在のフレームが背景モデルと比較され、現在のフレームのいずれの画素が前景領域を表し、いずれの画素が背景を表すかを推定する。背景モデルの小さい変化も更新される。第3の段階5においては、前景領域がフレーム間で追跡され、現在のフレーム内の前景領域と以前のフレーム内において追跡された前景領域との間において対応性が確立される。他方、例えば追跡されたオブジェクトのうちの1つ以上に関する挙動解析を行うことができるより高位のアプリケーション7が各前景領域の追跡歴を利用できるように軌跡データベースが更新される。

【0004】

各映像フレームを処理後は、背景モデルに関する有効性検査9が行われて依然として有効であるかどうかが決定される。取得されたシーンの有意な変化又は突然の変化は、第1の段階1に戻ることによる新たな背景モデルの初期設定を要求する場合がある。

【0005】

既知のインテリジェント映像システムが米国特許出願公開公報番号2003/0053659 A1において開示されている。既知の前景抽出・追跡方法が、"Learning Patterns of Activity using Real-Time Tracking", IEEE Transactions on Pattern Analysis and Machine Intelligence, Volume 22, No.8, August 2000(「リアルタイム追跡を用いた活動パターンの学習」、パターン解析及び機械知能に関するIEEE交渉 第22巻、No.8、2000年8月)においてスタウファー及びグリムソンによって開示されている。

【0006】

前景抽出段階3においては、いくつかの画素領域が実際には前景オブジェクトでないときに前景オブジェクトとして分類されるのが一般的である。例えば、映像シーンが、樹木上において前後に揺れ動く葉のような繰り返しの動きを含む場合は、前景抽出段階3は、これらの葉が実際には背景シーンの一部を形成するときに前記動いている領域を前景として分類することがある。さらに、映像データを取得、符号化及び復号するプロセスは、不可避的にノイズをシステムに導入することになる。このノイズは、前景抽出段階3の固有の動作によって前景として検出される可能性がある。本明細書においては、前記のような不正確に分類された画像領域が検討され、これらの画像領域はスプリアス領域と呼ばれる。

【発明の開示】

【発明が解決しようとする課題】

【0007】

映像フレーム内の前記スプリアス領域を識別することが望ましい。この方法により、真の対象領域に関して実行することが意図されている後続の処理ステップのためにこれらのスプリアス領域を無視することが可能である。例えば、オブジェクト追跡段階5は真の前景領域のみに関して動作することが望ましい。映像処理システムは、反復性の動き又はノイズを表す領域の追跡を試みることによって、ユーザーにとって重要でないデータに関して貴重な処理及びメモリ資源を浪費する。

【課題を解決するための手段】

【0008】

本発明の第1の側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法が提供され、前記方法は、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、(ii)前記領域が予め決められた数の後続フレームにおいて現れるかどうかを決定し、前記現れる場合は、前記予め決められた数のフレームにおける前記領域の位置の変化を示す動きパラメータを前記領域に割り当てることと、(iii)前記動きパラメータをしきい値と比較して前記領域を追跡すべきかどうかを決定することと、(iv)前記領域を追跡すべきである場合は、前記領域が識別される後続フレームに関する前記領域のフレーム位置を記録すること、とを具備する。

【0009】

本発明の好ましい特長が、本明細書に添付される従属請求項において定義されている。

【0010】

本発明のさらなる側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法が提供され、前記方法は、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、(ii)前記複数の映像フレームにおける動き上の特徴に基づいて動きパラメータζmを前記領域に割り当てることと、(iii)前記領域が識別される前記映像シーケンスの後続フレームに関して、前記動きパラメータが予め決められたしきい値Tζを下回る場合のみに前記領域のフレーム位置を記録すること、とを具備する。

【0011】

本発明のさらなる側面により、各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを選択的に追跡するための映像処理システムが提供され、前記システムは、(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別し、(ii)前記領域が予め決められた数の後続フレーム内において現れるかどうかを決定し、前記現れる場合は、前記予め決められた数のフレームにおける前記領域の位置の変化を表す動きパラメータを前記領域に割り当て、(iii)前記動きパラメータをしきい値と比較して前記領域を追跡すべきかどうかを決定し、(iv)前記領域を追跡すべきである場合は、前記領域が識別される後続フレームに関して前記領域のフレーム位置を記録するように構成される。

【0012】

本発明のさらなる側面により、映像シーケンスの一部を具備する映像フレーム内のオブジェクトを分類する方法が提供され、前記方法は、(a)第1のフレーム内の第1のオブジェクトを識別して複数の予め決められた状態のうちの1つを有する状態パラメータと関連づけることであって、各状態は関連づけられた異なる遷移規則を有することと、(b)後続フレーム内の少なくとも1つの候補オブジェクトを識別することと、(c)前記候補オブジェクト又は各候補オブジェクトを前記第1のオブジェクトと比較して両オブジェクト間に対応性が存在するかどうかを決定することと、(d)前記関連づけられた遷移規則に従って前記第1のオブジェクトの前記状態パラメータを更新することであって、前記遷移規則は、ステップ(c)において対応性が識別されたかどうかに依存して前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移すべきであるかを示すこと、とを具備する。

【0013】

オブジェクトが特定の状態にあると分類することによって、前記オブジェクトを追跡すべきであるかどうかを決定することが可能である。後続フレーム内の候補オブジェクトと比較後に、前記オブジェクトと関連づけられた予め定義された規則が適用されて前記オブジェクトの更新された状態が決定される。前記更新された状態は、例えば、前記オブジェクトが新しいこと、真のオブジェクトであること、隠されていること又は前記後続フレームから消えていることを反映させることができ、このため、次のフレームを受信時に適切な規則を適用することができる。

【0014】

前記方法は、前記映像シーケンスの複数の後続フレームに関する繰り返しステップ(b)乃至(d)をさらに具備することが可能である。

【0015】

状態と関連づけられた遷移規則は、ステップ(c)において対応性が識別されない場合に状態パラメータに現在の状態を維持させることができる。状態パラメータは、新しい状態又は真の状態を有することができ、新しい状態と関連づけられた遷移規則は、ステップ(c)において対応性が識別された場合に状態パラメータが真の状態に変更されるようにすることができる。前記方法は、状態パラメータが真の状態にあるときのみに第1のオブジェクトと対応する候補オブジェクトとの間における位置変化を記録することをさらに具備することができる。

【0016】

前記状態パラメータは、ステップ(c)において複数の順次フレームにおける対応性が識別された場合のみに真の状態に変更することができる。

【0017】

前記状態パラメータは、(i)ステップ(c)において対応性が識別され、(ii)前記オブジェクトの抽出された位置上の特徴が予め決められた判定基準を満たしている場合のみに前記真の状態に変更することができる。ステップ(ii)は、複数の映像フレームにおける位置上の特徴に基づいて動き率ζmを第1の領域に割り当てることと、前記動き率が予め決められたしきい値Tζを下回る場合に前記予め定義された判定基準を満たしているとして前記第1のオブジェクトを分類すること、とを具備することができる。

【数2】

【0018】

ここで、σcx2及びσcy2は、x方向及びy方向のそれぞれにおける第1のオブジェクトの位置分散である。σvx2及びσvy2は、x方向及びy方向のそれぞれにおける速度分散であり、τは、予め決められた定数である。

【0019】

前記方法は、前記後続フレーム内の対応する候補オブジェクトを、前記第1のオブジェクトと前記対応する候補オブジェクトとの間における記録された位置変化を示すオーバーレイされた経路ラインとともに表示することをさらに具備することができる。

【0020】

前記状態パラメータは、隠された状態を有することも可能であり、真の状態と関連づけられた前記遷移規則は、ステップ(c)において対応性が特定されずさらに前記第1のオブジェクトが同じフレーム内に現れる異なる対象領域とオーバーラップする場合に前記状態パラメータを前記隠された状態に変化させる。

【0021】

前記方法は、第1のオブジェクトの外観特徴fioを表す第1の組のデータを提供することと、後続フレーム内の前記候補領域又は各候補領域に関して、前記各々のオブジェクトの外観特徴fibを表す第2の組のデータを抽出することと、前記第1の組の外観データをコスト関数Cob内の前記第2の組の又は各々の第2の組の外観データと結合させそれによって前記第1のオブジェクトと前記新しい候補領域又は各々の新しい候補領域との間対応戸を示す数値パラメータを生成することを具備するステップ(c)と、をさらに具備することができる。

【0022】

コスト関数は、次式によって与えることができる。

【数3】

【0023】

ここで、fioは、第1のオブジェクトの外観特徴を表し、fioは、候補領域の外観特徴を表し、σi2は、予め決められた数のフレームにおけるfioの分散であり、nは、第1及び第2のデータセット内の外観特徴数である。

【0024】

前記第1のオブジェクト及び候補オブジェクトの外観特徴は、前記オブジェクト及び候補オブジェクトのフレーム位置に関連する特徴と、前記オブジェクト及び候補オブジェクトの形状に関連する特徴と、を含む。ステップ(c)において対応性が識別された場合は、前記第1のオブジェクトの外観特徴fioは、前記第1のオブジェクトが対応する前記候補オブジェクトの外観特徴fibを用いて更新することができる。

【0025】

本発明のさらなる側面により、コンピュータによって読み取り可能な媒体に格納され、(a)第1のフレーム内において第1のオブジェクトを識別し、各々の状態が関連づけられた異なる遷移規則を有する複数の予め決められた状態のうちの1つを有する状態パラメータと関連づけるステップ、(b)後続フレームにおいて少なくとも1つの候補オブジェクトを識別するステップ、(c)前記候補オブジェクト又は各候補オブジェクトを前記第1のオブジェクトと比較して両オブジェクト間に対応性が存在するかどうかを決定するステップ、及び(d)前記関連づけられた遷移規則に従って前記第1のオブジェクトの状態パラメータを更新するステップであって、前記遷移規則は、ステップ(c)において対応性が識別されたかどうかに依存して前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移させるべきであるかを示すステップ、をコンピュータに実行させるための一組の命令を具備するコンピュータプログラムが提供される。

【0026】

本発明のさらなる側面により、映像シーケンスのフレームを受信するための入力部と、1つ以上のフレームにおいて識別されたオブジェクトを表すデータ、及び各オブジェクトと関連づけられ、複数の予め決められた状態のうちの1つを表す状態パラメータを格納するように構成されたオブジェクト待ち行列と、複数の予め決められた状態のうちの1つを表す状態パラメータと、1つ以上の候補オブジェクトを有するフレームを受信しさらに前記候補オブジェクト又は各候補オブジェクトが前記オブジェクト待ち行列内の各オブジェクトとマッチするかどうかを決定するように構成された映像解析手段と、前記オブジェクトの状態パラメータの状態に対応する遷移規則に従って前記オブジェクト待ち行列内の各オブジェクトの状態パラメータを更新するように構成された状態遷移コントローラであって、前記遷移規則は、前記予め決められた状態のうちのいずれの状態に前記状態パラメータを遷移させるベきかを示す状態遷移コントローラと、を具備する映像処理装置が提供される。

【0027】

本発明のさらなる側面により、映像フレームにおいて識別された1つ以上のオブジェクトを表す情報を格納する映像処理システムとともに用いるための状態遷移データベースが提供され、各オブジェクトは、複数の予め定義されたオブジェクト状態のうちの1つに分類され、前記データベースは、各々のオブジェクト状態に関する複数の異なる遷移規則を定義し、前記遷移規則は、前記オブジェクトが後続フレーム内において現れるオブジェクトとマッチされているかどうかに依存して前記オブジェクトが遷移される2つ以上の更新状態を定義する。

【0028】

次に、本発明は、例を用いて添付図を参照しつつ説明される。

【発明を実施するための最良の形態】

【0029】

図2に関して、インテリジェント映像監視システム10は、カメラ11と、パーソナルコンピュータ(PC)13と、映像モニター15と、を具備する。カメラ11は、ウェブカメラ、例えばLogitec(登録商標)Pro4000カラーウェブカムである。デジタル画像データを出力する能力を備えたあらゆる型のカメラ、例えば、デジタルカムコーダー又はアナログーデジタル変換手段を有するアナログカメラ、を用いることが可能である。ウェブカメラ11は、ネットワーク14を通じてPC13と通信し、ネットワーク14は、ローカルエリアネットワーク(LAN)又はインターネット等のあらゆるネットワークであることができる。実際には、ウェブカメラ11及びPC13は、デジタル加入者ライン(DSL)モデム等の各々のネットワーク接続(図示されていない)を介してネットワーク14に接続される。代替として、ウェブカメラ11は、PC13のユニバーサルシリアルバス(USB)ポート12によって直接PC13に接続することができる。PC13は、あらゆる標準的なコンピュータを具備することができる。この場合は、PC13は、1GHzのプロセッサ、512メガバイトのランダムアクセスメモリ(RAM)、及び40ギガバイトのハードディスクドライブを有するデスクトップコンピュータである。映像モニター15は、標準の映像コネクタによってPC13に接続される17”薄膜トランジスタ(TFT)モニターである。

【0030】

PC13のハードディスクドライブにおいて映像処理ソフトウェアが提供される。前記ソフトウェアは、ウェブカメラ11から受け取られた映像データに関する幾つかの処理作業を行うように構成される。前記映像データは、取得された映像の個々のフレームを表し、各フレームは、複数の画像要素、すなわち画素から成る。この実施形態においては、各フレームは、320画素(幅)×240画素(高さ)の表示フォーマットを有する。用途に依存して代替表示フォーマットを用いることができる。ウェブカメラ11は、カラーのカメラであるため、各画素は、フレーム内における前記画素の位置を示すデータ、及び表示される色を決定する3つの色成分、すなわち、赤、緑及び青の各成分、の各々の重み付けによって表される。当業において理解されるように、所定の画素の輝度Yは、次式によって概算することができる。

【0031】

Y = α.R + β.G + γ.B (1)

ここで、α = 0.114、β = 0.587、及びγ = 0.299である。

【0032】

R、G及びBは、赤、緑及び青の色成分をそれぞれ表す。Yに関する代替方程式が知られているが、本発明の出願者は、上式が好ましいことを発見している。

【0033】

前記映像処理ソフトウェアは、図3に示されるように、幾つかの段階を具備する。図3は、図1に類似し、影除去段階17及びオブジェクト特徴付け段階18が追加され、両段階は、前景抽出段階3とオブジェクト追跡段階5との間に組み込まれている。

【0034】

影除去段階17の目的は、各映像フレームから影を除去して領域を強調することである。この方法で、前景領域の形状を識別する後続処理段階は、向上された信頼性を持って動作することができる。影除去段階17を含めることは、本発明にとって不可欠でないが、向上された動作を提供するのに役立つ。

【0035】

オブジェクト特徴付け段階18の目的は、映像フレーム内において識別された各前景領域に関するいわゆる特徴セットを抽出することである。前記特徴セットは、現在の映像フレーム内のオブジェクトを以前の映像フレームにおいて識別されたオブジェクトとマッチングさせるために後続ステップにおいて用いられる複数の予め決められた特徴を具備する。

【0036】

背景学習

前記映像処理ソフトウェアは、最初に、背景学習段階1を実行する。この段階の目的は、最初のセグメントの映像データから背景モデルを構築することである。この映像セグメントは、典型的には100のフレームを具備する。画像の背景シーンは、(前景オブジェクトと比較して)相対的に静止した状態になる可能性が高いため、この段階は、前景オブジェクトが見えるべきでない背景モデルを構築する。

【0037】

図4は、背景モデル19を示す。この場合は、ウェブカメラ11は、駐車場の方に向けられていた。PC13のメモリ内において、背景モデル19は、画素の位置を表す一組の格納データ、及び各画素の赤、緑及び青の色成分の各々の重み付けによって表される。

【0038】

背景モデル19を構築した後は、着信映像フレームがPC13によって受け取られ、前記映像処理ソフトウェアによって処理される。後続する前景抽出段階3、影除去段階17、オブジェクト特徴付け段階18、オブジェクト追跡段階5、及び高位アプリケーション7は、映像フレームをリアルタイムで処理する。

【0039】

前景抽出及び背景適合化

前景抽出及び背景適合化段階3(以下「前景抽出段階」と呼ばれる)は、現在のフレームの各画素を解析する。各画素は、背景モデル19内の対応する位置を占る画素と比較され、現在のフレームの画素が前景オブジェクト又は背景の一部を表すかどうかを推定する。背景モデル19の小さい変化は、動的に更新される。背景モデル19のより激しい変化又は突然の変化は、参照数字9によって示される試験を用いて実行される再学習動作を要求する。

【0040】

前景抽出段階3の詳細な説明は、本発明について理解する上で不可欠ではないが、当業者は、前景抽出3を実行するための既知の方法が存在することを理解するであろう。おそらく最も単純な方法は、各画素の輝度を背景モデル19内の対応位置を占める画素の輝度と比較することである。前記2つの画素間の差が予め決められたしきい値を超える場合は、現在の画素は、前景画素として分類される。

【0041】

特に有効な方法は、'Learning Patterns of Activity Using Real-Time Tracking', IEEE Transactions on Pattern Analysis and Machine Intelligence, Volume 22, No.8, August 2000, pp. 747-757(「リアルタイム追跡を用いた活動パターンの学習」、パターン解析及び機械知能に関するIEEE交渉、第22巻、No.8、2000年8月、747乃至757頁)においてスタウファー及びグリムソンによって説明されるいわゆるガウス混合(MoG)方法である。前記MoG方法の実装は、米国特許出願開示公報番号2003/0053658においても説明されている。背景モデルを構築するため及び前景抽出を行うためのさらなるMoG方法が、出願者の同時係属英国特許出願番号0425937.0において開示されている。この英国特許出願、又は外国の同等物の完全な内容は、本明細書によって参照されることによって本明細書に組み入れられる。すべての参照は、上記背景モデル19を構築するために適した背景学習方法を説明する。

【0042】

要約すると、前記MoG方法は、着信映像フレームの各画素を異なるガウス(又は正規)統計分布の組合せとしてモデル作成することを含む。このことは、同じシーンポイントのサンプルはガウス雑音分布を示す可能性が高いという仮定を反映させたものである。正規分布の組合せは、2つ以上のプロセスを経時で観測できるという予想を反映させたものである。前記組合せの各々の分布の永続性及び分散に基づき、いずれの分布が現在の背景に対応するかが決定される。背景分布に適合しない画素は、確実に対応しさらに幾つかのフレームにわたって築き上げられた一貫した証拠によって裏付けられた分布が存在するまでは前景画素として分類される。

【0043】

本明細書において説明される実施形態の場合は、前景抽出段階3は、好ましいことに、前記MoG方法を用いて動作する。しかしながら、この動作は、絶対に不可欠であるわけではなく、代替方法を用いることが可能である。

【0044】

前景抽出段階3の動作は、ウェブカメラ11からの着信映像フレーム21を示す図5を参照することによってより良く理解される。映像フレーム21は、(a)駐車場を横切って歩いている人23、及び(b)駐車場の下方部分を横切っている車両を描写する。映像フレーム21の各画素が背景モデル19内の対応する画素と比較され、前記各画素を前景画素又は背景画素のいずれとして分類すべきかが決定される。その結果、前景抽出段階3は、前景マスクを生成する。マスクは、各画素の分類、すなわち前景又は背景のいずれを表すかに関する情報を含む一組の画像データである。図6に関して、前景マスク27のビジュアル表示が示されており、前景画素が白で示され、背景画素が黒で示される。

【0045】

前景マスク27は、第1及び第2の前景領域29、31を含む。しかしながら、いずれの前景領域29、31も、その形状に関して特に適切には定義されておらず、実際にはいずれの前景オブジェクトが表されているかを前景マスク27のみを用いて決定するのは困難である。この原因は、図5に示されるように、人23及び車両25が背景上に落としている影である。前記影を表す画素は、背景モデル19内の対応する位置を占めている画素よりも暗い強度を有している。従って、これらの画素は、誤って前景画素として分類されている。強調の存在も同様の問題を引き起こす可能性がある。

【0046】

影及び強調の結果、後続する処理段階において問題が発生する可能性がある。例えば、オブジェクト特徴付け段階18が前景抽出段階3から直接前景マスク27を受け取る場合は、前景オブジェクトの一定の特徴を識別することが難しい場合がある。オブジェクト追跡段階5は、現在のフレーム内の前景オブジェクトと以前のフレームにおいて追跡された前景オブジェクトとの間で対応させるのが難しい場合がある。各々のマスクプロフィールがいずれの「実世界」のオブジェクトに類似するかに従ってオブジェクトが分類されるオブジェクト分類段階を映像監視システム10が含む場合も同様の問題が発生する可能性がある。

【0047】

上記の問題を軽減するため、前記映像処理ソフトウェアは、影除去段階17を含む。

【0048】

影除去

図7は、影除去段階17の主な機能上の要素を示す。弱影除去32と強影除去33を具備する2つの分枝を有するプロセスが採用される。両方とも前景マスク27に関して並行して動作し、更新マスク及び部分的領域マスクをそれぞれ生成する。

【0049】

並行動作は本発明にとって不可欠でないことを理解すべきである。しかしながら、このリアルタイム映像監視システム10の目的上は並行動作が好ましい。

【0050】

弱影除去32の目的は、現在のフレーム内に存在する最も重大な影のみを除去することである。実際には、幾つかの非常に区別しやすい影のみが存在すると仮定される。しかしながら、フレームは、現実的には強度が異なる幾つかの影を有する可能性があるため、弱影除去32だけでは不十分になる。その結果、幾つかの画素は依然として誤って前景画素として分類される可能性がある。

【0051】

逆に、強影除去33の目的は、現在のフレーム内に存在する実質的にすべての影を除去することである。その結果、一部の真の前景エリアが誤って影領域として検出される可能性がある。自己の上に影、いわゆる自己影、を作っているオブジェクトは特に脆弱である。例えば、人間の顔を示しているフレームは、鼻によって頬の上に作られた自己影領域を含む場合がある。強影除去33は、この領域の画素が実際には前景オブジェクト、すなわち顔の一部を形成しているにもかかわらずこの自己影領域を除去させてしまう。その結果は、通常は、同じオブジェクトの各部分が互いに切り離されているように見える断片化された画像になる。後続する処理ステップは、各断片を別個のオブジェクトとして解釈してしまう可能性がある。

【0052】

影除去段階17は、弱影除去29及び強影除去30の両方からの出力を用いていわゆるオブジェクト分類マスクを生成する。前記オブジェクト分類マスクは、部分的領域マスクを具備し、前記部分的領域マスクは、前景オブジェクト形状の改良された表現を、断片化されたオブジェクト部分が共通のオブジェクトに属するものとして適宜分類されるようにするための追加の分類情報とともに提供する。前記を達成させるために、弱影除去32に続く更新マスクにおいて、コネクテッドコンポーネントアナリシス(CCA)動作34が採用される。前記CCA動作は、前景オブジェクト形成段階35に送られるオブジェクトマスクを生成する。CCA段階34及び前景オブジェクト形成段階35の動作が以下において説明される。

【0053】

CCA動作34の目的は、更新された前景マスク内の1つ以上のクラスタの画像画素を識別することである。1つのクラスタは、1つ以上の隣接する画素、又は連結された画素を具備することができる。各クラスタを囲んでいる最小の長方形のエリアの輪郭を定める境界が、ソフトウェアによって自動的に確定される。フレーム上における各長方形エリアの位置が第1の更新マスクに加えられてオブジェクトマスクが形成される。

【0054】

上記のプロセスについて説明するために、図6に示される前景マスク27が影除去段階17に現在入力されると仮定する。図8aは、弱影除去32の結果から得られた更新された前景マスク36を示す。予想されるように、幾つかの影が除去されているが、各オブジェクト29’、31’の形状は引き続き輪郭が不明確な状態である。図8bは、CCA段階34によって生成され、各クラスタ29’及び31’を囲む長方形の境界が加えられているオブジェクトマスク37を示す。

【0055】

図8cは、強影除去33が行われた後の部分的領域マスク38を示す。各オブジェクト29’’、31’’の形状がより明確になっていることがわかるであろう。しかしながら、強影除去33は、不可避的に、一部の前景画素が背景画素として不正確に分類されており、さらに各オブジェクトが幾つかの別個の部分に断片化されている。

【0056】

前景オブジェクト形成段階35において、オブジェクトマスク37及び部分的領域マスク38が比較され、部分的領域マスク38においてオブジェクトマスク37の共通する長方形エリア内に位置する前景画素が識別される。共通の長方形エリア内にあるすべての前景画素は、同じ前景オブジェクトに属するとして分類される。これらの2つの長方形エリアの各々は、ブロブマスクと呼ばれる。

【0057】

上述されるように、前景オブジェクト形成段階35によって生成された出力は、オブジェクト分類マスク39と呼ばれる。オブジェクト分類マスク39は、強影除去33を用いて前景オブジェクトの改良された形状の表示を提供する。前景領域の断片化に起因する潜在的問題は、所定の境界領域内に入る各部分に共通のアイデンティティを割り当てることによって回避され、前記境界領域の大きさは、弱影除去32によって決定される。図8dは、オブジェクト分類マスク39をビジュアル的に表した図であり、前景オブジェクト形成段階35の結果得られた2つのブロック部マスクを含む。

【0058】

CCA段階34及びオブジェクト形成段階35の動作原理は、図8e乃至8hを参照することによってより良く理解される。図8eは、弱影除去32後における前景マスクの大写し部分を示す。単一の前景画素クラスタが存在する。図8fは、CCA段階34によって生成されたオブジェクトマスクの大写し部分を示す。CCA段階34は、各前景画素を囲む上で十分な大きさの長方形の境界の輪郭を定めている。図8gは、強影除去33後における部分的領域マスクの大写し部分を示す。単一の前景画素クラスタではなく、2つの別個のクラスタが存在する。図8hは、前景オブジェクト形成段階35後におけるオブジェクト分類マスクの大写し部分を示す。部分的領域マスク内においてCCA段階34によって定められた長方形の境界内にあるすべての前景画素は、共通する前景領域を表すとして分類されている。

【0059】

ソフトウェアレベルの動作を含む影除去段階のさらなる詳細が、出願者の同時係属英国特許出願番号0424030.5において開示されている。この英国特許出願、又は外国の同等物の完全な内容は、本明細書によって参照されることによって本明細書に組み入れられる。

【0060】

オブジェクト追跡

映像処理ソフトウェアに関するこれまでの説明は、着信映像フレーム内において存在する可能性がある前景領域を識別するように及び影及び強調の影響を影除去段階17によって軽減するように構成された段階に集中している。本節は、後続する段階、すなわちオブジェクト追跡段階5の動作について説明する。

【0061】

影除去段階17からの出力は、オブジェクト分類マスクを表す映像データであり、前記オブジェクト分類マスク自体は、可能性のある(又は「候補」の)前景オブジェクトの形状を各々が表す1つ以上のブロブマスクを具備することができる。図8dに示されるオブジェクト分類マスク39においては、人及び車両の形状をそれぞれ表す2つのブロブマスク29A、29Bが存在する。オブジェクト追跡段階5は、現在のフレーム内のブロブマスクと1つ以上の以前のフレームにおいて既に識別されているブロブマスクとの間における対応性を識別するように構成される。このような方法で、前記前景オブジェクト又は各前景オブジェクトによってとられる経路を計算すること及びこの経路情報を軌跡データベースに記録することが可能である。前記経路情報は、映像モニター15において表示すること及び/又は例えばオブジェクトによってとられる経路に基づく挙動解析を行うように構成される高位アプリケーション7が利用できるようにすることが可能である。

【0062】

オブジェクト追跡原理が図9に示される。図9のaに関して、第1及び第2のオブジェクト130,132が第1のフレーム内に示され、各々のオブジェクトのフレーム位置がデカルト座標によって示されている。図9のb及び図9のcは、映像シーケンスの第2及び第3の連続フレーム内の第1及び第2のオブジェクト130、132を示す。両オブジェクト130、132は、各フレーム内での位置を変えており、オブジェクトの動きを示していることがわかるであろう。後述されるオブジェクト追跡段階5においては、各オブジェクト130、132によってとられる軌跡ベクトルが計算され、表示された軌跡ベクトルによって経路が表される。図9のd及び図9のeは、第2及び第3のフレームをそれぞれ受け取り後における各オブジェクト130、132と関連する経路を示す。図9のeは、これらの3つのフレームに関する累積経路を示す。計算された軌跡ベクトルを表すデカルト座標も示される。

【0063】

各ブロブマスクを追跡するためには、最初に、現在のフレーム内のブロブマスクと以前のフレーム内において識別されたブロブマスクとの間において対応性、すなわちマッチ性を確立させる必要がある。説明を明確化するため、以前のフレームにおいて識別されているブロブマスクは、以下では「オブジェクト」と呼ばれる。以下において詳細に説明されるように、ブロブマスクとオブジェクトの各組合せにマッチングコストCobが割り当てられ、前記コストは、各対間におけるマッチ度を示す。マッチングコストCobは、特徴に基づく対応性測定基準を用いて計算される。当業者によって理解されるように、特徴に基づく対応性測定基準は、複数の特徴を各オブジェクトから抽出することと、コスト関数においてこれらの特徴を用いて着信ブロブマスクとのマッチを識別すること、とを含む。代替として、テンプレートに基づく対応性測定基準を用いることが可能であり、この方法は、例えばヒストグラム又はカラーブロックの形の外観テンプレートを採用し、さらに、着信ブロブマスクが各テンプレートと比較されてマッチが見つけ出される。ブロブマスク及びオブジェクトの数が増加するのに従って、テンプレートに基づく方法は時間がかかる傾向があり、この理由のため、特徴に基づく方法が好ましい。

【0064】

特徴に基づく対応性方法における第1の段階は、着信フレームの各ブロブマスクから予め決められた特徴を抽出することである。この抽出は、図3に示されるように、オブジェクト特徴付け段階18によって行われる。複数の特徴は、各ブロブマスクと関連づけられた「特徴セット」を具備する。表1は、前記特徴セットの特徴を示し、これらの特徴は、比較動作において適切な結果を提供する特徴を識別するための広範な実験後に選択されたものである。これらの特徴は、4つの主な組、すなわち、位置、形状、色及びベクトルの各特徴に分類される。以下において説明されるように、右側の列は、位置特徴更新プロセスにおいて採用されるカルマンフィルタアルゴリズムに関連する。

【0065】

表1.オブジェクト特徴付け段階18によって抽出された特徴セット

【表1】

【0066】

図10に関して、ブロブマスク41の位置特徴が示されている。中心位置特徴43は、ブロブマスク41の質量/重力の中心である。バウンディングボックス45及びオブジェクトバウンディング楕円47も示されており、後者は、円周内の全画素を囲む上で十分な大きさである。バウンディングボックス45は、ブロブマスク41のすべての前景画素を囲む最小の長方形である。残りの特徴については自明である。

【0067】

各ブロブマスクに関する特徴セットを生成後は、各特徴セットがオブジェクト追跡段階5によって受信される。次に、図11を参照してオブジェクト追跡段階5の動作が説明される。

【0068】

図11に示されるように、オブジェクト追跡段階5は、幾つかの副段階55、57、59、63、65を具備する。第1の副段階55においては、上記のマッチングコストCobが、オブジェクト待ち行列に格納された(a)着信ブロブマスクと(b)オブジェクトの各組合せに関して計算される。オブジェクト待ち行列は、以前のフレーム、より正確には予め決められた数の以前のフレー、において識別されているオブジェクトに関連するデータを保持する。図12に関して、オブジェクト待ち行列71が表されている。各オブジェクトと関連づけられた特徴セットを格納することに加えて、状態パラメータ、追跡レコードパラメータ(TR)及び失われたレコードパラメータ(LR)を含むその他の幾つかのパラメータも存在することが注記される。

【0069】

第2の副段階57においては、ブロブマスクとオブジェクトとの間のマッチが識別される。第3の副段階59においては、オブジェクト待ち行列71が、前段階の結果に基づいて更新される。この更新は、マッチされたオブジェクトの位置以外の特徴の代わりに、マッチしたブロブマスクの対応する特徴を用いることが含まれる。位置特徴は、第3の副段階59においては更新されない。第4の副段階63においては、オブジェクト待ち行列71内の各オブジェクトと関連づけられた状態パラメータを、状態遷移オブジェクト管理方式を用いて更新することができる。前記状態遷移オブジェクト管理方式は、幾つかの特徴に基づいてオブジェクトの状態を決定する一組の規則を具備する。オブジェクトの状態は、前記オブジェクトを追跡又は削除するか、又はその状態パラメータを変更すべきかを決定する。前記状態遷移管理方式の一部として、ユーザーにとって重要である可能性がある真の前景オブジェクトではなくスプリアスオブジェクトを表しているかどうかを決定するためにオブジェクトを検査することも可能である。第5の副段階65においては、オブジェクト特徴予測は、マッチされたオブジェクトの位置特徴をカルマンフィルタアルゴリズム(後述される)を用いて更新する。オブジェクト待ち行列71が第1の副段階55に戻され、次のブロブマスクの組に関するマッチングコスト計算が、オブジェクト待ち行列内の各オブジェクトに関する前記更新された特徴セットを用いて行われる。

【0070】

上述されるように、第5の副段階65において、カルマンフィルタアルゴリズムは、オブジェクト待ち行列71内のマッチされたオブジェクトの位置特徴を更新する。より具体的には、前記アルゴリズムは、次のフレームの3つの位置特徴の各々の値を予測する。この予測は、オブジェクト待ち行列71内のオブジェクトを(動きに起因して)前記フレーム内の異なる位置を占める可能性がある着信ブロブマスクと成功裡に一致させるためには、第1の副段階55においてマッチングコスト計算を行う前に位置特徴を予測及び更新するのが有利であるという事実を反映したものである。カルマンフィルタアルゴリズムは、仮想処理システムにおいて共通して用いられる反復性アルゴリズムであり、その概念は、当業者によって良く理解されるはずである。カルマンフィルタに関するさらなる情報が、グレッグ・ウェルチ及びゲーリー・ビショップによる"An Introduction to the Kalman Filter", SIGGRAPH 2001 Course 8, Computer Graphics, Annual Conference on Computer Graphics & Interactive Techniques, ACM Press, Addison-Wesley, Los Angeles, California, USA, August 2001 Course Pack(「カルマンフィルタ入門」、SIGGRAPH 2001 課程8、コンピュータグラフィックス、コンピュータグラフィックス及び対話技術に関する年次会議、ACMプレス、アディソン−ウェズレイ、ロサンゼルス、カリフォルニア、米国、2001年8月コースパック)において開示されている。この文書は、現在は、http://www.cs.unc.edu/−tracker/media/pdf/SIGGRAPGH2001 CoursePack 08.pdfにおいて入手可能である。

【0071】

表1の右側の列に関して、中心位置特徴(xco, yco)は、2次カルマンフィルタを用いて予測されることが注記される。このことは、各ブロブに関する速度特徴(vx0, vy0)を予測するのを可能にする。速度特徴(vxo, vyo)は、中心位置特徴の第1の導出関数であり、第4の副段階63において採用される状態遷移オブジェクト管理方式において用いられる。

【0072】

特徴セットの残りの位置以外の特徴は、第3の副段階59において、現在の値を、これらの特徴がマッチするブロブマスクの対応する特徴値に代えることによって更新される。カルマンフィルタリングプロセスは、計算集中型であるため、メモリ及び処理電力を節約するのに役立つ。

【0073】

次に、上述される副段階の各々がさらに詳細に説明される。

【0074】

第1の副段階55においては、以下の測定基準を用いてマッチングコスト関数Cobが各ブロブマスクに割り当てられる。

【数4】

【0075】

この測定基準は、一般的にはマハラノビスの距離測定基準と呼ばれ、オブジェクト待ち行列71内に格納されたブロブマスク特徴セットfib及びオブジェクト特徴セットfioからのすべての特徴を結合させて1つの好都合なコスト関数Cobにする(ここで、共分散行列は単位行列であると仮定されている)。パラメータσは、以前の観測に関して計算されたfioの標準偏差である。以前の観測数は50のフレームであるのが好ましいが、初期状態においては、前記標準偏差は、明らかに、50のフレームが受信されるまでより少ない観測を用いる。コスト関数Cobの値が低いほど、ブロブマスクとオブジェクトとの間のマッチがより優れている。

【0076】

コスト関数Cobは、(a)現在のフレーム内のブロブマスク及び(b)オブジェクト待ち行列71内に格納されたオブジェクトの各組合せに関して計算される。この動作は、図13において例示されており、前記図は、オブジェクト待ち行列71及び3つのブロブマスクと関連する特徴セットリスト72の両方を示す。これらのブロブマスクは、A、B及びCのラベルが貼付され、オブジェクトは、D、E及びFのラベルが貼付される。図12に示されるように、第1の副段階55からの出力は、各対の結果を示す格子として表すことができる「対応リスト」である。表2(下表)は、3つのブロブマスクA、B及びC、及び3つのオブジェクトD、E及びFを格納するオブジェクト待ち行列を有する着信フレームが関わるマッチングコスト計算に関する典型的対応リストである。格子内の数字は、各々の対に関するコスト関数Cobである。

【表2】

【0077】

コスト関数Cobの値に関してしきい値Tcが設定される。具体的には、CobがTcよりも上、例えば12である場合は、前記値は、対応リストには入れられない。Cobの値が大きい場合は、特徴セット間の対応度が低いことを示しており、このため、相対的に大きいCob値を生み出す対は直ちに捨てることができる。このことは、要求される処理量を低減させる。上例からわかるように、ブロブマスクBとオブジェクトDの対に関するコスト関数Cobは、12よりも上であり、このため、この値は対応リストには入れられない。

【0078】

要求される処理量をさらに低減させるために、コスト関数Cobが漸進的に計算されるように早期ジャンプ戦略が採用される。各々の新たな特徴との比較に応じてCob値が増加するのに従い、CobがTcと比較される。Cob > Tcである場合は、計算が直ちに停止し、現在の対は対応リストには入れられない。

【0079】

第2の副段階57において、対応リストを用いて最良のマッチを見つけ出す作業が行われる。最低のコスト関数Cobを有する対を識別するためにグローバルな探索が行われる。上例においては、ブロブマスクAとオブジェクトEを対にすることは、最低のコストが得られる。この対にすることは、「マッチされた」とみなされ、ブロブマスクA又はオブジェクトEが関係するその他のあらゆる対、すなわち、A&D、A&F、B&E及びC&Eは、対応リストから取り除かれる。最終結果は、オブジェクトが各ブロブマスクと対応することを示す「マッチリスト」である。表3は、上例の結果得られたマッチリストを示す。

【表3】

【0080】

上例において、各ブロブマスクは、待ち行列内のオブジェクトとマッチされている。しかしながら、最良のマッチを見つけ出す段階57の結果得ることが可能な2つのその他のシナリオが存在する。ブロブマスクがオブジェクト待ち行列内のいずれのオブジェクトともマッチしない場合は、コスト関数Cobは、すべてのオブジェクト比較に関してTcを上回ることになり、前記ブロブマスクは映像シーケンス内の「新しい」オブジェクトを表すと想定することができる。いずれのブロブマスクともマッチしないオブジェクトがオブジェクト待ち行列内に存在する場合は、前記オブジェクトは映像シーケンスから「消えている」と想定することができる。「新しい」及び「消えている」という表現は、状態の見出しの下で待ち行列内に格納することができる2つの型のオブジェクト状態を表す。以下において明確になるように、追跡をより効果的に及び効率的に行うために異なる状態を有するオブジェクトに関して異なる追跡戦略を採用することができる。特に、本発明では、オブジェクトの追跡歴を記録するかどうを決定するために前記オブジェクトの状態を用いる。

【0081】

第3の副段階59において、オブジェクト待ち行列が更新される。上述されるように、この更新は、待ち行列内においてマッチされた着信ブロブマスクを有するオブジェクトに関する位置以外の特徴を更新することを含む。

【0082】

第4の副段階63においては、各オブジェクトの状態が必要に応じてモニタリング及び更新される。より具体的には、各オブジェクトは、その値に依存して前記オブジェクトを追跡すべきかどうか及び/又はオブジェクト待ち行列から削除すべきかどうかを決定する状態が割り当てられる。オブジェクトに割り当てられる状態は、映像シーケンス内において発生する可能性がある様々なシナリオを考慮する状態遷移管理方式によって決定される。次に、2つの異なる状態遷移オブジェクト管理方式が説明される。

【0083】

単純追跡方式

映像シーケンスが互いを隠さない幾つかのオブジェクトを具備すると仮定した場合は(隠すとは、オブジェクトの一部又は全部が他のオブジェクトによって隠されて見えないことを意味する)、相対的に単純な追跡方式を採用することができる。この追跡方式は、図14に示される状態遷移オブジェクト管理方式によって代表され、第4の副段階63において待ち行列71に格納された各オブジェクトに対して適用される。

【0084】

図14に関して、オブジェクト待ち行列71内の各オブジェクトは、2つの主な状態のうちの1つ、すなわち「新しい状態」又は「真の状態」を占めることになる。「新しい」オブジェクトは、予め決められた数のフレームToに関して着信ブロブとマッチしていないオブジェクトであると定義される。前記「新しい」オブジェクトがToのフレームに関して着信ブロブといったんマッチした時点で、前記オブジェクトは「真」とみなされ、追跡目的のためにその位置が記録される。他方、オブジェクトが異なる予め決められた数のフレームTOMに関して着信フレームとマッチしていない場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。この実施形態においては、Toは、10のフレームに設定され、TOMは5つのフレームに設定される。

【0085】

オブジェクトの現在の状態は、オブジェクト待ち行列71内の状態パラメータによって定義される。次に、流れ図の各ステップに関して、第1のステップ75においては、前記オブジェクトの状態は、このフレーム期間においていずれの追加ステップが前記オブジェクトに対して適用されるかを決定する。前記オブジェクトが現在「新しい」として分類されており、ステップ77Aにおける決定により着信ブロブマスクとマッチする場合は、ステップ77BにおいてTRパラメータが増やされる。後続ステップ77Cにおいて、TRがToよりも大きいかどうかの試験が行われる。TRがToよりも大きい場合は、ステップ77Dにおいて、前記オブジェクトがスプリアスであるかどうかを決定するためのさらなる試験が行われる(この試験は、以下において詳細に説明される)。前記オブジェクトがスプリアスであるとみなされた場合は、ステップ77Eにおいてオブジェクト待ち行列から削除される。前記オブジェクトがスプリアスであるとみなされない場合は、オブジェクト待ち行列内の状態パラメータが「真」に変更される。ステップ84の結果が否定である場合は、オブジェクト待ち行列71内の状態パラメータは「新しい」として維持される。

【0086】

前記オブジェクトが現在「真」として分類されており、着信ブロブマスクとマッチしている場合は、その状態パラメータは「真」として維持される。ステップ79Aにおいてマッチしていない場合は、ステップ79BにおいてLRパラメータが増やされる。次のステップ79Cにおいて、前記オブジェクトが今回の場合は5つのフレームに関して着信ブロブマスクとマッチしていないことを示すTOMよりもLRが大きいかどうかが決定される。LRがTOMよりも大きい場合は、ステップ79Dにおいて前記オブジェクトがオブジェクト待ち行列から削除される。

【0087】

オブジェクト待ち行列71内において「真」と分類されるオブジェクトが追跡される。この追跡は、フレーム内の各「真の」オブジェクトの座標を記録し、さらにより多くのフレームが受信されるのに従って前記オブジェクトによってとられる軌跡を計算することによって行われる。この軌跡情報は、表示のために又はより高位のアプリケーション7による処理のために前記追跡情報を利用可能にする軌跡データベース内に格納される。好ましいことに、「真の」状態を有するオブジェクトは、バウンディングボックスによって囲まれた形で映像モニター15に表示される。前記軌跡情報は、前記オブジェクトによってとられた累積経路を示すトレールラインを作図するために用いられる。複数のオブジェクトを追跡中である場合は、前記トレールラインは、異なる各々の色で作図することができる。

【0088】

スプリアスオブジェクトの識別

第4の副段階63の一部として、図14のステップ77Dによって示されるように、オブジェクト待ち行列内の各「新しい」オブジェクトに関してスプリアスオブジェクト識別が行われる。具体的には、第4の副段階63は、各オブジェクトの動きに関する特徴を解析し、前記オブジェクトがスプリアスな前景領域を表しているかどうかを決定する。この点に関して、前景抽出段階3の動作は、一定の画像領域がユーザーにとって重要である前景オブジェクトを表していないにもかかわらず前景として分類される可能性がある。従って、後続の処理動作がこれらのオブジェクトに関して行われないようにこれらのオブジェクトを識別する価値がある。

【0089】

前景抽出段階3においてスプリアス領域が生成される可能性がある理由は幾つかある。樹木の葉又は枝の動き等の反復する動きの存在が共通する原因である。これらの葉は、背景モデルに関して動いているため、これらの葉を表す画素は、前景画素として分類することができる。しかしながら、この領域の画素は真の前景を表しておらず、このためこのような領域は、一般的にはスプリアスとみなされる。映像処理ソフトウェアも全体的なシステム内にノイズを導入する可能性がある。ノイズのある画素は、前景抽出段階3によって前景画素として解釈される可能性がある。いずれの場合も、スプリアス領域の軌跡を記録することによって処理資源とメモリ資源を浪費するのは望ましくない。この理由により、スプリアスであるとみなされるオブジェクトを識別してその後に除去するためのスプリアスオブジェクト識別が採用される。

【0090】

シーン内のノイズ及び/又はランダムな動きの影響を例示するため、図15a乃至15cが参照される。図15aは、背景学習段階1において生成された背景モデルを示す。前記背景モデルは、動いているオブジェクトが存在しない駐車場を示す。図15bは、3つの前景オブジェクト、すなわち、駐車場内を歩いている人、駐車場から出る車両及びフレームの左側において車両の近くを歩いている人が存在する着信映像フレームを示す。図15cは、前景抽出後の前景マスクを示す。上記の3つのオブジェクトを表している画素は、前景領域として正確に分類されている。これらの領域は、監視目的に関するものであり、これらの領域の軌跡は、オブジェクト追跡段階5によって追跡すべきである。しかしながら、特にフレームの右上の樹木領域において、幾つかのその他の白いエリアが存在している。これらの白いエリアは、可視の前景オブジェクトを表していないにもかかわらず前景として分類されている画素を表す。これらはスプリアス領域の例であり、その存在は、樹木のノイズ及びランダムな動きに起因する。明らかなことに、これらのオブジェクトの追跡は望ましくない。

【0091】

スプリアス領域を識別するために、オブジェクト待ち行列80内の各「新しい」オブジェクトによって示される動きがモニタリングされる。動きに関する一定の特徴は、複数のフレームにわたって測定時には、スプリアス効果を一般的に発生させるランダムな動き及び/又はノイズの影響を示す可能性があることが注記される。従って、図14のオブジェクト管理方式のステップ85において、映像処理ソフトウェアは、例えばこれらのブロブマスクをオブジェクト待ち行列80から削除することによって適切な措置を講じることができるようにするために、これらの動き上の特徴を有するオブジェクトを削除するように動作可能である。

【0092】

第1の例として、ほとんどの監視用途においては、ほとんど又はまったく動きを示さない真の前景オブジェクトが突然フレーム内に現れる可能性はない。このことは、映像コーデック内の量子化誤差によって引き起こされるスプリアス領域を示す可能性がある。従って、オブジェクト待ち行列内において動きがほぼゼロであって「新しい」と分類されるあらゆるオブジェクトがスプリアスとみなされる。前記オブジェクトは、好ましいことに、オブジェクト待ち行列71から除去されるか又は十分な時間にわたって追跡されている場合においても「真の」オブジェクトに変更されるのが少なくとも防止される。

【0093】

オブジェクトによって示される動き量を測定するために、前記ソフトウェアは、前記オブジェクトの中心点(xcb, ycb)の位置を複数のフレームにわたってモニタリングする。この情報は、オブジェクト待ち行列80内の特徴セット情報から入手可能である。中心点(xcb, ycb)の動きは、前記中心点位置の分散(σcx2, σcy2)によって定義することも可能であり、前記分散は、以前のフレームにわたって取得された値から導き出される。この場合は、中心点位置の分散がほぼゼロである「新しい」オブジェクトは、スプリアスとみなされる。

【0094】

第2の例として、ノイズ又はその他の現象(例えば波のような動きをしている葉)等のランダムな影響によって生成されるオブジェクトは、通常はランダムな動きを示す。この型の動きは、中心点位置の大きな分散(σcx2, σcy2)を呈し、中心位置の速度のさらに大きな分散(σvx2, σvy2)を呈する。この場合は、ステップ85は、複数のフレームにおける中心点位置の変化(又は分散)及び速度の変化(又は分散)の両方の計算を要求する。両値が各々のしきい値を上回る場合は、前記オブジェクトはスプリアスとみなされてオブジェクト待ち行列71から取り除かれる。

【0095】

好都合なことに、上記状況のいずれか/両方は、位置分散と速度分散の比に基づいていわゆる動き率ζmを用いて検出することができる。x座標及びy座標の両方を考慮に入れるため、前記動き率は、好ましいことに次式によって与えられる。

【数5】

【0096】

ここで、σcx2及びσcy2は、x方向とy方向におけるそれぞれの位置変化であり、σvx2及びσvy2は、x方向及びy方向におけるそれぞれの速度分散であり、τは、前記オブジェクトが完全に静止した状態であり(それによって分母をゼロにする)場合に動き率が急増するのを防止する予め決められた定数である。本実施形態においては、0.1の値がτに関して用いられる。

【0097】

オブジェクトに関する位置分散値及び速度分散値は、好ましいことに、予め決められた数の以前に取得されたフレームにわたる前記オブジェクトの位置及び速度に関してフレームごとに計算される。前記フレーム数は、フレーム取得速度に依存して変化可能である。1秒当たり25フレームの取得速度に関しては、5乃至10のフレームのウィンドーが適切である。例えば5つのフレームのウィンドーを用いる場合は、現在のフレームt内のオブジェクトの中心点位置の分散は、以前の5つのフレーム(t−1、t−2、t−3、t−4、t−5)にわたる平均位置を現在位置から減じることによって計算する。同様に、速度分散は、以前の5つのフレームにわたる平均速度を最後に記録された速度から減じることによって計算する。この点に関しては、速度は、個々のフレーム間における位置の変化を表すことが理解されるであろう。次のフレームt+1が受信されたときは、前記オブジェクトに関する位置分散及び速度分散は、フレームt、t−1、t−2、t−3及びt−4を具備する更新されたウィンドーに関して計算される。

【0098】

動き率が予め決められたしきい値Tζと比較されて前記オブジェクトの動きが規則的であるかどうかが決定され、このため以下のようになる。

【0099】

ζm > Tζである場合は、動きが規則的である−スプリアスでない

ζm > Tζでない場合は、動きが不規則である−スプリアスである

この実施形態においては、Tζの値は、2.5に設定される。この値は、人及び車両の通常の動きのモニタリングを含む毎秒25フレームの映像取得速度に関して当てはまることがわかっている。相対的に一定の動きを含む低速の動きのシナリオに関しては、Tζの値は、より多くのノイズを除去するためにより高い値に設定することができる。動きが突然変化する高速の動きのシナリオに関しては、Tζの値は、大きな速度変化に耐えるために2.5よりもわずかに小さい値に設定すべきである。実際には、2つの値範囲が提供され、第1の下方の範囲は、不規則なオブジェクトの動きを示し、上方の範囲は、真の前景オブジェクトと関連する規則的な動きを示す。

【0100】

要約すると、この副段階は、現在のフレームと前フレームとの間における動きがノイズ又はランダムな動き等のスプリアス効果を示す前景オブジェクトを識別するように構成される。この動きが、予め決められた数の以前のフレームにわたって記録された位置特徴のスライディングウィンドーと比較され、x方向とy方向における現在の位置分散と速度分散が決定され、前記分散は、予め決められた限度外にある場合は、後続する追跡段階から無視することができる不要なオブジェクトが存在することを示す。要求される場合は、システムは、前記検出されたスプリアスオブジェクトを表している画素の代わりに背景モデルからの画素を表示することによって、前記スプリアスオブジェクトの表示を抑止することができる。

【0101】

高度追跡方式

単純追跡方式においては、フレームシーケンス内において現れるオブジェクトは、その他のオブジェクトによって隠されない、又は一時的に視界から消えないと想定される。この理由により、図14の状態遷移管理方式は、オブジェクトを追跡すべきか又はオブジェクト待ち行列から削除すべきかを決定するために、2つの主な状態、すなわち「新しい」状態及び「真の」状態のみを要求する。しかしながら、ほとんどの実際の監視状況においては、オブジェクトは、あらゆる時点にシーン内のあらゆる場所に現れるか又はシーン内のあらゆる場所から消える可能性がある。オブジェクトは、数フレームだけ消えてその他の場所に再び現れることがある。複数のオブジェクトがシーンを横切り、互いを隠し、その後に分離することが可能である。この理由により、第4の副段階63において複雑な状態遷移管理方式を利用する高度追跡方式が提供される。この状態遷移管理方式が図16に示される。

【0102】

図16に関して、オブジェクト待ち行列内の各オブジェクトは6つの主な状態、すなわち「新しい」100、「成熟」101、「一時的に入手不能」102、「隠されている」103、「消えている」104及び「再び現れている」105のうちの1つを占めることがわかるであろう。各着信フレームに関して、オブジェクト待ち行列内のオブジェクトは、それぞれの状態を維持すること、それぞれの状態を変えること、又はオブジェクト待ち行列から削除されることができる。図14の管理方式における場合のように、各状態は、前記各状態を占めるオブジェクトを追跡(すなわち、その動き軌跡を記録及び表示)すべきか、削除すべきか、及び/又は新たなフレームが受信されたときに前記オブジェクトがどのように挙動しているかを反映させるようにその状態を変化させるべきか、を決定するための異なる追跡戦略を採用する。

【0103】

次に、前記管理方式の各状態が説明される。

【0104】

新しい100 該オブジェクトは、たった今、又はつい最近にシーン内に現れている。前記オブジェクトは、例えばランダムノイズに起因するスプリアスである可能性があり、このため、真の前景オブジェクトとして受け入れることができる前に前記オブジェクトの信頼度を累積する必要がある。この累積は、図13において描かれる単純管理方式と同様の方法で、すなわち、ステップ100aにおいてマッチング動作を行い、着信ブロブマスクとマッチする場合は追跡記録(TR)を増やすことによって行われる。ステップ100cにおいて、前記オブジェクトが予め決められた数の連続フレームTo、例えば10フレーム、に関してマッチしている場合は、ステップ100dに入り、上記のスプリアス試験が行われる。ステップ100aにおいてマッチされないか又はステップ100dにおいて前記オブジェクトがスプリアスであるとみなされた場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。ステップ100dにおいて前記オブジェクトがスプリアスであるとみなされない場合は、前記オブジェクトに関する特徴セットが更新され、その状態が「成熟」になる。

【0105】

成熟 該オブジェクトは、真の前景オブジェクトとして受け入れられている。こ101 の場合は、映像処理ソフトウェアは、前記オブジェクトを囲んだバウンデ

ィングボックスを映像モニター15に表示する。さらに、追加のフレームが受信されたときに前記オブジェクトの動きが追跡され、軌跡情報が格 納及び映像モニター15に表示される。前記オブジェクトがステップ101aにおいて着信ブロブマスクとマッチし続ける場合は、前記オブジェクトの状態は引き続き「成熟」状態になる。しかしながら、マッチしない場合は、前記オブジェクトがオブジェクト待ち行列80内の他のオブジェクトとオーバーラップするかどうかを決定するための試験がステップ101bにおいて行われる。このオーバーラップは、これらの2つのオブジェクトのバウンディングボックスがオーバーラップしている場合に発生する。オーバーラップしている場合は、前記オブジェクトが更新され、このためその状態は「隠されている」である。オーバーラップが存在しない場合は、失われたレコード(LR)パラメータがステップ101cにおいて‘1’に設定され、前記オブジェクトの状態が「一時的に入手不能」に更新される。

【0106】

一時的に オブジェクトは、幾つかの理由で一時的に入手不能になることがある。前入手不能 記オブジェクトは、ノイズによって壊されていること、他のオブジェクト 102 の背後に消えていること、又は単にシーンから出ている場合がある。前記

オブジェクトがステップ102aにおいて着信ブロブマスクと再度マッチする場合は、前記オブジェクトは、再度シーン内に入っており、このためその状態は「成熟」に戻る。マッチがない場合は、ステップ101bのオーバーラップ試験がステップ102bにおいて繰り返され、隠されているかどうかが試験される。隠されていない場合は、ステップ102cにおいてLRが増やされ、ステップ102dにおいてしきい値Toiと比較される。Toiは、成熟オブジェクトが失われたとみなされる前に前記成熟オブジェクトが紛失している可能性があるフレーム数である。従って、LRがToiよりも大きい場合は、前記オブジェクトの状態が「消えている」に変更される。LRがToiよりも小さい場合は、「一時的に入手不能」として状態が維持される。この状態においては、前記オブジェクトは、その軌跡情報が格納及び表示されるようにするために依然として追跡される。

【0107】

隠されている この場合は、該オブジェクトがオブジェクト待ち行列内のその他のオ 103 ジェクトとオーバーラップしている。この状態は、例えば、オブジェクト

がディスカッションに関わっている2人以上の人を表している場合又はこれらの人のうちの1人が他の1人の後ろに立っている場合に生じる可能性がある。この場合は、個々の特徴の描写を抽出及び更新することができない場合がある。しかしながら、対象となるオブジェクトを隠しているオブジェクトのバウンディングボックス特徴がその位置に関して幾つかの制約を提供する。ステップ103aにおいて、前記オブジェクトが着信ブロブマスクとマッチされている場合は、前記オブジェクトの状態は再度「成熟」であり、前記オブジェクトが隠しているオブジェクトから分離されていることを示す。マッチしてない場合は、ステップ103bは、オーバーラップが依然として存在するかどうかを決定し、オーバーラップしている場合は、前記オブジェクトの「隠されている」状態が維持される。オーバーラップがない場合は、ステップ103cにおいてLRが1に設定され、状態が「消えている」に変更される。「成熟」及び「一時的に入手不能」と同様に、前記オブジェクトは依然として追跡され、その軌跡情報が格納及び表示される。

【0108】

消えている オブジェクトの状態が「消えている」に達した場合は、前記オブジェクト104 がシーンから完全に出ているか、又は例えば樹木の後ろを歩くか又は建物

のドアを通ることによって背景オブジェクトの後ろに隠された状態になったことを反映させることになる。ステップ104aにおいて、前記オブジェクトが着信ブロブマスクと再度マッチされた場合は、ステップ104eにおいてTRが1に設定され、状態が「再度現れている」に更新される。しかしながら、このことは、しきい値TOMによって設定された一定数の フレーム内において起きなければならない。ステップ104aにおいてマッチが行われない場合は、ステップ104bにおいてLRが増やされ、ステップ104cにおいてTOMと比較される。LRがTOMよりも大きい場合は、前記オブジェクトは、ステップ104dにおいてオブジェクト待ち行列から削除される。その他の場合は、前記オブジェクトの状態は、「消えている」に維持される。この状態においては、前記オブジェクトに関する追跡は行われない。

【0109】

再び現れて この状態においては、以前に「消えている」として分類されているオブジェいる クトが、相対的に短時間のうちに、再びシーン内に現れている。この再出現、

105 は、前記オブジェクトが、例えば建物のドアから中に入った後に短時間で前記ドアから再び現れた場合に生じることが可能である。このオブジェクトの状態を「成熟」に戻す前に前記オブジェクトに関する信頼度を累積させることが望ましい。従って、前記再び現れたオブジェクトがステップ105aにおいて着信ブロブマスクとマッチしないかぎり、前記オブジェクトは、ステップ105aにおいてオブジェクト待ち行列から削除される。マッチングが行われた場合は、ステップ105bにおいてTRが増やされてステップ105cにおいてさらなるパラメータTorと比較される。TRがTorを超える上での十分な信頼度を前記オブジェクトが構築しないかぎり、その状態は「再び現れている」にとどまる。TRがTorを超えている場合は、ステップ105dに入り、ステップ105dにおいて上記のスプリアス識別試験が行われる。前記オブジェクトがスプリアスであるとみなされた場合は、前記オブジェクトは、オブジェクト待ち行列80から削除される。前記オブジェクトがスプリアスであるとみなされない場合は、前記オブジェクトの状態が「成熟」に更新される。「消えている」状態においては、前記オブジェクトに関する追跡は行われない。

【0110】

高度追跡方式に関する追加のマッチングコスト

これまでは、オブジェクト追跡段階5の第1の副段階55は、方程式(2)によって定義され、最良のマッチ発見副段階57における解析用の単一の対応リストを生成する単一のマッチングコストCobを採用している。このマッチングコストCobは、単純追跡方式及び高度追跡方式の両方に関して適切に機能する。しかしながら、高度追跡方式において提供される追加の状態を考慮した場合は、オブジェクトが特定の状態を有するときにこれらのオブジェクトの特徴を考慮する幾つかのマッチングコストを提供するのが有利である。従って、代替実施形態においては、3つのマッチングコストが提供される。すなわち、(i)方程式(2)とまったく同じであるCob、(ii)方程式(2)とまったく同じであるが、特徴セットのnp0を考慮しないCno−numpels、及び(iii)方程式(2)とまったく同じであるが特徴セットの速度特徴(vxo, vyo)を考慮しないCno−velである。

【0111】

第1の副段階55によって1つの対応リストが生成される代わりに、以下の規則に基づいて4つの対応リストが生成される。

【0112】

Lold−すべてのブロブマスクとオブジェクトの対を含む対応リスト。ここで、Con<Tc及び状態 ≠「新しい」

Lnew−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Con<Tc及び状態 =「新しい」

Lno−numpels−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Cno−numpels<Tc及び状態 は、「成熟」、「一時的に入手不能」又は「隠されている」

Lno−vel−ブロブマスクとオブジェクトのすべての対を含む対応リスト。ここで、Cno−vel<Tc及び状態は、「成熟」、「一時的に入手不能」又は「隠されている」

ここで、Tcは、好ましいことに依然と同じ値、すなわち12を有する。

【0113】

第1の副段階57において、Lold、Lnew、Lno−numpels及びLno−velの順序に従い、各対応リストに関するグローバル探索が順次で行われる。この順序は、より高い信頼度を有する「成熟」オブジェクトが「新しい」オブジェクトよりも前に処理されることを保証する。

【0114】

Lno−numpelsリストは、npo特徴に関する情報を含まないCno−numpelsの効力によって、ブロブマスク画素数の突然の変化による有意な影響を受けないコスト関数値を具備する。この点に関して、背景減算誤差、又は部分的覆い隠し状況がnpo値の突然の変化を引き起こす可能性があり、さらにそのことが有効なマッチが行われるのを妨げる可能性がある。前記のような状況は、車両が部分的にシーンから抜け出て短時間後に戻る場合に発生する可能性がある。

【0115】

Lno−velリストは、「隠された」状態においてはオブジェクトの特徴はカルマンフィルタリングプロセスによって更新されるために用いられる。速度特徴(vxo, vyo)を無視しない場合は、オブジェクトが隠しているオブジェクトから分離した場合に前記オブジェクトが追跡されない可能性がある。この理由は、カルマンフィルタは、隠しているオブジェクトの特徴に基づいて隠されているオブジェクトの速度を予測するためである。

【0116】

Lno−numpels及びLno−velの対応リストがスプリアスオブジェクト及びノイズによる影響を受けないようにするため、本発明では、コスト関数Cno−numpels及びCno−velの計算を、状態「成熟」、「一時的に入手不能」又は「隠されている」を有するオブジェクトに制限する。

【0117】

追加のマッチングコストを高度追跡方式とともに用いることは、効率的でかつ強固な動作を提供する。隠されている又は一時的に消えているオブジェクトを、向上された信頼度を持って追跡することができる。

【0118】

Lold、Lnew、Lno−numpels及びLno−velに関して実行されるステップの順序が図17の流れ図に示されている。グローバル探索は、Loldを取得すること(ステップ109)と、対応リスト内の最低コスト関数を識別してマッチされているブロブマスクとオブジェクトの対をマッチリストに転送すること(ステップ111)と、前記マッチされたブロブマスク又はオブジェクトの結果得られた残りのコスト関数を取り除くこと(ステップ113)と、対応リストが空であるかどうかを決定すること(ステップ115)、とを具備する。対応リストが空である場合は、ステップ117において次の対応リストが取得され、プロセスがステップ109から繰り返す。対応リストが空でない場合は、現在の対応リストを用いて空になるまでステップ111が繰り返される。4つ対応リストの各々が空であるときに、第3の副段階59においてオブジェクト待ち行列が更新される。

【0119】

初期条件

オブジェクト追跡段階5に関する上記の説明は、オブジェクト待ち行列71には少なくとも1つのオブジェクトが存在すると仮定している。しかしながら、映像処理ソフトウェアが最初に動作されるとき、又は映像シーンにおいて活動がないときには、オブジェクト待ち行列71は空になる。このことは、ブロブマスクの組がオブジェクト追跡段階5によって受け取られたときに前記オブジェクトと比較すべきオブジェクトが存在しないことを意味する。この場合は、これらのブロブマスクは「新しい」オブジェクトとしてオブジェクト待ち行列71内に入れられるが、第4の副段階63において状態遷移管理方式によって処理されない。第5の副段階65においては、カルマンフィルタアルゴリズムは、各オブジェクトに関する位置特徴を予測及び更新する。次のフレームが受信されたときに、オブジェクト追跡段階5は、前述されるように動作し、現時点におけるオブジェクト待ち行列71は、着信ブロブマスクを比較するための1つ以上のオブジェクトを含んでいる。

【0120】

軌跡情報

「真」(単純追跡方式の場合)又は「成熟」、「一時的に入手不能」又は「隠されている」(高度追跡方式の場合)として分類されているブロブマスクに関して、軌跡情報がオブジェクト状態更新副段階63によって生成される。この軌跡情報は、各追跡されたオブジェクトに関して、中心位置のデカルト座標、及び前記中心位置が関連するオブジェクトのアイデンティティを具備することができる。代替形態の軌跡情報、例えば、変位情報又はベクトル情報も生成可能である。図18に関して、軌跡情報は、軌跡データベースである第1の高位アプリケーション121によって受け取られる。軌跡データベース121は、前記軌跡情報を格納し、シーン上において各オブジェクトによってとられた経路を前記軌跡情報からリアルタイムで計算する。軌跡データベース121は、表示制御アプリケーションである第2の高位アプリケーション123によって受け取られる経路データを出力する。

【0121】

表示制御アプリケーション123は、PC13のハードドライブに格納された映像データを映像モニター1に表示することを制御する。表示制御アプリケーション70は、図3に示されるすべての処理段階から映像データを受け取ることができ、前記映像データによって表されている映像シーケンスをリアルタイムで又はその他の形で表示するように構成される。オペレータは、複数の画像を単一の画面上で見ることができる。例えば、オペレータは、背景モデル19及びオブジェクト分類マスク39の両方を同時に見るのを希望することができる。オペレータにとって特に関心があるのは、軌跡データベース21からの経路データである。表示制御アプリケーション123からの処理後フレーム125が図19に示されている。前景オブジェクト23、25に対応するブロブマスクは、「真」として識別され、その軌跡が軌跡データベース121に記録されている。結果的に得られた経路データは、現在のフレームにまで至る映像セグメントのコースにわたってオブジェクトによってとられた累積経路をそれぞれ表すトレールライン129、127を生成する。図19には示されていないが、前記軌跡データベースは、異なるオブジェクトとの関連性を示すための異なる色を各トレールライン129、127に割り当てる。

【0122】

さらに高位のアプリケーション7を提供することができる。例えば、オブジェクト分類アプリケーションは、影除去段階17からのブロブマスクを「現実の」オブジェクトのテンプレートと比較することができる。マッチが存在する場合は、前記オブジェクト分類アプリケーションは、図19に示されるように、バウンディングボックスの隣のオブジェクトを識別するラベルを表示することができる。

【0123】

要約すると、上述されるオブジェクト追跡段階5は、各オブジェクトが特定の状態を有するとして分類する状態遷移オブジェクト管理方式を提供することによって改良されたオブジェクト追跡を提供する。オブジェクトが分類される状態は、前記オブジェクトが追跡されるかどうか、すなわちその動き軌跡が記録されるかどうか、及び現在の状態を特に現在の状態に関する予め定められた規則に基づいて維持又変更すべきかを決定する。

【0124】

インテリジェント監視システム19の性能は、幾つかの実際上の状況からの結果を示した図20乃至22を参照することによってより良く理解されるであろう。各々の場合において、上述される高度追跡方式が採用された。

【0125】

図20のa乃至図20のbにおいて、映像シーケンスの4つのフレームが示されている。図20のaにおいては、単一のオブジェクト、すなわち車、がフレームの左端において識別されている。この時点においては、前記オブジェクトの状態パラメータは「成熟」である。識別は、前記車を囲んでいるバウンディングボックスによって確認される。図20のb及び図20のcにおいては、前記オブジェクトは、フレームの縁から消え始める。しかしながら、Cno−numplesコスト関数を用いたマッチングが行われ、このため、画素数の突然の減少は結果に対して重大な影響を及ぼさない。状態は「成熟」に維持され、前記オブジェクトは引き続き追跡される。図20のdにおいては、前記オブジェクトは、再び視界内に現れ、依然として追跡されている。

【0126】

図21のa乃至21のdにおいて、さらなる映像シーケンスの4つのフレームが示されている。図21のaにおいては、第1及び第2のオブジェクトがフレームの左下の方向において識別されている。この時点においては、各オブジェクトの状態パラメータは、「成熟」である。図21のb及び21のcにおいては、前記2つのオブジェクトは、互いに接近して各々のバウンディングボックスをオーバーラップさせる。この場合は、大きい方のオブジェクトの状態パラメータは、「成熟」として維持され、小さい方のオブジェクトの状態パラメータは、「隠されている」に変更される。この理由は、結合されたブロブマスクは大きい方のオブジェクトのバウンディングボックスにより似ているためである。しかしながら、カルマンフィルタは、現在の特徴セットに基づいて小さい方のオブジェクトの位置の予測を続ける。さらに、小さい方のオブジェクトの速度特徴を無視するCno−velコスト関数を用いたマッチングが行われ、このため、後続フレームとのマッチが行われて状態パラメータが再度「成熟」状態になる。図21のdに示されるように、いずれの時点においても、追跡は停止しておらず、両オブジェクトは、それぞれのバウンディングボックスが分離するまで正確に追跡される。

【0127】

最後に、図22のa乃至22のdにおいて、さらなる映像シーケンスの4つのフレームが示されている。この場合は、前記映像シーケンスは、魚眼レンズを有するカメラを用いて取得され、前記カメラの使用は、現代の映像監視システムにおいては一般的である。図21のaにおいては、第1のオブジェクト、すなわち移動中の車両、がフレームの左側方向において識別される。フレームの右側方向に位置する第2のオブジェクト、すなわち車両、が動き出している。しかしながら、このオブジェクトは、10の連続するフレームにおいてまだマッチされていないため「新しい」として分類される。画像21bにおいては、前記第1のオブジェクトは、魚眼レンズの歪みに起因してその大きさが劇的に変化しているにもかかわらず引き続きマッチングされており、従って追跡されている。この段階においては、前記第2のオブジェクトは、10の連続するフレームにわたってマッチングされており、このため「成熟」オブジェクトとして分類される。従って、前記第2のオブジェクトのバウンディングボックスは可視である。図21のcにおいては、前記第1のオブジェクトは、もはやフレーム内には見えず、このためその状態は「消えている」に変更される。前記第2のオブジェクトは、移動し続け、このためその状態は「成熟」として維持されて引き続き追跡される。このことは、前記第2のオブジェクトの動きが魚眼レンズの歪みに起因して放物線状にみえるにもかかわらず行われる。図11のdにおいても前記第2のオブジェクトの追跡が以前と同じように継続し、前記オブジェクトの変化する形状によって影響されない。

【図面の簡単な説明】

【0128】

【図1】従来のインテリジェント映像システムの処理段階を示したブロック図である。

【図2】本発明の実施形態によるインテリジェント映像監視システムの構成要素を示したブロック図である。

【図3】図2に示される監視システムの処理段階を示したブロック図である。

【図4】監視システムの前景抽出段階において用いられる背景モデルを表した図である。

【図5】前景抽出段階への着信映像フレームを表した図である。

【図6】前景抽出段階によって生成される前景マスクを表した図である。

【図7】監視システムの影除去段階の機能上の要素を表したブロック図である。

【図8a】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8b】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8c】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8d】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8e】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8f】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8g】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図8h】影除去段階の異なる動作フェーズにおいて生成されるマスク画像を表した図である。

【図9】a〜eは複数の映像フレーム内において現れる2つの異なるオブジェクトを追跡するプロセスを示した概略図である。

【図10】幾つかの抽出された位置特徴が示されるブロブマスクを表した図である。

【図11】監視システムのオブジェクト追跡段階の処理副段階を示したブロック図である。

【図12】オブジェクト追跡段階において用いられるオブジェクト待ち行列を表すテーブルである。

【図13】オブジェクト追跡段階においてマッチングコスト処理副段階を表した概略図である。

【図14】複数のオブジェクト状態及び各々の状態と関連づけられた遷移規則を示す流れ図である。

【図15a】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図15b】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図15c】異なる処理段階において監視システムによって受け取られ、オブジェクト追跡段階の動作について理解するのに役立つ画像である。

【図16】高度追跡方式に関連する流れ図である。

【図17】マッチングコスト処理副段階において実行することができる幾つかの追加ステップを示す流れ図である。

【図18】軌跡データベース及び表示制御アプリケーションのブロック図である。

【図19】追跡及び前記追跡に関するオブジェクト分類情報を示す処理後映像フレームを表した図である。

【図20】a〜dは本発明について理解するのに役立つ、第1の映像シーケンスの順次フレームを示した図である。

【図21】a〜dは本発明について理解するのに役立つ、第2の映像シーケンスの順次フレームを示した図である。

【図22】a〜dは本発明について理解するのに役立つ、第1の映像シーケンスの順次フレームを示した図である。

【特許請求の範囲】

【請求項1】

各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法であって、

(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、

(ii)前記領域が予め決められた数のフレームにおいて現れるかどうかを決定し、前記現れる場合は、前記予め決められた数のフレームにおける前記領域の位置の変化を示す動きパラメータを前記領域に割り当てることと、

(iii)前記動きパラメータをしきい値と比較して前記領域を追跡すべきかどうかを決定することと、

(iv)前記領域を追跡すべきである場合は、前記領域が識別される後続フレームに関して前記領域のフレーム位置を記録すること、とを具備する、方法。

【請求項2】

(ii)における前記予め決められた数の後続フレームは、連続するフレームである請求項1に記載の方法。

【請求項3】

前記領域を追跡すべきである場合は、前記方法は、(iv)の前記後続フレームの外観を修正して前記領域が追跡されていることをビジュアル表示することをさらに具備する請求項2に記載の方法。

【請求項4】

前記動きパラメータは、前記領域における基準点の位置分散を表し、前記領域は、前記位置分散が前記予め決められたしきい値を下回ることを前記動きパラメータが示す場合に追跡される前記のいずれかの請求項に記載の方法。

【請求項5】

第1及び第2の動きパラメータが前記領域に割り当てられ、前記第1の動きパラメータは、前記領域における基準点の位置分散を表し、前記第2の動きパラメータは、前記領域のフレームの動作速度を表し、前記領域は、前記第1の動きパラメータが予め決められた第1のしきい値を上回っており前記第2の動きパラメータが予め決められた第2のしきい値を上回る場合に追跡される請求項1乃至3のいずれかに記載の方法。

【請求項6】

前記第2のしきい値は、前記第1のしきい値よりも大きい請求項5に記載の方法。

【請求項7】

前記基準点は、前記前景領域のほぼ中心である請求項4乃至6のいずれかに記載の方法。

【請求項8】

各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを追跡する方法であって、

(i)前記映像シーケンスの第1及び第2のフレームを比較してフレーム間の動きを有するオブジェクトを表す画素領域を識別することと、

(ii)前記複数の映像フレームにおける動き上の特徴に基づいて動きパラメータζmを前記領域に割り当てることと、

(iii)前記領域が識別される前記映像シーケンスの後続フレームに関して、その動きパラメータが予め決められたしきい値Tζを下回る場合のみに前記領域の前記フレーム位置を記録すること、とを具備する、方法。

【請求項9】

ステップ(iii)の前において、前記領域の前記位置を表すデータがオブジェクト待ち行列内に格納され、前記データは、前記動きパラメータζmが前記予め決められたしきい値Tζを上回る場合に消去される請求項8に記載の方法。

【請求項10】

前記動き率ζmは、以下のように定義される請求項8又は9に記載の方法。

【数1】

ここで、σcx2及びσcy2は、それぞれx方向及びy方向における位置分散であり、σvx2及びσvy2は、それぞれx方向及びy方向における速度分散であり、τは、予め決められた定数である。

【請求項11】

前記予め決められたしきい値Tζは、2.5の領域において設定される請求項10に記載の方法。

【請求項12】

コンピュータによって読み取り可能な媒体に格納され、前記のいずれかの請求項に記載される前記方法をコンピュータに実行させるための一組の命令を具備する、コンピュータプログラム。

【請求項13】

各々のフレームが複数の画素を具備する複数のフレームを具備する映像シーケンスにおいて現れるオブジェクトを選択的に追跡するための映像処理システムであって、