歌声合成システム、歌声合成方法及び歌声合成装置

【課題】本発明は記憶ユニット、テンポユニット、入力装置、及び処理ユニットを備える歌声合成システムを提供する。

【解決手段】記憶ユニットは少なくとも1つの一旋律を記憶し、テンポユニットはテンポを指示し、入力装置は複数の音声信号を受信し、処理ユニットは音声信号に処理を行って合成歌声信号を生成する。

【解決手段】記憶ユニットは少なくとも1つの一旋律を記憶し、テンポユニットはテンポを指示し、入力装置は複数の音声信号を受信し、処理ユニットは音声信号に処理を行って合成歌声信号を生成する。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、主に歌声の合成技術に関し、より詳しくは、迫真の歌声を作り出せる歌声合成システム、歌声合成方法及び歌声合成装置に関する。

【背景技術】

【0002】

近年、情報科学技術が発展し次第に成熟するに伴って、電子計算装置が具備する処理能力も大幅に向上し、多くの複雑な応用が実用化されているが、そのうちの1つが音声や歌声合成の関連技術である。一般的に、音声合成とは人工的に人間に近い音声を生み出す技術を広く指し、例えば、バーチャル歌手、電子ペット、歌唱練習ソフト、作曲家と歌手の組合せのシミュレーション等のように、現在既に多くの関連した応用があり、これに呼応したニーズも次第に増加している。しかし、従来の一般的な音声や歌声の合成方法は、図1に示すように、言語データベース(Corpus Database)20によって文字と音声との間を変換することをベースとする。従って、事前に人間の音声データを録音して言語データベース20を構築しなければならない。なお、言語データベース20を構築するための入力する言語データの入力は、単音節データ(Single−Syllable−based Corpus)21の入力、単語データ(Coarticulation−based Corpus)22の入力、及び歌詞データ(Song−based Corpus)23の入力に分けられる。ここで、単音節データ21の入力には、中国語を例に取ると、図16に図面として示すような字形の注音字母等の中国語の単音節があり、単語データ22の入力には「明日」、「明後日」等のような入力がある。

【0003】

図1は従来の歌声合成方法のフローチャートである。先ず、選定楽曲のMIDI(Musical Instrument Digital Interface、MIDI)ファイルと歌詞データを入力する。MIDIファイルにはテンポと音符等の情報を含む選定楽曲の楽譜(score)が含まれており、ステップS101で入力されたMIDIファイルと歌詞データに基づき単語分割(Word Segmentation)を行って音声ラベル(Phonetic Label)を取得した上で、ステップS102で単語誘導を行い、言語データベース20から最も適合する言語を選び出し、ステップS103で音長(duration)と音高(Pitch)を調整し、最後に、ステップS103で音と音の間の接続と平滑処理を行い、エコー効果を加味し、伴奏音楽を付加して、合成の歌声を得る。

【発明の概要】

【発明が解決しようとする課題】

【0004】

しかしながら、従来の技術には下記の欠点があった。

(1)言語データベースの構築のために、長時間を要して言語の録音を行う必要があり、しかも言語データベースには膨大な記憶領域(保存スペース)を必要とする。

(2)単語誘導プログラムが複雑で、大量のシステム資源を消費し、しかも単語分割ミスという問題が発生し易い。

(3)歌声の合成効果が芳しくない。特に中国語については、機械音がはっきりと聞こえる。

(4)予め録音する言語データベースに制限されて、固定された音色しか出せず、また音色を変更しようとすると、言語データベースを録音し直さなければならない。

(5)プログラムが全体的に複雑で、合成歌声を製作するのに長時間を要し、リアルタイムで合成歌声が取得できない。

このため、全体的に従来の歌声合成の方法はコスト面、効率面、及び合成歌声の流暢さから言って、依然として一般ユーザーのニーズを満たせていない。

【0005】

本発明の目的はユーザーが楽理を習熟したり歌唱に長けたりする必要なくして、口頭でテンポに応じて音声信号を入力しさえすれば、個人の音色を有する歌声が得られる直感タイプの歌声合成システム、歌声合成方法及び歌声合成装置を提供することにある。

【課題を解決するための手段】

【0006】

本発明によれば、記憶ユニット、テンポユニット、入力装置、及び処理ユニットを含み、記憶ユニットは少なくとも1つの旋律を記憶し、テンポユニットは少なくとも1つの旋律における特定の旋律に基づきテンポを指示し、入力装置は複数の音声信号を受信し、音声信号が特定の旋律に対応し、処理ユニットは特定の旋律と音声信号に基づき合成歌声信号を生成することを特徴とする歌声合成システムが提供される。

【0007】

また本発明によれば、歌声合成方法は電子計算装置に適用され、そのステップは、旋律に基づきテンポを指示するステップと、電子計算装置のオーディオモジュールにより複数の音声信号を受信し、音声信号が特定の旋律に対応するステップと、特定の旋律と音声信号に基づき合成歌声信号を生成すると共に、電子計算装置の音声モジュールにより合成歌声信号を出力するステップとを含むことを特徴とする歌声合成方法が提供される。

【0008】

さらに本発明によれば、ケース、記憶装置、テンポ手段、オーディオレシーバ、処理装置を含み、記憶装置はケース内部に設置されて処理装置に接続され、少なくとも1つの旋律を記憶し、テンポ手段はケース外部に設置されて処理装置に接続され、少なくとも1つの旋律のうちの特定の旋律に基づきテンポを指示し、オーディオレシーバはケース外部に設置されて処理装置に接続され、複数の音声信号を受信し、そのうち音声信号は特定の旋律に対応し、処理装置はケース内部に設置されて、特定の旋律と音声信号に基づき合成歌声信号を生成することを特徴とする歌声合成装置が提供される。

【発明の効果】

【0009】

本発明によれば、ユーザーが楽理(楽譜に対する理解力。例えば拍子、音符等の意味を理解できる能力。)を習熟したり歌唱に長けたりする必要なくして、口頭でテンポに応じて音声信号を入力しさえすれば、個人の音色を有する歌声が得られる。

【0010】

本発明に関して追加された他の特徴や長所に関しては、その発明の属する技術の分野における通常の知識を有する者が本発明の精神や範囲内で、本願の実施形態において開示された移動通信システムにおいて連絡プログラムを実行するユーザー装置、システム及び方法に基づき若干の変更や修飾を行えるものとする。

【図面の簡単な説明】

【0011】

【図1】図1は、従来の音声合成構造に基づく歌声合成方法のフローチャートである。

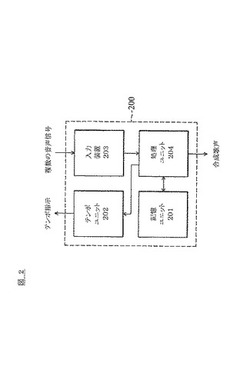

【図2】図2は、本発明の一実施形態の歌声合成装置の構造図である。

【図3】図3は、本発明の一実施形態に係る音声入力誤差を検知する処理を説明するための概略図である。

【図4】図4は、本発明の一実施形態に係るPSOLA法を使用した音高調整の処理を説明するための概略図である。

【図5】図5は、本発明の一実施形態に係るクロスフェード法を使用した音高調整の処理を説明するための概略図である。

【図6】図6(A)及び図6(B)は、本発明の一実施形態に係る再標本化法を使用した音高調整の処理を説明するための概略図である。

【図7】図7は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第1の図である。

【図8】図8は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第2の図である。

【図9】図9は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第3の図である。

【図10】図10は、本発明の一実施形態に係る歌声合成方法のフローチャートである。

【図11】図11は、本発明の他の実施形態に係る歌声合成方法のフローチャートである。

【図12】図12は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図13】図13は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図14】図14は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図15】図15は、本発明の一実施形態に係る歌声合成装置の形態を示す図である。

【図16】図16は、ここで、中国語の単音節の注音字母の字形を示す図である。

【発明を実施するための形態】

【0012】

以下、本発明を実施するための形態について、図面に基づいて詳細に説明する。なお、本発明は、以下に説明する実施形態に限定されるものではない。

図2は本発明の一実施形態に係る歌声合成システムの構造図である。

歌声合成システム200は、記憶ユニット(保存ユニット)201、テンポユニット202、入力装置203、及び処理ユニット204を含む。楽曲(歌曲)の歌声を合成しようとする際、記憶ユニット201は複数の楽曲の旋律を記憶し、楽曲の旋律をテンポユニット202に提供することができる。テンポユニット202は楽曲の旋律に基づき対応するテンポ(tempo)を指示する。テンポとは楽曲の旋律に基づき固定された周波数の拍子を指し、ユーザーが口頭で楽曲の歌詞を朗唱(歌唱、朗読)したりハミングしたりするのをサポートする。入力装置203はユーザーが朗唱したりハミングしたりして生じた複数の音声信号を受信する。音声信号は旋律に対応し、且つテンポに対応する(合致する)ものである。最後に、処理ユニット204が旋律と音声信号に基づいて処理を行い、合成歌声信号を生成する。

【0013】

ある実施形態では、旋律は音波(Waveform Audio、WAV)ファイルでよく、テンポユニット202はビートトラッキング(Beat Tracking)技術により楽曲のテンポを標記する。他の実施形態では、旋律はMIDI(Musical Instrument Digital Interface)ファイルでよく、テンポユニット202はMIDIファイル内のテンポイベント(tempo event)データを直接取り込んで楽曲のテンポを求める。テンポユニット202が旋律に基づきテンポを指示する形態としては、多様な実施方法があり、例えば移動、跳躍、明滅又は変色の記号のように、表示ユニットにより生成する視覚信号、或いは例えばメトロノームの「カチ、カチ〜」音を真似たような出力ユニットにより生成する音声信号、或いは例えば揺動、回転、跳動、又はメトロノームの振り子の振れのような機械構造が提供するテンポ動作、或いは発光ユニットが生成するライトの明滅、変色等がある。

【0014】

ある実施形態では、ユーザーが入力した複数の音声信号のリズム(rhythm)に一定レベルの正確性を持たせるため、リズム分析ユニット(図示せず)を具備する。リズム分析ユニットは、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき音声信号が有する固有のリズムが予め設定した許容誤差値を超えたか否かを判断する。リズムとは歌詞の各字が旋律に組合されて出現する速度の状態をいう。音声信号のリズムが予め設定許容誤差値を超えた場合、リズム分析ユニット(図示せず)は、ユーザーに音声信号を入力するステップを繰り返すよう指示する。このリズム誤差を判断する手順の詳細について後ほど図3で説明する。また、リズム分析ユニット(図示せず)はユーザーが入力した複数の音声信号を受信して、さらに音声信号を出力してユーザー自身でこの録音版(録音した音声信号)を受け入れるか否かを決定し、受け入れない場合、操作インターフェイスを提供してユーザーの操作により複数の音声信号の入力し直しを選択して、旧音声信号に代えるよう設計することもできる。

また、他の実施形態では、ユーザーは歌唱による方法で音声信号を発生して入力したり、事前に録音又は処理済みの音声信号を入力したりすることもできる。

【0015】

処理ユニット204は、主に旋律と音声信号に基づき所定の処理を行い、合成歌声信号を生成する。ある実施形態では、行う処理は音声信号に音高ならしを実行して複数の同一の音高の信号を取得し、旋律に基づいて同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高に調整して、複数の調整後の音声信号を取得するステップを含む。さらに、調整済みの複数の調整後の音声信号に平滑処理を実行して、平滑処理後の音声信号を生成する。以下、詳細な実施形態で説明する。

【0016】

ある実施形態では、処理ユニット204は音高分析プログラムを実行することができ、ピッチトラッキング(Pitch Tracking)、音高標記(ピッチマーキング)(Pitch Marking)によって、音声信号に音高ならしを実行して複数の同一の音高の信号を取得する。続いて、処理ユニット204は複数の同一の音高の信号に音高調整プログラムを実行し、例えばPSOLA法(Pitch Synchronous OverLap−Add、PSOLA)、クロスフェード法(Cross−Fadding)、又は再標本化法(Resample)を適用して、複数の同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する手順の詳細は後ほどそれぞれ図4、図5、図6(A)及び図6(B)でさらに説明する。処理ユニット204は複数の調整後の音声信号に平滑処理プログラムを実行し、例えば線形補間法(interpolation)、双線形補間法、又は多項式補間法を適用して、調整後の音声信号を平滑的に接続して平滑処理後の音声信号を取得するが、多項式補間法に関する手順の詳細は後ほど図7〜図9でさらに説明する。

【0017】

別の実施形態では、処理ユニット204はさらに平滑処理後の音声信号に歌声音響効果の処理プログラムを実行し、歌声合成システム200のシステムの負荷状況に応じてサンプリングの枠組みの大きさを決定した上で、平滑処理後の音声信号をサンプリングの枠組みの大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味して、音響効果処理後の音声信号を生成する。

また別の実施形態では、処理ユニット204は複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成プログラムを実行し、楽曲の伴奏音楽と各種音声信号とを合成して伴奏歌声信号を取得する。調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は、何れも本発明の合成歌声信号的実施態様であり、合成歌声信号は複数の音声信号(例:調整後、平滑処理後、音響効果処理後、又は伴奏処理後の音声信号)を含むファイルでよく、しかも合成歌声はユーザーの音色を有する。

またある実施形態では、歌声合成システム200は合成歌声信号を出力するための出力ユニットをさらに含み、出力ユニットはさらにテンポユニット202又は他の表示ユニットと結合して、合成歌声信号を出力する際、合成歌声信号に基づき、揺動、回転、跳動等の動作、又は移動、跳躍、明滅、変色等の視覚記号、又はメトロノームの「カチ、カチ」音を真似た音声信号等のようなテンポを表示する。

【0018】

図3は、本発明の一実施形態に係るリズム誤差を判断する方法を説明するための図である。図3に示すように、歌詞の音声信号の入力は歌詞1〜歌詞3を含む。ある実施形態では、記憶ユニット201内には楽曲の旋律を記憶する他に、さらに旋律に対応する歌詞及び歌詞に対応するリズムを記憶することができる。リズム分析ユニット(図示せず)は楽曲の旋律に基づきこの歌詞の標準テンポr(i)を取得し、このうち、r(1)、r(2)は歌詞1の時間区間の区切りを表わし、r(3)、r(4)は歌詞2の時間区間の区切りを表わし、r(5)、r(6)は歌詞3の時間区間の区切りを表わし、時間区間の区切りの前にある破線は早目に入力した誤差許容時間を表わし、時間区間の区切りの後にある点線は遅めに入力した誤差許容時間を表わし、よって破線と点線で形成される区間が誤差許容値μである。ユーザーが入力した複数の音声信号には固有のリズムがあり、そのリズムはc(i)で表示され、本実施形態では累計の誤差値は関数式(1)で表示される。

【0019】

【数1】

【0020】

関数式(1)において、算出された結果P(j)がμより大きい場合、改めて歌詞の音声信号を入力することができる。

【0021】

図4は本発明の一実施形態に係るPSOLA法を使用した音高調整概略図である。図4に示すように、最も上の横軸が表わすのは音高分析プログラムが完了した音声信号で、矢印指標は標記音高を表わす。本実施形態では、調整しようとする目標音高は元の音高の2倍であることから、標記音高の間の距離は元の1/2に短縮される。一方これと反対に、調整しようとする目標音高が元の音高の1/2である場合、標記音高の間的距離は2倍拡大される。各2つの音高の間は、ハミング窓(Hamming window)で改めてモデル化(model)され、ハミング窓の計算は関数式(2)で表示される。

【0022】

【数2】

【0023】

最後にこれをハミング窓が加算する波形によって積層方式で累積して、1つの新しい音声信号波形を形成する。

【0024】

図5は本発明の一実施形態に係るクロスフェード法を使用した音高調整の概略図である。クロスフェード法はPSOLA法に類似した音高調整方法で、計算に要する時間が短いものの、相対的に音声の合成はPSOLA法ほど平滑ではない。クロスフェード法を利用すると容易に音高の高低を変えることが可能で、しかも三角窓(triangular window)によりPSOLA法におけるハミング窓の方法に代え、そのフローチャートはPSOLA法と同様で、正確な音高を求めた上で、これらの音高と三角窓によって1つの音声信号波形を内積で算出する。

【0025】

図6(A)及び図6(B)は本発明の一実施形態に係る再標本化法を使用した音高調整概略図である。図6(A)で示す再標本化法は旋律の指示に基づき、ダウンサンプリング(down sampling)方式で元の音声信号を元の2倍の音高に偏移(shift)させ、またこれと反対に、図6(B)で示すように、元の音声信号を偏移させるのに、その音高を元の1/2に下げようとする場合、アップサンプリング(up sampling)方式で行う。

【0026】

人間が歌を歌うプロセスで、異なる音高の間の変換はコンピュータと同様にはいかない。人間は、毎回直接1つの音高から精確に目標の音高に到達させるが、特に音高の変化の幅が大きい場合、通常先ず目標の音高を若干超えてから、平滑して目標の音高に到達させる。この人間の歌声の特徴をシミュレーションするために、本実施形態では、ベジェ曲線(Bezier curve)を採用した平滑処理プログラムを実行する。3次ベジェ曲線を例に取ると、四つの制御点P0、P1、P2、P3は図7のように標示され、制御点の間の関係は関数式(3)で表わされる。

【0027】

【数3】

【0028】

関数式(3)の演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図7に示すように、制御点P0を起点音高に、制御点P3を目標音高に設定し、制御点P0を右に2ミリ秒移動すると制御点P2となり、制御点P2を左に1ミリ秒移動すると制御点P1となり、関数式(3)を式(4)として示す3次ベジェ曲線の公式に当て嵌めると、P0とP3を接続する曲線が算出される。

【0029】

【数4】

【0030】

本発明の別の実施形態では、4次ベジェ曲線で平滑処理プログラムを実行する。5つの制御点P0、P1、P2、P3、P4の間の関係は関数式(5)で表わされる。

【0031】

【数5】

【0032】

関数式(5)において、演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図8に示すように、制御点P0を起点音高に設定し、制御点P0を右に60ミリ秒移動すると制御点P2となり、制御点P2を左に10ミリ秒移動すると制御点P1となり、制御点P2を右に40ミリ秒移動すると制御点P4となり、制御点P4を左に20ミリ秒移動すると制御点P3となり、関数式(5)を式(6)として示す4次ベジェ曲線の公式に当て嵌めると、P0とP4を接続する曲線が算出される。

【0033】

【数6】

【0034】

本発明の別の実施形態では、5次ベジェ曲線で平滑処理プログラムを実行する。6つの制御点P0、P1、P2、P3、P4、P5の間の関係は関数式(7)で表わされる。

【0035】

【数7】

【0036】

関数式(7)において、演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図9に示すように、制御点P0を起点音高に、制御点P5を目標音高に設定し、制御点P0を右に2ミリ秒移動すると制御点P2となり、制御点P2を左に1ミリ秒移動すると制御点P1となり、制御点P2を右に2ミリ秒移動すると制御点P4となり、制御点P4を左に1ミリ秒移動すると制御点P3となり、関数式(6)を式(8)として支援す5次ベジェ曲線の公式に当て嵌めると、P0とP5を接続する曲線が算出される。

【0037】

【数8】

【0038】

図10は本発明の一実施形態に係る歌声合成方法のフローチャートである。なお、この歌声合成方法は、一例として、電子計算機(コンピュータ)に各ステップ(各手順)を実行させるためのコンピュータプログラムの形態で実現され、コンピュータ読み取り可能な記録媒体に記録され、或いは、電気通信回線を通じて提供されるものである。

本実施形態の歌声合成方法においては、先ず選定した楽曲の旋律に基づき楽曲のテンポを取得してテンポをユーザーに指示する(ステップS801)。テンポを指示する主な効果は、ユーザーがテンポの指示に基づき口頭で歌の歌詞を朗唱(歌唱や朗読)したりハミングしたりできることである。ユーザーの歌詞の朗唱やハミングは、電子計算装置のオーディオモジュールで複数の音声信号として受信する(ステップS802)。音声信号はユーザーが発声した歌の歌詞情報に基づき生成されるものであり、指示したテンポに応じて生じるのが好ましい。本実施形態の歌声合成方法においては、旋律と音声信号に処理を行うと共に、電子計算装置の音声モジュールにより合成歌声信号を出力する(ステップS803)。

【0039】

電子計算装置は、移動、跳躍(上下移動)、明滅又は変色の記号のような視覚信号を生成してテンポとして指示する表示ユニット、或いはメトロノームの「カチ、カチ」音を真似たような音声信号を生じてテンポとして指示する出力ユニット、或いは揺動、回転、跳動(移動、跳躍)、又はメトロノームの振り子構造のようなテンポ動作を提供してテンポとして指示する機械構造、或いはライトの明滅、変色等を生じてテンポとして指示する発光ユニットを含むことができる。

【0040】

ユーザーが入力した複数の音声信号のリズムに一定レベルの正確性を持たせるため、本実施形態の歌声合成方法は、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき、音声信号が有するリズムが、予め設定された許容誤差値を超えるか否かを判断し、超える場合、前記音声信号を入力するステップを繰り返すよう指示する。このリズム誤差の判断に関する操作は、図3に示す方法を採用することができる。

また、本実施形態の歌声合成方法は、ユーザーが入力した複数の音声信号を受信すると、音声信号を出力してユーザー自身でこの録音(記憶)した音声信号を受け入れるか否かを決定させることができる。受け入れない場合には、音声信号を入力するステップを繰り返すよう設計することもできる。

このほか、他の実施形態として、ユーザーが歌唱による方法で音声信号を生成じて(発っして)入力したり、又は事前に録音又は処理済みの音声信号を入力したりすることもできる。

【0041】

図11に示すように、本実施形態の歌声合成方法の音声信号に行う処理は、さらに以下のステップに細かく分けられる。先ず、音声信号に音高分析プログラムを実行し(ステップS803−1)、ピッチトラッキング、音高標記(ピッチマーキング)により、音声信号に音高ならしを実行して複数の同一の音高の信号を取得する。続いて、例えば複数の同一の音高にPSOLA法、クロスフェード法、又は再標本化法を適用して音高調整プログラムを実行し(ステップS803−2)、複数の同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する運用は図4、図5、図6(A)及び図6(B)に関する方法を採用することができる。

【0042】

図12に示すように、ある実施形態では、歌声合成方法は音高分析プログラムと音高調整プログラムの後に、引き続き複数の調整後の音声信号に平滑処理プログラムを実行することができ(ステップS803−3)、例えば線形補間法、双線形補間法、又は多項式補間法を運用して、調整後の音声信号を接続して平滑処理後の音声信号を取得する。このうち、多項式補間法に関する操作は図7〜図9の方法を採用することができる。

【0043】

図13に示すように、ある実施形態では、歌声合成方法は音高分析プログラム、音高調整プログラム及び平滑処理プログラムの後に、さらに平滑処理後の音声信号に歌声音響効果の処理プログラムを実行することができ(ステップS803−4)、それは電子計算装置システムの負荷状況に応じてサンプリングの枠組みの大きさを決定し、平滑処理後の音声信号をサンプリングの枠組み大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味して、音響効果処理後の音声信号を生成する。

【0044】

図14に示すように、ある実施形態での歌声合成方法は、複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成プログラムを実行して(ステップS803−5)、楽曲の伴奏音楽とシミュレーション歌声信号とを合成して伴奏歌声信号を取得した上で、伴奏歌声信号を出力する。複数の調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は何れも本発明の合成歌声信号の実施態様であり、合成歌声はユーザーの音色を有する。

【0045】

歌声合成方法を実施する電子計算装置は卓上型コンピュータ、ノートパソコン、携帯型通信装置、電子人形、電子寵物等でよい。また、電子計算装置は複数曲(ユーザー好み)の楽曲の旋律を記憶するための楽曲データベースを含み、ユーザーがその中から歌声を合成しようとする楽曲を選択することができ、楽曲データベースは楽曲に対応する歌詞や歌詞に対応するリズムを記憶することもできる。

【0046】

図15は本発明の一実施形態に係る歌声合成装置の構造図である。図に示すように、歌声合成装置1000は電子人形でよく、他の実施形態では、歌声合成装置1000は卓上型コンピュータ、ノートパソコン、携帯型通信装置、携帯用デジタル装置、PDA、電子ペット装置、ロボット、ボイスレコーダー、又はデジタル音楽プレーヤ等でもよい。歌声合成装置1000は少なくとも1つのケース1010、記憶装置1020、テンポ手段1030、オーディオレシーバ1040、処理装置1050を含む。記憶装置1020はケース1010内部に設置されて処理装置1050に接続され、複数曲の楽曲の旋律を記憶し、楽曲の旋律をテンポ手段1030に提供することができる。テンポ手段1030はケース1010外部に設置されて処理装置1050に接続され、旋律の中の特定の旋律に基づきこれに対応するテンポを指示し、ユーザーが口頭で歌の歌詞を朗唱したりハミングしたりするのをサポートする。オーディオレシーバ1040はケース1010外部に設置され、ユーザーが朗唱したりハミングしたりして生じた複数の音声信号を受信する。処理装置1050はケース1010内部に設置され、特定の旋律と音声信号に基づき処理を行い、合成歌声信号を生成する。

【0047】

図15の実施形態のように、記憶装置1020は電子人形の躯体部位に設置されるFlash、Hard disk、Cacheのようなメモリである。旋律は音波ファイル又はMIDIファイルでよく、テンポ手段1030は多様な実施方法が可能で、例えば発光装置では図15に示すように、電子人形の眼の領域に設置して、ライトの明滅、変色等を生じるが、実際にはLEDや他の発光性質を有するものを運用して完成させることができる。また、別のテンポ手段1030では可動式の機械構造として電子人形の手の領域に設置して、揺動、回転、跳動、又はメトロノームの振り子のような振れを提供するが、実際にはピアノのメトロノームの振り子に似たものを運用して完成させられる。また、別のテンポ手段1030では電子人形の腹部領域に設置する表示装置でよく、移動、跳躍、明滅又は変色の記号等の視覚信号を生成する。さらに、別のテンポ手段1030では電子人形の口の領域に設置された音声スピーカでよく、メトロノームを真似た「カチ、カチ」音を出力する。オーディオレシーバ1040はマイク、集音装置、録音装置又は他の受信機能を備えたものとして電子人形の耳の領域に設置され、音声信号は特定の旋律に対応してテンポに合わせる。

【0048】

処理装置1050は嵌入式のマイクロプロセッサとその運用の際に必要な他のものとして電子人形のケース内部に設置される。処理装置1050は記憶装置1020、テンポ手段1030、及びオーディオレシーバ1040に接続して、主に特定旋律と音声信号に基づき処理を行って合成歌声信号を生成する。ある実施形態では、行う処理は音声信号に音高ならしを実行して複数の同一の音高の信号を取得し、特定の旋律に基づいて同一の音高の信号を特定の旋律に対応して指示する複数の標準音高に調整して、複数の調整後の音声信号を取得するステップを含む。さらに、処理装置1050は調整済みの複数の調整後の音声信号に平滑処理を実行して、平滑処理後の音声信号を生成する。

【0049】

別のある実施形態では、処理ユニット1050は音高分析プログラムを実行することができ、ピッチトラッキング、音高標記によって、音高ならしを実行して複数の同一の音高を取得する。続いて、処理ユニット1050は複数の同一の音高に音高調整処理を実行し、PSOLA法、クロスフェード法、又は再標本化法を運用して、複数の同一の音高を特定の旋律に対応して指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する手順の詳細はそれぞれ図4、図5、図6(A)及び図6(B)の記述を参照する。また、処理ユニット1050は複数の調整後の音声信号に平滑処理を実行し、線形補間法、双線形補間法、又は多項式補間法を運用して調整後の音声信号を接続して平滑処理後の音声信号を取得するが、このうち、多項式補間法に関する手順の詳細は図7〜図9の記述を参照する。

【0050】

別の実施形態では、処理ユニット1050はさらに平滑処理後の音声信号に歌声音響効果の処理を実行し、歌声合成装置1000のシステムの負荷状況に応じてサンプリングの枠組みの大きさを決定した上で、シミュレーション歌声信号をサンプリングの枠組み大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味する。また別の実施形態では、処理ユニット1050は複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成処理を実行して、楽曲の伴奏音楽と各種音声信号とを合成して伴奏歌声信号を取得する。調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は、何れも本発明の合成歌声信号的実施態様であり、合成歌声はユーザーの音色を有する。

【0051】

ある実施形態では、歌声合成装置1000はケース1010外部に設置され処理装置1050に接続されて合成歌声信号を出力する音声スピーカ(図示せず)をさらに含む。図15の実施形態のように、音声スピーカはラッパ、拡声器、イヤホン、音声プレーヤ、又は他の放送機能を備えた器材やものとして電子人形の口領域に設置される。さらに、テンポ手段1030は音声スピーカが合成歌声信号を出力する際、揺動、回転、跳動等の動作、又は移動、跳躍、明滅、変色等の視覚記号、又はメトロノームを真似た「カチ、カチ」音といった音声信号のような合成歌声信号を表わすテンポに合わせることができる。

【0052】

ユーザーが入力した複数の音声信号のリズムに一定レベルの正確性を持たせるため、処理装置1050はリズム分析処理を行うことができ、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき、音声信号が有する固有のリズムが、予め設定された許容誤差値を超えるか否かを判断する。音声信号のリズムが予め設定された許容誤差値を超える場合、ユーザーに音声信号の入力し直しを指示するが、詳細は上記の図3に関する記述を参照する。別の実施方法では、処理装置1050とオーディオレシーバ1040で、ユーザーが入力した複数の音声信号を受信すると、音声信号を音声スピーカによって出力し、ユーザー自身で受け入れるか否か決定し、或いは複数の音声信号を入力し直して旧音声信号に取って代える。また、他の実施形態では、ユーザーは歌唱する方法で音声信号を生じて入力したり、事前に録音又は処理済みの音声信号を入力したりすることもでききる。

【0053】

上記の実施形態のように、本発明で述べた音声信号はユーザーが旋律やテンポに応じて朗唱したりハミングしたりして生じるものであるため、各音声信号は旋律やテンポにそれぞれ対応して直接音声信号を処理することができ、従来技術において大量に事前録音が必要な大量ユーザー言語データベースの時間とコストを節減し、システム資源の節約と楽曲合成速度の加速という効果を達して、最終的に得られた合成歌声はユーザーの音色を一層有しており、しかも効果はかなり迫真で、一般の従来技術では達成することができない。

【0054】

以上、本発明の実施形態について図面を参照して詳述したが、具体的な構成はこの実施形態に限られるものではなく、本発明の要旨を逸脱しない範囲の設計変更等も含まれる。上述の実施例は本発明の技術思想及び特徴を説明するためのものにすぎず、当該技術分野を熟知する者に本発明の内容を理解させると共にこれをもって実施させることを目的とし、本発明の特許範囲を限定するものではない。従って、本発明の精神を逸脱せずに行う各種の様の効果をもつ改良又は変更は、後述の請求項に含まれるものとする。

【産業上の利用可能性】

【0055】

本発明は、例えば、バーチャル歌手、電子ペット、歌唱練習ソフト、作曲家と歌手の組合せのシミュレーション等のように、音声合成を使用する任意の装置に適用可能である。

【符号の説明】

【0056】

20 言語データベース

21 単音節データ

22 単語データ

23 歌詞データ

200 歌声合成システム

201 記憶ユニット

202 テンポユニット

203 入力装置

204 処理ユニット

1000 歌声合成装置

1010 ケース

1020 記憶装置

1030 テンポ手段

1040 オーディオレシーバ

1050 処理装置

【技術分野】

【0001】

本発明は、主に歌声の合成技術に関し、より詳しくは、迫真の歌声を作り出せる歌声合成システム、歌声合成方法及び歌声合成装置に関する。

【背景技術】

【0002】

近年、情報科学技術が発展し次第に成熟するに伴って、電子計算装置が具備する処理能力も大幅に向上し、多くの複雑な応用が実用化されているが、そのうちの1つが音声や歌声合成の関連技術である。一般的に、音声合成とは人工的に人間に近い音声を生み出す技術を広く指し、例えば、バーチャル歌手、電子ペット、歌唱練習ソフト、作曲家と歌手の組合せのシミュレーション等のように、現在既に多くの関連した応用があり、これに呼応したニーズも次第に増加している。しかし、従来の一般的な音声や歌声の合成方法は、図1に示すように、言語データベース(Corpus Database)20によって文字と音声との間を変換することをベースとする。従って、事前に人間の音声データを録音して言語データベース20を構築しなければならない。なお、言語データベース20を構築するための入力する言語データの入力は、単音節データ(Single−Syllable−based Corpus)21の入力、単語データ(Coarticulation−based Corpus)22の入力、及び歌詞データ(Song−based Corpus)23の入力に分けられる。ここで、単音節データ21の入力には、中国語を例に取ると、図16に図面として示すような字形の注音字母等の中国語の単音節があり、単語データ22の入力には「明日」、「明後日」等のような入力がある。

【0003】

図1は従来の歌声合成方法のフローチャートである。先ず、選定楽曲のMIDI(Musical Instrument Digital Interface、MIDI)ファイルと歌詞データを入力する。MIDIファイルにはテンポと音符等の情報を含む選定楽曲の楽譜(score)が含まれており、ステップS101で入力されたMIDIファイルと歌詞データに基づき単語分割(Word Segmentation)を行って音声ラベル(Phonetic Label)を取得した上で、ステップS102で単語誘導を行い、言語データベース20から最も適合する言語を選び出し、ステップS103で音長(duration)と音高(Pitch)を調整し、最後に、ステップS103で音と音の間の接続と平滑処理を行い、エコー効果を加味し、伴奏音楽を付加して、合成の歌声を得る。

【発明の概要】

【発明が解決しようとする課題】

【0004】

しかしながら、従来の技術には下記の欠点があった。

(1)言語データベースの構築のために、長時間を要して言語の録音を行う必要があり、しかも言語データベースには膨大な記憶領域(保存スペース)を必要とする。

(2)単語誘導プログラムが複雑で、大量のシステム資源を消費し、しかも単語分割ミスという問題が発生し易い。

(3)歌声の合成効果が芳しくない。特に中国語については、機械音がはっきりと聞こえる。

(4)予め録音する言語データベースに制限されて、固定された音色しか出せず、また音色を変更しようとすると、言語データベースを録音し直さなければならない。

(5)プログラムが全体的に複雑で、合成歌声を製作するのに長時間を要し、リアルタイムで合成歌声が取得できない。

このため、全体的に従来の歌声合成の方法はコスト面、効率面、及び合成歌声の流暢さから言って、依然として一般ユーザーのニーズを満たせていない。

【0005】

本発明の目的はユーザーが楽理を習熟したり歌唱に長けたりする必要なくして、口頭でテンポに応じて音声信号を入力しさえすれば、個人の音色を有する歌声が得られる直感タイプの歌声合成システム、歌声合成方法及び歌声合成装置を提供することにある。

【課題を解決するための手段】

【0006】

本発明によれば、記憶ユニット、テンポユニット、入力装置、及び処理ユニットを含み、記憶ユニットは少なくとも1つの旋律を記憶し、テンポユニットは少なくとも1つの旋律における特定の旋律に基づきテンポを指示し、入力装置は複数の音声信号を受信し、音声信号が特定の旋律に対応し、処理ユニットは特定の旋律と音声信号に基づき合成歌声信号を生成することを特徴とする歌声合成システムが提供される。

【0007】

また本発明によれば、歌声合成方法は電子計算装置に適用され、そのステップは、旋律に基づきテンポを指示するステップと、電子計算装置のオーディオモジュールにより複数の音声信号を受信し、音声信号が特定の旋律に対応するステップと、特定の旋律と音声信号に基づき合成歌声信号を生成すると共に、電子計算装置の音声モジュールにより合成歌声信号を出力するステップとを含むことを特徴とする歌声合成方法が提供される。

【0008】

さらに本発明によれば、ケース、記憶装置、テンポ手段、オーディオレシーバ、処理装置を含み、記憶装置はケース内部に設置されて処理装置に接続され、少なくとも1つの旋律を記憶し、テンポ手段はケース外部に設置されて処理装置に接続され、少なくとも1つの旋律のうちの特定の旋律に基づきテンポを指示し、オーディオレシーバはケース外部に設置されて処理装置に接続され、複数の音声信号を受信し、そのうち音声信号は特定の旋律に対応し、処理装置はケース内部に設置されて、特定の旋律と音声信号に基づき合成歌声信号を生成することを特徴とする歌声合成装置が提供される。

【発明の効果】

【0009】

本発明によれば、ユーザーが楽理(楽譜に対する理解力。例えば拍子、音符等の意味を理解できる能力。)を習熟したり歌唱に長けたりする必要なくして、口頭でテンポに応じて音声信号を入力しさえすれば、個人の音色を有する歌声が得られる。

【0010】

本発明に関して追加された他の特徴や長所に関しては、その発明の属する技術の分野における通常の知識を有する者が本発明の精神や範囲内で、本願の実施形態において開示された移動通信システムにおいて連絡プログラムを実行するユーザー装置、システム及び方法に基づき若干の変更や修飾を行えるものとする。

【図面の簡単な説明】

【0011】

【図1】図1は、従来の音声合成構造に基づく歌声合成方法のフローチャートである。

【図2】図2は、本発明の一実施形態の歌声合成装置の構造図である。

【図3】図3は、本発明の一実施形態に係る音声入力誤差を検知する処理を説明するための概略図である。

【図4】図4は、本発明の一実施形態に係るPSOLA法を使用した音高調整の処理を説明するための概略図である。

【図5】図5は、本発明の一実施形態に係るクロスフェード法を使用した音高調整の処理を説明するための概略図である。

【図6】図6(A)及び図6(B)は、本発明の一実施形態に係る再標本化法を使用した音高調整の処理を説明するための概略図である。

【図7】図7は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第1の図である。

【図8】図8は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第2の図である。

【図9】図9は、本発明の一実施形態に係るベジェ曲線を使用した平滑処理を説明するための第3の図である。

【図10】図10は、本発明の一実施形態に係る歌声合成方法のフローチャートである。

【図11】図11は、本発明の他の実施形態に係る歌声合成方法のフローチャートである。

【図12】図12は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図13】図13は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図14】図14は、本発明のさらに他の実施形態に係る歌声合成方法のフローチャートである。

【図15】図15は、本発明の一実施形態に係る歌声合成装置の形態を示す図である。

【図16】図16は、ここで、中国語の単音節の注音字母の字形を示す図である。

【発明を実施するための形態】

【0012】

以下、本発明を実施するための形態について、図面に基づいて詳細に説明する。なお、本発明は、以下に説明する実施形態に限定されるものではない。

図2は本発明の一実施形態に係る歌声合成システムの構造図である。

歌声合成システム200は、記憶ユニット(保存ユニット)201、テンポユニット202、入力装置203、及び処理ユニット204を含む。楽曲(歌曲)の歌声を合成しようとする際、記憶ユニット201は複数の楽曲の旋律を記憶し、楽曲の旋律をテンポユニット202に提供することができる。テンポユニット202は楽曲の旋律に基づき対応するテンポ(tempo)を指示する。テンポとは楽曲の旋律に基づき固定された周波数の拍子を指し、ユーザーが口頭で楽曲の歌詞を朗唱(歌唱、朗読)したりハミングしたりするのをサポートする。入力装置203はユーザーが朗唱したりハミングしたりして生じた複数の音声信号を受信する。音声信号は旋律に対応し、且つテンポに対応する(合致する)ものである。最後に、処理ユニット204が旋律と音声信号に基づいて処理を行い、合成歌声信号を生成する。

【0013】

ある実施形態では、旋律は音波(Waveform Audio、WAV)ファイルでよく、テンポユニット202はビートトラッキング(Beat Tracking)技術により楽曲のテンポを標記する。他の実施形態では、旋律はMIDI(Musical Instrument Digital Interface)ファイルでよく、テンポユニット202はMIDIファイル内のテンポイベント(tempo event)データを直接取り込んで楽曲のテンポを求める。テンポユニット202が旋律に基づきテンポを指示する形態としては、多様な実施方法があり、例えば移動、跳躍、明滅又は変色の記号のように、表示ユニットにより生成する視覚信号、或いは例えばメトロノームの「カチ、カチ〜」音を真似たような出力ユニットにより生成する音声信号、或いは例えば揺動、回転、跳動、又はメトロノームの振り子の振れのような機械構造が提供するテンポ動作、或いは発光ユニットが生成するライトの明滅、変色等がある。

【0014】

ある実施形態では、ユーザーが入力した複数の音声信号のリズム(rhythm)に一定レベルの正確性を持たせるため、リズム分析ユニット(図示せず)を具備する。リズム分析ユニットは、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき音声信号が有する固有のリズムが予め設定した許容誤差値を超えたか否かを判断する。リズムとは歌詞の各字が旋律に組合されて出現する速度の状態をいう。音声信号のリズムが予め設定許容誤差値を超えた場合、リズム分析ユニット(図示せず)は、ユーザーに音声信号を入力するステップを繰り返すよう指示する。このリズム誤差を判断する手順の詳細について後ほど図3で説明する。また、リズム分析ユニット(図示せず)はユーザーが入力した複数の音声信号を受信して、さらに音声信号を出力してユーザー自身でこの録音版(録音した音声信号)を受け入れるか否かを決定し、受け入れない場合、操作インターフェイスを提供してユーザーの操作により複数の音声信号の入力し直しを選択して、旧音声信号に代えるよう設計することもできる。

また、他の実施形態では、ユーザーは歌唱による方法で音声信号を発生して入力したり、事前に録音又は処理済みの音声信号を入力したりすることもできる。

【0015】

処理ユニット204は、主に旋律と音声信号に基づき所定の処理を行い、合成歌声信号を生成する。ある実施形態では、行う処理は音声信号に音高ならしを実行して複数の同一の音高の信号を取得し、旋律に基づいて同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高に調整して、複数の調整後の音声信号を取得するステップを含む。さらに、調整済みの複数の調整後の音声信号に平滑処理を実行して、平滑処理後の音声信号を生成する。以下、詳細な実施形態で説明する。

【0016】

ある実施形態では、処理ユニット204は音高分析プログラムを実行することができ、ピッチトラッキング(Pitch Tracking)、音高標記(ピッチマーキング)(Pitch Marking)によって、音声信号に音高ならしを実行して複数の同一の音高の信号を取得する。続いて、処理ユニット204は複数の同一の音高の信号に音高調整プログラムを実行し、例えばPSOLA法(Pitch Synchronous OverLap−Add、PSOLA)、クロスフェード法(Cross−Fadding)、又は再標本化法(Resample)を適用して、複数の同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する手順の詳細は後ほどそれぞれ図4、図5、図6(A)及び図6(B)でさらに説明する。処理ユニット204は複数の調整後の音声信号に平滑処理プログラムを実行し、例えば線形補間法(interpolation)、双線形補間法、又は多項式補間法を適用して、調整後の音声信号を平滑的に接続して平滑処理後の音声信号を取得するが、多項式補間法に関する手順の詳細は後ほど図7〜図9でさらに説明する。

【0017】

別の実施形態では、処理ユニット204はさらに平滑処理後の音声信号に歌声音響効果の処理プログラムを実行し、歌声合成システム200のシステムの負荷状況に応じてサンプリングの枠組みの大きさを決定した上で、平滑処理後の音声信号をサンプリングの枠組みの大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味して、音響効果処理後の音声信号を生成する。

また別の実施形態では、処理ユニット204は複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成プログラムを実行し、楽曲の伴奏音楽と各種音声信号とを合成して伴奏歌声信号を取得する。調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は、何れも本発明の合成歌声信号的実施態様であり、合成歌声信号は複数の音声信号(例:調整後、平滑処理後、音響効果処理後、又は伴奏処理後の音声信号)を含むファイルでよく、しかも合成歌声はユーザーの音色を有する。

またある実施形態では、歌声合成システム200は合成歌声信号を出力するための出力ユニットをさらに含み、出力ユニットはさらにテンポユニット202又は他の表示ユニットと結合して、合成歌声信号を出力する際、合成歌声信号に基づき、揺動、回転、跳動等の動作、又は移動、跳躍、明滅、変色等の視覚記号、又はメトロノームの「カチ、カチ」音を真似た音声信号等のようなテンポを表示する。

【0018】

図3は、本発明の一実施形態に係るリズム誤差を判断する方法を説明するための図である。図3に示すように、歌詞の音声信号の入力は歌詞1〜歌詞3を含む。ある実施形態では、記憶ユニット201内には楽曲の旋律を記憶する他に、さらに旋律に対応する歌詞及び歌詞に対応するリズムを記憶することができる。リズム分析ユニット(図示せず)は楽曲の旋律に基づきこの歌詞の標準テンポr(i)を取得し、このうち、r(1)、r(2)は歌詞1の時間区間の区切りを表わし、r(3)、r(4)は歌詞2の時間区間の区切りを表わし、r(5)、r(6)は歌詞3の時間区間の区切りを表わし、時間区間の区切りの前にある破線は早目に入力した誤差許容時間を表わし、時間区間の区切りの後にある点線は遅めに入力した誤差許容時間を表わし、よって破線と点線で形成される区間が誤差許容値μである。ユーザーが入力した複数の音声信号には固有のリズムがあり、そのリズムはc(i)で表示され、本実施形態では累計の誤差値は関数式(1)で表示される。

【0019】

【数1】

【0020】

関数式(1)において、算出された結果P(j)がμより大きい場合、改めて歌詞の音声信号を入力することができる。

【0021】

図4は本発明の一実施形態に係るPSOLA法を使用した音高調整概略図である。図4に示すように、最も上の横軸が表わすのは音高分析プログラムが完了した音声信号で、矢印指標は標記音高を表わす。本実施形態では、調整しようとする目標音高は元の音高の2倍であることから、標記音高の間の距離は元の1/2に短縮される。一方これと反対に、調整しようとする目標音高が元の音高の1/2である場合、標記音高の間的距離は2倍拡大される。各2つの音高の間は、ハミング窓(Hamming window)で改めてモデル化(model)され、ハミング窓の計算は関数式(2)で表示される。

【0022】

【数2】

【0023】

最後にこれをハミング窓が加算する波形によって積層方式で累積して、1つの新しい音声信号波形を形成する。

【0024】

図5は本発明の一実施形態に係るクロスフェード法を使用した音高調整の概略図である。クロスフェード法はPSOLA法に類似した音高調整方法で、計算に要する時間が短いものの、相対的に音声の合成はPSOLA法ほど平滑ではない。クロスフェード法を利用すると容易に音高の高低を変えることが可能で、しかも三角窓(triangular window)によりPSOLA法におけるハミング窓の方法に代え、そのフローチャートはPSOLA法と同様で、正確な音高を求めた上で、これらの音高と三角窓によって1つの音声信号波形を内積で算出する。

【0025】

図6(A)及び図6(B)は本発明の一実施形態に係る再標本化法を使用した音高調整概略図である。図6(A)で示す再標本化法は旋律の指示に基づき、ダウンサンプリング(down sampling)方式で元の音声信号を元の2倍の音高に偏移(shift)させ、またこれと反対に、図6(B)で示すように、元の音声信号を偏移させるのに、その音高を元の1/2に下げようとする場合、アップサンプリング(up sampling)方式で行う。

【0026】

人間が歌を歌うプロセスで、異なる音高の間の変換はコンピュータと同様にはいかない。人間は、毎回直接1つの音高から精確に目標の音高に到達させるが、特に音高の変化の幅が大きい場合、通常先ず目標の音高を若干超えてから、平滑して目標の音高に到達させる。この人間の歌声の特徴をシミュレーションするために、本実施形態では、ベジェ曲線(Bezier curve)を採用した平滑処理プログラムを実行する。3次ベジェ曲線を例に取ると、四つの制御点P0、P1、P2、P3は図7のように標示され、制御点の間の関係は関数式(3)で表わされる。

【0027】

【数3】

【0028】

関数式(3)の演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図7に示すように、制御点P0を起点音高に、制御点P3を目標音高に設定し、制御点P0を右に2ミリ秒移動すると制御点P2となり、制御点P2を左に1ミリ秒移動すると制御点P1となり、関数式(3)を式(4)として示す3次ベジェ曲線の公式に当て嵌めると、P0とP3を接続する曲線が算出される。

【0029】

【数4】

【0030】

本発明の別の実施形態では、4次ベジェ曲線で平滑処理プログラムを実行する。5つの制御点P0、P1、P2、P3、P4の間の関係は関数式(5)で表わされる。

【0031】

【数5】

【0032】

関数式(5)において、演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図8に示すように、制御点P0を起点音高に設定し、制御点P0を右に60ミリ秒移動すると制御点P2となり、制御点P2を左に10ミリ秒移動すると制御点P1となり、制御点P2を右に40ミリ秒移動すると制御点P4となり、制御点P4を左に20ミリ秒移動すると制御点P3となり、関数式(5)を式(6)として示す4次ベジェ曲線の公式に当て嵌めると、P0とP4を接続する曲線が算出される。

【0033】

【数6】

【0034】

本発明の別の実施形態では、5次ベジェ曲線で平滑処理プログラムを実行する。6つの制御点P0、P1、P2、P3、P4、P5の間の関係は関数式(7)で表わされる。

【0035】

【数7】

【0036】

関数式(7)において、演算記号「±」は、音高の変化が上向きであれば「+」を、反対であれば「−」を表わす。図9に示すように、制御点P0を起点音高に、制御点P5を目標音高に設定し、制御点P0を右に2ミリ秒移動すると制御点P2となり、制御点P2を左に1ミリ秒移動すると制御点P1となり、制御点P2を右に2ミリ秒移動すると制御点P4となり、制御点P4を左に1ミリ秒移動すると制御点P3となり、関数式(6)を式(8)として支援す5次ベジェ曲線の公式に当て嵌めると、P0とP5を接続する曲線が算出される。

【0037】

【数8】

【0038】

図10は本発明の一実施形態に係る歌声合成方法のフローチャートである。なお、この歌声合成方法は、一例として、電子計算機(コンピュータ)に各ステップ(各手順)を実行させるためのコンピュータプログラムの形態で実現され、コンピュータ読み取り可能な記録媒体に記録され、或いは、電気通信回線を通じて提供されるものである。

本実施形態の歌声合成方法においては、先ず選定した楽曲の旋律に基づき楽曲のテンポを取得してテンポをユーザーに指示する(ステップS801)。テンポを指示する主な効果は、ユーザーがテンポの指示に基づき口頭で歌の歌詞を朗唱(歌唱や朗読)したりハミングしたりできることである。ユーザーの歌詞の朗唱やハミングは、電子計算装置のオーディオモジュールで複数の音声信号として受信する(ステップS802)。音声信号はユーザーが発声した歌の歌詞情報に基づき生成されるものであり、指示したテンポに応じて生じるのが好ましい。本実施形態の歌声合成方法においては、旋律と音声信号に処理を行うと共に、電子計算装置の音声モジュールにより合成歌声信号を出力する(ステップS803)。

【0039】

電子計算装置は、移動、跳躍(上下移動)、明滅又は変色の記号のような視覚信号を生成してテンポとして指示する表示ユニット、或いはメトロノームの「カチ、カチ」音を真似たような音声信号を生じてテンポとして指示する出力ユニット、或いは揺動、回転、跳動(移動、跳躍)、又はメトロノームの振り子構造のようなテンポ動作を提供してテンポとして指示する機械構造、或いはライトの明滅、変色等を生じてテンポとして指示する発光ユニットを含むことができる。

【0040】

ユーザーが入力した複数の音声信号のリズムに一定レベルの正確性を持たせるため、本実施形態の歌声合成方法は、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき、音声信号が有するリズムが、予め設定された許容誤差値を超えるか否かを判断し、超える場合、前記音声信号を入力するステップを繰り返すよう指示する。このリズム誤差の判断に関する操作は、図3に示す方法を採用することができる。

また、本実施形態の歌声合成方法は、ユーザーが入力した複数の音声信号を受信すると、音声信号を出力してユーザー自身でこの録音(記憶)した音声信号を受け入れるか否かを決定させることができる。受け入れない場合には、音声信号を入力するステップを繰り返すよう設計することもできる。

このほか、他の実施形態として、ユーザーが歌唱による方法で音声信号を生成じて(発っして)入力したり、又は事前に録音又は処理済みの音声信号を入力したりすることもできる。

【0041】

図11に示すように、本実施形態の歌声合成方法の音声信号に行う処理は、さらに以下のステップに細かく分けられる。先ず、音声信号に音高分析プログラムを実行し(ステップS803−1)、ピッチトラッキング、音高標記(ピッチマーキング)により、音声信号に音高ならしを実行して複数の同一の音高の信号を取得する。続いて、例えば複数の同一の音高にPSOLA法、クロスフェード法、又は再標本化法を適用して音高調整プログラムを実行し(ステップS803−2)、複数の同一の音高の信号を楽曲に対応する旋律が指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する運用は図4、図5、図6(A)及び図6(B)に関する方法を採用することができる。

【0042】

図12に示すように、ある実施形態では、歌声合成方法は音高分析プログラムと音高調整プログラムの後に、引き続き複数の調整後の音声信号に平滑処理プログラムを実行することができ(ステップS803−3)、例えば線形補間法、双線形補間法、又は多項式補間法を運用して、調整後の音声信号を接続して平滑処理後の音声信号を取得する。このうち、多項式補間法に関する操作は図7〜図9の方法を採用することができる。

【0043】

図13に示すように、ある実施形態では、歌声合成方法は音高分析プログラム、音高調整プログラム及び平滑処理プログラムの後に、さらに平滑処理後の音声信号に歌声音響効果の処理プログラムを実行することができ(ステップS803−4)、それは電子計算装置システムの負荷状況に応じてサンプリングの枠組みの大きさを決定し、平滑処理後の音声信号をサンプリングの枠組み大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味して、音響効果処理後の音声信号を生成する。

【0044】

図14に示すように、ある実施形態での歌声合成方法は、複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成プログラムを実行して(ステップS803−5)、楽曲の伴奏音楽とシミュレーション歌声信号とを合成して伴奏歌声信号を取得した上で、伴奏歌声信号を出力する。複数の調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は何れも本発明の合成歌声信号の実施態様であり、合成歌声はユーザーの音色を有する。

【0045】

歌声合成方法を実施する電子計算装置は卓上型コンピュータ、ノートパソコン、携帯型通信装置、電子人形、電子寵物等でよい。また、電子計算装置は複数曲(ユーザー好み)の楽曲の旋律を記憶するための楽曲データベースを含み、ユーザーがその中から歌声を合成しようとする楽曲を選択することができ、楽曲データベースは楽曲に対応する歌詞や歌詞に対応するリズムを記憶することもできる。

【0046】

図15は本発明の一実施形態に係る歌声合成装置の構造図である。図に示すように、歌声合成装置1000は電子人形でよく、他の実施形態では、歌声合成装置1000は卓上型コンピュータ、ノートパソコン、携帯型通信装置、携帯用デジタル装置、PDA、電子ペット装置、ロボット、ボイスレコーダー、又はデジタル音楽プレーヤ等でもよい。歌声合成装置1000は少なくとも1つのケース1010、記憶装置1020、テンポ手段1030、オーディオレシーバ1040、処理装置1050を含む。記憶装置1020はケース1010内部に設置されて処理装置1050に接続され、複数曲の楽曲の旋律を記憶し、楽曲の旋律をテンポ手段1030に提供することができる。テンポ手段1030はケース1010外部に設置されて処理装置1050に接続され、旋律の中の特定の旋律に基づきこれに対応するテンポを指示し、ユーザーが口頭で歌の歌詞を朗唱したりハミングしたりするのをサポートする。オーディオレシーバ1040はケース1010外部に設置され、ユーザーが朗唱したりハミングしたりして生じた複数の音声信号を受信する。処理装置1050はケース1010内部に設置され、特定の旋律と音声信号に基づき処理を行い、合成歌声信号を生成する。

【0047】

図15の実施形態のように、記憶装置1020は電子人形の躯体部位に設置されるFlash、Hard disk、Cacheのようなメモリである。旋律は音波ファイル又はMIDIファイルでよく、テンポ手段1030は多様な実施方法が可能で、例えば発光装置では図15に示すように、電子人形の眼の領域に設置して、ライトの明滅、変色等を生じるが、実際にはLEDや他の発光性質を有するものを運用して完成させることができる。また、別のテンポ手段1030では可動式の機械構造として電子人形の手の領域に設置して、揺動、回転、跳動、又はメトロノームの振り子のような振れを提供するが、実際にはピアノのメトロノームの振り子に似たものを運用して完成させられる。また、別のテンポ手段1030では電子人形の腹部領域に設置する表示装置でよく、移動、跳躍、明滅又は変色の記号等の視覚信号を生成する。さらに、別のテンポ手段1030では電子人形の口の領域に設置された音声スピーカでよく、メトロノームを真似た「カチ、カチ」音を出力する。オーディオレシーバ1040はマイク、集音装置、録音装置又は他の受信機能を備えたものとして電子人形の耳の領域に設置され、音声信号は特定の旋律に対応してテンポに合わせる。

【0048】

処理装置1050は嵌入式のマイクロプロセッサとその運用の際に必要な他のものとして電子人形のケース内部に設置される。処理装置1050は記憶装置1020、テンポ手段1030、及びオーディオレシーバ1040に接続して、主に特定旋律と音声信号に基づき処理を行って合成歌声信号を生成する。ある実施形態では、行う処理は音声信号に音高ならしを実行して複数の同一の音高の信号を取得し、特定の旋律に基づいて同一の音高の信号を特定の旋律に対応して指示する複数の標準音高に調整して、複数の調整後の音声信号を取得するステップを含む。さらに、処理装置1050は調整済みの複数の調整後の音声信号に平滑処理を実行して、平滑処理後の音声信号を生成する。

【0049】

別のある実施形態では、処理ユニット1050は音高分析プログラムを実行することができ、ピッチトラッキング、音高標記によって、音高ならしを実行して複数の同一の音高を取得する。続いて、処理ユニット1050は複数の同一の音高に音高調整処理を実行し、PSOLA法、クロスフェード法、又は再標本化法を運用して、複数の同一の音高を特定の旋律に対応して指示する複数の標準音高にそれぞれ調整して、複数の調整後の音声信号を取得する。このPSOLA法、クロスフェード法、及び再標本化法に関する手順の詳細はそれぞれ図4、図5、図6(A)及び図6(B)の記述を参照する。また、処理ユニット1050は複数の調整後の音声信号に平滑処理を実行し、線形補間法、双線形補間法、又は多項式補間法を運用して調整後の音声信号を接続して平滑処理後の音声信号を取得するが、このうち、多項式補間法に関する手順の詳細は図7〜図9の記述を参照する。

【0050】

別の実施形態では、処理ユニット1050はさらに平滑処理後の音声信号に歌声音響効果の処理を実行し、歌声合成装置1000のシステムの負荷状況に応じてサンプリングの枠組みの大きさを決定した上で、シミュレーション歌声信号をサンプリングの枠組み大きさでもって順番に音量調整をし、ビブラートやエコー効果を加味する。また別の実施形態では、処理ユニット1050は複数の調整後の音声信号、平滑処理後の音声信号又は音響効果処理後の音声信号等といった多様な音声信号に対して、伴奏合成処理を実行して、楽曲の伴奏音楽と各種音声信号とを合成して伴奏歌声信号を取得する。調整後の音声信号、平滑処理後の音声信号、音響効果処理後の音声信号、伴奏歌声信号等は、何れも本発明の合成歌声信号的実施態様であり、合成歌声はユーザーの音色を有する。

【0051】

ある実施形態では、歌声合成装置1000はケース1010外部に設置され処理装置1050に接続されて合成歌声信号を出力する音声スピーカ(図示せず)をさらに含む。図15の実施形態のように、音声スピーカはラッパ、拡声器、イヤホン、音声プレーヤ、又は他の放送機能を備えた器材やものとして電子人形の口領域に設置される。さらに、テンポ手段1030は音声スピーカが合成歌声信号を出力する際、揺動、回転、跳動等の動作、又は移動、跳躍、明滅、変色等の視覚記号、又はメトロノームを真似た「カチ、カチ」音といった音声信号のような合成歌声信号を表わすテンポに合わせることができる。

【0052】

ユーザーが入力した複数の音声信号のリズムに一定レベルの正確性を持たせるため、処理装置1050はリズム分析処理を行うことができ、ユーザーが入力した複数の音声信号を受信すると、楽曲の旋律に基づき、音声信号が有する固有のリズムが、予め設定された許容誤差値を超えるか否かを判断する。音声信号のリズムが予め設定された許容誤差値を超える場合、ユーザーに音声信号の入力し直しを指示するが、詳細は上記の図3に関する記述を参照する。別の実施方法では、処理装置1050とオーディオレシーバ1040で、ユーザーが入力した複数の音声信号を受信すると、音声信号を音声スピーカによって出力し、ユーザー自身で受け入れるか否か決定し、或いは複数の音声信号を入力し直して旧音声信号に取って代える。また、他の実施形態では、ユーザーは歌唱する方法で音声信号を生じて入力したり、事前に録音又は処理済みの音声信号を入力したりすることもでききる。

【0053】

上記の実施形態のように、本発明で述べた音声信号はユーザーが旋律やテンポに応じて朗唱したりハミングしたりして生じるものであるため、各音声信号は旋律やテンポにそれぞれ対応して直接音声信号を処理することができ、従来技術において大量に事前録音が必要な大量ユーザー言語データベースの時間とコストを節減し、システム資源の節約と楽曲合成速度の加速という効果を達して、最終的に得られた合成歌声はユーザーの音色を一層有しており、しかも効果はかなり迫真で、一般の従来技術では達成することができない。

【0054】

以上、本発明の実施形態について図面を参照して詳述したが、具体的な構成はこの実施形態に限られるものではなく、本発明の要旨を逸脱しない範囲の設計変更等も含まれる。上述の実施例は本発明の技術思想及び特徴を説明するためのものにすぎず、当該技術分野を熟知する者に本発明の内容を理解させると共にこれをもって実施させることを目的とし、本発明の特許範囲を限定するものではない。従って、本発明の精神を逸脱せずに行う各種の様の効果をもつ改良又は変更は、後述の請求項に含まれるものとする。

【産業上の利用可能性】

【0055】

本発明は、例えば、バーチャル歌手、電子ペット、歌唱練習ソフト、作曲家と歌手の組合せのシミュレーション等のように、音声合成を使用する任意の装置に適用可能である。

【符号の説明】

【0056】

20 言語データベース

21 単音節データ

22 単語データ

23 歌詞データ

200 歌声合成システム

201 記憶ユニット

202 テンポユニット

203 入力装置

204 処理ユニット

1000 歌声合成装置

1010 ケース

1020 記憶装置

1030 テンポ手段

1040 オーディオレシーバ

1050 処理装置

【特許請求の範囲】

【請求項1】

少なくとも1つの旋律を記憶するための記憶ユニットと、

前記少なくとも1つの旋律における特定の旋律に基づきテンポを指示するためのテンポユニットと、

複数の音声信号を受信し、前記音声信号が前記特定の旋律に対応させる入力装置と、

前記特定の旋律に基づき前記音声信号を処理して合成歌声信号を生成する処理ユニットと、

を含むことを特徴とする歌声合成システム。

【請求項2】

前記音声信号はユーザーの歌詞情報に基づき、前記指示されたテンポに対応して生じ、前記音声信号は順番にそれぞれ前記歌詞情報の各歌詞に対応することを特徴とする請求項1に記載の歌声合成システム。

【請求項3】

前記音声信号は固有のリズムを有し、前記システムはさらに前記固有のリズムが予め設定した許容誤差値を超えるか否かを判断するためのリズム分析ユニットを含むことを特徴とする請求項1に記載の歌声合成システム。

【請求項4】

前記処理ユニットが前記音声信号に行う処理は、音高分析プログラムと音高調整プログラムを実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とするステップを含み、前記音高分析プログラムはピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することを特徴とする請求項1に記載の歌声合成システム。

【請求項5】

前記処理ユニットが前記音声信号に行う処理は、前記調整後の音声信号に平滑処理プログラムを実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項4に記載の歌声合成システム。

【請求項6】

前記処理ユニットが前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理のプログラムを実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項5に記載の歌声合成システム。

【請求項7】

前記処理ユニットが前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成プログラムを実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項6に記載の歌声合成システム。

【請求項8】

電子計算装置に適用される歌声合成方法であって、

少なくとも1つの旋律における特定の旋律に基づきテンポを指示するステップと、

前記電子計算装置のオーディオモジュールにより複数の音声信号を受信し、前記音声信号が前記特定の旋律に対応するステップと、

前記特定の旋律処理に基づき前記音声信号を処理すると共に前記電子計算装置の音声モジュールにより合成歌声信号を出力するステップと

を含む歌声合成方法。

【請求項9】

前記音声信号はユーザーの歌詞情報と前記テンポに基づき生じ、前記音声信号は固有のリズムを有して順番にそれぞれ前記歌詞情報の各歌詞に対応し、前記歌声合成方法は前記音声信号のリズムが予め設定した許容誤差値を超えるか否かを判断し、超える場合、前記音声信号を入力するステップを繰り返すことを特徴とする請求項8に記載の歌声合成方法。

【請求項10】

前記音声信号に行う処理はさらに、音高分析プログラムと音高調整プログラムを実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とするステップを含み、前記音高分析プログラムはピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することを特徴とする請求項8に記載の歌声合成方法。

【請求項11】

前記音声信号に行う処理は、前記調整後の音声信号に平滑処理プログラムを実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項10に記載の歌声合成方法。

【請求項12】

前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理のプログラムを実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項11に記載の歌声合成方法。

【請求項13】

前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成プログラムを実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項12に記載の歌声合成方法。

【請求項14】

少なくとも1つのケース、記憶装置、テンポ手段、オーディオレシーバ、処理装置を含む歌声合成装置であって、前記記憶装置は前記ケース内部に設置されて前記処理装置に接続され、少なくとも1つの旋律を記憶し、前記テンポ手段は前記ケース外部に設置されて前記処理装置に接続され、前記旋律の特定旋律に基づきテンポを指示し、前記オーディオレシーバは前記ケース外部に設置されて前記処理装置に接続され、複数の音声信号を受信し、且つ前記音声信号は前記特定の旋律に対応し、前記処理装置は前記ケース内部に設置されて、前記特定の旋律に基づき前記音声信号を処理して合成歌声信号を生成することを特徴とする歌声合成装置。

【請求項15】

前記記憶装置はメモリであり、前記テンポ手段は発光装置、可動式機械構造、表示装置、又は音声スピーカであり、前記オーディオレシーバはマイク、集音装置、又は録音装置であり、前記処理装置は嵌入式のマイクロプロセッサであることを特徴とする請求項14に記載の歌声合成装置。

【請求項16】

前記音声信号はユーザーの歌詞情報と前記テンポに基づき生じ、前記音声信号は固有のリズムを有して順番にそれぞれ前記歌詞情報の各歌詞に対応し、前記処理装置は前記音声信号のリズムが予め設定した許容誤差値を超えるか否かを判断し、超える場合、前記ユーザーに前記音声信号を入力するステップを繰り返すよう指示することを特徴とする請求項14に記載の歌声合成装置。

【請求項17】

前記処理装置が前記音声信号に行う処理は、音高分析処理と音高調整処理を実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とすることであり、前記音高分析処理はピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することであることを特徴とする請求項14に記載の歌声合成装置。

【請求項18】

前記処理装置が前記音声信号に行う処理は、前記調整後の音声信号に平滑処理を実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項17に記載の歌声合成装置。

【請求項19】

前記処理装置が前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理を実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項18に記載の歌声合成装置。

【請求項20】

前記処理装置が前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成処理を実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項19に記載の歌声合成装置。

【請求項21】

前記合成歌声信号を出力する音声スピーカをさらに含むことを特徴とする請求項14に記載の歌声合成装置。

【請求項1】

少なくとも1つの旋律を記憶するための記憶ユニットと、

前記少なくとも1つの旋律における特定の旋律に基づきテンポを指示するためのテンポユニットと、

複数の音声信号を受信し、前記音声信号が前記特定の旋律に対応させる入力装置と、

前記特定の旋律に基づき前記音声信号を処理して合成歌声信号を生成する処理ユニットと、

を含むことを特徴とする歌声合成システム。

【請求項2】

前記音声信号はユーザーの歌詞情報に基づき、前記指示されたテンポに対応して生じ、前記音声信号は順番にそれぞれ前記歌詞情報の各歌詞に対応することを特徴とする請求項1に記載の歌声合成システム。

【請求項3】

前記音声信号は固有のリズムを有し、前記システムはさらに前記固有のリズムが予め設定した許容誤差値を超えるか否かを判断するためのリズム分析ユニットを含むことを特徴とする請求項1に記載の歌声合成システム。

【請求項4】

前記処理ユニットが前記音声信号に行う処理は、音高分析プログラムと音高調整プログラムを実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とするステップを含み、前記音高分析プログラムはピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することを特徴とする請求項1に記載の歌声合成システム。

【請求項5】

前記処理ユニットが前記音声信号に行う処理は、前記調整後の音声信号に平滑処理プログラムを実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項4に記載の歌声合成システム。

【請求項6】

前記処理ユニットが前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理のプログラムを実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項5に記載の歌声合成システム。

【請求項7】

前記処理ユニットが前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成プログラムを実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項6に記載の歌声合成システム。

【請求項8】

電子計算装置に適用される歌声合成方法であって、

少なくとも1つの旋律における特定の旋律に基づきテンポを指示するステップと、

前記電子計算装置のオーディオモジュールにより複数の音声信号を受信し、前記音声信号が前記特定の旋律に対応するステップと、

前記特定の旋律処理に基づき前記音声信号を処理すると共に前記電子計算装置の音声モジュールにより合成歌声信号を出力するステップと

を含む歌声合成方法。

【請求項9】

前記音声信号はユーザーの歌詞情報と前記テンポに基づき生じ、前記音声信号は固有のリズムを有して順番にそれぞれ前記歌詞情報の各歌詞に対応し、前記歌声合成方法は前記音声信号のリズムが予め設定した許容誤差値を超えるか否かを判断し、超える場合、前記音声信号を入力するステップを繰り返すことを特徴とする請求項8に記載の歌声合成方法。

【請求項10】

前記音声信号に行う処理はさらに、音高分析プログラムと音高調整プログラムを実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とするステップを含み、前記音高分析プログラムはピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することを特徴とする請求項8に記載の歌声合成方法。

【請求項11】

前記音声信号に行う処理は、前記調整後の音声信号に平滑処理プログラムを実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項10に記載の歌声合成方法。

【請求項12】

前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理のプログラムを実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項11に記載の歌声合成方法。

【請求項13】

前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成プログラムを実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項12に記載の歌声合成方法。

【請求項14】

少なくとも1つのケース、記憶装置、テンポ手段、オーディオレシーバ、処理装置を含む歌声合成装置であって、前記記憶装置は前記ケース内部に設置されて前記処理装置に接続され、少なくとも1つの旋律を記憶し、前記テンポ手段は前記ケース外部に設置されて前記処理装置に接続され、前記旋律の特定旋律に基づきテンポを指示し、前記オーディオレシーバは前記ケース外部に設置されて前記処理装置に接続され、複数の音声信号を受信し、且つ前記音声信号は前記特定の旋律に対応し、前記処理装置は前記ケース内部に設置されて、前記特定の旋律に基づき前記音声信号を処理して合成歌声信号を生成することを特徴とする歌声合成装置。

【請求項15】

前記記憶装置はメモリであり、前記テンポ手段は発光装置、可動式機械構造、表示装置、又は音声スピーカであり、前記オーディオレシーバはマイク、集音装置、又は録音装置であり、前記処理装置は嵌入式のマイクロプロセッサであることを特徴とする請求項14に記載の歌声合成装置。

【請求項16】

前記音声信号はユーザーの歌詞情報と前記テンポに基づき生じ、前記音声信号は固有のリズムを有して順番にそれぞれ前記歌詞情報の各歌詞に対応し、前記処理装置は前記音声信号のリズムが予め設定した許容誤差値を超えるか否かを判断し、超える場合、前記ユーザーに前記音声信号を入力するステップを繰り返すよう指示することを特徴とする請求項14に記載の歌声合成装置。

【請求項17】

前記処理装置が前記音声信号に行う処理は、音高分析処理と音高調整処理を実行して複数の調整後の音声信号を取得すると共に、前記調整後の音声信号を前記合成歌声信号とすることであり、前記音高分析処理はピッチトラッキングによって前記音声信号にそれぞれ対応する複数の音高を取得した上で、前記音高をならして複数の同様な音高を取得することであることを特徴とする請求項14に記載の歌声合成装置。

【請求項18】

前記処理装置が前記音声信号に行う処理は、前記調整後の音声信号に平滑処理を実行して平滑処理後の音声信号を取得すると共に、前記平滑処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項17に記載の歌声合成装置。

【請求項19】

前記処理装置が前記音声信号に行う処理は、前記平滑処理後の音声信号に歌声音響効果処理を実行して音響効果処理後の音声信号を取得すると共に、前記音響効果処理後の音声信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項18に記載の歌声合成装置。

【請求項20】

前記処理装置が前記音声信号に行う処理は、前記調整後の音声信号、前記平滑処理後の音声信号、及び前記音響効果処理後の音声信号のうちの1つに、伴奏合成処理を実行して歌声伴奏信号を取得すると共に、前記歌声伴奏信号を前記合成歌声信号とするステップをさらに含むことを特徴とする請求項19に記載の歌声合成装置。

【請求項21】

前記合成歌声信号を出力する音声スピーカをさらに含むことを特徴とする請求項14に記載の歌声合成装置。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【公開番号】特開2011−48335(P2011−48335A)

【公開日】平成23年3月10日(2011.3.10)

【国際特許分類】

【出願番号】特願2010−127931(P2010−127931)

【出願日】平成22年6月3日(2010.6.3)

【出願人】(599064731)インスティチュート フォー インフォメイション インダストリ (24)

【氏名又は名称原語表記】INSTITUTE FOR INFORMATION INDUSTRY

【Fターム(参考)】

【公開日】平成23年3月10日(2011.3.10)

【国際特許分類】

【出願日】平成22年6月3日(2010.6.3)

【出願人】(599064731)インスティチュート フォー インフォメイション インダストリ (24)

【氏名又は名称原語表記】INSTITUTE FOR INFORMATION INDUSTRY

【Fターム(参考)】

[ Back to top ]