自動車用のジェスチャーに基づいた情報およびコマンドの入力

ユーザーからの入力を受け取る方法は、ユーザーの手の届く範囲の表面を提供する工程を含む。ユーザーが触れる表面上の複数の位置が検知される。表面上の複数の触れられた位置にもっとも類似した形状を有する英数字が決定される。ユーザーは、英数字、および/または、英数字が含まれる単語を音声でまたは視覚的に知らされる。その英数字および/または単語が、決定する工程で決定されるとユーザーが望んだ英数字および/または単語であるかどうかについて、ユーザーからフィードバックが受け取られる。

【発明の詳細な説明】

【技術分野】

【0001】

(発明の分野)

本発明は、人間から入力、コマンドおよび情報を電子的に受け取るためのシステムおよび方法、より具体的には、車両の運転手から入力、コマンドおよび情報を電子的に受け取るためのシステムおよび方法に関する。

【背景技術】

【0002】

(関連技術の詳細)

ナビゲーションデバイスへのアドレス入力などの車両運転手による自動車への情報入力は、常に困難で、ときに危険な作業だった。伝統的に、車両の運転手は、ラジオ用の物理的なボタン、または、ナビゲーションシステムのタッチスクリーン上の表示されたボタンといった、車内の様々な制御部を操作することによって、コマンドを出すか、または、情報を入力する。このような操作は、運転手が所望のボタンを探すために道から目をそらすことを要求するのが一般的であり、時として、運転手は所望のボタンに届くようにと腕を伸ばし過ることもある。このようなことは、ボタンがタッチスクリーン上のように小さい場合、目をそらし、時間を消費し、かつ、危険であり、作業は、ナビゲーションデバイスにアドレスを入力する際などのように複雑である。さらに、タッチスクリーンは、運転手のすぐ近くに(すなわち、範囲内に)設置されなければならず、車に搭載されたダッシュボードの配置の設計選択肢を制限する。

【0003】

タッチスクリーンを使用する代わりに、いくつかの自動車メーカーは、遠隔制御とグラフィックディスプレイ(例えば、BMWのiDriveシステムと、LexusのRemote Touch Interfaceシステム)の組み合わせを使用することで、結果として、グラフィックディスプレイを運転手からさらに遠ざけて置くことができる。これらのシステムは依然として運転手が遠隔制御部を操作し、かつ、情報とコマンドの入力のためにグラフィックディスプレイ上の視覚フィードバックを見ることを要求する。iDriveシステム上でのアドレス入力は、例えば、運転手が、グラフィックディスプレイからの文字、州、および/または都市名のリストの中から選択するために遠隔制御部を操作することを必要とする。運転手がかなりの時間にわたって道から目を移動させる必要があるため、これは依然として非常に長く危険な工程である。

【0004】

従来技術で開示も示唆もされていないものは、上記の問題および制限を克服する運転手入力システムである。より具体的には、開示も示唆もされていないものは、ユーザーが、車両内の表面上に指で英数字を「書く」ことによってなどして、空間的なハンドジェスチャーを介して入力を提供することを可能にする運転手入力システムである。

【発明の概要】

【発明が解決しようとする課題】

【0005】

本発明は、ハンドジェスチャーを用いて、自動車内のユーザーによる情報とコマンドの入力のための新規なシステムを提供する。システムは、自動車内の表面、ジェスチャー捕捉モジュール、ジェスチャー認識モジュール、随意のジェスチャー確認モジュール、および、通信モジュールを含む。システムの使用によって、自動車の運転手は、ハンドジェスチャーを用いて、車内の表面上(一般的にハンドルの中央の平らな面上など)に「書く」ことができる。ハンドジェスチャーは、カメラなどのジェスチャー捕捉モジュールによって捕捉される。ジェスチャーによって示された情報とコマンドは、認識され、確認され、その後、自動車内の他のデバイスに送信される。このような情報およびコマンドは、ラジオまたはヒーターなどの操作装置のためのコマンドであってもよく、または、ナビゲーションデバイスのための宛先アドレスなどのコンテンツであってもよい。ジェスチャー認識のシステムは、音声認識システムと、または、他の入力様式のシステムと一体化され、その結果、情報とコマンドは多くの様式からの入力を用いて、よりよく認識されるようになる。

【課題を解決するための手段】

【0006】

本発明は、その1つの形態において、ユーザーの手の届く範囲の表面を提供する工程を含む、ユーザーからの入力を受け取る方法を含む。ユーザーが触れる表面上の複数の位置が検知される。表面上の複数の触れられた位置にもっとも類似した形状を有する英数字が決定される。英数字、および/または、英数字が含まれる単語が、可能であれば音声でユーザーに知らされる。ユーザーは、英数字および/または単語が、決定する工程で決定されるとユーザーが望む英数字および/または単語であるかどうかを確認する。このユーザーのフィードバックは、音声であっても、書かれるものであっても、または、例えば、確認ボタンを押すことなどのように触れられるものであってもよい。

【0007】

本発明は、その別の形態で、車両システムに入力値を入力する方法を含む。表面は車両のハンドルおよび/または肘掛け上に提供される。ユーザーが触れる表面上の複数の位置が検知される。表面の複数の触れられた位置にもっとも適合する英数字が決定される。入力は車両の電子システムに送信される。その入力は決定された英数字に依存する。

【0008】

本発明は、その別の形態において、車両内部のシステムに電子出力を提供するための構造を含む。表面は車両の客室内に配される。ジェスチャー捕捉モジュールはその表面に関連付けられる。ジェスチャー捕捉モジュールは、ユーザーが触れる表面上の複数の位置を特定する。ジェスチャー認識モジュールは、ジェスチャー捕捉モジュールに通信接続している。ジェスチャー認識モジュールは、表面上の多くの触れられた位置に最も類似する形状を有する英数字を決定する。ジェスチャー確認モジュールは、ジェスチャー認識モジュールに通信接続している。ジェスチャー確認モジュールは、ユーザーと相互作用し、それによって、決定された英数字または決定された英数字を含む単語が、ユーザーがスクリーンに触れることで伝えようとした英数字または単語であることを確認する。ジェスチャー確認モジュールは車両内のシステムに入力を送信する。その入力は確認された英数字または単語に依存する。

【0009】

本発明の利点は、既知の押ボタン、タッチスクリーン、または、遠隔制御システムよりも、本発明の方が学習するのが安全で簡単であるということである。本発明はユーザーが道から目をそらすようなことにはめったにならないので、より安全である。本発明は、目視確認機構が使用される制限された場合にのみ、ユーザーの視覚的注意を要求する。画像ディスプレイに表示されたリストから選択する代わりに、ユーザーは、ハンドジェスチャーで書くことによって情報またはコマンドを入力するので、これは可能である。さらに、ユーザーが書くことによって意図していることを表すため、本発明のシステムは学習しやすく、その一方で、他のシステムでは、ユーザーは、異なる遠隔制御部の機能を学習する必要がある。

【0010】

別の利点は、タッチパッドがハンドルに設置されることを本発明が必要としないということであり、それによって、他の用途のための空間を解放し、かつ、ハンドルの下のエアバッグを作動させることによって生じる潜在的な安全性の不安を回避する。

【0011】

しかし、別の利点は、ハンドルに加えて、肘掛けなどの運転手のすぐそばの任意の表面は、書きこまれるようにユーザーによって使用されることができるということである。

【0012】

さらに別の利点は、表面を使用することはジェスチャーを見つけ、かつ、手の動きの変化を減らすのに役立つため、本発明はより高い認識精度の能力を有するということである。さらに、表面の背景を活用することができる。

【0013】

さらなる利点は、コマンドに加えて、本発明はアドレス、連絡先、または、電話番号のような情報を入力することができるということである。

【図面の簡単な説明】

【0014】

【図1】本発明のジェスチャーに基づいた情報およびコマンドの入力システムの1つの実施形態のブロック図である。

【図2】図1のジェスチャーに基づいた情報およびコマンドの入力システムの斜視図である。

【図3】図1および図2の書き込み表面の1つの実施形態の平面図である。

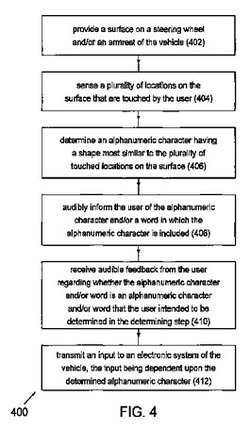

【図4】ユーザーからの入力を受け取るための本発明の方法の1つの実施形態のフローチャートである。

【発明を実施するための形態】

【0015】

本発明の上記および他の特徴および目的と、これらを成し遂げる手法がさらに明らかになるとともに、本発明そのものは、添付の図面と併せて取り込まれた本発明の実施形態の以下の記載を参照することによって、一層よく理解されるであろう。

【0016】

対応する参照文字は、複数の図にわたって対応する部分を示している。本明細書で書かれる例証は、本発明の実施形態を示しているが、幾つかの形態では、以下に開示される実施形態は、包括的となるよう意図されたものではなく、または、本発明の範囲を開示された正確な形状に制限するものとして解釈されるように意図されたものでもない。

【0017】

以下の詳細な記載では、添付の図面について言及され、これらの図面はその一部を形成する。図面では、文脈上他の意味で指示されていない限り、一般的に、同様の記号は同様の部品を識別する。詳細な記載、図面、および、請求項における例示的な実施形態は、限定することを意図したものではない。他の実施形態を利用してもよく、および、ここで示された主題の精神または範囲を逸脱することなく、他の変更がなされてもよい。明らかに当然のことながら、本開示の態様は、一般的に本明細書に記載のように、かつ、図で示されたように、非常に広範な様々な構造で、配置され、置き換えられ、組み合わされ、設計されてもよく、そのすべては明示的に熟慮され、この開示の一部を形成する。

【0018】

本発明は、自動車の運転手が、道路から目をそらすことなく、かつ、腕を伸ばし過ぎることなく、情報とコマンドを入力することを可能にする方法およびシステムを提供する。システムを用いて、運転手は、ハンドルまたはひじ掛けの表面などといった自動車内の運転手に近い予め決められた領域内の表面のどこかに、ハンドジェスチャーで「書く」。運転手に近い任意の表面を書くために使用してもよい。ジェスチャーは、書く動作をするために、運転手が表面で指を滑らせる形であってもよい。したがって、本発明は、運転手が押ボタンを見つけて操作する必要性を回避する。ハンドジェスチャーによって表示された情報とコマンドは、ジェスチャー捕捉モジュールによって捕捉され、認識モジュールによって認識され、確認モジュールによって確認され、その後、車両内の対応するデバイスに送信される。

【0019】

システムの1つの実施形態では、運転手がハンドルに「書く」際、ハンドジェスチャーと同様にハンドルの画像を得るために、1台以上のカメラが自動車の内部に取り付けられる。特定の実施形態では、運転手は、紙の上に書きとめるように人差し指を用いて、ハンドル上のナビゲーションデバイスに宛先アドレスを書き留める。ハンドジェスチャー、つまり、ユーザーの手と指の動きは、取り付けられたカメラによって捕捉される。認識モジュールは、ハンドジェスチャーによって表示されたアドレスを認識する。その後、認識されたアドレスは、ナビゲーションデバイスに送信される。

【0020】

本発明の他の実施形態は、対話システムにおける音声入力のような他のユーザー入力様式と、ジェスチャー入力様式を統合してもよい。1つの実施形態では、ユーザーは、ハンドジェスチャーを用いてハンドル上にアドレスのすべてまたは一部を書きながら宛先アドレスを話してもよい。音声入力およびハンドジェスチャー入力の両方は、認識モジュールが意図したアドレスを認識するのを助けるために統合されてもよい。

【0021】

本発明の車に搭載された情報とコマンドの入力システムは新しい設定を有する:運転手の近くの表面の任意の場所を用いること、および、音響確認を備えた対話システムとの一体化。本発明は新しいパラダイムシフトを提供し、さらに自然な入力手法を提供する:運転手は、予め決められたジェスチャーパターンを使用する代わりに情報を書き留める。

【0022】

本発明は任意の車両に搭載されたヒューマン・マシン・インタフェース(HMI)システムに適用可能であってもよい。例えば、本発明の運転手入力システムは、ナビゲーションシステム、娯楽システム、または、HVAC温度調節システムに入力値を入力するために使用されてもよい。

【0023】

ここで図面、特に図1を参照すると、ユーザーが表面(12)上で人差し指(14)を滑らせることによって「エア書き(air−write)」する表面(12)を含む、本発明のジェスチャーに基づいた情報およびコマンドの入力システム(10)の1つの実施形態が示されている。指(14)は、書き込み工程の間中、表面(12)との接触を維持する。

【0024】

ユーザーは、表面(12)上に英数字を書いてもよい。図1の例では、ユーザーは表面(12)上に数「2」を書いている。説明目的のために、数「2」の始まりは表面(12)上の破線(15)で描かれている。しかしながら、現実には、指(14)が以前あった場所の表面(12)には目に見える印はない。

【0025】

表面(12)に沿った指(14)の動きは、ジェスチャー捕捉モジュール(16)によって検知され記録される。1つの実施形態では、ジェスチャー捕捉モジュール(16)は、1台以上のカメラの形態であってもよい。例えば、モジュール(16)は、線(15)によって描かれた経路などの経路に沿った指(14)の動きを、デジタル形式で検出して記録する。

【0026】

モジュール(16)によって検知される指の動きはデジタル化され、これらのデジタル化された動きは、ジェスチャー認識モジュール(18)に入力として送信される。ジェスチャー認識モジュール(18)は、26の文字または10の数字のどれが、ユーザーの指または手でなされた動きによってもっとも良く表わされるのかを決定する。モジュール(18)は、小文字または大文字を認識し、同様に、活字体、ブロック体、または、筆記体を認識する。

【0027】

モジュール(18)によって行なわれる認識機能は、表面(12)の形状に依存する。例えば、ハンドルの中央部分で典型的なように、表面(12)が凸面の場合、モジュール(18)は、どの英数字が描かれたかを決める際にこの凸状を考慮に入れる。さらに、モジュール(18)は、表面(12)に一般的に垂直な方向に沿った表面(12)の各地点の位置を含む、表面(12)の正確な形状を考慮に入れる。

【0028】

ジェスチャー認識モジュール(18)は、単一文字を認識するか、または、単語の形をした文字および/または番号の群を認識する。モジュール(18)は、識別するのに十分な文字が描かれたとき、または、1つの単語の最後の文字が描かれたことをユーザーが示した後に、認識可能な単語を識別する。ユーザーは、例えば、表面(12)にピリオド(すなわち点)を描くことによって、または、予め決められた時間の間、表面(12)上に描く行為を中断することによって、単語の最後の文字が描かれたことを示してもよい。

【0029】

ジェスチャー認識モジュール(18)の出力は、ユーザーによって提供される可能な選択、コマンド、入力、または、情報の断片に相当する、単語、文字、または、数の形であってもよい。例えば、ジェスチャー認識モジュール(18)の出力は、特定のそれぞれのメニュー選択項目に対応する文字「B」または数字「3」の形であってもよい。ジェスチャー認識モジュール(18)の出力は、例えば、ナビゲーションシステムでは「探す(find)」、娯楽システムでは「遊ぶ(play)」、HVACシステムでは「霜を取る(defrost)」などのようなコマンドの形であってもよい。コマンドの前また後にユーザーが表面(12)上に書く入力データが、このようなコマンドに関連付けられてもよい。例えば、「探す(find)」というコマンドに、「エルム街10(10 Elm Street))」というアドレスが関連付けられてもよい。別の例として「演奏する(play)」というコマンドに、「ベートーベンの第5交響曲(Beethoven 5th Symphony)」、または、「WGN」あるいは「720AM」のようなラジオ放送局識別が関連付けられてもよい。さらに別の例として、HVACシステムの「熱(heat)」というコマンドに、「75F」などの温度レベルおよび/または「運転手(driver)」などの位置が関連付けられてもよい。

【0030】

ジェスチャー認識モジュール(18)の出力は、随意のジェスチャー確認モジュール(20)によって受け取られる。ジェスチャー認識モジュール(18)の出力が正確であることを確認するために、ジェスチャー確認モジュール(20)はユーザーからのフィードバックを求めるおよび/または受け取る。

例えば、確認モジュール(20)は、ユーザーから入力の確認を音声で求める。ジェスチャー認識モジュール(18)の出力が「霜を取る(defrost)」である場合、その後、確認モジュール(20)は、「「霜を取る(defrost)」を書きましたか?」と音声で(例えば、オーディオスピーカー(28)を介して;図2)運転手に訊ねる。「霜を取る(defrost)」と確かに言ったことを確認するために、ユーザーは「はい(yes)」と話してもよく、これはマイクロホン(26)によって受け取られ、確認モジュール(20)へと入力される。代替的に、ユーザーは、表面(12)上で「yes」の「y」を書くことによって、確かに「霜を取る(defrost)」と言ったことを確認してもよい。他方で、ユーザーが「霜を取る」と書かなかった場合、「no」と話すか、または、表面(12)上で「n」と書いてもよい。これに応えて、確認モジュール(20)は、「先程の入力をもう一度書いてください」と音声で運転手に尋ねる。このサイクルは、確認モジュール(20)がジェスチャーを正確に(すなわち、ユーザーの意図した通りに)認識したという確認を得るまで、ジェスチャー捕捉モジュール(16)にユーザーのジェスチャーを解釈させたまま継続する。ユーザーのジェスチャーの正確な認識の確認を得た後に、確認モジュール(20)は、ナビゲーションシステム(30)、音声システム(32)、または、HVACシステム(34)のような車両システムに認識されたジェスチャーを転送する。加えて、または、代替的に、確認モジュール(20)は、同様にユーザー確認を求めるために、他の様式(視覚的、押しボタン式、ジェスチャーなど)を使用してもよい。

【0031】

当然のことながら、ジェスチャー確認モジュール(20)は、本発明において随意である。すなわち、認識または解釈が最初に確認モジュール(20)によって確認されることなく、モジュール(18)の認識出力を、おそらく通信モジュール(22)によって車両システム(30、32、および/または、34)に転送することが可能である。

【0032】

自動車の客室内に設置されるようなジェスチャーに基づいた情報およびコマンドの入力システム(10)の斜視図が図2に示される。運転手が指で書きこむための2つの表面(12)が示されているが、実際には2つの表面(12)の1つだけしか含まれない。表面(12)のうちの1つはハンドル(24)の中央部分に設けられる。表面(12)のもう1つは、運転手の右手の肘掛け(25)の上部に設けられる。

【0033】

カメラ(16)の形をしたジェスチャー捕捉モジュールは、自動車の客室のルーフに、一般的には運転手の頭部の上に設置される。カメラ(16)は、2つの表面(12)のどちらかが実際に車両内で設けられた方向に向けられる。しかしながら、両方の表面(12)を含む実施形態では、カメラ(16)は、表面(12)の両方または一方に選択的に向けられるように調整可能である。

【0034】

図2に示されるように、確認モジュール(20)はマイクロホン(26)とオーディオスピーカー(28)に接続されてもよい。マイクロホン(26)とオーディオスピーカー(28)は、例えば、肘掛け、ダッシュボード、または、ドアなどのような客室内の任意の場所に設置されてもよい。

【0035】

図3は、書き込み面(12)の1つの実施形態に含まれるグリッドレイアウトを例示する。グリッドレイアウトは、等しく間隔を置いた垂直線(36)と等しく間隔を置いた水平線(38)とによって定義されるような行および列の矩形行列を含む。

【0036】

ジェスチャー認識モジュール(18)は、グリッドレイアウト内のどのセル(40)上でユーザーが指を滑らせたのか、および、どんな順番でユーザーは指を滑らせたのかに基づいて、ユーザーがどの英数字を描いたのかを決定する。ジェスチャー認識モジュール(18)は、ユーザーの指が辿ったセル(40)のリストを作るために、ルックアップテーブルまたはアルゴリズムを使用し、セルのそのリストを認識した英数字に翻訳する。セル(40)に触れる順番は、ルックアップテーブルまたはアルゴリズムへの入力であってもよい。

【0037】

ユーザーの手と背景表面(12)との間の視覚コントラストを改善し、それによって、ジェスチャー捕捉工程の精度を改善するために、表面(12)は白色などの単色で作られる。表面(12)のこのような白一色は、さらに、それによってさらに大きなコントラストがもたらされるおかげで、カメラ(16)が線(36、38)の位置を検知しやすくする。

【0038】

図4では、車両システムに入力値を入力する本発明の方法(400)の1つの実施形態が示されている。第1の工程(402)で、表面は車両のハンドルおよび/または肘掛け上に提供される。すなわち、表面(12)は、図2に示されたように、ハンドル(24)または肘掛け(25)上に設けられてもよい。

【0039】

次の工程(404)では、ユーザーが触れる表面上の複数の位置が検知される。例えば、カメラ(16)は、表面(12)に沿った運転手の指の動きを捕捉し、触れられる表面上の位置を同定する。カメラ(16)は、表面(12)上のどのセル(40)(図3)が触れられるのかを検知する。代替的に、カメラ(16)は、表面(12)の位置とは無関係に、(例えば、空中の)指の動きのみを検知してもよい。

【0040】

次に、工程(406)では、表面上の複数の触れられた位置にもっとも類似した形状を有する英数字が決定される。例えば、ルックアップテーブルまたはアルゴリズムは、ユーザーの指の移動によって定義された位置の群によって、どの数字または文字が最もよく表わされているかに対して使用されてもよい。

【0041】

工程(408)で、ユーザーは、英数字および/または英数字が含まれる単語を、音声で知らされる。例えば、合成音声は、システムがユーザーの指の動きによって定義された形状にもっとも良く似ていると決定した、「a」または「1」などの文字または数字を発しながらスピーカー(28)から流される。代替的に、合成音声は、個々の文字または数字を述べないが、その代わりに、システムが指の動きから決定された一連の文字によって形成された単語を決定するまで、抑制される。例えば、ユーザーが指で文字「f」、「i」、「n」、および、「d」を書いた後、合成音声はスピーカー(28)を介して「find」という単語を言う。加えて、システムは1つのフレーズを加え、ユーザーが指による書き込みのシステムの解釈を確認するように促す。1つの実施形態では、決定した単語を述べる前に、システムは「書きましたか」と音声で言い、その後、決定した単語(例えば、「find」)を言う。別の実施形態では、システムは、システムが作用するフレーズまたは単語の群を述べる。例えば、システムは、ナビゲーションシステムで意図される、「ガソリンスタンドを探す」などといったすぐに使用可能なコマンドを発してもよい。

【0042】

システムは、個々の文字の全ての文字が正確に認識されるとは限らないと想定する一方で、個々の英数字の認識にもっとも良く適合する単語またはフレーズを決定する。例えば、システムが順次的な一組の文字を「f」、「j」、「n」および「d」であるとして認識した場合、システムは「j」が「i」である可能性が最も高いと思われることを辞書から判断し、従って、システムはその単語を「find」と解釈する。

【0043】

次の工程(410)では、英数字および/または単語が、ユーザーが決定工程で決定されることを望んでいた英数字および/または単語であるかどうかに関して、音声フィードバックがユーザーから受け取られる。例えば、ユーザーは、指での書き込みのシステムの解釈を確認したこと、または、確認していないことを話し、このように口頭で述べたことはマイクロホン(26)によって拾い上げられる。1つの実施形態では、ユーザーは、「正しい(correct)」または「誤っている(incorrect)」と言ってもよい。別の実施形態では、ユーザーは、加えて、または、代替的に、訂正された解釈を述べてもいい。例えば、システムが「R」と述べたことに応じて、ユーザーは「いいえ、Pです(No, P)」と述べてもよい。システムは、その最初の解釈から、ユーザーが文字「R」に少なくとも似ている文字を書こうとしていると想定し、したがって、この知識は、システムが、「C」または「G」などの類似する音の文字の代わりに文字「P」としてユーザーの音声による発声を解釈する手助けをする。

【0044】

別の実施形態では、ユーザーは、音声での訂正(例えば、「いいえ、Pです」(No, P))に加えて、または、その代わりに、前回誤って解釈された書き込みを書き直してもよい。例えば、ユーザーは、「R」の一部であると解釈することができる任意の動きを回避するように注意して、表面上で「P」を書き直してもよい。

【0045】

システムがフレーズの一部のみを誤って解釈している場合、ユーザーはそのフレーズを口頭で正しく言い直して、フレーズの訂正された箇所のみを表面(12)に書き直してもよい。例えば、システムが「「R通りを探す(Find R Street)」と書きましたか?」と音声で聞いてきた場合、ユーザーは、「いいえ、P通りを探す(No,find P Street)」と言ってもよく、ユーザーは訂正された箇所のみ(すなわち、文字「P」)を表面(12)に(例えば、ほぼ同時に)書き直してもよい。

【0046】

別の実施形態では、表面(12)上の書込みの解釈の信頼度が閾値未満である場合のみ、システムは音声確認を求めることがある。すなわち、書込みが英数字または単語と十分なほど厳密に一致する場合、システムは確認を求めなくてもよい。さらに別の実施形態では、現在、運転作業が運転手の注意を要求するレベルは、音声確認を求めるべきかどうかにおける因子である。例えば、車両が高速で移動しているか、頻繁に曲がっている場合、システムは、音声確認を求めることによって、一時的に運転手の気をそらすことはあまりしない。むしろ、システムは、運転手には重要でない娯楽またはオーディオ機能について尋ねるよりも、安全性を最重視すべき機能(例えば、デフロスターの操作)またはナビゲーション機能の方を求める傾向にある。さらに別の実施形態では、音声確認を求めるシステムの可能性は、マイクロホン(26)によって測定されるように、客室の音または雑音のレベルに反比例してもよい。

【0047】

最終工程(412)では、入力は車両の電子システムに送信され、そこで入力は決定された英数字に依存している。例えば、「ピザ屋を探す(find pizza)」という入力が、車両のナビゲーションシステムに送信され、この入力はこの2つの単語からなるフレーズの9つの文字の各々のシステム認識に応答している。

【0048】

別の実施形態では、システムは、ユーザーが、システムが認識するのがさらに難しい小文字で書こうとしていることを検知する。これに応答して、システムは、ユーザーがこれらの書き込みでも小文字を使用していたと想定して、将来の書き込みを解釈する。代替的に、または、加えて、システムは、「大文字で書いてください」と運転手に音声で要請し、その結果、システムは非常に高い精度で書き込みを解釈するようになる。

【0049】

さらに別の実施形態では、システムは、書き込みの解釈中の車両の移動を補正することもある。例えば、表面(12)がハンドル(24)上にある場合、ジェスチャー認識モジュール(18)は、書かれた英数字を認識する際に回転によってユーザーの指を引きずる傾向があるハンドル(24)の回転を補正することがある。別の例として、突然の車線変更は、ユーザーの指を表面(12)上で水平方向のジグザグパターンで動かし、ジェスチャー認識モジュール(18)は、指の動きを英数字と一致させる際にジグザグを無視する。同様のわずかな影響が、加速、減速、および/または、旋回によって生じることがあり、指による書き込みの解釈はこれらのすべての影響を補正する。スピードメーター、ステアリングセンサ、ジャイロスコープなどのような従来の車両装備センサは、ジェスチャー認識モジュール(18)に車両の移動データを提供する。

【0050】

本発明は車両に適用されるものとして本明細書に記載されてきたが、当然のことながら、本発明は他の用途を有する。より一般的には、本発明は、運転手が別のタスクから注意をそらすことなく、英数字入力値を迅速に入力する必要がある任意のシステムに適用可能である。例えば、本発明は工場環境で使用されてもよく、ヒューマンマシンオペレータ(human machine operator)によって用いられてもよい。

【0051】

この発明は例示的な設計を有するものとして記載されてきたが、本発明はこの開示の精神と範囲内でさらに修正されてもよい。したがって、この出願は、一般的な原則を用いて、本発明の任意の変化、用途、または、適用を対象にするように意図されている。

【技術分野】

【0001】

(発明の分野)

本発明は、人間から入力、コマンドおよび情報を電子的に受け取るためのシステムおよび方法、より具体的には、車両の運転手から入力、コマンドおよび情報を電子的に受け取るためのシステムおよび方法に関する。

【背景技術】

【0002】

(関連技術の詳細)

ナビゲーションデバイスへのアドレス入力などの車両運転手による自動車への情報入力は、常に困難で、ときに危険な作業だった。伝統的に、車両の運転手は、ラジオ用の物理的なボタン、または、ナビゲーションシステムのタッチスクリーン上の表示されたボタンといった、車内の様々な制御部を操作することによって、コマンドを出すか、または、情報を入力する。このような操作は、運転手が所望のボタンを探すために道から目をそらすことを要求するのが一般的であり、時として、運転手は所望のボタンに届くようにと腕を伸ばし過ることもある。このようなことは、ボタンがタッチスクリーン上のように小さい場合、目をそらし、時間を消費し、かつ、危険であり、作業は、ナビゲーションデバイスにアドレスを入力する際などのように複雑である。さらに、タッチスクリーンは、運転手のすぐ近くに(すなわち、範囲内に)設置されなければならず、車に搭載されたダッシュボードの配置の設計選択肢を制限する。

【0003】

タッチスクリーンを使用する代わりに、いくつかの自動車メーカーは、遠隔制御とグラフィックディスプレイ(例えば、BMWのiDriveシステムと、LexusのRemote Touch Interfaceシステム)の組み合わせを使用することで、結果として、グラフィックディスプレイを運転手からさらに遠ざけて置くことができる。これらのシステムは依然として運転手が遠隔制御部を操作し、かつ、情報とコマンドの入力のためにグラフィックディスプレイ上の視覚フィードバックを見ることを要求する。iDriveシステム上でのアドレス入力は、例えば、運転手が、グラフィックディスプレイからの文字、州、および/または都市名のリストの中から選択するために遠隔制御部を操作することを必要とする。運転手がかなりの時間にわたって道から目を移動させる必要があるため、これは依然として非常に長く危険な工程である。

【0004】

従来技術で開示も示唆もされていないものは、上記の問題および制限を克服する運転手入力システムである。より具体的には、開示も示唆もされていないものは、ユーザーが、車両内の表面上に指で英数字を「書く」ことによってなどして、空間的なハンドジェスチャーを介して入力を提供することを可能にする運転手入力システムである。

【発明の概要】

【発明が解決しようとする課題】

【0005】

本発明は、ハンドジェスチャーを用いて、自動車内のユーザーによる情報とコマンドの入力のための新規なシステムを提供する。システムは、自動車内の表面、ジェスチャー捕捉モジュール、ジェスチャー認識モジュール、随意のジェスチャー確認モジュール、および、通信モジュールを含む。システムの使用によって、自動車の運転手は、ハンドジェスチャーを用いて、車内の表面上(一般的にハンドルの中央の平らな面上など)に「書く」ことができる。ハンドジェスチャーは、カメラなどのジェスチャー捕捉モジュールによって捕捉される。ジェスチャーによって示された情報とコマンドは、認識され、確認され、その後、自動車内の他のデバイスに送信される。このような情報およびコマンドは、ラジオまたはヒーターなどの操作装置のためのコマンドであってもよく、または、ナビゲーションデバイスのための宛先アドレスなどのコンテンツであってもよい。ジェスチャー認識のシステムは、音声認識システムと、または、他の入力様式のシステムと一体化され、その結果、情報とコマンドは多くの様式からの入力を用いて、よりよく認識されるようになる。

【課題を解決するための手段】

【0006】

本発明は、その1つの形態において、ユーザーの手の届く範囲の表面を提供する工程を含む、ユーザーからの入力を受け取る方法を含む。ユーザーが触れる表面上の複数の位置が検知される。表面上の複数の触れられた位置にもっとも類似した形状を有する英数字が決定される。英数字、および/または、英数字が含まれる単語が、可能であれば音声でユーザーに知らされる。ユーザーは、英数字および/または単語が、決定する工程で決定されるとユーザーが望む英数字および/または単語であるかどうかを確認する。このユーザーのフィードバックは、音声であっても、書かれるものであっても、または、例えば、確認ボタンを押すことなどのように触れられるものであってもよい。

【0007】

本発明は、その別の形態で、車両システムに入力値を入力する方法を含む。表面は車両のハンドルおよび/または肘掛け上に提供される。ユーザーが触れる表面上の複数の位置が検知される。表面の複数の触れられた位置にもっとも適合する英数字が決定される。入力は車両の電子システムに送信される。その入力は決定された英数字に依存する。

【0008】

本発明は、その別の形態において、車両内部のシステムに電子出力を提供するための構造を含む。表面は車両の客室内に配される。ジェスチャー捕捉モジュールはその表面に関連付けられる。ジェスチャー捕捉モジュールは、ユーザーが触れる表面上の複数の位置を特定する。ジェスチャー認識モジュールは、ジェスチャー捕捉モジュールに通信接続している。ジェスチャー認識モジュールは、表面上の多くの触れられた位置に最も類似する形状を有する英数字を決定する。ジェスチャー確認モジュールは、ジェスチャー認識モジュールに通信接続している。ジェスチャー確認モジュールは、ユーザーと相互作用し、それによって、決定された英数字または決定された英数字を含む単語が、ユーザーがスクリーンに触れることで伝えようとした英数字または単語であることを確認する。ジェスチャー確認モジュールは車両内のシステムに入力を送信する。その入力は確認された英数字または単語に依存する。

【0009】

本発明の利点は、既知の押ボタン、タッチスクリーン、または、遠隔制御システムよりも、本発明の方が学習するのが安全で簡単であるということである。本発明はユーザーが道から目をそらすようなことにはめったにならないので、より安全である。本発明は、目視確認機構が使用される制限された場合にのみ、ユーザーの視覚的注意を要求する。画像ディスプレイに表示されたリストから選択する代わりに、ユーザーは、ハンドジェスチャーで書くことによって情報またはコマンドを入力するので、これは可能である。さらに、ユーザーが書くことによって意図していることを表すため、本発明のシステムは学習しやすく、その一方で、他のシステムでは、ユーザーは、異なる遠隔制御部の機能を学習する必要がある。

【0010】

別の利点は、タッチパッドがハンドルに設置されることを本発明が必要としないということであり、それによって、他の用途のための空間を解放し、かつ、ハンドルの下のエアバッグを作動させることによって生じる潜在的な安全性の不安を回避する。

【0011】

しかし、別の利点は、ハンドルに加えて、肘掛けなどの運転手のすぐそばの任意の表面は、書きこまれるようにユーザーによって使用されることができるということである。

【0012】

さらに別の利点は、表面を使用することはジェスチャーを見つけ、かつ、手の動きの変化を減らすのに役立つため、本発明はより高い認識精度の能力を有するということである。さらに、表面の背景を活用することができる。

【0013】

さらなる利点は、コマンドに加えて、本発明はアドレス、連絡先、または、電話番号のような情報を入力することができるということである。

【図面の簡単な説明】

【0014】

【図1】本発明のジェスチャーに基づいた情報およびコマンドの入力システムの1つの実施形態のブロック図である。

【図2】図1のジェスチャーに基づいた情報およびコマンドの入力システムの斜視図である。

【図3】図1および図2の書き込み表面の1つの実施形態の平面図である。

【図4】ユーザーからの入力を受け取るための本発明の方法の1つの実施形態のフローチャートである。

【発明を実施するための形態】

【0015】

本発明の上記および他の特徴および目的と、これらを成し遂げる手法がさらに明らかになるとともに、本発明そのものは、添付の図面と併せて取り込まれた本発明の実施形態の以下の記載を参照することによって、一層よく理解されるであろう。

【0016】

対応する参照文字は、複数の図にわたって対応する部分を示している。本明細書で書かれる例証は、本発明の実施形態を示しているが、幾つかの形態では、以下に開示される実施形態は、包括的となるよう意図されたものではなく、または、本発明の範囲を開示された正確な形状に制限するものとして解釈されるように意図されたものでもない。

【0017】

以下の詳細な記載では、添付の図面について言及され、これらの図面はその一部を形成する。図面では、文脈上他の意味で指示されていない限り、一般的に、同様の記号は同様の部品を識別する。詳細な記載、図面、および、請求項における例示的な実施形態は、限定することを意図したものではない。他の実施形態を利用してもよく、および、ここで示された主題の精神または範囲を逸脱することなく、他の変更がなされてもよい。明らかに当然のことながら、本開示の態様は、一般的に本明細書に記載のように、かつ、図で示されたように、非常に広範な様々な構造で、配置され、置き換えられ、組み合わされ、設計されてもよく、そのすべては明示的に熟慮され、この開示の一部を形成する。

【0018】

本発明は、自動車の運転手が、道路から目をそらすことなく、かつ、腕を伸ばし過ぎることなく、情報とコマンドを入力することを可能にする方法およびシステムを提供する。システムを用いて、運転手は、ハンドルまたはひじ掛けの表面などといった自動車内の運転手に近い予め決められた領域内の表面のどこかに、ハンドジェスチャーで「書く」。運転手に近い任意の表面を書くために使用してもよい。ジェスチャーは、書く動作をするために、運転手が表面で指を滑らせる形であってもよい。したがって、本発明は、運転手が押ボタンを見つけて操作する必要性を回避する。ハンドジェスチャーによって表示された情報とコマンドは、ジェスチャー捕捉モジュールによって捕捉され、認識モジュールによって認識され、確認モジュールによって確認され、その後、車両内の対応するデバイスに送信される。

【0019】

システムの1つの実施形態では、運転手がハンドルに「書く」際、ハンドジェスチャーと同様にハンドルの画像を得るために、1台以上のカメラが自動車の内部に取り付けられる。特定の実施形態では、運転手は、紙の上に書きとめるように人差し指を用いて、ハンドル上のナビゲーションデバイスに宛先アドレスを書き留める。ハンドジェスチャー、つまり、ユーザーの手と指の動きは、取り付けられたカメラによって捕捉される。認識モジュールは、ハンドジェスチャーによって表示されたアドレスを認識する。その後、認識されたアドレスは、ナビゲーションデバイスに送信される。

【0020】

本発明の他の実施形態は、対話システムにおける音声入力のような他のユーザー入力様式と、ジェスチャー入力様式を統合してもよい。1つの実施形態では、ユーザーは、ハンドジェスチャーを用いてハンドル上にアドレスのすべてまたは一部を書きながら宛先アドレスを話してもよい。音声入力およびハンドジェスチャー入力の両方は、認識モジュールが意図したアドレスを認識するのを助けるために統合されてもよい。

【0021】

本発明の車に搭載された情報とコマンドの入力システムは新しい設定を有する:運転手の近くの表面の任意の場所を用いること、および、音響確認を備えた対話システムとの一体化。本発明は新しいパラダイムシフトを提供し、さらに自然な入力手法を提供する:運転手は、予め決められたジェスチャーパターンを使用する代わりに情報を書き留める。

【0022】

本発明は任意の車両に搭載されたヒューマン・マシン・インタフェース(HMI)システムに適用可能であってもよい。例えば、本発明の運転手入力システムは、ナビゲーションシステム、娯楽システム、または、HVAC温度調節システムに入力値を入力するために使用されてもよい。

【0023】

ここで図面、特に図1を参照すると、ユーザーが表面(12)上で人差し指(14)を滑らせることによって「エア書き(air−write)」する表面(12)を含む、本発明のジェスチャーに基づいた情報およびコマンドの入力システム(10)の1つの実施形態が示されている。指(14)は、書き込み工程の間中、表面(12)との接触を維持する。

【0024】

ユーザーは、表面(12)上に英数字を書いてもよい。図1の例では、ユーザーは表面(12)上に数「2」を書いている。説明目的のために、数「2」の始まりは表面(12)上の破線(15)で描かれている。しかしながら、現実には、指(14)が以前あった場所の表面(12)には目に見える印はない。

【0025】

表面(12)に沿った指(14)の動きは、ジェスチャー捕捉モジュール(16)によって検知され記録される。1つの実施形態では、ジェスチャー捕捉モジュール(16)は、1台以上のカメラの形態であってもよい。例えば、モジュール(16)は、線(15)によって描かれた経路などの経路に沿った指(14)の動きを、デジタル形式で検出して記録する。

【0026】

モジュール(16)によって検知される指の動きはデジタル化され、これらのデジタル化された動きは、ジェスチャー認識モジュール(18)に入力として送信される。ジェスチャー認識モジュール(18)は、26の文字または10の数字のどれが、ユーザーの指または手でなされた動きによってもっとも良く表わされるのかを決定する。モジュール(18)は、小文字または大文字を認識し、同様に、活字体、ブロック体、または、筆記体を認識する。

【0027】

モジュール(18)によって行なわれる認識機能は、表面(12)の形状に依存する。例えば、ハンドルの中央部分で典型的なように、表面(12)が凸面の場合、モジュール(18)は、どの英数字が描かれたかを決める際にこの凸状を考慮に入れる。さらに、モジュール(18)は、表面(12)に一般的に垂直な方向に沿った表面(12)の各地点の位置を含む、表面(12)の正確な形状を考慮に入れる。

【0028】

ジェスチャー認識モジュール(18)は、単一文字を認識するか、または、単語の形をした文字および/または番号の群を認識する。モジュール(18)は、識別するのに十分な文字が描かれたとき、または、1つの単語の最後の文字が描かれたことをユーザーが示した後に、認識可能な単語を識別する。ユーザーは、例えば、表面(12)にピリオド(すなわち点)を描くことによって、または、予め決められた時間の間、表面(12)上に描く行為を中断することによって、単語の最後の文字が描かれたことを示してもよい。

【0029】

ジェスチャー認識モジュール(18)の出力は、ユーザーによって提供される可能な選択、コマンド、入力、または、情報の断片に相当する、単語、文字、または、数の形であってもよい。例えば、ジェスチャー認識モジュール(18)の出力は、特定のそれぞれのメニュー選択項目に対応する文字「B」または数字「3」の形であってもよい。ジェスチャー認識モジュール(18)の出力は、例えば、ナビゲーションシステムでは「探す(find)」、娯楽システムでは「遊ぶ(play)」、HVACシステムでは「霜を取る(defrost)」などのようなコマンドの形であってもよい。コマンドの前また後にユーザーが表面(12)上に書く入力データが、このようなコマンドに関連付けられてもよい。例えば、「探す(find)」というコマンドに、「エルム街10(10 Elm Street))」というアドレスが関連付けられてもよい。別の例として「演奏する(play)」というコマンドに、「ベートーベンの第5交響曲(Beethoven 5th Symphony)」、または、「WGN」あるいは「720AM」のようなラジオ放送局識別が関連付けられてもよい。さらに別の例として、HVACシステムの「熱(heat)」というコマンドに、「75F」などの温度レベルおよび/または「運転手(driver)」などの位置が関連付けられてもよい。

【0030】

ジェスチャー認識モジュール(18)の出力は、随意のジェスチャー確認モジュール(20)によって受け取られる。ジェスチャー認識モジュール(18)の出力が正確であることを確認するために、ジェスチャー確認モジュール(20)はユーザーからのフィードバックを求めるおよび/または受け取る。

例えば、確認モジュール(20)は、ユーザーから入力の確認を音声で求める。ジェスチャー認識モジュール(18)の出力が「霜を取る(defrost)」である場合、その後、確認モジュール(20)は、「「霜を取る(defrost)」を書きましたか?」と音声で(例えば、オーディオスピーカー(28)を介して;図2)運転手に訊ねる。「霜を取る(defrost)」と確かに言ったことを確認するために、ユーザーは「はい(yes)」と話してもよく、これはマイクロホン(26)によって受け取られ、確認モジュール(20)へと入力される。代替的に、ユーザーは、表面(12)上で「yes」の「y」を書くことによって、確かに「霜を取る(defrost)」と言ったことを確認してもよい。他方で、ユーザーが「霜を取る」と書かなかった場合、「no」と話すか、または、表面(12)上で「n」と書いてもよい。これに応えて、確認モジュール(20)は、「先程の入力をもう一度書いてください」と音声で運転手に尋ねる。このサイクルは、確認モジュール(20)がジェスチャーを正確に(すなわち、ユーザーの意図した通りに)認識したという確認を得るまで、ジェスチャー捕捉モジュール(16)にユーザーのジェスチャーを解釈させたまま継続する。ユーザーのジェスチャーの正確な認識の確認を得た後に、確認モジュール(20)は、ナビゲーションシステム(30)、音声システム(32)、または、HVACシステム(34)のような車両システムに認識されたジェスチャーを転送する。加えて、または、代替的に、確認モジュール(20)は、同様にユーザー確認を求めるために、他の様式(視覚的、押しボタン式、ジェスチャーなど)を使用してもよい。

【0031】

当然のことながら、ジェスチャー確認モジュール(20)は、本発明において随意である。すなわち、認識または解釈が最初に確認モジュール(20)によって確認されることなく、モジュール(18)の認識出力を、おそらく通信モジュール(22)によって車両システム(30、32、および/または、34)に転送することが可能である。

【0032】

自動車の客室内に設置されるようなジェスチャーに基づいた情報およびコマンドの入力システム(10)の斜視図が図2に示される。運転手が指で書きこむための2つの表面(12)が示されているが、実際には2つの表面(12)の1つだけしか含まれない。表面(12)のうちの1つはハンドル(24)の中央部分に設けられる。表面(12)のもう1つは、運転手の右手の肘掛け(25)の上部に設けられる。

【0033】

カメラ(16)の形をしたジェスチャー捕捉モジュールは、自動車の客室のルーフに、一般的には運転手の頭部の上に設置される。カメラ(16)は、2つの表面(12)のどちらかが実際に車両内で設けられた方向に向けられる。しかしながら、両方の表面(12)を含む実施形態では、カメラ(16)は、表面(12)の両方または一方に選択的に向けられるように調整可能である。

【0034】

図2に示されるように、確認モジュール(20)はマイクロホン(26)とオーディオスピーカー(28)に接続されてもよい。マイクロホン(26)とオーディオスピーカー(28)は、例えば、肘掛け、ダッシュボード、または、ドアなどのような客室内の任意の場所に設置されてもよい。

【0035】

図3は、書き込み面(12)の1つの実施形態に含まれるグリッドレイアウトを例示する。グリッドレイアウトは、等しく間隔を置いた垂直線(36)と等しく間隔を置いた水平線(38)とによって定義されるような行および列の矩形行列を含む。

【0036】

ジェスチャー認識モジュール(18)は、グリッドレイアウト内のどのセル(40)上でユーザーが指を滑らせたのか、および、どんな順番でユーザーは指を滑らせたのかに基づいて、ユーザーがどの英数字を描いたのかを決定する。ジェスチャー認識モジュール(18)は、ユーザーの指が辿ったセル(40)のリストを作るために、ルックアップテーブルまたはアルゴリズムを使用し、セルのそのリストを認識した英数字に翻訳する。セル(40)に触れる順番は、ルックアップテーブルまたはアルゴリズムへの入力であってもよい。

【0037】

ユーザーの手と背景表面(12)との間の視覚コントラストを改善し、それによって、ジェスチャー捕捉工程の精度を改善するために、表面(12)は白色などの単色で作られる。表面(12)のこのような白一色は、さらに、それによってさらに大きなコントラストがもたらされるおかげで、カメラ(16)が線(36、38)の位置を検知しやすくする。

【0038】

図4では、車両システムに入力値を入力する本発明の方法(400)の1つの実施形態が示されている。第1の工程(402)で、表面は車両のハンドルおよび/または肘掛け上に提供される。すなわち、表面(12)は、図2に示されたように、ハンドル(24)または肘掛け(25)上に設けられてもよい。

【0039】

次の工程(404)では、ユーザーが触れる表面上の複数の位置が検知される。例えば、カメラ(16)は、表面(12)に沿った運転手の指の動きを捕捉し、触れられる表面上の位置を同定する。カメラ(16)は、表面(12)上のどのセル(40)(図3)が触れられるのかを検知する。代替的に、カメラ(16)は、表面(12)の位置とは無関係に、(例えば、空中の)指の動きのみを検知してもよい。

【0040】

次に、工程(406)では、表面上の複数の触れられた位置にもっとも類似した形状を有する英数字が決定される。例えば、ルックアップテーブルまたはアルゴリズムは、ユーザーの指の移動によって定義された位置の群によって、どの数字または文字が最もよく表わされているかに対して使用されてもよい。

【0041】

工程(408)で、ユーザーは、英数字および/または英数字が含まれる単語を、音声で知らされる。例えば、合成音声は、システムがユーザーの指の動きによって定義された形状にもっとも良く似ていると決定した、「a」または「1」などの文字または数字を発しながらスピーカー(28)から流される。代替的に、合成音声は、個々の文字または数字を述べないが、その代わりに、システムが指の動きから決定された一連の文字によって形成された単語を決定するまで、抑制される。例えば、ユーザーが指で文字「f」、「i」、「n」、および、「d」を書いた後、合成音声はスピーカー(28)を介して「find」という単語を言う。加えて、システムは1つのフレーズを加え、ユーザーが指による書き込みのシステムの解釈を確認するように促す。1つの実施形態では、決定した単語を述べる前に、システムは「書きましたか」と音声で言い、その後、決定した単語(例えば、「find」)を言う。別の実施形態では、システムは、システムが作用するフレーズまたは単語の群を述べる。例えば、システムは、ナビゲーションシステムで意図される、「ガソリンスタンドを探す」などといったすぐに使用可能なコマンドを発してもよい。

【0042】

システムは、個々の文字の全ての文字が正確に認識されるとは限らないと想定する一方で、個々の英数字の認識にもっとも良く適合する単語またはフレーズを決定する。例えば、システムが順次的な一組の文字を「f」、「j」、「n」および「d」であるとして認識した場合、システムは「j」が「i」である可能性が最も高いと思われることを辞書から判断し、従って、システムはその単語を「find」と解釈する。

【0043】

次の工程(410)では、英数字および/または単語が、ユーザーが決定工程で決定されることを望んでいた英数字および/または単語であるかどうかに関して、音声フィードバックがユーザーから受け取られる。例えば、ユーザーは、指での書き込みのシステムの解釈を確認したこと、または、確認していないことを話し、このように口頭で述べたことはマイクロホン(26)によって拾い上げられる。1つの実施形態では、ユーザーは、「正しい(correct)」または「誤っている(incorrect)」と言ってもよい。別の実施形態では、ユーザーは、加えて、または、代替的に、訂正された解釈を述べてもいい。例えば、システムが「R」と述べたことに応じて、ユーザーは「いいえ、Pです(No, P)」と述べてもよい。システムは、その最初の解釈から、ユーザーが文字「R」に少なくとも似ている文字を書こうとしていると想定し、したがって、この知識は、システムが、「C」または「G」などの類似する音の文字の代わりに文字「P」としてユーザーの音声による発声を解釈する手助けをする。

【0044】

別の実施形態では、ユーザーは、音声での訂正(例えば、「いいえ、Pです」(No, P))に加えて、または、その代わりに、前回誤って解釈された書き込みを書き直してもよい。例えば、ユーザーは、「R」の一部であると解釈することができる任意の動きを回避するように注意して、表面上で「P」を書き直してもよい。

【0045】

システムがフレーズの一部のみを誤って解釈している場合、ユーザーはそのフレーズを口頭で正しく言い直して、フレーズの訂正された箇所のみを表面(12)に書き直してもよい。例えば、システムが「「R通りを探す(Find R Street)」と書きましたか?」と音声で聞いてきた場合、ユーザーは、「いいえ、P通りを探す(No,find P Street)」と言ってもよく、ユーザーは訂正された箇所のみ(すなわち、文字「P」)を表面(12)に(例えば、ほぼ同時に)書き直してもよい。

【0046】

別の実施形態では、表面(12)上の書込みの解釈の信頼度が閾値未満である場合のみ、システムは音声確認を求めることがある。すなわち、書込みが英数字または単語と十分なほど厳密に一致する場合、システムは確認を求めなくてもよい。さらに別の実施形態では、現在、運転作業が運転手の注意を要求するレベルは、音声確認を求めるべきかどうかにおける因子である。例えば、車両が高速で移動しているか、頻繁に曲がっている場合、システムは、音声確認を求めることによって、一時的に運転手の気をそらすことはあまりしない。むしろ、システムは、運転手には重要でない娯楽またはオーディオ機能について尋ねるよりも、安全性を最重視すべき機能(例えば、デフロスターの操作)またはナビゲーション機能の方を求める傾向にある。さらに別の実施形態では、音声確認を求めるシステムの可能性は、マイクロホン(26)によって測定されるように、客室の音または雑音のレベルに反比例してもよい。

【0047】

最終工程(412)では、入力は車両の電子システムに送信され、そこで入力は決定された英数字に依存している。例えば、「ピザ屋を探す(find pizza)」という入力が、車両のナビゲーションシステムに送信され、この入力はこの2つの単語からなるフレーズの9つの文字の各々のシステム認識に応答している。

【0048】

別の実施形態では、システムは、ユーザーが、システムが認識するのがさらに難しい小文字で書こうとしていることを検知する。これに応答して、システムは、ユーザーがこれらの書き込みでも小文字を使用していたと想定して、将来の書き込みを解釈する。代替的に、または、加えて、システムは、「大文字で書いてください」と運転手に音声で要請し、その結果、システムは非常に高い精度で書き込みを解釈するようになる。

【0049】

さらに別の実施形態では、システムは、書き込みの解釈中の車両の移動を補正することもある。例えば、表面(12)がハンドル(24)上にある場合、ジェスチャー認識モジュール(18)は、書かれた英数字を認識する際に回転によってユーザーの指を引きずる傾向があるハンドル(24)の回転を補正することがある。別の例として、突然の車線変更は、ユーザーの指を表面(12)上で水平方向のジグザグパターンで動かし、ジェスチャー認識モジュール(18)は、指の動きを英数字と一致させる際にジグザグを無視する。同様のわずかな影響が、加速、減速、および/または、旋回によって生じることがあり、指による書き込みの解釈はこれらのすべての影響を補正する。スピードメーター、ステアリングセンサ、ジャイロスコープなどのような従来の車両装備センサは、ジェスチャー認識モジュール(18)に車両の移動データを提供する。

【0050】

本発明は車両に適用されるものとして本明細書に記載されてきたが、当然のことながら、本発明は他の用途を有する。より一般的には、本発明は、運転手が別のタスクから注意をそらすことなく、英数字入力値を迅速に入力する必要がある任意のシステムに適用可能である。例えば、本発明は工場環境で使用されてもよく、ヒューマンマシンオペレータ(human machine operator)によって用いられてもよい。

【0051】

この発明は例示的な設計を有するものとして記載されてきたが、本発明はこの開示の精神と範囲内でさらに修正されてもよい。したがって、この出願は、一般的な原則を用いて、本発明の任意の変化、用途、または、適用を対象にするように意図されている。

【特許請求の範囲】

【請求項1】

ユーザーからの入力を受け取る方法であって、

前記方法は、

ユーザーの手の届く範囲の表面を提供する工程と、

ユーザーが触れる表面上の複数の位置を検知する工程と、

表面上の複数の触れられた位置にもっとも類似した形状を有する英数字を決定する工程と、

英数字および/または英数字が含まれる単語をユーザーに知らせる工程と、

英数字および/または単語が、決定する工程で決定されることをユーザーが望む英数字および/または単語であるかどうかに関して、ユーザーからフィードバックを受け取る工程を含むことを特徴とする方法。

【請求項2】

表面が車両のハンドルまたは肘掛け上に提供されることを特徴とする請求項1に記載の方法。

【請求項3】

表面が複数のセルまたはグラデーションの付いた色のパレットを含み、前記検知する工程が、表面のどの位置がユーザーによって触れられたかを突き止める工程を含むことを特徴とする請求項1に記載の方法。

【請求項4】

前記決定する工程が、突き止められた触れられた位置を、決定された英数字と関連付けるルックアップテーブルまたはアルゴリズムを使用する工程を含むことを特徴とする請求項3に記載の方法。

【請求項5】

英数字または単語が正しいというユーザーからのフィードバックを受け取ったことに応答して、電子システムに入力を送信する工程をさらに備え、入力は英数字または単語に依存していることを特徴とする請求項1に記載の方法。

【請求項6】

前記検知する工程と決定する工程は、英数字によって形成される単語が特定されるまで繰り返され、前記知らせる工程は特定された単語をユーザーに音声でまたは視覚的に知らせる工程を含むことを特徴とする請求項1に記載の方法。

【請求項7】

英数字はユーザーに提供されるメニュー選択に対応することを特徴とする請求項1に記載の方法。

【請求項8】

車両に入力値を入力する方法であって、

前記方法は、

車両のハンドルおよび/または肘掛け上に表面を提供する工程と、

ユーザーが触れる表面上の複数の位置を検知する工程と、

表面上の複数の触れられた位置にもっとも適合する英数字を決定する工程と、

決定された英数字に依存する入力を車両の電子システムに送信する工程を含むことを特徴とする方法。

【請求項9】

車両の電子システムは、ナビゲーションシステム、娯楽システム、または、HVACシステムを含むことを特徴とする請求項8に記載の方法。

【請求項10】

前記検知する工程と決定する工程は、決定された英数字によって形成される単語が特定されるまで繰り返され、入力は特定された単語に依存することを特徴とする請求項8に記載の方法。

【請求項11】

単語は電子システムへのコマンドまたは情報であることを特徴とする請求項10に記載の方法。

【請求項12】

ユーザーからのフィードバックを介して、決定された英数字がユーザーが表面に触れた際に伝えようとした英数字であることを確認する工程をさらに含むことを特徴とする請求項8に記載の方法。

【請求項13】

前記確認する工程が、

決定された英数字をユーザーに知らせる工程と、

決定された英数字がユーザーの意図した英数字であるかどうかについて、ユーザーからのフィードバックを受け取る工程を含むことを特徴とする請求項12に記載の方法。

【請求項14】

ユーザーからの音声を検出する工程と、

ユーザーからの音声と表面上の複数の触れられた位置とにもっとも良く適合する一連の英数字列を突き止める工程をさらに含み、電子システムへの入力は、突き止められた英数字列に依存することを特徴とする請求項8に記載の方法。

【請求項15】

車両内のシステムに電子入力を提供するための構造であって、

前記構造は、

車両の客室内に配された表面と、

ユーザーが触れる表面の複数の位置を特定するために構成された、表面に関連付けられるジェスチャー捕捉モジュールと、

表面上の複数の触れられた位置によって形成される形状にもっともよく似た形状を有する英数字を決定するように構成された、ジェスチャー捕捉モジュールに通信接続しているジェスチャー認識モジュールと、

ジェスチャー認識モジュールに通信接続しているジェスチャー確認モジュールを含み、

ジェスチャー確認モジュールが、

ユーザーと相互作用することによって、決定された英数字、または、決定された英数字を含む単語が、ユーザーがスクリーンに触れることで伝えようとしていた英数字または単語であることを確認するように、および、

確認された英数字または単語に依存する入力を車両内のシステムに送信するように、

構成されることを特徴とする構造。

【請求項16】

ジェスチャー捕捉モジュールがカメラを含むことを特徴とする請求項15に記載の構造。

【請求項17】

表面が車両のハンドルまたは肘掛け上にあることを特徴とする請求項15に記載の構造。

【請求項18】

ジェスチャー確認モジュールは、

決定された英数字をユーザーに知らせるように、および、

決定された英数字がユーザーの考えていた英数字であるかどうかについて、ユーザーからのフィードバックを受け取るように、

構成されることを特徴とする請求項15に記載の構造。

【請求項19】

表面がグリッドまたはグラデーションの付いた色のパレットといった特別な背景で覆われることを特徴とする請求項15に記載の構造。

【請求項20】

ジェスチャー捕捉モジュールが、表面上の背景のどの部分がユーザーによって触れられたかを特定するように構成されることを特徴とする請求項19に記載の構造。

【請求項1】

ユーザーからの入力を受け取る方法であって、

前記方法は、

ユーザーの手の届く範囲の表面を提供する工程と、

ユーザーが触れる表面上の複数の位置を検知する工程と、

表面上の複数の触れられた位置にもっとも類似した形状を有する英数字を決定する工程と、

英数字および/または英数字が含まれる単語をユーザーに知らせる工程と、

英数字および/または単語が、決定する工程で決定されることをユーザーが望む英数字および/または単語であるかどうかに関して、ユーザーからフィードバックを受け取る工程を含むことを特徴とする方法。

【請求項2】

表面が車両のハンドルまたは肘掛け上に提供されることを特徴とする請求項1に記載の方法。

【請求項3】

表面が複数のセルまたはグラデーションの付いた色のパレットを含み、前記検知する工程が、表面のどの位置がユーザーによって触れられたかを突き止める工程を含むことを特徴とする請求項1に記載の方法。

【請求項4】

前記決定する工程が、突き止められた触れられた位置を、決定された英数字と関連付けるルックアップテーブルまたはアルゴリズムを使用する工程を含むことを特徴とする請求項3に記載の方法。

【請求項5】

英数字または単語が正しいというユーザーからのフィードバックを受け取ったことに応答して、電子システムに入力を送信する工程をさらに備え、入力は英数字または単語に依存していることを特徴とする請求項1に記載の方法。

【請求項6】

前記検知する工程と決定する工程は、英数字によって形成される単語が特定されるまで繰り返され、前記知らせる工程は特定された単語をユーザーに音声でまたは視覚的に知らせる工程を含むことを特徴とする請求項1に記載の方法。

【請求項7】

英数字はユーザーに提供されるメニュー選択に対応することを特徴とする請求項1に記載の方法。

【請求項8】

車両に入力値を入力する方法であって、

前記方法は、

車両のハンドルおよび/または肘掛け上に表面を提供する工程と、

ユーザーが触れる表面上の複数の位置を検知する工程と、

表面上の複数の触れられた位置にもっとも適合する英数字を決定する工程と、

決定された英数字に依存する入力を車両の電子システムに送信する工程を含むことを特徴とする方法。

【請求項9】

車両の電子システムは、ナビゲーションシステム、娯楽システム、または、HVACシステムを含むことを特徴とする請求項8に記載の方法。

【請求項10】

前記検知する工程と決定する工程は、決定された英数字によって形成される単語が特定されるまで繰り返され、入力は特定された単語に依存することを特徴とする請求項8に記載の方法。

【請求項11】

単語は電子システムへのコマンドまたは情報であることを特徴とする請求項10に記載の方法。

【請求項12】

ユーザーからのフィードバックを介して、決定された英数字がユーザーが表面に触れた際に伝えようとした英数字であることを確認する工程をさらに含むことを特徴とする請求項8に記載の方法。

【請求項13】

前記確認する工程が、

決定された英数字をユーザーに知らせる工程と、

決定された英数字がユーザーの意図した英数字であるかどうかについて、ユーザーからのフィードバックを受け取る工程を含むことを特徴とする請求項12に記載の方法。

【請求項14】

ユーザーからの音声を検出する工程と、

ユーザーからの音声と表面上の複数の触れられた位置とにもっとも良く適合する一連の英数字列を突き止める工程をさらに含み、電子システムへの入力は、突き止められた英数字列に依存することを特徴とする請求項8に記載の方法。

【請求項15】

車両内のシステムに電子入力を提供するための構造であって、

前記構造は、

車両の客室内に配された表面と、

ユーザーが触れる表面の複数の位置を特定するために構成された、表面に関連付けられるジェスチャー捕捉モジュールと、

表面上の複数の触れられた位置によって形成される形状にもっともよく似た形状を有する英数字を決定するように構成された、ジェスチャー捕捉モジュールに通信接続しているジェスチャー認識モジュールと、

ジェスチャー認識モジュールに通信接続しているジェスチャー確認モジュールを含み、

ジェスチャー確認モジュールが、

ユーザーと相互作用することによって、決定された英数字、または、決定された英数字を含む単語が、ユーザーがスクリーンに触れることで伝えようとしていた英数字または単語であることを確認するように、および、

確認された英数字または単語に依存する入力を車両内のシステムに送信するように、

構成されることを特徴とする構造。

【請求項16】

ジェスチャー捕捉モジュールがカメラを含むことを特徴とする請求項15に記載の構造。

【請求項17】

表面が車両のハンドルまたは肘掛け上にあることを特徴とする請求項15に記載の構造。

【請求項18】

ジェスチャー確認モジュールは、

決定された英数字をユーザーに知らせるように、および、

決定された英数字がユーザーの考えていた英数字であるかどうかについて、ユーザーからのフィードバックを受け取るように、

構成されることを特徴とする請求項15に記載の構造。

【請求項19】

表面がグリッドまたはグラデーションの付いた色のパレットといった特別な背景で覆われることを特徴とする請求項15に記載の構造。

【請求項20】

ジェスチャー捕捉モジュールが、表面上の背景のどの部分がユーザーによって触れられたかを特定するように構成されることを特徴とする請求項19に記載の構造。

【図2】

【図3】

【図1】

【図4】

【図3】

【図1】

【図4】

【公表番号】特表2013−503396(P2013−503396A)

【公表日】平成25年1月31日(2013.1.31)

【国際特許分類】

【出願番号】特願2012−526989(P2012−526989)

【出願日】平成22年8月26日(2010.8.26)

【国際出願番号】PCT/US2010/046823

【国際公開番号】WO2011/025884

【国際公開日】平成23年3月3日(2011.3.3)

【出願人】(511150573)ロベルト ボッシュ ゲーエムベーハー (6)

【Fターム(参考)】

【公表日】平成25年1月31日(2013.1.31)

【国際特許分類】

【出願日】平成22年8月26日(2010.8.26)

【国際出願番号】PCT/US2010/046823

【国際公開番号】WO2011/025884

【国際公開日】平成23年3月3日(2011.3.3)

【出願人】(511150573)ロベルト ボッシュ ゲーエムベーハー (6)

【Fターム(参考)】

[ Back to top ]