表示装置、表示方法、及びプログラム

【課題】ユーザがコンテンツを見ているときに必要のないオブジェクトの立体表示を終了する。

【解決手段】表示装置100の3D表示データ生成部113は、コンテンツを構成する各オブジェクトの2D表示用データと、フォーカス対象のオブジェクトの3D表示用データとを表示用コンテンツ300から生成する。出力部130は、操作開始状態である場合、フォーカス対象のオブジェクトの3D表示用データと、他のオブジェクトの2D表示用データを用い、フォーカス対象のオブジェクトが立体表示されているコンテンツ画面を表示デバイス400に表示させる。判定部121は、入力部120に操作終了が入力されたと判断した場合、3D表示の終了を出力部130に指示する。出力部130は、全てのオブジェクトについて2D表示用データを用い、全オブジェクトが平面表示されているコンテンツ画面を表示デバイス400に表示させる。

【解決手段】表示装置100の3D表示データ生成部113は、コンテンツを構成する各オブジェクトの2D表示用データと、フォーカス対象のオブジェクトの3D表示用データとを表示用コンテンツ300から生成する。出力部130は、操作開始状態である場合、フォーカス対象のオブジェクトの3D表示用データと、他のオブジェクトの2D表示用データを用い、フォーカス対象のオブジェクトが立体表示されているコンテンツ画面を表示デバイス400に表示させる。判定部121は、入力部120に操作終了が入力されたと判断した場合、3D表示の終了を出力部130に指示する。出力部130は、全てのオブジェクトについて2D表示用データを用い、全オブジェクトが平面表示されているコンテンツ画面を表示デバイス400に表示させる。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、表示装置、表示方法、及びプログラムに関する。

【背景技術】

【0002】

主にテレビなどがコンテンツを表示する際、ブラウザのフォーカスやメニューなどのオブジェクトを立体表示する技術がある。例えば、特許文献1には、フォーカスがあたっている部品を立体表示する技術が記載されている。また、特許文献2には、使用頻度、重要度、ユーザ嗜好等のオブジェクトの属性に応じて優先度が高いオブジェクトを立体表示することで、ユーザがコンテンツを操作する上での利便性を向上させることが記載されている。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特開2004−354540号公報

【特許文献2】特開2005−49668号公報

【発明の概要】

【発明が解決しようとする課題】

【0004】

上述した従来の技術では、立体表示させる対象を考慮することで、ユーザが実際にオブジェクトを操作する際の操作性を向上させている。しかし、これは常に何らかのオブジェクトが立体表示された状態であり、ユーザが本来見たいと思っていない情報が立体視されたままとなる可能性がある。例えば、ユーザは、データ放送の電車の運行情報や、テロップで流れるニュースなどで提示される情報を見ていたいだけの場合や、ブラウザで再生している映像を見ているだけの場合などがある。このときに、ユーザが意識する必要のない、あるいは意識したくないメニューやアイコンなどのオブジェクトが立体視されているままの状態では、本来見たい情報や映像を見にくくしてしまう。

【0005】

本発明は、このような事情を考慮してなされたものであり、ユーザがコンテンツを見ているときに必要のないオブジェクトの立体表示を終了することができる表示装置、表示方法、及びプログラムを提供する。

【課題を解決するための手段】

【0006】

上述した課題を解決するために、本発明は、画像を表示する表示部と、前記表示部に表示用データを表示させる出力部と、操作終了が入力されたか否かを判断する判定部とを備え、前記出力部は、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、ことを特徴とする表示装置である。

【0007】

また、本発明は、上述する表示装置であって、前記出力部は、前記表示部にコンテンツを構成するオブジェクトを立体表示させる表示用データ及び前記コンテンツを構成する他のオブジェクトを平面表示させる表示用データを表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、ことを特徴とする。

【0008】

また、本発明は、上述する表示装置であって、立体表示対象の前記オブジェクトはユーザに操作を選択させるメニューである、ことを特徴とする。

【0009】

また、本発明は、表示装置が実行する表示方法であって、出力部が、前記表示装置が備える表示部に表示用データを表示させる出力ステップと、判定部が、操作終了が入力されたか否かを判断する判定ステップと、前記出力部が、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定ステップにおいて操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了ステップと、を有することを特徴とする表示方法である。

【0010】

また、本発明は、表示装置として用いられるコンピュータに、前記表示装置が備える表示部に表示用データを表示させる出力手順と、操作終了が入力されたか否かを判断する判定手順と、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定手順において操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了手順と、を実行させるためのプログラムである。

【発明の効果】

【0011】

本発明によれば、ユーザがコンテンツを見ているときに必要のないオブジェクトの立体表示を終了することができる。

【図面の簡単な説明】

【0012】

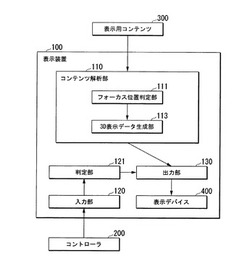

【図1】本発明の一実施形態による情報表示装置の構成を示す図である。

【図2】同実施形態による表示装置の内部構成を示すブロック図である。

【図3】同実施形態による表示用データ生成処理フローを示す図である。

【図4】同実施形態による表示処理フローを示す図である。

【図5】同実施形態による表示装置が表示する画面イメージを示す図である。

【図6】同実施形態による表示装置が表示する画面イメージを示す図である。

【発明を実施するための形態】

【0013】

以下、図面を参照しながら本発明の実施形態を詳細に説明する。

【0014】

図1は本発明の一実施形態による情報表示装置1の構成を示す図である。同図に示すように、本実施形態の情報表示装置1は、例えば、表示デバイス400を備えるテレビジョン受像機などの表示装置100と、操作デバイスであるコントローラ200とから構成される。表示デバイス400は、立体表示(以下、「3D(三次元)表示」と記載する。)が可能なディスプレイであり、専用の眼鏡が必要な場合もある。

なお、表示装置100にジェスチャー入力や音声入力が可能である場合、コントローラ200などの操作デバイスはなくともよい。また、情報表示装置1は、携帯電話端末、パーソナルコンピュータ、ゲーム機など、操作デバイスを同じ筐体に備える表示装置100でもよい。

【0015】

図2は、表示装置100の内部構成を示すブロック図であり、本実施形態と関係する機能ブロックのみ抽出して示してある。同図に示すように、表示装置100は、コンテンツ解析部110、入力部120、判定部121、出力部130、及び表示デバイス400(表示部)を備えて構成される。

【0016】

コンテンツ解析部110は、コンテンツの画像を表示させるためのデータである表示用コンテンツ300を取得する。表示用コンテンツ300は、1以上のオブジェクトの画像を表示させるためのデータからなる。オブジェクトには、例えば、動画、静止画、テキスト、メニューボタンなどが含まれる。コンテンツ解析部110は、取得した表示用コンテンツ300から、表示デバイス400にコンテンツの画像を表示させるための各オブジェクトの表示用データを生成する。

【0017】

コンテンツ解析部110は、フォーカス位置判定部111及び3D表示データ生成部113を備える。フォーカス位置判定部111は、表示用コンテンツ300の言語記述に基づいてフォーカスされているオブジェクトを特定する。

3D表示データ生成部113は、表示用コンテンツ300に含まれる全てのオブジェクトの2D(二次元)表示用データを生成するとともに、フォーカス位置判定部111によってフォーカスされていると特定されたオブジェクトの3D表示用データを生成する。2D表示用データは、3D表示を行なわずに、オブジェクトを通常どおり平面表示させる表示用データであり、3D表示用データは、オブジェクトを3D表示させる表示用データである。3D表示データ生成部113は、生成した各オブジェクトの2D表示用データと、フォーカスされているオブジェクトの3D表示用データとを出力部130に出力する。

【0018】

入力部120は、ユーザによる操作の入力を受けるインタフェースである。例えば、入力部120は、コントローラ200に行われたユーザ操作を赤外線通信等の無線通信により受信する。あるいは、入力部120は、ユーザのジェスチャーや音声による入力を受けてもよい。また、入力部120は、表示装置100が備えるキーやボタンなどの入力装置(操作デバイス)であってもよい。

判定部121は、入力部120に入力されたユーザ操作に基づいて、操作の開始や終了を判定する。

【0019】

出力部130は、3D表示データ生成部113から入力された表示用データを表示デバイス400に表示させる。出力部130は、判定部121が操作開始と判定した場合、フォーカスされているオブジェクトの3D表示用データと、フォーカスされていないオブジェクトの2D表示用データとを出力部130に出力し、コンテンツの画像を表示させる。また、出力部130は、判定部121が操作終了と判定した場合、全てのオブジェクトについて2D表示用データを出力部130に出力し、コンテンツの画像を表示させる。

表示デバイス400は、既存の3D表示方式により3D表示が可能なディスプレイである。

【0020】

次に、表示装置100の動作について説明する。

【0021】

図3は、本実施形態の表示装置100における表示用データ生成処理フローを示す図である。

表示装置100のコンテンツ解析部110は、表示用コンテンツ300を取得する(ステップS11)。コンテンツ解析部110は、表示用コンテンツ300を放送や通信により受信してもよく、内部に備える図示しない記憶装置やウェブサーバなど外部の記憶装置から読み出してもよい。

【0022】

フォーカス位置判定部111は、取得した表示用コンテンツ300の言語記述を解析し、この表示用コンテンツ300に含まれるオブジェクトのうち、フォーカスされているオブジェクトを特定する(ステップS12)。

【0023】

例えば、フォーカス位置判定部111は、表示用コンテンツ300にデフォルトでフォーカス対象である旨が記述されているオブジェクト(例えば、メニューボタンなど)を特定する。

あるいは、フォーカス位置判定部111は、表示用コンテンツ300に含まれるオブジェクトのうち、過去のユーザの入力に基づいてフォーカス対象のオブジェクトを特定する。例えば、フォーカス位置判定部111は、入力部120に入力されたユーザ操作から判定部121においてユーザが選択したと判断したメニューボタンと、その選択回数を記憶しておく。フォーカス位置判定部111は、記憶している各メニューボタンの選択回数に基づいて、使用頻度の高いメニューボタンをフォーカス対象のオブジェクトであると判断する。

【0024】

またあるいは、現在表示装置100がユーザ操作モードであり、表示デバイス400に3D表示を行っている状態である場合、フォーカス位置判定部111は、入力部120に入力されたユーザ操作に基づいて判定部121が操作対象であると判断したオブジェクトを、フォーカス対象のオブジェクトであると判断する。例えば、判定部121は、入力部120に入力されたユーザ操作からあるメニューボタンが選択されたと判定した場合、その旨をフォーカス位置判定部111に通知する。フォーカス位置判定部111は、通知されたメニューボタンをフォーカス対象のオブジェクトであると判断する。

【0025】

3D表示データ生成部113は、表示用コンテンツ300をデコードするなどして、表示対象の各オブジェクトの2D表示用データを生成する(ステップS13)。

例えば、表示用コンテンツ300が放送コンテンツである場合、表示対象のオブジェクトは、コントローラ200により選択されたチャネルの番組(動画)や、データ放送の天気予報(静止画)、ニュース(テキストデータ)、データ放送のメニューボタン、メニューボタンにより選択された情報(静止画やテキストデータ)などである。

【0026】

さらに、3D表示データ生成部113は、ステップS12において特定されたオブジェクトの2D表示用データを用いて、3D表示用データを生成する(ステップS14)。2D表示を行うための表示用データから3D表示を行うための表示用データを生成する方法として、例えば、特開平8―63615号公報に記載の方法などがあるが、任意の既存の方法を用いることができる。3D表示データ生成部113は、生成した全てのオブジェクトの2D表示用データと、フォーカスされているオブジェクトの3D表示用データを出力部130に出力する(ステップS15)。

【0027】

図4は、本実施形態の表示装置100における表示処理フローを示す図である。

出力部130は、現在、操作モードであるか否かを判断する(ステップS21)。なお、表示装置100の初期状態を操作モードとするか、閲覧モードとするかについては、任意である。出力部130は、現在閲覧モードであり、操作モードではないと判断した場合(ステップS21:NO)、3D表示データ生成部113から入力された各オブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS22)。これにより、表示デバイス400には、全てのオブジェクトが2D表示されているコンテンツの画像が表示される。

【0028】

判定部121は、入力部120に操作開始が入力されたかを判定する(ステップS23)。判定部121が、操作開始は入力されていないと判断した場合(ステップS23:NO)、表示装置100は、ステップS22の処理を繰り返す。

【0029】

判定部121は、入力部120に入力されたユーザ操作が操作開始を示していると判断した場合(ステップS23:YES)、ユーザ操作モードに遷移し、3D表示要求を出力部130に出力する(ステップS24)。このとき、判定部121は、ユーザ操作が、特定のオブジェクトについての操作開始を示していると判断した場合、そのオブジェクトをフォーカス位置判定部111に通知する。これにより、図3のステップS12においてフォーカス位置判定部111は、判定部121から通知されたオブジェクトをフォーカス対象として特定し、図3のステップS14において、3D表示データ生成部113は、通知されたオブジェクトの3D表示用データを生成する。

【0030】

出力部130は、判定部121から3D表示要求を受信すると、操作モードへ遷移したと判断し、ステップS21からの処理を繰り返す。これにより、出力部130は、現在、操作モードであると判断し(ステップS21:YES)、3D表示データ生成部113から入力されたフォーカス対象のオブジェクトの3D表示用データと、フォーカス対象以外のオブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS25)。これにより、表示デバイス400には、フォーカスされているオブジェクトが3D表示され、他のオブジェクトは2D表示されているコンテンツの画像が表示される。

【0031】

判定部121は、入力部120に操作終了が入力されたかを判定する(ステップS26)。判定部121が、操作終了は入力されていないと判断した場合(ステップS26:NO)、表示装置100は、ステップS25の処理を繰り返す。

【0032】

判定部121は、入力部120に入力されたユーザ操作が操作終了を示していると判断した場合(ステップS26:YES)、閲覧モードに遷移し、3D表示終了要求を出力部130に出力する(ステップS27)。出力部130は、判定部121から3D表示終了要求を受信すると、閲覧モードに遷移したと判断し、ステップS21からの処理を繰り返す。これにより、出力部130は、現在、操作モードではないと判断し(ステップS21:YES)、3D表示データ生成部113から入力された各オブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS22)。つまり、表示装置100は、操作モードのときに3D表示させていたオブジェクトの3D表示用データに代えて、当該オブジェクトの2D表示用データを表示デバイス400に表示させる。

このようにして、表示装置100は、ユーザによる操作終了の指示に従って3D表示を終了させる。

【0033】

なお、ステップS25においてユーザが他のオブジェクトの操作開始を入力した場合、ステップS26において判定部121は、NOと判断する。判定部121は、新たに操作開始が指示されたオブジェクトをフォーカス位置判定部111に通知する。これにより、図3のステップS12においてフォーカス位置判定部111は、判定部121から通知されたオブジェクトをフォーカス対象として特定し、図3のステップS14において、3D表示データ生成部113は、通知されたオブジェクトの3D表示用データを生成する。従って、ステップS25において、出力部130は、新たに操作開始が指示されたオブジェクトの3D表示用データと、これまで3D表示を行っていたオブジェクトを含む他のオブジェクトの2D表示用データを表示デバイス400に表示させる。

【0034】

ステップS23において、判定部121が操作開始として判断するユーザ操作の例を以下に示す。

(操作a1)コントローラ200を手に取る。例えば、コントローラ200は、内部に備えるセンサに基づいてユーザが当該コントローラ200を手に取ったことを検出した場合、その旨を表示装置100の入力部120に通知する。

(操作a2)操作開始に対応した特定のジェスチャーを行う。この場合、入力部120は、ジェスチャー入力装置であり、判定部121は、入力部120によるジェスチャーの解析結果から操作開始を判断する。

(操作a3)ユーザがコントローラ200の操作開始キーを押す。コントローラ200は、操作開始キーが押された旨を表示装置100の入力部120に通知する。

(操作a4)表示デバイス400の前に存在するユーザの手を動かし始める。入力部120は、表示デバイス400の前に存在するユーザが手を動かし始めたことを検出し、判定部121は、入力部120の検出結果から操作開始と判断する。

(操作a5)ユーザが口頭で操作開始を指示する。この場合、入力部120は、音声入力装置であり、ユーザの発声を音声認識した結果を判定部121に出力する。判定部121は、入力部120の音声認識結果から操作開始と判断する。

【0035】

また、ステップS26において、判定部121が操作終了として判断するユーザ操作の例を示す。

(操作b1)コントローラ200を手から離す。例えば、コントローラ200は、内部に備えるセンサに基づいてユーザが当該コントローラ200から手を離したことを検出した場合、その旨を表示装置100の入力部120に通知する。

(操作b2)操作終了に対応した特定のジェスチャーを行う。判定部121は、ジェスチャー入力装置である入力部120におけるジェスチャーの解析結果から操作終了を判断する。

(操作b3)ユーザがコントローラ200の操作終了キーを押す。コントローラ200は、操作終了キーが押された旨を表示装置100の入力部120に通知する。なお、閲覧モードへの遷移指示や、現在3D表示されているフォーカス対象のオブジェクトとは異なるオブジェクトに対する操作指示も、現在3D表示されているオブジェクトに対する操作終了とみなすことができる。

(操作b4)表示デバイス400の前に存在するユーザが手の動きを止める。入力部120は、表示デバイス400の前に存在するユーザの手の動きが止まったことを検出し、判定部121は、入力部120の検出結果から操作終了を判断する。

(操作b5)ユーザが口頭で操作終了を指示する。判定部121は、音声入力装置である入力部120の音声認識結果から操作終了と判断する。

(操作b6)所定時間以上操作を行なわない。判定部121は、操作モードになってから、予め決められた時間以上何らの操作も入力されない場合、操作終了と判断する。

【0036】

図5は、ステップS25において、表示装置100の表示デバイス400に3D表示がされているときの表示例を示す図であり、図6は、図5に示す3D表示が終了したときの表示デバイス400の表示例を示す図である。これらの図では、コンテンツとして、テレビのデータ放送が表示されている例を示している。

【0037】

図5に示すように、ユーザがコンテンツを操作する際は、フォーカスされているオブジェクトであるメニューボタンA1が表示デバイス400に3D表示され、他のオブジェクトは2D表示される。ユーザがコントローラ200によってメニューボタンA1を選択操作することにより、メニューボタンA1の下部の情報表示エリアA2、A3、A4、A5に、ユーザが選択した情報が表示される。この場合、ユーザは、メニューボタンA1の下部の情報表示エリアA2、A3、A4、A5に表示されている情報を順に見たいと考えている。

また、メニューボタンA1の操作を途中で終了した場合や、デフォルトでメニューボタンA1が3D表示されるようになっている場合などに、ユーザが、情報表示エリアA2、A3、A4、A5に表示されている情報を順に見たいと思うこともある。

しかしこれは、メニューボタンA1が立体視されており、ユーザが必要としない情報が手前に表示されている状態である。このような表示では、情報表示エリアA2〜A5の表示がユーザにとって見にくいものと成り得る。

【0038】

そこで本実施形態では、上述した(操作b6)のように、判定部121は、ユーザが操作をしないことを検出した場合、操作終了、すなわち、「コンテンツを閲覧する」状態(閲覧モード)になったと判断する(図4のステップS26:YES)。これにより、表示装置100は、操作終了による閲覧モードに遷移し(図4のステップS27、ステップS21:NO)、出力部130は、表示デバイス400に図6に示すように、全てのコンテンツが平面表示されるようにコンテンツの表示を行う。

このように、表示装置100は、各情報を同一の高さに表示する通常表示に戻して不必要な注視を避け、ユーザが見たい情報を見やすくする(図4のステップS22)。

【0039】

また、図5のように、メニューボタンA1が3D表示されているときに、ユーザがコントローラ200に、情報閲覧モード指示など、メニューボタンA1の選択操作以外の操作を行った場合も(操作b3)、判定部121は、メニューボタンA1の操作終了と判断し、出力部130に閲覧モードへの遷移を指示する。

【0040】

なお、上記においては、表示装置100がテレビである場合について説明したが、表示装置100がパーソナルコンピュータであれば、表示用コンテンツ300として、例えば、ブラウザに表示させるコンテンツデータを用いることができる。また、表示装置100がゲーム機であれば、表示用コンテンツ300として、例えば、ゲーム条件設定画面などの画面データを用いることができる。

【0041】

以上説明した本実施形態によれば、表示装置100は、ユーザによる操作の開始・終了を契機に3D表示の開始・終了を行う。つまり、表示装置100は、3D表示と2D表示とを切替えることにより、元のコンテンツの色やレイアウトを変更することなく、ユーザに対して操作開始と終了を明示することができる。そしてこのように、操作が終了した場合、表示装置100は、操作対象であったオブジェクトの3D表示を終了することによって、ユーザにとって不必要な情報への注視を避け、見たい情報を見やすく表示させることができる。

【0042】

上述した表示装置100は、内部にコンピュータシステムを有している。そして、表示装置100のコンテンツ解析部110、判定部121、及び出力部130の動作の過程は、プログラムの形式でコンピュータ読み取り可能な記録媒体に記憶されており、このプログラムをコンピュータシステムが読み出して実行することによって、上記処理が行われる。ここでいうコンピュータシステムとは、CPU及び各種メモリやOS、周辺機器等のハードウェアを含むものである。

【0043】

また、「コンピュータシステム」は、WWWシステムを利用している場合であれば、ホームページ提供環境(あるいは表示環境)も含むものとする。

また、「コンピュータ読み取り可能な記録媒体」とは、フレキシブルディスク、光磁気ディスク、ROM、CD−ROM等の可搬媒体、コンピュータシステムに内蔵されるハードディスク等の記憶装置のことをいう。さらに「コンピュータ読み取り可能な記録媒体」とは、インターネット等のネットワークや電話回線等の通信回線を介してプログラムを送信する場合の通信線のように、短時間の間、動的にプログラムを保持するもの、その場合のサーバやクライアントとなるコンピュータシステム内部の揮発性メモリのように、一定時間プログラムを保持しているものも含むものとする。また上記プログラムは、前述した機能の一部を実現するためのものであっても良く、さらに前述した機能をコンピュータシステムにすでに記録されているプログラムとの組み合わせで実現できるものであっても良い。

【符号の説明】

【0044】

1 情報表示装置

100 表示装置

110 コンテンツ解析部

111 フォーカス位置判定部

113 3D表示データ生成部

120 入力部

121 判定部

130 出力部

200 コントローラ

400 表示デバイス

【技術分野】

【0001】

本発明は、表示装置、表示方法、及びプログラムに関する。

【背景技術】

【0002】

主にテレビなどがコンテンツを表示する際、ブラウザのフォーカスやメニューなどのオブジェクトを立体表示する技術がある。例えば、特許文献1には、フォーカスがあたっている部品を立体表示する技術が記載されている。また、特許文献2には、使用頻度、重要度、ユーザ嗜好等のオブジェクトの属性に応じて優先度が高いオブジェクトを立体表示することで、ユーザがコンテンツを操作する上での利便性を向上させることが記載されている。

【先行技術文献】

【特許文献】

【0003】

【特許文献1】特開2004−354540号公報

【特許文献2】特開2005−49668号公報

【発明の概要】

【発明が解決しようとする課題】

【0004】

上述した従来の技術では、立体表示させる対象を考慮することで、ユーザが実際にオブジェクトを操作する際の操作性を向上させている。しかし、これは常に何らかのオブジェクトが立体表示された状態であり、ユーザが本来見たいと思っていない情報が立体視されたままとなる可能性がある。例えば、ユーザは、データ放送の電車の運行情報や、テロップで流れるニュースなどで提示される情報を見ていたいだけの場合や、ブラウザで再生している映像を見ているだけの場合などがある。このときに、ユーザが意識する必要のない、あるいは意識したくないメニューやアイコンなどのオブジェクトが立体視されているままの状態では、本来見たい情報や映像を見にくくしてしまう。

【0005】

本発明は、このような事情を考慮してなされたものであり、ユーザがコンテンツを見ているときに必要のないオブジェクトの立体表示を終了することができる表示装置、表示方法、及びプログラムを提供する。

【課題を解決するための手段】

【0006】

上述した課題を解決するために、本発明は、画像を表示する表示部と、前記表示部に表示用データを表示させる出力部と、操作終了が入力されたか否かを判断する判定部とを備え、前記出力部は、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、ことを特徴とする表示装置である。

【0007】

また、本発明は、上述する表示装置であって、前記出力部は、前記表示部にコンテンツを構成するオブジェクトを立体表示させる表示用データ及び前記コンテンツを構成する他のオブジェクトを平面表示させる表示用データを表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、ことを特徴とする。

【0008】

また、本発明は、上述する表示装置であって、立体表示対象の前記オブジェクトはユーザに操作を選択させるメニューである、ことを特徴とする。

【0009】

また、本発明は、表示装置が実行する表示方法であって、出力部が、前記表示装置が備える表示部に表示用データを表示させる出力ステップと、判定部が、操作終了が入力されたか否かを判断する判定ステップと、前記出力部が、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定ステップにおいて操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了ステップと、を有することを特徴とする表示方法である。

【0010】

また、本発明は、表示装置として用いられるコンピュータに、前記表示装置が備える表示部に表示用データを表示させる出力手順と、操作終了が入力されたか否かを判断する判定手順と、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定手順において操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了手順と、を実行させるためのプログラムである。

【発明の効果】

【0011】

本発明によれば、ユーザがコンテンツを見ているときに必要のないオブジェクトの立体表示を終了することができる。

【図面の簡単な説明】

【0012】

【図1】本発明の一実施形態による情報表示装置の構成を示す図である。

【図2】同実施形態による表示装置の内部構成を示すブロック図である。

【図3】同実施形態による表示用データ生成処理フローを示す図である。

【図4】同実施形態による表示処理フローを示す図である。

【図5】同実施形態による表示装置が表示する画面イメージを示す図である。

【図6】同実施形態による表示装置が表示する画面イメージを示す図である。

【発明を実施するための形態】

【0013】

以下、図面を参照しながら本発明の実施形態を詳細に説明する。

【0014】

図1は本発明の一実施形態による情報表示装置1の構成を示す図である。同図に示すように、本実施形態の情報表示装置1は、例えば、表示デバイス400を備えるテレビジョン受像機などの表示装置100と、操作デバイスであるコントローラ200とから構成される。表示デバイス400は、立体表示(以下、「3D(三次元)表示」と記載する。)が可能なディスプレイであり、専用の眼鏡が必要な場合もある。

なお、表示装置100にジェスチャー入力や音声入力が可能である場合、コントローラ200などの操作デバイスはなくともよい。また、情報表示装置1は、携帯電話端末、パーソナルコンピュータ、ゲーム機など、操作デバイスを同じ筐体に備える表示装置100でもよい。

【0015】

図2は、表示装置100の内部構成を示すブロック図であり、本実施形態と関係する機能ブロックのみ抽出して示してある。同図に示すように、表示装置100は、コンテンツ解析部110、入力部120、判定部121、出力部130、及び表示デバイス400(表示部)を備えて構成される。

【0016】

コンテンツ解析部110は、コンテンツの画像を表示させるためのデータである表示用コンテンツ300を取得する。表示用コンテンツ300は、1以上のオブジェクトの画像を表示させるためのデータからなる。オブジェクトには、例えば、動画、静止画、テキスト、メニューボタンなどが含まれる。コンテンツ解析部110は、取得した表示用コンテンツ300から、表示デバイス400にコンテンツの画像を表示させるための各オブジェクトの表示用データを生成する。

【0017】

コンテンツ解析部110は、フォーカス位置判定部111及び3D表示データ生成部113を備える。フォーカス位置判定部111は、表示用コンテンツ300の言語記述に基づいてフォーカスされているオブジェクトを特定する。

3D表示データ生成部113は、表示用コンテンツ300に含まれる全てのオブジェクトの2D(二次元)表示用データを生成するとともに、フォーカス位置判定部111によってフォーカスされていると特定されたオブジェクトの3D表示用データを生成する。2D表示用データは、3D表示を行なわずに、オブジェクトを通常どおり平面表示させる表示用データであり、3D表示用データは、オブジェクトを3D表示させる表示用データである。3D表示データ生成部113は、生成した各オブジェクトの2D表示用データと、フォーカスされているオブジェクトの3D表示用データとを出力部130に出力する。

【0018】

入力部120は、ユーザによる操作の入力を受けるインタフェースである。例えば、入力部120は、コントローラ200に行われたユーザ操作を赤外線通信等の無線通信により受信する。あるいは、入力部120は、ユーザのジェスチャーや音声による入力を受けてもよい。また、入力部120は、表示装置100が備えるキーやボタンなどの入力装置(操作デバイス)であってもよい。

判定部121は、入力部120に入力されたユーザ操作に基づいて、操作の開始や終了を判定する。

【0019】

出力部130は、3D表示データ生成部113から入力された表示用データを表示デバイス400に表示させる。出力部130は、判定部121が操作開始と判定した場合、フォーカスされているオブジェクトの3D表示用データと、フォーカスされていないオブジェクトの2D表示用データとを出力部130に出力し、コンテンツの画像を表示させる。また、出力部130は、判定部121が操作終了と判定した場合、全てのオブジェクトについて2D表示用データを出力部130に出力し、コンテンツの画像を表示させる。

表示デバイス400は、既存の3D表示方式により3D表示が可能なディスプレイである。

【0020】

次に、表示装置100の動作について説明する。

【0021】

図3は、本実施形態の表示装置100における表示用データ生成処理フローを示す図である。

表示装置100のコンテンツ解析部110は、表示用コンテンツ300を取得する(ステップS11)。コンテンツ解析部110は、表示用コンテンツ300を放送や通信により受信してもよく、内部に備える図示しない記憶装置やウェブサーバなど外部の記憶装置から読み出してもよい。

【0022】

フォーカス位置判定部111は、取得した表示用コンテンツ300の言語記述を解析し、この表示用コンテンツ300に含まれるオブジェクトのうち、フォーカスされているオブジェクトを特定する(ステップS12)。

【0023】

例えば、フォーカス位置判定部111は、表示用コンテンツ300にデフォルトでフォーカス対象である旨が記述されているオブジェクト(例えば、メニューボタンなど)を特定する。

あるいは、フォーカス位置判定部111は、表示用コンテンツ300に含まれるオブジェクトのうち、過去のユーザの入力に基づいてフォーカス対象のオブジェクトを特定する。例えば、フォーカス位置判定部111は、入力部120に入力されたユーザ操作から判定部121においてユーザが選択したと判断したメニューボタンと、その選択回数を記憶しておく。フォーカス位置判定部111は、記憶している各メニューボタンの選択回数に基づいて、使用頻度の高いメニューボタンをフォーカス対象のオブジェクトであると判断する。

【0024】

またあるいは、現在表示装置100がユーザ操作モードであり、表示デバイス400に3D表示を行っている状態である場合、フォーカス位置判定部111は、入力部120に入力されたユーザ操作に基づいて判定部121が操作対象であると判断したオブジェクトを、フォーカス対象のオブジェクトであると判断する。例えば、判定部121は、入力部120に入力されたユーザ操作からあるメニューボタンが選択されたと判定した場合、その旨をフォーカス位置判定部111に通知する。フォーカス位置判定部111は、通知されたメニューボタンをフォーカス対象のオブジェクトであると判断する。

【0025】

3D表示データ生成部113は、表示用コンテンツ300をデコードするなどして、表示対象の各オブジェクトの2D表示用データを生成する(ステップS13)。

例えば、表示用コンテンツ300が放送コンテンツである場合、表示対象のオブジェクトは、コントローラ200により選択されたチャネルの番組(動画)や、データ放送の天気予報(静止画)、ニュース(テキストデータ)、データ放送のメニューボタン、メニューボタンにより選択された情報(静止画やテキストデータ)などである。

【0026】

さらに、3D表示データ生成部113は、ステップS12において特定されたオブジェクトの2D表示用データを用いて、3D表示用データを生成する(ステップS14)。2D表示を行うための表示用データから3D表示を行うための表示用データを生成する方法として、例えば、特開平8―63615号公報に記載の方法などがあるが、任意の既存の方法を用いることができる。3D表示データ生成部113は、生成した全てのオブジェクトの2D表示用データと、フォーカスされているオブジェクトの3D表示用データを出力部130に出力する(ステップS15)。

【0027】

図4は、本実施形態の表示装置100における表示処理フローを示す図である。

出力部130は、現在、操作モードであるか否かを判断する(ステップS21)。なお、表示装置100の初期状態を操作モードとするか、閲覧モードとするかについては、任意である。出力部130は、現在閲覧モードであり、操作モードではないと判断した場合(ステップS21:NO)、3D表示データ生成部113から入力された各オブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS22)。これにより、表示デバイス400には、全てのオブジェクトが2D表示されているコンテンツの画像が表示される。

【0028】

判定部121は、入力部120に操作開始が入力されたかを判定する(ステップS23)。判定部121が、操作開始は入力されていないと判断した場合(ステップS23:NO)、表示装置100は、ステップS22の処理を繰り返す。

【0029】

判定部121は、入力部120に入力されたユーザ操作が操作開始を示していると判断した場合(ステップS23:YES)、ユーザ操作モードに遷移し、3D表示要求を出力部130に出力する(ステップS24)。このとき、判定部121は、ユーザ操作が、特定のオブジェクトについての操作開始を示していると判断した場合、そのオブジェクトをフォーカス位置判定部111に通知する。これにより、図3のステップS12においてフォーカス位置判定部111は、判定部121から通知されたオブジェクトをフォーカス対象として特定し、図3のステップS14において、3D表示データ生成部113は、通知されたオブジェクトの3D表示用データを生成する。

【0030】

出力部130は、判定部121から3D表示要求を受信すると、操作モードへ遷移したと判断し、ステップS21からの処理を繰り返す。これにより、出力部130は、現在、操作モードであると判断し(ステップS21:YES)、3D表示データ生成部113から入力されたフォーカス対象のオブジェクトの3D表示用データと、フォーカス対象以外のオブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS25)。これにより、表示デバイス400には、フォーカスされているオブジェクトが3D表示され、他のオブジェクトは2D表示されているコンテンツの画像が表示される。

【0031】

判定部121は、入力部120に操作終了が入力されたかを判定する(ステップS26)。判定部121が、操作終了は入力されていないと判断した場合(ステップS26:NO)、表示装置100は、ステップS25の処理を繰り返す。

【0032】

判定部121は、入力部120に入力されたユーザ操作が操作終了を示していると判断した場合(ステップS26:YES)、閲覧モードに遷移し、3D表示終了要求を出力部130に出力する(ステップS27)。出力部130は、判定部121から3D表示終了要求を受信すると、閲覧モードに遷移したと判断し、ステップS21からの処理を繰り返す。これにより、出力部130は、現在、操作モードではないと判断し(ステップS21:YES)、3D表示データ生成部113から入力された各オブジェクトの2D表示用データを表示デバイス400に表示させる(ステップS22)。つまり、表示装置100は、操作モードのときに3D表示させていたオブジェクトの3D表示用データに代えて、当該オブジェクトの2D表示用データを表示デバイス400に表示させる。

このようにして、表示装置100は、ユーザによる操作終了の指示に従って3D表示を終了させる。

【0033】

なお、ステップS25においてユーザが他のオブジェクトの操作開始を入力した場合、ステップS26において判定部121は、NOと判断する。判定部121は、新たに操作開始が指示されたオブジェクトをフォーカス位置判定部111に通知する。これにより、図3のステップS12においてフォーカス位置判定部111は、判定部121から通知されたオブジェクトをフォーカス対象として特定し、図3のステップS14において、3D表示データ生成部113は、通知されたオブジェクトの3D表示用データを生成する。従って、ステップS25において、出力部130は、新たに操作開始が指示されたオブジェクトの3D表示用データと、これまで3D表示を行っていたオブジェクトを含む他のオブジェクトの2D表示用データを表示デバイス400に表示させる。

【0034】

ステップS23において、判定部121が操作開始として判断するユーザ操作の例を以下に示す。

(操作a1)コントローラ200を手に取る。例えば、コントローラ200は、内部に備えるセンサに基づいてユーザが当該コントローラ200を手に取ったことを検出した場合、その旨を表示装置100の入力部120に通知する。

(操作a2)操作開始に対応した特定のジェスチャーを行う。この場合、入力部120は、ジェスチャー入力装置であり、判定部121は、入力部120によるジェスチャーの解析結果から操作開始を判断する。

(操作a3)ユーザがコントローラ200の操作開始キーを押す。コントローラ200は、操作開始キーが押された旨を表示装置100の入力部120に通知する。

(操作a4)表示デバイス400の前に存在するユーザの手を動かし始める。入力部120は、表示デバイス400の前に存在するユーザが手を動かし始めたことを検出し、判定部121は、入力部120の検出結果から操作開始と判断する。

(操作a5)ユーザが口頭で操作開始を指示する。この場合、入力部120は、音声入力装置であり、ユーザの発声を音声認識した結果を判定部121に出力する。判定部121は、入力部120の音声認識結果から操作開始と判断する。

【0035】

また、ステップS26において、判定部121が操作終了として判断するユーザ操作の例を示す。

(操作b1)コントローラ200を手から離す。例えば、コントローラ200は、内部に備えるセンサに基づいてユーザが当該コントローラ200から手を離したことを検出した場合、その旨を表示装置100の入力部120に通知する。

(操作b2)操作終了に対応した特定のジェスチャーを行う。判定部121は、ジェスチャー入力装置である入力部120におけるジェスチャーの解析結果から操作終了を判断する。

(操作b3)ユーザがコントローラ200の操作終了キーを押す。コントローラ200は、操作終了キーが押された旨を表示装置100の入力部120に通知する。なお、閲覧モードへの遷移指示や、現在3D表示されているフォーカス対象のオブジェクトとは異なるオブジェクトに対する操作指示も、現在3D表示されているオブジェクトに対する操作終了とみなすことができる。

(操作b4)表示デバイス400の前に存在するユーザが手の動きを止める。入力部120は、表示デバイス400の前に存在するユーザの手の動きが止まったことを検出し、判定部121は、入力部120の検出結果から操作終了を判断する。

(操作b5)ユーザが口頭で操作終了を指示する。判定部121は、音声入力装置である入力部120の音声認識結果から操作終了と判断する。

(操作b6)所定時間以上操作を行なわない。判定部121は、操作モードになってから、予め決められた時間以上何らの操作も入力されない場合、操作終了と判断する。

【0036】

図5は、ステップS25において、表示装置100の表示デバイス400に3D表示がされているときの表示例を示す図であり、図6は、図5に示す3D表示が終了したときの表示デバイス400の表示例を示す図である。これらの図では、コンテンツとして、テレビのデータ放送が表示されている例を示している。

【0037】

図5に示すように、ユーザがコンテンツを操作する際は、フォーカスされているオブジェクトであるメニューボタンA1が表示デバイス400に3D表示され、他のオブジェクトは2D表示される。ユーザがコントローラ200によってメニューボタンA1を選択操作することにより、メニューボタンA1の下部の情報表示エリアA2、A3、A4、A5に、ユーザが選択した情報が表示される。この場合、ユーザは、メニューボタンA1の下部の情報表示エリアA2、A3、A4、A5に表示されている情報を順に見たいと考えている。

また、メニューボタンA1の操作を途中で終了した場合や、デフォルトでメニューボタンA1が3D表示されるようになっている場合などに、ユーザが、情報表示エリアA2、A3、A4、A5に表示されている情報を順に見たいと思うこともある。

しかしこれは、メニューボタンA1が立体視されており、ユーザが必要としない情報が手前に表示されている状態である。このような表示では、情報表示エリアA2〜A5の表示がユーザにとって見にくいものと成り得る。

【0038】

そこで本実施形態では、上述した(操作b6)のように、判定部121は、ユーザが操作をしないことを検出した場合、操作終了、すなわち、「コンテンツを閲覧する」状態(閲覧モード)になったと判断する(図4のステップS26:YES)。これにより、表示装置100は、操作終了による閲覧モードに遷移し(図4のステップS27、ステップS21:NO)、出力部130は、表示デバイス400に図6に示すように、全てのコンテンツが平面表示されるようにコンテンツの表示を行う。

このように、表示装置100は、各情報を同一の高さに表示する通常表示に戻して不必要な注視を避け、ユーザが見たい情報を見やすくする(図4のステップS22)。

【0039】

また、図5のように、メニューボタンA1が3D表示されているときに、ユーザがコントローラ200に、情報閲覧モード指示など、メニューボタンA1の選択操作以外の操作を行った場合も(操作b3)、判定部121は、メニューボタンA1の操作終了と判断し、出力部130に閲覧モードへの遷移を指示する。

【0040】

なお、上記においては、表示装置100がテレビである場合について説明したが、表示装置100がパーソナルコンピュータであれば、表示用コンテンツ300として、例えば、ブラウザに表示させるコンテンツデータを用いることができる。また、表示装置100がゲーム機であれば、表示用コンテンツ300として、例えば、ゲーム条件設定画面などの画面データを用いることができる。

【0041】

以上説明した本実施形態によれば、表示装置100は、ユーザによる操作の開始・終了を契機に3D表示の開始・終了を行う。つまり、表示装置100は、3D表示と2D表示とを切替えることにより、元のコンテンツの色やレイアウトを変更することなく、ユーザに対して操作開始と終了を明示することができる。そしてこのように、操作が終了した場合、表示装置100は、操作対象であったオブジェクトの3D表示を終了することによって、ユーザにとって不必要な情報への注視を避け、見たい情報を見やすく表示させることができる。

【0042】

上述した表示装置100は、内部にコンピュータシステムを有している。そして、表示装置100のコンテンツ解析部110、判定部121、及び出力部130の動作の過程は、プログラムの形式でコンピュータ読み取り可能な記録媒体に記憶されており、このプログラムをコンピュータシステムが読み出して実行することによって、上記処理が行われる。ここでいうコンピュータシステムとは、CPU及び各種メモリやOS、周辺機器等のハードウェアを含むものである。

【0043】

また、「コンピュータシステム」は、WWWシステムを利用している場合であれば、ホームページ提供環境(あるいは表示環境)も含むものとする。

また、「コンピュータ読み取り可能な記録媒体」とは、フレキシブルディスク、光磁気ディスク、ROM、CD−ROM等の可搬媒体、コンピュータシステムに内蔵されるハードディスク等の記憶装置のことをいう。さらに「コンピュータ読み取り可能な記録媒体」とは、インターネット等のネットワークや電話回線等の通信回線を介してプログラムを送信する場合の通信線のように、短時間の間、動的にプログラムを保持するもの、その場合のサーバやクライアントとなるコンピュータシステム内部の揮発性メモリのように、一定時間プログラムを保持しているものも含むものとする。また上記プログラムは、前述した機能の一部を実現するためのものであっても良く、さらに前述した機能をコンピュータシステムにすでに記録されているプログラムとの組み合わせで実現できるものであっても良い。

【符号の説明】

【0044】

1 情報表示装置

100 表示装置

110 コンテンツ解析部

111 フォーカス位置判定部

113 3D表示データ生成部

120 入力部

121 判定部

130 出力部

200 コントローラ

400 表示デバイス

【特許請求の範囲】

【請求項1】

画像を表示する表示部と、

前記表示部に表示用データを表示させる出力部と、

操作終了が入力されたか否かを判断する判定部とを備え、

前記出力部は、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、

ことを特徴とする表示装置。

【請求項2】

前記出力部は、前記表示部にコンテンツを構成するオブジェクトを立体表示させる表示用データ及び前記コンテンツを構成する他のオブジェクトを平面表示させる表示用データを表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、

ことを特徴とする請求項1に記載の表示装置。

【請求項3】

立体表示対象の前記オブジェクトはユーザに操作を選択させるメニューである、

ことを特徴とする請求項1または請求項2に記載の表示装置。

【請求項4】

表示装置が実行する表示方法であって、

出力部が、前記表示装置が備える表示部に表示用データを表示させる出力ステップと、

判定部が、操作終了が入力されたか否かを判断する判定ステップと、

前記出力部が、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定ステップにおいて操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了ステップと、

を有することを特徴とする表示方法。

【請求項5】

表示装置として用いられるコンピュータに、

前記表示装置が備える表示部に表示用データを表示させる出力手順と、

操作終了が入力されたか否かを判断する判定手順と、

オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定手順において操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了手順と、

を実行させるためのプログラム。

【請求項1】

画像を表示する表示部と、

前記表示部に表示用データを表示させる出力部と、

操作終了が入力されたか否かを判断する判定部とを備え、

前記出力部は、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、

ことを特徴とする表示装置。

【請求項2】

前記出力部は、前記表示部にコンテンツを構成するオブジェクトを立体表示させる表示用データ及び前記コンテンツを構成する他のオブジェクトを平面表示させる表示用データを表示させているときに前記判定部が操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる、

ことを特徴とする請求項1に記載の表示装置。

【請求項3】

立体表示対象の前記オブジェクトはユーザに操作を選択させるメニューである、

ことを特徴とする請求項1または請求項2に記載の表示装置。

【請求項4】

表示装置が実行する表示方法であって、

出力部が、前記表示装置が備える表示部に表示用データを表示させる出力ステップと、

判定部が、操作終了が入力されたか否かを判断する判定ステップと、

前記出力部が、オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定ステップにおいて操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了ステップと、

を有することを特徴とする表示方法。

【請求項5】

表示装置として用いられるコンピュータに、

前記表示装置が備える表示部に表示用データを表示させる出力手順と、

操作終了が入力されたか否かを判断する判定手順と、

オブジェクトを立体表示させる表示用データを前記表示部に表示させているときに前記判定手順において操作終了のユーザ入力を判断した場合、前記オブジェクトを立体表示させる前記表示用データに代えて、前記オブジェクトを平面表示させる表示用データを前記表示部に表示させる立体表示終了手順と、

を実行させるためのプログラム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図2】

【図3】

【図4】

【図5】

【図6】

【公開番号】特開2013−109459(P2013−109459A)

【公開日】平成25年6月6日(2013.6.6)

【国際特許分類】

【出願番号】特願2011−252460(P2011−252460)

【出願日】平成23年11月18日(2011.11.18)

【出願人】(598045058)株式会社サムスン横浜研究所 (294)

【Fターム(参考)】

【公開日】平成25年6月6日(2013.6.6)

【国際特許分類】

【出願日】平成23年11月18日(2011.11.18)

【出願人】(598045058)株式会社サムスン横浜研究所 (294)

【Fターム(参考)】

[ Back to top ]