視線分析装置、視線計測システム、方法、プログラム、記録媒体

【課題】本発明の課題は、被験者の視線を推定・追跡することで、評価対象印刷物の掲載情報または陳列棚の商品の注目度を分析評価するシステムを提供することである。

【解決手段】

メガネを通して見るシーン画像とシーン画像上の注視点座標を視線分析装置に送信する視線追跡メガネと、基準画像および基準画像の分割画像の、特徴点の座標と特徴量を記憶する手段と、視線追跡メガネからシーン画像と注視点座標を受信する手段と、シーン画像の特徴点の特徴量と分割画像の特徴点の特徴量とに基づき最も類似度評価の高い特徴点を組み合せる手段と、最も多い組合せ個数を持つ分割画像の特徴点の座標とシーン画像の特徴点の座標に基づいて座標変換行列を算出する手段と、座標変換行列とシーン画像上の注視点座標から算出した分割画像上の注視点座標を、基準画像に変換して注視点マークを合成する手段と、を備える視線分析装置と、特徴とする視線計測システムである。

【解決手段】

メガネを通して見るシーン画像とシーン画像上の注視点座標を視線分析装置に送信する視線追跡メガネと、基準画像および基準画像の分割画像の、特徴点の座標と特徴量を記憶する手段と、視線追跡メガネからシーン画像と注視点座標を受信する手段と、シーン画像の特徴点の特徴量と分割画像の特徴点の特徴量とに基づき最も類似度評価の高い特徴点を組み合せる手段と、最も多い組合せ個数を持つ分割画像の特徴点の座標とシーン画像の特徴点の座標に基づいて座標変換行列を算出する手段と、座標変換行列とシーン画像上の注視点座標から算出した分割画像上の注視点座標を、基準画像に変換して注視点マークを合成する手段と、を備える視線分析装置と、特徴とする視線計測システムである。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、人物の視線を推定し、視線を計測する装置、システム、方法、プログラム、記録媒体に関するものである。

本発明は特に、評価対象印刷物(たとえば、チラシ、カタログ、ポスター)による生活者の購買動向分析において、眼鏡型アイトラッキング装置(視線追跡メガネ)を用いて、被験者が評価対象印刷物を見る視線を推定・追跡することで、評価対象印刷物の掲載情報(たとえば、商品情報)に対する視線を計測する場合に有用である。

【背景技術】

【0002】

従来、評価対象印刷物を見る人物の視線を推定・追跡して、掲載商品への視線を計測することで、注視度合いや関心度合いを解析し、生活者の購買動向を評価分析することが知られている。

生活者に適切な購買情報を提供するためには、評価対象印刷物の掲載情報を、どのように見ているかを知ることが重要となる。視線追跡方法は、生活者の関心度合いや、購買動向を把握するための有効な評価分析方法の1つである。

【0003】

視線を推定・追跡する方法としては、視線追跡メガネを用いた方法が知られている。

たとえば、特許文献1には、視線追跡メガネを被験者の頭部に装着させて、視線追跡メガネが有する視線計測用光源の赤外光を瞳孔と角膜に照射して、その反射光を視線追跡メガネに設けられた赤外光センサーにて受光し、その受光した反射光に基づいて、瞳孔の方向を推定することで、対象物を見る視線方向を推定する技術が開示されている。このメガネを通して対象物を見る視線方向に基づいて、メガネが捉える視野の中の注視位置を算出することが可能である。

このとき、識別が可能な基準マーカーを、評価対象印刷物の所定の位置に配置することで、視線追跡メガネの基準マーカー・センサーが捉えた基準マーカーの識別情報に基づいて、視線追跡メガネの向きとメガネが捉える視野の範囲を検知することが可能となる。また、検知した視線追跡メガネの向きとメガネが捉える視野の範囲に基づいて、メガネの視野が捉える評価対象印刷物の領域を推定することが出来る。

基準マーカーには、図形マーカー(印刷物)、または、IR(infrared)マーカー(IR発信器)を用いる場合がある。

たとえば、識別可能な複数のIRマーカーを用いて視線を追跡する、更にIRセンサーを設けた視線追跡メガネ(Tobiiグラスアイトラッカー、登録商標)が、非特許文献4に開示されている。非特許文献4によれば、視線追跡メガネが推定した視線方向と捉えた複数のIRマーカーの位置に基づいて、被験者が注視しているチラシ上の注視位置情報を算出することができる。

【0004】

なお、本発明の視線の計測・追跡技術に関連して、画像の回転・スケール変化・照明変化等に頑健な特徴量を記述する特徴点を検出するSlFT(Scale‐InvariantFeatureTransform)アルゴリズム、または、高速に画像の特徴点を抽出するSURF(SpeededUpRobustFeatures)アルゴリズムが、それぞれ、非特許文献1、2に記載されている。

なお、この2つのアルゴリズムが動作するプログラムは、OpenCV(非特許文献5)にて利用することが可能である。

または、画像の特徴点を検出して、検出した特徴点の局所特徴量を抽出するRandomized Treeアルゴリズム、もしくは、Fernsアルゴリズムが、それぞれ、非特許文献6、7に記載されている。

また、2つの平面画像間の視点変換により、一方の平面画像座標を他方の平面画像座標に変換するホモグラフィー行列を算出するアルゴリズムは、非特許文献3に記載されている。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2007−319187号公報(たとえば、段落「0025」−「0029」、図2)

【非特許文献】

【0006】

【非特許文献1】DavidG.Lowe、“Distinctive image features from scaleinvariant keypoints”、Int.Journal of Computer Vision、Vol.60、No.2、PP.91‐110、2004.

【非特許文献2】H.Bay,T.Tuytelaars,andL.VanGool、“SURF:Speeded Up Robust. Features”、InECCV、pp.404‐417、2006.

【非特許文献3】橋本浩一、“ビジュアルサーボ−II−コンピュータビジョンの基礎”、日本バーチャルリアリティ学会論文誌、Vol.4、No.4、1999.

【非特許文献4】トビー・テクノロジー・ジャパン株式会社、Tobiiグラスアイトラッカー、[online][平成23年9月8日検索]、インターネット<URL:http://www.tobii.com/ja−JP/eye−tracking−research/japan/products/hardware/tobii−glasses−eye−tracker/>

【非特許文献5】OpenCV、SIFT/SURF、[online][平成23年9月8日検索]、インターネット<URL:http://opencv.jp/opencv−2.2/cpp/features2d_feature_detection_and_description.html>

【非特許文献6】V. Lepetit and P. Fua, “Keypoint Recognition using Randomized Trees”, IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol.28, No.9, pp。1465−1479, 2006.

【非特許文献7】M.Ozuysal,P.Fua, V.Lepetit,―Fast Keypoint Recognition in Ten Lines of Code.,Proc. of Int.Conf. on Computer Vision and Pattern Recognition(2007)

【発明の概要】

【発明が解決しようとする課題】

【0007】

しかしながら、被験者の頭の向きと距離を知るために評価対象印刷物の表面に図形マーカーを設けることは、美観を損ね、被験者の注意力を散漫にさせて、無用な視線の動きを生じさせるので、視線の計測品質の低下を招き好ましくない。

また、IRマーカーを用いる場合には、評価対象印刷物の裏面に設ければ美観を損ねることは無いが、IRが印刷物(紙)を透過するときに減衰するために、受光できないことがあり、位置計測の精度が低下する。

しかも、裏面に設けたIRマーカーは、評価対象印刷物を裏返して閲覧する場合には、図形マーカーと同様にIRマーカーが目に入るので、被験者の注意力を散漫にさせて、無用な視線の動きを生じるので、視線の計測品質の低下を招き好ましくない。

【0008】

本発明は以上のような点を解決するためになされたものであって、本発明の課題は、評価対象印刷物の掲載情報の注目度を分析評価するときに、簡単に、被験者に無用な視線の動きを生じさせずに高い精度で、被験者の視線を推定して追跡することで、評価対象印刷物に対する視線を計測することが可能な装置、システム、方法、プログラム、記録媒体を提供することである。

【課題を解決するための手段】

【0009】

本発明は、以下の各態様に記載の手段により、前記課題を解決する。

すなわち、本願発明の第1の発明は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置である。

【0010】

このように、基準マーカーを用いる代わりに、基準特徴点データの座標情報とシーン特徴点データの座標情報にを用いることで、シーン画像上の注視点座標情報を、基準画像上の注視点座標情報に変換することが可能である。

【0011】

本願発明の第2の発明は、

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データとを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システムである。

【0012】

本願発明の第3の発明は、

基準画像と、座標情報と特徴量を含む基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せステップと、

視線分析装置が、組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0013】

本願発明の第4の発明は、さらに、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の高い分割画像の基準特徴点を求めて、求めた分割画像の基準特徴点とシーン特徴点の組合せと分割画像を識別する情報を含む特徴点組合せを作成する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、最も多い組合せ個数を持つ組合せを決定して、決定した特徴点組合せに含まれる分割画像を識別する情報が識別する分割画像を選択する分割画像選択手段と、

検出した組合せに含まれる分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置である。

【0014】

本願発明の第4の発明の1つの態様は、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置である。

【0015】

本願発明の第4の発明の異なる1つの態様は、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置である。

【0016】

本願発明の第4の発明の異なる1つの態様は、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線分析装置である。

【0017】

本願発明の第5の発明は、

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システムである。

【0018】

本願発明の第5の発明の1つの態様は、

前記視線分析装置において、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線計測システムである。

【0019】

本願発明の第5の発明の異なる1つの態様は、

前記視線分析装置において、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置であることを特徴とする視線計測システムである。

【0020】

本願発明の第5の発明の異なる1つの態様は、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線計測システムである。

【0021】

本願発明の第6の発明の態様は、

分割画像を特定する情報を含む分割画像データと、分割画像を特定する分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せステップと、

視線分析装置が、作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択ステップと、

視線分析装置が、選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0022】

本願発明の第6の発明の1つの態様は、

前記特徴点組合せステップは、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

手順でなされることを特徴とする視線計測方法である。

【0023】

本願発明の第6の発明の異なる1つの態様は、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

手順でなされることを特徴とする視線計測方法である。

【0024】

本願発明の第6の発明の異なる1つの態様は、

さらに、基準画像を用いて、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成するステップ、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0025】

本願発明の第7の発明は、コンピュータに組込むことによって、コンピュータを第1から第4の発明までのいずれかに記載の視線分析装置として動作させるコンピュータプログラムである。

【0026】

本願発明の第8の発明は、第7の発明に記載のコンピュータプログラムを記録したコンピュータ読取り可能な記録媒体である。

【発明の効果】

【0027】

本願発明によれば、

(1)基準マーカーを用いる必要がないので、被験者が通常と同じ状態で評価対象印刷物を閲覧できることから、閲覧に専念でき、正確な視線の動きを計測することが可能である。

(2)評価対象印刷物の特徴点情報を用いて、視線の動きを注視点マークとして評価対象印刷物の基準画像上に再現することが可能である。

(3)評価対象印刷物の特徴点情報は印刷ページごとに異なることからページを識別することができるので、複数ページの評価対象印刷物の視線を計測する場合にも、各ページごとに視線の動きを再現することが可能である。

【図面の簡単な説明】

【0028】

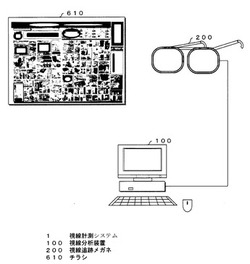

【図1】図1は、視線計測システム1の全体構成を説明する図である。(第1の実施形態)

【図2】図2は、視線計測システム1の操作と処理の大まかな手順を説明する図である。

【図3】図3は、視線追跡メガネ200を説明する図である。

【図4】図4は、各座標系の関係を説明する図である。

【図5】図5は、シーン画像とシーン特徴点の例である。

【図6】図6は、シーン特徴点データ194の形式を説明する図である。

【図7】図7は、基準画像と基準特徴点の例である。

【図8】図8は、基準特徴点の組合わせを説明する図である。

【図9】図9は、組み合わせられた特徴点の例である。

【図10】図10は、ホモグラフィー行列の説明図である。

【図11】図11は、基準画像上に合成された注視点マークの例である。

【図12】図12は、分析装置100の詳細な構成図である。

【図13】図12は、分析装置100のフローチャートである。

【図14】図13は、注視点マークを合成した基準画像の例

【図15】(第2の実施形態)図15は、視線計測システム2の全体構成を説明する図である。

【図16】(第2の実施形態)図16は、商品棚の正面画像の例である。

【図17】(第2の実施形態)図17は、特徴点組合せ197を説明する図である。

【図18】(第2の実施形態)図18は、分割画像を用いた視線追跡の処理手順(その1)を説明する図である。

【図19】(第2の実施形態)図19は、分割画像を用いた視線追跡の処理手順(その2)を説明する図である。

【図20】(第2の実施形態)図20は、対応付けられた特徴点の例(その1)である。

【図21】(第2の実施形態)図21は、対応付けられた特徴点の例(その2)である。

【図22】(第2の実施形態)図22は、各画像の注視点の相互関係である。

【図23】(第2の実施形態)図23は、視線分析装置100bの詳細な構成図である。

【発明を実施するための形態】

【0029】

以下、図面等を参照しながら、本発明の実施の形態について、更に詳しく説明する。

【0030】

(第1の実施形態)

図1は、本発明の実施の形態による視線計測システム1の概要を説明する図である。

視線計測システム1は、視線分析装置100と、視線追跡メガネ200とが接続可能に構成される。

【0031】

視線分析装置100は、既存のパーソナルコンピューターに、後述する専用プログラムを搭載したものである。

【0032】

視線追跡メガネ200は、評価対象印刷物610(以下、チラシ)を見る視線方向を推定する。

視線追跡メガネ200は、赤外線光源と赤外線センサーとカメラとから構成される。

【0033】

図2は、視線計測システム1の操作と処理の大まかな手順を説明する図である。

【0034】

(1)被験者は、視線追跡メガネ200を目に掛ける。

【0035】

(2)被験者がチラシ610の閲覧を開始すると、視線追跡メガネ200は、チラシ610を撮像して、シーン画像を作成する。同時に、赤外線を眼球に照射して、受光した反射光に基づいて視線方向を推定し、撮像したシーン画像上の注視点位置情報を算出する。

(3)被験者の視線計測作業が終わったら、視線計測者が、視線追跡メガネ200を視線分析装置100に接続すると、視線追跡メガネ200は、シーン画像と注視点位置情報を視線分析装置100に送信する。

【0036】

(4)視線分析装置100は、シーン画像と注視点位置情報を視線追跡メガネ200から受信する。

(5)視線分析装置100は、撮像したシーン画像から特徴点情報を抽出し、予め記憶する基準画像の特徴点情報と類似度を比較する。次に、最も類似度の高い特徴点同士を組み合わせて、この組み合わせた特徴点情報に基づいて、座標変換行列を算出する。(詳細は後述する)

【0037】

ここで、基準画像が複数個ある場合には、まず、各基準画像ごとに、シーン画像の特徴点情報を基準画像の特徴点情報の類似度を比較して最も類似度の高い特徴点同士を組み合わせて、次に、各特徴点の同士を組み合わせの中から、最も類似度の高い組み合わせを選び、その組合せの特徴点情報に基づいて、座標変換行列を算出する。

【0038】

(6)視線分析装置100は、 座標変換行列を用いて、受信したシーン画像上の注視点位置座標を基準画像上の座標に変換する。次に、座標変換した注視点位置に基づいて、基準画像に注視点マークを合成して表示する。

【0039】

なお、撮影されたシーン画像の中から撮影時間内の所望の時刻におけるシーン画像を用いることで、撮影時間内での所望の時刻における基準画像上での注視点座標が得られる。

たとえば、撮影された全てのシーン画像を用いることで、撮影中の全ての注視点の情報(視線の移動の様子など)を得ることが出来る。

【0040】

図3は、視線追跡メガネ200を説明する図である。

図3に例示されている視線追跡メガネ200は、赤外線光源201と赤外線センサー202とシーンカメラ203と処理部204とを備える。

【0041】

赤外線光源201は、赤外線207を被験者の眼球301(角膜(瞳孔)や強膜(白目))に照射する。

赤外線センサー202は、眼球301から反射された赤外線208(反射光)を受光する。

シーンカメラ203は、二次元撮像素子である。シーンカメラ203は、被験者の視野ほぼ同等の光景(注視点を中心としたチラシ画像)を撮像する。

【0042】

処理部204は、演算処理回路と、記憶回路と、コネクターと、二次電池とを備える。

処理部204は、たとえば、眼球301の角膜と強膜の反射率の違いを利用した強膜反射法(リンバスト・トラッキング法。特許文献1による)に基づいて、受光した反射光208を用いて視線を計測して、視線の方向を推定する。また、処理部204は、推定した視線の方向と撮像したチラシ画像とを、通信接続した視線分析装置100に送信する。

なお、処理部204は、強膜反射法の代わりに、瞳孔−角膜反射法や、角膜反射法、ダブルプリキニエ法などを用いることも可能である。

コネクターは、視線追跡メガネ200と視線分析装置100とに通信接続する。

二次電池は、処理部自身の各回路と、赤外線光源201と赤外線センサー202とシーンカメラ203とに、電力を供給する。

【0043】

ここで、図4を用いて、視線計測システム1が扱う座標系の説明をする。

視線計測システム1が扱う座標系は、三次元空間座標系600(Xm、Ym、Zm)と、視線追跡メガネ座標系700(Xc、Yc、Zc)と、シーン画像平面座標系800(Xp、Yp)と、基準画像平面座標系500(Xr、Yr)とである。

三次元空間座標系(Xm、Ym、Zm)は、計測対象のチラシ610を原点とする三次元空間である。三次元空間座標系には、チラシ610(撮影対象物)と、視線追跡メガネのシーンカメラ203が配置されている。

【0044】

視線追跡メガネ座標系700(Xc、Yc、Zc)は、視線追跡メガネのシーンカメラ203を原点701とする三次元空間である。

ここで、シーンカメラ203は被験者の目に相当し、シーンカメラ203の原点701は、被験者の視点に相当する。

【0045】

シーン画像平面座標系800(Xp、Yp)は、シーンカメラ203が撮影したシーン画像810(二次元画像)を現わす二次元空間である。このシーンカメラ203が撮影した二次元画像810は、三次元空間座標系に配置された撮影対象物610を透視変換した透視画像である。

シーン画像810は、この場合には、チラシ610の一部を撮像した部分画像である。

【0046】

視線追跡メガネ座標系700の原点701が被験者の視点に相当するので、視線方向情報702に基づく視線702がシーン画像810と交わる点811が、注視点となる。

【0047】

基準画像平面座標系500(Xr、Yr)の基準画像とは、チラシ610の正面画像に相当する画像である。チラシ610を正面から撮像した画像であっても良いし、チラシ610の印刷データから生成した画像でも良い。

【0048】

図5は、シーン画像とシーン特徴点の例である。

【0049】

図5の(a)には、シーン画像810が例示されている。

例示されているシーン画像810は、シーンカメラ203が撮像するチラシ画像であって、被験者がメガネを通して見るチラシと同等の画像である。たとえば、被験者がチラシに近づいた場合に、メガネを通して見えるチラシの一部に相当する。

【0050】

図5の(b)には、注視点マークが合成されたシーン画像810が例示されている。

例示されているシーン画像810には、被験者が注目するチラシ上の注視点811の位置に相当する位置に、注視点マーク812が合成されている。

この注視点マークの位置は、すでに説明したように、シーンカメラ203の原点701と視線方向情報702に基づいて算出した交点811(視線702がシーン画像810と交わる点、注視点)に相当する。

【0051】

図5の(c)には、シーン画像の特徴点Qが例示されている。

例示されているシーン画像810には、検出したシーン特徴点Qの一例が示されている。シーン特徴点Qは、たとえば、非特許文献1に記載のSlFTアルゴリズムにてシーン画像から検出した特徴点である。

または、非特許文献2に記載のSURF(SpeededUpRobustFeatures)アルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

または、非特許文献6に記載のRandomized Treeアルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

または、非特許文献7に記載のFernsアルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

【0052】

図6は、シーン特徴点データ194を説明する図である。

シーン特徴点データ194は、公知のSlFTアルゴリズムにて、シーン画像データから検出したシーン特徴点QのSIFT特徴量を含んで記述される点情報である。

シーン特徴点データ194のデータ形式は、特徴点番号1941と、座標値1942と、特徴量1943と、を含んで構成される。

特徴点番号1941は、シーン画像の特徴点に対して、検出された順に割り振られた連続番号(特定可能な数字列)を記述するデータ項目である。

座標値1942は、シーン画像の特徴点の座標情報(シーン画像平面座標系)を記述するデータ項目である。

特徴量1943は、SlFTアルゴリズムにて、シーン画像から抽出したシーン特徴点Qの局所特徴量(SIFT特徴量)を記述するデータ項目である。

SIFT特徴量は、SlFTアルゴリズムにて検出した特徴点の周辺領域を4×4の正方形グリッドに分割して、各グリッド内の8方向に対して求めた勾配ヒストグラムから構成される128次元の局所特徴量qである。

【0053】

図7は、基準画像と基準特徴点Pの例である。

例示されている基準画像510は、チラシ610を正面から撮像した正面画像である。

基準画像510には、基準特徴点P512の一例が示されている。

基準特徴点P512は、シーン画像のシーン特徴点Qと同様に、非特許文献1に記載のSlFTアルゴリズムにて基準画像から検出した特徴点である。

なお、基準画像610は、チラシ印刷データから作成しても良い。

【0054】

次に、基準画像の基準特徴点Pとシーン画像のシーン特徴点Qの中から、同一のものを抽出して対応付ける処理について説明する。

【0055】

図8は、基準特徴点Pとシーン特徴点Qの類似度を算出する処理を説明する図である。ここで、基準特徴点データ192の形式は、シーン特徴点データ194の形式と同じである。ただし、座標値1922は、基準画像の特徴点の座標情報(基準画像平面座標系)を記述するデータ項目である。

(1)基準特徴点Piの基準特徴点データ192iのSIFT特徴量(pi1、・・、pin 、・・、pi128)と、シーン特徴点Qjのシーン特徴点データ194jのSIFT特徴量(qj1 、・・ 、qjn 、・ ・、qj128)を用いて、基準特徴点Piとシーン特徴点Qjの128次元ユ−クリッド空間R128の距離dijを全てのPiとQjの組合せに対して算出する。(ステップS141)

(2)すべての基準特徴点Pに対してそれぞれdijが最小かつ、所定の閾値以下となるシーン特徴点Qを求めて、そのシーン特徴点Qが対する基準特徴点Pに最も類似度が高いと決定する。(ステップS142)

(3)基準特徴点Piに対して最も高い類似度を算出したシーン特徴点Qjを対応づける。

【0056】

ここで、組み合わせられた特徴点Piと特徴点Qjの類似度が最も高いということは、基準チラシ画像上の基準特徴点Piとシーン画像上のシーン特徴点Qjとが同一の特徴点である可能性が高いことを意味する。

【0057】

図9は、組み合わされた基準特徴点P512とシーン特徴点Q812とを図示した例である。

図示された基準チラシ画像の基準特徴点P512が、シーン画像のシーン特徴点Q812と対応付けられていて、同一の特徴点であることを示している。たとえば、基準特徴点P1とシーン特徴点Q20とが対応する特徴点であることを示している。

【0058】

図10は、ホモグラフィー行列を説明する図である。

【0059】

図10の(a)は、ホモグラフィー行列を説明する図である。

ホモグラフィー行列とは、2つの平面画像間の視点変換により、一方の平面画像座標を他方の平面画像座標に変換する関係式であることが数学的にすでに分かっている座標変換行列(二次元画像座標変換関係式)である。

ホモグラフィー行列の一般式は、未知数としての行列要素を6個(fx、fy、Cx、Cy、r1、r2)含む。

ここで、X、Yは、一方のカメラ画像の特徴点の座標値であって、x、yは、他方のカメラ画像の特徴点の座標値である。

fx、fy、Cx、Cyは、投影変換行列の要素であり、カメラの内部行列の要素に相当する。

sは、スケール係数である。

r1、r2、tは、回転・並行移動行列の要素である。

【0060】

図10の(b)は、所定のホモグラフィー行列を説明する図である。

fa、fb、Ca、Cb、ra、rbは、所定のホモグラフィー行列の要素の値である。

ホモグラフィー行列の一般式に対して、6組の平面画像座標の組合せ((X、Y)と(x、y)の組合せ)を適用して、6つの式を作成して、この6式を解いて、未知数である6個の行列要素の解(fa、fb、Ca、Cb、ra、rb)を求めることで、所望の座標変換行列を算出することができる。

【0061】

そこで、6組の対応付けられた基準特徴点612の座標(X、Y)とシーン特徴点812の座標(x、y)の組合せに基づいて算出した座標変換行列(ホモグラフィー行列)を用いることにより、シーン画像上の注視点811の座標値を基準チラシ画像上の注視点513の座標値に変換することが可能となる。

【0062】

図11は、基準画像510に合成された注視点マーク513の例である。

例示されている基準画像510には、シーン画像820に合成されている注視点マーク813の位置に相当する位置に、注視点マーク513が合成されている。

注視点マーク513の位置は、6組の対応付けられた基準チラシ画像とシーン画像の特徴点の組合せに基づいて算出された座標変換行列(ホモグラフィー行列)を用いることによって、シーン画像上の注視点の座標値を、基準チラシ画像上の注視点の座標値に変換して求められたものである。

【0063】

図12は、視線分析装置100の詳細な構成図である。

視線分析装置100は、CPU101と、表示部102と、接続部106と、記憶部109と専用プログラムなどを備える。

CPU101と、表示部102と、接続部106と、記憶部109とは、BUS199で接続される。

【0064】

CPU101は、中央演算装置である。

表示部102は、液晶表示装置や有機EL表示装置である。

接続部106は、コネクター(たとえば、USBコネクター)である。

接続部106は、視線追跡メガネ200の情報処理装置204と接続する。

【0065】

記憶部109は、半導体メモリーや磁気メモリーである。

記憶部109は、基準格納領域091と、シーン格納領域092と、注視点格納領域093と、を備えて、オペレーティングシステム185と、専用プログラムとを記憶する。

基準格納領域091は、基準画像データ191と基準特徴点データ192の集合を格納する。

シーン格納領域092は、シーン画像データ291とシーン特徴点データ194を格納する。

注視点格納領域093は、注視点データ292を格納する。注視点データ292は、注視点座標値を含んで構成される。

オペレーティングシステム185は、視線分析装置100のハードウェア(たとえば、CPU101と、表示部102と、接続部106と、記憶部109と、BUS199など)を管理・制御して、応用ソフトウエア(たとえば、専用プログラム)に対して、これらのハードウェアを利用できるようなサービスを提供する基本ソフトウエアである。

【0066】

このほかに、受信手段110と、特徴点抽出手段120と、特徴点対応付け手段130と、座標変換行列算出手段140と、注視点マーク算出手段150と、画像合成手段160と、を備える。これらの各手段は、それぞれの専用プログラムによって実現され、専用プログラムがCPU101に解釈・実行されることによって機能する。

【0067】

受信手段110は、視線追跡メガネ200からシーン画像データ291とシーン画像の注視点位置情報を含む注視点データ292を受信する機能を実行するプログラムモジュールである。

【0068】

特徴点抽出手段120は、シーン画像データ291からシーン特徴点を検出して、シーン特徴点の局所特徴量(SIFT特徴量)を抽出して、シーン特徴点データ194を作成する機能を実行するプログラムモジュールである。(詳細は、図6のシーン特徴点データを説明する項で述べた)

【0069】

特徴点対応付け手段130は、基準特徴点データ192のSIFT特徴量(128次元データ)と、シーン特徴点データ194のSIFT特徴量(128次元データ)を用いて、128次元ユークリッド空間の距離(2個の128次元データを構成する各要素の差の二乗の総和の平方根)を算出し類似度とする機能と、

最小の距離を最も類似度が高いとして、最も高い類似度を算出したときの基準特徴点データ192とシーン特徴点データ194を組み合わせる機能と、

を実行するプログラムモジュールである。(詳細は、図8の特徴点の組合せを説明する項で述べた)

【0070】

座標変換行列算出手段140は、対応付けられた基準特徴点データ192とシーン特徴点データ194の組合せの中から、任意の6組を選び出し、選び出した組の基準特徴点データ192の座標(X、Y)とシーン特徴点データ194の座標(x、y)に基づいて、座標変換行列を算出する機能を実行するプログラムモジュールである。(詳細は、図10のホモグラフィー行列を説明する項で述べた)

【0071】

注視点マーク算出手段150は、算出した座標変換行列に基づいて、シーン画像上の注視点位置情報を、基準画像上の注視点の位置情報に変換する機能を実行するプログラムモジュールである。(詳細は、図10のホモグラフィー行列を説明する項で述べた)

【0072】

画像合成手段160は、変換された基準画像上の注視点の座標値に基づいて、注視点マーク811を生成して、基準画像に合成する機能を実行するプログラムモジュールである。

【0073】

図13は、視線分析装置100が注視点マークが合成された基準画像510を表示するフローチャートである。

【0074】

(1)特徴点抽出手段120は、SIFTアルゴリズムを用いて、シーン画像データ291から検出したシーン特徴点のSIFT特徴量を抽出して、シーン特徴点データ194を作成する。(ステップS200)

(2)特徴点対応付け手段130は、記憶手段に記憶する基準特徴点データ192の128次元のSIFT特徴量pijと、シーン特徴点データ194の128次元のSIFT特徴量qijとを用いて、特徴点PiとQjの類似度dijとして、128次元ユークリッド空間の距離(下記の数式1)を全てのPiとQjの組合せに対して算出して、最も類似度の値の小さいもの(距離が最小の)を類似度が高い特徴点として決定して、基準特徴点データ192とシーン特徴点データ194を組み合わせる。(ステップS210)

【数1】

i,j=1,・・・,128

【0075】

(3)座標変換行列算出手段140は、基準特徴点データ192とシーン特徴点データ194の組合せの中から、任意の6組の組合せを選択する。次に、座標変換行列算出手段140は、ホモグラフィー行列の一般式(下記の数式2)に6組の特徴点情報を代入して、6つの式を作成する。最後に、座標変換行列算出手段140は、6つの式を解いて、fx、fy、Cx、Cy、r1、r2、を算出して、座標変換行列(二次元画像座標変換関係式、下記の数式3)を導出する。(ステップS220)

【数2】

【数3】

ここで、fa、fb、Ca、Cb、ra、rbは、算出した二次元画像座標変換関係式の行列要素である。

【0076】

(4)注視点マーク算出手段150は、算出した座標変換行列に基づいて、シーン画像上の注視点座標値を、基準画像上の注視点の座標値に変換する。(ステップS230)

(5)画像合成手段160は、変換された基準画像上の注視点の座標値に基づいて、注視点マーク811を生成して、基準画像に合成して、注視点マークが合成された基準画像611を表示する。(ステップS240)

【0077】

図14は、その他の注視点マークの例である。

【0078】

図14の(a)には、注視点の移動を表記する注視点マークが例示されている。

注視点の移動の順序を表す数字と、マーク間を結び注視点の移動方向を示す矢印を付した線分にて注視点マークを表記している。

【0079】

図14の(b)には、累積注視時間を表記する注視点マークが例示されている。

累積注視時間を、注視点マークの大きさや色の濃淡にて注視点マークを表記している。

【0080】

以上のように、本発明によれば、

(1)基準マーカーを用いずに、被験者が日常に目にするチラシと同じ状態のチラシを用いて閲覧できるので、視線の動きが自然であって、雑音のない、正確な視線の動きを計測することが可能である。

(2)チラシとシーン画像の特徴点情報を用いることで、視線の動きを注視点マークとしてチラシ上に再現することが可能である。

(3)評価対象印刷物が複数ページにわたる場合でも、各ページごとに視線の動きを再現することが可能である。

このように、日常と同じ状態のチラシを用いて、手間を掛けずに被験者の正確な視線追跡(視線計測)ができる。

【0081】

(第2の実施形態)

ところで、商品陳列棚上の視線を追跡する場合には、商品陳列棚を撮影した基準画像の特徴点Piと、商品陳列棚に寄ったシーン画像のシーン特徴点Qiとを対応付けて、シーン画像上の注視点を座標変換する必要がある。

ところが、商品陳列棚に寄ったシーン画像に相当する画像領域は、商品陳列棚を撮影した基準画像に対して小領域であるために、シーン画像に相当する画像領域に含まれる基準特徴点Piの個数が少ない。従って、基準特徴点Piとシーン特徴点Qiとの対応付けを行なう特徴点対応付処理ができず、座標変換行列を算出できないという不具合が生じることがある。

【0082】

そこで、基準画像を幾つかに分割した分割画像Smを用いることで、特徴点対応付処理を可能にして、基準画像とシーン画像のサイズの差が大きくなることが想定される被験者の視線追跡を可能にする実施形態を以下に説明する。

この実施形態(第2の実施形態)によれば、商品陳列棚上の被験者の視線を追跡するような場合でも、問題なく視線計測が可能となる。

【0083】

図15は、第2の実施形態による視線計測システム2の概要を説明する図である。

視線計測システム2は、第1の実施形態と同様に、視線分析装置100bと、視線追跡メガネ200とが接続可能に構成される。なお、第1の実施形態と同じ装置、構成を用いる場合には同じ符号を付して、重複する説明は省略する。

【0084】

視線追跡メガネ200は、商品陳列棚620を見る視線方向を推定する。

【0085】

商品陳列棚620は、飲料容器(商品)の陳列棚で複数の棚(段)を備え、たとえば、コンビニエンスストアに設置される。

商品陳列棚620は、陳列された商品が配置される複数の段から構成されている。

【0086】

図16は、商品陳列棚の画像(基準画像と分割画像)を説明する図である。

図16の(a)には、商品の陳列棚620を正面から撮影した正面画像としての基準画像510が例示されている。

例示された基準画像510の商品の陳列棚620は、たとえば、カートンが配置される複数の段から構成される陳列棚と、PETボトルが配置される複数の段から構成される陳列棚と、を組み合わせて構成される。

【0087】

図16の(b)には、基準画像を幾つかに分割した分割画像Sm515が例示されている。

例示された分割画像Sm515は、基準画像を6分割(縦2分割×横3分割)した例である。(m=1、2、・・、6)

なお、各分割画像Sm515からは、特徴点対応付処理に充分に必要な個数の基準特徴点Piを抽出することができる。

なお、例示された分割画像Smの大きさは同じであるが、異なる大きさの分割画像で構成しても良い。たとえば、商品棚の上段の分割画像は小さく、下段の分割画像は大きくしても良い。

【0088】

図18と図19を用いて、第2の実施形態における基準画像の分割画像Smを用いた視線追跡の処理手順を説明する図である。

【0089】

図18は、シーン画像に最も類似する分割画像(最適分割画像)S*を選択する手順を説明する図である。

分割画像から最適分割画像S*を選択するためには、シーン画像のシーン特徴点に最も類似度の高い分割画像の基準特徴点(最も類似度評価の高い分割画像の基準特徴点)を求める処理と、類似度の高いシーン特徴点と分割画像の基準特徴点の組合せ数に基づいて分割画像Smからシーン類似画像を選択する分割画像選択処理を実行する。

【0090】

「分割画像とシーン画像の特徴点対応付処理」

数式1を用いて、シーン画像の各シーン特徴点に対する最も類似度評価の高い基準特徴点を求める手順を既に説明したが、基準画像の代わりに分割画像を用いて同様の処理を行なう。以下にその詳細な手順を再度説明する。

(1)視線分析装置100bは、シーン画像の各シーン特徴点に最も類似度の高い分割画像の基準特徴点を、以下の手順により求める。

(1−1)まず、複数の分割画像から1つの分割画像Smを選ぶ。(ステップS310)

【0091】

(1−2)次に、シーン画像の全てのシーン特徴点Qjに対して、各シーン特徴点Qjと最も高い類似度と評価される分割画像の基準特徴点Piを1つ対応付けて、この分割画像Smにおける特徴点組合せ197を作成する処理を、以下の手順により実施する。(ステップS320)

【0092】

(1−2−1)シーン画像の1つのシーン特徴点Qjを選ぶ。

【0093】

(1−2−2)このシーン特徴点Qjのシーン特徴点データ194の128次元のSIFT特徴量qikと、選んだ分割画像Smの任意の基準特徴点Piの基準特徴点データ196の128次元のSIFT特徴量pikと、を、既に説明した数式1に適用して、128次元ユークリッド空間の距離を算出して類似度dijを求める類似度算出処理を行なう。

(1−2−3)この類似度算出処理を、選んだ分割画像Smの全ての基準特徴点Piについて行なう。その結果、d1j、・・・、dl(m)jのl(m)個の類似度の値が求められる。但し、l(m)は、分割画像Smの基準特徴点Pの個数である。

【0094】

(1−2−4)次に、d1j、・・・、dl(m)jに基づいて、所定の閾値以下であって、かつ、最も値の小さい(距離が最小)類似度を与える特徴点Piを1つ選択して、この基準特徴点Piをシーン特徴点Qjに対する最も高い類似度の特徴点と評価して組(Qj、Pi)決定する。

なお、d1j、・・・、dl(m)jが全て所定の閾値以上の場合には、この閾値で定められる類似度評価レベルを満たす特徴点Piが存在しないから、組(Qj、Pi)が存在しないとする。

(1−2−5)組(Qj、Pi)のシーン特徴点Qjのシーン特徴点データ194と、基準特徴点Piの基準特徴点データ196と、分割画像の識別情報と、を含む特徴点組合せ197を作成して一時記憶する。

【0095】

(1−2−6)次のシーン特徴点Qj+1 に対して、(1−2−1)から(1−2−5)までを繰り返して、分割画像Smにおける特徴点組合せ197を作成して一時記憶する。

このようにして、全てのシーン特徴点Qjに対する、分割画像Smに関しての特徴点組合せ197を作成して一時記憶する。

【0096】

(1−3)さらに、残りの分割画像から、次の分割画像Sm+1を選んで、(1−2)を繰り返して、分割画像Sm+1における特徴点組合せ197を作成して一時記憶する。このようにして、全ての分割画像は、分割画像ごとに特徴点組合せ197が作成されて一時記憶される。(ステップS325)

【0097】

「シーン画像に対応する分割画像を決定する処理」

(2)視線分析装置100bは、一時記憶された各分割画像における特徴点組合せ197に含まれる組合せ個数を計数する。

次に、視線分析装置100bは、計数した組合せ個数を比較して、最も多い組合せ個数(評価基準)の特徴点組合せ197を保持し、保持した特徴点組合せ197に含まれる分割画像の識別情報が識別する分割画像を、シーン画像に最も合致(近似)する分割画像(最適分割画像)として決定する。(ステップS330)

【0098】

なお、評価基準として、分割画像の特徴点組合せ197を構成する組(Qj、Pi)の類似度dijの平均値(類似度dijの総和を組合せ個数で除算した値)を用いても良い。この場合は、最小の上記平均値を与える分割画像が選択される。

【0099】

ここで、図20と図21を用いて、高い類似度評価の特徴点PiとQjを説明する。

【0100】

図20は、分割画像515の基準特徴点516とシーン画像810のシーン特徴点812との組合せの例である。

例示された分割画像515には、カートンの基準特徴点516として、たとえば、R1が例示されている。

シーン画像810には、カートンのシーン特徴点812として、たとえば、Q210が例示されている。

基準特徴点R1と、シーン特徴点Q210とは、類似度が高い特徴点として決定され組み合わされている。

【0101】

図17は、特徴点組合せ197を説明する図である。

特徴点組合せ197は、分割画像識別情報1971と対応付けた特徴点データ部1972から構成される。

分割画像識別情報1971は、たとえば、識別可能な数字列である。

対応付けた特徴点データ部1972は、シーン特徴点データ194と分割画像の基準特徴点データ196との組合せである。

【0102】

図21は、分割画像の基準特徴点516とシーン画像のシーン特徴点812との組合せの例(2)である。

例示された分割画像515には、PETボトルの基準特徴点516として、たとえば、R77が例示されている。

シーン画像810には、PETボトルのシーン特徴点812として、たとえば、Q330が例示されている。

基準特徴点R77と、シーン特徴点Q330とは、類似度が高い特徴点として決定され組み合わされている。

【0103】

視線追跡の処理手順の説明を続ける。

【0104】

図19は、分割画像に注視点マークを合成する手順を説明する図である。

【0105】

「座標変換行列を導出する処理」

(5)視線分析装置100bは、保持した特徴点組合せ197から、任意の6組の分割画像の基準特徴点データ196とシーン特徴点データ194の組合せを選択する。

次に、視線分析装置100bは、ホモグラフィー行列の一般式(既述の数式2)に6組の特徴点情報を代入して、6つの式を作成して、この6つの式を解いて、座標変換行列(二次元画像座標変換関係式、既述の数式3)を導出することを既に説明した。(ステップS340)

【0106】

「分割画像に注視点マークを合成する処理」

(6)視線分析装置100bは、シーン画像810の注視点の座標情報と、導出した座標変換行列を用いて、分割画像上の座標情報を算出する。(ステップS350)

(7)視線分析装置100は、保持した特徴点組合せ197の分割画像の識別情報を手掛りにして、記憶手段091に記憶される分割画像データ195を参照して、該当する分割画像を呼び出す。(ステップS360)

(8)視線分析装置100bは、算出した分割画像上の座標情報を用いて、呼び出した分割画像に注視点マークを合成する。(ステップS370)

【0107】

なお、算出した分割画像上の座標情報を手掛りにして、基準画像上の座標情報を算出手順を予め定めておき、その算出手順に従って基準画像に注視点マークを合成してもよい。

【0108】

図22は、シーン画像810と分割画像515の注視点と基準画像の注視点の例である。

例示されたシーン画像810には、注視点マーク813が画像合成されている。

例示された分割画像515には、注視点マーク517が画像合成されている。

例示された基準画像510には、注視点マーク513が画像合成されている。

シーン画像の注視点マーク813と分割画像の注視点マーク517との位置関係(座標)は、互いに、導出された座標変換行列式(数式3)によって座標変換される関係にある。

分割画像の注視点マーク517と基準画像の注視点マーク513との位置関係(座標)は、平行移動の関係にある。たとえば、分割画像の原点を、基準画像上の分割画像の原点相当位置に平行移動する座標変換行列式を導出して用いればよい。

【0109】

図23は、第2の実施形態における視線分析装置100bの詳細な構成図である。

【0110】

実施例2における視線分析装置100bは、第1の実施形態における視線分析装置100に対して、以下の変更を行なったものである。

【0111】

記憶手段091は、さらに、

分割画像を識別する情報(分割画像識別情報)を含む分割画像データ195と、

分割画像を特定する分割画像識別情報と、座標情報と特徴量を含む分割画像の基準特徴点データ196と、

を記憶する。

【0112】

前記特徴点抽出手段120は、さらに、

分割画像データから分割画像特徴点を検出して、分割画像特徴点の座標情報と特徴量とを抽出して、分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データ196を作成する機能、

を実行するプログラムモジュールを備える。

【0113】

特徴点対応付け手段(特徴点対応付手段、特徴点組合せ手段)130は、

指定された分割画像の基準特徴点データ196の特徴量と、シーン特徴点データの特徴量とに基づいて、特徴点の類似度を判定し、最も高い類似度の高い分割画像の基準特徴点とシーン特徴点を対応付けて組み合わせて、この組合せと分割画像識別情報を含む特徴点組合せ197を作成する機能、

を実行するプログラムモジュールを備える。(詳細は、図18のシーン特徴点と分割画像の基準特徴点との対応付けを説明する項で述べた)

【0114】

分割画像選択手段175は、

1つの分割画像を指定するたびに、特徴点対応付け手段130を呼び出して、各分割画像ごとの特徴点組合せ197を得た後に、特徴点組合せ197に含まれる組合せの個数(分割画像の基準特徴点データ196とシーン特徴点データ194の組合せ個数)を比較して、最も多い組合せ個数(評価基準)を持つ特徴点組合せ197を保持する機能と、(詳細は、図18のシーン類似画像を選択する項で述べた)

保持する特徴点組合せ197に含まれる分割画像識別情報が識別する分割画像をシーン画像に最も合致(近似)する分割画像である最適分割画像を決定・選択する機能と、

を実行するプログラムモジュールである。(詳細は、図18のシーン類似画像を選択する項で述べた)

【0115】

座標変換行列算出手段140は、

最適分割画像についての特徴点組合せ197(保持する特徴点組合せ)から選択した、6組の分割画像の基準特徴点とシーン特徴点の組合せに基づいて、分割画像の基準特徴点の座標情報とシーン特徴点の座標情報を用いて、シーン画像の座標情報をシーン類似画像の座標情報に変換する座標変換行列を算出する機能と、(詳細は、図19の座標変換行列算出を説明する項で述べた)

分割画像の原点を、基準画像上の分割画像の原点相当位置に平行移動する座標変換行列式を導出して、分割画像の座標情報を基準画像の座標情報に変換する座標変換行列を算出する機能と、(詳細は、図22の分割画像の注視点マーク座標と、基準画像の注視点マーク座標との関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0116】

注視点マーク算出手段(注視点写像手段)150は、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を、最適分割画像上の座標情報に変換する機能、(詳細は、たとえば、図20のシーン画像上の注視点マークと分割画像の注視点マークの座標の相互関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0117】

画像合成手段160は、さらに、

最適分割画像の特徴点組合せ197を構成する分割画像特徴点データの分割画像特定情報を手掛りにして注視点マークを合成するための分割画像(最適分割画像)を取得する機能と、(詳細は、たとえば、図19のシーン類似画像選択を説明する項で述べた)

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する機能と、(詳細は、たとえば、図22のシーン画像上の注視点と分割画像の注視点マークと基準画像の座標情報の注視点マークの相互関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0118】

(変形例)

なお、基準画像の基準特徴点Piに分布の偏り(分布の疎密)が生じる場合がある。

このような場合には、視線計測者が、基準画像の特徴抽出が集中する画像領域と、特徴抽出がまばらに分布する画像領域とに分割した分割画像を作成すれば良い。

このとき、視線計測者は、基準画像上の基準特徴点の分布を調べて、その分布に応じて、分割する画像領域を決めれば良い。

【0119】

以上のように、第2の実施形態によれば、被験者が大きな対象物に近づいた場合でも、対象物の基準画像を分割することで、被験者の視線追跡が可能となる。

【符号の説明】

【0120】

1 視線計測システム(第1の実施形態)

2 視線計測システム(第2の実施形態)

100 第1の実施形態の視線分析装置

100b 第2の実施形態の視線分析装置

110 受信手段

120 特徴点抽出手段

130 特徴点対応付け手段

140 座標変換行列算出手段

150 注視点マーク算出手段

160 画像合成手段

175 分割画像選択手段

191 基準画像データ

192 基準特徴点データ

194 シーン特徴点データ

195 分割画像データ

196 分割画像の基準特徴点データ

197 特徴点組合せ

200 視線追跡メガネ

201 赤外線光源

202 アイトラッキングセンサー

203 シーンカメラ

204 処理部

291 シーン画像データ

292 注視点データ

510 基準画像

512 基準特徴点

513 基準チラシ画像に合成された注視点マーク

515 分割画像

610 チラシ

620 商品陳列棚

810 シーン画像

812 シーン画像に合成された特徴点マーク

813 シーン画像に合成された注視点マーク

【技術分野】

【0001】

本発明は、人物の視線を推定し、視線を計測する装置、システム、方法、プログラム、記録媒体に関するものである。

本発明は特に、評価対象印刷物(たとえば、チラシ、カタログ、ポスター)による生活者の購買動向分析において、眼鏡型アイトラッキング装置(視線追跡メガネ)を用いて、被験者が評価対象印刷物を見る視線を推定・追跡することで、評価対象印刷物の掲載情報(たとえば、商品情報)に対する視線を計測する場合に有用である。

【背景技術】

【0002】

従来、評価対象印刷物を見る人物の視線を推定・追跡して、掲載商品への視線を計測することで、注視度合いや関心度合いを解析し、生活者の購買動向を評価分析することが知られている。

生活者に適切な購買情報を提供するためには、評価対象印刷物の掲載情報を、どのように見ているかを知ることが重要となる。視線追跡方法は、生活者の関心度合いや、購買動向を把握するための有効な評価分析方法の1つである。

【0003】

視線を推定・追跡する方法としては、視線追跡メガネを用いた方法が知られている。

たとえば、特許文献1には、視線追跡メガネを被験者の頭部に装着させて、視線追跡メガネが有する視線計測用光源の赤外光を瞳孔と角膜に照射して、その反射光を視線追跡メガネに設けられた赤外光センサーにて受光し、その受光した反射光に基づいて、瞳孔の方向を推定することで、対象物を見る視線方向を推定する技術が開示されている。このメガネを通して対象物を見る視線方向に基づいて、メガネが捉える視野の中の注視位置を算出することが可能である。

このとき、識別が可能な基準マーカーを、評価対象印刷物の所定の位置に配置することで、視線追跡メガネの基準マーカー・センサーが捉えた基準マーカーの識別情報に基づいて、視線追跡メガネの向きとメガネが捉える視野の範囲を検知することが可能となる。また、検知した視線追跡メガネの向きとメガネが捉える視野の範囲に基づいて、メガネの視野が捉える評価対象印刷物の領域を推定することが出来る。

基準マーカーには、図形マーカー(印刷物)、または、IR(infrared)マーカー(IR発信器)を用いる場合がある。

たとえば、識別可能な複数のIRマーカーを用いて視線を追跡する、更にIRセンサーを設けた視線追跡メガネ(Tobiiグラスアイトラッカー、登録商標)が、非特許文献4に開示されている。非特許文献4によれば、視線追跡メガネが推定した視線方向と捉えた複数のIRマーカーの位置に基づいて、被験者が注視しているチラシ上の注視位置情報を算出することができる。

【0004】

なお、本発明の視線の計測・追跡技術に関連して、画像の回転・スケール変化・照明変化等に頑健な特徴量を記述する特徴点を検出するSlFT(Scale‐InvariantFeatureTransform)アルゴリズム、または、高速に画像の特徴点を抽出するSURF(SpeededUpRobustFeatures)アルゴリズムが、それぞれ、非特許文献1、2に記載されている。

なお、この2つのアルゴリズムが動作するプログラムは、OpenCV(非特許文献5)にて利用することが可能である。

または、画像の特徴点を検出して、検出した特徴点の局所特徴量を抽出するRandomized Treeアルゴリズム、もしくは、Fernsアルゴリズムが、それぞれ、非特許文献6、7に記載されている。

また、2つの平面画像間の視点変換により、一方の平面画像座標を他方の平面画像座標に変換するホモグラフィー行列を算出するアルゴリズムは、非特許文献3に記載されている。

【先行技術文献】

【特許文献】

【0005】

【特許文献1】特開2007−319187号公報(たとえば、段落「0025」−「0029」、図2)

【非特許文献】

【0006】

【非特許文献1】DavidG.Lowe、“Distinctive image features from scaleinvariant keypoints”、Int.Journal of Computer Vision、Vol.60、No.2、PP.91‐110、2004.

【非特許文献2】H.Bay,T.Tuytelaars,andL.VanGool、“SURF:Speeded Up Robust. Features”、InECCV、pp.404‐417、2006.

【非特許文献3】橋本浩一、“ビジュアルサーボ−II−コンピュータビジョンの基礎”、日本バーチャルリアリティ学会論文誌、Vol.4、No.4、1999.

【非特許文献4】トビー・テクノロジー・ジャパン株式会社、Tobiiグラスアイトラッカー、[online][平成23年9月8日検索]、インターネット<URL:http://www.tobii.com/ja−JP/eye−tracking−research/japan/products/hardware/tobii−glasses−eye−tracker/>

【非特許文献5】OpenCV、SIFT/SURF、[online][平成23年9月8日検索]、インターネット<URL:http://opencv.jp/opencv−2.2/cpp/features2d_feature_detection_and_description.html>

【非特許文献6】V. Lepetit and P. Fua, “Keypoint Recognition using Randomized Trees”, IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol.28, No.9, pp。1465−1479, 2006.

【非特許文献7】M.Ozuysal,P.Fua, V.Lepetit,―Fast Keypoint Recognition in Ten Lines of Code.,Proc. of Int.Conf. on Computer Vision and Pattern Recognition(2007)

【発明の概要】

【発明が解決しようとする課題】

【0007】

しかしながら、被験者の頭の向きと距離を知るために評価対象印刷物の表面に図形マーカーを設けることは、美観を損ね、被験者の注意力を散漫にさせて、無用な視線の動きを生じさせるので、視線の計測品質の低下を招き好ましくない。

また、IRマーカーを用いる場合には、評価対象印刷物の裏面に設ければ美観を損ねることは無いが、IRが印刷物(紙)を透過するときに減衰するために、受光できないことがあり、位置計測の精度が低下する。

しかも、裏面に設けたIRマーカーは、評価対象印刷物を裏返して閲覧する場合には、図形マーカーと同様にIRマーカーが目に入るので、被験者の注意力を散漫にさせて、無用な視線の動きを生じるので、視線の計測品質の低下を招き好ましくない。

【0008】

本発明は以上のような点を解決するためになされたものであって、本発明の課題は、評価対象印刷物の掲載情報の注目度を分析評価するときに、簡単に、被験者に無用な視線の動きを生じさせずに高い精度で、被験者の視線を推定して追跡することで、評価対象印刷物に対する視線を計測することが可能な装置、システム、方法、プログラム、記録媒体を提供することである。

【課題を解決するための手段】

【0009】

本発明は、以下の各態様に記載の手段により、前記課題を解決する。

すなわち、本願発明の第1の発明は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置である。

【0010】

このように、基準マーカーを用いる代わりに、基準特徴点データの座標情報とシーン特徴点データの座標情報にを用いることで、シーン画像上の注視点座標情報を、基準画像上の注視点座標情報に変換することが可能である。

【0011】

本願発明の第2の発明は、

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データとを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システムである。

【0012】

本願発明の第3の発明は、

基準画像と、座標情報と特徴量を含む基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も高い類似度の基準特徴点とシーン特徴点の組合せを求める特徴点組合せステップと、

視線分析装置が、組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0013】

本願発明の第4の発明は、さらに、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の高い分割画像の基準特徴点を求めて、求めた分割画像の基準特徴点とシーン特徴点の組合せと分割画像を識別する情報を含む特徴点組合せを作成する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、最も多い組合せ個数を持つ組合せを決定して、決定した特徴点組合せに含まれる分割画像を識別する情報が識別する分割画像を選択する分割画像選択手段と、

検出した組合せに含まれる分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置である。

【0014】

本願発明の第4の発明の1つの態様は、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置である。

【0015】

本願発明の第4の発明の異なる1つの態様は、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置である。

【0016】

本願発明の第4の発明の異なる1つの態様は、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線分析装置である。

【0017】

本願発明の第5の発明は、

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システムである。

【0018】

本願発明の第5の発明の1つの態様は、

前記視線分析装置において、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線計測システムである。

【0019】

本願発明の第5の発明の異なる1つの態様は、

前記視線分析装置において、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置であることを特徴とする視線計測システムである。

【0020】

本願発明の第5の発明の異なる1つの態様は、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線計測システムである。

【0021】

本願発明の第6の発明の態様は、

分割画像を特定する情報を含む分割画像データと、分割画像を特定する分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せステップと、

視線分析装置が、作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択ステップと、

視線分析装置が、選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0022】

本願発明の第6の発明の1つの態様は、

前記特徴点組合せステップは、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

手順でなされることを特徴とする視線計測方法である。

【0023】

本願発明の第6の発明の異なる1つの態様は、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

手順でなされることを特徴とする視線計測方法である。

【0024】

本願発明の第6の発明の異なる1つの態様は、

さらに、基準画像を用いて、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成するステップ、

を含んだ手順でなされることを特徴とする視線計測方法である。

【0025】

本願発明の第7の発明は、コンピュータに組込むことによって、コンピュータを第1から第4の発明までのいずれかに記載の視線分析装置として動作させるコンピュータプログラムである。

【0026】

本願発明の第8の発明は、第7の発明に記載のコンピュータプログラムを記録したコンピュータ読取り可能な記録媒体である。

【発明の効果】

【0027】

本願発明によれば、

(1)基準マーカーを用いる必要がないので、被験者が通常と同じ状態で評価対象印刷物を閲覧できることから、閲覧に専念でき、正確な視線の動きを計測することが可能である。

(2)評価対象印刷物の特徴点情報を用いて、視線の動きを注視点マークとして評価対象印刷物の基準画像上に再現することが可能である。

(3)評価対象印刷物の特徴点情報は印刷ページごとに異なることからページを識別することができるので、複数ページの評価対象印刷物の視線を計測する場合にも、各ページごとに視線の動きを再現することが可能である。

【図面の簡単な説明】

【0028】

【図1】図1は、視線計測システム1の全体構成を説明する図である。(第1の実施形態)

【図2】図2は、視線計測システム1の操作と処理の大まかな手順を説明する図である。

【図3】図3は、視線追跡メガネ200を説明する図である。

【図4】図4は、各座標系の関係を説明する図である。

【図5】図5は、シーン画像とシーン特徴点の例である。

【図6】図6は、シーン特徴点データ194の形式を説明する図である。

【図7】図7は、基準画像と基準特徴点の例である。

【図8】図8は、基準特徴点の組合わせを説明する図である。

【図9】図9は、組み合わせられた特徴点の例である。

【図10】図10は、ホモグラフィー行列の説明図である。

【図11】図11は、基準画像上に合成された注視点マークの例である。

【図12】図12は、分析装置100の詳細な構成図である。

【図13】図12は、分析装置100のフローチャートである。

【図14】図13は、注視点マークを合成した基準画像の例

【図15】(第2の実施形態)図15は、視線計測システム2の全体構成を説明する図である。

【図16】(第2の実施形態)図16は、商品棚の正面画像の例である。

【図17】(第2の実施形態)図17は、特徴点組合せ197を説明する図である。

【図18】(第2の実施形態)図18は、分割画像を用いた視線追跡の処理手順(その1)を説明する図である。

【図19】(第2の実施形態)図19は、分割画像を用いた視線追跡の処理手順(その2)を説明する図である。

【図20】(第2の実施形態)図20は、対応付けられた特徴点の例(その1)である。

【図21】(第2の実施形態)図21は、対応付けられた特徴点の例(その2)である。

【図22】(第2の実施形態)図22は、各画像の注視点の相互関係である。

【図23】(第2の実施形態)図23は、視線分析装置100bの詳細な構成図である。

【発明を実施するための形態】

【0029】

以下、図面等を参照しながら、本発明の実施の形態について、更に詳しく説明する。

【0030】

(第1の実施形態)

図1は、本発明の実施の形態による視線計測システム1の概要を説明する図である。

視線計測システム1は、視線分析装置100と、視線追跡メガネ200とが接続可能に構成される。

【0031】

視線分析装置100は、既存のパーソナルコンピューターに、後述する専用プログラムを搭載したものである。

【0032】

視線追跡メガネ200は、評価対象印刷物610(以下、チラシ)を見る視線方向を推定する。

視線追跡メガネ200は、赤外線光源と赤外線センサーとカメラとから構成される。

【0033】

図2は、視線計測システム1の操作と処理の大まかな手順を説明する図である。

【0034】

(1)被験者は、視線追跡メガネ200を目に掛ける。

【0035】

(2)被験者がチラシ610の閲覧を開始すると、視線追跡メガネ200は、チラシ610を撮像して、シーン画像を作成する。同時に、赤外線を眼球に照射して、受光した反射光に基づいて視線方向を推定し、撮像したシーン画像上の注視点位置情報を算出する。

(3)被験者の視線計測作業が終わったら、視線計測者が、視線追跡メガネ200を視線分析装置100に接続すると、視線追跡メガネ200は、シーン画像と注視点位置情報を視線分析装置100に送信する。

【0036】

(4)視線分析装置100は、シーン画像と注視点位置情報を視線追跡メガネ200から受信する。

(5)視線分析装置100は、撮像したシーン画像から特徴点情報を抽出し、予め記憶する基準画像の特徴点情報と類似度を比較する。次に、最も類似度の高い特徴点同士を組み合わせて、この組み合わせた特徴点情報に基づいて、座標変換行列を算出する。(詳細は後述する)

【0037】

ここで、基準画像が複数個ある場合には、まず、各基準画像ごとに、シーン画像の特徴点情報を基準画像の特徴点情報の類似度を比較して最も類似度の高い特徴点同士を組み合わせて、次に、各特徴点の同士を組み合わせの中から、最も類似度の高い組み合わせを選び、その組合せの特徴点情報に基づいて、座標変換行列を算出する。

【0038】

(6)視線分析装置100は、 座標変換行列を用いて、受信したシーン画像上の注視点位置座標を基準画像上の座標に変換する。次に、座標変換した注視点位置に基づいて、基準画像に注視点マークを合成して表示する。

【0039】

なお、撮影されたシーン画像の中から撮影時間内の所望の時刻におけるシーン画像を用いることで、撮影時間内での所望の時刻における基準画像上での注視点座標が得られる。

たとえば、撮影された全てのシーン画像を用いることで、撮影中の全ての注視点の情報(視線の移動の様子など)を得ることが出来る。

【0040】

図3は、視線追跡メガネ200を説明する図である。

図3に例示されている視線追跡メガネ200は、赤外線光源201と赤外線センサー202とシーンカメラ203と処理部204とを備える。

【0041】

赤外線光源201は、赤外線207を被験者の眼球301(角膜(瞳孔)や強膜(白目))に照射する。

赤外線センサー202は、眼球301から反射された赤外線208(反射光)を受光する。

シーンカメラ203は、二次元撮像素子である。シーンカメラ203は、被験者の視野ほぼ同等の光景(注視点を中心としたチラシ画像)を撮像する。

【0042】

処理部204は、演算処理回路と、記憶回路と、コネクターと、二次電池とを備える。

処理部204は、たとえば、眼球301の角膜と強膜の反射率の違いを利用した強膜反射法(リンバスト・トラッキング法。特許文献1による)に基づいて、受光した反射光208を用いて視線を計測して、視線の方向を推定する。また、処理部204は、推定した視線の方向と撮像したチラシ画像とを、通信接続した視線分析装置100に送信する。

なお、処理部204は、強膜反射法の代わりに、瞳孔−角膜反射法や、角膜反射法、ダブルプリキニエ法などを用いることも可能である。

コネクターは、視線追跡メガネ200と視線分析装置100とに通信接続する。

二次電池は、処理部自身の各回路と、赤外線光源201と赤外線センサー202とシーンカメラ203とに、電力を供給する。

【0043】

ここで、図4を用いて、視線計測システム1が扱う座標系の説明をする。

視線計測システム1が扱う座標系は、三次元空間座標系600(Xm、Ym、Zm)と、視線追跡メガネ座標系700(Xc、Yc、Zc)と、シーン画像平面座標系800(Xp、Yp)と、基準画像平面座標系500(Xr、Yr)とである。

三次元空間座標系(Xm、Ym、Zm)は、計測対象のチラシ610を原点とする三次元空間である。三次元空間座標系には、チラシ610(撮影対象物)と、視線追跡メガネのシーンカメラ203が配置されている。

【0044】

視線追跡メガネ座標系700(Xc、Yc、Zc)は、視線追跡メガネのシーンカメラ203を原点701とする三次元空間である。

ここで、シーンカメラ203は被験者の目に相当し、シーンカメラ203の原点701は、被験者の視点に相当する。

【0045】

シーン画像平面座標系800(Xp、Yp)は、シーンカメラ203が撮影したシーン画像810(二次元画像)を現わす二次元空間である。このシーンカメラ203が撮影した二次元画像810は、三次元空間座標系に配置された撮影対象物610を透視変換した透視画像である。

シーン画像810は、この場合には、チラシ610の一部を撮像した部分画像である。

【0046】

視線追跡メガネ座標系700の原点701が被験者の視点に相当するので、視線方向情報702に基づく視線702がシーン画像810と交わる点811が、注視点となる。

【0047】

基準画像平面座標系500(Xr、Yr)の基準画像とは、チラシ610の正面画像に相当する画像である。チラシ610を正面から撮像した画像であっても良いし、チラシ610の印刷データから生成した画像でも良い。

【0048】

図5は、シーン画像とシーン特徴点の例である。

【0049】

図5の(a)には、シーン画像810が例示されている。

例示されているシーン画像810は、シーンカメラ203が撮像するチラシ画像であって、被験者がメガネを通して見るチラシと同等の画像である。たとえば、被験者がチラシに近づいた場合に、メガネを通して見えるチラシの一部に相当する。

【0050】

図5の(b)には、注視点マークが合成されたシーン画像810が例示されている。

例示されているシーン画像810には、被験者が注目するチラシ上の注視点811の位置に相当する位置に、注視点マーク812が合成されている。

この注視点マークの位置は、すでに説明したように、シーンカメラ203の原点701と視線方向情報702に基づいて算出した交点811(視線702がシーン画像810と交わる点、注視点)に相当する。

【0051】

図5の(c)には、シーン画像の特徴点Qが例示されている。

例示されているシーン画像810には、検出したシーン特徴点Qの一例が示されている。シーン特徴点Qは、たとえば、非特許文献1に記載のSlFTアルゴリズムにてシーン画像から検出した特徴点である。

または、非特許文献2に記載のSURF(SpeededUpRobustFeatures)アルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

または、非特許文献6に記載のRandomized Treeアルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

または、非特許文献7に記載のFernsアルゴリズムにてシーン画像からシーン特徴点Qを検出して、局所特徴量を抽出してもよい。

【0052】

図6は、シーン特徴点データ194を説明する図である。

シーン特徴点データ194は、公知のSlFTアルゴリズムにて、シーン画像データから検出したシーン特徴点QのSIFT特徴量を含んで記述される点情報である。

シーン特徴点データ194のデータ形式は、特徴点番号1941と、座標値1942と、特徴量1943と、を含んで構成される。

特徴点番号1941は、シーン画像の特徴点に対して、検出された順に割り振られた連続番号(特定可能な数字列)を記述するデータ項目である。

座標値1942は、シーン画像の特徴点の座標情報(シーン画像平面座標系)を記述するデータ項目である。

特徴量1943は、SlFTアルゴリズムにて、シーン画像から抽出したシーン特徴点Qの局所特徴量(SIFT特徴量)を記述するデータ項目である。

SIFT特徴量は、SlFTアルゴリズムにて検出した特徴点の周辺領域を4×4の正方形グリッドに分割して、各グリッド内の8方向に対して求めた勾配ヒストグラムから構成される128次元の局所特徴量qである。

【0053】

図7は、基準画像と基準特徴点Pの例である。

例示されている基準画像510は、チラシ610を正面から撮像した正面画像である。

基準画像510には、基準特徴点P512の一例が示されている。

基準特徴点P512は、シーン画像のシーン特徴点Qと同様に、非特許文献1に記載のSlFTアルゴリズムにて基準画像から検出した特徴点である。

なお、基準画像610は、チラシ印刷データから作成しても良い。

【0054】

次に、基準画像の基準特徴点Pとシーン画像のシーン特徴点Qの中から、同一のものを抽出して対応付ける処理について説明する。

【0055】

図8は、基準特徴点Pとシーン特徴点Qの類似度を算出する処理を説明する図である。ここで、基準特徴点データ192の形式は、シーン特徴点データ194の形式と同じである。ただし、座標値1922は、基準画像の特徴点の座標情報(基準画像平面座標系)を記述するデータ項目である。

(1)基準特徴点Piの基準特徴点データ192iのSIFT特徴量(pi1、・・、pin 、・・、pi128)と、シーン特徴点Qjのシーン特徴点データ194jのSIFT特徴量(qj1 、・・ 、qjn 、・ ・、qj128)を用いて、基準特徴点Piとシーン特徴点Qjの128次元ユ−クリッド空間R128の距離dijを全てのPiとQjの組合せに対して算出する。(ステップS141)

(2)すべての基準特徴点Pに対してそれぞれdijが最小かつ、所定の閾値以下となるシーン特徴点Qを求めて、そのシーン特徴点Qが対する基準特徴点Pに最も類似度が高いと決定する。(ステップS142)

(3)基準特徴点Piに対して最も高い類似度を算出したシーン特徴点Qjを対応づける。

【0056】

ここで、組み合わせられた特徴点Piと特徴点Qjの類似度が最も高いということは、基準チラシ画像上の基準特徴点Piとシーン画像上のシーン特徴点Qjとが同一の特徴点である可能性が高いことを意味する。

【0057】

図9は、組み合わされた基準特徴点P512とシーン特徴点Q812とを図示した例である。

図示された基準チラシ画像の基準特徴点P512が、シーン画像のシーン特徴点Q812と対応付けられていて、同一の特徴点であることを示している。たとえば、基準特徴点P1とシーン特徴点Q20とが対応する特徴点であることを示している。

【0058】

図10は、ホモグラフィー行列を説明する図である。

【0059】

図10の(a)は、ホモグラフィー行列を説明する図である。

ホモグラフィー行列とは、2つの平面画像間の視点変換により、一方の平面画像座標を他方の平面画像座標に変換する関係式であることが数学的にすでに分かっている座標変換行列(二次元画像座標変換関係式)である。

ホモグラフィー行列の一般式は、未知数としての行列要素を6個(fx、fy、Cx、Cy、r1、r2)含む。

ここで、X、Yは、一方のカメラ画像の特徴点の座標値であって、x、yは、他方のカメラ画像の特徴点の座標値である。

fx、fy、Cx、Cyは、投影変換行列の要素であり、カメラの内部行列の要素に相当する。

sは、スケール係数である。

r1、r2、tは、回転・並行移動行列の要素である。

【0060】

図10の(b)は、所定のホモグラフィー行列を説明する図である。

fa、fb、Ca、Cb、ra、rbは、所定のホモグラフィー行列の要素の値である。

ホモグラフィー行列の一般式に対して、6組の平面画像座標の組合せ((X、Y)と(x、y)の組合せ)を適用して、6つの式を作成して、この6式を解いて、未知数である6個の行列要素の解(fa、fb、Ca、Cb、ra、rb)を求めることで、所望の座標変換行列を算出することができる。

【0061】

そこで、6組の対応付けられた基準特徴点612の座標(X、Y)とシーン特徴点812の座標(x、y)の組合せに基づいて算出した座標変換行列(ホモグラフィー行列)を用いることにより、シーン画像上の注視点811の座標値を基準チラシ画像上の注視点513の座標値に変換することが可能となる。

【0062】

図11は、基準画像510に合成された注視点マーク513の例である。

例示されている基準画像510には、シーン画像820に合成されている注視点マーク813の位置に相当する位置に、注視点マーク513が合成されている。

注視点マーク513の位置は、6組の対応付けられた基準チラシ画像とシーン画像の特徴点の組合せに基づいて算出された座標変換行列(ホモグラフィー行列)を用いることによって、シーン画像上の注視点の座標値を、基準チラシ画像上の注視点の座標値に変換して求められたものである。

【0063】

図12は、視線分析装置100の詳細な構成図である。

視線分析装置100は、CPU101と、表示部102と、接続部106と、記憶部109と専用プログラムなどを備える。

CPU101と、表示部102と、接続部106と、記憶部109とは、BUS199で接続される。

【0064】

CPU101は、中央演算装置である。

表示部102は、液晶表示装置や有機EL表示装置である。

接続部106は、コネクター(たとえば、USBコネクター)である。

接続部106は、視線追跡メガネ200の情報処理装置204と接続する。

【0065】

記憶部109は、半導体メモリーや磁気メモリーである。

記憶部109は、基準格納領域091と、シーン格納領域092と、注視点格納領域093と、を備えて、オペレーティングシステム185と、専用プログラムとを記憶する。

基準格納領域091は、基準画像データ191と基準特徴点データ192の集合を格納する。

シーン格納領域092は、シーン画像データ291とシーン特徴点データ194を格納する。

注視点格納領域093は、注視点データ292を格納する。注視点データ292は、注視点座標値を含んで構成される。

オペレーティングシステム185は、視線分析装置100のハードウェア(たとえば、CPU101と、表示部102と、接続部106と、記憶部109と、BUS199など)を管理・制御して、応用ソフトウエア(たとえば、専用プログラム)に対して、これらのハードウェアを利用できるようなサービスを提供する基本ソフトウエアである。

【0066】

このほかに、受信手段110と、特徴点抽出手段120と、特徴点対応付け手段130と、座標変換行列算出手段140と、注視点マーク算出手段150と、画像合成手段160と、を備える。これらの各手段は、それぞれの専用プログラムによって実現され、専用プログラムがCPU101に解釈・実行されることによって機能する。

【0067】

受信手段110は、視線追跡メガネ200からシーン画像データ291とシーン画像の注視点位置情報を含む注視点データ292を受信する機能を実行するプログラムモジュールである。

【0068】

特徴点抽出手段120は、シーン画像データ291からシーン特徴点を検出して、シーン特徴点の局所特徴量(SIFT特徴量)を抽出して、シーン特徴点データ194を作成する機能を実行するプログラムモジュールである。(詳細は、図6のシーン特徴点データを説明する項で述べた)

【0069】

特徴点対応付け手段130は、基準特徴点データ192のSIFT特徴量(128次元データ)と、シーン特徴点データ194のSIFT特徴量(128次元データ)を用いて、128次元ユークリッド空間の距離(2個の128次元データを構成する各要素の差の二乗の総和の平方根)を算出し類似度とする機能と、

最小の距離を最も類似度が高いとして、最も高い類似度を算出したときの基準特徴点データ192とシーン特徴点データ194を組み合わせる機能と、

を実行するプログラムモジュールである。(詳細は、図8の特徴点の組合せを説明する項で述べた)

【0070】

座標変換行列算出手段140は、対応付けられた基準特徴点データ192とシーン特徴点データ194の組合せの中から、任意の6組を選び出し、選び出した組の基準特徴点データ192の座標(X、Y)とシーン特徴点データ194の座標(x、y)に基づいて、座標変換行列を算出する機能を実行するプログラムモジュールである。(詳細は、図10のホモグラフィー行列を説明する項で述べた)

【0071】

注視点マーク算出手段150は、算出した座標変換行列に基づいて、シーン画像上の注視点位置情報を、基準画像上の注視点の位置情報に変換する機能を実行するプログラムモジュールである。(詳細は、図10のホモグラフィー行列を説明する項で述べた)

【0072】

画像合成手段160は、変換された基準画像上の注視点の座標値に基づいて、注視点マーク811を生成して、基準画像に合成する機能を実行するプログラムモジュールである。

【0073】

図13は、視線分析装置100が注視点マークが合成された基準画像510を表示するフローチャートである。

【0074】

(1)特徴点抽出手段120は、SIFTアルゴリズムを用いて、シーン画像データ291から検出したシーン特徴点のSIFT特徴量を抽出して、シーン特徴点データ194を作成する。(ステップS200)

(2)特徴点対応付け手段130は、記憶手段に記憶する基準特徴点データ192の128次元のSIFT特徴量pijと、シーン特徴点データ194の128次元のSIFT特徴量qijとを用いて、特徴点PiとQjの類似度dijとして、128次元ユークリッド空間の距離(下記の数式1)を全てのPiとQjの組合せに対して算出して、最も類似度の値の小さいもの(距離が最小の)を類似度が高い特徴点として決定して、基準特徴点データ192とシーン特徴点データ194を組み合わせる。(ステップS210)

【数1】

i,j=1,・・・,128

【0075】

(3)座標変換行列算出手段140は、基準特徴点データ192とシーン特徴点データ194の組合せの中から、任意の6組の組合せを選択する。次に、座標変換行列算出手段140は、ホモグラフィー行列の一般式(下記の数式2)に6組の特徴点情報を代入して、6つの式を作成する。最後に、座標変換行列算出手段140は、6つの式を解いて、fx、fy、Cx、Cy、r1、r2、を算出して、座標変換行列(二次元画像座標変換関係式、下記の数式3)を導出する。(ステップS220)

【数2】

【数3】

ここで、fa、fb、Ca、Cb、ra、rbは、算出した二次元画像座標変換関係式の行列要素である。

【0076】

(4)注視点マーク算出手段150は、算出した座標変換行列に基づいて、シーン画像上の注視点座標値を、基準画像上の注視点の座標値に変換する。(ステップS230)

(5)画像合成手段160は、変換された基準画像上の注視点の座標値に基づいて、注視点マーク811を生成して、基準画像に合成して、注視点マークが合成された基準画像611を表示する。(ステップS240)

【0077】

図14は、その他の注視点マークの例である。

【0078】

図14の(a)には、注視点の移動を表記する注視点マークが例示されている。

注視点の移動の順序を表す数字と、マーク間を結び注視点の移動方向を示す矢印を付した線分にて注視点マークを表記している。

【0079】

図14の(b)には、累積注視時間を表記する注視点マークが例示されている。

累積注視時間を、注視点マークの大きさや色の濃淡にて注視点マークを表記している。

【0080】

以上のように、本発明によれば、

(1)基準マーカーを用いずに、被験者が日常に目にするチラシと同じ状態のチラシを用いて閲覧できるので、視線の動きが自然であって、雑音のない、正確な視線の動きを計測することが可能である。

(2)チラシとシーン画像の特徴点情報を用いることで、視線の動きを注視点マークとしてチラシ上に再現することが可能である。

(3)評価対象印刷物が複数ページにわたる場合でも、各ページごとに視線の動きを再現することが可能である。

このように、日常と同じ状態のチラシを用いて、手間を掛けずに被験者の正確な視線追跡(視線計測)ができる。

【0081】

(第2の実施形態)

ところで、商品陳列棚上の視線を追跡する場合には、商品陳列棚を撮影した基準画像の特徴点Piと、商品陳列棚に寄ったシーン画像のシーン特徴点Qiとを対応付けて、シーン画像上の注視点を座標変換する必要がある。

ところが、商品陳列棚に寄ったシーン画像に相当する画像領域は、商品陳列棚を撮影した基準画像に対して小領域であるために、シーン画像に相当する画像領域に含まれる基準特徴点Piの個数が少ない。従って、基準特徴点Piとシーン特徴点Qiとの対応付けを行なう特徴点対応付処理ができず、座標変換行列を算出できないという不具合が生じることがある。

【0082】

そこで、基準画像を幾つかに分割した分割画像Smを用いることで、特徴点対応付処理を可能にして、基準画像とシーン画像のサイズの差が大きくなることが想定される被験者の視線追跡を可能にする実施形態を以下に説明する。

この実施形態(第2の実施形態)によれば、商品陳列棚上の被験者の視線を追跡するような場合でも、問題なく視線計測が可能となる。

【0083】

図15は、第2の実施形態による視線計測システム2の概要を説明する図である。

視線計測システム2は、第1の実施形態と同様に、視線分析装置100bと、視線追跡メガネ200とが接続可能に構成される。なお、第1の実施形態と同じ装置、構成を用いる場合には同じ符号を付して、重複する説明は省略する。

【0084】

視線追跡メガネ200は、商品陳列棚620を見る視線方向を推定する。

【0085】

商品陳列棚620は、飲料容器(商品)の陳列棚で複数の棚(段)を備え、たとえば、コンビニエンスストアに設置される。

商品陳列棚620は、陳列された商品が配置される複数の段から構成されている。

【0086】

図16は、商品陳列棚の画像(基準画像と分割画像)を説明する図である。

図16の(a)には、商品の陳列棚620を正面から撮影した正面画像としての基準画像510が例示されている。

例示された基準画像510の商品の陳列棚620は、たとえば、カートンが配置される複数の段から構成される陳列棚と、PETボトルが配置される複数の段から構成される陳列棚と、を組み合わせて構成される。

【0087】

図16の(b)には、基準画像を幾つかに分割した分割画像Sm515が例示されている。

例示された分割画像Sm515は、基準画像を6分割(縦2分割×横3分割)した例である。(m=1、2、・・、6)

なお、各分割画像Sm515からは、特徴点対応付処理に充分に必要な個数の基準特徴点Piを抽出することができる。

なお、例示された分割画像Smの大きさは同じであるが、異なる大きさの分割画像で構成しても良い。たとえば、商品棚の上段の分割画像は小さく、下段の分割画像は大きくしても良い。

【0088】

図18と図19を用いて、第2の実施形態における基準画像の分割画像Smを用いた視線追跡の処理手順を説明する図である。

【0089】

図18は、シーン画像に最も類似する分割画像(最適分割画像)S*を選択する手順を説明する図である。

分割画像から最適分割画像S*を選択するためには、シーン画像のシーン特徴点に最も類似度の高い分割画像の基準特徴点(最も類似度評価の高い分割画像の基準特徴点)を求める処理と、類似度の高いシーン特徴点と分割画像の基準特徴点の組合せ数に基づいて分割画像Smからシーン類似画像を選択する分割画像選択処理を実行する。

【0090】

「分割画像とシーン画像の特徴点対応付処理」

数式1を用いて、シーン画像の各シーン特徴点に対する最も類似度評価の高い基準特徴点を求める手順を既に説明したが、基準画像の代わりに分割画像を用いて同様の処理を行なう。以下にその詳細な手順を再度説明する。

(1)視線分析装置100bは、シーン画像の各シーン特徴点に最も類似度の高い分割画像の基準特徴点を、以下の手順により求める。

(1−1)まず、複数の分割画像から1つの分割画像Smを選ぶ。(ステップS310)

【0091】

(1−2)次に、シーン画像の全てのシーン特徴点Qjに対して、各シーン特徴点Qjと最も高い類似度と評価される分割画像の基準特徴点Piを1つ対応付けて、この分割画像Smにおける特徴点組合せ197を作成する処理を、以下の手順により実施する。(ステップS320)

【0092】

(1−2−1)シーン画像の1つのシーン特徴点Qjを選ぶ。

【0093】

(1−2−2)このシーン特徴点Qjのシーン特徴点データ194の128次元のSIFT特徴量qikと、選んだ分割画像Smの任意の基準特徴点Piの基準特徴点データ196の128次元のSIFT特徴量pikと、を、既に説明した数式1に適用して、128次元ユークリッド空間の距離を算出して類似度dijを求める類似度算出処理を行なう。

(1−2−3)この類似度算出処理を、選んだ分割画像Smの全ての基準特徴点Piについて行なう。その結果、d1j、・・・、dl(m)jのl(m)個の類似度の値が求められる。但し、l(m)は、分割画像Smの基準特徴点Pの個数である。

【0094】

(1−2−4)次に、d1j、・・・、dl(m)jに基づいて、所定の閾値以下であって、かつ、最も値の小さい(距離が最小)類似度を与える特徴点Piを1つ選択して、この基準特徴点Piをシーン特徴点Qjに対する最も高い類似度の特徴点と評価して組(Qj、Pi)決定する。

なお、d1j、・・・、dl(m)jが全て所定の閾値以上の場合には、この閾値で定められる類似度評価レベルを満たす特徴点Piが存在しないから、組(Qj、Pi)が存在しないとする。

(1−2−5)組(Qj、Pi)のシーン特徴点Qjのシーン特徴点データ194と、基準特徴点Piの基準特徴点データ196と、分割画像の識別情報と、を含む特徴点組合せ197を作成して一時記憶する。

【0095】

(1−2−6)次のシーン特徴点Qj+1 に対して、(1−2−1)から(1−2−5)までを繰り返して、分割画像Smにおける特徴点組合せ197を作成して一時記憶する。

このようにして、全てのシーン特徴点Qjに対する、分割画像Smに関しての特徴点組合せ197を作成して一時記憶する。

【0096】

(1−3)さらに、残りの分割画像から、次の分割画像Sm+1を選んで、(1−2)を繰り返して、分割画像Sm+1における特徴点組合せ197を作成して一時記憶する。このようにして、全ての分割画像は、分割画像ごとに特徴点組合せ197が作成されて一時記憶される。(ステップS325)

【0097】

「シーン画像に対応する分割画像を決定する処理」

(2)視線分析装置100bは、一時記憶された各分割画像における特徴点組合せ197に含まれる組合せ個数を計数する。

次に、視線分析装置100bは、計数した組合せ個数を比較して、最も多い組合せ個数(評価基準)の特徴点組合せ197を保持し、保持した特徴点組合せ197に含まれる分割画像の識別情報が識別する分割画像を、シーン画像に最も合致(近似)する分割画像(最適分割画像)として決定する。(ステップS330)

【0098】

なお、評価基準として、分割画像の特徴点組合せ197を構成する組(Qj、Pi)の類似度dijの平均値(類似度dijの総和を組合せ個数で除算した値)を用いても良い。この場合は、最小の上記平均値を与える分割画像が選択される。

【0099】

ここで、図20と図21を用いて、高い類似度評価の特徴点PiとQjを説明する。

【0100】

図20は、分割画像515の基準特徴点516とシーン画像810のシーン特徴点812との組合せの例である。

例示された分割画像515には、カートンの基準特徴点516として、たとえば、R1が例示されている。

シーン画像810には、カートンのシーン特徴点812として、たとえば、Q210が例示されている。

基準特徴点R1と、シーン特徴点Q210とは、類似度が高い特徴点として決定され組み合わされている。

【0101】

図17は、特徴点組合せ197を説明する図である。

特徴点組合せ197は、分割画像識別情報1971と対応付けた特徴点データ部1972から構成される。

分割画像識別情報1971は、たとえば、識別可能な数字列である。

対応付けた特徴点データ部1972は、シーン特徴点データ194と分割画像の基準特徴点データ196との組合せである。

【0102】

図21は、分割画像の基準特徴点516とシーン画像のシーン特徴点812との組合せの例(2)である。

例示された分割画像515には、PETボトルの基準特徴点516として、たとえば、R77が例示されている。

シーン画像810には、PETボトルのシーン特徴点812として、たとえば、Q330が例示されている。

基準特徴点R77と、シーン特徴点Q330とは、類似度が高い特徴点として決定され組み合わされている。

【0103】

視線追跡の処理手順の説明を続ける。

【0104】

図19は、分割画像に注視点マークを合成する手順を説明する図である。

【0105】

「座標変換行列を導出する処理」

(5)視線分析装置100bは、保持した特徴点組合せ197から、任意の6組の分割画像の基準特徴点データ196とシーン特徴点データ194の組合せを選択する。

次に、視線分析装置100bは、ホモグラフィー行列の一般式(既述の数式2)に6組の特徴点情報を代入して、6つの式を作成して、この6つの式を解いて、座標変換行列(二次元画像座標変換関係式、既述の数式3)を導出することを既に説明した。(ステップS340)

【0106】

「分割画像に注視点マークを合成する処理」

(6)視線分析装置100bは、シーン画像810の注視点の座標情報と、導出した座標変換行列を用いて、分割画像上の座標情報を算出する。(ステップS350)

(7)視線分析装置100は、保持した特徴点組合せ197の分割画像の識別情報を手掛りにして、記憶手段091に記憶される分割画像データ195を参照して、該当する分割画像を呼び出す。(ステップS360)

(8)視線分析装置100bは、算出した分割画像上の座標情報を用いて、呼び出した分割画像に注視点マークを合成する。(ステップS370)

【0107】

なお、算出した分割画像上の座標情報を手掛りにして、基準画像上の座標情報を算出手順を予め定めておき、その算出手順に従って基準画像に注視点マークを合成してもよい。

【0108】

図22は、シーン画像810と分割画像515の注視点と基準画像の注視点の例である。

例示されたシーン画像810には、注視点マーク813が画像合成されている。

例示された分割画像515には、注視点マーク517が画像合成されている。

例示された基準画像510には、注視点マーク513が画像合成されている。

シーン画像の注視点マーク813と分割画像の注視点マーク517との位置関係(座標)は、互いに、導出された座標変換行列式(数式3)によって座標変換される関係にある。

分割画像の注視点マーク517と基準画像の注視点マーク513との位置関係(座標)は、平行移動の関係にある。たとえば、分割画像の原点を、基準画像上の分割画像の原点相当位置に平行移動する座標変換行列式を導出して用いればよい。

【0109】

図23は、第2の実施形態における視線分析装置100bの詳細な構成図である。

【0110】

実施例2における視線分析装置100bは、第1の実施形態における視線分析装置100に対して、以下の変更を行なったものである。

【0111】

記憶手段091は、さらに、

分割画像を識別する情報(分割画像識別情報)を含む分割画像データ195と、

分割画像を特定する分割画像識別情報と、座標情報と特徴量を含む分割画像の基準特徴点データ196と、

を記憶する。

【0112】

前記特徴点抽出手段120は、さらに、

分割画像データから分割画像特徴点を検出して、分割画像特徴点の座標情報と特徴量とを抽出して、分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データ196を作成する機能、

を実行するプログラムモジュールを備える。

【0113】

特徴点対応付け手段(特徴点対応付手段、特徴点組合せ手段)130は、

指定された分割画像の基準特徴点データ196の特徴量と、シーン特徴点データの特徴量とに基づいて、特徴点の類似度を判定し、最も高い類似度の高い分割画像の基準特徴点とシーン特徴点を対応付けて組み合わせて、この組合せと分割画像識別情報を含む特徴点組合せ197を作成する機能、

を実行するプログラムモジュールを備える。(詳細は、図18のシーン特徴点と分割画像の基準特徴点との対応付けを説明する項で述べた)

【0114】

分割画像選択手段175は、

1つの分割画像を指定するたびに、特徴点対応付け手段130を呼び出して、各分割画像ごとの特徴点組合せ197を得た後に、特徴点組合せ197に含まれる組合せの個数(分割画像の基準特徴点データ196とシーン特徴点データ194の組合せ個数)を比較して、最も多い組合せ個数(評価基準)を持つ特徴点組合せ197を保持する機能と、(詳細は、図18のシーン類似画像を選択する項で述べた)

保持する特徴点組合せ197に含まれる分割画像識別情報が識別する分割画像をシーン画像に最も合致(近似)する分割画像である最適分割画像を決定・選択する機能と、

を実行するプログラムモジュールである。(詳細は、図18のシーン類似画像を選択する項で述べた)

【0115】

座標変換行列算出手段140は、

最適分割画像についての特徴点組合せ197(保持する特徴点組合せ)から選択した、6組の分割画像の基準特徴点とシーン特徴点の組合せに基づいて、分割画像の基準特徴点の座標情報とシーン特徴点の座標情報を用いて、シーン画像の座標情報をシーン類似画像の座標情報に変換する座標変換行列を算出する機能と、(詳細は、図19の座標変換行列算出を説明する項で述べた)

分割画像の原点を、基準画像上の分割画像の原点相当位置に平行移動する座標変換行列式を導出して、分割画像の座標情報を基準画像の座標情報に変換する座標変換行列を算出する機能と、(詳細は、図22の分割画像の注視点マーク座標と、基準画像の注視点マーク座標との関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0116】

注視点マーク算出手段(注視点写像手段)150は、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を、最適分割画像上の座標情報に変換する機能、(詳細は、たとえば、図20のシーン画像上の注視点マークと分割画像の注視点マークの座標の相互関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0117】

画像合成手段160は、さらに、

最適分割画像の特徴点組合せ197を構成する分割画像特徴点データの分割画像特定情報を手掛りにして注視点マークを合成するための分割画像(最適分割画像)を取得する機能と、(詳細は、たとえば、図19のシーン類似画像選択を説明する項で述べた)

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する機能と、(詳細は、たとえば、図22のシーン画像上の注視点と分割画像の注視点マークと基準画像の座標情報の注視点マークの相互関係を説明する項で述べた)

を実行するプログラムモジュールを備える。

【0118】

(変形例)

なお、基準画像の基準特徴点Piに分布の偏り(分布の疎密)が生じる場合がある。

このような場合には、視線計測者が、基準画像の特徴抽出が集中する画像領域と、特徴抽出がまばらに分布する画像領域とに分割した分割画像を作成すれば良い。

このとき、視線計測者は、基準画像上の基準特徴点の分布を調べて、その分布に応じて、分割する画像領域を決めれば良い。

【0119】

以上のように、第2の実施形態によれば、被験者が大きな対象物に近づいた場合でも、対象物の基準画像を分割することで、被験者の視線追跡が可能となる。

【符号の説明】

【0120】

1 視線計測システム(第1の実施形態)

2 視線計測システム(第2の実施形態)

100 第1の実施形態の視線分析装置

100b 第2の実施形態の視線分析装置

110 受信手段

120 特徴点抽出手段

130 特徴点対応付け手段

140 座標変換行列算出手段

150 注視点マーク算出手段

160 画像合成手段

175 分割画像選択手段

191 基準画像データ

192 基準特徴点データ

194 シーン特徴点データ

195 分割画像データ

196 分割画像の基準特徴点データ

197 特徴点組合せ

200 視線追跡メガネ

201 赤外線光源

202 アイトラッキングセンサー

203 シーンカメラ

204 処理部

291 シーン画像データ

292 注視点データ

510 基準画像

512 基準特徴点

513 基準チラシ画像に合成された注視点マーク

515 分割画像

610 チラシ

620 商品陳列棚

810 シーン画像

812 シーン画像に合成された特徴点マーク

813 シーン画像に合成された注視点マーク

【特許請求の範囲】

【請求項1】

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置。

【請求項2】

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データとを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システム。

【請求項3】

基準画像と、座標情報と特徴量を含む基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せステップと、

視線分析装置が、組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項4】

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置。

【請求項5】

請求項4に記載の視線分析装置であって、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置。

【請求項6】

請求項5に記載の視線分析装置であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置。

【請求項7】

請求項4に記載の視線分析装置であって、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線分析装置。

【請求項8】

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システム。

【請求項9】

請求項8に記載の視線分析装置であって、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置。

【請求項10】

請求項9に記載の視線分析装置であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置。

【請求項11】

請求項8に記載の視線計測システムであって、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線計測システム。

【請求項12】

分割画像を特定する情報を含む分割画像データと、分割画像を特定する分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せステップと、

視線分析装置が、作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択ステップと、

視線分析装置が、選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項13】

請求項12に記載の視線計測方法であって、

前記特徴点組合せステップは、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

手順でなされることを特徴とする視線計測方法。

【請求項14】

請求項13に記載の視線計測方法であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

手順でなされることを特徴とする視線計測方法。

【請求項15】

請求項12に記載の視線計測方法であって、

さらに、基準画像を用いて、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成するステップ、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項16】

コンピュータに組込むことによって、コンピュータを請求項1から12のいずれか1項に記載の視線分析装置として動作させるコンピュータプログラム。

【請求項17】

請求項16に記載のコンピュータプログラムを記録したコンピュータ読取り可能な記録媒体。

【請求項1】

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置。

【請求項2】

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

基準画像と、座標情報と特徴量を含む基準特徴点データと、を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データとを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せ手段と、

組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像手段と、

変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システム。

【請求項3】

基準画像と、座標情報と特徴量を含む基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、基準特徴点データの特徴量と、シーン特徴点データの特徴量を用いて、類似度を判定し、最も類似度の高い基準特徴点とシーン特徴点の組合せを求める特徴点組合せステップと、

視線分析装置が、組み合わされた基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を基準画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された基準画像上の座標情報に基づいて、注視点マークを生成して、基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項4】

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備えることを特徴とする視線分析装置。

【請求項5】

請求項4に記載の視線分析装置であって、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置。

【請求項6】

請求項5に記載の視線分析装置であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置。

【請求項7】

請求項4に記載の視線分析装置であって、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線分析装置。

【請求項8】

視線追跡メガネと視線分析装置とが接続可能に構成される視線計測システムであって、

前記視線追跡メガネは、

メガネを通して見るシーン画像データを生成するシーンカメラと、

赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線センサーと、

赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する処理手段と、

シーン画像データとシーン画像上の注視点座標情報を含む注視点データとを視線分析装置に送信する送信手段と、

を備えるメガネであって、

前記視線分析装置は、

分割画像を識別する情報を含む分割画像データと、

分割画像を識別する情報と座標情報と特徴量を含む分割画像の基準特徴点データと、

を記憶する記憶手段と、

視線追跡メガネからシーン画像データとシーン画像上の注視点座標情報を含む注視点データを受信する受信手段と、

シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出手段と、

各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せ手段と、

作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択手段と、

選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出手段と、

算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像手段と、

変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成手段と、

を備える分析装置である、

ことを特徴とする視線計測システム。

【請求項9】

請求項8に記載の視線分析装置であって、

前記特徴点組合せ手段は、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

ことを特徴とする視線分析装置。

【請求項10】

請求項9に記載の視線分析装置であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

ことを特徴とする視線分析装置。

【請求項11】

請求項8に記載の視線計測システムであって、

前記視線分析装置において、

前記記憶手段は、さらに、

基準画像を記憶して、

前記画像合成手段は、さらに、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成する、

ことを特徴とする視線計測システム。

【請求項12】

分割画像を特定する情報を含む分割画像データと、分割画像を特定する分割画像特定情報と座標情報と特徴量を含む分割画像の基準特徴点データとを用いる視線計測方法であって、

視線追跡メガネが、メガネを通して見るシーン画像データを生成するシーン撮像ステップと、

視線追跡メガネが、赤外線光源から発した赤外光が眼球から反射した反射光を受光する赤外線受光ステップと、

視線追跡メガネが、赤外線センサーが受光した反射光情報に基づいて、シーン画像上の注視点座標情報を算出する算出処理ステップと、

視線分析装置が、シーン画像データからシーン特徴点を検出して、シーン特徴点の特徴量を抽出して、シーン特徴点データを作成する特徴点抽出ステップと、

視線分析装置が、各分割画像ごとに、シーン特徴点データの特徴量と分割画像の基準特徴点データの特徴量とに基づき、各シーン特徴点に対する最も高い類似度評価の分割画像の基準特徴点を求めて、各シーン特徴点に対する分割画像の基準特徴点の組合せである特徴点組合せを決定する特徴点組合せステップと、

視線分析装置が、作成した特徴点組合せに基づいて、予め定められた評価基準により最適な分割画像を選択する分割画像選択ステップと、

視線分析装置が、選択された最適な分割画像の基準特徴点データの座標情報とシーン特徴点データの座標情報に基づいて、座標変換行列を算出する座標変換行列算出ステップと、

視線分析装置が、算出した座標変換行列とシーン画像上の注視点座標情報に基づいて、シーン画像上の注視点を分割画像上の座標情報に変換する注視点写像ステップと、

視線分析装置が、変換された分割画像上の座標情報に基づいて、注視点マークを生成して、選択した基準画像に合成する画像合成ステップと、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項13】

請求項12に記載の視線計測方法であって、

前記特徴点組合せステップは、さらに、

シーン特徴点に対する分割画像の基準特徴点のいずれもが所定の類似度評価レベルを満たさない場合には、このシーン特徴点に対する分割画像の基準特徴点の組合せは存在しないと決定する、

手順でなされることを特徴とする視線計測方法。

【請求項14】

請求項13に記載の視線計測方法であって、

前記予め定められた評価基準は、

特徴点組合せにおけるシーン特徴点と分割画像の基準特徴点の組合せ個数である、

手順でなされることを特徴とする視線計測方法。

【請求項15】

請求項12に記載の視線計測方法であって、

さらに、基準画像を用いて、

変換された分割画像上の座標情報に基づいて、基準画像の座標情報を算出して注視点マークを基準画像に合成するステップ、

を含んだ手順でなされることを特徴とする視線計測方法。

【請求項16】

コンピュータに組込むことによって、コンピュータを請求項1から12のいずれか1項に記載の視線分析装置として動作させるコンピュータプログラム。

【請求項17】

請求項16に記載のコンピュータプログラムを記録したコンピュータ読取り可能な記録媒体。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【図21】

【図22】

【図23】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【図21】

【図22】

【図23】

【公開番号】特開2013−81762(P2013−81762A)

【公開日】平成25年5月9日(2013.5.9)

【国際特許分類】

【出願番号】特願2012−202109(P2012−202109)

【出願日】平成24年9月13日(2012.9.13)

【出願人】(000002897)大日本印刷株式会社 (14,506)

【Fターム(参考)】

【公開日】平成25年5月9日(2013.5.9)

【国際特許分類】

【出願日】平成24年9月13日(2012.9.13)

【出願人】(000002897)大日本印刷株式会社 (14,506)

【Fターム(参考)】

[ Back to top ]