議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラム

【課題】会議の重要な部分を抽出して議事録を作成することができる議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムを提供する。

【解決手段】議事録作成支援装置(サーバー100)は、会議の参加者同士の会話が成立している状態を検知するための検知手段(会話集中度算出部840)と、前記会議の参加者が発する音声を記録するための記録手段(データ保存部920)と、前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段(抽出部850)と、前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを備える。

【解決手段】議事録作成支援装置(サーバー100)は、会議の参加者同士の会話が成立している状態を検知するための検知手段(会話集中度算出部840)と、前記会議の参加者が発する音声を記録するための記録手段(データ保存部920)と、前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段(抽出部850)と、前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを備える。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムに関し、特に、重要な発言が抽出できる議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムに関する。

【背景技術】

【0002】

従来から、議事録の作成について、種々の技術が開示されている。

たとえば、特許文献1(特開2007−215053号公報)には、会議中に議事録を作成する技術が開示されている。特許文献1に記載の技術によれば、議事録作成開始と共に、それを重要な発言の開始時刻と設定し、会議終了時間をもって重要な発言の終了とする。

【0003】

また、非特許文献1("VoiceGraphy−製品概要"、[online]、日本電気株式会社、[平成23年9月21日検索]、インターネット<http://www.nec.co.jp/soft/VoiceGraphy/outline.html>)では、音声認識でテキスト化して議事録が生成される。

【0004】

また、非特許文献2("ディスカッションマイニングプロジェクト"、[online]、名古屋大学大学院情報科学研究科メディア科学専攻、[平成23年9月21日検索]、インターネット<http://www.nagao.nuie.nagoya-u.ac.jp/projects/discussion.xml>)では、複数のカメラ、マイク、および、ブラウザベースのツールを用いて、実世界の活動(たとえば、会議)の様子が収録される。発表者は、専用のツールを用いて、自分が発表に用いるスライドやスライドを切替えるタイミングなどを伝達することで、自動的に、これらの情報が議事録に記録される。また、発言内容は、書記が専用ツールを用いることによって記録される。具体的には、参加者が発言する際には、議論札と呼ばれる札型のデバイスを用いることで、発言者のIDと発言タイプ(質問、回答、コメント)が書記に伝達され、書記の議事録作成が支援されるとともに、議論の構造化が補助される。このようなシステムでは、使用したスライド、Web資料のURL(Uniform Resource Locator)などの情報も自動的に議事録に取り込まれ、半自動的に、議論自体が、構造化された議事録を生成する仕組みになっている。

【0005】

なお、イベントなどにおける参加者間の会話を記録する技術としては、非特許文献3("ビジネス顕微鏡(登録商標)とは"、[online]、株式会社日立製作所、[平成23年9月21日検索]、インターネット<http://www.hitachi-hitec.com/jyouhou/business-microscope/solution/microscope.html>)において、ビジネス顕微鏡という技術が開示されている。当該技術では、IDカード型のセンシング装置が利用される。当該装置は、マイクを備え、対面センサを内蔵している。このマイクは、当該装置を装着したユーザーの声や環境音を捉える。また、対面センサは、対面した人が装着するIDカード型のセンシング装置と通信することにより、対面した人を特定する。

【先行技術文献】

【特許文献】

【0006】

【特許文献1】特開2007−215053号公報

【非特許文献】

【0007】

【非特許文献1】"VoiceGraphy−製品概要"、[online]、日本電気株式会社、[平成23年9月21日検索]、インターネット<http://www.nec.co.jp/soft/VoiceGraphy/outline.html>

【非特許文献2】"ディスカッションマイニングプロジェクト"、[online]、名古屋大学大学院情報科学研究科メディア科学専攻、[平成23年9月21日検索]、インターネット<http://www.nagao.nuie.nagoya-u.ac.jp/projects/discussion.xml>

【非特許文献3】"ビジネス顕微鏡(登録商標)とは"、[online]、株式会社日立製作所、[平成23年9月21日検索]、インターネット<http://www.hitachi-hitec.com/jyouhou/business-microscope/solution/microscope.html>

【発明の概要】

【発明が解決しようとする課題】

【0008】

近年、ライフログという、ある程度コマ切りになった音声データ、その場(会議等の場)で作成した文書、ホワイトボードの画像など、多様で雑多な情報をすべて保存し、活用するような仕組みが提案されている。このようなライフログを利用して、人の行動パターンを抽出し、それをマーケティングにつなげるシステムの利用も種々検討されている。

【0009】

会議等のイベントの議事録の作成としては、上記のようなライフログから、当該イベントにとって重要な部分が抽出されることが有益であると考えられる。議事録作成担当者が、イベント全体を観察し、または、イベント全体が記録されたもののみが残された場合にその記録物から、手作業で、議事録を作成するのは手間と時間を要するからである。

【0010】

しかしながら、特許文献1に記載の技術によれば、重要な発言の出現のタイミングが会議開始時刻に対応して設定されるが、このような方法では重要な発言を記録できない場合も考えられる。さらに、会議中に議事録を作成することを前提としており、あとから作成することができない。したがって、会議後に議事録の作成が必要となった場合に、対応できない。

【0011】

また、非特許文献1に記載の技術によれば、イベント中の発言の一覧表を得ることはできるが、重要な部分の抽出という点が考慮されていない。

【0012】

また、非特許文献2に記載の技術によれば、イベント中に生じた議論を構造化して解析することはできるが、発言者による札型のデバイスの操作を要し、参加者にとって煩雑となる。また、発言者がデバイスの操作を忘れて発言を行なった場合には、議事録作成の対応ができなくなる。さらに、議事録の作成対象が日常の業務における会話といった参加者が特別な意識を持たない場面での適用も難しいと考えられる。

【0013】

また、非特許文献3に記載の技術によれば、ユーザー間の相関図が作成されたりするものの、イベントの重要な部分の抽出という点については検討がなされていない。

【0014】

本発明は係る実情に鑑み考え出されたものであり、その目的は、会議の重要な部分を抽出して議事録を作成することができる議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムを提供することである。

【課題を解決するための手段】

【0015】

本発明に従った議事録作成支援装置は、会議の参加者同士の会話が成立している状態を検知するための検知手段と、会議の参加者が発する音声を記録するための記録手段と、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段と、特定の音声を用いて会議の議事録を作成するための議事録作成手段とを備える。

【0016】

好ましくは、抽出手段は、会議の参加者のそれぞれについて、検知手段によって会話が成立したと判断された時間を積算して合計会話時間を算出し、各参加者についての合計会話時間に基づいて、会議における主発言者を特定し、記録手段が記録した音声から、主発言者が含まれる会話の音声を、特定の音声として抽出する。

【0017】

好ましくは、抽出手段は、すべての参加者についての合計会話時間に対する各参加者の合計会話時間の比を算出することによって、各参加者の会話集中度を算出し、各参加者の会話集中度に基づいて、最も会話集中度の高い参加者を主発言者として決定し、記録手段が記録した音声から、主発言者が含まれる会話の音声を、特定の音声として抽出する。

【0018】

好ましくは、記録手段は、各参加者が発した音声と当該参加者に発せられた音声とを区別して、音声を記録する。

【0019】

好ましくは、議事録作成手段は、特定の音声に対するリンクを生成し、当該リンクを提示する。

【0020】

好ましくは、抽出手段は、音声の発話の時間帯に基づく優先度に基づいて、記録手段に記録された音声から特定の音声を抽出する。

【0021】

好ましくは、抽出手段は、記録手段に記録された音声を発した参加者に対して設定された優先度に基づいて、記録手段に記録された音声から特定の音声を抽出する。

【0022】

好ましくは、記録手段は、音声を、当該音声を発する者の生体情報とともに記録する。

好ましくは、検知手段は、各参加者によって装着される光学的検出手段によって検出される情報を取得し、当該光学的検出手段から取得される情報に基づいて、会議の参加者同士の会話が成立している状態を検知する。

【0023】

好ましくは、検知手段は、各参加者の位置情報を検出するための位置検出手段によって検出される当該参加者の位置情報を取得し、当該位置検出手段から取得される情報に基づいて、会議の参加者同士の会話が成立している状態を検知する。

【0024】

本発明に従った議事録作成支援システムは、会議の参加者が装着する検出手段と、検出手段と通信可能な議事録作成支援装置とを備えた、議事録作成支援システムであって、議事録作成支援装置は、各検出手段から取得する検出結果に基づいて、会議の参加者同士の会話が成立している状態を検知するための検知手段と、会議の参加者が発する音声を記録するための記録手段と、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段と、特定の音声を用いて会議の議事録を作成するための議事録作成手段とを含む。

【0025】

本発明に従った議事録作成用プログラムは、コンピュータ読取可能なプログラムであって、コンピュータを、会議の参加者同士の会話が成立している状態を検知するための検知手段、会議の参加者が発する音声を記録するための記録手段、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段、および、特定の音声を用いて会議の議事録を作成するための議事録作成手段として機能させる。

【発明の効果】

【0026】

会話が記録され、また、会話の成立状態が検知され、そして、成立が検知された結果に基づいて、記録された音声から特定の音声が抽出されて、議事録が作成される。

【0027】

これにより、会話が成立し、さらに、当該会話がどのように成立したかに応じて、議事録の作成に利用される音声が抽出される。

【0028】

これにより、会議において重要と考えられる音声を抽出して、議事録を作成することができる。

【図面の簡単な説明】

【0029】

【図1】本発明の一実施の形態である議事録作成支援システムの概略構成を示す図である。

【図2】議事録作成支援システムの機能構成の一例を模式的に示す図である。

【図3】会話収集デバイスの外観の一例を示す図である。

【図4】会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【図5】サーバーのハードウェア構成の一例を模式的に示す図である。

【図6】会議の風景の一例を模式的に示す図である。

【図7】本発明の一実施の形態において生成される会話状態の一例を模式的に示す図である。

【図8】本発明の一実施の形態において生成される各参加者の会話時間の一例を模式的に示す図である。

【図9】会話集中度の算出方法を説明するための図である。

【図10】図9に示された各者の発言のうち、抽出部によって抽出される発言に対応する音声データの内容を模式的に示す図である。

【図11】本発明の一実施の形態の議事録作成システムにおいて実行される議事録作成処理のフローチャートである。

【図12】会議ごとに予め登録されるタグ情報の一例を示す図である。

【図13】サーバーの表示デバイスに表示される画面の一例を示す図である。

【図14】議事録ファイルの表示例を示す図である。

【図15】各音声データにリンクする情報を表示するための画面の一例を示す図である。

【図16】会話収集デバイスの変形例の外観を示す図である。

【図17】図16の会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【図18】会話収集デバイスの他の変形例のハードウェア構成の一例を模式的に示す図である。

【図19】図15のリンクの表示画面の変形例を示す図である。

【図20】会話収集デバイスのさらに他の変形例のハードウェア構成の一例を模式的に示す図である。

【発明を実施するための形態】

【0030】

以下、本発明に係る議事録作成支援システムについて、図面を参照して説明する。なお、各図において、同様の作用および機能を奏する構成要素については、同じ符号を付し、その説明は繰返さない。

【0031】

[議事録作成システムの概略構成]

図1は、本発明の一実施の形態である議事録作成支援システムの概略構成を示す図である。

【0032】

図1を参照して、議事録作成支援システムは、各ユーザー(会議の参加者)が装着し、検出手段として機能する会話収集デバイス200A〜200Dと、会話収集デバイス200A〜200Dのそれぞれと通信し、議事録作成支援装置として機能するサーバー100とを含む。

【0033】

本明細書では、会話収集デバイス200A〜200Dを総称して「会話収集デバイス200」と呼ぶ場合もある。会話収集デバイスの数は、参加者と同数あっても良いし、それ以下であっても良い。つまり、会議の参加者全員が会話収集デバイスを装着していても良いし、一部の参加者のみが会話収集デバイスを装着していても良い。

【0034】

また、会話収集デバイスは、会議の参加者間で会話が成立している状態を検知するための情報を取得したり、参加者が発する音声(会話)を取得するための装置である。したがって、議事録作成支援システムでは、複数の参加者についてのこれらの情報を取得できる装置が備えられれば、参加者全員の情報を取得するためであっても、参加者と同数備えられる必要はなく、単数である場合も有り得る。

【0035】

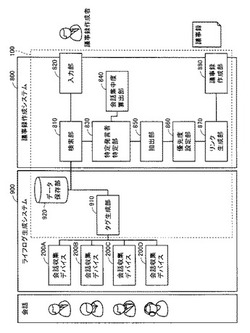

図2は、議事録作成支援システムの機能構成の一例を模式的に示す図である。

議事録作成支援システムは、ライフログ生成システム900と議事録作成システム800とから主に構成される。ライフログ生成システム900は、1以上の会話収集デバイス200と、タグ生成部910と、データ保存部920とを含み、会議中に当該会議の参加者のデータを取得して保存する機能を有する。タグ生成部910は、会議についてのタグ情報を生成する。

【0036】

会話収集デバイス200を介して取得された参加者のデータは、タグ生成部910において生成されたタグ情報とともに、データ保存部920に保存される。より具体的には、会話収集デバイス200は、各参加者の音声等の参加者自身の情報を取得する部分と、各参加者が誰と会話しているのかを特定するための情報を取得する部分とを有する。これらの情報は、会議終了後に検索が可能なように、会議に付されるタグ情報とともに、保存される。タグ生成部910は、タグ情報として、日時や図示しないスケジューラからの会議情報などを、タグ情報として付与する。ライフログ生成システム900では、このようにしてリアルタイムに生成された情報が、データ保存部920に保存される。

【0037】

議事録作成システム800は、検索部810と、入力部820と、特定発言者特定部830と、会話集中度算出部840と、抽出部850と、優先度設定部860と、リンク生成部870と、議事録作成部880とを含む。本実施の形態では、会話集中度算出部840は検知手段として機能し、特定発言者特定部830と会話集中度算出部840と抽出部850とは抽出手段として機能する。

【0038】

検索部810は、議事録作成の対象となる会議のタグ情報をデータ保存部920から検索する。入力部820は、議事録作成の指示等の情報の入力を受付ける。なお、入力部820は、議事録作成の指示を、ネットワークを介して、外部の装置から、受付ける場合も有り得る。なお、入力部820は、タグ情報を生成するための情報の入力を受付ける場合も有り得る。

【0039】

会話集中度算出部840は、会議の各参加者について、後述する会話集中度を算出する。特定発言者特定部830は、会議の参加者から、会話集中度等に基づいて、議事録の作成に発言を利用する参加者を特定する。抽出部850は、特定発言者特定部830が特定した参加者が関与する会話をデータ保存部920から抽出する。優先度設定部860は、会議の参加者に対して、議事録の作成に関しての優先度を設定する。リンク生成部870は、議事録ファイルのトップページから議事録を構成する音声データ等の各種のデータへのリンク情報を生成する。議事録作成部880は、上記したようなトップページとリンク情報とを関連付ける等により、議事録ファイルを作成する。

【0040】

[会話収集デバイスの構成]

図3は、会話収集デバイス200の外観の一例を示す図である。

【0041】

図3を参照して、会話収集デバイス200は、会議参加者が首からかけるIDカードタイプの形態を有している。会話収集デバイス200は、マイク201と赤外線送受信部202とを含む。マイク201は、装着者が発する音声を取得することができる。

【0042】

会話収集デバイス200の内部には、メモリー(後述する記憶部260)を含む。当該メモリーには、装着者を区別することができるように、各会話収集デバイス200を特定するための個別IDが保存されている。議事録作成支援システムでは、当該個別IDと、たとえば図示しない社内人事DBとを連携させることにより、各会話収集デバイス200のマイク201で検出された音声データが、誰の音声データであるかを区別することができる。

【0043】

赤外線送受信部202は、上記メモリーに保存されている個別IDをコード化して、赤外線で送信している。また、赤外線送受信部202は、他の会話収集デバイス200の赤外線送受信部202が送信した個別IDを受信できる。

【0044】

議事録作成支援システムでは、会話収集デバイス200において他の個別IDが受信されたことにより、当該会話収集デバイス200を装着している参加者が、個別IDを受信された会話収集デバイス200を装着している参加者と対面していることが検知される。

【0045】

図4は、会話収集デバイス200のハードウェア構成の一例を模式的に示す図である。

図4を参照して、会話収集デバイス200は、当該端末の動作を全体的に制御する演算装置によって構成されるCPU(Central Processing Unit)251と、RAM(Random Access Memory)252と、ROM(Read Only Memory)253と、通信装置254と、記憶部260とを含む。

【0046】

RAM252は、CPU251がプログラムを実行する際のワークエリアとして機能する。通信装置254は、たとえばLAN(Local Area Network)カード、LANアダプタ等のネットワーク通信機器からなる。なお、会議中等にデータをサーバー100に送信する場合は、無線LANカードや、Bluetooth(登録商標)チップセット等の非接触での通信機能を有することが望ましい。会話収集デバイス200は、通信装置254を介して、サーバー100へ接続される。

【0047】

記憶部260は、CPU251が実行するプログラムを記憶するプログラム記憶部261と、種々のデータを記憶するデータ記憶部262とを含む。なお、記憶部260は、会話収集デバイス200の本体から着脱可能な記録媒体によって構成されても良い。記憶媒体としては、CD−ROM(Compact Disc - Read Only Memory)、DVD−ROM(Digital Versatile Disk - Read Only Memory)、USB(Universal Serial Bus)メモリ、メモリカード、FD(Flexible Disk)、ハードディスク、磁気テープ、カセットテープ、MO(Magnetic Optical Disc)、MD(Mini Disc)、IC(Integrated Circuit)カード(メモリカードを除く)、光カード、マスクROM、EPROM、EEPROM(Electronically Erasable Programmable Read-Only Memory)などの、不揮発的にプログラムを格納する媒体が挙げられる。

【0048】

[サーバーの構成]

図5は、サーバー100のハードウェア構成の一例を模式的に示す図である。

【0049】

図5を参照して、サーバー100は、当該サーバー100の動作を全体的に制御する演算装置によって構成されるCPU151と、RAM152と、ROM153と、通信装置154と、表示ドライバー155と、表示デバイス156と、入力部157と、記憶部160とを含む。

【0050】

通信装置154は、たとえばLANカード、LANアダプタ等のネットワーク通信機器からなる。なお、会議中等にデータを会話収集デバイス200から受信する場合は、無線LANカードや、Bluetooth(登録商標)チップセット等の非接触での通信機能を有することが望ましい。サーバー100は、通信装置154を介して、会話収集デバイス200と通信する。

【0051】

表示デバイス156は、液晶表示デバイスなどから構成される。表示ドライバー155は、CPU151が適切なプログラムを実行することによって生成した情報に基づいて、表示デバイス156において表示させるための画像情報を生成する。表示ドライバー155は、図5に示されたようにハードウェアとして設けられていてもよいし、CPU151が適切なプログラムを実行することによって、ソフトウェアとして設けられてもよい。

【0052】

入力部157は、たとえば、タッチセンサ、キーボード、マウスなどの入力装置によって実現される。

【0053】

記憶部160は、CPU151が実行するプログラムを記憶するプログラム記憶部161と、サーバー100が本実施の形態において説明される機能を実現するために必要とされる種々のデータを記憶するデータ記憶部162とを含む。

【0054】

議事録作成支援システムにおいて、図2に破線で囲んで示したライフログ生成システム900のタグ生成部910、データ保存部920、および議事録作成システム800の各構成要素は、たとえばサーバー100によって実現される。タグ生成部910、検索部810、特定発言者特定部830、会話集中度算出部840、抽出部850、優先度設定部860、リンク生成部870、および、議事録作成部880は、たとえばCPU151が適切なプログラムを実行することによって、実現される。データ保存部920は、たとえば記憶部260によって実現される。入力部820は、たとえば入力部157や通信装置154によって、実現される。

【0055】

[会話成立の検出]

次に、議事録作成支援システムにおいて、参加者同士の会話の成立がどのように検出されるかについて、説明する。

【0056】

図6は、会議の風景の一例を模式的に示す図である。

図6を参照して、会議には、参加者300A〜300Fの6人が参加している。なお、図6は、長机の周りに座る6人の参加者300A〜300Fを上方から見た図に相当する。そして、参加者300A〜300Fは、各自会話収集デバイス200(会話収集デバイス200A〜200F)を装着している。なお、図6では、理解を容易にするため、会話収集デバイス200A〜200Fが参加者300A〜300Fに対して大きめに記載されている。

【0057】

会話収集デバイス200の赤外線送受信部202は、指向性が高い。そして、各会話収集デバイス200の赤外線送受信部202は、他の会話収集デバイス200の赤外線送受信部202と対向する状態となって初めて当該他の会話収集デバイス200の赤外線送受信部202と通信可能になる。

【0058】

図6では、参加者300Aと参加者300Dが対向することにより、会話収集デバイス200Aと会話収集デバイス200Dが対向し、これにより、赤外線送受信部202Aと赤外線送受信部202Dが矢印R1で示されるような経路に沿って通信可能になる。会話収集デバイス200Aは、赤外線送受信部202Aが赤外線送受信部202Dの個別IDを受信したことを、受信した時刻情報とともにデータ保存部920へ送信する。また、会話収集デバイス200Dは、赤外線送受信部202Dが赤外線送受信部202Aの個別IDを受信したことを、受信した時刻情報とともにデータ保存部920へ送信する。

【0059】

会話集中度算出部840は、同じ時刻に、互いに相手の個別IDを受信した会話収集デバイス200の組が存在するか否かを判断する。そして、そのような組が存在すると判断すると、当該の組の双方に対応する参加者の間で、会話が成立していると判断する。つまり、たとえば、上記の検出例によれば、会話集中度算出部840は、会話収集デバイス200Aに対応する参加者と会話収集デバイス200Dに対応する参加者との間で、会話が成立していると判断する。

【0060】

会話集中度算出部840は、上記のように、いつ、どの参加者の間で、会話が成立しているかを検出できる。これにより、会話集中度算出部840は、会議における、参加者の会話状態の時間変化を表す情報を生成できる。図7は、生成される会話状態の一例を模式的に示す図である。

【0061】

図7の会話状態では、ST1〜ST10の会話(発話)部分が示されている。

図7に示された会議では、Aさん、Bさん、Cさん、Dさんの4人の参加者が示されている。ST1は、Aさんと、Bさん、Cさん、および、Dさんのそれぞれとの間で短時間ずつ会話が成立した状態を示す。

【0062】

ST2は、AさんとBさんの間で会話が成立し、かつ、BさんからAさんに話しかけている状態を示す。会話が成立した参加者の間で、どちらからどちらに話しかけているかは、両者のいずれのマイク201で音声が取得されたかによって判断される。つまり、図7では、ST2の期間中、Bさんの装着する会話収集デバイス200のマイク201において音声が検出されたことを示している。

【0063】

なお、会話集中度算出部840は、マイク201によって取得された音声データに対して、所定の音量のフィルタを用いて、取得された音声から環境音を分離して、会話収集デバイス200を装着した者が声を出したか否かを判断することが好ましい。さらに、会話集中度算出部840は、各会話収集デバイス200を装着した者の音声データをサンプルとして取得し、当該者の声と同定できる音声データが検出された期間のみ、当該者が発言した期間と判断しても良い。

【0064】

ST3は、AさんとBさんの間で会話が成立し、かつ、AさんからBさんに話しかけている状態を示す。ST4とST5は、CさんとDさんの間で会話が成立し、かつ、CさんからDさんへの発言とDさんからCさんへの発言が交互に頻繁に行なわれた状態を示す。ST6とST7は、BさんとDさんの間で会話が成立し、かつ、BさんからDさんへの発言とDさんからBさんへの発言とが交互に頻繁に行なわれた状態を示す。ST8は、AさんとCさんの間で会話が成立し、かつ、CさんからAさんに話しかけている状態を示す。ST9は、AさんとCさんの間で会話が成立し、かつ、AさんからCさんに話しかけている状態を示す。ST10は、AさんとBさんの間で会話が成立し、かつ、BさんからAさんに話しかけている状態を示す。

【0065】

会話集中度算出部840は、各会話収集デバイス200で取得され、データ保存部920に保存された情報に基づいて、図7に示されたような会話状態とともに、図8に示されるような、各参加者の会話時間を算出することができる。

【0066】

図8は、生成される各参加者の会話時間の一例を模式的に示す図である。

図8では、Aさん、Bさん、Cさん、Dさんのそれぞれについて、誰から誰に、どのぐらいの長さ、発言をしたかが示されている。図8において示された例は、図7に示された会議とは別の会議における会話時間が示されているものとする。そして、図8では、ある会議についての、各参加者の、各相手に対する発言の時間の和が示されている。つまり、たとえば、AさんからBさんへの当該会議中の発言時間の合計時間は、3分である。また、BさんからAさんへの当該会議中の発言時間の合計時間は、2分である。本明細書では、会話時間とは、参加者間で会話が成立した時間を意味する。つまり、2者間で言えば、発言を行なった時間と発言を受けた時間の和とする。たとえば図8の例では、AさんとBさんの間での会話時間は5分である。このうち、Aさんについては、(Bさんに対して)発言を行なった時間は3分である。また、(Bさんから)発言を受けた時間は2分である。

【0067】

また、本明細書では、一方の参加者から他方の参加者へ発言が行なわれた時間を、一方の参加者の発話時間と呼ぶ場合がある。さらに、一方の参加者から他方の参加者へ発言が行なわれた時間を、他方の参加者の着話時間と呼ぶ場合がある。

【0068】

本実施の形態では、会話集中度算出部840は、ある会議の各参加者について、会話の相手、発言をした時間、および、発言を受けた時間が特定されることにより、図9に示されるようなマトリクスを作成し、これに基づいて、当該会議における各参加者の会話集中度を算出することができる。図9は、会話集中度の算出方法を説明するための図である。

【0069】

図9には、会議の参加者として、「田中」「伊藤」「井上」「石田」「佐藤」「小林」の6人が挙げられている。そして、図9における上部の表には、各参加者の発話時間と着話時間が分単位で示されている。縦方向に、各参加者の、各参加者に対する発話時間が示されている。たとえば、井上さんについては、田中さんに対する発話時間は3分であり、伊藤さんに対する発話時間は0分であり、井上さん自身に対する発話時間は0分であり、石田さんに対する発話時間は1分であり、佐藤さんに対する発話時間は0分であり、小林さんに対する発話時間は0分である。

【0070】

会話集中度算出部840は、全参加者の発話時間の合計を算出する。図9の例では、27分である。

【0071】

また、会話集中度算出部840は、全参加者の発話時間の合計を算出する。図9の例では、田中さんについては9分であり、伊藤さんについては3分であり、井上さんについては4分であり、石田さんについては7分であり、佐藤さんについては3分であり、小林さんについては1分である。

【0072】

また、会話集中度算出部840は、各参加者の着話時間の合計を算出する。図9の例では、田中さんについては10分であり、伊藤さんについては3分であり、井上さんについては4分であり、石田さんについては5分であり、佐藤さんについては3分であり、小林さんについては2分である。

【0073】

また、会話集中度算出部840は、各参加者の発話集中度を算出する。発話集中度とは、全参加者の発話時間の合計に対する各参加者の発話時間の割合である。図9の例では、田中さんについては0.33であり、伊藤さんについては0.11であり、井上さんについては0.15であり、石田さんについては0.26であり、佐藤さんについては0.11であり、小林さんについては0.04である。

【0074】

また、会話集中度算出部840は、各参加者の着話集中度を算出する。着話集中度とは、全参加者の発話時間の合計に対する各参加者の着話時間の割合である。図9の例では、田中さんについては0.37であり、伊藤さんについては0.11であり、井上さんについては0.15であり、石田さんについては0.19であり、佐藤さんについては0.11であり、小林さんについては0.07である。

【0075】

また、会話集中度算出部840は、各参加者の会話集中度を算出する。会話集中度とは、発話集中度と着話集中度の和である。図9の例では、田中さんについては0.7である。田中さんであれば、発話時間の総和は9分、着話時間の総和は10分である。また、会議全体の発話時間の合計は27分である。したがって、田中さんの会話集中度は、「(9+10)/27」に従って、約0.7と算出される。また、伊藤さんについては0.22であり、井上さんについては0.3であり、石田さんについては0.45であり、佐藤さんについては0.22であり、小林さんについては0.11である。

【0076】

[音声データの抽出]

本実施の形態では、特定発言者特定部830は、各参加者の会話集中度に基づいて、当該会議における特定発言者を特定する。特定発言者とは、当該会議における中心的な参加者と考えられる。図9の例では、会話集中度が最も高い田中さんが、特定発言者として特定される。

【0077】

そして、本実施の形態では、抽出部850は、データ保存部920に保存された会話の音声データから、特定発言者がした発言の音声データおよび特定発言者が受けた発言の音声データを、当該会議における重要な発言として抽出する。図9の例では、田中さんが各参加者に対してした発言と田中さんが受けた発言の音声データが抽出される。図10は、図9に示された各者の発言のうち、抽出部850によって抽出される発言に対応する音声データの内容を模式的に示す図である。

【0078】

なお、図9に示された会議では、実際に重要であった発言は、太枠で囲われた、石田さんから田中さんに対する発言(合計3分間)と、佐藤さんから田中さんに対する発言(合計2分間)と、田中さんから石田さんに対する発言(合計3分間)であったとする。図10に示された結果によれば、図9において重要であると示された発言は、すべて、抽出されている。

【0079】

[議事録作成処理]

図11は、議事録作成システムにおいて実行される議事録作成処理のフローチャートである。議事録作成処理は、たとえばサーバー100にインストールされた議事録作成アプリケーションとして実現される。

【0080】

議事録作成処理では、まずステップSA10において、入力部820が、ユーザーによる議事録を作成する会議に関する情報の入力を受付ける。具体的には、会議名、会議の日時、会議の開催場所、会議の参加者等の必要なプロパティーが、ユーザーによって入力される。

【0081】

なお、サーバー100には、たとえば図12に示されるように、予め、タグ情報として、会議に関する情報(日時、場所、参加者、等)が登録される。そして、ステップSA10では、入力部820は、登録された会議に関する情報の中から会議を指定する情報の入力を受付けて、ステップSA20へ処理を進める。

【0082】

図12は、会議ごとに予め登録されるタグ情報の一例を示す図である。

図12を参照して、データ保存部920には、各会議の情報として、会議ID、開始日時、終了日時、場所、参加者(参加者ID)、目的、および、会議形態が登録されている。会議IDは、会議を識別するための情報であり、会議ごとに固有の値が設定される。開始日時は、会議の開始の時刻を特定する情報である。終了日時は、会議の終了の時刻を特定する情報である。また、場所、参加者、および、目的は、それぞれ、会議の場所、参加者、および、目的を特定する情報である。特に、参加者については、たとえば参加者IDで特定される。なお、本実施の形態では、各参加者IDは、各参加者が装着する会話収集デバイス200の個別IDに関連付けられている。

【0083】

会議形態としては、「自己想定」と「システム評価」の2種類の情報が格納される。「自己想定」は、たとえば管理者等によって入力される情報であり、「システム評価」は、たとえば、図7を参照して説明したような会話状態等に基づいて判定される評価内容である。たとえば、会話状態が、ある特定の参加者の会話集中度が高く、他の参加者の会話集中度がある程度低い値である場合には、「質疑応答型」と判定される。また、たとえば、ある特定の参加者の会話集中度が特に高く、残りの参加者の会話集中度がほぼ0に近い値である場合には、「通知通達型」と判定される。また、たとえば、参加者の会話集中度がまんべんなく同じような値である場合には、「対話型」等の判定がなされる。

【0084】

ステップSA20では、会話集中度算出部840は、データ保存部920から、ステップSA10で指定された会議のライフログ(音声データ)を検索して、ステップSA30へ処理を進める。

【0085】

たとえば、会議が指定されると、図12に示されているように、当該会議に対応する開始日時、終了日時、および、参加者IDが特定される。たとえば、図12においてC1で示された会議(会議IDが「POE−0003」)が指定されると、当該会議に対応する開始日時(2011年8月27日10時00分)、終了日時(2011年8月27日11時10分)、参加者ID(10201,10850,10430,および,8431)が特定される。

【0086】

会話集中度算出部840は、特定されたこれらの情報に基づいて、開始日時から終了日時までの、参加者IDが行なった発言または受けた発言のすべての音声データを、データ保存部920に登録されている音声データから検索する。

【0087】

以下、より具体的に説明する。図13は、サーバー100の表示デバイス156に表示される画面の一例を示す図である。会議を指定する情報が入力されると、検索部810は、図13の画面500に示すように、当該指定された会議のタグ情報を表示する。そして、ユーザー(たとえば、議事録作成担当者)は、タグ情報を確認し、当該会議についての議事録の作成を進めることを希望する場合には、さらに、画面500内のリンク作成ボタン501を操作する。当該操作に応じて、検索部810は、上記したように、当該会議のタグ情報によって特定される音声データを、検索する。

【0088】

つまり、ステップSA20の処理によれば、会議の出席者について記録されたすべての音声データが、検索結果となる。

【0089】

なお、タグ情報における会議の場所に基づいて、当該会議の場所から接続される無線LANが特定されても良い。そして、このように特定されたLANにおいて、開始日時から終了日時まで取得(当該LANのサーバーに登録)された音声データが、ステップSA20の検索結果とされる場合も有り得る。

【0090】

次に、ステップSA30では、会話集中度算出部840は、ステップSA20で検索結果として得られた音声データを利用して、当該会議について、図7や図8を参照して説明したような会話状態(参加者間の有向グラフ)を作成して、ステップSA40へ処理を進める。

【0091】

ステップSA40では、会話集中度算出部840は、図9を参照して説明したように、各参加者の会話集中度を算出して、ステップSA50へ処理を進める。

【0092】

ステップSA50では、特定発言者特定部830は、ステップSA40で算出した各参加者の会話集中度に基づいて、特定発言者を特定して、ステップSA60へ処理を進める。

【0093】

ステップSA60では、抽出部850は、ステップSA20の検索結果から、特定発言者が行なった発言と特定発言者に対する発言に対応する音声データを抽出して、ステップSA70へ処理を進める。

【0094】

ステップSA70では、リンク生成部870が、ステップSA60で抽出した音声データのそれぞれにリンクするためのリンクデータを生成し、さらに、議事録作成部880が、図13の画面500のような議事録の作成対象となっている会議についての画面データに、作成されたリンクデータを追加することにより、議事録ファイルを作成して、議事録作成処理を終了する。

【0095】

図14は、議事録ファイルの表示例を示す図である。

図14を参照して、議事録ファイルは、画面510のような表示画面のデータを含む。画面510では、対象となる会議の日時、場所、参加者、および、データリンクを含む。画面510は、図13の画面500に、データリンクが追加された画面である。日時、場所、参加者は、図12に示されたようなタグ情報から取得される。

【0096】

画面510では、会話が成立した参加者の組別のリンクが表示されている。なお、リンクは、下線を付されて表示されている。また、画面510のデータリンクにおける参加者の組の表示の順序は、たとえば会話時間の長い順序とすることができる。つまり、画面510は、田中さんと石田さんの組の会話が、会話時間(石田さんとの会話についての、田中さんの発話時間と着話時間の和)の最も長い組である場合を示している。

【0097】

なお、データ保存部920では、音声データは、会話が一区切りされるごとに、異なるファイルとして登録されている。具体的には、会話収集デバイス200のCPU251(図4参照)は、マイク201から入力される音声について、所定時間以上の無音期間(または、特定のレベル未満の音声期間)が出現するごとに、異なるファイルで、音声データを生成する。そして、画面510にデータリンクとして表示された各参加者の組のうち、ある組を指定すると、当該組の会話の音声データのそれぞれにリンクする情報が表示される。図15は、各音声データにリンクする情報を表示するための画面の一例を示す図である。

【0098】

図15を参照して、画面520では、田中さんと石田さんの会話の各音声データへのリンクが、当該音声データが取得された時刻を含むように表示されている。サーバー100では、各リンクが選択されると、当該リンクに対応した時刻に記録された音声データが、再生される。なお、ここでいう時刻は、たとえば、音声の取得が開始された時刻である。なお、画面520では、音声データが取得された時刻の順ではなく、たとえば各音声データの再生時間が長い順等、対応する音声データの性質等が所定の条件に従ってソートされて、表示されている。

【0099】

図14に戻って、画面510では、「そのほかの発言」という文字によって示されるリンクを含む。このリンクは、当該会議において、会話時間の長い順から特定の順序以下の組の発言の音声データに対応する。このようなリンクが選択されると、たとえば、表示デバイス156には、「そのほかの発言」に分類された参加者の組の会話の各音声データへのリンクが表示される。そして、そこに表示された各リンクが選択されると、サーバー100では、当該リンクに対応した音声データが再生される。

【0100】

以上説明した議事録作成処理によれば、図6〜図9等を参照して説明したように、会議における会話の成立に関する状態を検知し、当該検知の結果に基づいて、記録された音声データから音声データを抽出し、議事録の作成に利用される。

【0101】

これにより、会議で取得された音声すべてではなく、会議において重要と考えられる音声が抽出されて、議事録の作成に利用される。

【0102】

[変形例等]

(変形例1)

以上説明した本実施の形態において、「会議」とは、議事録の作成対象を言うのであって、特別に集合することを予定されたイベントに限られるものではない。たとえば、オフィスにおいて、当該オフィスにいると想定される人を特定する情報が参加者IDとして特定され、また、オフィスにいる各ユーザーが図3等を参照して説明された会話収集デバイス200を装着し、そして、当該オフィスにおける日常会話が記録された場合にも、本実施の形態によって開示された技術的思想は適用され得る。

【0103】

(変形例2)

会話収集デバイス200によって検出手段の一例が構成される。なお、会話収集デバイスは、図3等を参照して説明されたような形態のものに限定されない。図16は、会話収集デバイスの変形例の外観を示す図である。また、図17は、図16の会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【0104】

図16および図17を参照して、会話収集デバイス210は、図4を参照して説明した構成に対して、マイク201と赤外線送受信部202の代わりに、マイク211とカメラ212を含む。

【0105】

会話収集デバイス210では、カメラ212は、会話収集デバイス210を装着している会議の参加者の視線の先に存在するものを撮影する。したがって、会話集中度算出部840は、カメラ212が撮影する画像を既知の顔判別アルゴリズムに従って解析することにより、当該会話収集デバイス210を装着している参加者が誰を見ているのかを特定することができる。

【0106】

さらに、会話集中度算出部840は、上記顔判別アルゴリズムと合わせて、上記画像を解析することによって、会話収集デバイス210を装着している参加者が頷いているか否かを判別することができる。当該判別結果をさらに用いることにより、既知のうなずき理論(岡山県立大学情報システム工学科、渡辺富夫教授の「身体的引き込み技術iRT」等)に基づいて、会話収集デバイス210を装着している参加者が頷いているときに見ている相手を会話の相手と特定するなど、参加者の会話の相手を、より高い精度で、特定することができる。

【0107】

また、会話収集デバイス210では、カメラ212がテレビ画面に映った相手を撮影することができる。したがって、会話収集デバイス210において収集される情報は、遠隔地とのテレビ会議においても、会話相手の特定に利用することができる。

【0108】

(変形例3)

図18は、会話収集デバイス200の他の変形例のハードウェア構成の一例を模式的に示す図である。

【0109】

本変形例では、会話収集デバイス200は、図4に示された構成に加えて、生体情報検出部203を備える。生体情報検出部203は、会話収集デバイス200を装着したユーザーの心拍数、熱、および/または、皮膚の導電性などの生体情報(バイタルデータ)を検出するためのセンサーである。会話収集デバイス200を装着する参加者は、さらに、当該センサーを、当該センサーが取得するべきデータを取得できる態様で、装着する。

【0110】

そして、本変形例では、データ保存部920には、音声データとともに、当該音声データを発した参加者および/または当該音声データの発言を受けた参加者の生体情報も記録される。

【0111】

このように記録された生体情報は、当該音声データに対応する発言がどのような感情で発せられたか、あるいは、会話相手にどのぐらいのインパクトを与えたかなど、会話の内容や重要度の特定をサポートする情報となり得る。特に、心拍間隔時系列データのパターンから、プレゼンテーションや質疑の区間を識別する研究(「脈拍数を用いた平常/非平常(眠気,緊張)推定方法」NTT)もある。したがって、上記したような生体情報が記録されることにより、会話状態の検知の精度を向上させることができる。

【0112】

さらに、上記のように記録された生体情報は、会話状態の検知だけでなく、会話の重要度の特定にも利用できる。たとえば、音声データが取得されたときの発言者の心拍数が、当該発言者の定常時の心拍数に対して特定の割合以上上昇している場合には、緊張した状態での発言と考えられる。そのことが分かるように、当該音声データのリンクが表示されても良い。図19は、図15のリンクの表示画面の変形例を示す図である。図19に示された画面530では、10時50分の発言のリンクと10時44分の発言のリンクが、ハートマークを付されて、表示されている。当該ハートマークは、発言した参加者が、上記したような緊張状態で対応する発言を行なったことを示す。

【0113】

緊張状態での発言は、重要な内容である可能性が比較的高いと言える。議事録ファイルを再生するユーザーは、このようなハートマークの表示に従って、重要な内容である可能性が比較的高い音声ファイルを優先して再生させることにより、会議の内容を、より早期に把握することが可能となる。

【0114】

(変形例4)

図20は、会話収集デバイス200のさらに他の変形例のハードウェア構成の一例を模式的に示す図である。図20の会話収集デバイス220は、図4を参照して説明した会話収集デバイス200に対して、赤外線送受信部202の代わりに、電子コンパス204とGPS(Global Positioning System)コントローラー205を含む。

【0115】

電子コンパス204は、磁気センサーを含み、会話収集デバイス220の向きを検出する。GPSコントローラー205は、GPS信号または基地局からの位置信号を受信することにより、会話収集デバイス220の位置情報を取得する。

【0116】

本変形例では、データ保存部920において、(赤外線送受信部202によって取得される個別IDの代わりに)会話収集デバイス220の位置情報と向き情報が登録される。これにより、議事録作成支援システムでは、データ保存部920において、各参加者(会話収集デバイス220を装着しているユーザー)の位置情報と向き情報が取得される。これにより、各ユーザーの位置と向きを特定できる。これにより、近傍(所定の距離範囲内)に位置し、かつ、向かい合っているユーザーの組を特定できる。そして、会話集中度算出部840は、当該組において、一方のユーザーの装着する会話収集デバイス220のマイク201において音声が検出されたことを条件として、当該組のユーザーの間で会話が成立していると特定することができる。

【0117】

(変形例5)

以上説明した本実施の形態において、参加者ごとに重みの値が設定されることによる重み付けがなされ、特定発言者特定部830は、当該重み付けをさらに利用して、特定発言者を特定することができる。

【0118】

重み付けによって付される重みの値としては、たとえば、職場における人事情報が利用される。つまり、管理職の人間は、職場における多くの決定権を有するため、会議において影響力の大きい発言をすることが多い。たとえば、部長の職にある参加者は、他の参加者と比較して2倍の重み値を有するとする。特定発言者特定部830は、各参加者の会話集中度と各参加者に付された重み値との積を算出し、当該算出結果が最も大きい値となった参加者を特定発言者と決定することができる。

【0119】

また、会議の議題等に応じて、会議ごとに、各参加者に付される重みの値が変更される場合も有り得る。

【0120】

(変形例6)

会話集中度算出部840が特定発言者の特定の際に利用される重みの値は、発言が生じた時間帯に応じて設定される場合も有り得る。たとえば2時間の会議では、後半1時間における発言は、前半1時間における発言よりも、会議の場が成熟している等の理由によって重要度が高い場合がある。そこで、図9を参照して説明したような着話時間や発話時間の算出の際に、たとえば、後半1時間における発言についての着話時間および発話時間の長さは1.5倍されて、会話集中度の算出に利用されても良い。なお、この場合、前半1時間における発言についての着話時間および発話時間の長さは、実際の時間のままとされる。

【0121】

これにより、発言が生じた時間帯に応じて、音声データに重みを付けて、特定発言者の特定を行なうことができる。また、発言が生じた時間帯に応じて、発言をした参加者に、当該参加者の音声が議事録に利用される際の優先度を付することができる。

【0122】

(その他の変形例等)

ブレインストーミングのような、意見交換型会議は、議事録を作成されることは少なく、その場で出たアイデアがその場でまとめられる場合が多い。したがって、その場で利用されたホワイトボード上の画像や、会議中に付加情報(ポストイット)を付された時点の情報を参照することが主と考えられる。

【0123】

ただし、意見交換型会議においても、ファシリテーターが皆無ということはなく、特定発言者(主発言者)を見出すことはできる。最終的に、意見交換型会議においてもまとめがファシリテーターによってなされるケースがある。したがって、主発言者の発言とその主発言者に向けてなされた音声をリンクさせることは、意見交換型会議においても役立つと考えられる。

【0124】

なお、本明細書において説明された議事録作成支援システムは、会議中であっても、会議後であっても、議事録ファイルを作成できる。会議中であれば、それまでの会話からリンクが生成され、順次会話が進むことでリンクが更新されていく。

【0125】

本明細書において説明された議事録作成支援システムは、会話集中度から、議事録の作成にとって重要な情報(音声データ)を取り出し、リンクを作成する。

【0126】

これにより、議事録ファイルを参照するユーザーは、会議において記録されたすべての情報(音声データ)をたぐることなく、議事録の元データを参照することができる。

【0127】

なお、議事録作成支援システムにおいて取得される会話集中度は、次の用途にも活用できる。

【0128】

・各自の会話集中度の比較をして、参加者間で議論ができているかどうかのチェック

・会話中集度から重要な発言を取り出して、セキュリティ(読取属性の変更や暗号化)をかける

・会議前に設定したファシリテーターのスキルチェック(自分で話しているだけか、議論を活性化させているか)

・主発言者と関わりのない発言は、記録として不必要なので削除、あるいは難読化(暗号化やデータ分割など)を施すことよる、データの圧縮、議論と関係のないおしゃべりなどの削除、および/または、プライバシーの保護

今回開示された各実施の形態はすべての点で例示であって制限的なものではないと考えられるべきである。本発明の範囲は上記した説明ではなくて特許請求の範囲によって示され、特許請求の範囲と均等の意味および範囲内でのすべての変更が含まれることが意図される。また、実施の形態および各変形例において説明された発明は、可能な限り、単独でも、組合わせても、実施することが意図される。

【符号の説明】

【0129】

100 サーバー、200,200A〜200F 会話収集デバイス、201,211 マイク、202 赤外線送受信部、203 生体情報検出部、204 電子コンパス、205 GPSコントローラー、212 カメラ、800 議事録作成システム、900 ライフログ生成システム。

【技術分野】

【0001】

本発明は、議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムに関し、特に、重要な発言が抽出できる議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムに関する。

【背景技術】

【0002】

従来から、議事録の作成について、種々の技術が開示されている。

たとえば、特許文献1(特開2007−215053号公報)には、会議中に議事録を作成する技術が開示されている。特許文献1に記載の技術によれば、議事録作成開始と共に、それを重要な発言の開始時刻と設定し、会議終了時間をもって重要な発言の終了とする。

【0003】

また、非特許文献1("VoiceGraphy−製品概要"、[online]、日本電気株式会社、[平成23年9月21日検索]、インターネット<http://www.nec.co.jp/soft/VoiceGraphy/outline.html>)では、音声認識でテキスト化して議事録が生成される。

【0004】

また、非特許文献2("ディスカッションマイニングプロジェクト"、[online]、名古屋大学大学院情報科学研究科メディア科学専攻、[平成23年9月21日検索]、インターネット<http://www.nagao.nuie.nagoya-u.ac.jp/projects/discussion.xml>)では、複数のカメラ、マイク、および、ブラウザベースのツールを用いて、実世界の活動(たとえば、会議)の様子が収録される。発表者は、専用のツールを用いて、自分が発表に用いるスライドやスライドを切替えるタイミングなどを伝達することで、自動的に、これらの情報が議事録に記録される。また、発言内容は、書記が専用ツールを用いることによって記録される。具体的には、参加者が発言する際には、議論札と呼ばれる札型のデバイスを用いることで、発言者のIDと発言タイプ(質問、回答、コメント)が書記に伝達され、書記の議事録作成が支援されるとともに、議論の構造化が補助される。このようなシステムでは、使用したスライド、Web資料のURL(Uniform Resource Locator)などの情報も自動的に議事録に取り込まれ、半自動的に、議論自体が、構造化された議事録を生成する仕組みになっている。

【0005】

なお、イベントなどにおける参加者間の会話を記録する技術としては、非特許文献3("ビジネス顕微鏡(登録商標)とは"、[online]、株式会社日立製作所、[平成23年9月21日検索]、インターネット<http://www.hitachi-hitec.com/jyouhou/business-microscope/solution/microscope.html>)において、ビジネス顕微鏡という技術が開示されている。当該技術では、IDカード型のセンシング装置が利用される。当該装置は、マイクを備え、対面センサを内蔵している。このマイクは、当該装置を装着したユーザーの声や環境音を捉える。また、対面センサは、対面した人が装着するIDカード型のセンシング装置と通信することにより、対面した人を特定する。

【先行技術文献】

【特許文献】

【0006】

【特許文献1】特開2007−215053号公報

【非特許文献】

【0007】

【非特許文献1】"VoiceGraphy−製品概要"、[online]、日本電気株式会社、[平成23年9月21日検索]、インターネット<http://www.nec.co.jp/soft/VoiceGraphy/outline.html>

【非特許文献2】"ディスカッションマイニングプロジェクト"、[online]、名古屋大学大学院情報科学研究科メディア科学専攻、[平成23年9月21日検索]、インターネット<http://www.nagao.nuie.nagoya-u.ac.jp/projects/discussion.xml>

【非特許文献3】"ビジネス顕微鏡(登録商標)とは"、[online]、株式会社日立製作所、[平成23年9月21日検索]、インターネット<http://www.hitachi-hitec.com/jyouhou/business-microscope/solution/microscope.html>

【発明の概要】

【発明が解決しようとする課題】

【0008】

近年、ライフログという、ある程度コマ切りになった音声データ、その場(会議等の場)で作成した文書、ホワイトボードの画像など、多様で雑多な情報をすべて保存し、活用するような仕組みが提案されている。このようなライフログを利用して、人の行動パターンを抽出し、それをマーケティングにつなげるシステムの利用も種々検討されている。

【0009】

会議等のイベントの議事録の作成としては、上記のようなライフログから、当該イベントにとって重要な部分が抽出されることが有益であると考えられる。議事録作成担当者が、イベント全体を観察し、または、イベント全体が記録されたもののみが残された場合にその記録物から、手作業で、議事録を作成するのは手間と時間を要するからである。

【0010】

しかしながら、特許文献1に記載の技術によれば、重要な発言の出現のタイミングが会議開始時刻に対応して設定されるが、このような方法では重要な発言を記録できない場合も考えられる。さらに、会議中に議事録を作成することを前提としており、あとから作成することができない。したがって、会議後に議事録の作成が必要となった場合に、対応できない。

【0011】

また、非特許文献1に記載の技術によれば、イベント中の発言の一覧表を得ることはできるが、重要な部分の抽出という点が考慮されていない。

【0012】

また、非特許文献2に記載の技術によれば、イベント中に生じた議論を構造化して解析することはできるが、発言者による札型のデバイスの操作を要し、参加者にとって煩雑となる。また、発言者がデバイスの操作を忘れて発言を行なった場合には、議事録作成の対応ができなくなる。さらに、議事録の作成対象が日常の業務における会話といった参加者が特別な意識を持たない場面での適用も難しいと考えられる。

【0013】

また、非特許文献3に記載の技術によれば、ユーザー間の相関図が作成されたりするものの、イベントの重要な部分の抽出という点については検討がなされていない。

【0014】

本発明は係る実情に鑑み考え出されたものであり、その目的は、会議の重要な部分を抽出して議事録を作成することができる議事録作成支援装置、議事録作成支援システム、および、議事録作成用プログラムを提供することである。

【課題を解決するための手段】

【0015】

本発明に従った議事録作成支援装置は、会議の参加者同士の会話が成立している状態を検知するための検知手段と、会議の参加者が発する音声を記録するための記録手段と、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段と、特定の音声を用いて会議の議事録を作成するための議事録作成手段とを備える。

【0016】

好ましくは、抽出手段は、会議の参加者のそれぞれについて、検知手段によって会話が成立したと判断された時間を積算して合計会話時間を算出し、各参加者についての合計会話時間に基づいて、会議における主発言者を特定し、記録手段が記録した音声から、主発言者が含まれる会話の音声を、特定の音声として抽出する。

【0017】

好ましくは、抽出手段は、すべての参加者についての合計会話時間に対する各参加者の合計会話時間の比を算出することによって、各参加者の会話集中度を算出し、各参加者の会話集中度に基づいて、最も会話集中度の高い参加者を主発言者として決定し、記録手段が記録した音声から、主発言者が含まれる会話の音声を、特定の音声として抽出する。

【0018】

好ましくは、記録手段は、各参加者が発した音声と当該参加者に発せられた音声とを区別して、音声を記録する。

【0019】

好ましくは、議事録作成手段は、特定の音声に対するリンクを生成し、当該リンクを提示する。

【0020】

好ましくは、抽出手段は、音声の発話の時間帯に基づく優先度に基づいて、記録手段に記録された音声から特定の音声を抽出する。

【0021】

好ましくは、抽出手段は、記録手段に記録された音声を発した参加者に対して設定された優先度に基づいて、記録手段に記録された音声から特定の音声を抽出する。

【0022】

好ましくは、記録手段は、音声を、当該音声を発する者の生体情報とともに記録する。

好ましくは、検知手段は、各参加者によって装着される光学的検出手段によって検出される情報を取得し、当該光学的検出手段から取得される情報に基づいて、会議の参加者同士の会話が成立している状態を検知する。

【0023】

好ましくは、検知手段は、各参加者の位置情報を検出するための位置検出手段によって検出される当該参加者の位置情報を取得し、当該位置検出手段から取得される情報に基づいて、会議の参加者同士の会話が成立している状態を検知する。

【0024】

本発明に従った議事録作成支援システムは、会議の参加者が装着する検出手段と、検出手段と通信可能な議事録作成支援装置とを備えた、議事録作成支援システムであって、議事録作成支援装置は、各検出手段から取得する検出結果に基づいて、会議の参加者同士の会話が成立している状態を検知するための検知手段と、会議の参加者が発する音声を記録するための記録手段と、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段と、特定の音声を用いて会議の議事録を作成するための議事録作成手段とを含む。

【0025】

本発明に従った議事録作成用プログラムは、コンピュータ読取可能なプログラムであって、コンピュータを、会議の参加者同士の会話が成立している状態を検知するための検知手段、会議の参加者が発する音声を記録するための記録手段、検知手段による会話の成立状態の検知結果に基づいて、記録手段に記録された音声から特定の音声を抽出するための抽出手段、および、特定の音声を用いて会議の議事録を作成するための議事録作成手段として機能させる。

【発明の効果】

【0026】

会話が記録され、また、会話の成立状態が検知され、そして、成立が検知された結果に基づいて、記録された音声から特定の音声が抽出されて、議事録が作成される。

【0027】

これにより、会話が成立し、さらに、当該会話がどのように成立したかに応じて、議事録の作成に利用される音声が抽出される。

【0028】

これにより、会議において重要と考えられる音声を抽出して、議事録を作成することができる。

【図面の簡単な説明】

【0029】

【図1】本発明の一実施の形態である議事録作成支援システムの概略構成を示す図である。

【図2】議事録作成支援システムの機能構成の一例を模式的に示す図である。

【図3】会話収集デバイスの外観の一例を示す図である。

【図4】会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【図5】サーバーのハードウェア構成の一例を模式的に示す図である。

【図6】会議の風景の一例を模式的に示す図である。

【図7】本発明の一実施の形態において生成される会話状態の一例を模式的に示す図である。

【図8】本発明の一実施の形態において生成される各参加者の会話時間の一例を模式的に示す図である。

【図9】会話集中度の算出方法を説明するための図である。

【図10】図9に示された各者の発言のうち、抽出部によって抽出される発言に対応する音声データの内容を模式的に示す図である。

【図11】本発明の一実施の形態の議事録作成システムにおいて実行される議事録作成処理のフローチャートである。

【図12】会議ごとに予め登録されるタグ情報の一例を示す図である。

【図13】サーバーの表示デバイスに表示される画面の一例を示す図である。

【図14】議事録ファイルの表示例を示す図である。

【図15】各音声データにリンクする情報を表示するための画面の一例を示す図である。

【図16】会話収集デバイスの変形例の外観を示す図である。

【図17】図16の会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【図18】会話収集デバイスの他の変形例のハードウェア構成の一例を模式的に示す図である。

【図19】図15のリンクの表示画面の変形例を示す図である。

【図20】会話収集デバイスのさらに他の変形例のハードウェア構成の一例を模式的に示す図である。

【発明を実施するための形態】

【0030】

以下、本発明に係る議事録作成支援システムについて、図面を参照して説明する。なお、各図において、同様の作用および機能を奏する構成要素については、同じ符号を付し、その説明は繰返さない。

【0031】

[議事録作成システムの概略構成]

図1は、本発明の一実施の形態である議事録作成支援システムの概略構成を示す図である。

【0032】

図1を参照して、議事録作成支援システムは、各ユーザー(会議の参加者)が装着し、検出手段として機能する会話収集デバイス200A〜200Dと、会話収集デバイス200A〜200Dのそれぞれと通信し、議事録作成支援装置として機能するサーバー100とを含む。

【0033】

本明細書では、会話収集デバイス200A〜200Dを総称して「会話収集デバイス200」と呼ぶ場合もある。会話収集デバイスの数は、参加者と同数あっても良いし、それ以下であっても良い。つまり、会議の参加者全員が会話収集デバイスを装着していても良いし、一部の参加者のみが会話収集デバイスを装着していても良い。

【0034】

また、会話収集デバイスは、会議の参加者間で会話が成立している状態を検知するための情報を取得したり、参加者が発する音声(会話)を取得するための装置である。したがって、議事録作成支援システムでは、複数の参加者についてのこれらの情報を取得できる装置が備えられれば、参加者全員の情報を取得するためであっても、参加者と同数備えられる必要はなく、単数である場合も有り得る。

【0035】

図2は、議事録作成支援システムの機能構成の一例を模式的に示す図である。

議事録作成支援システムは、ライフログ生成システム900と議事録作成システム800とから主に構成される。ライフログ生成システム900は、1以上の会話収集デバイス200と、タグ生成部910と、データ保存部920とを含み、会議中に当該会議の参加者のデータを取得して保存する機能を有する。タグ生成部910は、会議についてのタグ情報を生成する。

【0036】

会話収集デバイス200を介して取得された参加者のデータは、タグ生成部910において生成されたタグ情報とともに、データ保存部920に保存される。より具体的には、会話収集デバイス200は、各参加者の音声等の参加者自身の情報を取得する部分と、各参加者が誰と会話しているのかを特定するための情報を取得する部分とを有する。これらの情報は、会議終了後に検索が可能なように、会議に付されるタグ情報とともに、保存される。タグ生成部910は、タグ情報として、日時や図示しないスケジューラからの会議情報などを、タグ情報として付与する。ライフログ生成システム900では、このようにしてリアルタイムに生成された情報が、データ保存部920に保存される。

【0037】

議事録作成システム800は、検索部810と、入力部820と、特定発言者特定部830と、会話集中度算出部840と、抽出部850と、優先度設定部860と、リンク生成部870と、議事録作成部880とを含む。本実施の形態では、会話集中度算出部840は検知手段として機能し、特定発言者特定部830と会話集中度算出部840と抽出部850とは抽出手段として機能する。

【0038】

検索部810は、議事録作成の対象となる会議のタグ情報をデータ保存部920から検索する。入力部820は、議事録作成の指示等の情報の入力を受付ける。なお、入力部820は、議事録作成の指示を、ネットワークを介して、外部の装置から、受付ける場合も有り得る。なお、入力部820は、タグ情報を生成するための情報の入力を受付ける場合も有り得る。

【0039】

会話集中度算出部840は、会議の各参加者について、後述する会話集中度を算出する。特定発言者特定部830は、会議の参加者から、会話集中度等に基づいて、議事録の作成に発言を利用する参加者を特定する。抽出部850は、特定発言者特定部830が特定した参加者が関与する会話をデータ保存部920から抽出する。優先度設定部860は、会議の参加者に対して、議事録の作成に関しての優先度を設定する。リンク生成部870は、議事録ファイルのトップページから議事録を構成する音声データ等の各種のデータへのリンク情報を生成する。議事録作成部880は、上記したようなトップページとリンク情報とを関連付ける等により、議事録ファイルを作成する。

【0040】

[会話収集デバイスの構成]

図3は、会話収集デバイス200の外観の一例を示す図である。

【0041】

図3を参照して、会話収集デバイス200は、会議参加者が首からかけるIDカードタイプの形態を有している。会話収集デバイス200は、マイク201と赤外線送受信部202とを含む。マイク201は、装着者が発する音声を取得することができる。

【0042】

会話収集デバイス200の内部には、メモリー(後述する記憶部260)を含む。当該メモリーには、装着者を区別することができるように、各会話収集デバイス200を特定するための個別IDが保存されている。議事録作成支援システムでは、当該個別IDと、たとえば図示しない社内人事DBとを連携させることにより、各会話収集デバイス200のマイク201で検出された音声データが、誰の音声データであるかを区別することができる。

【0043】

赤外線送受信部202は、上記メモリーに保存されている個別IDをコード化して、赤外線で送信している。また、赤外線送受信部202は、他の会話収集デバイス200の赤外線送受信部202が送信した個別IDを受信できる。

【0044】

議事録作成支援システムでは、会話収集デバイス200において他の個別IDが受信されたことにより、当該会話収集デバイス200を装着している参加者が、個別IDを受信された会話収集デバイス200を装着している参加者と対面していることが検知される。

【0045】

図4は、会話収集デバイス200のハードウェア構成の一例を模式的に示す図である。

図4を参照して、会話収集デバイス200は、当該端末の動作を全体的に制御する演算装置によって構成されるCPU(Central Processing Unit)251と、RAM(Random Access Memory)252と、ROM(Read Only Memory)253と、通信装置254と、記憶部260とを含む。

【0046】

RAM252は、CPU251がプログラムを実行する際のワークエリアとして機能する。通信装置254は、たとえばLAN(Local Area Network)カード、LANアダプタ等のネットワーク通信機器からなる。なお、会議中等にデータをサーバー100に送信する場合は、無線LANカードや、Bluetooth(登録商標)チップセット等の非接触での通信機能を有することが望ましい。会話収集デバイス200は、通信装置254を介して、サーバー100へ接続される。

【0047】

記憶部260は、CPU251が実行するプログラムを記憶するプログラム記憶部261と、種々のデータを記憶するデータ記憶部262とを含む。なお、記憶部260は、会話収集デバイス200の本体から着脱可能な記録媒体によって構成されても良い。記憶媒体としては、CD−ROM(Compact Disc - Read Only Memory)、DVD−ROM(Digital Versatile Disk - Read Only Memory)、USB(Universal Serial Bus)メモリ、メモリカード、FD(Flexible Disk)、ハードディスク、磁気テープ、カセットテープ、MO(Magnetic Optical Disc)、MD(Mini Disc)、IC(Integrated Circuit)カード(メモリカードを除く)、光カード、マスクROM、EPROM、EEPROM(Electronically Erasable Programmable Read-Only Memory)などの、不揮発的にプログラムを格納する媒体が挙げられる。

【0048】

[サーバーの構成]

図5は、サーバー100のハードウェア構成の一例を模式的に示す図である。

【0049】

図5を参照して、サーバー100は、当該サーバー100の動作を全体的に制御する演算装置によって構成されるCPU151と、RAM152と、ROM153と、通信装置154と、表示ドライバー155と、表示デバイス156と、入力部157と、記憶部160とを含む。

【0050】

通信装置154は、たとえばLANカード、LANアダプタ等のネットワーク通信機器からなる。なお、会議中等にデータを会話収集デバイス200から受信する場合は、無線LANカードや、Bluetooth(登録商標)チップセット等の非接触での通信機能を有することが望ましい。サーバー100は、通信装置154を介して、会話収集デバイス200と通信する。

【0051】

表示デバイス156は、液晶表示デバイスなどから構成される。表示ドライバー155は、CPU151が適切なプログラムを実行することによって生成した情報に基づいて、表示デバイス156において表示させるための画像情報を生成する。表示ドライバー155は、図5に示されたようにハードウェアとして設けられていてもよいし、CPU151が適切なプログラムを実行することによって、ソフトウェアとして設けられてもよい。

【0052】

入力部157は、たとえば、タッチセンサ、キーボード、マウスなどの入力装置によって実現される。

【0053】

記憶部160は、CPU151が実行するプログラムを記憶するプログラム記憶部161と、サーバー100が本実施の形態において説明される機能を実現するために必要とされる種々のデータを記憶するデータ記憶部162とを含む。

【0054】

議事録作成支援システムにおいて、図2に破線で囲んで示したライフログ生成システム900のタグ生成部910、データ保存部920、および議事録作成システム800の各構成要素は、たとえばサーバー100によって実現される。タグ生成部910、検索部810、特定発言者特定部830、会話集中度算出部840、抽出部850、優先度設定部860、リンク生成部870、および、議事録作成部880は、たとえばCPU151が適切なプログラムを実行することによって、実現される。データ保存部920は、たとえば記憶部260によって実現される。入力部820は、たとえば入力部157や通信装置154によって、実現される。

【0055】

[会話成立の検出]

次に、議事録作成支援システムにおいて、参加者同士の会話の成立がどのように検出されるかについて、説明する。

【0056】

図6は、会議の風景の一例を模式的に示す図である。

図6を参照して、会議には、参加者300A〜300Fの6人が参加している。なお、図6は、長机の周りに座る6人の参加者300A〜300Fを上方から見た図に相当する。そして、参加者300A〜300Fは、各自会話収集デバイス200(会話収集デバイス200A〜200F)を装着している。なお、図6では、理解を容易にするため、会話収集デバイス200A〜200Fが参加者300A〜300Fに対して大きめに記載されている。

【0057】

会話収集デバイス200の赤外線送受信部202は、指向性が高い。そして、各会話収集デバイス200の赤外線送受信部202は、他の会話収集デバイス200の赤外線送受信部202と対向する状態となって初めて当該他の会話収集デバイス200の赤外線送受信部202と通信可能になる。

【0058】

図6では、参加者300Aと参加者300Dが対向することにより、会話収集デバイス200Aと会話収集デバイス200Dが対向し、これにより、赤外線送受信部202Aと赤外線送受信部202Dが矢印R1で示されるような経路に沿って通信可能になる。会話収集デバイス200Aは、赤外線送受信部202Aが赤外線送受信部202Dの個別IDを受信したことを、受信した時刻情報とともにデータ保存部920へ送信する。また、会話収集デバイス200Dは、赤外線送受信部202Dが赤外線送受信部202Aの個別IDを受信したことを、受信した時刻情報とともにデータ保存部920へ送信する。

【0059】

会話集中度算出部840は、同じ時刻に、互いに相手の個別IDを受信した会話収集デバイス200の組が存在するか否かを判断する。そして、そのような組が存在すると判断すると、当該の組の双方に対応する参加者の間で、会話が成立していると判断する。つまり、たとえば、上記の検出例によれば、会話集中度算出部840は、会話収集デバイス200Aに対応する参加者と会話収集デバイス200Dに対応する参加者との間で、会話が成立していると判断する。

【0060】

会話集中度算出部840は、上記のように、いつ、どの参加者の間で、会話が成立しているかを検出できる。これにより、会話集中度算出部840は、会議における、参加者の会話状態の時間変化を表す情報を生成できる。図7は、生成される会話状態の一例を模式的に示す図である。

【0061】

図7の会話状態では、ST1〜ST10の会話(発話)部分が示されている。

図7に示された会議では、Aさん、Bさん、Cさん、Dさんの4人の参加者が示されている。ST1は、Aさんと、Bさん、Cさん、および、Dさんのそれぞれとの間で短時間ずつ会話が成立した状態を示す。

【0062】

ST2は、AさんとBさんの間で会話が成立し、かつ、BさんからAさんに話しかけている状態を示す。会話が成立した参加者の間で、どちらからどちらに話しかけているかは、両者のいずれのマイク201で音声が取得されたかによって判断される。つまり、図7では、ST2の期間中、Bさんの装着する会話収集デバイス200のマイク201において音声が検出されたことを示している。

【0063】

なお、会話集中度算出部840は、マイク201によって取得された音声データに対して、所定の音量のフィルタを用いて、取得された音声から環境音を分離して、会話収集デバイス200を装着した者が声を出したか否かを判断することが好ましい。さらに、会話集中度算出部840は、各会話収集デバイス200を装着した者の音声データをサンプルとして取得し、当該者の声と同定できる音声データが検出された期間のみ、当該者が発言した期間と判断しても良い。

【0064】

ST3は、AさんとBさんの間で会話が成立し、かつ、AさんからBさんに話しかけている状態を示す。ST4とST5は、CさんとDさんの間で会話が成立し、かつ、CさんからDさんへの発言とDさんからCさんへの発言が交互に頻繁に行なわれた状態を示す。ST6とST7は、BさんとDさんの間で会話が成立し、かつ、BさんからDさんへの発言とDさんからBさんへの発言とが交互に頻繁に行なわれた状態を示す。ST8は、AさんとCさんの間で会話が成立し、かつ、CさんからAさんに話しかけている状態を示す。ST9は、AさんとCさんの間で会話が成立し、かつ、AさんからCさんに話しかけている状態を示す。ST10は、AさんとBさんの間で会話が成立し、かつ、BさんからAさんに話しかけている状態を示す。

【0065】

会話集中度算出部840は、各会話収集デバイス200で取得され、データ保存部920に保存された情報に基づいて、図7に示されたような会話状態とともに、図8に示されるような、各参加者の会話時間を算出することができる。

【0066】

図8は、生成される各参加者の会話時間の一例を模式的に示す図である。

図8では、Aさん、Bさん、Cさん、Dさんのそれぞれについて、誰から誰に、どのぐらいの長さ、発言をしたかが示されている。図8において示された例は、図7に示された会議とは別の会議における会話時間が示されているものとする。そして、図8では、ある会議についての、各参加者の、各相手に対する発言の時間の和が示されている。つまり、たとえば、AさんからBさんへの当該会議中の発言時間の合計時間は、3分である。また、BさんからAさんへの当該会議中の発言時間の合計時間は、2分である。本明細書では、会話時間とは、参加者間で会話が成立した時間を意味する。つまり、2者間で言えば、発言を行なった時間と発言を受けた時間の和とする。たとえば図8の例では、AさんとBさんの間での会話時間は5分である。このうち、Aさんについては、(Bさんに対して)発言を行なった時間は3分である。また、(Bさんから)発言を受けた時間は2分である。

【0067】

また、本明細書では、一方の参加者から他方の参加者へ発言が行なわれた時間を、一方の参加者の発話時間と呼ぶ場合がある。さらに、一方の参加者から他方の参加者へ発言が行なわれた時間を、他方の参加者の着話時間と呼ぶ場合がある。

【0068】

本実施の形態では、会話集中度算出部840は、ある会議の各参加者について、会話の相手、発言をした時間、および、発言を受けた時間が特定されることにより、図9に示されるようなマトリクスを作成し、これに基づいて、当該会議における各参加者の会話集中度を算出することができる。図9は、会話集中度の算出方法を説明するための図である。

【0069】

図9には、会議の参加者として、「田中」「伊藤」「井上」「石田」「佐藤」「小林」の6人が挙げられている。そして、図9における上部の表には、各参加者の発話時間と着話時間が分単位で示されている。縦方向に、各参加者の、各参加者に対する発話時間が示されている。たとえば、井上さんについては、田中さんに対する発話時間は3分であり、伊藤さんに対する発話時間は0分であり、井上さん自身に対する発話時間は0分であり、石田さんに対する発話時間は1分であり、佐藤さんに対する発話時間は0分であり、小林さんに対する発話時間は0分である。

【0070】

会話集中度算出部840は、全参加者の発話時間の合計を算出する。図9の例では、27分である。

【0071】

また、会話集中度算出部840は、全参加者の発話時間の合計を算出する。図9の例では、田中さんについては9分であり、伊藤さんについては3分であり、井上さんについては4分であり、石田さんについては7分であり、佐藤さんについては3分であり、小林さんについては1分である。

【0072】

また、会話集中度算出部840は、各参加者の着話時間の合計を算出する。図9の例では、田中さんについては10分であり、伊藤さんについては3分であり、井上さんについては4分であり、石田さんについては5分であり、佐藤さんについては3分であり、小林さんについては2分である。

【0073】

また、会話集中度算出部840は、各参加者の発話集中度を算出する。発話集中度とは、全参加者の発話時間の合計に対する各参加者の発話時間の割合である。図9の例では、田中さんについては0.33であり、伊藤さんについては0.11であり、井上さんについては0.15であり、石田さんについては0.26であり、佐藤さんについては0.11であり、小林さんについては0.04である。

【0074】

また、会話集中度算出部840は、各参加者の着話集中度を算出する。着話集中度とは、全参加者の発話時間の合計に対する各参加者の着話時間の割合である。図9の例では、田中さんについては0.37であり、伊藤さんについては0.11であり、井上さんについては0.15であり、石田さんについては0.19であり、佐藤さんについては0.11であり、小林さんについては0.07である。

【0075】

また、会話集中度算出部840は、各参加者の会話集中度を算出する。会話集中度とは、発話集中度と着話集中度の和である。図9の例では、田中さんについては0.7である。田中さんであれば、発話時間の総和は9分、着話時間の総和は10分である。また、会議全体の発話時間の合計は27分である。したがって、田中さんの会話集中度は、「(9+10)/27」に従って、約0.7と算出される。また、伊藤さんについては0.22であり、井上さんについては0.3であり、石田さんについては0.45であり、佐藤さんについては0.22であり、小林さんについては0.11である。

【0076】

[音声データの抽出]

本実施の形態では、特定発言者特定部830は、各参加者の会話集中度に基づいて、当該会議における特定発言者を特定する。特定発言者とは、当該会議における中心的な参加者と考えられる。図9の例では、会話集中度が最も高い田中さんが、特定発言者として特定される。

【0077】

そして、本実施の形態では、抽出部850は、データ保存部920に保存された会話の音声データから、特定発言者がした発言の音声データおよび特定発言者が受けた発言の音声データを、当該会議における重要な発言として抽出する。図9の例では、田中さんが各参加者に対してした発言と田中さんが受けた発言の音声データが抽出される。図10は、図9に示された各者の発言のうち、抽出部850によって抽出される発言に対応する音声データの内容を模式的に示す図である。

【0078】

なお、図9に示された会議では、実際に重要であった発言は、太枠で囲われた、石田さんから田中さんに対する発言(合計3分間)と、佐藤さんから田中さんに対する発言(合計2分間)と、田中さんから石田さんに対する発言(合計3分間)であったとする。図10に示された結果によれば、図9において重要であると示された発言は、すべて、抽出されている。

【0079】

[議事録作成処理]

図11は、議事録作成システムにおいて実行される議事録作成処理のフローチャートである。議事録作成処理は、たとえばサーバー100にインストールされた議事録作成アプリケーションとして実現される。

【0080】

議事録作成処理では、まずステップSA10において、入力部820が、ユーザーによる議事録を作成する会議に関する情報の入力を受付ける。具体的には、会議名、会議の日時、会議の開催場所、会議の参加者等の必要なプロパティーが、ユーザーによって入力される。

【0081】

なお、サーバー100には、たとえば図12に示されるように、予め、タグ情報として、会議に関する情報(日時、場所、参加者、等)が登録される。そして、ステップSA10では、入力部820は、登録された会議に関する情報の中から会議を指定する情報の入力を受付けて、ステップSA20へ処理を進める。

【0082】

図12は、会議ごとに予め登録されるタグ情報の一例を示す図である。

図12を参照して、データ保存部920には、各会議の情報として、会議ID、開始日時、終了日時、場所、参加者(参加者ID)、目的、および、会議形態が登録されている。会議IDは、会議を識別するための情報であり、会議ごとに固有の値が設定される。開始日時は、会議の開始の時刻を特定する情報である。終了日時は、会議の終了の時刻を特定する情報である。また、場所、参加者、および、目的は、それぞれ、会議の場所、参加者、および、目的を特定する情報である。特に、参加者については、たとえば参加者IDで特定される。なお、本実施の形態では、各参加者IDは、各参加者が装着する会話収集デバイス200の個別IDに関連付けられている。

【0083】

会議形態としては、「自己想定」と「システム評価」の2種類の情報が格納される。「自己想定」は、たとえば管理者等によって入力される情報であり、「システム評価」は、たとえば、図7を参照して説明したような会話状態等に基づいて判定される評価内容である。たとえば、会話状態が、ある特定の参加者の会話集中度が高く、他の参加者の会話集中度がある程度低い値である場合には、「質疑応答型」と判定される。また、たとえば、ある特定の参加者の会話集中度が特に高く、残りの参加者の会話集中度がほぼ0に近い値である場合には、「通知通達型」と判定される。また、たとえば、参加者の会話集中度がまんべんなく同じような値である場合には、「対話型」等の判定がなされる。

【0084】

ステップSA20では、会話集中度算出部840は、データ保存部920から、ステップSA10で指定された会議のライフログ(音声データ)を検索して、ステップSA30へ処理を進める。

【0085】

たとえば、会議が指定されると、図12に示されているように、当該会議に対応する開始日時、終了日時、および、参加者IDが特定される。たとえば、図12においてC1で示された会議(会議IDが「POE−0003」)が指定されると、当該会議に対応する開始日時(2011年8月27日10時00分)、終了日時(2011年8月27日11時10分)、参加者ID(10201,10850,10430,および,8431)が特定される。

【0086】

会話集中度算出部840は、特定されたこれらの情報に基づいて、開始日時から終了日時までの、参加者IDが行なった発言または受けた発言のすべての音声データを、データ保存部920に登録されている音声データから検索する。

【0087】

以下、より具体的に説明する。図13は、サーバー100の表示デバイス156に表示される画面の一例を示す図である。会議を指定する情報が入力されると、検索部810は、図13の画面500に示すように、当該指定された会議のタグ情報を表示する。そして、ユーザー(たとえば、議事録作成担当者)は、タグ情報を確認し、当該会議についての議事録の作成を進めることを希望する場合には、さらに、画面500内のリンク作成ボタン501を操作する。当該操作に応じて、検索部810は、上記したように、当該会議のタグ情報によって特定される音声データを、検索する。

【0088】

つまり、ステップSA20の処理によれば、会議の出席者について記録されたすべての音声データが、検索結果となる。

【0089】

なお、タグ情報における会議の場所に基づいて、当該会議の場所から接続される無線LANが特定されても良い。そして、このように特定されたLANにおいて、開始日時から終了日時まで取得(当該LANのサーバーに登録)された音声データが、ステップSA20の検索結果とされる場合も有り得る。

【0090】

次に、ステップSA30では、会話集中度算出部840は、ステップSA20で検索結果として得られた音声データを利用して、当該会議について、図7や図8を参照して説明したような会話状態(参加者間の有向グラフ)を作成して、ステップSA40へ処理を進める。

【0091】

ステップSA40では、会話集中度算出部840は、図9を参照して説明したように、各参加者の会話集中度を算出して、ステップSA50へ処理を進める。

【0092】

ステップSA50では、特定発言者特定部830は、ステップSA40で算出した各参加者の会話集中度に基づいて、特定発言者を特定して、ステップSA60へ処理を進める。

【0093】

ステップSA60では、抽出部850は、ステップSA20の検索結果から、特定発言者が行なった発言と特定発言者に対する発言に対応する音声データを抽出して、ステップSA70へ処理を進める。

【0094】

ステップSA70では、リンク生成部870が、ステップSA60で抽出した音声データのそれぞれにリンクするためのリンクデータを生成し、さらに、議事録作成部880が、図13の画面500のような議事録の作成対象となっている会議についての画面データに、作成されたリンクデータを追加することにより、議事録ファイルを作成して、議事録作成処理を終了する。

【0095】

図14は、議事録ファイルの表示例を示す図である。

図14を参照して、議事録ファイルは、画面510のような表示画面のデータを含む。画面510では、対象となる会議の日時、場所、参加者、および、データリンクを含む。画面510は、図13の画面500に、データリンクが追加された画面である。日時、場所、参加者は、図12に示されたようなタグ情報から取得される。

【0096】

画面510では、会話が成立した参加者の組別のリンクが表示されている。なお、リンクは、下線を付されて表示されている。また、画面510のデータリンクにおける参加者の組の表示の順序は、たとえば会話時間の長い順序とすることができる。つまり、画面510は、田中さんと石田さんの組の会話が、会話時間(石田さんとの会話についての、田中さんの発話時間と着話時間の和)の最も長い組である場合を示している。

【0097】

なお、データ保存部920では、音声データは、会話が一区切りされるごとに、異なるファイルとして登録されている。具体的には、会話収集デバイス200のCPU251(図4参照)は、マイク201から入力される音声について、所定時間以上の無音期間(または、特定のレベル未満の音声期間)が出現するごとに、異なるファイルで、音声データを生成する。そして、画面510にデータリンクとして表示された各参加者の組のうち、ある組を指定すると、当該組の会話の音声データのそれぞれにリンクする情報が表示される。図15は、各音声データにリンクする情報を表示するための画面の一例を示す図である。

【0098】

図15を参照して、画面520では、田中さんと石田さんの会話の各音声データへのリンクが、当該音声データが取得された時刻を含むように表示されている。サーバー100では、各リンクが選択されると、当該リンクに対応した時刻に記録された音声データが、再生される。なお、ここでいう時刻は、たとえば、音声の取得が開始された時刻である。なお、画面520では、音声データが取得された時刻の順ではなく、たとえば各音声データの再生時間が長い順等、対応する音声データの性質等が所定の条件に従ってソートされて、表示されている。

【0099】

図14に戻って、画面510では、「そのほかの発言」という文字によって示されるリンクを含む。このリンクは、当該会議において、会話時間の長い順から特定の順序以下の組の発言の音声データに対応する。このようなリンクが選択されると、たとえば、表示デバイス156には、「そのほかの発言」に分類された参加者の組の会話の各音声データへのリンクが表示される。そして、そこに表示された各リンクが選択されると、サーバー100では、当該リンクに対応した音声データが再生される。

【0100】

以上説明した議事録作成処理によれば、図6〜図9等を参照して説明したように、会議における会話の成立に関する状態を検知し、当該検知の結果に基づいて、記録された音声データから音声データを抽出し、議事録の作成に利用される。

【0101】

これにより、会議で取得された音声すべてではなく、会議において重要と考えられる音声が抽出されて、議事録の作成に利用される。

【0102】

[変形例等]

(変形例1)

以上説明した本実施の形態において、「会議」とは、議事録の作成対象を言うのであって、特別に集合することを予定されたイベントに限られるものではない。たとえば、オフィスにおいて、当該オフィスにいると想定される人を特定する情報が参加者IDとして特定され、また、オフィスにいる各ユーザーが図3等を参照して説明された会話収集デバイス200を装着し、そして、当該オフィスにおける日常会話が記録された場合にも、本実施の形態によって開示された技術的思想は適用され得る。

【0103】

(変形例2)

会話収集デバイス200によって検出手段の一例が構成される。なお、会話収集デバイスは、図3等を参照して説明されたような形態のものに限定されない。図16は、会話収集デバイスの変形例の外観を示す図である。また、図17は、図16の会話収集デバイスのハードウェア構成の一例を模式的に示す図である。

【0104】

図16および図17を参照して、会話収集デバイス210は、図4を参照して説明した構成に対して、マイク201と赤外線送受信部202の代わりに、マイク211とカメラ212を含む。

【0105】

会話収集デバイス210では、カメラ212は、会話収集デバイス210を装着している会議の参加者の視線の先に存在するものを撮影する。したがって、会話集中度算出部840は、カメラ212が撮影する画像を既知の顔判別アルゴリズムに従って解析することにより、当該会話収集デバイス210を装着している参加者が誰を見ているのかを特定することができる。

【0106】

さらに、会話集中度算出部840は、上記顔判別アルゴリズムと合わせて、上記画像を解析することによって、会話収集デバイス210を装着している参加者が頷いているか否かを判別することができる。当該判別結果をさらに用いることにより、既知のうなずき理論(岡山県立大学情報システム工学科、渡辺富夫教授の「身体的引き込み技術iRT」等)に基づいて、会話収集デバイス210を装着している参加者が頷いているときに見ている相手を会話の相手と特定するなど、参加者の会話の相手を、より高い精度で、特定することができる。

【0107】

また、会話収集デバイス210では、カメラ212がテレビ画面に映った相手を撮影することができる。したがって、会話収集デバイス210において収集される情報は、遠隔地とのテレビ会議においても、会話相手の特定に利用することができる。

【0108】

(変形例3)

図18は、会話収集デバイス200の他の変形例のハードウェア構成の一例を模式的に示す図である。

【0109】

本変形例では、会話収集デバイス200は、図4に示された構成に加えて、生体情報検出部203を備える。生体情報検出部203は、会話収集デバイス200を装着したユーザーの心拍数、熱、および/または、皮膚の導電性などの生体情報(バイタルデータ)を検出するためのセンサーである。会話収集デバイス200を装着する参加者は、さらに、当該センサーを、当該センサーが取得するべきデータを取得できる態様で、装着する。

【0110】

そして、本変形例では、データ保存部920には、音声データとともに、当該音声データを発した参加者および/または当該音声データの発言を受けた参加者の生体情報も記録される。

【0111】

このように記録された生体情報は、当該音声データに対応する発言がどのような感情で発せられたか、あるいは、会話相手にどのぐらいのインパクトを与えたかなど、会話の内容や重要度の特定をサポートする情報となり得る。特に、心拍間隔時系列データのパターンから、プレゼンテーションや質疑の区間を識別する研究(「脈拍数を用いた平常/非平常(眠気,緊張)推定方法」NTT)もある。したがって、上記したような生体情報が記録されることにより、会話状態の検知の精度を向上させることができる。

【0112】

さらに、上記のように記録された生体情報は、会話状態の検知だけでなく、会話の重要度の特定にも利用できる。たとえば、音声データが取得されたときの発言者の心拍数が、当該発言者の定常時の心拍数に対して特定の割合以上上昇している場合には、緊張した状態での発言と考えられる。そのことが分かるように、当該音声データのリンクが表示されても良い。図19は、図15のリンクの表示画面の変形例を示す図である。図19に示された画面530では、10時50分の発言のリンクと10時44分の発言のリンクが、ハートマークを付されて、表示されている。当該ハートマークは、発言した参加者が、上記したような緊張状態で対応する発言を行なったことを示す。

【0113】

緊張状態での発言は、重要な内容である可能性が比較的高いと言える。議事録ファイルを再生するユーザーは、このようなハートマークの表示に従って、重要な内容である可能性が比較的高い音声ファイルを優先して再生させることにより、会議の内容を、より早期に把握することが可能となる。

【0114】

(変形例4)

図20は、会話収集デバイス200のさらに他の変形例のハードウェア構成の一例を模式的に示す図である。図20の会話収集デバイス220は、図4を参照して説明した会話収集デバイス200に対して、赤外線送受信部202の代わりに、電子コンパス204とGPS(Global Positioning System)コントローラー205を含む。

【0115】

電子コンパス204は、磁気センサーを含み、会話収集デバイス220の向きを検出する。GPSコントローラー205は、GPS信号または基地局からの位置信号を受信することにより、会話収集デバイス220の位置情報を取得する。

【0116】

本変形例では、データ保存部920において、(赤外線送受信部202によって取得される個別IDの代わりに)会話収集デバイス220の位置情報と向き情報が登録される。これにより、議事録作成支援システムでは、データ保存部920において、各参加者(会話収集デバイス220を装着しているユーザー)の位置情報と向き情報が取得される。これにより、各ユーザーの位置と向きを特定できる。これにより、近傍(所定の距離範囲内)に位置し、かつ、向かい合っているユーザーの組を特定できる。そして、会話集中度算出部840は、当該組において、一方のユーザーの装着する会話収集デバイス220のマイク201において音声が検出されたことを条件として、当該組のユーザーの間で会話が成立していると特定することができる。

【0117】

(変形例5)

以上説明した本実施の形態において、参加者ごとに重みの値が設定されることによる重み付けがなされ、特定発言者特定部830は、当該重み付けをさらに利用して、特定発言者を特定することができる。

【0118】

重み付けによって付される重みの値としては、たとえば、職場における人事情報が利用される。つまり、管理職の人間は、職場における多くの決定権を有するため、会議において影響力の大きい発言をすることが多い。たとえば、部長の職にある参加者は、他の参加者と比較して2倍の重み値を有するとする。特定発言者特定部830は、各参加者の会話集中度と各参加者に付された重み値との積を算出し、当該算出結果が最も大きい値となった参加者を特定発言者と決定することができる。

【0119】

また、会議の議題等に応じて、会議ごとに、各参加者に付される重みの値が変更される場合も有り得る。

【0120】

(変形例6)

会話集中度算出部840が特定発言者の特定の際に利用される重みの値は、発言が生じた時間帯に応じて設定される場合も有り得る。たとえば2時間の会議では、後半1時間における発言は、前半1時間における発言よりも、会議の場が成熟している等の理由によって重要度が高い場合がある。そこで、図9を参照して説明したような着話時間や発話時間の算出の際に、たとえば、後半1時間における発言についての着話時間および発話時間の長さは1.5倍されて、会話集中度の算出に利用されても良い。なお、この場合、前半1時間における発言についての着話時間および発話時間の長さは、実際の時間のままとされる。

【0121】

これにより、発言が生じた時間帯に応じて、音声データに重みを付けて、特定発言者の特定を行なうことができる。また、発言が生じた時間帯に応じて、発言をした参加者に、当該参加者の音声が議事録に利用される際の優先度を付することができる。

【0122】

(その他の変形例等)

ブレインストーミングのような、意見交換型会議は、議事録を作成されることは少なく、その場で出たアイデアがその場でまとめられる場合が多い。したがって、その場で利用されたホワイトボード上の画像や、会議中に付加情報(ポストイット)を付された時点の情報を参照することが主と考えられる。

【0123】

ただし、意見交換型会議においても、ファシリテーターが皆無ということはなく、特定発言者(主発言者)を見出すことはできる。最終的に、意見交換型会議においてもまとめがファシリテーターによってなされるケースがある。したがって、主発言者の発言とその主発言者に向けてなされた音声をリンクさせることは、意見交換型会議においても役立つと考えられる。

【0124】

なお、本明細書において説明された議事録作成支援システムは、会議中であっても、会議後であっても、議事録ファイルを作成できる。会議中であれば、それまでの会話からリンクが生成され、順次会話が進むことでリンクが更新されていく。

【0125】

本明細書において説明された議事録作成支援システムは、会話集中度から、議事録の作成にとって重要な情報(音声データ)を取り出し、リンクを作成する。

【0126】

これにより、議事録ファイルを参照するユーザーは、会議において記録されたすべての情報(音声データ)をたぐることなく、議事録の元データを参照することができる。

【0127】

なお、議事録作成支援システムにおいて取得される会話集中度は、次の用途にも活用できる。

【0128】

・各自の会話集中度の比較をして、参加者間で議論ができているかどうかのチェック

・会話中集度から重要な発言を取り出して、セキュリティ(読取属性の変更や暗号化)をかける

・会議前に設定したファシリテーターのスキルチェック(自分で話しているだけか、議論を活性化させているか)

・主発言者と関わりのない発言は、記録として不必要なので削除、あるいは難読化(暗号化やデータ分割など)を施すことよる、データの圧縮、議論と関係のないおしゃべりなどの削除、および/または、プライバシーの保護

今回開示された各実施の形態はすべての点で例示であって制限的なものではないと考えられるべきである。本発明の範囲は上記した説明ではなくて特許請求の範囲によって示され、特許請求の範囲と均等の意味および範囲内でのすべての変更が含まれることが意図される。また、実施の形態および各変形例において説明された発明は、可能な限り、単独でも、組合わせても、実施することが意図される。

【符号の説明】

【0129】

100 サーバー、200,200A〜200F 会話収集デバイス、201,211 マイク、202 赤外線送受信部、203 生体情報検出部、204 電子コンパス、205 GPSコントローラー、212 カメラ、800 議事録作成システム、900 ライフログ生成システム。

【特許請求の範囲】

【請求項1】

会議の参加者同士の会話が成立している状態を検知するための検知手段と、

前記会議の参加者が発する音声を記録するための記録手段と、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段と、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを備える、議事録作成支援装置。

【請求項2】

前記抽出手段は、

前記会議の参加者のそれぞれについて、前記検知手段によって会話が成立したと判断された時間を積算して合計会話時間を算出し、

各参加者についての合計会話時間に基づいて、前記会議における主発言者を特定し、

前記記録手段が記録した音声から、前記主発言者が含まれる会話の音声を、前記特定の音声として抽出する、請求項1に記載の議事録作成支援装置。

【請求項3】

前記抽出手段は、

すべての参加者についての前記合計会話時間に対する各参加者の前記合計会話時間の比を算出することによって、各参加者の会話集中度を算出し、

各参加者の前記会話集中度に基づいて、最も前記会話集中度の高い参加者を主発言者として決定し、

前記記録手段が記録した音声から、前記主発言者が含まれる会話の音声を、前記特定の音声として抽出する、請求項2に記載の議事録作成支援装置。

【請求項4】

前記記録手段は、各参加者が発した音声と当該参加者に発せられた音声とを区別して、音声を記録する、請求項1〜請求項3のいずれかに記載の議事録作成支援装置。

【請求項5】

前記議事録作成手段は、前記特定の音声に対するリンクを生成し、当該リンクを提示する、請求項1〜請求項4のいずれかに記載の議事録作成支援装置。

【請求項6】

前記抽出手段は、音声の発話の時間帯に基づく優先度に基づいて、前記記録手段に記録された音声から前記特定の音声を抽出する、請求項1〜請求項5のいずれかに記載の議事録作成支援装置。

【請求項7】

前記抽出手段は、前記記録手段に記録された音声を発した参加者に対して設定された優先度に基づいて、前記記録手段に記録された音声から前記特定の音声を抽出する、請求項1〜請求項6のいずれかに記載の議事録作成支援装置。

【請求項8】

前記記録手段は、前記音声を、当該音声を発する者の生体情報とともに記録する、請求項1〜請求項7のいずれかに記載の議事録作成支援装置。

【請求項9】

前記検知手段は、各参加者によって装着される光学的検出手段によって検出される情報を取得し、当該光学的検出手段から取得される情報に基づいて、前記会議の参加者同士の会話が成立している状態を検知する、請求項1〜請求項8のいずれかに記載の議事録作成支援装置。

【請求項10】

前記検知手段は、

各参加者の位置情報を検出するための位置検出手段によって検出される当該参加者の位置情報を取得し、当該位置検出手段から取得される情報に基づいて、前記会議の参加者同士の会話が成立している状態を検知する、請求項1〜請求項9のいずれかに記載の議事録作成支援装置。

【請求項11】

会議の参加者が装着する検出手段と、前記検出手段と通信可能な議事録作成支援装置とを備えた、議事録作成支援システムであって、

前記議事録作成支援装置は、

各前記検出手段から取得する検出結果に基づいて、会議の参加者同士の会話が成立している状態を検知するための検知手段と、

前記会議の参加者が発する音声を記録するための記録手段と、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段と、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを含む、議事録作成支援システム。

【請求項12】

コンピュータ読取可能なプログラムであって、前記コンピュータを、

会議の参加者同士の会話が成立している状態を検知するための検知手段、

前記会議の参加者が発する音声を記録するための記録手段、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段、および、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段として機能させるための、議事録作成用プログラム。

【請求項1】

会議の参加者同士の会話が成立している状態を検知するための検知手段と、

前記会議の参加者が発する音声を記録するための記録手段と、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段と、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを備える、議事録作成支援装置。

【請求項2】

前記抽出手段は、

前記会議の参加者のそれぞれについて、前記検知手段によって会話が成立したと判断された時間を積算して合計会話時間を算出し、

各参加者についての合計会話時間に基づいて、前記会議における主発言者を特定し、

前記記録手段が記録した音声から、前記主発言者が含まれる会話の音声を、前記特定の音声として抽出する、請求項1に記載の議事録作成支援装置。

【請求項3】

前記抽出手段は、

すべての参加者についての前記合計会話時間に対する各参加者の前記合計会話時間の比を算出することによって、各参加者の会話集中度を算出し、

各参加者の前記会話集中度に基づいて、最も前記会話集中度の高い参加者を主発言者として決定し、

前記記録手段が記録した音声から、前記主発言者が含まれる会話の音声を、前記特定の音声として抽出する、請求項2に記載の議事録作成支援装置。

【請求項4】

前記記録手段は、各参加者が発した音声と当該参加者に発せられた音声とを区別して、音声を記録する、請求項1〜請求項3のいずれかに記載の議事録作成支援装置。

【請求項5】

前記議事録作成手段は、前記特定の音声に対するリンクを生成し、当該リンクを提示する、請求項1〜請求項4のいずれかに記載の議事録作成支援装置。

【請求項6】

前記抽出手段は、音声の発話の時間帯に基づく優先度に基づいて、前記記録手段に記録された音声から前記特定の音声を抽出する、請求項1〜請求項5のいずれかに記載の議事録作成支援装置。

【請求項7】

前記抽出手段は、前記記録手段に記録された音声を発した参加者に対して設定された優先度に基づいて、前記記録手段に記録された音声から前記特定の音声を抽出する、請求項1〜請求項6のいずれかに記載の議事録作成支援装置。

【請求項8】

前記記録手段は、前記音声を、当該音声を発する者の生体情報とともに記録する、請求項1〜請求項7のいずれかに記載の議事録作成支援装置。

【請求項9】

前記検知手段は、各参加者によって装着される光学的検出手段によって検出される情報を取得し、当該光学的検出手段から取得される情報に基づいて、前記会議の参加者同士の会話が成立している状態を検知する、請求項1〜請求項8のいずれかに記載の議事録作成支援装置。

【請求項10】

前記検知手段は、

各参加者の位置情報を検出するための位置検出手段によって検出される当該参加者の位置情報を取得し、当該位置検出手段から取得される情報に基づいて、前記会議の参加者同士の会話が成立している状態を検知する、請求項1〜請求項9のいずれかに記載の議事録作成支援装置。

【請求項11】

会議の参加者が装着する検出手段と、前記検出手段と通信可能な議事録作成支援装置とを備えた、議事録作成支援システムであって、

前記議事録作成支援装置は、

各前記検出手段から取得する検出結果に基づいて、会議の参加者同士の会話が成立している状態を検知するための検知手段と、

前記会議の参加者が発する音声を記録するための記録手段と、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段と、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段とを含む、議事録作成支援システム。

【請求項12】

コンピュータ読取可能なプログラムであって、前記コンピュータを、

会議の参加者同士の会話が成立している状態を検知するための検知手段、

前記会議の参加者が発する音声を記録するための記録手段、

前記検知手段による会話の成立状態の検知結果に基づいて、前記記録手段に記録された音声から特定の音声を抽出するための抽出手段、および、

前記特定の音声を用いて前記会議の議事録を作成するための議事録作成手段として機能させるための、議事録作成用プログラム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【公開番号】特開2013−105374(P2013−105374A)

【公開日】平成25年5月30日(2013.5.30)

【国際特許分類】

【出願番号】特願2011−249680(P2011−249680)

【出願日】平成23年11月15日(2011.11.15)

【出願人】(000001270)コニカミノルタホールディングス株式会社 (4,463)

【Fターム(参考)】

【公開日】平成25年5月30日(2013.5.30)

【国際特許分類】

【出願日】平成23年11月15日(2011.11.15)

【出願人】(000001270)コニカミノルタホールディングス株式会社 (4,463)

【Fターム(参考)】

[ Back to top ]