電子機器、顔画像抽出制御方法およびプログラム

【課題】映像コンテンツデータからの人物の顔画像の抽出を適切に制御する電子機器を提供する。

【解決手段】実施形態によれば、電子機器は、映像コンテンツから人物の顔画像を抽出するための電子機器であって、検出手段と、調整手段と、抽出手段と、を有する。検出手段は、前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する。調整手段は、前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する。抽出手段は、前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する。

【解決手段】実施形態によれば、電子機器は、映像コンテンツから人物の顔画像を抽出するための電子機器であって、検出手段と、調整手段と、抽出手段と、を有する。検出手段は、前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する。調整手段は、前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する。抽出手段は、前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する。

【発明の詳細な説明】

【技術分野】

【0001】

この発明は、映像コンテンツデータの再生開始位置をユーザが効率的に選択可能とするためのユーザインタフェース用の画像表示制御技術に関する。

【背景技術】

【0002】

一般に、ビデオレコーダ、パーソナルコンピュータといった電子機器は、テレビジョン放送番組データのような各種映像コンテンツデータを記録および再生することが可能である。この場合、電子機器に格納された各映像コンテンツデータにはタイトル名が付加されるが、タイトル名だけでは、ユーザが、各映像コンテンツデータがどのような内容のものであるかを把握することは困難である。このため、映像コンテンツデータの内容を把握するためには、その映像コンテンツデータを再生することが必要となる。しかし、総時間長の長い映像コンテンツデータの再生には、たとえ早送り再生機能等を用いた場合であっても、多くの時間が要される。

【0003】

特許文献1には、登場人物一覧表示機能を有する装置が開示されている。この装置は、映像コンテンツにおける登場人物の一覧として、映像コンテンツにおける登場人物それぞれの顔の画像を並べて表示する機能を有している。

【先行技術文献】

【特許文献】

【0004】

【特許文献1】特開2001−309269号公報

【発明の概要】

【発明が解決しようとする課題】

【0005】

ところで、顔の画像を並べて表示する場合、その顔画像は、表示サイズは勿論、画像内における顔の位置や大きさを揃えることが好ましい。そのためには、元画像からの顔領域の切り出し範囲を適宜に決定する必要がある。

【0006】

しかしながら、他の顔画像と顔の位置や大きさを揃えること、即ち、画像内における顔の位置や大きさが一定になることを考慮して、元画像からの顔領域の切り出し範囲を決定しようとすると、例えば顔領域が元画像の端部に位置する場合、その元画像をはみ出して切り出し範囲を決定せざるを得ない。よって、このような場合の調整を適切に行うための仕組みが必要である。

【0007】

この発明は、このような事情を考慮してなされたものであり、映像コンテンツデータからの人物の顔画像の抽出を適切に制御する電子機器、顔画像抽出制御方法およびプログラムを提供することを目的とする。

【課題を解決するための手段】

【0008】

実施形態によれば、電子機器は、映像コンテンツから人物の顔画像を抽出するための電子機器であって、検出手段と、調整手段と、抽出手段と、を有する。検出手段は、前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する。調整手段は、前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する。抽出手段は、前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する。

【図面の簡単な説明】

【0009】

【図1】本発明の一実施形態に係る電子機器の概観の例を示す斜視図

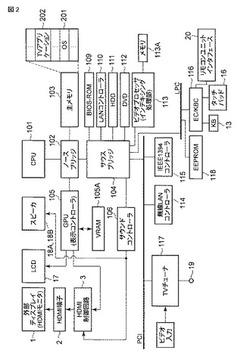

【図2】同実施形態の電子機器のシステム構成の例を示すブロック図

【図3】同実施形態の電子機器の顔画像一覧表示機能を説明するためのブロック図

【図4】同実施形態の電子機器で用いられる区間属性情報(属性検出結果情報)の例を示す図

【図5】同実施形態の電子機器で用いられるプログラムの機能構成を示すブロック図

【図6】同実施形態の電子機器によって表示装置に表示されるインデキシングビュー画面の例を示す図

【図7】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアの構成例を示す図

【図8】図6のインデキシングビュー画面内に含まれる、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの関係を説明するための図

【図9】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの間の連携表示制御を説明するための第1の図

【図10】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの間の連携表示制御を説明するための第2の図

【図11】同実施形態の電子機器によって抽出時に調整が施された顔画像の一覧表示例を示す図

【図12】同実施形態の電子機器によって実行される顔画像の抽出原理の第1の例を説明するための第1の図

【図13】同実施形態の電子機器によって実行される顔画像の抽出原理の第1の例を説明するための第2の図

【図14】同実施形態の電子機器によって実行される顔画像抽出処理の第1の手順の例を示すフローチャート

【図15】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第1の図

【図16】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第2の図

【図17】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第3の図

【図18】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第4の図

【図19】同実施形態の電子機器によって実行される顔画像抽出処理の第2の手順の例を示すフローチャート

【発明を実施するための形態】

【0010】

以下、図面を参照して、本発明の実施形態を説明する。

【0011】

まず、図1および図2を参照して、本発明の一実施形態に係る電子機器の構成を説明する。本実施形態の電子機器は、例えば、情報処理装置として機能するノートブック型の携帯型パーソナルコンピュータ10から実現されている。

【0012】

このパーソナルコンピュータ10は、放送番組データ、外部機器から入力されるビデオデータといった、映像コンテンツデータ(オーディオビジュアルコンテンツデータ)を記録および再生することができる。即ち、パーソナルコンピュータ10は、テレビジョン放送信号によって放送される放送番組データの視聴および録画を実行するためのテレビジョン(TV)機能を有している。このTV機能は、例えば、パーソナルコンピュータ10に予めインストールされているTVアプリケーションプログラムによって実現されている。また、TV機能は、外部のAV機器から入力されるビデオデータを記録する機能、および記録されたビデオデータおよび記録された放送番組データを再生する機能も有している。

【0013】

さらに、パーソナルコンピュータ10は、パーソナルコンピュータ10に格納されたビデオデータ、放送番組データのような映像コンテンツデータに登場する人物の顔画像の一覧等を表示する顔画像一覧表示機能と、同映像コンテンツデータから例えば等時間間隔で抽出された複数のフレームの各々に対応する画像(縮小画像)を表示するサムネイル画像表示機能とを有している。

【0014】

顔画像一覧表示機能およびサムネイル画像表示機能は、例えば、TV機能内にその一機能として実装されている。顔画像一覧表示機能は、映像コンテンツデータの概要等をユーザに提示するための映像インデキシング機能の一つである。この顔画像一覧表示機能は、映像コンテンツデータ全体の中のどの時間帯にどの人物が登場するのかをユーザに提示することができる。また、この顔画像一覧表示機能は、映像コンテンツデータ内に含まれる所定の属性区間に着目して人物の一覧を表示することもできる。

【0015】

図1はコンピュータ10のディスプレイユニットを開いた状態における斜視図である。本コンピュータ10は、コンピュータ本体11と、ディスプレイユニット12とから構成されている。ディスプレイユニット12には、TFT−LCD(Thin Film Transistor Liquid Crystal Display)17から構成される表示装置が組み込まれている。

【0016】

ディスプレイユニット12は、コンピュータ本体11に対し、コンピュータ本体11の上面が露出される開放位置とコンピュータ本体11の上面を覆う閉塞位置との間を回動自在に取り付けられている。コンピュータ本体11は薄い箱形の筐体を有しており、その上面にはキーボード13、本コンピュータ10をパワーオン/パワーオフするためのパワーボタン14、入力操作パネル15、タッチパッド16、およびスピーカ18A,18Bなどが配置されている。

【0017】

入力操作パネル15は、押されたボタンに対応するイベントを入力する入力装置であり、複数の機能をそれぞれ起動するための複数のボタンを備えている。これらボタン群には、TV機能(視聴、録画、録画された放送番組データ/ビデオデータの再生)を制御するための操作ボタン群も含まれている。また、コンピュータ本体11の正面には、本コンピュータ10のTV機能をリモート制御するリモコンユニットとの通信を実行するためのリモコンユニットインタフェース部20が設けられている。リモコンユニットインタフェース部20は、赤外線信号受信部などから構成されている。

【0018】

コンピュータ本体11の例えば右側面には、TV放送用のアンテナ端子19が設けられている。また、コンピュータ本体11の例えば背面には、例えばHDMI(high-definition multimedia interface)規格に対応した外部ディスプレイ接続端子が設けられている。この外部ディスプレイ接続端子は、放送番組データのような映像コンテンツデータに含まれる映像データ(動画像データ)を外部ディスプレイに出力するために用いられる。

【0019】

次に、図2を参照して、本コンピュータ10のシステム構成について説明する。

【0020】

本コンピュータ10は、図2に示されているように、CPU101、ノースブリッジ102、主メモリ103、サウスブリッジ104、グラフィクスプロセッシングユニット(GPU)105、ビデオメモリ(VRAM)105A、サウンドコントローラ106、BIOS−ROM109、LANコントローラ110、ハードディスクドライブ(HDD)111、DVDドライブ112、ビデオプロセッサ113、メモリ113A、カードコントローラ113、無線LANコントローラ114、IEEE 1394コントローラ115、エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116、TVチューナ117、およびEEPROM118等を備えている。

【0021】

CPU101は本コンピュータ10の動作を制御するプロセッサであり、ハードディスクドライブ(HDD)111から主メモリ103にロードされる、オペレーティングシステム(OS)201、およびTVアプリケーションプログラム202のような各種アプリケーションプログラムを実行する。TVアプリケーションプログラム202はTV機能を実行するためのソフトウェアである。このTVアプリケーションプログラム202は、TVチューナ117によって受信された放送番組データを視聴するためのライブ再生処理、受信された放送番組データをHDD111に記録する録画処理、およびHDD111に記録された放送番組データ/ビデオデータを再生する再生処理等を実行する。また、CPU101は、BIOS−ROM109に格納されたBIOS(Basic Input Output System)も実行する。BIOSはハードウェア制御のためのプログラムである。

【0022】

ノースブリッジ102はCPU101のローカルバスとサウスブリッジ104との間を接続するブリッジデバイスである。ノースブリッジ102には、主メモリ103をアクセス制御するメモリコントローラも内蔵されている。また、ノースブリッジ102は、PCI EXPRESS規格のシリアルバスなどを介してGPU105との通信を実行する機能も有している。

【0023】

GPU105は、本コンピュータ10のディスプレイモニタとして使用されるLCD17を制御する表示コントローラである。このGPU105によって生成される表示信号はLCD17に送られる。また、GPU105は、HDMI制御回路3およびHDMI端子2を介して、外部ディスプレイ装置1にデジタル映像信号を送出することもできる。

【0024】

HDMI端子2は上述の外部ディスプレイ接続端子である。HDMI端子2は、非圧縮のデジタル映像信号と、デジタルオーディオ信号とを一本のケーブルでテレビのような外部ディスプレイ装置1に送出することができる。HDMI制御回路3は、HDMIモニタと称される外部ディスプレイ装置1にデジタル映像信号をHDMI端子2を介して送出するためのインタフェースである。

【0025】

サウスブリッジ104は、LPC(Low Pin Count)バス上の各デバイス、およびPCI(Peripheral Component Interconnect)バス上の各デバイスを制御する。また、サウスブリッジ104は、ハードディスクドライブ(HDD)111およびDVDドライブ112を制御するためのIDE(Integrated Drive Electronics)コントローラを内蔵している。さらに、サウスブリッジ104は、サウンドコントローラ106との通信を実行する機能も有している。

【0026】

またさらに、サウスブリッジ104には、PCI EXPRESS規格のシリアルバスなどを介してビデオプロセッサ113が接続されている。

【0027】

ビデオプロセッサ113は、前述の映像インデキシングに関する各種処理を実行するプロセッサである。このビデオプロセッサ113は、映像インデキシング処理を実行するためのインデキシング処理部として機能する。すなわち、映像インデキシング処理においては、ビデオプロセッサ113は、映像コンテンツデータに含まれる動画像データから複数の顔画像を抽出すると共に、抽出された各顔画像が映像コンテンツデータ内に登場する時点を示すタイムスタンプ情報、等を出力する。顔画像の抽出は、例えば、動画像データの各フレームから顔領域を検出する顔検出処理、検出された顔領域をフレームから切り出す切り出し処理等によって実行される。顔領域の検出は、例えば、各フレームの画像の特徴を解析して、予め用意された顔画像特徴サンプルと類似する特徴を有する領域を探索することによって行うことができる。顔画像特徴サンプルは、多数の人物それぞれの顔画像特徴を統計的に処理することによって得られた特徴データである。

【0028】

さらに、ビデオプロセッサ113は、例えば、映像コンテンツデータ内に含まれるコマーシャル(CM)区間を検出する処理、および音声インデキシング処理も実行する。通常、各CM区間の時間長は、予め決められた幾つかの時間長の内の1つに設定されている。また、CM区間の前後には一定時間長の無音期間が存在する。したがって、CM区間の検出処理においては、例えば、映像コンテンツデータ内に含まれるオーディオデータが分析され、一定時間長の無音区間が検出される。そして、検出された連続する2つの無音区間に挾まれ、且つ一定値以上の時間長を有する部分データを含む区間が、CM区間として検出される。

【0029】

音声インデキシング処理は、映像コンテンツデータ内に含まれるオーディオデータを分析して、映像コンテンツデータ内に含まれる、音楽が流れている音楽区間、および人物によるトークが行われているトーク区間を検出するインデキシング処理である。音声インデキシング処理においては、例えば、オーディオデータの周波数スペクトルの特徴が分析され、その周波数スペクトルの特徴に応じて、音楽区間、およびトーク区間が検出される。音楽区間に対応する周波数スペクトルの特徴と、トーク区間に対応する周波数スペクトルの特徴とは互いに異なるので、周波数スペクトルの特徴を分析することによって、音楽区間およびトーク区間のそれぞれを検出することができる。また、音楽区間に対応する周波数スペクトルの特徴とトーク区間に対応する周波数スペクトルの特徴とが混ざり合った周波数スペクトルを有する区間は、音楽区間とトーク区間とが重なった重畳区間として検出することができる。

【0030】

トーク区間の検出処理においては、例えば、話者セグメンテーション技術または話者クラスタリング技術等が用いられ、これによって話者の切り替わりも検出される。同一の話者(または同一の話者グループ)が連続してトークしている期間が、一つのトーク区間となる。

【0031】

さらに、音声インデキシング処理は、映像コンテンツデータ内の各部分データ(一定時間長のデータ)毎に歓声レベルを検出する歓声レベル検出処理、および映像コンテンツデータ内の各部分データ毎に盛り上がりレベルを検出する盛り上がりレベル検出処理を実行する。

【0032】

歓声レベルは、歓声の大きさを示す。歓声は、大勢の人の声が合わさった音である。大勢の人の声が合わさった音は、ある特定の周波数スペクトルの分布を有する。歓声レベル検出処理においては、映像コンテンツデータに含まれるオーディオデータの周波数スペクトルが分析され、そしてその周波数スペクトルの分析結果に従って、各部分データの歓声レベルが検出される。盛り上がりレベルは、ある一定以上の音量レベルがある一定時間長以上連続的に発生する区間の音量レベルである。例えば、比較的盛大な拍手、大きな笑い声のような音の音量レベルが、盛り上がりレベルである。盛り上がりレベル検出処理においては、映像コンテンツデータに含まれるオーディオデータの音量の分布が分析され、その分析結果に従って、各部分データの盛り上がりレベルが検出される。

【0033】

メモリ113Aは、ビデオプロセッサ113の作業メモリとして用いられる。インデキシング処理(CM検出処理、映像インデキシング処理、および音声インデキシング処理)を実行するためには多くの演算量が必要とされる。本実施形態においては、CPU101とは異なる専用のプロセッサであるビデオプロセッサ113がバックエンドプロセッサとして使用され、このビデオプロセッサ113によってインデキシング処理が実行される。よって、CPU101の負荷の増加を招くことなく、インデキシング処理を実行することが出来る。なお、CM検出処理は上述したようにオーディオデータを解析することによって実行することができるので、以下では、CM検出処理を音声インデキシング処理内の1つの処理として扱うことにする。

【0034】

サウンドコントローラ106は音源デバイスであり、再生対象のオーディオデータをスピーカ18A,18BまたはHDMI制御回路3に出力する。

【0035】

無線LANコントローラ114は、たとえばIEEE 802.11規格の無線通信を実行する無線通信デバイスである。IEEE 1394コントローラ115は、IEEE 1394規格のシリアルバスを介して外部機器との通信を実行する。

【0036】

エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、電力管理のためのエンベデッドコントローラと、キーボード(KB)13およびタッチパッド16を制御するためのキーボードコントローラとが集積された1チップマイクロコンピュータである。このエンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、ユーザによるパワーボタン14の操作に応じて本コンピュータ10をパワーオン/パワーオフする機能を有している。さらに、エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、リモコンユニットインタフェース20との通信を実行する機能を有している。

【0037】

TVチューナ117はテレビジョン(TV)放送信号によって放送される放送番組データを受信する受信装置であり、アンテナ端子19に接続されている。このTVチューナ117は、例えば、地上波デジタルTV放送のようなデジタル放送番組データを受信可能なデジタルTVチューナとして実現されている。また、TVチューナ117は、外部機器から入力されるビデオデータをキャプチャする機能も有している。

【0038】

次に、図3を参照して、TVアプリケーションプログラム202によって実行される顔画像一覧表示機能について説明する。

【0039】

放送番組データのような映像コンテンツデータに対するインデキシング処理(映像インデキシング処理、および音声インデキシング処理)は、上述したように、インデキシング処理部として機能するビデオプロセッサ113によって実行される。

【0040】

ビデオプロセッサ113は、TVアプリケーションプログラム202の制御の下、例えば、ユーザによって指定された録画済みの放送番組データ等の映像コンテンツデータに対してインデキシング処理を実行する。また、ビデオプロセッサ113は、TVチューナ117によって受信された放送番組データをHDD111に格納する録画処理と並行して、当該放送番組データに対するインデキシング処理を実行することもできる。

【0041】

映像インデキシング処理(顔画像インデキシング処理とも云う)においては、ビデオプロセッサ113は、映像コンテンツデータに含まれる動画像データをフレーム単位で解析する。そして、ビデオプロセッサ113は、動画像データを構成する複数のフレームそれぞれから人物の顔画像を抽出すると共に、抽出された各顔画像が映像コンテンツデータ内に登場する時点を示すタイムスタンプ情報を出力する。各顔画像に対応するタイムスタンプ情報としては、映像コンテンツデータの開始から当該顔画像が登場するまでの経過時間、または当該顔画像が抽出されたフレーム番号、等を使用することが出来る。

【0042】

さらに、ビデオプロセッサ113は、抽出された各顔画像のサイズ(解像度)も出力する。ビデオプロセッサ113から出力される顔検出結果データ(顔画像、タイムスタンプ情報TS、およびサイズ)は、データベース111Aに顔画像インデキシング情報として格納される。このデータベース111Aは、HDD111内に用意されたインデキシングデータ記憶用の記憶領域である。

【0043】

なお、この映像インデキシング処理においては、ビデオプロセッサ113は、顔画像一覧表示機能の顔画像抽出処理と並行して、サムネイル画像表示機能のサムネイル画像取得処理も実行する。サムネイル画像は、映像コンテンツデータから例えば等時間間隔で抽出された複数のフレームの各々に対応する画像(縮小画像)である。すなわち、ビデオプロセッサ113は、顔画像を含むフレームであるか否かに関係なく、映像コンテンツデータから例えば所定の等時間間隔でフレームを順次抽出し、抽出した各フレームに対応する画像(サムネイル画像)と、そのサムネイル画像が出現する時点を示すタイムスタンプ情報TSとを出力する。ビデオプロセッサ113から出力されるサムネイル画像取得結果データ(サムネイル、タイムスタンプ情報TS)も、データベース111Aにサムネイルインデキシング情報として格納される。

【0044】

また、音声インデキシング処理においては、ビデオプロセッサ113は、映像コンテンツに含まれるオーディオデータを分析して、映像コンテンツデータ内に含まれる複数種の属性区間(CM区間、音楽区間、およびトーク区間)を検出し、検出された各属性区間の開始時点および終了時点を示す区間属性情報を出力する。この区間属性情報は、属性検出結果情報としてデータベース111Aに格納される。さらに、音声インデキシング処理においては、ビデオプロセッサ113は、上述の歓声レベル検出処理および盛り上がりレベル検出処理も実行する。これら歓声レベル検出処理の結果および盛り上がりレベル検出処理の結果も、上述の属性検出結果情報の一部としてデータベース111Aに格納される。

【0045】

属性検出結果情報(区間属性情報)は、図4に示されているように、例えば、CM区間テーブル、音楽区間テーブル、トーク区間テーブル、および歓声/盛り上がりテーブルから構成されている。

【0046】

CM区間テーブルは、検出されたCM区間の開始時点および終了時点を示すCM区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数のCM区間が存在する場合には、それら複数のCM区間それぞれに対応するCM区間属性情報がCM区間テーブルに格納される。CM区間テーブルにおいては、検出された各CM区間毎に当該CM区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0047】

音楽区間テーブルは、検出された音楽区間の開始時点および終了時点を示す音楽区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数の音楽区間が存在する場合には、それら複数の音楽区間それぞれに対応する音楽区間属性情報が音楽区間テーブルに格納される。音楽区間テーブルにおいては、検出された各音楽区間毎に当該音楽区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0048】

トーク区間テーブルは、検出されたトーク区間の開始時点および終了時点を示す音楽区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数のトーク区間が存在する場合には、それら複数のトーク区間それぞれに対応するトーク区間属性情報がトーク区間テーブルに格納される。トーク区間テーブルにおいては、検出された各トーク区間毎に当該トーク区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0049】

歓声/盛り上がりテーブルは、映像コンテンツデータ内の一定時間長の部分データ(タイムセグメントT1,T2,T3,…)それぞれにおける歓声レベルおよび盛り上がりレベルを格納する。

【0050】

図3に示されているように、TVアプリケーションプログラム202は、顔画像一覧表示機能を実行するための顔画像一覧表示処理部301を含んでいる。この顔画像一覧表示処理部301は、例えば、インデキシングビューワプログラムとして実現されており、データベース111Aに格納されたインデキシング情報(顔画像インデキシング情報、サムネイルインデキシング情報、区間属性情報、等)を用いて、映像コンテンツデータの概要を俯瞰するためのインデキシングビュー画面を表示する。

【0051】

具体的には、顔画像一覧表示処理部301は、データベース111Aから顔画像インデキシング情報(顔画像、タイムスタンプ情報TS、およびサイズ)を読み出し、そしてその顔画像インデキシング情報を用いて、映像コンテンツデータに登場する人物の顔画像の一覧を、インデキシングビュー画面上の2次元の表示エリア(以下、顔サムネイル表示エリアと称する)上に表示する。この場合、顔画像一覧表示処理部301は、映像コンテンツデータの総時間長を、例えば等間隔で、複数の時間帯に分割し、時間帯毎に、抽出された顔画像の内から当該時間帯に登場する顔画像を所定個選択する。そして、顔画像一覧表示処理部301は、時間帯毎に、選択した所定個の顔画像それぞれを並べて表示する。

【0052】

すなわち、2次元の顔サムネイル表示エリアは、複数の行および複数の列を含むマトリクス状に配置された複数の顔画像表示エリアを含む。複数の列それぞれには、映像コンテンツデータの総時間長を構成する複数の時間帯が割り当てられている。具体的には、例えば、複数の列それぞれには、映像コンテンツデータの総時間長をこれら複数の列の数で等間隔に分割することによって得られる、互いに同一の時間長を有する複数の時間帯がそれぞれ割り当てられる。もちろん、各列に割り当てられる時間帯は必ずしも同一の時間長でなくてもよい。

【0053】

顔画像一覧表示処理部301は、顔画像それぞれに対応するタイムスタンプ情報TSに基づき、各列内に属する行数分の顔画像表示エリア上に、当該各列に割り当てられた時間帯に属する顔画像それぞれを、例えば、それら顔画像の出現頻度順(顔画像の検出時間長順)のような順序で並べて表示する。この場合、例えば、当該各列に割り当てられた時間帯に属する顔画像の内から、出現頻度(登場頻度)の高い順に顔画像が行数分だけ選択され、選択された顔画像が登場頻度順に上から下に向かって並んで配置される。もちろん、出現頻度順ではなく、各列に割り当てられた時間帯に出現する顔画像それぞれを、その出現順に並べて表示してもよい。

【0054】

この顔画像一覧表示機能により、映像コンテンツデータ全体の中のどの時間帯にどの人物が登場するのかをユーザに分かりやすく提示することができる。顔サムネイル表示エリアの具体的な構成例については、図6以降で後述する。

【0055】

また、顔画像一覧表示処理部301は、サムネイル画像表示機能も併せて実行する。顔画像一覧表示処理部301は、データベース111Aからサムネイルインデキシング情報(サムネイル、タイムスタンプ情報TS)を読み出し、そしてサムネイルインデキシング情報を用いて、サムネイル画像それぞれを、顔サムネイル表示エリアの下方側または上方側の一方に配置されたサムネイル表示エリア(以下、じゃばらサムネイル表示エリアと称する)上に、それらサムネイル画像の出現時間順に一列に並べて表示する。

【0056】

映像コンテンツデータによっては、顔画像が登場しない時間帯も存在する。したがって、インデキシングビュー画面上に顔サムネイル表示エリアのみならず、じゃばらサムネイル表示エリアも表示することにより、顔画像が登場しない時間帯においても、その時間帯の映像コンテンツデータの内容をユーザに提示することができる。

【0057】

さらに、顔画像一覧表示処理部301は、データベース111Aから区間属性情報(CM区間属性情報、音楽区間属性情報、トーク区間属性情報)を読み出し、その区間属性情報に従って、映像コンテンツデータの開始位置から終端位置までのシーケンス内における各属性区間(CM区間、音楽区間、トーク区間)の位置(開始時点から終了時点までの区間)を示すバー領域を含む区間バーを、インデキシングビュー画面上の顔サムネイル表示エリアの下方側または上方側の一方に表示する。この区間バーは、例えば、3つのサブ区間バー、つまりCM区間の位置を示すCM区間バー、音楽区間の位置を示す音楽区間バー、トーク区間の位置を示すトーク区間バーを含んでいる。

【0058】

シーケンス内に複数のCM区間が存在する場合、複数のCM区間それぞれの位置を示す複数のバー領域がCM区間バー内に表示される。同様に、シーケンス内に複数の音楽区間が存在する場合には複数の音楽区間それぞれの位置を示す複数のバー領域が音楽区間バー内に表示され、シーケンス内に複数のトーク区間が存在する場合には複数のトーク区間それぞれの位置を示す複数のバー領域がトーク区間バー内に表示される。以下では、シーケンス内に分散して存在する複数のCM区間の各々を部分CM区間と称し、シーケンス内に分散して存在する複数の音楽区間のそれぞれを部分音楽区間と称し、シーケンス内に分散して存在する複数のトーク区間のそれぞれを部分トーク区間と称する。

【0059】

インデキシングビュー画面上に区間バーを表示することにより、顔サムネイル表示エリア内の各顔画像がどのような属性区間(CM区間、音楽区間、トーク区間)に登場する人物の顔画像であるかを、ユーザに提示することができる。したがって、ユーザは、登場人物と、区間属性とを考慮して、映像コンテンツデータ全体の中から再生を開始すべきデータ位置を見つけることができる。

【0060】

さらに、顔画像一覧表示処理部301は、データベース111Aから歓声レベル情報および盛り上がりレベル情報を読み出し、それら歓声レベル情報および盛り上がりレベル情報に従って、映像コンテンツデータの開始位置から終端位置までのシーケンス内における歓声レベルの変化および盛り上がりレベルの変化をそれぞれ示すグラフを、インデキシングビュー画面上の顔サムネイル表示エリアの下方側または上方側の一方に配置されたレベル表示エリア上に表示する。

【0061】

このレベル表示エリアを見ることにより、ユーザに、映像コンテンツデータ内のどの辺りに大きな歓声が生じた区間が存在し、また映像コンテンツデータ内のどの辺りに盛り上がりの大きな区間が存在するかを提示することができる。ユーザは、登場人物と、区間属性と、歓声レベルと、盛り上がりレベルとを考慮して、映像コンテンツデータ全体の中から再生を開始すべきデータ位置を見つけることができる。

【0062】

次に、図5を参照して、TVアプリケーションプログラム202の機能構成を説明する。

【0063】

TVアプリケーションプログラム202は、上述の顔画像一覧表示処理部301に加え、記録処理部401、インデキシング制御部402、再生処理部403等を備えている。

【0064】

記録処理部401は、TVチューナ117によって受信された放送番組データ、または外部機器から入力されるビデオデータをHDD111に記録する記録処理を実行する。また、記録処理部401は、ユーザによって予め設定された録画予約情報(チャンネル番号、日時)によって指定される放送番組データをTVチューナ117を用いて受信し、その放送番組データをHDD111に記録する予約録画処理も実行する。

【0065】

インデキシング制御部402は、ビデオプロセッサ(インデキシング処理部)113を制御して、インデキシング処理(映像インデキシング処理、音声インデキシング処理)をビデオプロセッサ113に実行させる。ユーザは、録画対象の放送番組データ毎にインデキシング処理を実行するか否かを指定することができる。例えば、インデキシング処理の実行が指示された録画対象の放送番組データについては、その放送番組データがHDD111に記録された後に、インデキシング処理が自動的に開始される。また、ユーザは、既にHDD111に格納されている映像コンテンツデータの内から、インデキシング処理を実行すべき映像コンテンツデータを指定することもできる。

【0066】

再生処理部403は、HDD111に格納されている各映像コンテンツデータを再生する処理を実行する。また、再生処理部403は、ある映像コンテンツデータの顔画像一覧の中の一つの顔画像が選択されている状態でユーザ操作によって再生指示イベントが入力された時、選択されている顔画像が登場する時点よりも所定時間前の時点から映像コンテンツデータの再生を開始する機能を有している。

【0067】

ユーザは、複数の属性区間を選択的に指定することにより、様々な属性に着目した顔画像一覧を見ながら、映像コンテンツデータの再生位置を決定することができる。

【0068】

次に、図6乃至図11を参照して、インデキシングビュー画面の具体的な構成について説明する。

【0069】

図6には、顔画像一覧表示処理部301によってLCD17に表示されるインデキシングビュー画面の例が示されている。このインデキシングビュー画面は、ある映像コンテンツデータ(例えば放送番組データ)をインデキシング処理することによって得られた画面である。このインデキシングビュー画面には、顔画像の一覧を表示するための上述の顔サムネイル表示エリアと、上述のレベル表示エリアと、上述の区間バーと、サムネイル画像の一覧をじゃばら形式で表示するための上述のじゃばらサムネイル表示エリアとを含んでいる。

【0070】

ここで、じゃばら形式とは、選択されているサムネイル画像を通常サイズ(フルサイズ)で表示し、他の各サムネイル画像についてはその横方向サイズを縮小して表示する表示形式である。図6においては、選択されたサムネイル画像との距離が大きいサムネイル画像ほど、その横方向サイズが縮小されている。

【0071】

レベル表示エリアにおいては、歓声レベルの変化を示すグラフ(図6中の濃い色で示されるグラフ)と、歓声レベルの変化を示すグラフ(図6中の薄い色で示されるグラフ)が表示される。

【0072】

区間バーは、トーク区間バーと、音楽区間バーと、CM区間バーとを含んでいる。CM区間バーにおいては、各CM区間(各部分CM区間)の位置にバー領域(図6の黒色の帯状領域)が表示される。音楽区間バーにおいては、各音楽区間(各部分音楽区間)の位置にバー領域(図6のクロスハッチングされた帯状領域)が表示される。トーク区間バーにおいては、各トーク区間(各部分トーク区間)の位置にバー領域(図6のハッチングされた帯状領域)が表示される。ユーザは、リモコンユニットのボタン、上下左右等のカーソルキーの操作により、トーク区間バー、音楽区間バーと、CM区間バーのいずれか一つを選択することができる。また、ユーザは、リモコンユニットのボタン、上下左右等のカーソルキーの操作により、選択された区間バー内の一つのバー領域を選択することもできる。

【0073】

図7は、顔サムネイル表示エリアの構成例が示されている。

【0074】

顔サムネイル表示エリアは、複数の行と複数の列とを含むマトリクス状に配置された複数個の顔画像表示エリアを含んでいる。図7においては、顔サムネイル表示エリアは6行×16列から構成されている。顔サムネイル表示エリアに含まれる顔画像表示エリアの数は、96個である。

【0075】

列1〜列16のそれぞれには、例えば、映像コンテンツデータの総時間長を列数(=16)で等間隔で分割することによって得られる、互いに同一の時間長Tを有する複数の時間帯がそれぞれ割り当てられる。

【0076】

例えば、映像コンテンツデータの総時間長が2時間であるならば、その2時間が16個の時間帯に等間隔で分割される。この場合、各時間帯の時間長Tは、7.5分である。例えば、列1には、先頭0:00:00から0:07:30までの時間帯が割り当てられ、列2には、0:07:30から0:15:00までの時間帯が割り当てられ、列3には、0:15:00から0:22:30までの時間帯が割り当てられる。映像コンテンツデータの総時間長に応じて、各時間帯の時間長Tは変化する。

【0077】

もちろん、複数の列それぞれに割り当てられる時間帯の長さは、必ずしも同一である必要はない。

【0078】

顔画像一覧表示処理部301は、ビデオプロセッサ113によって抽出された顔画像それぞれに対応するタイムスタンプ情報に基づき、各列内の6個の顔画像表示エリア上に、当該各列に割り当てられた時間帯に属する顔画像それぞれをたとえば上述の頻度順に並べて表示する。この場合、顔画像一覧表示処理部301は、表示処理対象の列に割り当てられた時間帯に属する顔画像の内から行数分(6個)の顔画像を選択し、選択した行数分の顔画像それぞれを並べて表示する。

【0079】

このように、顔サムネイル表示エリアにおいては、左端位置(1,1)を基点とし、右端位置(6,16)を映像コンテンツデータの終端とする時間軸が用いられている。

【0080】

顔サムネイル表示エリアの各顔画像表示エリアに表示される顔画像のサイズは“大”、“中”、“小”の内からユーザが選択することができる。行と列の数は、ユーザが選択した顔画像のサイズに応じて変化される。顔画像のサイズと行と列の数との関係は、次の通りである。

【0081】

(1)“大”の場合; 3行×8列

(2)“中”の場合; 6行×16列

(3)“小”の場合: 10行×24列

“大”の場合においては、各顔画像は、例えば、180×180ピクセルのサイズで表示される。“中”の場合においては、各顔画像は、例えば、90×90ピクセルのサイズで表示される。“小”の場合においては、各顔画像は、例えば、60×60ピクセルのサイズで表示される。デフォルトの顔画像サイズは、例えば、“中”に設定されている。

【0082】

顔サムネイル表示エリア内の各顔画像は、選択されていない“標準”状態、選択されている“フォーカス”状態の2つの状態のいずれかに設定される。“フォーカス”状態の顔画像のサイズは、“標準”状態の時のサイズ(180×180、90×90、または60×60)よりも大きく設定される。図7においては、座標(5,12)の顔画像が“フォーカス”状態である場合を示している。

【0083】

じゃばらサムネイル表示エリアに表示されるサムネイル画像の枚数は、ユーザ設定に従って、例えば240枚、144枚、96枚、48枚のいずれかに設定される。デフォルトは例えば240枚である。

【0084】

サムネイル画像は、選択されていない“標準”状態、選択されている“フォーカス”状態の2つの状態のいずれかに設定される。“フォーカス”状態のサムネイル画像は、他のサムネイル画像よりも大きいサイズで表示される。

【0085】

次に、図8を参照して、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの関係について説明する。

【0086】

同一列に属する顔画像表示エリア群の集合、つまり顔サムネイル表示エリア内の個々の列を“大区間”と称する。また、“大区間”をさらに分割したものを“小区間”と称する。1つの大区間に含まれる小区間の数は、じゃばらサムネイル表示エリアに表示されるサムネイル画像の数を顔サムネイル表示エリアの列数で割った商で与えられる。例えば、顔サムネイル表示エリアが6行×16列で、じゃばらサムネイル表示エリアに表示されるサムネイル画像の数が240枚であるならば、1つの大区間に含まれる小区間の数は、15(=240÷16)となる。1つの大区間は15個の小区間を含む。換言すれば、1つの大区間に対応する時間帯には、15枚のサムネイル画像が属することになる。

【0087】

また、顔画像一覧表示処理部301は、大区間とサムネイル画像との間を接続する縦長のバーを表示する。この縦長のバーは、あるサムネイル画像に対応する小区間が、大区間に含まれる15個の小区間の内のどの小区間に対応するかを提示するために使用される。縦長のバーは、大区間に含まれる15個の小区間の内で、サムネイル画像に対応する小区間の位置に表示される。例えば、あるサムネイル画像が、ある大区間に対応する時間帯に属する15枚のサムネイル画像の内の先頭の画像、つまり大区間内の先頭の小区間に対応する画像であるならば、当該サムネイル画像は、縦長のバーによって大区間の左端に接続される。また、例えば、あるサムネイル画像が、ある大区間に対応する時間帯に属する15枚のサムネイル画像の内の終端の画像、つまり大区間内の終端の小区間に対応する画像であるならば、当該サムネイル画像は、縦長のバーによって大区間の右端に接続される。

【0088】

さらに、顔画像一覧表示処理部301は、サムネイル画像のタイムスタンプ情報に基づいて、そのサムネイル画像が出現する時点を示す時間情報もインデキシングビュー画面上に表示する。

【0089】

“現在位置変更”ボタンは、選択対象のサムネイル画像を変更するための操作ボタンである。“現在位置変更”ボタンがフォーカスされている状態でユーザが左カーソルキーまたは右カーソルキーを操作すると、選択対象のサムネイル画像は、例えば1小区間単位で左または右に移動する。

【0090】

このような関係を有する顔サムネイル表示エリアとじゃばらサムネイル表示エリアとを含むインデキシングビュー画面において、顔サムネイル表示エリア上のある顔画像がユーザによって選択されると、顔画像一覧表示処理部301は、その顔画像のタイムスタンプ情報で示される時刻を含む小区間を特定して、当該小区間に対応するサムネイル画像を通常サイズで表示すべく、じゃばらサムネイル表示エリアにおけるサムネイル画像の表示制御を行う。

【0091】

即ち、図9に示すように、ある顔画像(a1)がユーザによって選択されると、それに連動して、その顔画像の人物が登場する時間帯のサムネイル画像(a2)が自動的に選択されて追従表示されることになる。

【0092】

逆に、このインデキシングビュー画面において、じゃばらサムネイル表示エリア上のあるサムネイル画像がユーザによって選択されると、顔画像一覧表示処理部301は、そのサムネイル画像に対応する小区間内の時刻をタイムスタンプ情報としてもつ顔画像を検出し、その検出した顔画像すべてを他の顔画像と区別可能に強調表示する。

【0093】

即ち、図10に示すように、あるサムネイル画像(b1)がユーザによって選択されると、それに連動して、そのサムネイル画像に対応する小区間内に登場する人物の顔画像が自動的に選択されて強調表示(b2)されることになる。

【0094】

従って、ユーザは、第1に、顔サムネイル表示エリア上の顔画像を選択することで、当該顔画像の人物が登場する時間帯(場面)のサムネイル画像をじゃばらサムネイル表示エリア上で確認することができ、第2に、じゃばらサムネイル表示エリア上のサムネイル画像を選択することで、そのサムネイル画像に対応する時間帯に登場する人物の顔画像を顔サムネイル表示エリア上で確認することができる。

【0095】

この確認を行った後、ユーザは、顔サムネイル表示エリア上の顔画像を選択した状態で映像コンテンツデータの再生開始を指示すれば、その顔画像のタイムスタンプ情報で示される時刻よりも所定時間前の時点から当該映像コンテンツデータの再生を開始でき、じゃばらサムネイル表示エリア上のサムネイル画像を選択した状態で映像コンテンツデータの再生開始を指示すれば、そのサムネイル画像に対応する小区間の先頭位置(時点)から当該映像コンテンツデータの再生を開始できる。

【0096】

このように、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとが連動して表示制御される本コンピュータ10においては、所望の人物が登場する場面の映像を簡単な操作に応じて提示でき、また、各場面に登場する人物の顔画像を簡単な操作に応じて提示できる。

【0097】

ところで、顔サムネイル表示エリアに表示される各顔画像は、図6に示したように、画像内における顔の位置や大きさが揃っている。即ち、ビデオプロセッサ113は、映像コンテンツデータの各フレームから顔領域を切り出す際、その切り出し範囲を適宜に決定する機能を有している。

【0098】

ここで、例えば顔領域がフレームの端部に位置する場合を想定する。この場合、画像内における顔の位置や大きさが一定になるように顔領域の切り出し範囲を決定すると、その切り出し範囲はフレームをはみ出すことになってしまう。そこで、本コンピュータ10では、ビデオプロセッサ113が、決定した切り出し範囲がフレーム外に及んだ場合における調整機能を備える。以下、この点について詳述する。

【0099】

図11は、本コンピュータ10のビデオプロセッサ113が備える調整機能の第1の例を示す図である。

【0100】

図中、符号aで示されるハッチングがなされた各所がビデオプロセッサ113による調整が施された部分であり、例えば1行目15列目の顔画像は、フレームの右上端部に位置する顔領域を切り出したものである。このような、顔領域が端部に位置するフレームからのビデオプロセッサ113による顔画像の抽出原理を、図12および図13を参照して説明する。

【0101】

図12は、通常の顔画像の抽出原理を示す図であり、ビデオプロセッサ113は、顔領域を検出すると、その顔の位置や大きさが一定となるように切り出し範囲(破線の枠)を決定し、その範囲内の画像を顔サムネイル表示エリア上での表示サイズに揃えるべく拡縮することで顔画像を抽出する。一方、図13は、決定した切り出し範囲がフレームをはみ出してしまう場合の顔画像の抽出原理を示す図であり、図13(A)に示すように、決定した切り出し範囲がフレームをはみ出してしまった場合、ビデオプロセッサ113は、図13(B)に示すように、フレーム内の画像を取り出すことに加えて、フレーム外の欠損部分を所定の色でマスキングすることにより、顔の位置や大きさが一定となった顔画像の抽出を実現する。このマスキングの色は、予め指定された色を使用してもよいが、顔の輪郭線周辺の色を各々採取して使用するようにしてもよい。

【0102】

次に、図14のフローチャートを参照して、ビデオプロセッサ113によって実行される顔画像抽出処理の手順を説明する。

【0103】

まず、ビデオプロセッサ113は、処理対象のフレーム内で顔領域を探索する(ステップS101)。もし、顔領域が検出されたら(ステップS102のYES)、ビデオプロセッサ113は、切り出すべき範囲がフレーム内に収まっているかどうかを調べる(ステップS103)。フレーム内に収まっていれば(ステップS103のYES)、ビデオプロセッサ113は、その領域の切り出しをそのまま実行する(ステップS104)。

【0104】

一方、フレーム内に収まっていなければ(ステップS103のNO)、ビデオプロセッサ113は、フレーム内の領域を切り出すと共に、それ以外の領域をマスキングにより補充する(ステップS105)。そして、ビデオプロセッサ113は、切り出した顔画像をデータベースへ格納する(ステップS106)。

【0105】

この切り出した顔画像のデータベースへの格納の完了後、または、顔領域が検出されなかった場合(ステップS102のNO)、ビデオプロセッサ113は、残りのフレームが存在するかどうかを調べて(ステップS107)、存在すれば(ステップS107のYES)、ステップS101からの処理を繰り返し、また、存在しなければ(ステップS107のNO)、この処理を終了する。

【0106】

続いて、図15乃至図18を参照して、顔領域が端部に位置するフレームからのビデオプロセッサ113による顔画像の第2の抽出原理を説明する。

【0107】

以上の説明では、画像内における顔の位置や大きさを一定にするために生じる欠損部分をマスキングする調整方法を示したが、ここでは、ある程度の顔の位置のずれや顔の大きさのばらつきを許容する調整方法を説明する。

【0108】

図13(A)に示したケースと同様、図15に示すように、決定した切り出し範囲がフレームをはみ出してしまった場合、ビデオプロセッサ113は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる。この場合、顔の位置は他の顔画像と比較して若干右上にずれることになるが、フレーム内の画像のみで顔画像の抽出を行うことが可能となる。

【0109】

一方、図16には、このような移動が行えないケースが示されている。図16(A)に示すケースの場合、切り出し領域を左上方向に移動させたとしても、移動先において左上部がフレーム外にはみ出してしまう。また、図16(B)に示すケースの場合は、上下両方向にはみ出しているので、そもそも移動が行えない。

【0110】

このような場合、ビデオプロセッサ113は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる。より具体的に説明すると、図16(A)に示したケースの場合には、ビデオプロセッサ113は、図17に示すように、切り出し領域の左上端部を固定した状態で、切り出し領域の右下端部を対角線上中心に向けるように縮小し、切り出し範囲をフレーム内に収める。同様に、図16(B)に示したケースの場合、ビデオプロセッサ113は、図18に示すように、切り出し領域の左上端部および右下端部の両方を対角線上中心に向けるように縮小し、切り出し範囲をフレーム内に収める。

【0111】

この場合、顔の大きさは他の顔画像と比較して若干異なる(大きくなる)が、フレーム内の画像のみで顔画像の抽出を行うことが可能となる。

【0112】

図19は、ビデオプロセッサ113によって実行される顔画像抽出処理の第2の手順を示すフローチャートである。

【0113】

まず、ビデオプロセッサ113は、処理対象のフレーム内で顔領域を探索する(ステップS201)。もし、顔領域が検出されたら(ステップS202のYES)、ビデオプロセッサ113は、切り出すべき範囲がフレーム内に収まっているかどうかを調べる(ステップS203)。

【0114】

切り出すべき範囲がフレーム内に収まっていなければ(ステップS203のNO)、ビデオプロセッサ113は、その範囲を移動または縮小し、フレーム内に収めさせる(ステップS204)。ビデオプロセッサ113は、顔領域の切り出しを実行し(ステップS205)、その顔画像をデータベースへ格納する(ステップS206)。

【0115】

この切り出した顔画像のデータベースへの格納の完了後、または、顔領域が検出されなかった場合(ステップS202のNO)、ビデオプロセッサ113は、残りのフレームが存在するかどうかを調べて(ステップS207)、存在すれば(ステップS207のYES)、ステップS201からの処理を繰り返し、また、存在しなければ(ステップS207のNO)、この処理を終了する。

【0116】

以上のように、本実施形態においては、映像コンテンツデータからの人物の顔画像の抽出を適切に制御することができる。

【0117】

なお、マスキングによる調整および移動・縮小による調整のいずれを適用するのかをユーザが設定するためのユーザインタフェース機能を備えるようにしてもよい。

【0118】

また、本実施形態では、顔画像の抽出を含むインデキシング処理を、ビデオプロセッサ113によって実行する例を説明したが、例えば、TVアプリケーションプログラム202にインデキシング処理を実行する機能を設けてもよい。この場合、顔画像の抽出を含むインデキシング処理は、TVアプリケーションプログラム202の制御の下に、CPU101によって実行される。

【0119】

さらに、本実施形態の電子機器はコンピュータ10によって実現するのみならず、例えば、HDDレコーダ、DVDレコーダ、テレビジョン装置といった様々なコンシューマ電子機器によって実現することもできる。この場合、TVアプリケーションプログラム202の機能は、DSP、マイクロコンピュータのようなハードウェアによって実現することができる。

【0120】

つまり、本発明は、上記実施形態そのままに限定されるものではなく、実施段階ではその要旨を逸脱しない範囲で構成要素を変形して具体化できる。また、上記実施形態に開示されている複数の構成要素の適宜な組み合わせにより種々の発明を形成できる。例えば、実施形態に示される全構成要素から幾つかの構成要素を削除してもよい。更に、異なる実施形態に構成要素を適宜組み合わせてもよい。

【符号の説明】

【0121】

10…電子機器(コンピュータ)、111A…データベース、113…ビデオプロセッサ、117…TVチューナ、301…顔画像一覧表示処理部、402…インデキシング制御部、403…再生処理部。

【技術分野】

【0001】

この発明は、映像コンテンツデータの再生開始位置をユーザが効率的に選択可能とするためのユーザインタフェース用の画像表示制御技術に関する。

【背景技術】

【0002】

一般に、ビデオレコーダ、パーソナルコンピュータといった電子機器は、テレビジョン放送番組データのような各種映像コンテンツデータを記録および再生することが可能である。この場合、電子機器に格納された各映像コンテンツデータにはタイトル名が付加されるが、タイトル名だけでは、ユーザが、各映像コンテンツデータがどのような内容のものであるかを把握することは困難である。このため、映像コンテンツデータの内容を把握するためには、その映像コンテンツデータを再生することが必要となる。しかし、総時間長の長い映像コンテンツデータの再生には、たとえ早送り再生機能等を用いた場合であっても、多くの時間が要される。

【0003】

特許文献1には、登場人物一覧表示機能を有する装置が開示されている。この装置は、映像コンテンツにおける登場人物の一覧として、映像コンテンツにおける登場人物それぞれの顔の画像を並べて表示する機能を有している。

【先行技術文献】

【特許文献】

【0004】

【特許文献1】特開2001−309269号公報

【発明の概要】

【発明が解決しようとする課題】

【0005】

ところで、顔の画像を並べて表示する場合、その顔画像は、表示サイズは勿論、画像内における顔の位置や大きさを揃えることが好ましい。そのためには、元画像からの顔領域の切り出し範囲を適宜に決定する必要がある。

【0006】

しかしながら、他の顔画像と顔の位置や大きさを揃えること、即ち、画像内における顔の位置や大きさが一定になることを考慮して、元画像からの顔領域の切り出し範囲を決定しようとすると、例えば顔領域が元画像の端部に位置する場合、その元画像をはみ出して切り出し範囲を決定せざるを得ない。よって、このような場合の調整を適切に行うための仕組みが必要である。

【0007】

この発明は、このような事情を考慮してなされたものであり、映像コンテンツデータからの人物の顔画像の抽出を適切に制御する電子機器、顔画像抽出制御方法およびプログラムを提供することを目的とする。

【課題を解決するための手段】

【0008】

実施形態によれば、電子機器は、映像コンテンツから人物の顔画像を抽出するための電子機器であって、検出手段と、調整手段と、抽出手段と、を有する。検出手段は、前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する。調整手段は、前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する。抽出手段は、前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する。

【図面の簡単な説明】

【0009】

【図1】本発明の一実施形態に係る電子機器の概観の例を示す斜視図

【図2】同実施形態の電子機器のシステム構成の例を示すブロック図

【図3】同実施形態の電子機器の顔画像一覧表示機能を説明するためのブロック図

【図4】同実施形態の電子機器で用いられる区間属性情報(属性検出結果情報)の例を示す図

【図5】同実施形態の電子機器で用いられるプログラムの機能構成を示すブロック図

【図6】同実施形態の電子機器によって表示装置に表示されるインデキシングビュー画面の例を示す図

【図7】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアの構成例を示す図

【図8】図6のインデキシングビュー画面内に含まれる、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの関係を説明するための図

【図9】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの間の連携表示制御を説明するための第1の図

【図10】図6のインデキシングビュー画面内に含まれる顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの間の連携表示制御を説明するための第2の図

【図11】同実施形態の電子機器によって抽出時に調整が施された顔画像の一覧表示例を示す図

【図12】同実施形態の電子機器によって実行される顔画像の抽出原理の第1の例を説明するための第1の図

【図13】同実施形態の電子機器によって実行される顔画像の抽出原理の第1の例を説明するための第2の図

【図14】同実施形態の電子機器によって実行される顔画像抽出処理の第1の手順の例を示すフローチャート

【図15】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第1の図

【図16】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第2の図

【図17】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第3の図

【図18】同実施形態の電子機器によって実行される顔画像の抽出原理の第2の例を説明するための第4の図

【図19】同実施形態の電子機器によって実行される顔画像抽出処理の第2の手順の例を示すフローチャート

【発明を実施するための形態】

【0010】

以下、図面を参照して、本発明の実施形態を説明する。

【0011】

まず、図1および図2を参照して、本発明の一実施形態に係る電子機器の構成を説明する。本実施形態の電子機器は、例えば、情報処理装置として機能するノートブック型の携帯型パーソナルコンピュータ10から実現されている。

【0012】

このパーソナルコンピュータ10は、放送番組データ、外部機器から入力されるビデオデータといった、映像コンテンツデータ(オーディオビジュアルコンテンツデータ)を記録および再生することができる。即ち、パーソナルコンピュータ10は、テレビジョン放送信号によって放送される放送番組データの視聴および録画を実行するためのテレビジョン(TV)機能を有している。このTV機能は、例えば、パーソナルコンピュータ10に予めインストールされているTVアプリケーションプログラムによって実現されている。また、TV機能は、外部のAV機器から入力されるビデオデータを記録する機能、および記録されたビデオデータおよび記録された放送番組データを再生する機能も有している。

【0013】

さらに、パーソナルコンピュータ10は、パーソナルコンピュータ10に格納されたビデオデータ、放送番組データのような映像コンテンツデータに登場する人物の顔画像の一覧等を表示する顔画像一覧表示機能と、同映像コンテンツデータから例えば等時間間隔で抽出された複数のフレームの各々に対応する画像(縮小画像)を表示するサムネイル画像表示機能とを有している。

【0014】

顔画像一覧表示機能およびサムネイル画像表示機能は、例えば、TV機能内にその一機能として実装されている。顔画像一覧表示機能は、映像コンテンツデータの概要等をユーザに提示するための映像インデキシング機能の一つである。この顔画像一覧表示機能は、映像コンテンツデータ全体の中のどの時間帯にどの人物が登場するのかをユーザに提示することができる。また、この顔画像一覧表示機能は、映像コンテンツデータ内に含まれる所定の属性区間に着目して人物の一覧を表示することもできる。

【0015】

図1はコンピュータ10のディスプレイユニットを開いた状態における斜視図である。本コンピュータ10は、コンピュータ本体11と、ディスプレイユニット12とから構成されている。ディスプレイユニット12には、TFT−LCD(Thin Film Transistor Liquid Crystal Display)17から構成される表示装置が組み込まれている。

【0016】

ディスプレイユニット12は、コンピュータ本体11に対し、コンピュータ本体11の上面が露出される開放位置とコンピュータ本体11の上面を覆う閉塞位置との間を回動自在に取り付けられている。コンピュータ本体11は薄い箱形の筐体を有しており、その上面にはキーボード13、本コンピュータ10をパワーオン/パワーオフするためのパワーボタン14、入力操作パネル15、タッチパッド16、およびスピーカ18A,18Bなどが配置されている。

【0017】

入力操作パネル15は、押されたボタンに対応するイベントを入力する入力装置であり、複数の機能をそれぞれ起動するための複数のボタンを備えている。これらボタン群には、TV機能(視聴、録画、録画された放送番組データ/ビデオデータの再生)を制御するための操作ボタン群も含まれている。また、コンピュータ本体11の正面には、本コンピュータ10のTV機能をリモート制御するリモコンユニットとの通信を実行するためのリモコンユニットインタフェース部20が設けられている。リモコンユニットインタフェース部20は、赤外線信号受信部などから構成されている。

【0018】

コンピュータ本体11の例えば右側面には、TV放送用のアンテナ端子19が設けられている。また、コンピュータ本体11の例えば背面には、例えばHDMI(high-definition multimedia interface)規格に対応した外部ディスプレイ接続端子が設けられている。この外部ディスプレイ接続端子は、放送番組データのような映像コンテンツデータに含まれる映像データ(動画像データ)を外部ディスプレイに出力するために用いられる。

【0019】

次に、図2を参照して、本コンピュータ10のシステム構成について説明する。

【0020】

本コンピュータ10は、図2に示されているように、CPU101、ノースブリッジ102、主メモリ103、サウスブリッジ104、グラフィクスプロセッシングユニット(GPU)105、ビデオメモリ(VRAM)105A、サウンドコントローラ106、BIOS−ROM109、LANコントローラ110、ハードディスクドライブ(HDD)111、DVDドライブ112、ビデオプロセッサ113、メモリ113A、カードコントローラ113、無線LANコントローラ114、IEEE 1394コントローラ115、エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116、TVチューナ117、およびEEPROM118等を備えている。

【0021】

CPU101は本コンピュータ10の動作を制御するプロセッサであり、ハードディスクドライブ(HDD)111から主メモリ103にロードされる、オペレーティングシステム(OS)201、およびTVアプリケーションプログラム202のような各種アプリケーションプログラムを実行する。TVアプリケーションプログラム202はTV機能を実行するためのソフトウェアである。このTVアプリケーションプログラム202は、TVチューナ117によって受信された放送番組データを視聴するためのライブ再生処理、受信された放送番組データをHDD111に記録する録画処理、およびHDD111に記録された放送番組データ/ビデオデータを再生する再生処理等を実行する。また、CPU101は、BIOS−ROM109に格納されたBIOS(Basic Input Output System)も実行する。BIOSはハードウェア制御のためのプログラムである。

【0022】

ノースブリッジ102はCPU101のローカルバスとサウスブリッジ104との間を接続するブリッジデバイスである。ノースブリッジ102には、主メモリ103をアクセス制御するメモリコントローラも内蔵されている。また、ノースブリッジ102は、PCI EXPRESS規格のシリアルバスなどを介してGPU105との通信を実行する機能も有している。

【0023】

GPU105は、本コンピュータ10のディスプレイモニタとして使用されるLCD17を制御する表示コントローラである。このGPU105によって生成される表示信号はLCD17に送られる。また、GPU105は、HDMI制御回路3およびHDMI端子2を介して、外部ディスプレイ装置1にデジタル映像信号を送出することもできる。

【0024】

HDMI端子2は上述の外部ディスプレイ接続端子である。HDMI端子2は、非圧縮のデジタル映像信号と、デジタルオーディオ信号とを一本のケーブルでテレビのような外部ディスプレイ装置1に送出することができる。HDMI制御回路3は、HDMIモニタと称される外部ディスプレイ装置1にデジタル映像信号をHDMI端子2を介して送出するためのインタフェースである。

【0025】

サウスブリッジ104は、LPC(Low Pin Count)バス上の各デバイス、およびPCI(Peripheral Component Interconnect)バス上の各デバイスを制御する。また、サウスブリッジ104は、ハードディスクドライブ(HDD)111およびDVDドライブ112を制御するためのIDE(Integrated Drive Electronics)コントローラを内蔵している。さらに、サウスブリッジ104は、サウンドコントローラ106との通信を実行する機能も有している。

【0026】

またさらに、サウスブリッジ104には、PCI EXPRESS規格のシリアルバスなどを介してビデオプロセッサ113が接続されている。

【0027】

ビデオプロセッサ113は、前述の映像インデキシングに関する各種処理を実行するプロセッサである。このビデオプロセッサ113は、映像インデキシング処理を実行するためのインデキシング処理部として機能する。すなわち、映像インデキシング処理においては、ビデオプロセッサ113は、映像コンテンツデータに含まれる動画像データから複数の顔画像を抽出すると共に、抽出された各顔画像が映像コンテンツデータ内に登場する時点を示すタイムスタンプ情報、等を出力する。顔画像の抽出は、例えば、動画像データの各フレームから顔領域を検出する顔検出処理、検出された顔領域をフレームから切り出す切り出し処理等によって実行される。顔領域の検出は、例えば、各フレームの画像の特徴を解析して、予め用意された顔画像特徴サンプルと類似する特徴を有する領域を探索することによって行うことができる。顔画像特徴サンプルは、多数の人物それぞれの顔画像特徴を統計的に処理することによって得られた特徴データである。

【0028】

さらに、ビデオプロセッサ113は、例えば、映像コンテンツデータ内に含まれるコマーシャル(CM)区間を検出する処理、および音声インデキシング処理も実行する。通常、各CM区間の時間長は、予め決められた幾つかの時間長の内の1つに設定されている。また、CM区間の前後には一定時間長の無音期間が存在する。したがって、CM区間の検出処理においては、例えば、映像コンテンツデータ内に含まれるオーディオデータが分析され、一定時間長の無音区間が検出される。そして、検出された連続する2つの無音区間に挾まれ、且つ一定値以上の時間長を有する部分データを含む区間が、CM区間として検出される。

【0029】

音声インデキシング処理は、映像コンテンツデータ内に含まれるオーディオデータを分析して、映像コンテンツデータ内に含まれる、音楽が流れている音楽区間、および人物によるトークが行われているトーク区間を検出するインデキシング処理である。音声インデキシング処理においては、例えば、オーディオデータの周波数スペクトルの特徴が分析され、その周波数スペクトルの特徴に応じて、音楽区間、およびトーク区間が検出される。音楽区間に対応する周波数スペクトルの特徴と、トーク区間に対応する周波数スペクトルの特徴とは互いに異なるので、周波数スペクトルの特徴を分析することによって、音楽区間およびトーク区間のそれぞれを検出することができる。また、音楽区間に対応する周波数スペクトルの特徴とトーク区間に対応する周波数スペクトルの特徴とが混ざり合った周波数スペクトルを有する区間は、音楽区間とトーク区間とが重なった重畳区間として検出することができる。

【0030】

トーク区間の検出処理においては、例えば、話者セグメンテーション技術または話者クラスタリング技術等が用いられ、これによって話者の切り替わりも検出される。同一の話者(または同一の話者グループ)が連続してトークしている期間が、一つのトーク区間となる。

【0031】

さらに、音声インデキシング処理は、映像コンテンツデータ内の各部分データ(一定時間長のデータ)毎に歓声レベルを検出する歓声レベル検出処理、および映像コンテンツデータ内の各部分データ毎に盛り上がりレベルを検出する盛り上がりレベル検出処理を実行する。

【0032】

歓声レベルは、歓声の大きさを示す。歓声は、大勢の人の声が合わさった音である。大勢の人の声が合わさった音は、ある特定の周波数スペクトルの分布を有する。歓声レベル検出処理においては、映像コンテンツデータに含まれるオーディオデータの周波数スペクトルが分析され、そしてその周波数スペクトルの分析結果に従って、各部分データの歓声レベルが検出される。盛り上がりレベルは、ある一定以上の音量レベルがある一定時間長以上連続的に発生する区間の音量レベルである。例えば、比較的盛大な拍手、大きな笑い声のような音の音量レベルが、盛り上がりレベルである。盛り上がりレベル検出処理においては、映像コンテンツデータに含まれるオーディオデータの音量の分布が分析され、その分析結果に従って、各部分データの盛り上がりレベルが検出される。

【0033】

メモリ113Aは、ビデオプロセッサ113の作業メモリとして用いられる。インデキシング処理(CM検出処理、映像インデキシング処理、および音声インデキシング処理)を実行するためには多くの演算量が必要とされる。本実施形態においては、CPU101とは異なる専用のプロセッサであるビデオプロセッサ113がバックエンドプロセッサとして使用され、このビデオプロセッサ113によってインデキシング処理が実行される。よって、CPU101の負荷の増加を招くことなく、インデキシング処理を実行することが出来る。なお、CM検出処理は上述したようにオーディオデータを解析することによって実行することができるので、以下では、CM検出処理を音声インデキシング処理内の1つの処理として扱うことにする。

【0034】

サウンドコントローラ106は音源デバイスであり、再生対象のオーディオデータをスピーカ18A,18BまたはHDMI制御回路3に出力する。

【0035】

無線LANコントローラ114は、たとえばIEEE 802.11規格の無線通信を実行する無線通信デバイスである。IEEE 1394コントローラ115は、IEEE 1394規格のシリアルバスを介して外部機器との通信を実行する。

【0036】

エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、電力管理のためのエンベデッドコントローラと、キーボード(KB)13およびタッチパッド16を制御するためのキーボードコントローラとが集積された1チップマイクロコンピュータである。このエンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、ユーザによるパワーボタン14の操作に応じて本コンピュータ10をパワーオン/パワーオフする機能を有している。さらに、エンベデッドコントローラ/キーボードコントローラIC(EC/KBC)116は、リモコンユニットインタフェース20との通信を実行する機能を有している。

【0037】

TVチューナ117はテレビジョン(TV)放送信号によって放送される放送番組データを受信する受信装置であり、アンテナ端子19に接続されている。このTVチューナ117は、例えば、地上波デジタルTV放送のようなデジタル放送番組データを受信可能なデジタルTVチューナとして実現されている。また、TVチューナ117は、外部機器から入力されるビデオデータをキャプチャする機能も有している。

【0038】

次に、図3を参照して、TVアプリケーションプログラム202によって実行される顔画像一覧表示機能について説明する。

【0039】

放送番組データのような映像コンテンツデータに対するインデキシング処理(映像インデキシング処理、および音声インデキシング処理)は、上述したように、インデキシング処理部として機能するビデオプロセッサ113によって実行される。

【0040】

ビデオプロセッサ113は、TVアプリケーションプログラム202の制御の下、例えば、ユーザによって指定された録画済みの放送番組データ等の映像コンテンツデータに対してインデキシング処理を実行する。また、ビデオプロセッサ113は、TVチューナ117によって受信された放送番組データをHDD111に格納する録画処理と並行して、当該放送番組データに対するインデキシング処理を実行することもできる。

【0041】

映像インデキシング処理(顔画像インデキシング処理とも云う)においては、ビデオプロセッサ113は、映像コンテンツデータに含まれる動画像データをフレーム単位で解析する。そして、ビデオプロセッサ113は、動画像データを構成する複数のフレームそれぞれから人物の顔画像を抽出すると共に、抽出された各顔画像が映像コンテンツデータ内に登場する時点を示すタイムスタンプ情報を出力する。各顔画像に対応するタイムスタンプ情報としては、映像コンテンツデータの開始から当該顔画像が登場するまでの経過時間、または当該顔画像が抽出されたフレーム番号、等を使用することが出来る。

【0042】

さらに、ビデオプロセッサ113は、抽出された各顔画像のサイズ(解像度)も出力する。ビデオプロセッサ113から出力される顔検出結果データ(顔画像、タイムスタンプ情報TS、およびサイズ)は、データベース111Aに顔画像インデキシング情報として格納される。このデータベース111Aは、HDD111内に用意されたインデキシングデータ記憶用の記憶領域である。

【0043】

なお、この映像インデキシング処理においては、ビデオプロセッサ113は、顔画像一覧表示機能の顔画像抽出処理と並行して、サムネイル画像表示機能のサムネイル画像取得処理も実行する。サムネイル画像は、映像コンテンツデータから例えば等時間間隔で抽出された複数のフレームの各々に対応する画像(縮小画像)である。すなわち、ビデオプロセッサ113は、顔画像を含むフレームであるか否かに関係なく、映像コンテンツデータから例えば所定の等時間間隔でフレームを順次抽出し、抽出した各フレームに対応する画像(サムネイル画像)と、そのサムネイル画像が出現する時点を示すタイムスタンプ情報TSとを出力する。ビデオプロセッサ113から出力されるサムネイル画像取得結果データ(サムネイル、タイムスタンプ情報TS)も、データベース111Aにサムネイルインデキシング情報として格納される。

【0044】

また、音声インデキシング処理においては、ビデオプロセッサ113は、映像コンテンツに含まれるオーディオデータを分析して、映像コンテンツデータ内に含まれる複数種の属性区間(CM区間、音楽区間、およびトーク区間)を検出し、検出された各属性区間の開始時点および終了時点を示す区間属性情報を出力する。この区間属性情報は、属性検出結果情報としてデータベース111Aに格納される。さらに、音声インデキシング処理においては、ビデオプロセッサ113は、上述の歓声レベル検出処理および盛り上がりレベル検出処理も実行する。これら歓声レベル検出処理の結果および盛り上がりレベル検出処理の結果も、上述の属性検出結果情報の一部としてデータベース111Aに格納される。

【0045】

属性検出結果情報(区間属性情報)は、図4に示されているように、例えば、CM区間テーブル、音楽区間テーブル、トーク区間テーブル、および歓声/盛り上がりテーブルから構成されている。

【0046】

CM区間テーブルは、検出されたCM区間の開始時点および終了時点を示すCM区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数のCM区間が存在する場合には、それら複数のCM区間それぞれに対応するCM区間属性情報がCM区間テーブルに格納される。CM区間テーブルにおいては、検出された各CM区間毎に当該CM区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0047】

音楽区間テーブルは、検出された音楽区間の開始時点および終了時点を示す音楽区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数の音楽区間が存在する場合には、それら複数の音楽区間それぞれに対応する音楽区間属性情報が音楽区間テーブルに格納される。音楽区間テーブルにおいては、検出された各音楽区間毎に当該音楽区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0048】

トーク区間テーブルは、検出されたトーク区間の開始時点および終了時点を示す音楽区間属性情報を格納する。映像コンテンツデータの開始位置から終端位置までのシーケンス内に複数のトーク区間が存在する場合には、それら複数のトーク区間それぞれに対応するトーク区間属性情報がトーク区間テーブルに格納される。トーク区間テーブルにおいては、検出された各トーク区間毎に当該トーク区間の開始時点および終了時点をそれぞれ示すスタートタイム情報およびエンドタイム情報が格納される。

【0049】

歓声/盛り上がりテーブルは、映像コンテンツデータ内の一定時間長の部分データ(タイムセグメントT1,T2,T3,…)それぞれにおける歓声レベルおよび盛り上がりレベルを格納する。

【0050】

図3に示されているように、TVアプリケーションプログラム202は、顔画像一覧表示機能を実行するための顔画像一覧表示処理部301を含んでいる。この顔画像一覧表示処理部301は、例えば、インデキシングビューワプログラムとして実現されており、データベース111Aに格納されたインデキシング情報(顔画像インデキシング情報、サムネイルインデキシング情報、区間属性情報、等)を用いて、映像コンテンツデータの概要を俯瞰するためのインデキシングビュー画面を表示する。

【0051】

具体的には、顔画像一覧表示処理部301は、データベース111Aから顔画像インデキシング情報(顔画像、タイムスタンプ情報TS、およびサイズ)を読み出し、そしてその顔画像インデキシング情報を用いて、映像コンテンツデータに登場する人物の顔画像の一覧を、インデキシングビュー画面上の2次元の表示エリア(以下、顔サムネイル表示エリアと称する)上に表示する。この場合、顔画像一覧表示処理部301は、映像コンテンツデータの総時間長を、例えば等間隔で、複数の時間帯に分割し、時間帯毎に、抽出された顔画像の内から当該時間帯に登場する顔画像を所定個選択する。そして、顔画像一覧表示処理部301は、時間帯毎に、選択した所定個の顔画像それぞれを並べて表示する。

【0052】

すなわち、2次元の顔サムネイル表示エリアは、複数の行および複数の列を含むマトリクス状に配置された複数の顔画像表示エリアを含む。複数の列それぞれには、映像コンテンツデータの総時間長を構成する複数の時間帯が割り当てられている。具体的には、例えば、複数の列それぞれには、映像コンテンツデータの総時間長をこれら複数の列の数で等間隔に分割することによって得られる、互いに同一の時間長を有する複数の時間帯がそれぞれ割り当てられる。もちろん、各列に割り当てられる時間帯は必ずしも同一の時間長でなくてもよい。

【0053】

顔画像一覧表示処理部301は、顔画像それぞれに対応するタイムスタンプ情報TSに基づき、各列内に属する行数分の顔画像表示エリア上に、当該各列に割り当てられた時間帯に属する顔画像それぞれを、例えば、それら顔画像の出現頻度順(顔画像の検出時間長順)のような順序で並べて表示する。この場合、例えば、当該各列に割り当てられた時間帯に属する顔画像の内から、出現頻度(登場頻度)の高い順に顔画像が行数分だけ選択され、選択された顔画像が登場頻度順に上から下に向かって並んで配置される。もちろん、出現頻度順ではなく、各列に割り当てられた時間帯に出現する顔画像それぞれを、その出現順に並べて表示してもよい。

【0054】

この顔画像一覧表示機能により、映像コンテンツデータ全体の中のどの時間帯にどの人物が登場するのかをユーザに分かりやすく提示することができる。顔サムネイル表示エリアの具体的な構成例については、図6以降で後述する。

【0055】

また、顔画像一覧表示処理部301は、サムネイル画像表示機能も併せて実行する。顔画像一覧表示処理部301は、データベース111Aからサムネイルインデキシング情報(サムネイル、タイムスタンプ情報TS)を読み出し、そしてサムネイルインデキシング情報を用いて、サムネイル画像それぞれを、顔サムネイル表示エリアの下方側または上方側の一方に配置されたサムネイル表示エリア(以下、じゃばらサムネイル表示エリアと称する)上に、それらサムネイル画像の出現時間順に一列に並べて表示する。

【0056】

映像コンテンツデータによっては、顔画像が登場しない時間帯も存在する。したがって、インデキシングビュー画面上に顔サムネイル表示エリアのみならず、じゃばらサムネイル表示エリアも表示することにより、顔画像が登場しない時間帯においても、その時間帯の映像コンテンツデータの内容をユーザに提示することができる。

【0057】

さらに、顔画像一覧表示処理部301は、データベース111Aから区間属性情報(CM区間属性情報、音楽区間属性情報、トーク区間属性情報)を読み出し、その区間属性情報に従って、映像コンテンツデータの開始位置から終端位置までのシーケンス内における各属性区間(CM区間、音楽区間、トーク区間)の位置(開始時点から終了時点までの区間)を示すバー領域を含む区間バーを、インデキシングビュー画面上の顔サムネイル表示エリアの下方側または上方側の一方に表示する。この区間バーは、例えば、3つのサブ区間バー、つまりCM区間の位置を示すCM区間バー、音楽区間の位置を示す音楽区間バー、トーク区間の位置を示すトーク区間バーを含んでいる。

【0058】

シーケンス内に複数のCM区間が存在する場合、複数のCM区間それぞれの位置を示す複数のバー領域がCM区間バー内に表示される。同様に、シーケンス内に複数の音楽区間が存在する場合には複数の音楽区間それぞれの位置を示す複数のバー領域が音楽区間バー内に表示され、シーケンス内に複数のトーク区間が存在する場合には複数のトーク区間それぞれの位置を示す複数のバー領域がトーク区間バー内に表示される。以下では、シーケンス内に分散して存在する複数のCM区間の各々を部分CM区間と称し、シーケンス内に分散して存在する複数の音楽区間のそれぞれを部分音楽区間と称し、シーケンス内に分散して存在する複数のトーク区間のそれぞれを部分トーク区間と称する。

【0059】

インデキシングビュー画面上に区間バーを表示することにより、顔サムネイル表示エリア内の各顔画像がどのような属性区間(CM区間、音楽区間、トーク区間)に登場する人物の顔画像であるかを、ユーザに提示することができる。したがって、ユーザは、登場人物と、区間属性とを考慮して、映像コンテンツデータ全体の中から再生を開始すべきデータ位置を見つけることができる。

【0060】

さらに、顔画像一覧表示処理部301は、データベース111Aから歓声レベル情報および盛り上がりレベル情報を読み出し、それら歓声レベル情報および盛り上がりレベル情報に従って、映像コンテンツデータの開始位置から終端位置までのシーケンス内における歓声レベルの変化および盛り上がりレベルの変化をそれぞれ示すグラフを、インデキシングビュー画面上の顔サムネイル表示エリアの下方側または上方側の一方に配置されたレベル表示エリア上に表示する。

【0061】

このレベル表示エリアを見ることにより、ユーザに、映像コンテンツデータ内のどの辺りに大きな歓声が生じた区間が存在し、また映像コンテンツデータ内のどの辺りに盛り上がりの大きな区間が存在するかを提示することができる。ユーザは、登場人物と、区間属性と、歓声レベルと、盛り上がりレベルとを考慮して、映像コンテンツデータ全体の中から再生を開始すべきデータ位置を見つけることができる。

【0062】

次に、図5を参照して、TVアプリケーションプログラム202の機能構成を説明する。

【0063】

TVアプリケーションプログラム202は、上述の顔画像一覧表示処理部301に加え、記録処理部401、インデキシング制御部402、再生処理部403等を備えている。

【0064】

記録処理部401は、TVチューナ117によって受信された放送番組データ、または外部機器から入力されるビデオデータをHDD111に記録する記録処理を実行する。また、記録処理部401は、ユーザによって予め設定された録画予約情報(チャンネル番号、日時)によって指定される放送番組データをTVチューナ117を用いて受信し、その放送番組データをHDD111に記録する予約録画処理も実行する。

【0065】

インデキシング制御部402は、ビデオプロセッサ(インデキシング処理部)113を制御して、インデキシング処理(映像インデキシング処理、音声インデキシング処理)をビデオプロセッサ113に実行させる。ユーザは、録画対象の放送番組データ毎にインデキシング処理を実行するか否かを指定することができる。例えば、インデキシング処理の実行が指示された録画対象の放送番組データについては、その放送番組データがHDD111に記録された後に、インデキシング処理が自動的に開始される。また、ユーザは、既にHDD111に格納されている映像コンテンツデータの内から、インデキシング処理を実行すべき映像コンテンツデータを指定することもできる。

【0066】

再生処理部403は、HDD111に格納されている各映像コンテンツデータを再生する処理を実行する。また、再生処理部403は、ある映像コンテンツデータの顔画像一覧の中の一つの顔画像が選択されている状態でユーザ操作によって再生指示イベントが入力された時、選択されている顔画像が登場する時点よりも所定時間前の時点から映像コンテンツデータの再生を開始する機能を有している。

【0067】

ユーザは、複数の属性区間を選択的に指定することにより、様々な属性に着目した顔画像一覧を見ながら、映像コンテンツデータの再生位置を決定することができる。

【0068】

次に、図6乃至図11を参照して、インデキシングビュー画面の具体的な構成について説明する。

【0069】

図6には、顔画像一覧表示処理部301によってLCD17に表示されるインデキシングビュー画面の例が示されている。このインデキシングビュー画面は、ある映像コンテンツデータ(例えば放送番組データ)をインデキシング処理することによって得られた画面である。このインデキシングビュー画面には、顔画像の一覧を表示するための上述の顔サムネイル表示エリアと、上述のレベル表示エリアと、上述の区間バーと、サムネイル画像の一覧をじゃばら形式で表示するための上述のじゃばらサムネイル表示エリアとを含んでいる。

【0070】

ここで、じゃばら形式とは、選択されているサムネイル画像を通常サイズ(フルサイズ)で表示し、他の各サムネイル画像についてはその横方向サイズを縮小して表示する表示形式である。図6においては、選択されたサムネイル画像との距離が大きいサムネイル画像ほど、その横方向サイズが縮小されている。

【0071】

レベル表示エリアにおいては、歓声レベルの変化を示すグラフ(図6中の濃い色で示されるグラフ)と、歓声レベルの変化を示すグラフ(図6中の薄い色で示されるグラフ)が表示される。

【0072】

区間バーは、トーク区間バーと、音楽区間バーと、CM区間バーとを含んでいる。CM区間バーにおいては、各CM区間(各部分CM区間)の位置にバー領域(図6の黒色の帯状領域)が表示される。音楽区間バーにおいては、各音楽区間(各部分音楽区間)の位置にバー領域(図6のクロスハッチングされた帯状領域)が表示される。トーク区間バーにおいては、各トーク区間(各部分トーク区間)の位置にバー領域(図6のハッチングされた帯状領域)が表示される。ユーザは、リモコンユニットのボタン、上下左右等のカーソルキーの操作により、トーク区間バー、音楽区間バーと、CM区間バーのいずれか一つを選択することができる。また、ユーザは、リモコンユニットのボタン、上下左右等のカーソルキーの操作により、選択された区間バー内の一つのバー領域を選択することもできる。

【0073】

図7は、顔サムネイル表示エリアの構成例が示されている。

【0074】

顔サムネイル表示エリアは、複数の行と複数の列とを含むマトリクス状に配置された複数個の顔画像表示エリアを含んでいる。図7においては、顔サムネイル表示エリアは6行×16列から構成されている。顔サムネイル表示エリアに含まれる顔画像表示エリアの数は、96個である。

【0075】

列1〜列16のそれぞれには、例えば、映像コンテンツデータの総時間長を列数(=16)で等間隔で分割することによって得られる、互いに同一の時間長Tを有する複数の時間帯がそれぞれ割り当てられる。

【0076】

例えば、映像コンテンツデータの総時間長が2時間であるならば、その2時間が16個の時間帯に等間隔で分割される。この場合、各時間帯の時間長Tは、7.5分である。例えば、列1には、先頭0:00:00から0:07:30までの時間帯が割り当てられ、列2には、0:07:30から0:15:00までの時間帯が割り当てられ、列3には、0:15:00から0:22:30までの時間帯が割り当てられる。映像コンテンツデータの総時間長に応じて、各時間帯の時間長Tは変化する。

【0077】

もちろん、複数の列それぞれに割り当てられる時間帯の長さは、必ずしも同一である必要はない。

【0078】

顔画像一覧表示処理部301は、ビデオプロセッサ113によって抽出された顔画像それぞれに対応するタイムスタンプ情報に基づき、各列内の6個の顔画像表示エリア上に、当該各列に割り当てられた時間帯に属する顔画像それぞれをたとえば上述の頻度順に並べて表示する。この場合、顔画像一覧表示処理部301は、表示処理対象の列に割り当てられた時間帯に属する顔画像の内から行数分(6個)の顔画像を選択し、選択した行数分の顔画像それぞれを並べて表示する。

【0079】

このように、顔サムネイル表示エリアにおいては、左端位置(1,1)を基点とし、右端位置(6,16)を映像コンテンツデータの終端とする時間軸が用いられている。

【0080】

顔サムネイル表示エリアの各顔画像表示エリアに表示される顔画像のサイズは“大”、“中”、“小”の内からユーザが選択することができる。行と列の数は、ユーザが選択した顔画像のサイズに応じて変化される。顔画像のサイズと行と列の数との関係は、次の通りである。

【0081】

(1)“大”の場合; 3行×8列

(2)“中”の場合; 6行×16列

(3)“小”の場合: 10行×24列

“大”の場合においては、各顔画像は、例えば、180×180ピクセルのサイズで表示される。“中”の場合においては、各顔画像は、例えば、90×90ピクセルのサイズで表示される。“小”の場合においては、各顔画像は、例えば、60×60ピクセルのサイズで表示される。デフォルトの顔画像サイズは、例えば、“中”に設定されている。

【0082】

顔サムネイル表示エリア内の各顔画像は、選択されていない“標準”状態、選択されている“フォーカス”状態の2つの状態のいずれかに設定される。“フォーカス”状態の顔画像のサイズは、“標準”状態の時のサイズ(180×180、90×90、または60×60)よりも大きく設定される。図7においては、座標(5,12)の顔画像が“フォーカス”状態である場合を示している。

【0083】

じゃばらサムネイル表示エリアに表示されるサムネイル画像の枚数は、ユーザ設定に従って、例えば240枚、144枚、96枚、48枚のいずれかに設定される。デフォルトは例えば240枚である。

【0084】

サムネイル画像は、選択されていない“標準”状態、選択されている“フォーカス”状態の2つの状態のいずれかに設定される。“フォーカス”状態のサムネイル画像は、他のサムネイル画像よりも大きいサイズで表示される。

【0085】

次に、図8を参照して、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとの関係について説明する。

【0086】

同一列に属する顔画像表示エリア群の集合、つまり顔サムネイル表示エリア内の個々の列を“大区間”と称する。また、“大区間”をさらに分割したものを“小区間”と称する。1つの大区間に含まれる小区間の数は、じゃばらサムネイル表示エリアに表示されるサムネイル画像の数を顔サムネイル表示エリアの列数で割った商で与えられる。例えば、顔サムネイル表示エリアが6行×16列で、じゃばらサムネイル表示エリアに表示されるサムネイル画像の数が240枚であるならば、1つの大区間に含まれる小区間の数は、15(=240÷16)となる。1つの大区間は15個の小区間を含む。換言すれば、1つの大区間に対応する時間帯には、15枚のサムネイル画像が属することになる。

【0087】

また、顔画像一覧表示処理部301は、大区間とサムネイル画像との間を接続する縦長のバーを表示する。この縦長のバーは、あるサムネイル画像に対応する小区間が、大区間に含まれる15個の小区間の内のどの小区間に対応するかを提示するために使用される。縦長のバーは、大区間に含まれる15個の小区間の内で、サムネイル画像に対応する小区間の位置に表示される。例えば、あるサムネイル画像が、ある大区間に対応する時間帯に属する15枚のサムネイル画像の内の先頭の画像、つまり大区間内の先頭の小区間に対応する画像であるならば、当該サムネイル画像は、縦長のバーによって大区間の左端に接続される。また、例えば、あるサムネイル画像が、ある大区間に対応する時間帯に属する15枚のサムネイル画像の内の終端の画像、つまり大区間内の終端の小区間に対応する画像であるならば、当該サムネイル画像は、縦長のバーによって大区間の右端に接続される。

【0088】

さらに、顔画像一覧表示処理部301は、サムネイル画像のタイムスタンプ情報に基づいて、そのサムネイル画像が出現する時点を示す時間情報もインデキシングビュー画面上に表示する。

【0089】

“現在位置変更”ボタンは、選択対象のサムネイル画像を変更するための操作ボタンである。“現在位置変更”ボタンがフォーカスされている状態でユーザが左カーソルキーまたは右カーソルキーを操作すると、選択対象のサムネイル画像は、例えば1小区間単位で左または右に移動する。

【0090】

このような関係を有する顔サムネイル表示エリアとじゃばらサムネイル表示エリアとを含むインデキシングビュー画面において、顔サムネイル表示エリア上のある顔画像がユーザによって選択されると、顔画像一覧表示処理部301は、その顔画像のタイムスタンプ情報で示される時刻を含む小区間を特定して、当該小区間に対応するサムネイル画像を通常サイズで表示すべく、じゃばらサムネイル表示エリアにおけるサムネイル画像の表示制御を行う。

【0091】

即ち、図9に示すように、ある顔画像(a1)がユーザによって選択されると、それに連動して、その顔画像の人物が登場する時間帯のサムネイル画像(a2)が自動的に選択されて追従表示されることになる。

【0092】

逆に、このインデキシングビュー画面において、じゃばらサムネイル表示エリア上のあるサムネイル画像がユーザによって選択されると、顔画像一覧表示処理部301は、そのサムネイル画像に対応する小区間内の時刻をタイムスタンプ情報としてもつ顔画像を検出し、その検出した顔画像すべてを他の顔画像と区別可能に強調表示する。

【0093】

即ち、図10に示すように、あるサムネイル画像(b1)がユーザによって選択されると、それに連動して、そのサムネイル画像に対応する小区間内に登場する人物の顔画像が自動的に選択されて強調表示(b2)されることになる。

【0094】

従って、ユーザは、第1に、顔サムネイル表示エリア上の顔画像を選択することで、当該顔画像の人物が登場する時間帯(場面)のサムネイル画像をじゃばらサムネイル表示エリア上で確認することができ、第2に、じゃばらサムネイル表示エリア上のサムネイル画像を選択することで、そのサムネイル画像に対応する時間帯に登場する人物の顔画像を顔サムネイル表示エリア上で確認することができる。

【0095】

この確認を行った後、ユーザは、顔サムネイル表示エリア上の顔画像を選択した状態で映像コンテンツデータの再生開始を指示すれば、その顔画像のタイムスタンプ情報で示される時刻よりも所定時間前の時点から当該映像コンテンツデータの再生を開始でき、じゃばらサムネイル表示エリア上のサムネイル画像を選択した状態で映像コンテンツデータの再生開始を指示すれば、そのサムネイル画像に対応する小区間の先頭位置(時点)から当該映像コンテンツデータの再生を開始できる。

【0096】

このように、顔サムネイル表示エリアとじゃばらサムネイル表示エリアとが連動して表示制御される本コンピュータ10においては、所望の人物が登場する場面の映像を簡単な操作に応じて提示でき、また、各場面に登場する人物の顔画像を簡単な操作に応じて提示できる。

【0097】

ところで、顔サムネイル表示エリアに表示される各顔画像は、図6に示したように、画像内における顔の位置や大きさが揃っている。即ち、ビデオプロセッサ113は、映像コンテンツデータの各フレームから顔領域を切り出す際、その切り出し範囲を適宜に決定する機能を有している。

【0098】

ここで、例えば顔領域がフレームの端部に位置する場合を想定する。この場合、画像内における顔の位置や大きさが一定になるように顔領域の切り出し範囲を決定すると、その切り出し範囲はフレームをはみ出すことになってしまう。そこで、本コンピュータ10では、ビデオプロセッサ113が、決定した切り出し範囲がフレーム外に及んだ場合における調整機能を備える。以下、この点について詳述する。

【0099】

図11は、本コンピュータ10のビデオプロセッサ113が備える調整機能の第1の例を示す図である。

【0100】

図中、符号aで示されるハッチングがなされた各所がビデオプロセッサ113による調整が施された部分であり、例えば1行目15列目の顔画像は、フレームの右上端部に位置する顔領域を切り出したものである。このような、顔領域が端部に位置するフレームからのビデオプロセッサ113による顔画像の抽出原理を、図12および図13を参照して説明する。

【0101】

図12は、通常の顔画像の抽出原理を示す図であり、ビデオプロセッサ113は、顔領域を検出すると、その顔の位置や大きさが一定となるように切り出し範囲(破線の枠)を決定し、その範囲内の画像を顔サムネイル表示エリア上での表示サイズに揃えるべく拡縮することで顔画像を抽出する。一方、図13は、決定した切り出し範囲がフレームをはみ出してしまう場合の顔画像の抽出原理を示す図であり、図13(A)に示すように、決定した切り出し範囲がフレームをはみ出してしまった場合、ビデオプロセッサ113は、図13(B)に示すように、フレーム内の画像を取り出すことに加えて、フレーム外の欠損部分を所定の色でマスキングすることにより、顔の位置や大きさが一定となった顔画像の抽出を実現する。このマスキングの色は、予め指定された色を使用してもよいが、顔の輪郭線周辺の色を各々採取して使用するようにしてもよい。

【0102】

次に、図14のフローチャートを参照して、ビデオプロセッサ113によって実行される顔画像抽出処理の手順を説明する。

【0103】

まず、ビデオプロセッサ113は、処理対象のフレーム内で顔領域を探索する(ステップS101)。もし、顔領域が検出されたら(ステップS102のYES)、ビデオプロセッサ113は、切り出すべき範囲がフレーム内に収まっているかどうかを調べる(ステップS103)。フレーム内に収まっていれば(ステップS103のYES)、ビデオプロセッサ113は、その領域の切り出しをそのまま実行する(ステップS104)。

【0104】

一方、フレーム内に収まっていなければ(ステップS103のNO)、ビデオプロセッサ113は、フレーム内の領域を切り出すと共に、それ以外の領域をマスキングにより補充する(ステップS105)。そして、ビデオプロセッサ113は、切り出した顔画像をデータベースへ格納する(ステップS106)。

【0105】

この切り出した顔画像のデータベースへの格納の完了後、または、顔領域が検出されなかった場合(ステップS102のNO)、ビデオプロセッサ113は、残りのフレームが存在するかどうかを調べて(ステップS107)、存在すれば(ステップS107のYES)、ステップS101からの処理を繰り返し、また、存在しなければ(ステップS107のNO)、この処理を終了する。

【0106】

続いて、図15乃至図18を参照して、顔領域が端部に位置するフレームからのビデオプロセッサ113による顔画像の第2の抽出原理を説明する。

【0107】

以上の説明では、画像内における顔の位置や大きさを一定にするために生じる欠損部分をマスキングする調整方法を示したが、ここでは、ある程度の顔の位置のずれや顔の大きさのばらつきを許容する調整方法を説明する。

【0108】

図13(A)に示したケースと同様、図15に示すように、決定した切り出し範囲がフレームをはみ出してしまった場合、ビデオプロセッサ113は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる。この場合、顔の位置は他の顔画像と比較して若干右上にずれることになるが、フレーム内の画像のみで顔画像の抽出を行うことが可能となる。

【0109】

一方、図16には、このような移動が行えないケースが示されている。図16(A)に示すケースの場合、切り出し領域を左上方向に移動させたとしても、移動先において左上部がフレーム外にはみ出してしまう。また、図16(B)に示すケースの場合は、上下両方向にはみ出しているので、そもそも移動が行えない。

【0110】

このような場合、ビデオプロセッサ113は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる。より具体的に説明すると、図16(A)に示したケースの場合には、ビデオプロセッサ113は、図17に示すように、切り出し領域の左上端部を固定した状態で、切り出し領域の右下端部を対角線上中心に向けるように縮小し、切り出し範囲をフレーム内に収める。同様に、図16(B)に示したケースの場合、ビデオプロセッサ113は、図18に示すように、切り出し領域の左上端部および右下端部の両方を対角線上中心に向けるように縮小し、切り出し範囲をフレーム内に収める。

【0111】

この場合、顔の大きさは他の顔画像と比較して若干異なる(大きくなる)が、フレーム内の画像のみで顔画像の抽出を行うことが可能となる。

【0112】

図19は、ビデオプロセッサ113によって実行される顔画像抽出処理の第2の手順を示すフローチャートである。

【0113】

まず、ビデオプロセッサ113は、処理対象のフレーム内で顔領域を探索する(ステップS201)。もし、顔領域が検出されたら(ステップS202のYES)、ビデオプロセッサ113は、切り出すべき範囲がフレーム内に収まっているかどうかを調べる(ステップS203)。

【0114】

切り出すべき範囲がフレーム内に収まっていなければ(ステップS203のNO)、ビデオプロセッサ113は、その範囲を移動または縮小し、フレーム内に収めさせる(ステップS204)。ビデオプロセッサ113は、顔領域の切り出しを実行し(ステップS205)、その顔画像をデータベースへ格納する(ステップS206)。

【0115】

この切り出した顔画像のデータベースへの格納の完了後、または、顔領域が検出されなかった場合(ステップS202のNO)、ビデオプロセッサ113は、残りのフレームが存在するかどうかを調べて(ステップS207)、存在すれば(ステップS207のYES)、ステップS201からの処理を繰り返し、また、存在しなければ(ステップS207のNO)、この処理を終了する。

【0116】

以上のように、本実施形態においては、映像コンテンツデータからの人物の顔画像の抽出を適切に制御することができる。

【0117】

なお、マスキングによる調整および移動・縮小による調整のいずれを適用するのかをユーザが設定するためのユーザインタフェース機能を備えるようにしてもよい。

【0118】

また、本実施形態では、顔画像の抽出を含むインデキシング処理を、ビデオプロセッサ113によって実行する例を説明したが、例えば、TVアプリケーションプログラム202にインデキシング処理を実行する機能を設けてもよい。この場合、顔画像の抽出を含むインデキシング処理は、TVアプリケーションプログラム202の制御の下に、CPU101によって実行される。

【0119】

さらに、本実施形態の電子機器はコンピュータ10によって実現するのみならず、例えば、HDDレコーダ、DVDレコーダ、テレビジョン装置といった様々なコンシューマ電子機器によって実現することもできる。この場合、TVアプリケーションプログラム202の機能は、DSP、マイクロコンピュータのようなハードウェアによって実現することができる。

【0120】

つまり、本発明は、上記実施形態そのままに限定されるものではなく、実施段階ではその要旨を逸脱しない範囲で構成要素を変形して具体化できる。また、上記実施形態に開示されている複数の構成要素の適宜な組み合わせにより種々の発明を形成できる。例えば、実施形態に示される全構成要素から幾つかの構成要素を削除してもよい。更に、異なる実施形態に構成要素を適宜組み合わせてもよい。

【符号の説明】

【0121】

10…電子機器(コンピュータ)、111A…データベース、113…ビデオプロセッサ、117…TVチューナ、301…顔画像一覧表示処理部、402…インデキシング制御部、403…再生処理部。

【特許請求の範囲】

【請求項1】

映像コンテンツから人物の顔画像を抽出するための電子機器であって、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する検出手段と、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する調整手段と、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する抽出手段と、

を有する電子機器。

【請求項2】

前記抽出手段は、前記切り出し範囲がフレームに含まれる場合、前記切り出し範囲に含まれる第1顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する請求項1に記載の電子機器。

【請求項3】

前記タイムスタンプ情報を用いて、前記第1顔画像または前記第2顔画像の一方を、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応して表示する表示手段をさらに備える請求項1または請求項2に記載の電子機器。

【請求項4】

前記表示手段は、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、各顔画像が前記映像コンテンツ内で登場する時点に対応して並べて表示する請求項3に記載の電子機器。

【請求項5】

前記抽出手段によって出力される複数の顔画像を表示する場合であって、各顔画像が前記映像コンテンツ内で登場する時点が第1期間の範囲内である場合に、前記表示手段は、各顔画像に対応する人物の出現頻度に応じて、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、並べて表示する請求項3に記載の電子機器。

【請求項6】

前記調整手段は、フレーム外の欠損部分を所定の色でマスキングする請求項1に記載の電子機器。

【請求項7】

前記調整手段は、フレーム内の顔の輪郭線周辺の色でマスキングする請求項6に記載の電子機器。

【請求項8】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる請求項1に記載の電子機器。

【請求項9】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる請求項1に記載の電子機器。

【請求項10】

映像コンテンツから人物の顔画像を抽出するための電子機器における顔画像抽出制御方法であって、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定し、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力し、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する、

顔画像抽出制御方法。

【請求項11】

映像コンテンツから人物の顔画像を抽出するためのコンピュータを、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する検出手段、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する調整手段、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する抽出手段、

として機能させるためのプログラム。

【請求項12】

前記抽出手段は、前記切り出し範囲がフレームに含まれる場合、前記切り出し範囲に含まれる第1顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する請求項11に記載のプログラム。

【請求項13】

前記コンピュータを、前記タイムスタンプ情報を用いて、前記第1顔画像または前記第2顔画像の一方を、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応して表示する表示手段としてさらに機能させる請求項11または請求項12に記載のプログラム。

【請求項14】

前記表示手段は、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、各顔画像が前記映像コンテンツ内で登場する時点に対応して並べて表示する請求項13に記載のプログラム。

【請求項15】

前記抽出手段によって出力される複数の顔画像を表示する場合であって、各顔画像が前記映像コンテンツ内で登場する時点が第1期間の範囲内である場合に、前記表示手段は、各顔画像に対応する人物の出現頻度に応じて、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、並べて表示する請求項13に記載のプログラム。

【請求項16】

前記調整手段は、フレーム外の欠損部分を所定の色でマスキングする請求項11に記載のプログラム。

【請求項17】

前記調整手段は、フレーム内の顔の輪郭線周辺の色でマスキングする請求項16に記載のプログラム。

【請求項18】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる請求項11に記載のプログラム。

【請求項19】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる請求項11に記載のプログラム。

【請求項1】

映像コンテンツから人物の顔画像を抽出するための電子機器であって、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する検出手段と、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する調整手段と、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する抽出手段と、

を有する電子機器。

【請求項2】

前記抽出手段は、前記切り出し範囲がフレームに含まれる場合、前記切り出し範囲に含まれる第1顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する請求項1に記載の電子機器。

【請求項3】

前記タイムスタンプ情報を用いて、前記第1顔画像または前記第2顔画像の一方を、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応して表示する表示手段をさらに備える請求項1または請求項2に記載の電子機器。

【請求項4】

前記表示手段は、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、各顔画像が前記映像コンテンツ内で登場する時点に対応して並べて表示する請求項3に記載の電子機器。

【請求項5】

前記抽出手段によって出力される複数の顔画像を表示する場合であって、各顔画像が前記映像コンテンツ内で登場する時点が第1期間の範囲内である場合に、前記表示手段は、各顔画像に対応する人物の出現頻度に応じて、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、並べて表示する請求項3に記載の電子機器。

【請求項6】

前記調整手段は、フレーム外の欠損部分を所定の色でマスキングする請求項1に記載の電子機器。

【請求項7】

前記調整手段は、フレーム内の顔の輪郭線周辺の色でマスキングする請求項6に記載の電子機器。

【請求項8】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる請求項1に記載の電子機器。

【請求項9】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる請求項1に記載の電子機器。

【請求項10】

映像コンテンツから人物の顔画像を抽出するための電子機器における顔画像抽出制御方法であって、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定し、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力し、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する、

顔画像抽出制御方法。

【請求項11】

映像コンテンツから人物の顔画像を抽出するためのコンピュータを、

前記映像コンテンツのフレームに顔画像が含まれる場合に、検出した顔画像を切り出すための切り出し範囲を決定する検出手段、

前記切り出し範囲がフレーム外に及ぶ場合、前記切り出し範囲に含まれる第1顔画像を調整して第2顔画像を出力する調整手段、

前記第2顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する抽出手段、

として機能させるためのプログラム。

【請求項12】

前記抽出手段は、前記切り出し範囲がフレームに含まれる場合、前記切り出し範囲に含まれる第1顔画像と、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応するタイムスタンプ情報とを出力する請求項11に記載のプログラム。

【請求項13】

前記コンピュータを、前記タイムスタンプ情報を用いて、前記第1顔画像または前記第2顔画像の一方を、前記第1顔画像が前記映像コンテンツ内で登場する時点に対応して表示する表示手段としてさらに機能させる請求項11または請求項12に記載のプログラム。

【請求項14】

前記表示手段は、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、各顔画像が前記映像コンテンツ内で登場する時点に対応して並べて表示する請求項13に記載のプログラム。

【請求項15】

前記抽出手段によって出力される複数の顔画像を表示する場合であって、各顔画像が前記映像コンテンツ内で登場する時点が第1期間の範囲内である場合に、前記表示手段は、各顔画像に対応する人物の出現頻度に応じて、前記抽出手段によって出力される複数の顔画像の少なくとも1つを、並べて表示する請求項13に記載のプログラム。

【請求項16】

前記調整手段は、フレーム外の欠損部分を所定の色でマスキングする請求項11に記載のプログラム。

【請求項17】

前記調整手段は、フレーム内の顔の輪郭線周辺の色でマスキングする請求項16に記載のプログラム。

【請求項18】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を移動させる請求項11に記載のプログラム。

【請求項19】

前記調整手段は、切り出し範囲がフレーム内に収まるように当該切り出し範囲を縮小させる請求項11に記載のプログラム。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【公開番号】特開2012−213196(P2012−213196A)

【公開日】平成24年11月1日(2012.11.1)

【国際特許分類】

【出願番号】特願2012−127951(P2012−127951)

【出願日】平成24年6月5日(2012.6.5)

【分割の表示】特願2007−249829(P2007−249829)の分割

【原出願日】平成19年9月26日(2007.9.26)

【公序良俗違反の表示】

(特許庁注:以下のものは登録商標)

1.HDMI

【出願人】(000003078)株式会社東芝 (54,554)

【Fターム(参考)】

【公開日】平成24年11月1日(2012.11.1)

【国際特許分類】

【出願日】平成24年6月5日(2012.6.5)

【分割の表示】特願2007−249829(P2007−249829)の分割

【原出願日】平成19年9月26日(2007.9.26)

【公序良俗違反の表示】

(特許庁注:以下のものは登録商標)

1.HDMI

【出願人】(000003078)株式会社東芝 (54,554)

【Fターム(参考)】

[ Back to top ]