3次元的モデルを利用した身体臓器の映像生成方法及び装置並びにコンピュータ読み取り可能な記録媒体

【課題】リアルタイムで医療映像を入力してこれを3次元モデルと整合した映像と比較し、リアルタイム医療映像に3次元モデルが結合された映像を出力する3次元的モデルを利用した身体臓器の映像生成方法及び装置を提供する。

【解決手段】本発明による臓器映像の生成方法は、患者の少なくとも一つの臓器を表す医療映像に基づいて少なくとも一つの臓器の3次元モデルを生成し、患者の身体活動による少なくとも一つの臓器の形態的変化を表す複数の映像と臓器の3次元モデルとを整合させることで複数の整合映像を生成し、患者の現在身体状態に基づいて複数の整合映像のうちのいずれか一つを選択して出力する。

【解決手段】本発明による臓器映像の生成方法は、患者の少なくとも一つの臓器を表す医療映像に基づいて少なくとも一つの臓器の3次元モデルを生成し、患者の身体活動による少なくとも一つの臓器の形態的変化を表す複数の映像と臓器の3次元モデルとを整合させることで複数の整合映像を生成し、患者の現在身体状態に基づいて複数の整合映像のうちのいずれか一つを選択して出力する。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、3次元的モデルを利用した身体臓器の映像を生成する方法及び装置、並びにその方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体に関する。

【背景技術】

【0002】

疾病治療において、患者の診断と治療の伝統的な方法は、外科的手術で開腹後に肉眼で発病状態を確認し、巨大な手術用機器を利用して病変部位に切開及び形成を行う方法であった。しかし、最近医療技術の発達につれて高解像度の医療映像を得ることができ、且つ医療機器の微細な操作が可能になることで、人体を直接的に切開しなくても皮膚に小さな穴をあけた後、血管或いはその他の所望の身体部位に直接カテーテルや医療用針を入れて、医学映像装置で身体内を観察しながら治療する方法が開発されている。これを“映像を利用する手術法”、“インターベンション映像手術法”又は“仲介的映像手術法”と呼ぶ。手術者は、臓器や病変の位置を、映像を通じて把握する。更に、手術をする間に患者は呼吸をしたり動いたりするが、これによる変化を把握しなければならない。従って、手術者はリアルタイム映像に基づいて呼吸や動きを正確且つ迅速に把握して手術しなければならないが、この時にリアルタイム映像で臓器と病変の形状を肉眼で把握することが難しい。従って、これを解決するために、手術者にリアルタイムで臓器の形状及び位置を知らせる方法及び装置が登場している。

【0003】

一方、超音波診断部の外部で得られた外部映像を提供し、外部映像内の病変の位置情報に基づいて外部映像の座標を超音波映像の座標に一致させて、超音波映像と外部映像とを合成する方法が知られており、これについては、特許文献1に開示されている。

【先行技術文献】

【特許文献】

【0004】

【特許文献1】韓国特許公開2007−0110965号明細書

【発明の概要】

【発明が解決しようとする課題】

【0005】

本発明は、上記従来技術に鑑みてなされたものであって、本発明の目的は、患者のリアルタイム医療映像から、臓器の迅速且つ正確な追跡に好適な映像を生成する方法及び装置を提供することにある。また、本発明の他の目的は、この方法をコンピュータで実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体を提供することにある。

【課題を解決するための手段】

【0006】

上記目的を達成するためになされた本発明の一特徴による臓器映像生成方法は、患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する段階と、前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合させることで複数の整合映像を生成する段階と、前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択して出力する段階と、を有する。

【0007】

また、本発明による前記臓器映像生成方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体を提供する。

【0008】

上記目的を達成するためになされた本発明の一特徴による臓器映像生成装置は、患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する臓器モデル生成部と、前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合した複数の映像を生成する映像整合部と、前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択する映像検索部と、を備える。

【発明の効果】

【0009】

本発明によれば、リアルタイムで出力される医療映像にグラフィック的な臓器のモデルを合成して出力することで、仲介的手術時臓器の位置を正確で迅速に追跡できる。

【図面の簡単な説明】

【0010】

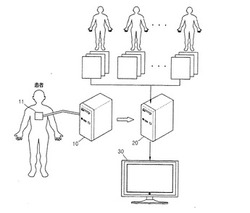

【図1】本発明の一実施形態による身体臓器映像生成システムの構成図である。

【図2】図1に示した映像整合装置20の構成図である。

【図3】平均モデル生成部202における臓器境界及び内部構造の位置座標情報を抽出する過程の一例を示す図面である。

【図4】映像整合部204が、臓器の変形を反映した個人化モデルを、超音波映像における臓器の位置と各映像別に一致させる過程のフローチャートである。

【図5】2次元映像でアフィン変換関数Taffineを獲得する一例を示す図面である。

【図6】映像整合部204で映像を整合する過程を示す図面である。

【図7】横隔膜の絶対的な位置の上下移動グラフである。

【図8】3次元的な臓器モデル基盤の動的臓器及び病変追跡方法の全体的なフローチャートである。

【発明を実施するための形態】

【0011】

以下、本発明を実施するための形態の具体例を、図面を参照しながら詳細に説明する。

【0012】

図1は、本発明の一実施形態による身体臓器映像生成システムの構成図である。図1を参照すると、図1に示した実施形態による身体臓器映像生成システムは、映像検出装置10、映像整合装置20、映像表示装置30で構成される。映像検出装置10は、これに装着されたプローブ11から発生したソース信号が、医者などの医療専門家が診断しようとする患者身体の特定部位に伝達されることで発生する反応を利用して、映像データを生成する。ここで、ソース信号は、超音波、X線などの様々な信号になりうる。映像検出装置10が超音波を利用して患者身体から3次元映像を検出する超音波診断器である場合を挙げて説明すると、次の通りである。

【0013】

超音波診断器におけるプローブ11は、一般的に圧電変換器で製作される。映像検出装置10のプローブ11から、2〜18MHz範囲の超音波が患者の身体内部の特定部位に伝達されると、この超音波は、様々な他の組織間の階層から部分的に反射される。特に、超音波は身体内部の密度変化のあるところ、例えば、血しょう内の血球、臓器内の小さな組織などで反射される。このように反射された超音波はプローブ11の圧電変換器を振動させ、圧電変換器は、この振動による電気的パルスを出力する。これらの電気的パルスが映像に変換される。

【0014】

映像検出装置10は、2次元的な映像を出力することもできるが、3次元的な映像も出力できる。映像検出装置10が3次元的な映像を出力する方法は、次の通りである。患者身体上でプローブ11の位置及び方向を変化させながら、患者身体の特定部位に対する複数の断面映像を検出する。次いで、映像検出装置10は、これらの断面映像を蓄積して患者身体の特定部位を3次元的に表す3次元ボリュームの映像データを生成する。このように断面映像を蓄積して3次元ボリュームの映像データを生成する方式を、MPR(Multiplanar reconstruction)方式という。

【0015】

ところが、このように映像検出装置10により得られる映像、例えば、超音波映像はリアルタイム映像を得ることができるという長所があるが、臓器の輪郭、内部構造や病変を明確に識別し難いという短所がある。

【0016】

一方、CT(Computed Tomography)映像やMR(Magnetic Resonance)映像の場合には、臓器の位置や病変の位置が明確に区別されるという長所がある。しかし、CT映像やMR映像は、手術する間に患者が呼吸をしたり動いたりする時に、臓器が変形するか位置が変わってリアルタイムの変化を反映した映像を得られないという短所がある。リアルタイムで映像を出力できないそれぞれの理由は、CT映像の場合、放射線を利用した撮影方法であるため、患者と手術者とが長時間放射線に露出される恐れがあるため短時間の撮影が薦められ、MR映像の場合、一度撮影するのに長時間がかかるためである。

【0017】

これにより、リアルタイムで撮影できると同時に臓器の輪郭、内部構造や病変を明確に識別する方法及び装置が要求される。従って、以下で説明する実施形態は、リアルタイムで検出された映像から臓器及び病変のモデルを整合した映像を出力して、リアルタイム映像で臓器及び病変の正確な位置や変形を識別できる方法を提示する。

【0018】

図2は、図1に示した映像整合装置20の構成図である。図2を参照すると、図1に示した映像整合装置20は、医療映像DB 201、平均モデル生成部202、個人化モデル生成部203、映像整合部204、映像検索部205、追加調整部206、及びストレージ207で構成される。

【0019】

平均モデル生成部202は、多様な個人の医療映像を入力してこれを処理することで、対象臓器の平均的なモデルを出力する。本実施形態では、患者個人化モデルを生成して臓器を追跡するが、ここで平均的なモデルを生成する段階は、個人化したモデルを生成するための準備段階である。その理由は、個人によって臓器の形態、サイズ、特徴などの多様性があって、正確な手術環境を提供するためには患者個人の特性を反映する必要があるためである。一方、正確な平均的モデルを得るためには、多様な個人の映像情報が活用される。また、各個人から得た映像からも、呼吸によって変わる臓器の形態を反映するために多様な呼吸の映像を得ることができる。

【0020】

具体的に、先ず平均モデル生成部202は、多様な個人の臓器形態、サイズなどを分析するために、医療専門家が患者の診断のために撮影した映像(以下、外部医療映像という)を、撮影機器から直接又は映像が保存された記録媒体から入力する。従って、臓器と病変の輪郭や臓器内部の特徴の分析が容易な映像を入力することが望ましい。例えば、CT或いはMR映像が入力される。

【0021】

外部映像を入力する他の方法としては、医療映像DB 201によって外部医療映像がデータベース化されて保存された映像を入力することができる。医療映像DB 201は、外部医療映像が多様な個人から撮影装置で撮影されて保存されたものでもよく、記録媒体から入力してもよい。医療映像DB 201から映像を入力する際には、映像全部を入力してもよく、ユーザの選択によって一部を入力してもよい。

【0022】

一実施形態として、平均モデル生成部202は、入力された外部医療映像に基づいて3次元ASM(Active Shape Models)アルゴリズムを適用することができる。アルゴリズムを適用するために、先ず外部医療映像を分析して各外部医療映像から臓器の形態、サイズ、解剖学的特徴を抽出し、これらの平均を算出して統計的に平均を算出したモデルを生成する。ASMアルゴリズムは、1994年に発表された“The Use of Active Shape Models For Locating Structure in Medical Images”(T.F.Cootes,A.Hill,C.J.Taylor and J.Haslam著)に詳細な説明がある。ASMアルゴリズムを適用すると、平均的な臓器の形状を得ることができ、この平均的な臓器形状は、変数を調整する場合にその形態を変形させることができる。

【0023】

図3は、平均モデル生成部202が外部医療映像を分析する過程を示し、入力されたCT或いはMR映像の臓器境界及び内部構造の位置座標情報を抽出する概略的な方法を示したものである。平均モデル生成部202は、CT或いはMR映像が入力されると、臓器境界及び内部構造の位置座標情報を抽出する際、2次元映像である場合と3次元映像である場合とで異なる方式で進められる。ここで、内部構造とは、肝臓を例にすると、肝動脈、肝静脈、肝門脈と肝管の位置などがあり、これらの境界値も含まれる。

【0024】

2次元映像を入力する場合、3次元モデルを生成するために、複数の断面映像を蓄積して対象部位を3次元的に表す3次元ボリュームの映像データを得る。この過程は、図3の左側部分に、複数の映像情報が重なって3次元ボリューム映像を得る方法を図示している。重ねる前に複数の断面映像における臓器境界及び内部構造の位置座標情報を抽出した後、重ねる方向軸の座標情報を追加して3次元座標情報を得ることができるが、図3の右側部分に示した映像はz軸の値が1である映像であるため、映像から抽出される境界位置座標値のzは常に1である。従って、左側映像データの断面の座標情報を抽出する際、これは2次元の座標情報であるためx、y軸のデータで表されるが、z軸の座標情報まで含めて[x,y,1]の座標で境界の位置座標情報を抽出する。すると、座標情報は、x,y,z軸の座標を含む情報になる。3次元映像が入力される場合には、所定の間隔で3次元映像の断面を抽出した後、2次元映像が入力された場合と同じ過程を経ることで、臓器境界及び内部構造の位置座標情報を得ることができる。この過程での2次元映像からの境界位置座標の抽出は、アルゴリズムによる自動又は半自動的になされ、出力された映像情報を見てユーザが受動的に座標情報を入力してもよい。自動で境界の座標情報を得る方法を挙げると、映像から輝度の急変する地点の座標情報を得ることができ、DTFT(Discrete Time Fourier Transform)を利用して、周波数値の最も大きい位置を境界として抽出できる。半自動的な方法は、ユーザにより映像から一部警戒地点についての情報が入力されると、警戒地点に基づいて自動で座標を得る方法と同一に周辺の境界を抽出できる。臓器の境界は連続的であり、閉曲線形態をなすため、上記性質を利用して臓器境界全体についての情報を得ることができる。このように半自動の方法は映像全体を検索しなくてもよいため、自動的な場合より更に早く結果を得ることができる。受動的に得る場合には、ユーザが映像を見ながら直接境界の座標を指定できるが、この時に指定する間隔は連続的でないため、中間の不連続的な区間については、補間を通じて連続的に境界を抽出する。上記方法で得た臓器と病変の位置座標情報は、3次元空間でその座標に該当するボクセルにおける輝度値を所定の値に設定した後で出力することで、ユーザが3次元グラフィック的に表現された臓器と内部構造の態様を確認できる。例えば、対象臓器境界座標の輝度値を最小、即ち最も暗い値に設定すると、出力される映像で対象臓器の映像は黒い形態で出力され、対象臓器の輝度を白色と黒色との中間値に設定し、病変の座標の輝度を黒色に設定することで、対象臓器及び病変を容易に肉眼で区分できる。上記方法で得た複数の臓器境界及び内部構造の位置座標情報をデータセットと定めて、3次元ASMアルゴリズムを活用するための情報として活用できる。以下、ASMアルゴリズムについて説明する。

【0025】

ASMアルゴリズムを適用するために、複数の臓器境界と内部構造との位置座標情報の座標軸を一致させる。座標軸を一致させるとは、複数の対象体の重さ中心を一つの原点に一致させ、多様な形態に対してあらゆる臓器の方向を整列させることを意味する。次いで、複数の臓器境界と内部構造との位置座標情報で特徴点になる地点を決定する。特徴点とは、アルゴリズムを適用させるための基本的な地点をいう。特徴点は下記のような方法で決定する。

【0026】

第1に、対象の特徴が明確に反映された地点を特徴点と定める。例えば、肝臓の場合、あらゆる人が共通的に持っている血管が分けられる地点、又は心臓の場合、右心房と左心房とが分けられる境界、大静脈と心臓の外壁とが合う境界などがある。

【0027】

第2に、定められた座標系で対象体の最も高い地点、或いは最も低い地点を特徴点と定める。

【0028】

第3に、第1及び第2で定めた点の間を補間できる地点を、所定の一定の間隔で境界に沿って特徴点として指定する。

【0029】

指定された特徴点は、2次元である場合にx,y軸の座標で表し、3次元である場合にx,y,z軸の座標で表す。従って、3次元である場合にそれぞれの特徴点座標をベクトルとして

のように表すと(nは、特徴点の個数を意味する)、数式1で表現できる。

【0030】

【数1】

【0031】

下添字iは、i番目の映像から得た臓器境界と内部構造との位置座標情報を意味する。位置座標情報は、場合によってその個数が多くなりうるが、その演算を容易にするために一つのベクトルで表現する。これにより、特徴点全体を一つのベクトルで表した特徴点ベクトルを、数式2で定義できる。

【0032】

【数2】

xiベクトルのサイズは3n×lである。

【0033】

データセットの個数をN個とすると、セット全体に対して特徴点の平均を、下記の数式3で表すことができる。

【0034】

【数3】

【0035】

同様に、

ベクトルのサイズは3n×lである。

【0036】

平均モデル生成部202は、数式3を計算すると平均的な特徴点である

を得て、これに基づいたモデルを生成することで、そのモデルが平均的な臓器モデルになりうる。ASMアルゴリズムは、平均的なモデルを生成するだけでなく、更に平均的なモデルを、複数のパラメータの調節だけで形態を変形させることができる。従って、平均モデル生成部202は、単純に平均的なモデルを計算するだけでなく、複数のパラメータを適用できるように数式を計算する。以下、パラメータを適用する数式を説明する。

【0037】

下記の数式4によって特徴点の平均と各データとの差を表すことができる。数式4で、下添字iは、i番目の映像を意味する。従って、数式4は、各映像における特徴点の全体映像の平均との差を意味する。

【0038】

【数4】

【0039】

各データの差を利用して数式5により、3つの変数x,y,zに対する共分散行列を定義できる。共分散行列を求める理由は、ASMアルゴリズムを適用するための複数のパラメータに対するアイゲンベクトルを求めるためである(詳細な内容は、上記論文に記載されている)。

【0040】

【数5】

【0041】

共分散行列Sの単位アイゲンベクトルをpkとすると、ベクトルpkが意味するものは、ASMアルゴリズムにより生成されたモデルが変化する態様である。例えば、ベクトルp1と乗算されたパラメータb1を

で変形させると、左右への長さが変わるか、又はベクトルp2と乗算されたパラメータb2を

で変形させると、上下への長さが変わることをいう。従って、この単位アイゲンベクトルpk(サイズ3n×l)を、下記のように数式6により求める。

【0042】

【数6】

(λkは、アイゲン値(eigen−value)を意味する)

【0043】

それにより、最終的に変形を適用した特徴点ベクトルxを、特徴点の平均ベクトルである

を利用して計算すると、

【0044】

【数7】

ここでp=(p1,p2,…pt)(各pkのサイズ3n×l、pのサイズ3n×t)は、最初のt個のアイゲンベクトルをいい、b=(b1,b2,…bt)T(サイズt×l)は、各アイゲンベクトルの比重(weight)を意味する。

【0045】

平均モデル生成部202は、上記過程の数式の計算を通じて、平均的なモデルの形態を意味する

(サイズ3n×l)と、3次元ASMアルゴリズムを利用して変形を適用するためのp=(p1,p2,…pt)(サイズ3n×t)ベクトルと、を計算できる。

【0046】

個人化モデル生成部203は、平均モデル生成部202から平均的な臓器モデル(

)とp=(p1,p2,…pt)(サイズ3n×t)ベクトルと、を入力し、3次元ASMアルゴリズムのパラメータ処理により個人化モデルを生成する。患者個人の臓器形状も同様に形態やサイズなどがそれぞれ異なるので、平均的な臓器モデルをそのまま使用すると、正確性が落ちる。その理由は、個人によって平均形態より左右が長いか、上下が長いか、又は左側がより厚いか、右側がより下方に下がっているなどの特徴があるためである。また個人の臓器に病変がある場合、病変の形態及び位置を正確に把握するために、個人化モデル生成部203は、病変の位置をモデルに含ませる。従って、個人化モデル生成部203は、映像撮影装置又は記録媒体から患者個人の外部医療映像を入力して、個人臓器形態、サイズ、位置情報を分析し、病変があると、病変の位置、サイズ、形態情報を分析する。以下、この過程を詳細に説明する。

【0047】

個人化モデル生成部203は、CT或いはMR映像のように臓器の形状を明確に把握できる映像に基づいて、患者個人のASMアルゴリズムのアイゲンベクトルの比重値(ベクトルb)を決定する。従って、先ず患者個人の外部医療映像を入力して臓器境界及び内部構造の位置座標情報を把握する。この際は、平均モデル生成部202が外部医療映像を分析する過程のように、図3の過程で把握する。更に上記アルゴリズムを初めて適用する際、特徴点を把握した方法と同じ過程で特徴点座標情報を把握すると、患者個人化した特徴点集合であるベクトルx(サイズ3n×l)の値を得ることができる。上記ベクトルに基づいて臓器モデルを生成したものが個人化モデルになる。数式7の逆関数及び単位アイゲンベクトルの性質(

)を活用すると、下記の数式8を得ることができる。数式8によって値を決定する。

【0048】

【数8】

【0049】

一方、平均モデル生成部202より決定されたベクトル情報

は、ストレージ207に対象臓器に対する平均的なモデルとして保存して、データベース化して反復的に使われる。また、個人化モデル生成部202に入力された患者個人の外部医療映像は、次の患者の診療時にデータベースに保存された平均的なモデルを決定する際に追加する学習過程を持つ。

【0050】

映像整合部204は、個人化モデル生成部203からベクトル

情報を受けると、これを所定の周期の間の患者の医療映像と整合させる。超音波映像で臓器の位置に、ASMアルゴリズムを利用したモデルを重ねて出力するという意味であり、より正確には、映像でASMアルゴリズムにより形成されたモデルの座標情報に該当するピクセル或いはボクセル値を、所定の輝度に置換又は重畳させるという意味である。置換すると、元来の超音波映像から臓器部分は除去されて個人化モデルのみを出力するが、重畳させると、元来の超音波映像と個人化モデルとが重なった映像が出力される。重なった映像は、色を異ならせると肉眼で区分しやすい。例えば、白黒超音波映像に個人化モデルを青色で重畳させると、グラフィック的な形態を肉眼で容易に区別できる。

【0051】

医療映像は、望ましくは、リアルタイム映像を撮影できる映像であり、例えば、超音波映像がある。医療映像は、2次元或いは3次元映像である。所定の周期は、望ましくは1呼吸周期になる。その理由は、身体の呼吸周期の間に臓器の変化も一定の周期を持つためである。例えば、患者の1呼吸周期を5秒とした場合、超音波映像を1秒当たり20フレーム生成すると、100フレームの映像が生成される。

【0052】

映像整合部204で映像を整合する過程は、2段階に大別できる。所定の周期の間に入力される超音波映像で、呼吸による臓器の変化を3次元臓器モデルに反映させる段階と、変形が反映された3次元臓器モデルをスケール調整、軸回転及び軸移動して超音波映像における対象臓器と整列させる段階と、である。

【0053】

映像整合部204が、呼吸による臓器の変化を3次元臓器モデルに反映させる段階は下記の通りである。医療映像と整合する前に超音波映像の場合を例として挙げると、超音波映像の各フレーム別に臓器の位置及び変化を把握して、ASMアルゴリズムのパラメータの比重値であるベクトルbの値を調整する。この時に決定されるベクトルbの値は、平均モデル生成部202で決定されたベクトルbの値とあまり差がない。その理由は、映像整合部204は、患者の呼吸による変化のみ反映されるが、呼吸による臓器の形状変化は、他の個人との変化に比べて小さいためである。従って、ベクトルbの値を決定する際に、平均モデル生成部202で決定されたベクトルbの値に基づいて、所定の制限された範囲内の変形のみを加える。更に、前フレームのベクトルbは、次のフレームのベクトルbの決定に反映できる。その理由は、呼吸過程での臓器の変化は連続的であるため、短いフレーム間の周期の間に大きい変化がないためである。ベクトルbの値を決定すると、3次元ASMアルゴリズムの演算により、各超音波映像に臓器の変形を反映した個人化モデルをフレーム別に生成できる。

【0054】

図4は、映像整合部204が各映像別に臓器の変形を反映した個人化モデルを、回転、スケール調整、平行移動を通じて超音波映像における臓器の位置と一致させる過程のフローチャートである。詳細には、各フレーム別にアイゲンベクトルの比重値であるベクトルbが定められた場合に、各フレーム別に一対一アフィン整合を行うフローチャートである。フレームの個数をNとし、nをフレーム番号とすると、n=1からn=Nになるまで一対一整合を行う。超音波映像における特徴点集合とモデルの特徴点集合とを使用して、各フレーム別にICP(Iterative Closest Point)アルゴリズムを利用してアフィン変換関数Taffineを獲得し、これを利用して3次元身体臓器モデル映像を変換する。ICPアルゴリズムとは、複数の映像内の対象体を整列させるために、一つの映像を基準に残りの映像を回転、平行移動、スケール調整させるアルゴリズムである。ICPアルゴリズムは、“Iterative point matching for registration of free−form curves and surfaces”(Zhengyou Zhang著)に詳細な説明がある。

【0055】

図5は、2次元映像でアフィン変換関数を獲得する方法を簡略に示したものである。501は、変換を適用する前の状態であり、502は、変換を適用した後の状態である。変換の適用時には回転、平行移動、スケール調整をしなければならないが、アフィン変換が1:1点対応ということを利用すると、下記の数式9によって最初の座標と最終の座標とを獲得することで、直ちに行列Taffineの係数を決定できる。

【0056】

【数9】

【0057】

数式10は、2次元ではない3次元以上で獲得したアフィン変換関数(Taffine)を各フレーム別に適用させる式である。

【数10】

【0058】

nは、n番目のフレームを意味し、(1≦n≦N)の整数である。

は、映像整合部204で比重値であるベクトルbを変化させた特徴点ベクトルを意味する。形成された

は、各フレーム別に変形を反映した臓器境界及び内部構造の位置座標情報があるが、これを超音波映像と整合させる際に、超音波映像で位置座標に該当するボクセル値を所定の輝度値に置換或いは重畳させると、肉眼で臓器のグラフィック的な態様を確認できる。

【0059】

図6は、映像整合部204で映像を整合する過程を概略的に示すものである。図6は、一呼吸周期の間に入力された超音波映像に基づいて映像整合部204から入力された所定周期の間の医療映像と、身体臓器モデルとの整合映像を形成する過程を示した。入力された超音波映像は、図6で左側エッジに配置されており、入力された超音波映像で*は、特徴点を表示したものである。入力された超音波映像は、吸気から呼気に至るまで呼吸の様々な形態を反映することが望ましい。

【0060】

個人化モデル生成部203が生成した個人化モデルは、呼吸によってその形態が変形される。しかし、呼吸による変形は、個人間の多様性による変形よりは小さい。従って、呼吸による変形を反映する際に3次元ASMアルゴリズムパラメータの値を新たに求めることより、個人化モデル生成部203により決定されたパラメータ値で調整する方法がより迅速且つ容易である。変形を反映した臓器モデルの特徴点と、超音波映像の臓器における特徴点とを利用して、ICPアルゴリズムを通じてアフィン変換関数Taffineを適用する。アフィン変換を介することで、3次元臓器モデルのサイズ及び位置が、超音波映像内の臓器のサイズ及び位置に合うように変わる。変形されたモデルを超音波映像に合成することは、モデルの位置に該当する超音波映像のピクセル(又はボクセル)値を一定の値に置換又は重畳する方法により行うことができる。一方、整合された映像を超音波−モデル整合映像といい、ストレージ207に保存する。

【0061】

映像検索部205は、手術する過程での処理を行う。手術する過程を簡単に説明すると、リアルタイムで入力される超音波映像に臓器のグラフィック的形状が画面に出力され、手術者は、これを肉眼で確認しながら手術をする。この過程を具体的に説明すると、先ず、患者のリアルタイム医療映像を入力する。この時、医療映像は、望ましくは、映像整合部204から入力される映像と同じ映像である。従って、上記例と同様に、超音波映像を例として挙げると、リアルタイム超音波映像を入力して、映像整合部204に入力された所定周期の間の医療映像と比較して最も類似した映像を決定し、決定された映像と対応する超音波−モデル整合映像をストレージ207で検索して出力する。

【0062】

映像検索部205で超音波映像における類似した映像を比較する実施形態としては、横隔膜の位置を検出して映像を決定する方法がある。入力されるリアルタイム医療映像で横隔膜の位置がXならば、映像整合部204に入力された所定周期の複数の医療映像でそれぞれの横隔膜の位置とXとの差を計算して、その差の最も小さな映像を検索する方法である。図7は、横隔膜の絶対的な位置の上下移動グラフを示す。グラフを分析すると、呼吸の周期で位置が規則的に変わることが分かる。望ましくは、映像整合部204から入力される所定周期の医療映像と、映像検索部205から入力されるリアルタイム医療映像との撮影時に、プローブ11の位置及び患者の位置を固定させる。その理由は、プローブ11の位置或いは患者の位置が変わると、映像で臓器の相対的な位置が変わり、相対的な位置が変わると、映像を比較する時に正確且つ早く検索できないためである。

【0063】

映像検索部205で超音波映像における類似した映像を比較する更に他の実施形態としては、ピクセルの輝度差を利用して映像を決定する方法がある。最も類似した映像同士ではその輝度の差が最も少ないということを利用した方法である。具体的には、整合に使われた所定周期の医療映像(第1映像)のうち、リアルタイム医療映像の1フレームの映像(第2映像)と類似した映像を探す際、先ず第1映像のうちのいずれか一つの映像と第2映像の各ピクセル間の輝度差を計算して、全体輝度差に対する分散を求める。次いで、残りの第1映像と第2映像ともそれぞれ上記のような方法で分散を求めてその分散が最も小さな映像を決定すると、最も類似した映像を決定できる。

【0064】

一方、追加調整部206は、出力された映像を見てユーザがアフィン変換関数Taffine、3次元ASMアルゴリズムのパラメータを調整して最終出力結果を調整する。ユーザが出力映像を見ながら肉眼で正確な変換を行うことができる。

【0065】

図8は、3次元的な臓器モデル基盤の動的臓器と病変追跡方法の全体的なフローチャートを示すものである。802段階及び803段階は、既に処理されたデータをデータベース化する。802段階は、多様な個人に対して各個人の多様な呼吸周期に対するCT或いはMR映像を入力する。803段階は、入力された映像に基づいて3次元身体臓器モデルを生成する。その際、3次元ASMアルゴリズムを使用できるということは、上述した通りである。

【0066】

801段階は、患者個人のCT或いはMR映像を入力する。804段階は、入力された映像に基づいて803段階で生成された3次元身体臓器モデルを変形させる。個人化した3次元身体臓器モデルを生成する過程は準備過程であり、手術室外でも行われうる。805段階は、患者1呼吸周期の間の超音波映像(以下、第1超音波映像という)が入力され、第1超音波映像と個人化した身体臓器モデルとを整合する。整合された映像を超音波−モデル整合映像といい、一時的メモリに保存してもよいし、ストレージなどの記録媒体に保存してもよい。805段階は、手術室内の準備過程で行われうる。また805段階及び806段階の患者及びプローブの位置は固定されていることが望ましい。806段階で手術室でのリアルタイム段階として、リアルタイムで患者の超音波映像(第2超音波映像)が入力されると、超音波映像と最も類似した第1超音波映像が決定され、決定された第1超音波映像に対応する超音波−モデル整合映像を出力する。

【0067】

一方、上述した本発明の実施形態は、コンピュータで実行されるプログラムで作成でき、コンピュータ読み取り可能な記録媒体を利用してプログラムを作動させる汎用デジタルコンピュータで具現できる。また、上述した本発明の実施形態で使われたデータの構造は、コンピュータ読み取り可能な記録媒体に様々な手段により記録される。コンピュータ読み取り可能な記録媒体は、マグネチック記録媒体(例えば、ROM、フロッピー(登録商標)ディスク、ハードディスクなど)、光学的判読媒体(例えば、CD−ROM、DVDなど)などの記録媒体を含む。

【0068】

以上、図面を参照しながら本発明の実施形態について詳細に説明したが、本発明は、上述の実施形態に限定されるものではなく、本発明の技術的範囲から逸脱しない範囲内で多様に変更実施することが可能である。

【産業上の利用可能性】

【0069】

本発明は、3次元的モデルを利用した身体臓器の映像生成装置関連の技術分野に好適に用いられる。

【符号の説明】

【0070】

11 プローブ

10 映像検出装置

20 映像整合装置

30 映像表示装置

101 整合映像形成部

201 医療映像DB

202 平均モデル生成部

203 個人化モデル生成部

204 映像整合部

205 映像検索部

206 追加調整部

207 ストレージ

【技術分野】

【0001】

本発明は、3次元的モデルを利用した身体臓器の映像を生成する方法及び装置、並びにその方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体に関する。

【背景技術】

【0002】

疾病治療において、患者の診断と治療の伝統的な方法は、外科的手術で開腹後に肉眼で発病状態を確認し、巨大な手術用機器を利用して病変部位に切開及び形成を行う方法であった。しかし、最近医療技術の発達につれて高解像度の医療映像を得ることができ、且つ医療機器の微細な操作が可能になることで、人体を直接的に切開しなくても皮膚に小さな穴をあけた後、血管或いはその他の所望の身体部位に直接カテーテルや医療用針を入れて、医学映像装置で身体内を観察しながら治療する方法が開発されている。これを“映像を利用する手術法”、“インターベンション映像手術法”又は“仲介的映像手術法”と呼ぶ。手術者は、臓器や病変の位置を、映像を通じて把握する。更に、手術をする間に患者は呼吸をしたり動いたりするが、これによる変化を把握しなければならない。従って、手術者はリアルタイム映像に基づいて呼吸や動きを正確且つ迅速に把握して手術しなければならないが、この時にリアルタイム映像で臓器と病変の形状を肉眼で把握することが難しい。従って、これを解決するために、手術者にリアルタイムで臓器の形状及び位置を知らせる方法及び装置が登場している。

【0003】

一方、超音波診断部の外部で得られた外部映像を提供し、外部映像内の病変の位置情報に基づいて外部映像の座標を超音波映像の座標に一致させて、超音波映像と外部映像とを合成する方法が知られており、これについては、特許文献1に開示されている。

【先行技術文献】

【特許文献】

【0004】

【特許文献1】韓国特許公開2007−0110965号明細書

【発明の概要】

【発明が解決しようとする課題】

【0005】

本発明は、上記従来技術に鑑みてなされたものであって、本発明の目的は、患者のリアルタイム医療映像から、臓器の迅速且つ正確な追跡に好適な映像を生成する方法及び装置を提供することにある。また、本発明の他の目的は、この方法をコンピュータで実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体を提供することにある。

【課題を解決するための手段】

【0006】

上記目的を達成するためになされた本発明の一特徴による臓器映像生成方法は、患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する段階と、前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合させることで複数の整合映像を生成する段階と、前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択して出力する段階と、を有する。

【0007】

また、本発明による前記臓器映像生成方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体を提供する。

【0008】

上記目的を達成するためになされた本発明の一特徴による臓器映像生成装置は、患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する臓器モデル生成部と、前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合した複数の映像を生成する映像整合部と、前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択する映像検索部と、を備える。

【発明の効果】

【0009】

本発明によれば、リアルタイムで出力される医療映像にグラフィック的な臓器のモデルを合成して出力することで、仲介的手術時臓器の位置を正確で迅速に追跡できる。

【図面の簡単な説明】

【0010】

【図1】本発明の一実施形態による身体臓器映像生成システムの構成図である。

【図2】図1に示した映像整合装置20の構成図である。

【図3】平均モデル生成部202における臓器境界及び内部構造の位置座標情報を抽出する過程の一例を示す図面である。

【図4】映像整合部204が、臓器の変形を反映した個人化モデルを、超音波映像における臓器の位置と各映像別に一致させる過程のフローチャートである。

【図5】2次元映像でアフィン変換関数Taffineを獲得する一例を示す図面である。

【図6】映像整合部204で映像を整合する過程を示す図面である。

【図7】横隔膜の絶対的な位置の上下移動グラフである。

【図8】3次元的な臓器モデル基盤の動的臓器及び病変追跡方法の全体的なフローチャートである。

【発明を実施するための形態】

【0011】

以下、本発明を実施するための形態の具体例を、図面を参照しながら詳細に説明する。

【0012】

図1は、本発明の一実施形態による身体臓器映像生成システムの構成図である。図1を参照すると、図1に示した実施形態による身体臓器映像生成システムは、映像検出装置10、映像整合装置20、映像表示装置30で構成される。映像検出装置10は、これに装着されたプローブ11から発生したソース信号が、医者などの医療専門家が診断しようとする患者身体の特定部位に伝達されることで発生する反応を利用して、映像データを生成する。ここで、ソース信号は、超音波、X線などの様々な信号になりうる。映像検出装置10が超音波を利用して患者身体から3次元映像を検出する超音波診断器である場合を挙げて説明すると、次の通りである。

【0013】

超音波診断器におけるプローブ11は、一般的に圧電変換器で製作される。映像検出装置10のプローブ11から、2〜18MHz範囲の超音波が患者の身体内部の特定部位に伝達されると、この超音波は、様々な他の組織間の階層から部分的に反射される。特に、超音波は身体内部の密度変化のあるところ、例えば、血しょう内の血球、臓器内の小さな組織などで反射される。このように反射された超音波はプローブ11の圧電変換器を振動させ、圧電変換器は、この振動による電気的パルスを出力する。これらの電気的パルスが映像に変換される。

【0014】

映像検出装置10は、2次元的な映像を出力することもできるが、3次元的な映像も出力できる。映像検出装置10が3次元的な映像を出力する方法は、次の通りである。患者身体上でプローブ11の位置及び方向を変化させながら、患者身体の特定部位に対する複数の断面映像を検出する。次いで、映像検出装置10は、これらの断面映像を蓄積して患者身体の特定部位を3次元的に表す3次元ボリュームの映像データを生成する。このように断面映像を蓄積して3次元ボリュームの映像データを生成する方式を、MPR(Multiplanar reconstruction)方式という。

【0015】

ところが、このように映像検出装置10により得られる映像、例えば、超音波映像はリアルタイム映像を得ることができるという長所があるが、臓器の輪郭、内部構造や病変を明確に識別し難いという短所がある。

【0016】

一方、CT(Computed Tomography)映像やMR(Magnetic Resonance)映像の場合には、臓器の位置や病変の位置が明確に区別されるという長所がある。しかし、CT映像やMR映像は、手術する間に患者が呼吸をしたり動いたりする時に、臓器が変形するか位置が変わってリアルタイムの変化を反映した映像を得られないという短所がある。リアルタイムで映像を出力できないそれぞれの理由は、CT映像の場合、放射線を利用した撮影方法であるため、患者と手術者とが長時間放射線に露出される恐れがあるため短時間の撮影が薦められ、MR映像の場合、一度撮影するのに長時間がかかるためである。

【0017】

これにより、リアルタイムで撮影できると同時に臓器の輪郭、内部構造や病変を明確に識別する方法及び装置が要求される。従って、以下で説明する実施形態は、リアルタイムで検出された映像から臓器及び病変のモデルを整合した映像を出力して、リアルタイム映像で臓器及び病変の正確な位置や変形を識別できる方法を提示する。

【0018】

図2は、図1に示した映像整合装置20の構成図である。図2を参照すると、図1に示した映像整合装置20は、医療映像DB 201、平均モデル生成部202、個人化モデル生成部203、映像整合部204、映像検索部205、追加調整部206、及びストレージ207で構成される。

【0019】

平均モデル生成部202は、多様な個人の医療映像を入力してこれを処理することで、対象臓器の平均的なモデルを出力する。本実施形態では、患者個人化モデルを生成して臓器を追跡するが、ここで平均的なモデルを生成する段階は、個人化したモデルを生成するための準備段階である。その理由は、個人によって臓器の形態、サイズ、特徴などの多様性があって、正確な手術環境を提供するためには患者個人の特性を反映する必要があるためである。一方、正確な平均的モデルを得るためには、多様な個人の映像情報が活用される。また、各個人から得た映像からも、呼吸によって変わる臓器の形態を反映するために多様な呼吸の映像を得ることができる。

【0020】

具体的に、先ず平均モデル生成部202は、多様な個人の臓器形態、サイズなどを分析するために、医療専門家が患者の診断のために撮影した映像(以下、外部医療映像という)を、撮影機器から直接又は映像が保存された記録媒体から入力する。従って、臓器と病変の輪郭や臓器内部の特徴の分析が容易な映像を入力することが望ましい。例えば、CT或いはMR映像が入力される。

【0021】

外部映像を入力する他の方法としては、医療映像DB 201によって外部医療映像がデータベース化されて保存された映像を入力することができる。医療映像DB 201は、外部医療映像が多様な個人から撮影装置で撮影されて保存されたものでもよく、記録媒体から入力してもよい。医療映像DB 201から映像を入力する際には、映像全部を入力してもよく、ユーザの選択によって一部を入力してもよい。

【0022】

一実施形態として、平均モデル生成部202は、入力された外部医療映像に基づいて3次元ASM(Active Shape Models)アルゴリズムを適用することができる。アルゴリズムを適用するために、先ず外部医療映像を分析して各外部医療映像から臓器の形態、サイズ、解剖学的特徴を抽出し、これらの平均を算出して統計的に平均を算出したモデルを生成する。ASMアルゴリズムは、1994年に発表された“The Use of Active Shape Models For Locating Structure in Medical Images”(T.F.Cootes,A.Hill,C.J.Taylor and J.Haslam著)に詳細な説明がある。ASMアルゴリズムを適用すると、平均的な臓器の形状を得ることができ、この平均的な臓器形状は、変数を調整する場合にその形態を変形させることができる。

【0023】

図3は、平均モデル生成部202が外部医療映像を分析する過程を示し、入力されたCT或いはMR映像の臓器境界及び内部構造の位置座標情報を抽出する概略的な方法を示したものである。平均モデル生成部202は、CT或いはMR映像が入力されると、臓器境界及び内部構造の位置座標情報を抽出する際、2次元映像である場合と3次元映像である場合とで異なる方式で進められる。ここで、内部構造とは、肝臓を例にすると、肝動脈、肝静脈、肝門脈と肝管の位置などがあり、これらの境界値も含まれる。

【0024】

2次元映像を入力する場合、3次元モデルを生成するために、複数の断面映像を蓄積して対象部位を3次元的に表す3次元ボリュームの映像データを得る。この過程は、図3の左側部分に、複数の映像情報が重なって3次元ボリューム映像を得る方法を図示している。重ねる前に複数の断面映像における臓器境界及び内部構造の位置座標情報を抽出した後、重ねる方向軸の座標情報を追加して3次元座標情報を得ることができるが、図3の右側部分に示した映像はz軸の値が1である映像であるため、映像から抽出される境界位置座標値のzは常に1である。従って、左側映像データの断面の座標情報を抽出する際、これは2次元の座標情報であるためx、y軸のデータで表されるが、z軸の座標情報まで含めて[x,y,1]の座標で境界の位置座標情報を抽出する。すると、座標情報は、x,y,z軸の座標を含む情報になる。3次元映像が入力される場合には、所定の間隔で3次元映像の断面を抽出した後、2次元映像が入力された場合と同じ過程を経ることで、臓器境界及び内部構造の位置座標情報を得ることができる。この過程での2次元映像からの境界位置座標の抽出は、アルゴリズムによる自動又は半自動的になされ、出力された映像情報を見てユーザが受動的に座標情報を入力してもよい。自動で境界の座標情報を得る方法を挙げると、映像から輝度の急変する地点の座標情報を得ることができ、DTFT(Discrete Time Fourier Transform)を利用して、周波数値の最も大きい位置を境界として抽出できる。半自動的な方法は、ユーザにより映像から一部警戒地点についての情報が入力されると、警戒地点に基づいて自動で座標を得る方法と同一に周辺の境界を抽出できる。臓器の境界は連続的であり、閉曲線形態をなすため、上記性質を利用して臓器境界全体についての情報を得ることができる。このように半自動の方法は映像全体を検索しなくてもよいため、自動的な場合より更に早く結果を得ることができる。受動的に得る場合には、ユーザが映像を見ながら直接境界の座標を指定できるが、この時に指定する間隔は連続的でないため、中間の不連続的な区間については、補間を通じて連続的に境界を抽出する。上記方法で得た臓器と病変の位置座標情報は、3次元空間でその座標に該当するボクセルにおける輝度値を所定の値に設定した後で出力することで、ユーザが3次元グラフィック的に表現された臓器と内部構造の態様を確認できる。例えば、対象臓器境界座標の輝度値を最小、即ち最も暗い値に設定すると、出力される映像で対象臓器の映像は黒い形態で出力され、対象臓器の輝度を白色と黒色との中間値に設定し、病変の座標の輝度を黒色に設定することで、対象臓器及び病変を容易に肉眼で区分できる。上記方法で得た複数の臓器境界及び内部構造の位置座標情報をデータセットと定めて、3次元ASMアルゴリズムを活用するための情報として活用できる。以下、ASMアルゴリズムについて説明する。

【0025】

ASMアルゴリズムを適用するために、複数の臓器境界と内部構造との位置座標情報の座標軸を一致させる。座標軸を一致させるとは、複数の対象体の重さ中心を一つの原点に一致させ、多様な形態に対してあらゆる臓器の方向を整列させることを意味する。次いで、複数の臓器境界と内部構造との位置座標情報で特徴点になる地点を決定する。特徴点とは、アルゴリズムを適用させるための基本的な地点をいう。特徴点は下記のような方法で決定する。

【0026】

第1に、対象の特徴が明確に反映された地点を特徴点と定める。例えば、肝臓の場合、あらゆる人が共通的に持っている血管が分けられる地点、又は心臓の場合、右心房と左心房とが分けられる境界、大静脈と心臓の外壁とが合う境界などがある。

【0027】

第2に、定められた座標系で対象体の最も高い地点、或いは最も低い地点を特徴点と定める。

【0028】

第3に、第1及び第2で定めた点の間を補間できる地点を、所定の一定の間隔で境界に沿って特徴点として指定する。

【0029】

指定された特徴点は、2次元である場合にx,y軸の座標で表し、3次元である場合にx,y,z軸の座標で表す。従って、3次元である場合にそれぞれの特徴点座標をベクトルとして

のように表すと(nは、特徴点の個数を意味する)、数式1で表現できる。

【0030】

【数1】

【0031】

下添字iは、i番目の映像から得た臓器境界と内部構造との位置座標情報を意味する。位置座標情報は、場合によってその個数が多くなりうるが、その演算を容易にするために一つのベクトルで表現する。これにより、特徴点全体を一つのベクトルで表した特徴点ベクトルを、数式2で定義できる。

【0032】

【数2】

xiベクトルのサイズは3n×lである。

【0033】

データセットの個数をN個とすると、セット全体に対して特徴点の平均を、下記の数式3で表すことができる。

【0034】

【数3】

【0035】

同様に、

ベクトルのサイズは3n×lである。

【0036】

平均モデル生成部202は、数式3を計算すると平均的な特徴点である

を得て、これに基づいたモデルを生成することで、そのモデルが平均的な臓器モデルになりうる。ASMアルゴリズムは、平均的なモデルを生成するだけでなく、更に平均的なモデルを、複数のパラメータの調節だけで形態を変形させることができる。従って、平均モデル生成部202は、単純に平均的なモデルを計算するだけでなく、複数のパラメータを適用できるように数式を計算する。以下、パラメータを適用する数式を説明する。

【0037】

下記の数式4によって特徴点の平均と各データとの差を表すことができる。数式4で、下添字iは、i番目の映像を意味する。従って、数式4は、各映像における特徴点の全体映像の平均との差を意味する。

【0038】

【数4】

【0039】

各データの差を利用して数式5により、3つの変数x,y,zに対する共分散行列を定義できる。共分散行列を求める理由は、ASMアルゴリズムを適用するための複数のパラメータに対するアイゲンベクトルを求めるためである(詳細な内容は、上記論文に記載されている)。

【0040】

【数5】

【0041】

共分散行列Sの単位アイゲンベクトルをpkとすると、ベクトルpkが意味するものは、ASMアルゴリズムにより生成されたモデルが変化する態様である。例えば、ベクトルp1と乗算されたパラメータb1を

で変形させると、左右への長さが変わるか、又はベクトルp2と乗算されたパラメータb2を

で変形させると、上下への長さが変わることをいう。従って、この単位アイゲンベクトルpk(サイズ3n×l)を、下記のように数式6により求める。

【0042】

【数6】

(λkは、アイゲン値(eigen−value)を意味する)

【0043】

それにより、最終的に変形を適用した特徴点ベクトルxを、特徴点の平均ベクトルである

を利用して計算すると、

【0044】

【数7】

ここでp=(p1,p2,…pt)(各pkのサイズ3n×l、pのサイズ3n×t)は、最初のt個のアイゲンベクトルをいい、b=(b1,b2,…bt)T(サイズt×l)は、各アイゲンベクトルの比重(weight)を意味する。

【0045】

平均モデル生成部202は、上記過程の数式の計算を通じて、平均的なモデルの形態を意味する

(サイズ3n×l)と、3次元ASMアルゴリズムを利用して変形を適用するためのp=(p1,p2,…pt)(サイズ3n×t)ベクトルと、を計算できる。

【0046】

個人化モデル生成部203は、平均モデル生成部202から平均的な臓器モデル(

)とp=(p1,p2,…pt)(サイズ3n×t)ベクトルと、を入力し、3次元ASMアルゴリズムのパラメータ処理により個人化モデルを生成する。患者個人の臓器形状も同様に形態やサイズなどがそれぞれ異なるので、平均的な臓器モデルをそのまま使用すると、正確性が落ちる。その理由は、個人によって平均形態より左右が長いか、上下が長いか、又は左側がより厚いか、右側がより下方に下がっているなどの特徴があるためである。また個人の臓器に病変がある場合、病変の形態及び位置を正確に把握するために、個人化モデル生成部203は、病変の位置をモデルに含ませる。従って、個人化モデル生成部203は、映像撮影装置又は記録媒体から患者個人の外部医療映像を入力して、個人臓器形態、サイズ、位置情報を分析し、病変があると、病変の位置、サイズ、形態情報を分析する。以下、この過程を詳細に説明する。

【0047】

個人化モデル生成部203は、CT或いはMR映像のように臓器の形状を明確に把握できる映像に基づいて、患者個人のASMアルゴリズムのアイゲンベクトルの比重値(ベクトルb)を決定する。従って、先ず患者個人の外部医療映像を入力して臓器境界及び内部構造の位置座標情報を把握する。この際は、平均モデル生成部202が外部医療映像を分析する過程のように、図3の過程で把握する。更に上記アルゴリズムを初めて適用する際、特徴点を把握した方法と同じ過程で特徴点座標情報を把握すると、患者個人化した特徴点集合であるベクトルx(サイズ3n×l)の値を得ることができる。上記ベクトルに基づいて臓器モデルを生成したものが個人化モデルになる。数式7の逆関数及び単位アイゲンベクトルの性質(

)を活用すると、下記の数式8を得ることができる。数式8によって値を決定する。

【0048】

【数8】

【0049】

一方、平均モデル生成部202より決定されたベクトル情報

は、ストレージ207に対象臓器に対する平均的なモデルとして保存して、データベース化して反復的に使われる。また、個人化モデル生成部202に入力された患者個人の外部医療映像は、次の患者の診療時にデータベースに保存された平均的なモデルを決定する際に追加する学習過程を持つ。

【0050】

映像整合部204は、個人化モデル生成部203からベクトル

情報を受けると、これを所定の周期の間の患者の医療映像と整合させる。超音波映像で臓器の位置に、ASMアルゴリズムを利用したモデルを重ねて出力するという意味であり、より正確には、映像でASMアルゴリズムにより形成されたモデルの座標情報に該当するピクセル或いはボクセル値を、所定の輝度に置換又は重畳させるという意味である。置換すると、元来の超音波映像から臓器部分は除去されて個人化モデルのみを出力するが、重畳させると、元来の超音波映像と個人化モデルとが重なった映像が出力される。重なった映像は、色を異ならせると肉眼で区分しやすい。例えば、白黒超音波映像に個人化モデルを青色で重畳させると、グラフィック的な形態を肉眼で容易に区別できる。

【0051】

医療映像は、望ましくは、リアルタイム映像を撮影できる映像であり、例えば、超音波映像がある。医療映像は、2次元或いは3次元映像である。所定の周期は、望ましくは1呼吸周期になる。その理由は、身体の呼吸周期の間に臓器の変化も一定の周期を持つためである。例えば、患者の1呼吸周期を5秒とした場合、超音波映像を1秒当たり20フレーム生成すると、100フレームの映像が生成される。

【0052】

映像整合部204で映像を整合する過程は、2段階に大別できる。所定の周期の間に入力される超音波映像で、呼吸による臓器の変化を3次元臓器モデルに反映させる段階と、変形が反映された3次元臓器モデルをスケール調整、軸回転及び軸移動して超音波映像における対象臓器と整列させる段階と、である。

【0053】

映像整合部204が、呼吸による臓器の変化を3次元臓器モデルに反映させる段階は下記の通りである。医療映像と整合する前に超音波映像の場合を例として挙げると、超音波映像の各フレーム別に臓器の位置及び変化を把握して、ASMアルゴリズムのパラメータの比重値であるベクトルbの値を調整する。この時に決定されるベクトルbの値は、平均モデル生成部202で決定されたベクトルbの値とあまり差がない。その理由は、映像整合部204は、患者の呼吸による変化のみ反映されるが、呼吸による臓器の形状変化は、他の個人との変化に比べて小さいためである。従って、ベクトルbの値を決定する際に、平均モデル生成部202で決定されたベクトルbの値に基づいて、所定の制限された範囲内の変形のみを加える。更に、前フレームのベクトルbは、次のフレームのベクトルbの決定に反映できる。その理由は、呼吸過程での臓器の変化は連続的であるため、短いフレーム間の周期の間に大きい変化がないためである。ベクトルbの値を決定すると、3次元ASMアルゴリズムの演算により、各超音波映像に臓器の変形を反映した個人化モデルをフレーム別に生成できる。

【0054】

図4は、映像整合部204が各映像別に臓器の変形を反映した個人化モデルを、回転、スケール調整、平行移動を通じて超音波映像における臓器の位置と一致させる過程のフローチャートである。詳細には、各フレーム別にアイゲンベクトルの比重値であるベクトルbが定められた場合に、各フレーム別に一対一アフィン整合を行うフローチャートである。フレームの個数をNとし、nをフレーム番号とすると、n=1からn=Nになるまで一対一整合を行う。超音波映像における特徴点集合とモデルの特徴点集合とを使用して、各フレーム別にICP(Iterative Closest Point)アルゴリズムを利用してアフィン変換関数Taffineを獲得し、これを利用して3次元身体臓器モデル映像を変換する。ICPアルゴリズムとは、複数の映像内の対象体を整列させるために、一つの映像を基準に残りの映像を回転、平行移動、スケール調整させるアルゴリズムである。ICPアルゴリズムは、“Iterative point matching for registration of free−form curves and surfaces”(Zhengyou Zhang著)に詳細な説明がある。

【0055】

図5は、2次元映像でアフィン変換関数を獲得する方法を簡略に示したものである。501は、変換を適用する前の状態であり、502は、変換を適用した後の状態である。変換の適用時には回転、平行移動、スケール調整をしなければならないが、アフィン変換が1:1点対応ということを利用すると、下記の数式9によって最初の座標と最終の座標とを獲得することで、直ちに行列Taffineの係数を決定できる。

【0056】

【数9】

【0057】

数式10は、2次元ではない3次元以上で獲得したアフィン変換関数(Taffine)を各フレーム別に適用させる式である。

【数10】

【0058】

nは、n番目のフレームを意味し、(1≦n≦N)の整数である。

は、映像整合部204で比重値であるベクトルbを変化させた特徴点ベクトルを意味する。形成された

は、各フレーム別に変形を反映した臓器境界及び内部構造の位置座標情報があるが、これを超音波映像と整合させる際に、超音波映像で位置座標に該当するボクセル値を所定の輝度値に置換或いは重畳させると、肉眼で臓器のグラフィック的な態様を確認できる。

【0059】

図6は、映像整合部204で映像を整合する過程を概略的に示すものである。図6は、一呼吸周期の間に入力された超音波映像に基づいて映像整合部204から入力された所定周期の間の医療映像と、身体臓器モデルとの整合映像を形成する過程を示した。入力された超音波映像は、図6で左側エッジに配置されており、入力された超音波映像で*は、特徴点を表示したものである。入力された超音波映像は、吸気から呼気に至るまで呼吸の様々な形態を反映することが望ましい。

【0060】

個人化モデル生成部203が生成した個人化モデルは、呼吸によってその形態が変形される。しかし、呼吸による変形は、個人間の多様性による変形よりは小さい。従って、呼吸による変形を反映する際に3次元ASMアルゴリズムパラメータの値を新たに求めることより、個人化モデル生成部203により決定されたパラメータ値で調整する方法がより迅速且つ容易である。変形を反映した臓器モデルの特徴点と、超音波映像の臓器における特徴点とを利用して、ICPアルゴリズムを通じてアフィン変換関数Taffineを適用する。アフィン変換を介することで、3次元臓器モデルのサイズ及び位置が、超音波映像内の臓器のサイズ及び位置に合うように変わる。変形されたモデルを超音波映像に合成することは、モデルの位置に該当する超音波映像のピクセル(又はボクセル)値を一定の値に置換又は重畳する方法により行うことができる。一方、整合された映像を超音波−モデル整合映像といい、ストレージ207に保存する。

【0061】

映像検索部205は、手術する過程での処理を行う。手術する過程を簡単に説明すると、リアルタイムで入力される超音波映像に臓器のグラフィック的形状が画面に出力され、手術者は、これを肉眼で確認しながら手術をする。この過程を具体的に説明すると、先ず、患者のリアルタイム医療映像を入力する。この時、医療映像は、望ましくは、映像整合部204から入力される映像と同じ映像である。従って、上記例と同様に、超音波映像を例として挙げると、リアルタイム超音波映像を入力して、映像整合部204に入力された所定周期の間の医療映像と比較して最も類似した映像を決定し、決定された映像と対応する超音波−モデル整合映像をストレージ207で検索して出力する。

【0062】

映像検索部205で超音波映像における類似した映像を比較する実施形態としては、横隔膜の位置を検出して映像を決定する方法がある。入力されるリアルタイム医療映像で横隔膜の位置がXならば、映像整合部204に入力された所定周期の複数の医療映像でそれぞれの横隔膜の位置とXとの差を計算して、その差の最も小さな映像を検索する方法である。図7は、横隔膜の絶対的な位置の上下移動グラフを示す。グラフを分析すると、呼吸の周期で位置が規則的に変わることが分かる。望ましくは、映像整合部204から入力される所定周期の医療映像と、映像検索部205から入力されるリアルタイム医療映像との撮影時に、プローブ11の位置及び患者の位置を固定させる。その理由は、プローブ11の位置或いは患者の位置が変わると、映像で臓器の相対的な位置が変わり、相対的な位置が変わると、映像を比較する時に正確且つ早く検索できないためである。

【0063】

映像検索部205で超音波映像における類似した映像を比較する更に他の実施形態としては、ピクセルの輝度差を利用して映像を決定する方法がある。最も類似した映像同士ではその輝度の差が最も少ないということを利用した方法である。具体的には、整合に使われた所定周期の医療映像(第1映像)のうち、リアルタイム医療映像の1フレームの映像(第2映像)と類似した映像を探す際、先ず第1映像のうちのいずれか一つの映像と第2映像の各ピクセル間の輝度差を計算して、全体輝度差に対する分散を求める。次いで、残りの第1映像と第2映像ともそれぞれ上記のような方法で分散を求めてその分散が最も小さな映像を決定すると、最も類似した映像を決定できる。

【0064】

一方、追加調整部206は、出力された映像を見てユーザがアフィン変換関数Taffine、3次元ASMアルゴリズムのパラメータを調整して最終出力結果を調整する。ユーザが出力映像を見ながら肉眼で正確な変換を行うことができる。

【0065】

図8は、3次元的な臓器モデル基盤の動的臓器と病変追跡方法の全体的なフローチャートを示すものである。802段階及び803段階は、既に処理されたデータをデータベース化する。802段階は、多様な個人に対して各個人の多様な呼吸周期に対するCT或いはMR映像を入力する。803段階は、入力された映像に基づいて3次元身体臓器モデルを生成する。その際、3次元ASMアルゴリズムを使用できるということは、上述した通りである。

【0066】

801段階は、患者個人のCT或いはMR映像を入力する。804段階は、入力された映像に基づいて803段階で生成された3次元身体臓器モデルを変形させる。個人化した3次元身体臓器モデルを生成する過程は準備過程であり、手術室外でも行われうる。805段階は、患者1呼吸周期の間の超音波映像(以下、第1超音波映像という)が入力され、第1超音波映像と個人化した身体臓器モデルとを整合する。整合された映像を超音波−モデル整合映像といい、一時的メモリに保存してもよいし、ストレージなどの記録媒体に保存してもよい。805段階は、手術室内の準備過程で行われうる。また805段階及び806段階の患者及びプローブの位置は固定されていることが望ましい。806段階で手術室でのリアルタイム段階として、リアルタイムで患者の超音波映像(第2超音波映像)が入力されると、超音波映像と最も類似した第1超音波映像が決定され、決定された第1超音波映像に対応する超音波−モデル整合映像を出力する。

【0067】

一方、上述した本発明の実施形態は、コンピュータで実行されるプログラムで作成でき、コンピュータ読み取り可能な記録媒体を利用してプログラムを作動させる汎用デジタルコンピュータで具現できる。また、上述した本発明の実施形態で使われたデータの構造は、コンピュータ読み取り可能な記録媒体に様々な手段により記録される。コンピュータ読み取り可能な記録媒体は、マグネチック記録媒体(例えば、ROM、フロッピー(登録商標)ディスク、ハードディスクなど)、光学的判読媒体(例えば、CD−ROM、DVDなど)などの記録媒体を含む。

【0068】

以上、図面を参照しながら本発明の実施形態について詳細に説明したが、本発明は、上述の実施形態に限定されるものではなく、本発明の技術的範囲から逸脱しない範囲内で多様に変更実施することが可能である。

【産業上の利用可能性】

【0069】

本発明は、3次元的モデルを利用した身体臓器の映像生成装置関連の技術分野に好適に用いられる。

【符号の説明】

【0070】

11 プローブ

10 映像検出装置

20 映像整合装置

30 映像表示装置

101 整合映像形成部

201 医療映像DB

202 平均モデル生成部

203 個人化モデル生成部

204 映像整合部

205 映像検索部

206 追加調整部

207 ストレージ

【特許請求の範囲】

【請求項1】

患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する段階と、

前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合させることで複数の整合映像を生成する段階と、

前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択して出力する段階と、を有することを特徴とする臓器映像生成方法。

【請求項2】

前記3次元モデルを生成する段階における前記3次元モデルの生成は、患者医療映像に基づいて患者の臓器形態を表す3次元モデルを生成することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項3】

前記整合映像を生成する段階は、

前記臓器の形態的変化に基づいて前記3次元モデルを変形する段階と、

前記3次元モデルの座標軸と前記複数の映像の座標軸とを一致させる段階と、を含むことを特徴とする請求項1に記載の臓器映像生成方法。

【請求項4】

前記整合映像を生成する段階は、前記複数の映像のピクセル/ボクセル値を一定輝度で重畳させて前記整合映像を生成することを特徴とする請求項3に記載の臓器映像生成方法。

【請求項5】

前記出力する段階は、前記複数の映像のうち、リアルタイム医療映像の映像と最も類似した映像に対応する整合映像を選択することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項6】

前記出力する段階は、前記複数の映像の横隔膜の位置と前記リアルタイム医療映像の横隔膜の位置との差を計算して、最も差の少ない映像に対応する整合映像を選択することを特徴とする請求項5に記載の臓器映像生成方法。

【請求項7】

前記3次元モデルを生成する段階は、

前記医療映像から臓器の境界及び内部構造の位置座標情報を抽出する段階と、

特徴点の座標を前記位置座標情報内で指定する段階と、

統計的な外観モデルを生成する段階と、を含むことを特徴とする請求項1に記載の臓器映像生成方法。

【請求項8】

前記3次元モデルを生成する段階は、前記統計的な外観モデルを患者臓器の形態的特性を反映したモデルに変形する段階を更に含むことを特徴とする請求項7に記載の臓器映像生成方法。

【請求項9】

前記3次元モデルを生成する段階は、患者の医療映像に基づいて患者臓器の形態的特性を反映することを特徴とする請求項8に記載の臓器映像生成方法。

【請求項10】

前記位置座標情報を抽出する段階は、前記医療映像で輝度値の変化が最大である地点を、臓器の境界及び内部構造の位置座標情報に決定することを特徴とする請求項7に記載の臓器映像生成方法。

【請求項11】

前記位置座標情報を抽出する段階は、前記医療映像でDTFT(Discrete Time Fourier Transform)の周波数の値が極大点である地点を、臓器の境界及び内部構造の位置座標情報に決定することを特徴とする請求項10に記載の臓器映像生成方法。

【請求項12】

前記位置座標情報を抽出する段階は、前記医療映像でユーザにより入力された座標に基づいて臓器の境界及び内部構造の位置座標情報を決定することを特徴とする請求項7に記載の臓器映像生成方法。

【請求項13】

前記複数の映像は、呼吸周期において一定間隔で形成された映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項14】

前記少なくとも一つの臓器を表す医療映像は、CT(Computed Tomography)方式を利用して撮影した映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項15】

前記少なくとも一つの臓器を表す医療映像は、MR(Magnetic Resonance)方式を利用して撮影した映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項16】

前記複数の映像及び前記患者のリアルタイム医療映像は、超音波映像であることを特徴とする請求項1又は2に記載の臓器映像生成方法。

【請求項17】

前記3次元モデルを生成する段階は、データベースに保存された既生成の3次元モデルを入力することで置換することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項18】

前記形態的特性は、病変の形態及び位置を更に含むことを特徴とする請求項8又は9に記載の臓器映像生成方法。

【請求項19】

患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する臓器モデル生成部と、

前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合した複数の映像を生成する映像整合部と、

前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択する映像検索部と、を備えることを特徴とする臓器映像生成装置。

【請求項20】

前記整合された映像をユーザの入力により更に調整できる追加調整部を更に備えることを特徴とする請求項19に記載の臓器映像生成装置。

【請求項21】

請求項1乃至18のいずれか1項に記載の方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体。

【請求項1】

患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する段階と、

前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合させることで複数の整合映像を生成する段階と、

前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択して出力する段階と、を有することを特徴とする臓器映像生成方法。

【請求項2】

前記3次元モデルを生成する段階における前記3次元モデルの生成は、患者医療映像に基づいて患者の臓器形態を表す3次元モデルを生成することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項3】

前記整合映像を生成する段階は、

前記臓器の形態的変化に基づいて前記3次元モデルを変形する段階と、

前記3次元モデルの座標軸と前記複数の映像の座標軸とを一致させる段階と、を含むことを特徴とする請求項1に記載の臓器映像生成方法。

【請求項4】

前記整合映像を生成する段階は、前記複数の映像のピクセル/ボクセル値を一定輝度で重畳させて前記整合映像を生成することを特徴とする請求項3に記載の臓器映像生成方法。

【請求項5】

前記出力する段階は、前記複数の映像のうち、リアルタイム医療映像の映像と最も類似した映像に対応する整合映像を選択することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項6】

前記出力する段階は、前記複数の映像の横隔膜の位置と前記リアルタイム医療映像の横隔膜の位置との差を計算して、最も差の少ない映像に対応する整合映像を選択することを特徴とする請求項5に記載の臓器映像生成方法。

【請求項7】

前記3次元モデルを生成する段階は、

前記医療映像から臓器の境界及び内部構造の位置座標情報を抽出する段階と、

特徴点の座標を前記位置座標情報内で指定する段階と、

統計的な外観モデルを生成する段階と、を含むことを特徴とする請求項1に記載の臓器映像生成方法。

【請求項8】

前記3次元モデルを生成する段階は、前記統計的な外観モデルを患者臓器の形態的特性を反映したモデルに変形する段階を更に含むことを特徴とする請求項7に記載の臓器映像生成方法。

【請求項9】

前記3次元モデルを生成する段階は、患者の医療映像に基づいて患者臓器の形態的特性を反映することを特徴とする請求項8に記載の臓器映像生成方法。

【請求項10】

前記位置座標情報を抽出する段階は、前記医療映像で輝度値の変化が最大である地点を、臓器の境界及び内部構造の位置座標情報に決定することを特徴とする請求項7に記載の臓器映像生成方法。

【請求項11】

前記位置座標情報を抽出する段階は、前記医療映像でDTFT(Discrete Time Fourier Transform)の周波数の値が極大点である地点を、臓器の境界及び内部構造の位置座標情報に決定することを特徴とする請求項10に記載の臓器映像生成方法。

【請求項12】

前記位置座標情報を抽出する段階は、前記医療映像でユーザにより入力された座標に基づいて臓器の境界及び内部構造の位置座標情報を決定することを特徴とする請求項7に記載の臓器映像生成方法。

【請求項13】

前記複数の映像は、呼吸周期において一定間隔で形成された映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項14】

前記少なくとも一つの臓器を表す医療映像は、CT(Computed Tomography)方式を利用して撮影した映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項15】

前記少なくとも一つの臓器を表す医療映像は、MR(Magnetic Resonance)方式を利用して撮影した映像であることを特徴とする請求項1に記載の臓器映像生成方法。

【請求項16】

前記複数の映像及び前記患者のリアルタイム医療映像は、超音波映像であることを特徴とする請求項1又は2に記載の臓器映像生成方法。

【請求項17】

前記3次元モデルを生成する段階は、データベースに保存された既生成の3次元モデルを入力することで置換することを特徴とする請求項1に記載の臓器映像生成方法。

【請求項18】

前記形態的特性は、病変の形態及び位置を更に含むことを特徴とする請求項8又は9に記載の臓器映像生成方法。

【請求項19】

患者の少なくとも一つの臓器を表す医療映像に基づいて該少なくとも一つの臓器の3次元モデルを生成する臓器モデル生成部と、

前記患者の身体活動による前記少なくとも一つの臓器の形態的変化を表す複数の映像と前記臓器の3次元モデルとを整合した複数の映像を生成する映像整合部と、

前記患者の現在身体状態に基づいて前記複数の整合映像のうちのいずれか一つを選択する映像検索部と、を備えることを特徴とする臓器映像生成装置。

【請求項20】

前記整合された映像をユーザの入力により更に調整できる追加調整部を更に備えることを特徴とする請求項19に記載の臓器映像生成装置。

【請求項21】

請求項1乃至18のいずれか1項に記載の方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【公開番号】特開2012−205899(P2012−205899A)

【公開日】平成24年10月25日(2012.10.25)

【国際特許分類】

【出願番号】特願2012−73631(P2012−73631)

【出願日】平成24年3月28日(2012.3.28)

【出願人】(390019839)三星電子株式会社 (8,520)

【氏名又は名称原語表記】Samsung Electronics Co.,Ltd.

【住所又は居所原語表記】129,Samsung−ro,Yeongtong−gu,Suwon−si,Gyeonggi−do,Republic of Korea

【Fターム(参考)】

【公開日】平成24年10月25日(2012.10.25)

【国際特許分類】

【出願日】平成24年3月28日(2012.3.28)

【出願人】(390019839)三星電子株式会社 (8,520)

【氏名又は名称原語表記】Samsung Electronics Co.,Ltd.

【住所又は居所原語表記】129,Samsung−ro,Yeongtong−gu,Suwon−si,Gyeonggi−do,Republic of Korea

【Fターム(参考)】

[ Back to top ]