国際特許分類[G06N3/08]の内容

物理学 (1,541,580) | 計算;計数 (381,677) | 特定の計算モデルに基づくコンピュータ・システム (1,616) | 生物学的モデルに基づくコンピュータ・システム (1,008) | ニューラル・ネットワーク・モデルを用いるもの (314) | 学習方法 (142)

国際特許分類[G06N3/08]に分類される特許

41 - 50 / 142

次元削減方法、パターン認識用辞書生成装置、及びパターン認識装置

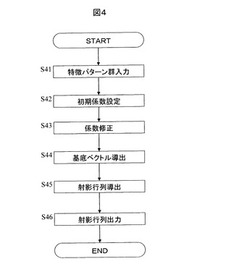

【課題】高次元特徴空間での識別処理による識別率の低下、計算量の増大、使用メモリの増大を解決するために、高精度、高速、省メモリを目的とした効率的な特徴空間の次元削減を行う。

【解決手段】辞書生成用特徴パターン群を用いて、多項式ニューラルネットワークにより二次関数を学習し、二次関数の主要成分を保存する部分空間を選択することにより、特徴空間の次元を削減する。初期係数設定ステップ42、係数修正ステップ43では、二次関数を識別関数として用いた場合の損失関数の値が小さくなるように、勾配降下法又は確率的勾配降下法により係数を修正する。基底ベクトル導出ステップ44は、二次関数の二次の項の二次形式の行列の固有ベクトルと、一次の項の係数ベクトルを導出する。次に、射影行列導出ステップ45は、固有ベクトルと係数ベクトルとの中から主成分となる1つ以上のベクトルを選択し、選択されたベクトルによって生成される部分空間を新たな特徴空間として生成する。

(もっと読む)

学習装置、学習方法、およびプログラム

【課題】規模拡張性があり、かつ、汎化特性を有するパターン学習モデルを得ることができるようにする。

【解決手段】学習モジュール101ないし10Nは、入力データを用いて、パターン学習モデルの複数のモデルパラメータを更新する更新学習を行う。モデルパラメータ共有部20は、学習モジュール101ないし10Nの各学習モジュールが更新したモデルパラメータを、学習モジュール101ないし10Nに共有させる。パターン分類部111は、更新学習後のパターン学習モデルのモデルパラメータを、学習モジュール101ないし10Nそれぞれから取得し、モデルパラメータ距離に基づく分類を行う。本発明は、例えば、時系列パターンの学習等に適用できる。

(もっと読む)

学習装置、学習方法、およびプログラム

【課題】規模拡張性があり、かつ、汎化特性を有するパターン学習モデルを得ることができるようにする。

【解決手段】学習モジュール101ないし10Nは、入力データを用いて、パターン学習モデルの複数のモデルパラメータを更新する更新学習を行う。モデルパラメータ共有部20は、学習モジュール101ないし10Nに、モデルパラメータを共有させる。共有強度制御部112は、学習モジュール101ないし10Nそれぞれについて、学習モジュール10jから学習モジュール10iへの影響の強さを表す共有強度βijを、更新学習により複数のモデルパラメータを更新したとき学習モジュール10iの学習誤差Eiを最小化するように更新する。本発明は、例えば、時系列パターンの学習等に適用できる。

(もっと読む)

学習装置、学習方法、およびプログラム

【課題】規模拡張性があり、かつ、汎化特性を有するパターン学習モデルを得ることができるようにする。

【解決手段】学習モジュール101ないし10Nは、入力データを用いて、パターン学習モデルの複数のモデルパラメータを更新する更新学習を行う。モデルパラメータ共有部20は、学習モジュール101ないし10Nに、モデルパラメータを共有させる。新たな学習データが入力データとしてパターン学習部111に供給された場合、モジュール作成部121は、その新たな学習データに対応する新たな学習モジュールを作成する。そして、新たな学習モジュールを含む全ての学習モジュールで更新学習後、モジュール統合部123は、類似性評価部122による学習モジュール間の類似性に基づいて、学習モジュールの統合の可否を判定し、学習モジュールの統合を行う。本発明は、例えば、時系列パターンの学習等に適用できる。

(もっと読む)

最大射影を規定する重みを含む人工ニューロン

【課題】複数の入力と、それぞれの1つが該複数の入力のそれぞれの1つと関連付けされた複数のデンドライトとを含む人工ニューロンを提供する。

【解決手段】人工ニューロンは、入力部とそれぞれの1つが入力部のそれぞれの1つに関連付けされたデンドライト700とを含む。それぞれのデンドライトはそれぞれの重みのべき級数730を含む。べき級数の所定の累乗内の重みは最大射影を示す。それぞれの累乗は少なくとも1つのスイッチも含み、射影内のホールを識別する。最大射影を提供することによって、線形のスケーリングが最大射影に提供され、また準線形のスケーリングが人工ニューロンに提供されると同時に、関連付けの損失のない圧縮が可能にされる。このため、ヘテロ連想及び/又は自己連想の呼び出しが、入力の関数として幾何学的スケーリングを必要とせずに、多数の入力に対して提供される。

(もっと読む)

前の及び次の連合を表現する重みとカウントのべき級数を含む人工ニューロン

【課題】膨大な入力変数等のスケーリング問題を解決するための人工ニューロンを提供する。

【解決手段】人工ニューロン700は、入力及び樹状突起を含み、樹状突起のそれぞれは、入力のそれぞれと連合(関連付け)される。各樹状突起は、重みのべき級数を含み、べき級数の各重みは、連合されたべきに対する連合されたカウントを含む。重みのべき級数は、好ましくは、重みの2を底とするべき級数であり、この2を底とするべき級数の各重みは、ビット位置を表す連合されたカウントを含む。連合されたべきに対するカウントは、統計的カウントである。より具体的には、樹状突起は、シーケンシャルに順序付けられ、重みのべき級数は、一対の重みの第1及び第2のべき級数を含む。第1のべき級数の各重みは、先行の樹状突起の連合の関数である第1のカウントを含み、且つ、第2のべき級数の各重みは、次の樹状突起の連合の関数である第2のカウントを含む。

(もっと読む)

学習装置、学習方法、及びプログラム

【課題】時系列データの時系列パターンを適切な要素パターンに分けた学習を、容易に行う。

【解決手段】データ抽出部2は、ウインドウの位置をずらすことで、時系列データから、例えば、N個のモデル学習用データを抽出し、i番目の各モデル学習用データを、学習モジュール10iに分配する。学習モジュール101ないし10Nは、モデル学習用データを用いて、パターン学習モデルを定義するモデルパラメータを更新する更新学習を行う。モデルパラメータ共有部20は、学習モジュール101ないし10Nに、モデルパラメータを共有させる。本発明は、例えば、時系列パターンの学習等に適用できる。

(もっと読む)

データ処理装置、データ処理方法、及びプログラム

【課題】ロボット等のエージェントが、汎化が可能な範囲で目標をたて、その目標を達成する行動を、迅速にとる。

【解決手段】生成装置20では、時系列データ予測部21が、時系列データを予測するための予測モデルとしてのRNNを用い、時系列データの入力に対して、時系列データの予測値を求める。さらに、目標決定部22が、時系列データの予測値に基づき、時系列データの目標値を決定し、誤差計算部23が、予測値の、目標値に対する誤差を計算する。そして、時系列データ探索部24が、予測値の誤差を減少させる、RNNへの時系列データの入力である誤差減少データを探索する。本発明は、例えば、ロボット等のエージェントを制御する場合に適用できる。

(もっと読む)

外れ値検出方法、外れ値検出装置およびプログラム

【課題】少ない計算量で確実に外れ値を検出する。

【解決手段】外れ値検出装置は、学習データを記憶する記憶部1と、μ−ε−SVRにより学習データから各データのラグランジュ乗数を求めるSVR計算部2と、ラグランジュ乗数が最大となるデータを外れ値の候補とする外れ値候補選択部3と、ラグランジュ乗数の総和が上限値より小さいかどうかを判定するラグランジュ乗数総和上限判定部4と、ラグランジュ乗数の総和が上限値と等しい場合に、外れ値候補選択部3で選択されたデータを外れ値として学習データから除去する外れ値除去部5と、ラグランジュ乗数の総和が上限値より小さくなるまで、外れ値を除去した後の学習データについて処理を繰り返し実行させる処理制御部6とを有する。

(もっと読む)

情報処理装置、情報処理方法、およびプログラム

【課題】より多くの時系列パターンを学習、予測できるようにする。

【解決手段】変換部12が、ロボット2から取得されたモーター81に関する8次元のデータmtと視覚センサー82に関する2次元のデータStを、グループ毎に、1峰性の確率分布のより高次元のモーター81に関する64次元のデータXi(t)と視覚センサー82に関する36次元のデータXi(t)に変換する。リカレントニューラルネットワーク11が、高次元のデータXi(t)から重み付け係数に基づいて、グループ毎に合計が1になるように、モーター81に関する64次元の予測値Yi(t)と視覚センサー82に関する36次元の予測値Yi(t)を演算する。

(もっと読む)

41 - 50 / 142

[ Back to top ]