映像編集システム、映像処理装置、映像編集装置、映像処理方法、映像編集方法、プログラムおよびデータ構造

【課題】映像データもしくはその映像データに同期する他の映像データについて、その特徴量を映像データに同期して保持するメタデータを生成し、または、そのメタデータに基づいて映像データを編集する。

【解決手段】第1のビデオデータ101に同期する第2のビデオデータ102から映像処理装置110によってメタデータ103が生成される。メタデータ103は、第1のビデオデータ101に同期し、第2のビデオデータ102の特徴量を時間軸で管理しながら保持する。メタデータ103において抽出条件に合致する位置が映像編集装置120の位置探索部122によって探索され、エディットリスト104が生成される。エディットリスト104に従って、第1のビデオデータ101から映像抽出部123によって映像が抽出され、編集ビデオデータ105が生成される。

【解決手段】第1のビデオデータ101に同期する第2のビデオデータ102から映像処理装置110によってメタデータ103が生成される。メタデータ103は、第1のビデオデータ101に同期し、第2のビデオデータ102の特徴量を時間軸で管理しながら保持する。メタデータ103において抽出条件に合致する位置が映像編集装置120の位置探索部122によって探索され、エディットリスト104が生成される。エディットリスト104に従って、第1のビデオデータ101から映像抽出部123によって映像が抽出され、編集ビデオデータ105が生成される。

【発明の詳細な説明】

【技術分野】

【0001】

本発明は、映像編集システムに関し、特に映像データにおける特徴量を示すメタデータを生成する映像編集システム、映像処理装置、または、そのメタデータに基づいて映像データを編集する映像編集装置、これらにおける処理方法ならびに当該方法をコンピュータに実行させるプログラムおよびこれらに用いられるデータ構造に関する。

【背景技術】

【0002】

記録再生装置における記録形式の一つとして、QuickTimeファイルフォーマットが知られている。このQuickTimeファイルフォーマットは、マルチメディアデータを扱うためのファイルフォーマットであり、映像データ(ビデオデータおよびオーディオデータ)の実データをメディアデータアトム(ムービーデータともいう。)に保持して、その管理情報をムービーアトム(ムービーリソースともいう。)に保持する。これにより、実データに直接手を加えることなく、映像データを"非破壊的に"編集できるようになっている。このQuickTimeファイルフォーマットをベースとしたファイルフォーマットには、ISOベースメディア(ISO Base Media)ファイルフォーマット、そのアプリケーションフォーマットであるMPEG4(MP4)ファイルフォーマット、MJ2(Motion JPEG2000)ファイルフォーマット、AVC(Advanced Video Coding:MPEG4-part10)ファイルフォーマットなどがある。

【0003】

このような実データ格納部と管理情報格納部に分かれた形式のファイルフォーマットにおいては、オリジナルデータを外部から参照して、再生上の時間軸管理を行うエディットアトムと呼ばれるデータ構造により編集を行う方法が知られている。例えば、そのようなエディットアトムを用いて、記録中の映像に対して非破壊的にマークを付与する映像記録装置が提案されている(例えば、特許文献1参照。)。

【特許文献1】特開2005−303943号公報(図5)

【発明の開示】

【発明が解決しようとする課題】

【0004】

しかしながら、エディットアトムにより構成されるムービーファイルでは、最終的な編集結果が1つだけ保存されるに留まり、他の条件で編集を行うためには最初から処理をやり直さなければならない。例えば、映像データもしくはその映像データに同期する他の映像データにおける何らかの特徴量を解析して、その解析結果に基づいて編集を行う場合、編集条件を変えるたびに特徴量の解析からやり直すことになり、処理効率上の問題がある。

【0005】

そこで、本発明は、映像データもしくはその映像データに同期する他の映像データについて、その特徴量を映像データに同期して保持するメタデータを生成し、または、そのメタデータに基づいて映像データを編集することを目的とする。

【課題を解決するための手段】

【0006】

本発明は、上記課題を解決するためになされたものであり、その第1の側面は、時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、上記第2の映像データにおける特徴量を解析する映像解析手段と、上記第1の映像データと同期して上記特徴量を保持するメタデータを生成するメタデータ生成手段とを具備することを特徴とする映像処理装置である。これにより、第1の映像データに同期した第2の映像データの特徴量を、第1の映像データに同期するメタデータに保持させるという作用をもたらす。

【0007】

また、この第1の側面において、上記特徴量は、上記第2の映像データに含まれる顔の表情であってもよい。顔の表情として、笑い、驚き、怒り、眠いといった種別を表現することができる。

【0008】

また、この第1の側面において、上記第1の映像データを撮像する第1の撮像手段をさらに具備し、上記映像取得手段は、上記第1の映像データの撮像と同時に上記第2の映像データを撮像する第2の撮像手段を含んでもよい。これにより、撮像されている第1の映像データに関する映像を第2の映像データとして撮像させるという作用をもたらす。

【0009】

また、この第1の側面において、上記第1の映像データを再生する再生手段をさらに具備し、上記映像取得手段は、上記再生手段による上記第1の映像データの再生と同時に上記第2の映像データを撮像する撮像手段を含んでもよい。これにより、再生されている第1の映像データに関する映像を第2の映像データとして撮像させるという作用をもたらす。

【0010】

また、この第1の側面において、上記第1の映像データを再生する再生手段をさらに具備し、上記映像取得手段は、上記再生手段により再生された上記第1の映像データを上記第2の映像データとして入力する映像入力手段を含んでもよい。これにより、再生されている第1の映像データをそのまま第2の映像データとして入力させるという作用をもたらす。

【0011】

なお、この第1の側面において、上記第1の映像データおよび上記メタデータは、QuickTimeフォーマットにおけるメディアデータアトムの形式で記録されてもよい。

【0012】

また、本発明の第2の側面は、時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得した後に所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出する映像抽出手段とを具備することを特徴とする映像編集装置である。これにより、メタデータに含まれる特徴量が所定の条件に合致する時系列上の位置について、第1の映像データの対応する部分を抽出して、非破壊的に編集させるという作用をもたらす。

【0013】

また、この第2の側面において、上記位置探索手段は、上記メタデータを管理する管理情報を取得して、上記管理情報が上記メタデータに上記特徴量は保持されない旨を示している場合には上記メタデータを取得しないようにしてもよい。これにより、無意味なメタデータへのアクセスを回避させるという作用をもたらす。

【0014】

また、本発明の第3の側面は、時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、上記第2の映像データにおける特徴量を解析する映像解析手段と、上記第1の映像データと同期して上記特徴量を保持するメタデータを生成するメタデータ生成手段と、上記メタデータから所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出する映像抽出手段とを具備することを特徴とする映像編集システムである。これにより、第2の映像データの特徴量を保持するメタデータを中間状態として、第1の映像データを非破壊的に編集させるという作用をもたらす。

【0015】

また、本発明の第4の側面は、時系列に管理される第1の映像データと、上記第1の映像データに同期した第2の映像データにおける特徴量を上記第1の映像データと同期して保持するメタデータとを具備するデータ構造であって、コンピュータが、上記メタデータを取得して、上記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成して、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出することを特徴とするデータ構造である。これにより、第1の映像データの編集のための中間状態としてメタデータを保持させるという作用をもたらす。

【発明の効果】

【0016】

本発明によれば、映像データもしくはその映像データに同期する他の映像データについて、その特徴量を映像データに同期して保持するメタデータを生成し、または、そのメタデータに基づいて映像データを編集することができるという優れた効果を奏し得る。

【発明を実施するための最良の形態】

【0017】

次に本発明の実施の形態について図面を参照して詳細に説明する。

【0018】

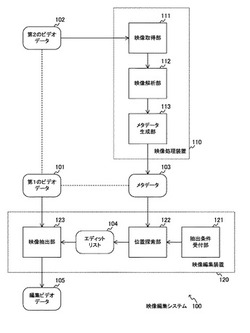

図1は、本発明の実施の形態における映像編集システム100の一構成例を示す図である。この映像編集システム100は、メタデータ103に基づいて第1のビデオデータ101を編集した編集ビデオデータ105を出力する映像編集装置120と、第2のビデオデータ102の特徴量を解析してメタデータ103を出力する映像処理装置110とを備えている。

【0019】

第1のビデオデータ101および第2のビデオデータ102は、時系列に管理される映像データであり、動画像データに加えて音声データを含んでもよい。第1のビデオデータ101は、映像編集装置120における編集対象となる映像データである。第2のビデオデータ102は、第1のビデオデータ101に同期しており、第1のビデオデータ101の撮像または再生と同時に撮像され得る。また、第1のビデオデータ101および第2のビデオデータ102は、同一の内容であってもよい。

【0020】

メタデータ103は、第1のビデオデータ101に同期しており、第2のビデオデータ102の特徴量を時間軸で管理しながら保持するものである。特徴量としては、後述のように、第2のビデオデータ102に含まれる顔の表情が想定される。

【0021】

映像処理装置110は、映像取得部111と、映像解析部112と、メタデータ生成部113とを備えている。また、映像編集装置120は、抽出条件受付部121と、位置探索部122と、映像抽出部123とを備えている。

【0022】

映像取得部111は、第2のビデオデータ102を取得するものである。この映像取得部111は、映像を光学レンズにより撮像するビデオカメラであってもよく、また、電子信号を入力する入力端子などであってもよい。

【0023】

映像解析部112は、映像取得部111によって取得された第2のビデオデータ102における特徴量を解析するものである。映像解析部112は、例えば、特徴量として第2のビデオデータ102に含まれる顔の画像を抽出して、その顔の表情を判断する。顔の表情を判断する処理手順は公知の技術を使用することができる。例えば、顔画像中の外眼角点を結ぶ線分と口角点を結ぶ線分との比から笑顔の判断をする技術(例えば、特開2005−266984)や、顔の構成要素毎に基準画像と評価ポイントを設けて平均値を算出して被撮影者の表情を判断する技術(例えば、特開2004−46591)等が提案されている。

【0024】

メタデータ生成部113は、映像解析部112によって解析された特徴量を保持するメタデータ103を生成するものである。この生成されたメタデータ103は、第1のビデオデータ101の各時刻に対応して、第2のビデオデータ102の特徴量を保持している。これにより、例えば、第1のビデオデータ101の各時刻において、第2のビデオデータ102にどのような顔の表情が含まれているかを、編集のための中間状態として保持することができる。

【0025】

抽出条件受付部121は、抽出条件の入力を受け付けるものである。例えば、顔の表情を条件とするのであれば、笑顔を抽出するのか、または、驚いた顔を抽出するのか、といった条件を受け付ける。これらの条件は論理積(AND)や論理和(OR)などにより組み合わせた条件にすることができる。

【0026】

位置探索部122は、抽出条件受付部121によって受け付けられた抽出条件によりメタデータ103を探索するものである。これにより、抽出条件に合致する時系列上の位置が得られ、エディットリスト104として保持される。

【0027】

映像抽出部123は、エディットリスト104に基づいて、第1のビデオデータ101から抽出条件に合致する時系列上の位置に対応する部分を抽出して、編集ビデオデータ105に出力するものである。

【0028】

図2は、本発明の実施の形態における映像処理装置110の第1の構成例を示す図である。この第1の構成例では、記録部210に、撮像部211と、映像加工部212と、映像圧縮部213と、ファイル生成部214と、書込み部215と、撮像部216と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。

【0029】

撮像部211は、被写体を第1のビデオデータ101として撮像するものである。映像加工部212は、撮像部211によって撮像された映像に対してエフェクト処理などの加工を施すものである。映像圧縮部213は、映像加工部212によって加工された映像を圧縮するものである。

【0030】

撮像部216は、被写体を撮像している撮影者(もしくは、被写体の様子を鑑賞している鑑賞者)の顔を第2のビデオデータ102として撮像するものである。映像解析部217は、撮像部216によって撮像された映像を解析するものである。すなわち、映像解析部217は、映像に含まれる撮影者の顔の表情を解析する。この解析結果は、メタデータ103となる。

【0031】

ファイル生成部214は、映像圧縮部213によって圧縮された映像(第1のビデオデータ101)および映像解析部217によって解析された撮影者の顔の表情の解析結果(メタデータ103)を含むファイルをそれぞれ所定のファイル形式として生成するものである。

【0032】

書込み部215は、ファイル生成部214によって生成されたファイルを記録媒体219に書き込むものである。記録媒体219としては、ハードディスクなどのディスク状記録媒体やメモリスティックなどの半導体記録媒体を想定することができる。

【0033】

記録制御部218は、記録部210における記録媒体219への記録動作を制御するものである。

【0034】

この第1の構成例では、撮像部211によって被写体を第1のビデオデータ101として撮像しながら、同時に撮像部216によって撮影者の顔の表情を第2のビデオデータ102として撮像し、その表情を解析してメタデータ103を生成している。

【0035】

図3は、本発明の実施の形態における映像処理装置110の第1の構成例による使用態様を示す図である。図3(a)では、ビデオカメラ装置520の前面のカメラ521によって被写体501が撮像されているのと同時に、ビデオカメラ装置520の操作面のカメラ522によって撮影者502の顔が撮像されている。これにより、ビデオカメラ装置520の内部で撮影者502の顔の表情を解析することによって、メタデータを生成することができる。

【0036】

また、ビデオカメラ装置520はネットワーク510に接続されてもよい。このネットワーク510によって、ビデオカメラ装置520の前面のカメラ521によって撮像された被写体501の映像を、図3(b)のテレビ装置530や図3(c)のコンピュータ装置540に配信することができる。

【0037】

図3(b)のテレビ装置530にはビデオカメラ装置531が接続され、鑑賞者503の顔が撮像されている。これにより、テレビ装置530またはビデオカメラ装置531の内部で鑑賞者503の顔の表情を解析することによって、メタデータを生成することができる。

【0038】

図3(c)のコンピュータ装置540の前面にはカメラ541が設けられ、鑑賞者504の顔が撮像されている。これにより、コンピュータ装置540の内部で鑑賞者504の顔の表情を解析することによって、メタデータを生成することができる。

【0039】

このように、映像処理装置110の第1の構成例では、第1のビデオデータ101の撮像と同時に第2のビデオデータ102を撮像して、この第2のビデオデータ102からメタデータ103を生成する。第2のビデオデータ102に含まれる顔の表情には、第1のビデオデータ101の映像に対する何らかの反応が反映されているものと考えられるため、その特徴量をメタデータ103に中間状態として保存しておいて、第1のビデオデータ101の編集に利用しようとするものである。

【0040】

図4は、本発明の実施の形態における映像処理装置110の第2の構成例を示す図である。この第2の構成例では、記録部210に、撮像部211と、ファイル生成部214と、書込み部215と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。また、再生部220に、表示部221と、映像加工部222と、映像伸張部223と、ファイル復号部224と、読出し部225と、記録媒体229とが備えられている。

【0041】

記録媒体229は、第1のビデオデータ101を所定のファイル形式により記録するものである。読出し部225は、第1のビデオデータ101を含むファイルを記録媒体229から読み出すものである。ファイル復号部224は、読出し部225によって読み出されたファイルを復号するものである。映像伸張部223は、ファイル復号部224によって復号されたファイル内の圧縮された映像を伸張するものである。映像加工部222は、映像伸張部223によって伸張された映像に対してエフェクト処理などの加工を施すものである。

【0042】

表示部221は、映像加工部222から出力された映像を表示するものである。これにより、記録媒体229に記録されていた第1のビデオデータ101が表示部221に再生表示される。

【0043】

撮像部211は、被写体を第2のビデオデータ102として撮像するものである。映像解析部217は、撮像部211によって撮像された映像を解析するものである。すなわち、映像解析部217は、映像に含まれる鑑賞者の顔の表情を解析する。この解析結果は、メタデータ103となる。

【0044】

ファイル生成部214は、映像解析部217によって解析された鑑賞者の顔の表情の解析結果(メタデータ103)を含むファイルを所定のファイル形式として生成するものである。

【0045】

書込み部215は、ファイル生成部214によって生成されたファイルを記録媒体219に書き込むものである。記録制御部218は、記録部210における記録媒体219への記録動作を制御するものである。

【0046】

なお、記録媒体219および229としては、ハードディスクなどのディスク状記録媒体やメモリスティックなどの半導体記録媒体を想定することができるが、両者は互いに異なる種類の記録媒体であってもよい。

【0047】

この第2の構成例では、表示部221によって第1のビデオデータ101を再生表示しながら、同時に撮像部211によって鑑賞者の顔の表情を第2のビデオデータ102として撮像し、その表情を解析してメタデータ103を生成している。

【0048】

図5は、本発明の実施の形態における映像処理装置110の第2の構成例による使用態様を示す図である。図2(a)では、ビデオカメラ装置520の操作面に再生表示画面が表示されており、その操作面のカメラ522によって鑑賞者505の顔が撮像されている。これにより、ビデオカメラ装置520の内部で鑑賞者505の顔の表情を解析することによって、メタデータを生成することができる。

【0049】

図5(b)のテレビ装置530にはビデオカメラ装置531が接続され、鑑賞者503の顔が撮像されている。これにより、テレビ装置530またはビデオカメラ装置531の内部で鑑賞者503の顔の表情を解析することによって、メタデータを生成することができる。

【0050】

図5(c)のコンピュータ装置540の前面にはカメラ541が設けられ、鑑賞者504の顔が撮像されている。これにより、コンピュータ装置540の内部で鑑賞者504の顔の表情を解析することによって、メタデータを生成することができる。

【0051】

このように、映像処理装置110の第2の構成例では、第1のビデオデータ101の再生と同時に第2のビデオデータ102を撮像して、この第2のビデオデータ102からメタデータ103を生成する。第2のビデオデータ102に含まれる顔の表情には、第1のビデオデータ101の映像に対する何らかの反応が反映されているものと考えられるため、その特徴量をメタデータ103に中間状態として保存しておいて、第1のビデオデータ101の編集に利用しようとするものである。

【0052】

図6は、本発明の実施の形態における映像処理装置110の第3の構成例を示す図である。この第3の構成例では、記録部210に、映像入力部206と、ファイル生成部214と、書込み部215と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。また、再生部220に、映像加工部222と、映像伸張部223と、ファイル復号部224と、読出し部225と、記録媒体229とが備えられている。

【0053】

再生部220の構成は、第2の構成例の場合と同様であるが、表示部221は省かれ、映像加工部222の出力が記録部210にそのまま供給されている点が異なる。

【0054】

記録部210の構成も、第2の構成例の場合と同様であるが、撮像部211の代わりに、再生部220からの映像を入力する映像入力部206を備える点が異なる。

【0055】

すなわち、この第3の構成例では、再生部220によって再生された映像(第1のビデオデータ101)をそのまま記録部210の入力映像(第2のビデオデータ102)として供給して、それに含まれる顔の表情を解析してメタデータ103を生成している。

【0056】

図7は、本発明の実施の形態における映像処理装置110の一実施例であるカメラ一体型撮像装置の構成例を示す図である。この撮像装置は、撮像部301と、映像加工部330と、映像圧縮部341と、圧縮制御部342と、記録媒体アクセス部351と、ドライブ制御部352と、操作受付部360と、表示部370と、システム制御部390とを備えている。

【0057】

撮像部301は、被写体を撮像して映像データとして出力するものである。映像加工部330は、撮像部301から出力された映像データにエフェクト処理を施すものである。映像圧縮部341は、映像加工部330によって加工された映像データを圧縮するものである。圧縮制御部342は、映像圧縮部341における圧縮処理の制御を行うものである。

【0058】

記録媒体アクセス部351は、記録媒体309に対する書込みや読出しを行うものである。ドライブ制御部352は、記録媒体アクセス部351による書込みや読出しを制御するものである。

【0059】

操作受付部360は、ユーザによる操作入力を受け付けるものであり、各種ボタンやGUI(Graphical User Interface)などが想定される。表示部370は、撮像中の映像や再生映像、または、ユーザに対する各種メッセージなどを表示するものである。

【0060】

システム制御部390は、撮像装置の全体を制御するものであり、例えば、マイクロプロセッサなどにより実現され得る。このシステム制御部390は、操作受付部360によって受け付けられた操作入力によって映像の録画の開始、停止や、録画の経過時間情報などを制御するとともに、ユーザに対する表示部370における表示を制御する。また、システム制御部390は、カメラ制御部329や圧縮制御部342との間で情報をやり取りして、ドライブ制御部352を介して記録媒体309に対する書込み制御を行う。

【0061】

また、撮像部301は、ズームレンズ311と、アイリス(絞り)312と、フォーカスレンズ313と、フィルタ314と、撮像素子321と、A/D変換器322と、カメラ信号処理回路323と、検波部324と、ズーム制御部325と、角速度センサ326と、カメラ制御部329とを備えている。

【0062】

ズームレンズ311は、ズーム(拡大)処理を行うためのレンズである。アイリス312は、被写体からの光量を調整するための絞りである。フォーカスレンズ313は、被写体に焦点を合わせるためのレンズである。フィルタ314は、赤外線を除去するためのフィルタである。

【0063】

撮像素子321は、光学レンズ群から供給された光を電気信号に変換する光電変換素子であり、例えば、CCD(Charge Coupled Devices)などにより実現され得る。この撮像素子321により、被写体の画像が、例えばRGB(赤、緑、青)の3原色に相当する3つの映像信号として取り出される。

【0064】

A/D変換器322は、撮像素子321から供給されたアナログの電気信号をデジタル信号に変換するものである。カメラ信号処理回路323は、A/D変換器322により変換されたデジタル信号に対して、白色の基準を定めるホワイトバランスなどの信号処理を施すものである。

【0065】

検波部324は、カメラ信号処理回路323によって信号処理の施された映像信号のフィードバックを受けて、各種の検波処理を行うものである。例えば、自動的に被写体に焦点を合わせるためのオートフォーカス(AF:Auto Focus)検波、自動的に露光を行うためのオートエクスポージャ(AE:Auto Exposure)検波、自動的にホワイトバランスを行うためのオートホワイトバランス(AWB:Auto White Balance)検波などを行うものである。

【0066】

ズーム制御部325は、ユーザからの操作入力などに従ってズームレンズ311を移動させてズーム処理を制御するものである。角速度センサ326は、撮像装置の角速度を検出するものであり、例えば、ジャイロスコープなどにより手ぶれの度合いを検出するものである。

【0067】

カメラ制御部329は、撮像部301の制御を行うものである。例えば、カメラ制御部329は、角速度センサ326において検知された手ぶれに対して手ぶれ補正を行って画質の劣化を低減するように制御を行う。また、カメラ制御部329は、撮像素子321からの映像入力の制御、検波部324における処理の制御、ズーム制御部325における処理の制御などを行う。

【0068】

図8は、QuickTimeファイルフォーマットをベースとしたファイル形式(以下、QuickTimeベースファイル形式という。)の構造例を示す図である。このファイル形式では、ファイルの内容が実データ格納部と、その実データを参照するために必要な場所情報などを格納する管理情報格納部とに分かれている。QuickTimeファイルフォーマットでは、実データ格納部はメディアデータアトム(media data atom、タイプ名:'mdat')と呼ばれ、管理情報格納部はムービーアトム(movie atom、タイプ名:'moov')と呼ばれる。なお、「アトム(atom)」は「ボックス(box)」と表現されることもある。また、ムービーアトムはムービーリソースと表現されることがあり、メディアデータアトムは単にメディアデータまたはムービーデータと表現されることがある。

【0069】

これらメディアデータアトムおよびムービーアトムは、同一のファイルに含まれていてもよく、別ファイルに分かれていてもよい。例えば、図8のように、動画像(V1等)や音声(A1等)のメディアデータを含むメディアデータアトム612と、それを参照するムービーアトム611とを同一のファイル610に格納するようにしてもよく、また、メディアデータアトム612を参照するムービーアトム621を別のファイル620に格納するようにしてもよい。前者の形式を有するファイルは自己内包型ファイルと呼ばれ、後者の形式を有するファイルは外部参照型ファイルと呼ばれる。そのため、ムービーアトムは、外部参照するメディアデータアトムが含まれる外部ファイルの相対パスまたは絶対パスを示す管理情報を格納できるようになっている。

【0070】

メディアデータアトム612には、例えばMPEG1オーディオ(MPEG1 Audio Layer2)に基づく圧縮符号化方式によって符号化されたオーディオデータおよびMPEG2ビデオ(MPEG2 Video)規定に従う圧縮符号化方式によって符号化された画像データが格納される。符号化方式はこれらに限定されるものではなく、例えば、ビデオデータであればモーションJPEG(Motion JPEG)やMJ2(Motion JPEG2000)、MPEG4(MP4)やAVC(Advanced Video Coding:MPEG4-part10)、オーディオデータであればドルビーAC3(Dolby AC3)やATRAC(Adaptive TRansform Acoustic Coding)などでもよく、また、圧縮符号化が施されていないリニアデータを格納することも可能である。

【0071】

図9は、QuickTimeファイルフォーマットにおける階層構造を示す図である。メディアデータアトム('mdat')における実データはサンプル(sample)と呼ばれる最小管理単位に分かれており、このサンプルを任意の個数分集めたものがチャンク(chunk)と呼ばれる。メディアデータアトム('mdat')の管理情報であるムービーアトム('moov')では、サンプルのサイズや、チャンクの先頭格納場所、各サンプルの表示時間等が格納される。

【0072】

ムービーアトム('moov')は、ムービーヘッダアトム('mvhd')と、トラックアトム('trak')等から構成される。

【0073】

ムービーヘッダアトム('mvhd')は、ムービーアトムのヘッダ情報を保持する部分であり、ムービー全体の特徴を示すものである。例えば、ムービー全体の期間や時間スケール、作成日等を項目として含む。

【0074】

トラックアトム('trak')は、サウンド、ビデオ、テキストといった異なるタイプのデータをそれぞれ別のトラックにより格納するものであり、この図では、ビデオのトラックアトムとして、トラックヘッダアトム('tkhd')と、エディットアトム('edts')と、ユーザデータアトム('udta')と、メディアアトム('mdia')とを含んで構成される。また、オーディオのトラックアトムについては省略されているが、ビデオの場合と同様の構成を備えて構成される。

【0075】

トラックヘッダアトム('tkhd')は、トラックアトムのヘッダ情報を保持する部分であり、そのトラックの特徴を示すものである。例えば、ビデオのピクセル数やサウンドの音量、作成日等を項目として含む。

【0076】

エディットアトム('edts')は、トラックの編集情報をエディットリストアトム('elst')として保持するものである。なお、このエディットアトムについては、図27により詳述する。

【0077】

ユーザデータアトム('udta')は、必要に応じてユーザにより定義された任意の情報を含むものである。例えば、ムービーのウィンドウ位置や再生方法、作成情報等を保持することができる。このユーザデータアトムは、ムービーユーザデータをリスト形式により保持する。

【0078】

メディアアトム('mdia')は、そのトラックで実際に用いられる実データに関する情報を格納するものである。すなわち、メディアアトムは、メディア全体に関する情報、メディアデータの取扱いに関する情報、メディアの構成に関する情報等を格納する。実データはサンプル(sample)と呼ばれる最小管理単位に分かれており、このサンプルを任意の個数分集めたものがチャンク(chunk)と呼ばれる。メディアアトムでは、サンプルのサイズや、チャンクの先頭格納場所、各サンプルの表示時間等が格納される。

【0079】

このメディアアトムは、メディアヘッダアトム('mdhd')と、メディアハンドラアトム('hdlr')と、メディア情報アトム('minf')等から構成される。

【0080】

メディアヘッダアトム('mdhd')は、メディアアトムのヘッダ情報を保持する部分であり、メディア全体としての特徴を示すものである。

【0081】

メディアハンドラアトム('hdlr')は、メディア毎の取り扱いに関する情報を保持するものである。

【0082】

メディア情報アトム('minf')は、そのメディアタイプで表現される情報を保持するものである。このメディア情報アトムは、ビデオメディア情報ヘッダアトム('vmhd')と、データハンドラアトム('hdlr')と、データ情報アトム('dinf')と、サンプルテーブルアトム('stbl')等から構成される。

【0083】

ビデオメディア情報ヘッダアトム('vmhd')は、ビデオトラックにおいて、ビデオメディアに関するヘッダ情報を保持するものである。なお、オーディオトラックの場合、サウンドメディアに関するヘッダ情報を保持するサウンドメディア情報ヘッダアトム('smhd')が、ビデオメディアヘッダアトム('vmhd')の代わりに含まれる。

【0084】

データハンドラアトム('hdlr')は、ビデオメディアの取り扱いに関する情報を保持するものである。

【0085】

データ情報アトム('dinf')は、実際に参照する実データの格納先に関する情報を保持するものである。このデータ情報アトムには、参照する実データの格納方法、格納場所、ファイル名に関する情報を保持するデータリファレンスアトム('dref')が含まれる。

【0086】

サンプルテーブルアトム('stbl')は、そのメディアの実データの最小管理単位であるサンプルに関する情報を保持するものである。このサンプルテーブルアトムは、サンプルディスクリプションアトム('stsd')と、時間対サンプルアトム('stss')と、サンプルサイズアトム('stsz')と、サンプル対チャンクアトム('stsc')と、チャンクオフセットアトム('stco')等から構成される。

【0087】

サンプルディスクリプションアトム('stsd')は、各サンプルに関する圧縮方式やその特性に関する情報を保持するものである。時間対サンプルアトム('stss')は、各サンプルと時間との関係を保持するものである。サンプルサイズアトム('stsz')は、各サンプルのデータ量を保持するものである。サンプル対チャンクアトム('stsc')は、チャンクとそのチャンクを構成するサンプルの関係を保持するものである。チャンクオフセットアトム('stco')は、ファイル先頭からの各チャンクの先頭位置までのオフセットを保持するものである。

【0088】

本発明の実施の形態では、第1のビデオデータ101をQuickTimeベースファイル形式により保持するのみならず、メタデータ103もこのQuickTimeベースファイル形式により保持する。これにより、第2のビデオデータ102の特徴量を時間軸で管理しながらメタデータ103に保持することができる。

【0089】

図10は、本発明の実施の形態におけるファイルの保存形式の一例を示す図である。

【0090】

図10(a)は、第1のビデオデータ101を含むビデオファイル630の構成例を示す図である。このビデオファイル630は、第1のビデオデータ101を有するメディアデータ632と、メディアデータ632を管理するムービーリソース631とを備えている。メディアデータ632は、第1のビデオデータ101の各サンプル633を含んでおり、これらはムービーリソース631によって管理される。

【0091】

図10(b)は、メタデータ103を含むメタファイル640の構成例を示す図である。このメタファイル640は、メタデータ103を有するメディアデータ642と、メディアデータ642を管理するムービーリソース641とを備えている。メディアデータ642は、メタデータ103の各サンプル643を含んでおり、これらはムービーリソース641によって管理される。また、ムービーリソース641は、メディアデータ632も外部参照する形式で、同様に一つの時間軸によって管理している。

【0092】

図10(c)は、ビデオファイル630およびメタファイル640によって実現されるビデオトラック650およびメタトラック660の時間軸上の流れを示す図である。ここでは、簡略化のため、ビデオファイル630の映像信号および音声信号のうち、ビデオトラック650のみを図示している。

【0093】

ビデオトラック650では、各サンプル653が時間軸上に並んでいる。また、メタトラック660では、ビデオトラック650のサンプル653と同期して、各サンプル663が時間軸上に並んでいる。例えば、第2のビデオデータ102の時刻t1からt2の区間において笑顔が特徴量として抽出された場合、その旨がメタトラック660の時刻t1からt2の区間において記録される。同様に、第2のビデオデータ102の時刻t3からt4の区間において驚いた顔が特徴量として抽出された場合、その旨がメタトラック660の時刻t3からt4の区間において記録される。

【0094】

すなわち、メタデータ103を示すメタトラック660は、第2のビデオデータ102を介して、第1のビデオデータ101を示すビデオトラック650と同期していることになる。

【0095】

なお、図中では省略されているが、顔の表情の分類上、無表情である区間においては、無表情である旨を示す情報がメタトラック660に記録される。

【0096】

図11は、本発明の実施の形態におけるメタトラックの階層構造の一例を示す図である。このメタトラックは、図9で説明したビデオトラックと基本的に同様の構成を有している。但し、トラック配下にトラックリファレンスアトム('tref')を有し、メディアアトム配下にトラックインプットマップアトム('imap')を有する点でビデオトラックとは異なっている。

【0097】

トラックリファレンスアトム('tref')は、ソーストラック(第1のビデオデータ101)との参照関係を指定するための情報を保持するものである。そのため、トラックリファレンスアトムは、指定対象となるトラックのトラックヘッダアトム('tkhd')に格納されているトラック固有のトラックIDを指定するトラックリファレンスタイプアトム('ssrc')を含む。このトラックリファレンスタイプアトムに含まれるトラックIDの数は、ソーストラックの数と一致する。

【0098】

トラックインプットマップアトム('imap')は、ソーストラックに関する情報を保持するものであり、QuickTimeにおけるQTアトム構造と呼ばれるデータ構造により構成される。このトラックインプットマップアトムには、QTアトムコンテナ('sean')を最上位アトムとするコンテナによってパッキングされたトラックインプットQTアトム(' in')が1つ以上含まれる。このトラックインプットQTアトムの数は、ソーストラックの数と一致する。

【0099】

トラックインプットQTアトム(' in')は、インプットタイプQTアトム(' ty')およびデータソースタイプQTアトム('dtst')を保持する。インプットタイプQTアトム(' ty')は、ソーストラックがビデオメディアであることを指定するものである。また、データソースタイプQTアトム('dtst')は、ソーストラックに対して固有の名称を与えるものである。

【0100】

図12は、本発明の実施の形態におけるメタトラックを含むムービーアトムの記載例を示す図である。この記載例では、ソーストラック(第1のビデオデータ101)としてビデオトラックアトム(video)が1つだけ含まれている。そのため、メタトラックアトムにおけるトラックインプットQTアトム(' in')も1つだけ含まれている。

【0101】

図13は、本発明の実施の形態におけるメタトラックを含むムービーアトムの他の記載例を示す図である。また、図14は、図13のムービーアトムにおけるメタトラックアトムの記載例を示す図である。この記載例では、ソーストラック(第1のビデオデータ101)としてビデオトラックアトムが2つ含まれている(video 1およびvideo 2)。そのため、図14に示すように、メタトラックアトムにおけるトラックインプットQTアトム(' in')も2つ含まれている。

【0102】

図15は、本発明の実施の形態におけるメタトラックのサンプルディスクリプションアトム('stsd')の記載例を示す図である。この記載例では、メタサンプルディスクリプションエントリがM個(Mは1以上の整数)含まれている。このメタサンプルディスクリプションエントリの数は、特徴量の種類の数と一致する。例えば、特徴量の種類として、無表情の顔と笑顔の2種類の分類をするのであれば、メタサンプルディスクリプションエントリの数は2つになる。

【0103】

なお、同図において、かっこ内の数字は各フィールドのバイト数を表す。

【0104】

メタサンプルディスクリプションエントリは、QuickTimeにおけるサンプルディスクリプションエントリに対してストリームディスクリプターアトムを拡張追加した構造になっている。サンプルディスクリプションエントリにおけるデータフォーマット(Data Format)フィールドは、本来、エフェクト効果を指定するためのものである。本発明の実施の形態では、このフィールドを拡張のために用いている。これにより、通常のQuickTimeファイルフォーマットとの間で互換性を維持しながら、拡張を施すことができる。

【0105】

図16は、本発明の実施の形態におけるデータフォーマットフィールドの一例を示す図である。この図に示すように、データフォーマットフィールドは、本来、エフェクト効果を指定するためのものである。同図において、アルファベット小文字で示している種別は、QuickTimeにおいて定義済のエフェクト種別である。例えば、タイプ名'brco'は、明るさを示すブライトネス(brightness)と画像における黒色および白色の幅を示すコントラスト(contrast)とを変化させる効果を指定するものである。

【0106】

一方、アルファベット大文字で示している種別はQuickTimeにおいて定義されていないエフェクト種別である。本発明の実施の形態では、同図最下欄にあるユーザ定義のメタデータであることを示すタイプ名'UDEF'をこのデータフォーマットフィールドで指定することによって、メタデータとして独自拡張された意味を有することを示している。

【0107】

図17は、本発明の実施の形態におけるストリームディスクリプターアトム('strd')の記載例を示す図である。このストリームディスクリプターアトムは、QuickTimeにおける他のアトム構造と同様に、サイズ(Size)、タイプ(Type)、バージョン(Version)およびフラグ群(Flags)の各フィールドを保持している。

【0108】

サイズフィールドは、このサイズフィールドを含むストリームディスクリプターアトム全体の大きさを保持するものである。タイプフィールドは、ストリームディスクリプターアトムのタイプ名として'strd'を保持するものである。バージョンフィールドおよびフラグ群フィールドは、将来の拡張用に確保されているものであり、ここでは全てゼロが設定されるものとする。

【0109】

ストリームディスクリプターアトム('strd')は、以下に説明するように、データフォーマット(Data Format)、ユーザデファインドメタタイプ(User Defined Meta Type)、パラメータフラグ(Parameter Flag)の3つのフィールドをさらに保持している。

【0110】

データフォーマットフィールドは、図16により説明したメタサンプルディスクリプションエントリのデータフォーマットフィールドと形式上同じものを保持するフィールドであり、本発明の実施の形態ではタイプ名'UDEF'を示すことになる。

【0111】

ユーザデファインドメタタイプフィールドは、図18に示すように、2バイトのオーナーID(Owner ID)と2バイトのメタID(Meta ID)とを保持している。オーナーIDは、メーカー毎に割り当てられたIDであり、これにより、各メーカーは、メタIDによって独自の拡張定義を用いることができるようになる。これらオーナーIDおよびメタIDは、データフォーマットフィールドがタイプ名'UDEF'を示す場合にのみ有効になるものである。例えば、メタIDとして、図19に示すように、顔の表情として、笑い(smile)、驚き(surprise)、怒り(angry)、眠い(sleepy)といった種別を表現することができる。

【0112】

なお、オーナーIDおよびメタIDの2つのフィールドに分けて詳細メタデータ種別を定義するのは、メーカー内で閉じて、重複なくメタデータ種別の管理運用を行うためである。仮に、このような区別を設けないと、新規に定義したいメーカー間で名称が重複し、もしくは、申請順番などの管理が煩雑になるおそれがある。そこで、メタサンプルディスクリプションエントリ側のデータフォーマットフィールドにて指定する独自定義メタデータ種別には、'UDEF'として独自定義メタデータ大別であることだけを指示し、詳細な独自拡張定義メタデータ種別はオーナーIDおよびメタIDの両フィールドを組み合わせることによって、どのメーカーが定義したどのようなメタデータ種別かを指示するものである。

【0113】

パラメータフラグフィールドは、メタデータによる効果が有効であるか否かを示すフィールドである。例えば、図20に示すように、16ビットのうちの1ビットを用いて、メタデータによる効果が「有効」であるか「無効」であるかを示す。これにより、ムービーリソース('moov')におけるパラメータフラグフィールドが「無効」を示している場合には、メディアデータ('mdat')をアクセスするまでもなく、メタデータによる効果がないものと判断することができ、処理の負荷を低減することができる。

【0114】

図21は、本発明の実施の形態におけるメタトラックのメディアデータ(メタデータ103)のサンプルの記載例を示す図である。メタトラックのサンプルは、ビデオトラックのサンプルと同様に、サンプル毎にメディアデータアトムに格納される。

【0115】

ここでは、第2のビデオデータ102の対応するサンプルにおいて抽出された顔の数(face_number)と、それぞれの顔についてその表情の度合いを示すことができるようになっている。例えば、笑顔度合い、驚き度合い、怒り度合い、眠さ度合いをそれぞれ示すことができる。

【0116】

図22は、本発明の実施の形態におけるメタデータを含むファイルの階層構造の一例を示す図である。この例では、ソーストラック(第1のビデオデータ101)が1つ(ソーストラック1)だけであることが想定されている。このソーストラック1のムービーリソース('moov')のトラックヘッダアトム('tkhd')には、そのトラックIDである「#1」が保持されている。また、メタトラック(メタデータ103)のムービーリソースのトラックヘッダアトムには、そのトラックIDである「#2」が保持されている。

【0117】

メタトラックのムービーリソースでは、トラックリファレンスアトム('tref')のトラックリファレンスタイプアトム('ssrc')に、ソーストラック1のトラックID「#1」が保持されている。

【0118】

また、メディアアトム('mdia')のトラックインプットマップアトム('imap')には、インプットタイプQTアトム(' ty')としてビデオメディアを表す'vide'が設定され、データソースタイプQTアトム('dtst')としてソーストラック1の名称'srcA'が設定されている。

【0119】

また、メタトラックのムービーリソースにおいて、サンプルディスクリプションアトム('stsd')のメタIDにより、2つの種別「meta_type1」および「meta_type2」が定義されている。

【0120】

この例では、メタトラックのメディアデータ('mdat')において、メタサンプルが4つ設けられている。ソーストラックは1つだけであり、全て同じソーストラック1を示している。また、メタサンプル#1および#3が「meta_type1」を示し、メタサンプル#2および#4が「meta_type2」を示している。

【0121】

図23は、図22の例におけるソーストラック(第1のビデオデータ101)とメタトラック(メタデータ103)との関係を示す図である。この例では、ソーストラックは1つだけであり、全て同じソーストラック1('srcA')を対象としている。

【0122】

ここで、「meta_type2」を特定区間として抽出する場合には、ソーストラックからこの特定区間のみが抽出されることになり、それ以外の区間は不要な区間として扱われる。

【0123】

図24は、本発明の実施の形態におけるメタデータを含むファイルの階層構造の他の例を示す図である。この例では、ソーストラック(第1のビデオデータ101)が2つ(ソーストラック1およびソーストラック2)存在することが想定されている。ソーストラック1のムービーリソース('moov')のトラックヘッダアトム('tkhd')には、そのトラックIDである「#1」が保持されている。ソーストラック2のムービーリソースのトラックヘッダアトム('tkhd')には、そのトラックIDである「#2」が保持されている。また、メタトラック(メタデータ103)のムービーリソースのトラックヘッダアトム('tkhd')には、そのトラックIDである「#3」が保持されている。

【0124】

メタトラックのムービーリソースでは、トラックリファレンスアトム('tref')のトラックリファレンスタイプアトム('ssrc')に、ソーストラック1のトラックID「#1」およびソーストラック2のトラックID「#2」がそれぞれ保持されている。

【0125】

また、メディアアトム('mdia')のトラックインプットマップアトム('imap')には、2つのトラックインプットQTアトム(' in')が含まれており、1つ目のトラックインプットQTアトムには、インプットタイプQTアトム(' ty')としてビデオメディアを表す'vide'が設定され、データソースタイプQTアトム('dtst')としてソーストラック1の名称'srcA'が設定されている。2つ目のトラックインプットQTアトムには、インプットタイプQTアトムとしてビデオメディアを表す'vide'が設定され、データソースタイプQTアトムとしてソーストラック2の名称'srcB'が設定されている。

【0126】

また、メタトラックのムービーリソースにおいて、サンプルディスクリプションアトム('stsd')のメタIDにより、2つの種別「meta_type1」および「meta_type2」が定義されている。

【0127】

この例では、メタトラックのメディアデータ('mdat')において、メタサンプルが4つ設けられている。ソーストラックは2つ存在しており、メタサンプル#1および#2が'srcA'を参照し、メタサンプル#3および#4が'srcB'を参照している。また、メタサンプル#1および#3が「meta_type1」を示し、メタサンプル#2および#4が「meta_type2」を示している。

【0128】

図25は、図24の例におけるソーストラック(第1のビデオデータ101)とメタトラック(メタデータ103)との関係を示す図である。この例では、ソーストラックは2つ存在しており、メタサンプル#1および#2が'srcA'を参照し、メタサンプル#3および#4が'srcB'を参照している。

【0129】

ここで、「meta_type2」を特定区間として抽出する場合には、ソーストラックからこの特定区間のみが抽出されることになり、それ以外の区間は不要な区間として扱われる。

【0130】

図26は、本発明の実施の形態におけるソーストラック(第1のビデオデータ101)およびメタトラック(メタデータ103)と編集トラック(編集ビデオデータ105)との関係例を示す図である。この例では、ソーストラックは、時刻0から始まり、時刻ts6に終了している。また、メタトラックはソーストラックに同期しており、時刻ts1から時刻ts2の区間に笑顔を検出した旨を示し、時刻ts3から時刻ts4の区間に驚いた顔を検出した旨を示し、時刻ts5から時刻ts6の区間に笑顔を検出した旨を示している。

【0131】

また、編集していないムービーファイルにおいては、ソーストラック時間の時間軸はメディア時間の時間軸と一対一対応していることが多いため、ここでは、時刻ts1=時刻tm1、時刻ts2=時刻tm2、時刻ts3=時刻tm3、時刻ts4=時刻tm4、時刻ts5=時刻tm5、時刻ts6=時刻tm6としている。

【0132】

ここで、メタトラックにおいて笑顔または驚いた顔を示す区間を抽出条件としてソーストラックを編集することを想定すると、その出力として図のような編集トラックが生成される。すなわち、ソーストラック時間の時刻ts1から時刻ts2の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻0から時刻te1の区間になり、ソーストラック時間の時刻ts3から時刻ts4の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te1から時刻te2の区間になり、ソーストラック時間の時刻ts5から時刻ts6の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te2から時刻te3の区間になる。

【0133】

図27は、QuickTimeファイルフォーマットにおけるエディットアトム('edts')の記載例を示す図である。このエディットアトムは、図17により説明したストリームディスクリプターアトム('strd')と同様に、サイズ、タイプ、バージョンおよびフラグ群の各フィールドを保持している。このエディットアトムでは、タイプ名として'edts'が保持されている。

【0134】

このエディットアトムは、さらにエディットリストアトム('elst')を保持する。このエディットリストアトムは、エディットアトムと同様に、サイズ、タイプ、バージョンおよびフラグ群の各フィールドを保持している。このエディットリストアトムでは、タイプ名として'elst'が保持されている。エディットリストアトムは、さらにN個(Nは1以上の整数)のエディットリストエントリ(Edit List Entry)と、その数(Number of Entries)とを含んでいる。

【0135】

エディットリストエントリの各々は、セグメント期間(Segment duration)と、メディア時間(Media time)と、メディアレート(Media rate)とを備えている。

【0136】

このエディットアトム('edts')を模式的に表したものが図28である。図28(a)のように、エディットアトム680は、エディットアトム680の大きさを示すサイズ681と、エディットアトムであることを示すタイプ682と、エディットアトムのバージョン683と、未使用のフラグ群694と、エディットリストアトム570とから構成される。

【0137】

エディットリストアトム690は、エディットリストアトム690の大きさを示すサイズ691と、エディットリストアトムであることを示すタイプ692と、エディットリストアトムのバージョン693と、未使用のフラグ群694と、エディットリストテーブル696と、エディットリストテーブル696のエントリ数695とから構成される。

【0138】

エディットリストテーブル696はエントリ数695により示される数のエントリから構成される。図28(b)のようにエディットリストテーブル696の各エントリは、セグメント期間697と、メディア時間698と、メディアレート699とから構成される。セグメント期間697は、対応する編集単位の期間を示す。メディア時間698は、対応する編集単位のメディアデータアトムにおける開始時刻を示す。なお、このメディア時間698が「−1」を示している場合には、対応する編集単位はメディアデータアトムに存在しないことを意味する。メディアレート699は、再生の際の時間比率を示すものであり、メディアデータアトムにおける時間軸と編集後の時間軸とで再生時間が変わらない場合には「1.0」を示すことになる。

【0139】

図29は、図26の例におけるエディットリストアトム('elst')の内容例を示す図である。図29(a)は編集前のエディットリストアトムの内容である。編集前の状態では、エントリは1つだけ存在する。セグメント期間は全期間のts6を示す。メディア時間は先頭時刻の0を示す。また、メディアレート699は、「1.0」である。

【0140】

図29(b)は編集後のエディットリストアトムの内容である。編集後は、3つのエントリが生成される。

【0141】

第1のエントリでは、最初の笑顔の期間te1(=tm2−tm1)を示す。メディア時間は最初の笑顔の先頭時刻tm1を示す。また、メディアレート699は、「1.0」である。

【0142】

第2のエントリでは、驚いた顔の期間te2−te1(=tm4−tm3)を示す。メディア時間は驚いた顔の先頭時刻tm3を示す。また、メディアレート699は、「1.0」である。

【0143】

第3のエントリでは、2回目の笑顔の期間te3−te2(=tm6−tm5)を示す。メディア時間は2回目の笑顔の先頭時刻tm5を示す。また、メディアレート699は、「1.0」である。

【0144】

図30は、本発明の実施の形態におけるソーストラック(第1のビデオデータ101)およびメタトラック(メタデータ103)と編集トラック(編集ビデオデータ105)との他の関係例を示す図である。この例では、ソーストラックおよびメタトラックは図26の例と同様の関係になっている。

【0145】

ここで、メタトラックにおいて笑顔を示す区間を抽出条件としてソーストラックを編集することを想定すると、その出力として図のような編集トラックが生成される。すなわち、ソーストラック時間の時刻ts1から時刻ts2の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻0から時刻te1の区間になり、ソーストラック時間の時刻ts5から時刻ts6の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te1から時刻te2の区間になる。

【0146】

図31は、図30の例におけるエディットリストアトム('elst')の内容例を示す図である。この図は編集後のエディットリストアトムの内容である。編集後は、2つのエントリが生成される。

【0147】

第1のエントリでは、最初の笑顔の期間te1(=tm2−tm1)を示す。メディア時間は最初の笑顔の先頭時刻tm1を示す。また、メディアレート699は、「1.0」である。

【0148】

第2のエントリでは、2回目の笑顔の期間te2−te1(=tm6−tm5)を示す。メディア時間は2回目の笑顔の先頭時刻tm5を示す。また、メディアレート699は、「1.0」である。

【0149】

このようにして生成されたエディットリストアトム(エディットリスト104)は映像抽出部123に供給され、この映像抽出部123においてソーストラック(第1のビデオデータ101)から編集トラック(編集ビデオデータ105)が生成される。すなわち、元のソーストラックを破壊することのない非破壊型編集を実現することができる。

【0150】

次に本発明の実施の形態における映像編集システムの動作について図面を参照して説明する。

【0151】

図32は、本発明の実施の形態における映像処理装置110による処理手順の一例を示す図である。まず、映像取得部111によって、第2のビデオデータ102の映像が取得される(ステップS911)。この第2のビデオデータ102は、第1のビデオデータ101に同期しており、図2の例のように第1のビデオデータ101の撮像と同時に撮像されたものでもよく、図4の例のように第1のビデオデータ101の再生と同時に撮像されたものでもよく、また、図6の例のように第1のビデオデータ101と同一の内容であってもよい。

【0152】

ステップS911で映像が取得されると、取得された第2のビデオデータ102における特徴量が映像解析部112によって解析される(ステップS912)。例えば、特徴量として第2のビデオデータ102に含まれる顔の画像が抽出されて、その顔の表情が判断される。

【0153】

そして、ステップS912において解析された特徴量を時間軸により管理するメタデータ103がメタデータ生成部113によって生成される(ステップS913)。この生成されたメタデータ103は、第1のビデオデータ101の各時刻に対応して、第2のビデオデータ102の特徴量を保持するものである。

【0154】

これらステップS911乃至S913の処理手順は、第2のビデオデータ102の映像が全て処理されるまで繰り返される(ステップS914)。

【0155】

図33は、本発明の実施の形態における映像編集装置120による処理手順の一例を示す図である。まず、抽出条件受付部121によって、抽出条件の入力が受け付けられる(ステップS921)。そして、その抽出条件によってメタデータ103における位置が探索される(ステップS930)。これにより、抽出条件に合致する時系列上の位置が得られ、エディットリスト104として保持される。

【0156】

このエディットリスト104に基づいて、第1のビデオデータ101から抽出条件に合致する時系列上の位置に対応する部分が映像抽出部123によって抽出され、編集ビデオデータ105として出力される(ステップS923)。

【0157】

図34は、図33の位置探索処理(ステップS930)における処理手順の一例を示す図である。まず、メタデータのムービーリソース(図11のメタトラック)が取得される(ステップS931)。そして、このムービーリソースのサンプルディスクリプションアトム('stsd')に含まれるパラメータフラグ(図20参照)によりエフェクトの有効性、すなわち特徴量の記録の有効性が判断される(ステップS932)。

【0158】

ステップS932において「有効」であると判断された場合には、メタデータの対応するメディアデータのサンプルが取得される(ステップS933)。その結果、メタデータのサンプルの示す特徴量が抽出条件と一致していれば(ステップS934)、その該当する区間(セグメント)がエディットリストアトム(エディットリスト104)のエントリとして登録される(ステップS935)。

【0159】

一方、ステップS932において「無効」であると判断された場合には、メタデータのメディアデータは取得されることなく、そのサンプルに関する処理は終了する。

【0160】

これらステップS931乃至S935の処理手順は、メタデータ103のサンプルが全て処理されるまで繰り返される(ステップS936)。

【0161】

このように、本発明の実施の形態によれば、第1のビデオデータ101に同期する第2のビデオデータ102から映像処理装置110によってメタデータ103が生成される。このメタデータ103は、第1のビデオデータ101に同期しており、第2のビデオデータ102の特徴量を時間軸で管理しながら保持するものである。また、本発明の実施の形態によれば、メタデータ103において抽出条件に合致する位置が映像編集装置120の位置探索部122によって探索され、エディットリスト104が生成される。このエディットリスト104に従って、第1のビデオデータ101から映像抽出部123によって映像が抽出され、編集ビデオデータ105が生成される。すなわち、本発明の実施の形態によれば、メタデータ103を中間状態として、第1のビデオデータ101を非破壊的に編集することができる。

【0162】

なお、本発明の実施の形態は本発明を具現化するための一例を示したものであり、以下に示すように特許請求の範囲における発明特定事項とそれぞれ対応関係を有するが、これに限定されるものではなく本発明の要旨を逸脱しない範囲において種々の変形を施すことができる。

【0163】

すなわち、請求項1において、映像取得手段は例えば映像取得部111、撮像部211、216、または、映像入力部206に対応する。また、映像解析手段は例えば映像解析部112または217に対応する。また、メタデータ生成手段は例えばメタデータ生成部113またはファイル生成部214に対応する。

【0164】

また、請求項3において、第1の撮像手段は例えば撮像部211に対応する。また、第2の撮像手段は例えば撮像部216に対応する。

【0165】

また、請求項4において、再生手段は例えば再生部220に対応する。また、撮像手段は例えば撮像部211に対応する。

【0166】

また、請求項5において、再生手段は例えば再生部220に対応する。また、映像入力手段は例えば映像入力部206に対応する。

【0167】

また、請求項7において、位置探索手段は例えば位置探索部122に対応する。また、映像抽出手段は例えば映像抽出部123に対応する。

【0168】

また、請求項9において、映像取得手段は例えば映像取得部111、撮像部211、216、または、映像入力部206に対応する。また、映像解析手段は例えば映像解析部112または217に対応する。また、メタデータ生成手段は例えばメタデータ生成部113またはファイル生成部214に対応する。また、位置探索手段は例えば位置探索部122に対応する。また、映像抽出手段は例えば映像抽出部123に対応する。

【0169】

また、請求項10および11において、映像取得手順は例えばステップS911に対応する。また、映像解析手順は例えばステップS912に対応する。また、メタデータ生成手順は例えばステップS913に対応する。

【0170】

また、請求項12および13において、メタデータ取得手順は例えばステップS933に対応する。また、位置探索手順は例えばステップS934に対応する。また、映像抽出手順は例えばステップS923に対応する。

【0171】

また、請求項14において、第1の映像データは例えば第1のビデオデータ101に対応する。また、第2の映像データは例えば第2のビデオデータ102に対応する。また、メタデータは例えばメタデータ103に対応する。

【0172】

なお、本発明の実施の形態において説明した処理手順は、これら一連の手順を有する方法として捉えてもよく、また、これら一連の手順をコンピュータに実行させるためのプログラム乃至そのプログラムを記憶する記録媒体として捉えてもよい。

【図面の簡単な説明】

【0173】

【図1】本発明の実施の形態における映像編集システム100の一構成例を示す図である。

【図2】本発明の実施の形態における映像処理装置110の第1の構成例を示す図である。

【図3】本発明の実施の形態における映像処理装置110の第1の構成例による使用態様を示す図である。

【図4】本発明の実施の形態における映像処理装置110の第2の構成例を示す図である。

【図5】本発明の実施の形態における映像処理装置110の第2の構成例による使用態様を示す図である。

【図6】本発明の実施の形態における映像処理装置110の第3の構成例を示す図である。

【図7】本発明の実施の形態における映像処理装置110の一実施例であるカメラ一体型撮像装置の構成例を示す図である。

【図8】QuickTimeベースファイル形式の構造例を示す図である。

【図9】QuickTimeファイルフォーマットにおける階層構造を示す図である。

【図10】本発明の実施の形態におけるファイルの保存形式の一例を示す図である。

【図11】本発明の実施の形態におけるメタトラックの階層構造の一例を示す図である。

【図12】本発明の実施の形態におけるメタトラックを含むムービーアトムの記載例を示す図である。

【図13】本発明の実施の形態におけるメタトラックを含むムービーアトムの他の記載例を示す図である。

【図14】図13のムービーアトムにおけるメタトラックアトムの記載例を示す図である。

【図15】本発明の実施の形態におけるメタトラックのサンプルディスクリプションアトム('stsd')の記載例を示す図である。

【図16】本発明の実施の形態におけるデータフォーマットフィールドの一例を示す図である。

【図17】本発明の実施の形態におけるストリームディスクリプターアトム('strd')の記載例を示す図である。

【図18】本発明の実施の形態におけるユーザデファインドメタタイプフィールドの記載例を示す図である。

【図19】本発明の実施の形態におけるメタIDのビットフィールド構成例を示す図である。

【図20】本発明の実施の形態におけるパラメータフラグフィールドのビットフィールド構成例を示す図である。

【図21】本発明の実施の形態におけるメタトラックのメディアデータのサンプルの記載例を示す図である。

【図22】本発明の実施の形態におけるメタデータを含むファイルの階層構造の一例を示す図である。

【図23】図22の例におけるソーストラックとメタトラックとの関係を示す図である。

【図24】本発明の実施の形態におけるメタデータを含むファイルの階層構造の他の例を示す図である。

【図25】図24の例におけるソーストラックとメタトラックとの関係を示す図である。

【図26】本発明の実施の形態におけるソーストラックおよびメタトラックと編集トラックとの関係例を示す図である。

【図27】QuickTimeファイルフォーマットにおけるエディットアトム('edts')の記載例を示す図である。

【図28】QuickTimeファイルフォーマットにおけるエディットアトムを模式的に表した図である。

【図29】図26の例におけるエディットリストアトム('elst')の内容例を示す図である。

【図30】本発明の実施の形態におけるソーストラックおよびメタトラックと編集トラックとの他の関係例を示す図である。

【図31】図30の例におけるエディットリストアトムの内容例を示す図である。

【図32】本発明の実施の形態における映像処理装置110による処理手順の一例を示す図である。

【図33】本発明の実施の形態における映像編集装置120による処理手順の一例を示す図である。

【図34】図33の位置探索処理(ステップS930)における処理手順の一例を示す図である。

【符号の説明】

【0174】

100 映像編集システム

101 第1のビデオデータ

102 第2のビデオデータ

103 メタデータ

104 エディットリスト

105 編集ビデオデータ

110 映像処理装置

111 映像取得部

112 映像解析部

113 メタデータ生成部

120 映像編集装置

121 抽出条件受付部

122 位置探索部

123 映像抽出部

206 映像入力部

210 記録部

211 撮像部

212 映像加工部

213 映像圧縮部

214 ファイル生成部

215 書込み部

216 撮像部

217 映像解析部

218 記録制御部

219 記録媒体

220 再生部

221 表示部

222 映像加工部

223 映像伸張部

224 ファイル復号部

225 読出し部

229 記録媒体

301 撮像部

309 記録媒体

311 ズームレンズ

312 アイリス

313 フォーカスレンズ

314 フィルタ

321 撮像素子

322 A/D変換器

323 カメラ信号処理回路

324 検波部

325 ズーム制御部

326 角速度センサ

329 カメラ制御部

330 映像加工部

341 映像圧縮部

342 圧縮制御部

351 記録媒体アクセス部

352 ドライブ制御部

360 操作受付部

370 表示部

390 システム制御部

501 被写体

502 撮影者

503〜505 鑑賞者

510 ネットワーク

520、531 ビデオカメラ装置

521、522、541 カメラ

530 テレビ装置

540 コンピュータ装置

【技術分野】

【0001】

本発明は、映像編集システムに関し、特に映像データにおける特徴量を示すメタデータを生成する映像編集システム、映像処理装置、または、そのメタデータに基づいて映像データを編集する映像編集装置、これらにおける処理方法ならびに当該方法をコンピュータに実行させるプログラムおよびこれらに用いられるデータ構造に関する。

【背景技術】

【0002】

記録再生装置における記録形式の一つとして、QuickTimeファイルフォーマットが知られている。このQuickTimeファイルフォーマットは、マルチメディアデータを扱うためのファイルフォーマットであり、映像データ(ビデオデータおよびオーディオデータ)の実データをメディアデータアトム(ムービーデータともいう。)に保持して、その管理情報をムービーアトム(ムービーリソースともいう。)に保持する。これにより、実データに直接手を加えることなく、映像データを"非破壊的に"編集できるようになっている。このQuickTimeファイルフォーマットをベースとしたファイルフォーマットには、ISOベースメディア(ISO Base Media)ファイルフォーマット、そのアプリケーションフォーマットであるMPEG4(MP4)ファイルフォーマット、MJ2(Motion JPEG2000)ファイルフォーマット、AVC(Advanced Video Coding:MPEG4-part10)ファイルフォーマットなどがある。

【0003】

このような実データ格納部と管理情報格納部に分かれた形式のファイルフォーマットにおいては、オリジナルデータを外部から参照して、再生上の時間軸管理を行うエディットアトムと呼ばれるデータ構造により編集を行う方法が知られている。例えば、そのようなエディットアトムを用いて、記録中の映像に対して非破壊的にマークを付与する映像記録装置が提案されている(例えば、特許文献1参照。)。

【特許文献1】特開2005−303943号公報(図5)

【発明の開示】

【発明が解決しようとする課題】

【0004】

しかしながら、エディットアトムにより構成されるムービーファイルでは、最終的な編集結果が1つだけ保存されるに留まり、他の条件で編集を行うためには最初から処理をやり直さなければならない。例えば、映像データもしくはその映像データに同期する他の映像データにおける何らかの特徴量を解析して、その解析結果に基づいて編集を行う場合、編集条件を変えるたびに特徴量の解析からやり直すことになり、処理効率上の問題がある。

【0005】

そこで、本発明は、映像データもしくはその映像データに同期する他の映像データについて、その特徴量を映像データに同期して保持するメタデータを生成し、または、そのメタデータに基づいて映像データを編集することを目的とする。

【課題を解決するための手段】

【0006】

本発明は、上記課題を解決するためになされたものであり、その第1の側面は、時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、上記第2の映像データにおける特徴量を解析する映像解析手段と、上記第1の映像データと同期して上記特徴量を保持するメタデータを生成するメタデータ生成手段とを具備することを特徴とする映像処理装置である。これにより、第1の映像データに同期した第2の映像データの特徴量を、第1の映像データに同期するメタデータに保持させるという作用をもたらす。

【0007】

また、この第1の側面において、上記特徴量は、上記第2の映像データに含まれる顔の表情であってもよい。顔の表情として、笑い、驚き、怒り、眠いといった種別を表現することができる。

【0008】

また、この第1の側面において、上記第1の映像データを撮像する第1の撮像手段をさらに具備し、上記映像取得手段は、上記第1の映像データの撮像と同時に上記第2の映像データを撮像する第2の撮像手段を含んでもよい。これにより、撮像されている第1の映像データに関する映像を第2の映像データとして撮像させるという作用をもたらす。

【0009】

また、この第1の側面において、上記第1の映像データを再生する再生手段をさらに具備し、上記映像取得手段は、上記再生手段による上記第1の映像データの再生と同時に上記第2の映像データを撮像する撮像手段を含んでもよい。これにより、再生されている第1の映像データに関する映像を第2の映像データとして撮像させるという作用をもたらす。

【0010】

また、この第1の側面において、上記第1の映像データを再生する再生手段をさらに具備し、上記映像取得手段は、上記再生手段により再生された上記第1の映像データを上記第2の映像データとして入力する映像入力手段を含んでもよい。これにより、再生されている第1の映像データをそのまま第2の映像データとして入力させるという作用をもたらす。

【0011】

なお、この第1の側面において、上記第1の映像データおよび上記メタデータは、QuickTimeフォーマットにおけるメディアデータアトムの形式で記録されてもよい。

【0012】

また、本発明の第2の側面は、時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得した後に所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出する映像抽出手段とを具備することを特徴とする映像編集装置である。これにより、メタデータに含まれる特徴量が所定の条件に合致する時系列上の位置について、第1の映像データの対応する部分を抽出して、非破壊的に編集させるという作用をもたらす。

【0013】

また、この第2の側面において、上記位置探索手段は、上記メタデータを管理する管理情報を取得して、上記管理情報が上記メタデータに上記特徴量は保持されない旨を示している場合には上記メタデータを取得しないようにしてもよい。これにより、無意味なメタデータへのアクセスを回避させるという作用をもたらす。

【0014】

また、本発明の第3の側面は、時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、上記第2の映像データにおける特徴量を解析する映像解析手段と、上記第1の映像データと同期して上記特徴量を保持するメタデータを生成するメタデータ生成手段と、上記メタデータから所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出する映像抽出手段とを具備することを特徴とする映像編集システムである。これにより、第2の映像データの特徴量を保持するメタデータを中間状態として、第1の映像データを非破壊的に編集させるという作用をもたらす。

【0015】

また、本発明の第4の側面は、時系列に管理される第1の映像データと、上記第1の映像データに同期した第2の映像データにおける特徴量を上記第1の映像データと同期して保持するメタデータとを具備するデータ構造であって、コンピュータが、上記メタデータを取得して、上記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成して、上記探索情報に基づいて上記第1の映像データから上記合致する時系列上の位置に対応する部分を抽出することを特徴とするデータ構造である。これにより、第1の映像データの編集のための中間状態としてメタデータを保持させるという作用をもたらす。

【発明の効果】

【0016】

本発明によれば、映像データもしくはその映像データに同期する他の映像データについて、その特徴量を映像データに同期して保持するメタデータを生成し、または、そのメタデータに基づいて映像データを編集することができるという優れた効果を奏し得る。

【発明を実施するための最良の形態】

【0017】

次に本発明の実施の形態について図面を参照して詳細に説明する。

【0018】

図1は、本発明の実施の形態における映像編集システム100の一構成例を示す図である。この映像編集システム100は、メタデータ103に基づいて第1のビデオデータ101を編集した編集ビデオデータ105を出力する映像編集装置120と、第2のビデオデータ102の特徴量を解析してメタデータ103を出力する映像処理装置110とを備えている。

【0019】

第1のビデオデータ101および第2のビデオデータ102は、時系列に管理される映像データであり、動画像データに加えて音声データを含んでもよい。第1のビデオデータ101は、映像編集装置120における編集対象となる映像データである。第2のビデオデータ102は、第1のビデオデータ101に同期しており、第1のビデオデータ101の撮像または再生と同時に撮像され得る。また、第1のビデオデータ101および第2のビデオデータ102は、同一の内容であってもよい。

【0020】

メタデータ103は、第1のビデオデータ101に同期しており、第2のビデオデータ102の特徴量を時間軸で管理しながら保持するものである。特徴量としては、後述のように、第2のビデオデータ102に含まれる顔の表情が想定される。

【0021】

映像処理装置110は、映像取得部111と、映像解析部112と、メタデータ生成部113とを備えている。また、映像編集装置120は、抽出条件受付部121と、位置探索部122と、映像抽出部123とを備えている。

【0022】

映像取得部111は、第2のビデオデータ102を取得するものである。この映像取得部111は、映像を光学レンズにより撮像するビデオカメラであってもよく、また、電子信号を入力する入力端子などであってもよい。

【0023】

映像解析部112は、映像取得部111によって取得された第2のビデオデータ102における特徴量を解析するものである。映像解析部112は、例えば、特徴量として第2のビデオデータ102に含まれる顔の画像を抽出して、その顔の表情を判断する。顔の表情を判断する処理手順は公知の技術を使用することができる。例えば、顔画像中の外眼角点を結ぶ線分と口角点を結ぶ線分との比から笑顔の判断をする技術(例えば、特開2005−266984)や、顔の構成要素毎に基準画像と評価ポイントを設けて平均値を算出して被撮影者の表情を判断する技術(例えば、特開2004−46591)等が提案されている。

【0024】

メタデータ生成部113は、映像解析部112によって解析された特徴量を保持するメタデータ103を生成するものである。この生成されたメタデータ103は、第1のビデオデータ101の各時刻に対応して、第2のビデオデータ102の特徴量を保持している。これにより、例えば、第1のビデオデータ101の各時刻において、第2のビデオデータ102にどのような顔の表情が含まれているかを、編集のための中間状態として保持することができる。

【0025】

抽出条件受付部121は、抽出条件の入力を受け付けるものである。例えば、顔の表情を条件とするのであれば、笑顔を抽出するのか、または、驚いた顔を抽出するのか、といった条件を受け付ける。これらの条件は論理積(AND)や論理和(OR)などにより組み合わせた条件にすることができる。

【0026】

位置探索部122は、抽出条件受付部121によって受け付けられた抽出条件によりメタデータ103を探索するものである。これにより、抽出条件に合致する時系列上の位置が得られ、エディットリスト104として保持される。

【0027】

映像抽出部123は、エディットリスト104に基づいて、第1のビデオデータ101から抽出条件に合致する時系列上の位置に対応する部分を抽出して、編集ビデオデータ105に出力するものである。

【0028】

図2は、本発明の実施の形態における映像処理装置110の第1の構成例を示す図である。この第1の構成例では、記録部210に、撮像部211と、映像加工部212と、映像圧縮部213と、ファイル生成部214と、書込み部215と、撮像部216と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。

【0029】

撮像部211は、被写体を第1のビデオデータ101として撮像するものである。映像加工部212は、撮像部211によって撮像された映像に対してエフェクト処理などの加工を施すものである。映像圧縮部213は、映像加工部212によって加工された映像を圧縮するものである。

【0030】

撮像部216は、被写体を撮像している撮影者(もしくは、被写体の様子を鑑賞している鑑賞者)の顔を第2のビデオデータ102として撮像するものである。映像解析部217は、撮像部216によって撮像された映像を解析するものである。すなわち、映像解析部217は、映像に含まれる撮影者の顔の表情を解析する。この解析結果は、メタデータ103となる。

【0031】

ファイル生成部214は、映像圧縮部213によって圧縮された映像(第1のビデオデータ101)および映像解析部217によって解析された撮影者の顔の表情の解析結果(メタデータ103)を含むファイルをそれぞれ所定のファイル形式として生成するものである。

【0032】

書込み部215は、ファイル生成部214によって生成されたファイルを記録媒体219に書き込むものである。記録媒体219としては、ハードディスクなどのディスク状記録媒体やメモリスティックなどの半導体記録媒体を想定することができる。

【0033】

記録制御部218は、記録部210における記録媒体219への記録動作を制御するものである。

【0034】

この第1の構成例では、撮像部211によって被写体を第1のビデオデータ101として撮像しながら、同時に撮像部216によって撮影者の顔の表情を第2のビデオデータ102として撮像し、その表情を解析してメタデータ103を生成している。

【0035】

図3は、本発明の実施の形態における映像処理装置110の第1の構成例による使用態様を示す図である。図3(a)では、ビデオカメラ装置520の前面のカメラ521によって被写体501が撮像されているのと同時に、ビデオカメラ装置520の操作面のカメラ522によって撮影者502の顔が撮像されている。これにより、ビデオカメラ装置520の内部で撮影者502の顔の表情を解析することによって、メタデータを生成することができる。

【0036】

また、ビデオカメラ装置520はネットワーク510に接続されてもよい。このネットワーク510によって、ビデオカメラ装置520の前面のカメラ521によって撮像された被写体501の映像を、図3(b)のテレビ装置530や図3(c)のコンピュータ装置540に配信することができる。

【0037】

図3(b)のテレビ装置530にはビデオカメラ装置531が接続され、鑑賞者503の顔が撮像されている。これにより、テレビ装置530またはビデオカメラ装置531の内部で鑑賞者503の顔の表情を解析することによって、メタデータを生成することができる。

【0038】

図3(c)のコンピュータ装置540の前面にはカメラ541が設けられ、鑑賞者504の顔が撮像されている。これにより、コンピュータ装置540の内部で鑑賞者504の顔の表情を解析することによって、メタデータを生成することができる。

【0039】

このように、映像処理装置110の第1の構成例では、第1のビデオデータ101の撮像と同時に第2のビデオデータ102を撮像して、この第2のビデオデータ102からメタデータ103を生成する。第2のビデオデータ102に含まれる顔の表情には、第1のビデオデータ101の映像に対する何らかの反応が反映されているものと考えられるため、その特徴量をメタデータ103に中間状態として保存しておいて、第1のビデオデータ101の編集に利用しようとするものである。

【0040】

図4は、本発明の実施の形態における映像処理装置110の第2の構成例を示す図である。この第2の構成例では、記録部210に、撮像部211と、ファイル生成部214と、書込み部215と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。また、再生部220に、表示部221と、映像加工部222と、映像伸張部223と、ファイル復号部224と、読出し部225と、記録媒体229とが備えられている。

【0041】

記録媒体229は、第1のビデオデータ101を所定のファイル形式により記録するものである。読出し部225は、第1のビデオデータ101を含むファイルを記録媒体229から読み出すものである。ファイル復号部224は、読出し部225によって読み出されたファイルを復号するものである。映像伸張部223は、ファイル復号部224によって復号されたファイル内の圧縮された映像を伸張するものである。映像加工部222は、映像伸張部223によって伸張された映像に対してエフェクト処理などの加工を施すものである。

【0042】

表示部221は、映像加工部222から出力された映像を表示するものである。これにより、記録媒体229に記録されていた第1のビデオデータ101が表示部221に再生表示される。

【0043】

撮像部211は、被写体を第2のビデオデータ102として撮像するものである。映像解析部217は、撮像部211によって撮像された映像を解析するものである。すなわち、映像解析部217は、映像に含まれる鑑賞者の顔の表情を解析する。この解析結果は、メタデータ103となる。

【0044】

ファイル生成部214は、映像解析部217によって解析された鑑賞者の顔の表情の解析結果(メタデータ103)を含むファイルを所定のファイル形式として生成するものである。

【0045】

書込み部215は、ファイル生成部214によって生成されたファイルを記録媒体219に書き込むものである。記録制御部218は、記録部210における記録媒体219への記録動作を制御するものである。

【0046】

なお、記録媒体219および229としては、ハードディスクなどのディスク状記録媒体やメモリスティックなどの半導体記録媒体を想定することができるが、両者は互いに異なる種類の記録媒体であってもよい。

【0047】

この第2の構成例では、表示部221によって第1のビデオデータ101を再生表示しながら、同時に撮像部211によって鑑賞者の顔の表情を第2のビデオデータ102として撮像し、その表情を解析してメタデータ103を生成している。

【0048】

図5は、本発明の実施の形態における映像処理装置110の第2の構成例による使用態様を示す図である。図2(a)では、ビデオカメラ装置520の操作面に再生表示画面が表示されており、その操作面のカメラ522によって鑑賞者505の顔が撮像されている。これにより、ビデオカメラ装置520の内部で鑑賞者505の顔の表情を解析することによって、メタデータを生成することができる。

【0049】

図5(b)のテレビ装置530にはビデオカメラ装置531が接続され、鑑賞者503の顔が撮像されている。これにより、テレビ装置530またはビデオカメラ装置531の内部で鑑賞者503の顔の表情を解析することによって、メタデータを生成することができる。

【0050】

図5(c)のコンピュータ装置540の前面にはカメラ541が設けられ、鑑賞者504の顔が撮像されている。これにより、コンピュータ装置540の内部で鑑賞者504の顔の表情を解析することによって、メタデータを生成することができる。

【0051】

このように、映像処理装置110の第2の構成例では、第1のビデオデータ101の再生と同時に第2のビデオデータ102を撮像して、この第2のビデオデータ102からメタデータ103を生成する。第2のビデオデータ102に含まれる顔の表情には、第1のビデオデータ101の映像に対する何らかの反応が反映されているものと考えられるため、その特徴量をメタデータ103に中間状態として保存しておいて、第1のビデオデータ101の編集に利用しようとするものである。

【0052】

図6は、本発明の実施の形態における映像処理装置110の第3の構成例を示す図である。この第3の構成例では、記録部210に、映像入力部206と、ファイル生成部214と、書込み部215と、映像解析部217と、記録制御部218と、記録媒体219とが備えられている。また、再生部220に、映像加工部222と、映像伸張部223と、ファイル復号部224と、読出し部225と、記録媒体229とが備えられている。

【0053】

再生部220の構成は、第2の構成例の場合と同様であるが、表示部221は省かれ、映像加工部222の出力が記録部210にそのまま供給されている点が異なる。

【0054】

記録部210の構成も、第2の構成例の場合と同様であるが、撮像部211の代わりに、再生部220からの映像を入力する映像入力部206を備える点が異なる。

【0055】

すなわち、この第3の構成例では、再生部220によって再生された映像(第1のビデオデータ101)をそのまま記録部210の入力映像(第2のビデオデータ102)として供給して、それに含まれる顔の表情を解析してメタデータ103を生成している。

【0056】

図7は、本発明の実施の形態における映像処理装置110の一実施例であるカメラ一体型撮像装置の構成例を示す図である。この撮像装置は、撮像部301と、映像加工部330と、映像圧縮部341と、圧縮制御部342と、記録媒体アクセス部351と、ドライブ制御部352と、操作受付部360と、表示部370と、システム制御部390とを備えている。

【0057】

撮像部301は、被写体を撮像して映像データとして出力するものである。映像加工部330は、撮像部301から出力された映像データにエフェクト処理を施すものである。映像圧縮部341は、映像加工部330によって加工された映像データを圧縮するものである。圧縮制御部342は、映像圧縮部341における圧縮処理の制御を行うものである。

【0058】

記録媒体アクセス部351は、記録媒体309に対する書込みや読出しを行うものである。ドライブ制御部352は、記録媒体アクセス部351による書込みや読出しを制御するものである。

【0059】

操作受付部360は、ユーザによる操作入力を受け付けるものであり、各種ボタンやGUI(Graphical User Interface)などが想定される。表示部370は、撮像中の映像や再生映像、または、ユーザに対する各種メッセージなどを表示するものである。

【0060】

システム制御部390は、撮像装置の全体を制御するものであり、例えば、マイクロプロセッサなどにより実現され得る。このシステム制御部390は、操作受付部360によって受け付けられた操作入力によって映像の録画の開始、停止や、録画の経過時間情報などを制御するとともに、ユーザに対する表示部370における表示を制御する。また、システム制御部390は、カメラ制御部329や圧縮制御部342との間で情報をやり取りして、ドライブ制御部352を介して記録媒体309に対する書込み制御を行う。

【0061】

また、撮像部301は、ズームレンズ311と、アイリス(絞り)312と、フォーカスレンズ313と、フィルタ314と、撮像素子321と、A/D変換器322と、カメラ信号処理回路323と、検波部324と、ズーム制御部325と、角速度センサ326と、カメラ制御部329とを備えている。

【0062】

ズームレンズ311は、ズーム(拡大)処理を行うためのレンズである。アイリス312は、被写体からの光量を調整するための絞りである。フォーカスレンズ313は、被写体に焦点を合わせるためのレンズである。フィルタ314は、赤外線を除去するためのフィルタである。

【0063】

撮像素子321は、光学レンズ群から供給された光を電気信号に変換する光電変換素子であり、例えば、CCD(Charge Coupled Devices)などにより実現され得る。この撮像素子321により、被写体の画像が、例えばRGB(赤、緑、青)の3原色に相当する3つの映像信号として取り出される。

【0064】

A/D変換器322は、撮像素子321から供給されたアナログの電気信号をデジタル信号に変換するものである。カメラ信号処理回路323は、A/D変換器322により変換されたデジタル信号に対して、白色の基準を定めるホワイトバランスなどの信号処理を施すものである。

【0065】

検波部324は、カメラ信号処理回路323によって信号処理の施された映像信号のフィードバックを受けて、各種の検波処理を行うものである。例えば、自動的に被写体に焦点を合わせるためのオートフォーカス(AF:Auto Focus)検波、自動的に露光を行うためのオートエクスポージャ(AE:Auto Exposure)検波、自動的にホワイトバランスを行うためのオートホワイトバランス(AWB:Auto White Balance)検波などを行うものである。

【0066】

ズーム制御部325は、ユーザからの操作入力などに従ってズームレンズ311を移動させてズーム処理を制御するものである。角速度センサ326は、撮像装置の角速度を検出するものであり、例えば、ジャイロスコープなどにより手ぶれの度合いを検出するものである。

【0067】

カメラ制御部329は、撮像部301の制御を行うものである。例えば、カメラ制御部329は、角速度センサ326において検知された手ぶれに対して手ぶれ補正を行って画質の劣化を低減するように制御を行う。また、カメラ制御部329は、撮像素子321からの映像入力の制御、検波部324における処理の制御、ズーム制御部325における処理の制御などを行う。

【0068】

図8は、QuickTimeファイルフォーマットをベースとしたファイル形式(以下、QuickTimeベースファイル形式という。)の構造例を示す図である。このファイル形式では、ファイルの内容が実データ格納部と、その実データを参照するために必要な場所情報などを格納する管理情報格納部とに分かれている。QuickTimeファイルフォーマットでは、実データ格納部はメディアデータアトム(media data atom、タイプ名:'mdat')と呼ばれ、管理情報格納部はムービーアトム(movie atom、タイプ名:'moov')と呼ばれる。なお、「アトム(atom)」は「ボックス(box)」と表現されることもある。また、ムービーアトムはムービーリソースと表現されることがあり、メディアデータアトムは単にメディアデータまたはムービーデータと表現されることがある。

【0069】

これらメディアデータアトムおよびムービーアトムは、同一のファイルに含まれていてもよく、別ファイルに分かれていてもよい。例えば、図8のように、動画像(V1等)や音声(A1等)のメディアデータを含むメディアデータアトム612と、それを参照するムービーアトム611とを同一のファイル610に格納するようにしてもよく、また、メディアデータアトム612を参照するムービーアトム621を別のファイル620に格納するようにしてもよい。前者の形式を有するファイルは自己内包型ファイルと呼ばれ、後者の形式を有するファイルは外部参照型ファイルと呼ばれる。そのため、ムービーアトムは、外部参照するメディアデータアトムが含まれる外部ファイルの相対パスまたは絶対パスを示す管理情報を格納できるようになっている。

【0070】

メディアデータアトム612には、例えばMPEG1オーディオ(MPEG1 Audio Layer2)に基づく圧縮符号化方式によって符号化されたオーディオデータおよびMPEG2ビデオ(MPEG2 Video)規定に従う圧縮符号化方式によって符号化された画像データが格納される。符号化方式はこれらに限定されるものではなく、例えば、ビデオデータであればモーションJPEG(Motion JPEG)やMJ2(Motion JPEG2000)、MPEG4(MP4)やAVC(Advanced Video Coding:MPEG4-part10)、オーディオデータであればドルビーAC3(Dolby AC3)やATRAC(Adaptive TRansform Acoustic Coding)などでもよく、また、圧縮符号化が施されていないリニアデータを格納することも可能である。

【0071】

図9は、QuickTimeファイルフォーマットにおける階層構造を示す図である。メディアデータアトム('mdat')における実データはサンプル(sample)と呼ばれる最小管理単位に分かれており、このサンプルを任意の個数分集めたものがチャンク(chunk)と呼ばれる。メディアデータアトム('mdat')の管理情報であるムービーアトム('moov')では、サンプルのサイズや、チャンクの先頭格納場所、各サンプルの表示時間等が格納される。

【0072】

ムービーアトム('moov')は、ムービーヘッダアトム('mvhd')と、トラックアトム('trak')等から構成される。

【0073】

ムービーヘッダアトム('mvhd')は、ムービーアトムのヘッダ情報を保持する部分であり、ムービー全体の特徴を示すものである。例えば、ムービー全体の期間や時間スケール、作成日等を項目として含む。

【0074】

トラックアトム('trak')は、サウンド、ビデオ、テキストといった異なるタイプのデータをそれぞれ別のトラックにより格納するものであり、この図では、ビデオのトラックアトムとして、トラックヘッダアトム('tkhd')と、エディットアトム('edts')と、ユーザデータアトム('udta')と、メディアアトム('mdia')とを含んで構成される。また、オーディオのトラックアトムについては省略されているが、ビデオの場合と同様の構成を備えて構成される。

【0075】

トラックヘッダアトム('tkhd')は、トラックアトムのヘッダ情報を保持する部分であり、そのトラックの特徴を示すものである。例えば、ビデオのピクセル数やサウンドの音量、作成日等を項目として含む。

【0076】

エディットアトム('edts')は、トラックの編集情報をエディットリストアトム('elst')として保持するものである。なお、このエディットアトムについては、図27により詳述する。

【0077】

ユーザデータアトム('udta')は、必要に応じてユーザにより定義された任意の情報を含むものである。例えば、ムービーのウィンドウ位置や再生方法、作成情報等を保持することができる。このユーザデータアトムは、ムービーユーザデータをリスト形式により保持する。

【0078】

メディアアトム('mdia')は、そのトラックで実際に用いられる実データに関する情報を格納するものである。すなわち、メディアアトムは、メディア全体に関する情報、メディアデータの取扱いに関する情報、メディアの構成に関する情報等を格納する。実データはサンプル(sample)と呼ばれる最小管理単位に分かれており、このサンプルを任意の個数分集めたものがチャンク(chunk)と呼ばれる。メディアアトムでは、サンプルのサイズや、チャンクの先頭格納場所、各サンプルの表示時間等が格納される。

【0079】

このメディアアトムは、メディアヘッダアトム('mdhd')と、メディアハンドラアトム('hdlr')と、メディア情報アトム('minf')等から構成される。

【0080】

メディアヘッダアトム('mdhd')は、メディアアトムのヘッダ情報を保持する部分であり、メディア全体としての特徴を示すものである。

【0081】

メディアハンドラアトム('hdlr')は、メディア毎の取り扱いに関する情報を保持するものである。

【0082】

メディア情報アトム('minf')は、そのメディアタイプで表現される情報を保持するものである。このメディア情報アトムは、ビデオメディア情報ヘッダアトム('vmhd')と、データハンドラアトム('hdlr')と、データ情報アトム('dinf')と、サンプルテーブルアトム('stbl')等から構成される。

【0083】

ビデオメディア情報ヘッダアトム('vmhd')は、ビデオトラックにおいて、ビデオメディアに関するヘッダ情報を保持するものである。なお、オーディオトラックの場合、サウンドメディアに関するヘッダ情報を保持するサウンドメディア情報ヘッダアトム('smhd')が、ビデオメディアヘッダアトム('vmhd')の代わりに含まれる。

【0084】

データハンドラアトム('hdlr')は、ビデオメディアの取り扱いに関する情報を保持するものである。

【0085】

データ情報アトム('dinf')は、実際に参照する実データの格納先に関する情報を保持するものである。このデータ情報アトムには、参照する実データの格納方法、格納場所、ファイル名に関する情報を保持するデータリファレンスアトム('dref')が含まれる。

【0086】

サンプルテーブルアトム('stbl')は、そのメディアの実データの最小管理単位であるサンプルに関する情報を保持するものである。このサンプルテーブルアトムは、サンプルディスクリプションアトム('stsd')と、時間対サンプルアトム('stss')と、サンプルサイズアトム('stsz')と、サンプル対チャンクアトム('stsc')と、チャンクオフセットアトム('stco')等から構成される。

【0087】

サンプルディスクリプションアトム('stsd')は、各サンプルに関する圧縮方式やその特性に関する情報を保持するものである。時間対サンプルアトム('stss')は、各サンプルと時間との関係を保持するものである。サンプルサイズアトム('stsz')は、各サンプルのデータ量を保持するものである。サンプル対チャンクアトム('stsc')は、チャンクとそのチャンクを構成するサンプルの関係を保持するものである。チャンクオフセットアトム('stco')は、ファイル先頭からの各チャンクの先頭位置までのオフセットを保持するものである。

【0088】

本発明の実施の形態では、第1のビデオデータ101をQuickTimeベースファイル形式により保持するのみならず、メタデータ103もこのQuickTimeベースファイル形式により保持する。これにより、第2のビデオデータ102の特徴量を時間軸で管理しながらメタデータ103に保持することができる。

【0089】

図10は、本発明の実施の形態におけるファイルの保存形式の一例を示す図である。

【0090】

図10(a)は、第1のビデオデータ101を含むビデオファイル630の構成例を示す図である。このビデオファイル630は、第1のビデオデータ101を有するメディアデータ632と、メディアデータ632を管理するムービーリソース631とを備えている。メディアデータ632は、第1のビデオデータ101の各サンプル633を含んでおり、これらはムービーリソース631によって管理される。

【0091】

図10(b)は、メタデータ103を含むメタファイル640の構成例を示す図である。このメタファイル640は、メタデータ103を有するメディアデータ642と、メディアデータ642を管理するムービーリソース641とを備えている。メディアデータ642は、メタデータ103の各サンプル643を含んでおり、これらはムービーリソース641によって管理される。また、ムービーリソース641は、メディアデータ632も外部参照する形式で、同様に一つの時間軸によって管理している。

【0092】

図10(c)は、ビデオファイル630およびメタファイル640によって実現されるビデオトラック650およびメタトラック660の時間軸上の流れを示す図である。ここでは、簡略化のため、ビデオファイル630の映像信号および音声信号のうち、ビデオトラック650のみを図示している。

【0093】

ビデオトラック650では、各サンプル653が時間軸上に並んでいる。また、メタトラック660では、ビデオトラック650のサンプル653と同期して、各サンプル663が時間軸上に並んでいる。例えば、第2のビデオデータ102の時刻t1からt2の区間において笑顔が特徴量として抽出された場合、その旨がメタトラック660の時刻t1からt2の区間において記録される。同様に、第2のビデオデータ102の時刻t3からt4の区間において驚いた顔が特徴量として抽出された場合、その旨がメタトラック660の時刻t3からt4の区間において記録される。

【0094】

すなわち、メタデータ103を示すメタトラック660は、第2のビデオデータ102を介して、第1のビデオデータ101を示すビデオトラック650と同期していることになる。

【0095】

なお、図中では省略されているが、顔の表情の分類上、無表情である区間においては、無表情である旨を示す情報がメタトラック660に記録される。

【0096】

図11は、本発明の実施の形態におけるメタトラックの階層構造の一例を示す図である。このメタトラックは、図9で説明したビデオトラックと基本的に同様の構成を有している。但し、トラック配下にトラックリファレンスアトム('tref')を有し、メディアアトム配下にトラックインプットマップアトム('imap')を有する点でビデオトラックとは異なっている。

【0097】

トラックリファレンスアトム('tref')は、ソーストラック(第1のビデオデータ101)との参照関係を指定するための情報を保持するものである。そのため、トラックリファレンスアトムは、指定対象となるトラックのトラックヘッダアトム('tkhd')に格納されているトラック固有のトラックIDを指定するトラックリファレンスタイプアトム('ssrc')を含む。このトラックリファレンスタイプアトムに含まれるトラックIDの数は、ソーストラックの数と一致する。

【0098】

トラックインプットマップアトム('imap')は、ソーストラックに関する情報を保持するものであり、QuickTimeにおけるQTアトム構造と呼ばれるデータ構造により構成される。このトラックインプットマップアトムには、QTアトムコンテナ('sean')を最上位アトムとするコンテナによってパッキングされたトラックインプットQTアトム(' in')が1つ以上含まれる。このトラックインプットQTアトムの数は、ソーストラックの数と一致する。

【0099】

トラックインプットQTアトム(' in')は、インプットタイプQTアトム(' ty')およびデータソースタイプQTアトム('dtst')を保持する。インプットタイプQTアトム(' ty')は、ソーストラックがビデオメディアであることを指定するものである。また、データソースタイプQTアトム('dtst')は、ソーストラックに対して固有の名称を与えるものである。

【0100】

図12は、本発明の実施の形態におけるメタトラックを含むムービーアトムの記載例を示す図である。この記載例では、ソーストラック(第1のビデオデータ101)としてビデオトラックアトム(video)が1つだけ含まれている。そのため、メタトラックアトムにおけるトラックインプットQTアトム(' in')も1つだけ含まれている。

【0101】

図13は、本発明の実施の形態におけるメタトラックを含むムービーアトムの他の記載例を示す図である。また、図14は、図13のムービーアトムにおけるメタトラックアトムの記載例を示す図である。この記載例では、ソーストラック(第1のビデオデータ101)としてビデオトラックアトムが2つ含まれている(video 1およびvideo 2)。そのため、図14に示すように、メタトラックアトムにおけるトラックインプットQTアトム(' in')も2つ含まれている。

【0102】

図15は、本発明の実施の形態におけるメタトラックのサンプルディスクリプションアトム('stsd')の記載例を示す図である。この記載例では、メタサンプルディスクリプションエントリがM個(Mは1以上の整数)含まれている。このメタサンプルディスクリプションエントリの数は、特徴量の種類の数と一致する。例えば、特徴量の種類として、無表情の顔と笑顔の2種類の分類をするのであれば、メタサンプルディスクリプションエントリの数は2つになる。

【0103】

なお、同図において、かっこ内の数字は各フィールドのバイト数を表す。

【0104】

メタサンプルディスクリプションエントリは、QuickTimeにおけるサンプルディスクリプションエントリに対してストリームディスクリプターアトムを拡張追加した構造になっている。サンプルディスクリプションエントリにおけるデータフォーマット(Data Format)フィールドは、本来、エフェクト効果を指定するためのものである。本発明の実施の形態では、このフィールドを拡張のために用いている。これにより、通常のQuickTimeファイルフォーマットとの間で互換性を維持しながら、拡張を施すことができる。

【0105】

図16は、本発明の実施の形態におけるデータフォーマットフィールドの一例を示す図である。この図に示すように、データフォーマットフィールドは、本来、エフェクト効果を指定するためのものである。同図において、アルファベット小文字で示している種別は、QuickTimeにおいて定義済のエフェクト種別である。例えば、タイプ名'brco'は、明るさを示すブライトネス(brightness)と画像における黒色および白色の幅を示すコントラスト(contrast)とを変化させる効果を指定するものである。

【0106】

一方、アルファベット大文字で示している種別はQuickTimeにおいて定義されていないエフェクト種別である。本発明の実施の形態では、同図最下欄にあるユーザ定義のメタデータであることを示すタイプ名'UDEF'をこのデータフォーマットフィールドで指定することによって、メタデータとして独自拡張された意味を有することを示している。

【0107】

図17は、本発明の実施の形態におけるストリームディスクリプターアトム('strd')の記載例を示す図である。このストリームディスクリプターアトムは、QuickTimeにおける他のアトム構造と同様に、サイズ(Size)、タイプ(Type)、バージョン(Version)およびフラグ群(Flags)の各フィールドを保持している。

【0108】

サイズフィールドは、このサイズフィールドを含むストリームディスクリプターアトム全体の大きさを保持するものである。タイプフィールドは、ストリームディスクリプターアトムのタイプ名として'strd'を保持するものである。バージョンフィールドおよびフラグ群フィールドは、将来の拡張用に確保されているものであり、ここでは全てゼロが設定されるものとする。

【0109】

ストリームディスクリプターアトム('strd')は、以下に説明するように、データフォーマット(Data Format)、ユーザデファインドメタタイプ(User Defined Meta Type)、パラメータフラグ(Parameter Flag)の3つのフィールドをさらに保持している。

【0110】

データフォーマットフィールドは、図16により説明したメタサンプルディスクリプションエントリのデータフォーマットフィールドと形式上同じものを保持するフィールドであり、本発明の実施の形態ではタイプ名'UDEF'を示すことになる。

【0111】

ユーザデファインドメタタイプフィールドは、図18に示すように、2バイトのオーナーID(Owner ID)と2バイトのメタID(Meta ID)とを保持している。オーナーIDは、メーカー毎に割り当てられたIDであり、これにより、各メーカーは、メタIDによって独自の拡張定義を用いることができるようになる。これらオーナーIDおよびメタIDは、データフォーマットフィールドがタイプ名'UDEF'を示す場合にのみ有効になるものである。例えば、メタIDとして、図19に示すように、顔の表情として、笑い(smile)、驚き(surprise)、怒り(angry)、眠い(sleepy)といった種別を表現することができる。

【0112】

なお、オーナーIDおよびメタIDの2つのフィールドに分けて詳細メタデータ種別を定義するのは、メーカー内で閉じて、重複なくメタデータ種別の管理運用を行うためである。仮に、このような区別を設けないと、新規に定義したいメーカー間で名称が重複し、もしくは、申請順番などの管理が煩雑になるおそれがある。そこで、メタサンプルディスクリプションエントリ側のデータフォーマットフィールドにて指定する独自定義メタデータ種別には、'UDEF'として独自定義メタデータ大別であることだけを指示し、詳細な独自拡張定義メタデータ種別はオーナーIDおよびメタIDの両フィールドを組み合わせることによって、どのメーカーが定義したどのようなメタデータ種別かを指示するものである。

【0113】

パラメータフラグフィールドは、メタデータによる効果が有効であるか否かを示すフィールドである。例えば、図20に示すように、16ビットのうちの1ビットを用いて、メタデータによる効果が「有効」であるか「無効」であるかを示す。これにより、ムービーリソース('moov')におけるパラメータフラグフィールドが「無効」を示している場合には、メディアデータ('mdat')をアクセスするまでもなく、メタデータによる効果がないものと判断することができ、処理の負荷を低減することができる。

【0114】

図21は、本発明の実施の形態におけるメタトラックのメディアデータ(メタデータ103)のサンプルの記載例を示す図である。メタトラックのサンプルは、ビデオトラックのサンプルと同様に、サンプル毎にメディアデータアトムに格納される。

【0115】

ここでは、第2のビデオデータ102の対応するサンプルにおいて抽出された顔の数(face_number)と、それぞれの顔についてその表情の度合いを示すことができるようになっている。例えば、笑顔度合い、驚き度合い、怒り度合い、眠さ度合いをそれぞれ示すことができる。

【0116】

図22は、本発明の実施の形態におけるメタデータを含むファイルの階層構造の一例を示す図である。この例では、ソーストラック(第1のビデオデータ101)が1つ(ソーストラック1)だけであることが想定されている。このソーストラック1のムービーリソース('moov')のトラックヘッダアトム('tkhd')には、そのトラックIDである「#1」が保持されている。また、メタトラック(メタデータ103)のムービーリソースのトラックヘッダアトムには、そのトラックIDである「#2」が保持されている。

【0117】

メタトラックのムービーリソースでは、トラックリファレンスアトム('tref')のトラックリファレンスタイプアトム('ssrc')に、ソーストラック1のトラックID「#1」が保持されている。

【0118】

また、メディアアトム('mdia')のトラックインプットマップアトム('imap')には、インプットタイプQTアトム(' ty')としてビデオメディアを表す'vide'が設定され、データソースタイプQTアトム('dtst')としてソーストラック1の名称'srcA'が設定されている。

【0119】

また、メタトラックのムービーリソースにおいて、サンプルディスクリプションアトム('stsd')のメタIDにより、2つの種別「meta_type1」および「meta_type2」が定義されている。

【0120】

この例では、メタトラックのメディアデータ('mdat')において、メタサンプルが4つ設けられている。ソーストラックは1つだけであり、全て同じソーストラック1を示している。また、メタサンプル#1および#3が「meta_type1」を示し、メタサンプル#2および#4が「meta_type2」を示している。

【0121】

図23は、図22の例におけるソーストラック(第1のビデオデータ101)とメタトラック(メタデータ103)との関係を示す図である。この例では、ソーストラックは1つだけであり、全て同じソーストラック1('srcA')を対象としている。

【0122】

ここで、「meta_type2」を特定区間として抽出する場合には、ソーストラックからこの特定区間のみが抽出されることになり、それ以外の区間は不要な区間として扱われる。

【0123】

図24は、本発明の実施の形態におけるメタデータを含むファイルの階層構造の他の例を示す図である。この例では、ソーストラック(第1のビデオデータ101)が2つ(ソーストラック1およびソーストラック2)存在することが想定されている。ソーストラック1のムービーリソース('moov')のトラックヘッダアトム('tkhd')には、そのトラックIDである「#1」が保持されている。ソーストラック2のムービーリソースのトラックヘッダアトム('tkhd')には、そのトラックIDである「#2」が保持されている。また、メタトラック(メタデータ103)のムービーリソースのトラックヘッダアトム('tkhd')には、そのトラックIDである「#3」が保持されている。

【0124】

メタトラックのムービーリソースでは、トラックリファレンスアトム('tref')のトラックリファレンスタイプアトム('ssrc')に、ソーストラック1のトラックID「#1」およびソーストラック2のトラックID「#2」がそれぞれ保持されている。

【0125】

また、メディアアトム('mdia')のトラックインプットマップアトム('imap')には、2つのトラックインプットQTアトム(' in')が含まれており、1つ目のトラックインプットQTアトムには、インプットタイプQTアトム(' ty')としてビデオメディアを表す'vide'が設定され、データソースタイプQTアトム('dtst')としてソーストラック1の名称'srcA'が設定されている。2つ目のトラックインプットQTアトムには、インプットタイプQTアトムとしてビデオメディアを表す'vide'が設定され、データソースタイプQTアトムとしてソーストラック2の名称'srcB'が設定されている。

【0126】

また、メタトラックのムービーリソースにおいて、サンプルディスクリプションアトム('stsd')のメタIDにより、2つの種別「meta_type1」および「meta_type2」が定義されている。

【0127】

この例では、メタトラックのメディアデータ('mdat')において、メタサンプルが4つ設けられている。ソーストラックは2つ存在しており、メタサンプル#1および#2が'srcA'を参照し、メタサンプル#3および#4が'srcB'を参照している。また、メタサンプル#1および#3が「meta_type1」を示し、メタサンプル#2および#4が「meta_type2」を示している。

【0128】

図25は、図24の例におけるソーストラック(第1のビデオデータ101)とメタトラック(メタデータ103)との関係を示す図である。この例では、ソーストラックは2つ存在しており、メタサンプル#1および#2が'srcA'を参照し、メタサンプル#3および#4が'srcB'を参照している。

【0129】

ここで、「meta_type2」を特定区間として抽出する場合には、ソーストラックからこの特定区間のみが抽出されることになり、それ以外の区間は不要な区間として扱われる。

【0130】

図26は、本発明の実施の形態におけるソーストラック(第1のビデオデータ101)およびメタトラック(メタデータ103)と編集トラック(編集ビデオデータ105)との関係例を示す図である。この例では、ソーストラックは、時刻0から始まり、時刻ts6に終了している。また、メタトラックはソーストラックに同期しており、時刻ts1から時刻ts2の区間に笑顔を検出した旨を示し、時刻ts3から時刻ts4の区間に驚いた顔を検出した旨を示し、時刻ts5から時刻ts6の区間に笑顔を検出した旨を示している。

【0131】

また、編集していないムービーファイルにおいては、ソーストラック時間の時間軸はメディア時間の時間軸と一対一対応していることが多いため、ここでは、時刻ts1=時刻tm1、時刻ts2=時刻tm2、時刻ts3=時刻tm3、時刻ts4=時刻tm4、時刻ts5=時刻tm5、時刻ts6=時刻tm6としている。

【0132】

ここで、メタトラックにおいて笑顔または驚いた顔を示す区間を抽出条件としてソーストラックを編集することを想定すると、その出力として図のような編集トラックが生成される。すなわち、ソーストラック時間の時刻ts1から時刻ts2の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻0から時刻te1の区間になり、ソーストラック時間の時刻ts3から時刻ts4の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te1から時刻te2の区間になり、ソーストラック時間の時刻ts5から時刻ts6の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te2から時刻te3の区間になる。

【0133】

図27は、QuickTimeファイルフォーマットにおけるエディットアトム('edts')の記載例を示す図である。このエディットアトムは、図17により説明したストリームディスクリプターアトム('strd')と同様に、サイズ、タイプ、バージョンおよびフラグ群の各フィールドを保持している。このエディットアトムでは、タイプ名として'edts'が保持されている。

【0134】

このエディットアトムは、さらにエディットリストアトム('elst')を保持する。このエディットリストアトムは、エディットアトムと同様に、サイズ、タイプ、バージョンおよびフラグ群の各フィールドを保持している。このエディットリストアトムでは、タイプ名として'elst'が保持されている。エディットリストアトムは、さらにN個(Nは1以上の整数)のエディットリストエントリ(Edit List Entry)と、その数(Number of Entries)とを含んでいる。

【0135】

エディットリストエントリの各々は、セグメント期間(Segment duration)と、メディア時間(Media time)と、メディアレート(Media rate)とを備えている。

【0136】

このエディットアトム('edts')を模式的に表したものが図28である。図28(a)のように、エディットアトム680は、エディットアトム680の大きさを示すサイズ681と、エディットアトムであることを示すタイプ682と、エディットアトムのバージョン683と、未使用のフラグ群694と、エディットリストアトム570とから構成される。

【0137】

エディットリストアトム690は、エディットリストアトム690の大きさを示すサイズ691と、エディットリストアトムであることを示すタイプ692と、エディットリストアトムのバージョン693と、未使用のフラグ群694と、エディットリストテーブル696と、エディットリストテーブル696のエントリ数695とから構成される。

【0138】

エディットリストテーブル696はエントリ数695により示される数のエントリから構成される。図28(b)のようにエディットリストテーブル696の各エントリは、セグメント期間697と、メディア時間698と、メディアレート699とから構成される。セグメント期間697は、対応する編集単位の期間を示す。メディア時間698は、対応する編集単位のメディアデータアトムにおける開始時刻を示す。なお、このメディア時間698が「−1」を示している場合には、対応する編集単位はメディアデータアトムに存在しないことを意味する。メディアレート699は、再生の際の時間比率を示すものであり、メディアデータアトムにおける時間軸と編集後の時間軸とで再生時間が変わらない場合には「1.0」を示すことになる。

【0139】

図29は、図26の例におけるエディットリストアトム('elst')の内容例を示す図である。図29(a)は編集前のエディットリストアトムの内容である。編集前の状態では、エントリは1つだけ存在する。セグメント期間は全期間のts6を示す。メディア時間は先頭時刻の0を示す。また、メディアレート699は、「1.0」である。

【0140】

図29(b)は編集後のエディットリストアトムの内容である。編集後は、3つのエントリが生成される。

【0141】

第1のエントリでは、最初の笑顔の期間te1(=tm2−tm1)を示す。メディア時間は最初の笑顔の先頭時刻tm1を示す。また、メディアレート699は、「1.0」である。

【0142】

第2のエントリでは、驚いた顔の期間te2−te1(=tm4−tm3)を示す。メディア時間は驚いた顔の先頭時刻tm3を示す。また、メディアレート699は、「1.0」である。

【0143】

第3のエントリでは、2回目の笑顔の期間te3−te2(=tm6−tm5)を示す。メディア時間は2回目の笑顔の先頭時刻tm5を示す。また、メディアレート699は、「1.0」である。

【0144】

図30は、本発明の実施の形態におけるソーストラック(第1のビデオデータ101)およびメタトラック(メタデータ103)と編集トラック(編集ビデオデータ105)との他の関係例を示す図である。この例では、ソーストラックおよびメタトラックは図26の例と同様の関係になっている。

【0145】

ここで、メタトラックにおいて笑顔を示す区間を抽出条件としてソーストラックを編集することを想定すると、その出力として図のような編集トラックが生成される。すなわち、ソーストラック時間の時刻ts1から時刻ts2の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻0から時刻te1の区間になり、ソーストラック時間の時刻ts5から時刻ts6の区間のソーストラックの部分が、編集トラックにおける編集トラック時間の時刻te1から時刻te2の区間になる。

【0146】

図31は、図30の例におけるエディットリストアトム('elst')の内容例を示す図である。この図は編集後のエディットリストアトムの内容である。編集後は、2つのエントリが生成される。

【0147】

第1のエントリでは、最初の笑顔の期間te1(=tm2−tm1)を示す。メディア時間は最初の笑顔の先頭時刻tm1を示す。また、メディアレート699は、「1.0」である。

【0148】

第2のエントリでは、2回目の笑顔の期間te2−te1(=tm6−tm5)を示す。メディア時間は2回目の笑顔の先頭時刻tm5を示す。また、メディアレート699は、「1.0」である。

【0149】

このようにして生成されたエディットリストアトム(エディットリスト104)は映像抽出部123に供給され、この映像抽出部123においてソーストラック(第1のビデオデータ101)から編集トラック(編集ビデオデータ105)が生成される。すなわち、元のソーストラックを破壊することのない非破壊型編集を実現することができる。

【0150】

次に本発明の実施の形態における映像編集システムの動作について図面を参照して説明する。

【0151】

図32は、本発明の実施の形態における映像処理装置110による処理手順の一例を示す図である。まず、映像取得部111によって、第2のビデオデータ102の映像が取得される(ステップS911)。この第2のビデオデータ102は、第1のビデオデータ101に同期しており、図2の例のように第1のビデオデータ101の撮像と同時に撮像されたものでもよく、図4の例のように第1のビデオデータ101の再生と同時に撮像されたものでもよく、また、図6の例のように第1のビデオデータ101と同一の内容であってもよい。

【0152】

ステップS911で映像が取得されると、取得された第2のビデオデータ102における特徴量が映像解析部112によって解析される(ステップS912)。例えば、特徴量として第2のビデオデータ102に含まれる顔の画像が抽出されて、その顔の表情が判断される。

【0153】

そして、ステップS912において解析された特徴量を時間軸により管理するメタデータ103がメタデータ生成部113によって生成される(ステップS913)。この生成されたメタデータ103は、第1のビデオデータ101の各時刻に対応して、第2のビデオデータ102の特徴量を保持するものである。

【0154】

これらステップS911乃至S913の処理手順は、第2のビデオデータ102の映像が全て処理されるまで繰り返される(ステップS914)。

【0155】

図33は、本発明の実施の形態における映像編集装置120による処理手順の一例を示す図である。まず、抽出条件受付部121によって、抽出条件の入力が受け付けられる(ステップS921)。そして、その抽出条件によってメタデータ103における位置が探索される(ステップS930)。これにより、抽出条件に合致する時系列上の位置が得られ、エディットリスト104として保持される。

【0156】

このエディットリスト104に基づいて、第1のビデオデータ101から抽出条件に合致する時系列上の位置に対応する部分が映像抽出部123によって抽出され、編集ビデオデータ105として出力される(ステップS923)。

【0157】

図34は、図33の位置探索処理(ステップS930)における処理手順の一例を示す図である。まず、メタデータのムービーリソース(図11のメタトラック)が取得される(ステップS931)。そして、このムービーリソースのサンプルディスクリプションアトム('stsd')に含まれるパラメータフラグ(図20参照)によりエフェクトの有効性、すなわち特徴量の記録の有効性が判断される(ステップS932)。

【0158】

ステップS932において「有効」であると判断された場合には、メタデータの対応するメディアデータのサンプルが取得される(ステップS933)。その結果、メタデータのサンプルの示す特徴量が抽出条件と一致していれば(ステップS934)、その該当する区間(セグメント)がエディットリストアトム(エディットリスト104)のエントリとして登録される(ステップS935)。

【0159】

一方、ステップS932において「無効」であると判断された場合には、メタデータのメディアデータは取得されることなく、そのサンプルに関する処理は終了する。

【0160】

これらステップS931乃至S935の処理手順は、メタデータ103のサンプルが全て処理されるまで繰り返される(ステップS936)。

【0161】

このように、本発明の実施の形態によれば、第1のビデオデータ101に同期する第2のビデオデータ102から映像処理装置110によってメタデータ103が生成される。このメタデータ103は、第1のビデオデータ101に同期しており、第2のビデオデータ102の特徴量を時間軸で管理しながら保持するものである。また、本発明の実施の形態によれば、メタデータ103において抽出条件に合致する位置が映像編集装置120の位置探索部122によって探索され、エディットリスト104が生成される。このエディットリスト104に従って、第1のビデオデータ101から映像抽出部123によって映像が抽出され、編集ビデオデータ105が生成される。すなわち、本発明の実施の形態によれば、メタデータ103を中間状態として、第1のビデオデータ101を非破壊的に編集することができる。

【0162】

なお、本発明の実施の形態は本発明を具現化するための一例を示したものであり、以下に示すように特許請求の範囲における発明特定事項とそれぞれ対応関係を有するが、これに限定されるものではなく本発明の要旨を逸脱しない範囲において種々の変形を施すことができる。

【0163】

すなわち、請求項1において、映像取得手段は例えば映像取得部111、撮像部211、216、または、映像入力部206に対応する。また、映像解析手段は例えば映像解析部112または217に対応する。また、メタデータ生成手段は例えばメタデータ生成部113またはファイル生成部214に対応する。

【0164】

また、請求項3において、第1の撮像手段は例えば撮像部211に対応する。また、第2の撮像手段は例えば撮像部216に対応する。

【0165】

また、請求項4において、再生手段は例えば再生部220に対応する。また、撮像手段は例えば撮像部211に対応する。

【0166】

また、請求項5において、再生手段は例えば再生部220に対応する。また、映像入力手段は例えば映像入力部206に対応する。

【0167】

また、請求項7において、位置探索手段は例えば位置探索部122に対応する。また、映像抽出手段は例えば映像抽出部123に対応する。

【0168】

また、請求項9において、映像取得手段は例えば映像取得部111、撮像部211、216、または、映像入力部206に対応する。また、映像解析手段は例えば映像解析部112または217に対応する。また、メタデータ生成手段は例えばメタデータ生成部113またはファイル生成部214に対応する。また、位置探索手段は例えば位置探索部122に対応する。また、映像抽出手段は例えば映像抽出部123に対応する。

【0169】

また、請求項10および11において、映像取得手順は例えばステップS911に対応する。また、映像解析手順は例えばステップS912に対応する。また、メタデータ生成手順は例えばステップS913に対応する。

【0170】

また、請求項12および13において、メタデータ取得手順は例えばステップS933に対応する。また、位置探索手順は例えばステップS934に対応する。また、映像抽出手順は例えばステップS923に対応する。

【0171】

また、請求項14において、第1の映像データは例えば第1のビデオデータ101に対応する。また、第2の映像データは例えば第2のビデオデータ102に対応する。また、メタデータは例えばメタデータ103に対応する。

【0172】

なお、本発明の実施の形態において説明した処理手順は、これら一連の手順を有する方法として捉えてもよく、また、これら一連の手順をコンピュータに実行させるためのプログラム乃至そのプログラムを記憶する記録媒体として捉えてもよい。

【図面の簡単な説明】

【0173】

【図1】本発明の実施の形態における映像編集システム100の一構成例を示す図である。

【図2】本発明の実施の形態における映像処理装置110の第1の構成例を示す図である。

【図3】本発明の実施の形態における映像処理装置110の第1の構成例による使用態様を示す図である。

【図4】本発明の実施の形態における映像処理装置110の第2の構成例を示す図である。

【図5】本発明の実施の形態における映像処理装置110の第2の構成例による使用態様を示す図である。

【図6】本発明の実施の形態における映像処理装置110の第3の構成例を示す図である。

【図7】本発明の実施の形態における映像処理装置110の一実施例であるカメラ一体型撮像装置の構成例を示す図である。

【図8】QuickTimeベースファイル形式の構造例を示す図である。

【図9】QuickTimeファイルフォーマットにおける階層構造を示す図である。

【図10】本発明の実施の形態におけるファイルの保存形式の一例を示す図である。

【図11】本発明の実施の形態におけるメタトラックの階層構造の一例を示す図である。

【図12】本発明の実施の形態におけるメタトラックを含むムービーアトムの記載例を示す図である。

【図13】本発明の実施の形態におけるメタトラックを含むムービーアトムの他の記載例を示す図である。

【図14】図13のムービーアトムにおけるメタトラックアトムの記載例を示す図である。

【図15】本発明の実施の形態におけるメタトラックのサンプルディスクリプションアトム('stsd')の記載例を示す図である。

【図16】本発明の実施の形態におけるデータフォーマットフィールドの一例を示す図である。

【図17】本発明の実施の形態におけるストリームディスクリプターアトム('strd')の記載例を示す図である。

【図18】本発明の実施の形態におけるユーザデファインドメタタイプフィールドの記載例を示す図である。

【図19】本発明の実施の形態におけるメタIDのビットフィールド構成例を示す図である。

【図20】本発明の実施の形態におけるパラメータフラグフィールドのビットフィールド構成例を示す図である。

【図21】本発明の実施の形態におけるメタトラックのメディアデータのサンプルの記載例を示す図である。

【図22】本発明の実施の形態におけるメタデータを含むファイルの階層構造の一例を示す図である。

【図23】図22の例におけるソーストラックとメタトラックとの関係を示す図である。

【図24】本発明の実施の形態におけるメタデータを含むファイルの階層構造の他の例を示す図である。

【図25】図24の例におけるソーストラックとメタトラックとの関係を示す図である。

【図26】本発明の実施の形態におけるソーストラックおよびメタトラックと編集トラックとの関係例を示す図である。

【図27】QuickTimeファイルフォーマットにおけるエディットアトム('edts')の記載例を示す図である。

【図28】QuickTimeファイルフォーマットにおけるエディットアトムを模式的に表した図である。

【図29】図26の例におけるエディットリストアトム('elst')の内容例を示す図である。

【図30】本発明の実施の形態におけるソーストラックおよびメタトラックと編集トラックとの他の関係例を示す図である。

【図31】図30の例におけるエディットリストアトムの内容例を示す図である。

【図32】本発明の実施の形態における映像処理装置110による処理手順の一例を示す図である。

【図33】本発明の実施の形態における映像編集装置120による処理手順の一例を示す図である。

【図34】図33の位置探索処理(ステップS930)における処理手順の一例を示す図である。

【符号の説明】

【0174】

100 映像編集システム

101 第1のビデオデータ

102 第2のビデオデータ

103 メタデータ

104 エディットリスト

105 編集ビデオデータ

110 映像処理装置

111 映像取得部

112 映像解析部

113 メタデータ生成部

120 映像編集装置

121 抽出条件受付部

122 位置探索部

123 映像抽出部

206 映像入力部

210 記録部

211 撮像部

212 映像加工部

213 映像圧縮部

214 ファイル生成部

215 書込み部

216 撮像部

217 映像解析部

218 記録制御部

219 記録媒体

220 再生部

221 表示部

222 映像加工部

223 映像伸張部

224 ファイル復号部

225 読出し部

229 記録媒体

301 撮像部

309 記録媒体

311 ズームレンズ

312 アイリス

313 フォーカスレンズ

314 フィルタ

321 撮像素子

322 A/D変換器

323 カメラ信号処理回路

324 検波部

325 ズーム制御部

326 角速度センサ

329 カメラ制御部

330 映像加工部

341 映像圧縮部

342 圧縮制御部

351 記録媒体アクセス部

352 ドライブ制御部

360 操作受付部

370 表示部

390 システム制御部

501 被写体

502 撮影者

503〜505 鑑賞者

510 ネットワーク

520、531 ビデオカメラ装置

521、522、541 カメラ

530 テレビ装置

540 コンピュータ装置

【特許請求の範囲】

【請求項1】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、

前記第2の映像データにおける特徴量を解析する映像解析手段と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手段と

を具備することを特徴とする映像処理装置。

【請求項2】

前記特徴量は、前記第2の映像データに含まれる顔の表情であることを特徴とする請求項1記載の映像処理装置。

【請求項3】

前記第1の映像データを撮像する第1の撮像手段をさらに具備し、

前記映像取得手段は、前記第1の映像データの撮像と同時に前記第2の映像データを撮像する第2の撮像手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項4】

前記第1の映像データを再生する再生手段をさらに具備し、

前記映像取得手段は、前記再生手段による前記第1の映像データの再生と同時に前記第2の映像データを撮像する撮像手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項5】

前記第1の映像データを再生する再生手段をさらに具備し、

前記映像取得手段は、前記再生手段により再生された前記第1の映像データを前記第2の映像データとして入力する映像入力手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項6】

前記第1の映像データおよび前記メタデータは、QuickTimeフォーマットにおけるメディアデータアトムの形式で記録されることを特徴とする請求項1記載の映像処理装置。

【請求項7】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得した後に所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手段と

を具備することを特徴とする映像編集装置。

【請求項8】

前記位置探索手段は、前記メタデータを管理する管理情報を取得して、前記管理情報が前記メタデータに前記特徴量は保持されない旨を示している場合には前記メタデータを取得しないことを特徴とする請求項7記載の映像編集装置。

【請求項9】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、

前記第2の映像データにおける特徴量を解析する映像解析手段と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手段と、

前記メタデータから所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手段と

を具備することを特徴とする映像編集システム。

【請求項10】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手順と、

前記第2の映像データにおける特徴量を解析する映像解析手順と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手順と

を具備することを特徴とする映像処理方法。

【請求項11】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手順と、

前記第2の映像データにおける特徴量を解析する映像解析手順と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手順と

をコンピュータに実行させることを特徴とするプログラム。

【請求項12】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得するメタデータ取得手順と、

前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手順と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手順と

を具備することを特徴とする映像編集方法。

【請求項13】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得するメタデータ取得手順と、

前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手順と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手順と

をコンピュータに実行させることを特徴とするプログラム。

【請求項14】

時系列に管理される第1の映像データと、

前記第1の映像データに同期した第2の映像データにおける特徴量を前記第1の映像データと同期して保持するメタデータと

を具備するデータ構造であって、

コンピュータが、前記メタデータを取得して、前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成して、前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出することを特徴とするデータ構造。

【請求項1】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、

前記第2の映像データにおける特徴量を解析する映像解析手段と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手段と

を具備することを特徴とする映像処理装置。

【請求項2】

前記特徴量は、前記第2の映像データに含まれる顔の表情であることを特徴とする請求項1記載の映像処理装置。

【請求項3】

前記第1の映像データを撮像する第1の撮像手段をさらに具備し、

前記映像取得手段は、前記第1の映像データの撮像と同時に前記第2の映像データを撮像する第2の撮像手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項4】

前記第1の映像データを再生する再生手段をさらに具備し、

前記映像取得手段は、前記再生手段による前記第1の映像データの再生と同時に前記第2の映像データを撮像する撮像手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項5】

前記第1の映像データを再生する再生手段をさらに具備し、

前記映像取得手段は、前記再生手段により再生された前記第1の映像データを前記第2の映像データとして入力する映像入力手段を含む

ことを特徴とする請求項1記載の映像処理装置。

【請求項6】

前記第1の映像データおよび前記メタデータは、QuickTimeフォーマットにおけるメディアデータアトムの形式で記録されることを特徴とする請求項1記載の映像処理装置。

【請求項7】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得した後に所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手段と

を具備することを特徴とする映像編集装置。

【請求項8】

前記位置探索手段は、前記メタデータを管理する管理情報を取得して、前記管理情報が前記メタデータに前記特徴量は保持されない旨を示している場合には前記メタデータを取得しないことを特徴とする請求項7記載の映像編集装置。

【請求項9】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手段と、

前記第2の映像データにおける特徴量を解析する映像解析手段と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手段と、

前記メタデータから所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手段と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手段と

を具備することを特徴とする映像編集システム。

【請求項10】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手順と、

前記第2の映像データにおける特徴量を解析する映像解析手順と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手順と

を具備することを特徴とする映像処理方法。

【請求項11】

時系列に管理される第1の映像データに同期した第2の映像データを取得する映像取得手順と、

前記第2の映像データにおける特徴量を解析する映像解析手順と、

前記第1の映像データと同期して前記特徴量を保持するメタデータを生成するメタデータ生成手順と

をコンピュータに実行させることを特徴とするプログラム。

【請求項12】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得するメタデータ取得手順と、

前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手順と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手順と

を具備することを特徴とする映像編集方法。

【請求項13】

時系列に管理される第1の映像データに同期した第2の映像データにおける特徴量を保持するメタデータを取得するメタデータ取得手順と、

前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成する位置探索手順と、

前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出する映像抽出手順と

をコンピュータに実行させることを特徴とするプログラム。

【請求項14】

時系列に管理される第1の映像データと、

前記第1の映像データに同期した第2の映像データにおける特徴量を前記第1の映像データと同期して保持するメタデータと

を具備するデータ構造であって、

コンピュータが、前記メタデータを取得して、前記メタデータにおいて所定の条件に合致する時系列上の位置を探索してその結果を探索情報として生成して、前記探索情報に基づいて前記第1の映像データから前記合致する時系列上の位置に対応する部分を抽出することを特徴とするデータ構造。

【図1】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【図21】

【図22】

【図23】

【図24】

【図25】

【図26】

【図27】

【図28】

【図29】

【図30】

【図31】

【図32】

【図33】

【図34】

【図2】

【図3】

【図4】

【図5】

【図6】

【図7】

【図8】

【図9】

【図10】

【図11】

【図12】

【図13】

【図14】

【図15】

【図16】

【図17】

【図18】

【図19】

【図20】

【図21】

【図22】

【図23】

【図24】

【図25】

【図26】

【図27】

【図28】

【図29】

【図30】

【図31】

【図32】

【図33】

【図34】

【公開番号】特開2008−60622(P2008−60622A)

【公開日】平成20年3月13日(2008.3.13)

【国際特許分類】

【出願番号】特願2006−231429(P2006−231429)

【出願日】平成18年8月29日(2006.8.29)

【出願人】(000002185)ソニー株式会社 (34,172)

【Fターム(参考)】

【公開日】平成20年3月13日(2008.3.13)

【国際特許分類】

【出願日】平成18年8月29日(2006.8.29)

【出願人】(000002185)ソニー株式会社 (34,172)

【Fターム(参考)】

[ Back to top ]